Материалы по тегу: ии

|

15.10.2025 [08:43], Руслан Авдеев

Brookfield потратит до $5 млрд на поддержку внедрения твердооксидных топливных элементов Bloom Energy в ИИ ЦОДАмериканский разработчик топливных элементов Bloom Energy заключил соглашение о партнёрстве в области ИИ-инфраструктуры с инвестиционной группой Brookfield. Последняя инвестирует до $5 млрд во внедрение разработанных Bloom твердооксидных топливных элементов (SOFC) в ИИ ЦОД по всему миру, сообщает Datacenter Dynamics. Партнёры сообщили, что уже сотрудничают в проектировании и строительстве ИИ-фабрик по всему, до конца 2025 года они намерены официально объявить о площадке в Европе. Brookfield Asset Management, управляющая активами на сумму более $1 трлн, является крупным инвестором в мировую цифровую и энергетическую инфраструктуру. Её портфолио включает доли в компаниях, занимающихся строительством дата-центров и телеком-инфраструктуры, в том числе Centersquare, Compass, Data4, Ascenty, Digital Connexion и DCI. Это первый договор о партнёрстве Brookfield в рамках стратегии развития ИИ-инфраструктуры, ориентированной на инвестиции в крупные проекты, энергетические мощности, вычислительную инфраструктуру и совместные стратегические инвестиционные проекты. Bloom Energy специализируется на топливных элементах для дата-центров, которые эффективнее традиционного сжигания газообразного топлива и более экобезопасны. Элементы способны работать с природным газом, биогазом и водородом. По словам Bloom Energy, ИИ-фабрики требуют огромных мощностей с возможностью быстрой организации подачи энергии и реагирования на изменение нагрузки в режиме реального времени — такие возможности недоступны традиционным электросетям.

Источник изображения: Bloom Energy В июле Bloom заключила контракт на прямую поставку энергии Oracle — топливные элементы разместят в отдельных дата-центрах. Есть соглашение с Equinix, которое предусматривает развёртывание энергосистем в 19 ЦОД мощностью более 100 МВт. Также заключён договор с энергетической компанией American Electric Power на поставку до 1 ГВт SOFC для автономного энергоснабжения ИИ ЦОД. В последнем финансовом отчёте Bloom объявила, что к концу 2026 года она намерена удвоить производство с 1 ГВт до 2 ГВт в год, это потребует инвестиций в объёме около $100 млн. В июне Bloom Energy заявляла, что к 2030 году более четверти ЦОД в США обзаведутся собственными электростанциями. Прямыми конкурентами в компании считают поставщиков газовых турбин, к которым на рынке ЦОД в последнее время имеется большой интерес. В Bloom уверяют, что в настоящее время элементы требуют сопоставимых с турбинами капитальных затрат, в то же время потребляя на 15–20 % меньше топлива. При этом разрешения на эксплуатацию получить проще, из-за более скромных выбросов. Впрочем, определённые сомнения в экоустойчивости решения всё-таки существуют, поскольку такие ячейки обычно работают также на природном газе из-за высокой стоимости водорода и отсутствия стабильной цепочки его поставок. Это, например, помешало заключить в прошлом году сделку с Amazon (AWS) — гиперскейлер расторг контракт на поставку топливных ячеек для трёх своих ЦОД в Орегоне.

14.10.2025 [20:58], Владимир Мироненко

Oracle анонсировала крупнейший в мире зеттафлопсный ИИ-кластер OCI Zettascale10: до 800 тыс. ускорителей NVIDIA в нескольких ЦОД

800gbe

ethernet

hardware

hpc

nvidia

oracle

oracle cloud infrastructure

stargate

ии

интерконнект

кластер

сша

цод

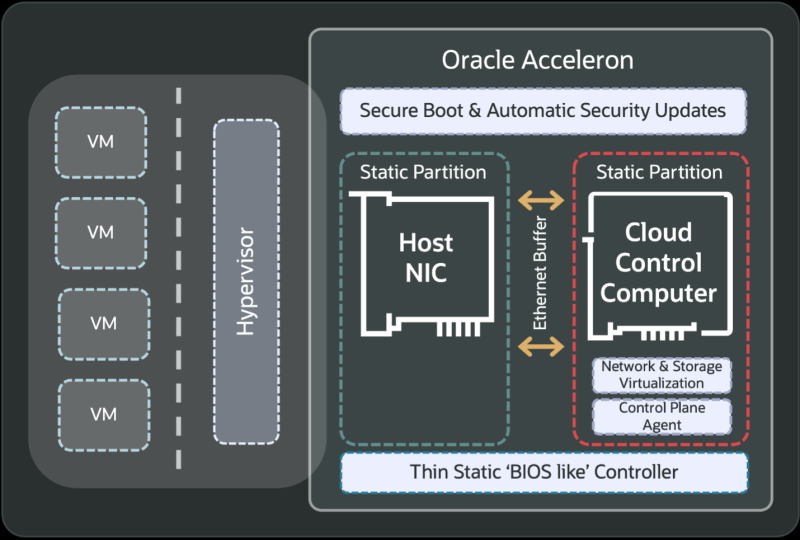

Oracle анонсировала облачный ИИ-кластер OCI Zettascale10 на базе сотен тысяч ускорителей NVIDIA, размещённых в нескольких ЦОД, который имеет пиковую ИИ-производительность 16 Зфлопс (точность вычислений не указана). OCI Zettascale10 — это инфраструктура, на которой базируется флагманский ИИ-суперкластер, созданный совместно с OpenAI в техасском Абилине (Abilene) в рамках проекта Stargate и основанный на сетевой архитектуре Oracle Acceleron RoCE нового поколения. OCI Zettascale10 использует NVIDIA Spectrum-X Ethernet — первую, по словам NVIDIA, Ethernet-платформу, которая обеспечивает высокую масштабируемость, чрезвычайно низкую задержку между ускорителями в кластере, лидирующее в отрасли соотношение цены и производительности, улучшенное использование кластера и надежность, необходимую для крупномасштабных ИИ-задач. Как отметила Oracle, OCI Zettascale10 является «мощным развитием» первого облачного ИИ-кластера Zettascale, который был представлен в сентябре 2024 года. Кластеры OCI Zettascale10 будут располагаться в больших кампусах ЦОД мощностью в гигаватты с высокоплотным размещением в радиусе двух километров, чтобы обеспечить наилучшую задержку между ускорителями для крупномасштабных задач ИИ-обучения. Именно такой подход выбран для кампуса Stargate в Техасе. Oracle отметила, что помимо возможности создавать, обучать и развёртывать крупнейшие ИИ-модели, потребляя меньше энергии на единицу производительности и обеспечивая высокую надёжность, клиенты получат свободу работы в распределённом облаке Oracle со строгим контролем над данными и суверенитетом ИИ. Изначально кластеры OCI Zettascale10 будут рассчитаны на развёртывание до 800 тыс. ускорителей NVIDIA, обеспечивая предсказуемую производительность и высокую экономическую эффективность, а также высокую пропускную способность между ними благодаря RoCEv2-интерконнекту Oracle Acceleron со сверхнизкой задержкой. Acceleron предлагает 400G/800G-подключение со сверхнизкой задержкой, двухуровневую топологию, множественное подключение одного NIC к нескольким коммутатором с физической и логической изоляцией сетевых потоков, поддержку LPO/LRO и гибкость конфигурации. DPU Pensando от AMD в Acceleron место тоже нашлось. OCI уже принимает заказы на OCI Zettascale10, который поступит в продажу во II половине следующего календарного года. В августе NVIDIA анонсировала решение Spectrum-XGS Ethernet для объединения нескольких ЦОД в одну ИИ-суперфабрику, которым, по-видимому, воспользуется не только Oracle, но и Meta✴.

14.10.2025 [19:00], Сергей Карасёв

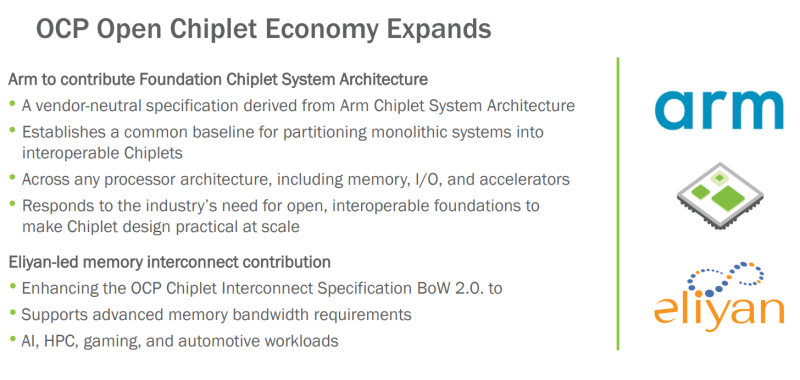

OCP поможет в унификации чиплетов с применением открытых стандартов: Arm и Eliyan поделились наработкамиНекоммерческая организация Open Compute Project Foundation (OCP) сообщила о расширении так называемой «открытой чиплетной экономики» (Open Chiplet Economy). Свои наработки в данной сфере сообществу передали компании Arm и Eliyan. Open Chiplet Economy — это инициатива OCP Server Project Group. Она позволяет разработчикам чиплетов посредством открытого рынка взаимодействовать с производителями продукции. Речь идет о формировании унифицированной экосистемы, за поддержание которой в актуальном состоянии отвечает OCP. В рамках проекта компания Arm передала организации OCP и её участникам архитектуру FCSA (Foundation Chiplet System Architecture), основанную на CSA (Chiplet System Architecture). Она определяет общие базовые стандарты для разделения монолитных систем на чиплеты, которые затем могут использоваться в составе различных изделий, включая память, устройства ввода-вывода и ускорители. Такой подход, как ожидается, упростит создание новых продуктов благодаря повторному использованию уже разработанных блоков. Кроме того, повысится гибкость за счёт отказа от привязки к проприетарным стандартам чиплетов. В свою очередь, Eliyan предоставит сообществу разработки, которые помогут расширить спецификацию интерконнекта для чиплетов OCP BoW 2.0 (Bunch of Wires). В частности, будут добавлены функции для систем, которым требуется высокая пропускная способность: это могут быть приложения ИИ, НРС, игры, автомобильные платформы и пр. Целевым показателем является поддержка скоростей памяти HBM4 (2 Тбайт/с для чтения или записи) вместе с дополнительным каналом связи для сигналов ECC и управления.

14.10.2025 [17:24], Руслан Авдеев

ABB поддержит NVIDIA во внедрении 800 В питания для мегаваттных ИИ-стоекКомпания ABB Group, специализирующаяся на электрификации и автоматизации, объявила об ускоренной разработке новых решений для дата-центров совместно с NVIDIA. В первую очередь речь идёт о создании и внедрении передовых энергетических решений, необходимых для эффективной и масштабируемой подачи энергии, сообщает пресс-служба ABB. ABB будет развивать платформу 800 В DC для мегаваттных серверных стоек. Прогнозируется, что мировой спрос на ЦОД вырастет с 80 ГВт в 2024 году до около 220 ГВт к 2030 году. Капитальные затраты, по мнению экспертов, превысят $1 трлн, сообщает Dell'Oro Group. На рабочие нагрузки ИИ придётся порядка 70 % этого роста. Чтобы эффективно обеспечивать мощность такого уровня, потребуются новые технологии и архитектура распределения электроэнергии. Будущие ЦОД получат комбинацию источника бесперебойного питания среднего напряжения (MV) и систему распределения постоянного тока в серверных с использованием твердотельных преобразователей, заменяющих классические трансформаторы и иные компоненты.

Источник изображения: Frames For Your Heart/unsplash.com В ABB заявляют, что компания возглавляет разработку новых технологий распределения электричества, позволяющих создавать дата-центры нового поколения. Утверждается, что она одной из первых стала инвестировать в новые ИБП, DC-системы и твердотельные компоненты. Портфолио решений ABB для дата-центров включает интеллектуальные системы распределения электроэнергии, специальные решения для резервного питания ЦОД, средства цифрового мониторинга и прочие ключевые технологии, обеспечивающие бесперебойную работу оборудования и оптимизирующие использование энергии для ИИ-серверов. Около 40 % научных исследований ABB в сфере электроснабжения приходится на тематики, имеющие решающее значение для ЦОД нового поколения — это касается работ в области электрической архитектуры, систем защиты, распределения постоянного тока и охлаждения. В конце мая сообщалось, что Infineon Technologies объединит усилия с NVIDIA для разработки централизованной архитектуры высоковольтного питания постоянным током (HVDC) на 800 В для нужд ИИ ЦОД.

14.10.2025 [15:49], Андрей Крупин

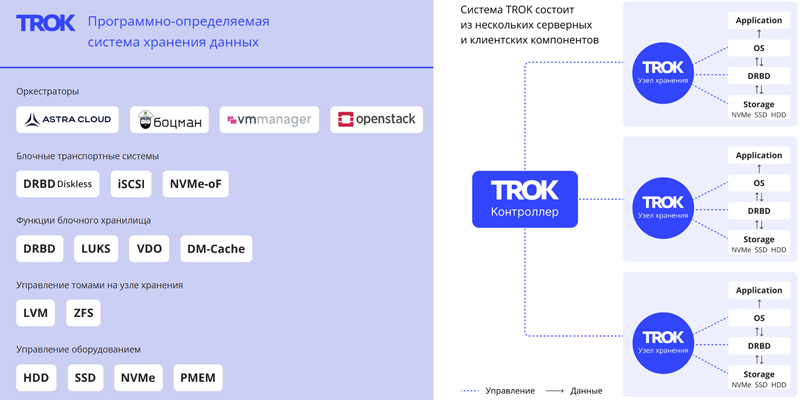

«Группа Астра» представила программно-определяемую систему хранения данных TROK«Группа Астра» объявила о выпуске TROK — российского программно-определяемого хранилища данных (Software-defined storage, SDS), предназначенного для построения отказоустойчивых облачных инфраструктур и корпоративных систем хранения. Система TROK может быть развёрнута на любом типовом сервере с архитектурой x86-64, amd64 или Arm. Решение позволяет управлять виртуальными устройствами, поддерживает разные протоколы доступа (блочный, файловый, объектный), параллельную синхронную репликацию данных между узлами хранения, возможность подключения по iSCSI, NVMEoF Target, NFS и различные механизмы восстановления данных. Доступен API управления хранилищем с поддержкой аутентификации. Продукт интегрирован в экосистему «Группы Астра» и совместим с отечественными платформами, включая ОС Astra Linux и СУБД Tantor.

Источник изображения: trok-sds.ru По заверениям разработчика, TROK подходит для построения частных, гибридных, публичных облаков и обеспечивает снижение совокупной стоимости владения (TCO) до 50 % по сравнению с проприетарными СХД. Стоимость TROK зависит от количества поддерживаемых виртуальных блочных устройств (доступны варианты на 10 Тбайт и 1 Пбайт), типа лицензии (бессрочная или подписка) и срока технической поддержки. Платформа зарегистрирована в реестре отечественного программного обеспечения и полностью подходит для задач импортозамещения.

14.10.2025 [13:26], Руслан Авдеев

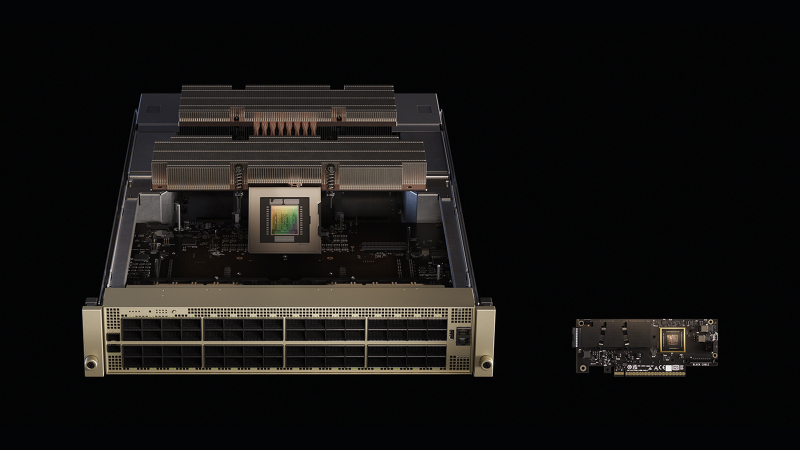

«Нервная система» ИИ-фабрик: Meta✴ и Oracle развернут сетевые платформы NVIDIA Spectrum-X Ethernet в своих ЦОДNVIDIA объявила, что Meta✴ и Oracle развернут в своих ИИ ЦОД Ethernet-платформы NVIDIA Spectrum-X. В NVIDIA подчёркивают, что модели на триллионы параметров трансформируют дата-центры в ИИ-фабрики гигаваттного уровня, а лидеры индустрии стандартизируют использование решений Spectrum-X Ethernet в качестве одного из драйверов промышленной революции. По словам компании, речь идёт не просто о быстром Ethernet, а о «нервной системе» ИИ-фабрик, позволяющей гиперскейлерам объединять миллионы ИИ-ускорителей в гигантские кластеры для обучения крупнейших за всю историю моделей. Oracle намерена строить ИИ-гигафабрики из ускорителей NVIDIA Vera Rubin с интерконнектами Spectrum-X Ethernet. В Oracle подчёркивают, что инфраструктура Oracle Cloud «с нуля» строится для ИИ-задач, и партнёрство с NVIDIA способствует лидерству Oracle в сфере ИИ. Использование Spectrum-X Ethernet позволит клиентам связывать миллионы ускорителей и быстрее обучать, внедрять и пользоваться благами генеративных и «рассуждающих» ИИ нового поколения. Meta✴ намерена интегрировать коммутаторы в свою сетевую инфраструктуру для программной платформы Facebook✴ Open Switching System (FBOSS), как раз разработанной для управления и контроля массивами сетевых коммутаторов. Интеграция решений ускорит масштабное внедрение для повышения эффективности ИИ-проектов. Интеграция NVIDIA Spectrum Ethernet в коммутатор Minipack3N и использование FBOSS позволит повысить эффективность и предсказуемость, необходимые для обучения крупнейших в истории ИИ-моделей и доступа к ИИ-приложениям миллионам людей.

Источник изображения: NVIDIA Платформа NVIDIA Spectrum-X Ethernet включает как собственно коммутаторы Spectrum-X Ethernet, так и адаптеры Spectrum-X Ethernet SuperNIC. Spectrum-X Ethernet уже продемонстрировала рекордную эффективность, позволившую крупнейшему в мире суперкомпьютеру Colossus компании xAI добиться использования 95 % возможной полосы, тогда как обычные Ethernet-платформы обеспечивают лишь 60 %, утверждает NVIDIA.

Источник изображения: Meta✴ В июне сообщалось, что продажи Ethernet-коммутаторов NVIDIA за год выросли на 760 % благодаря росту спроса на ИИ, а в последнем квартале рост составил +98 %. Акции Arista, одного из ключевых поставщиков коммутаторов для Meta✴, упали после анонса NVIDIA и объявления Meta✴, что коммутаторы Minipack3N теперь используют ASIC Spectrum-4 и производятся Accton.

14.10.2025 [12:46], Владимир Мироненко

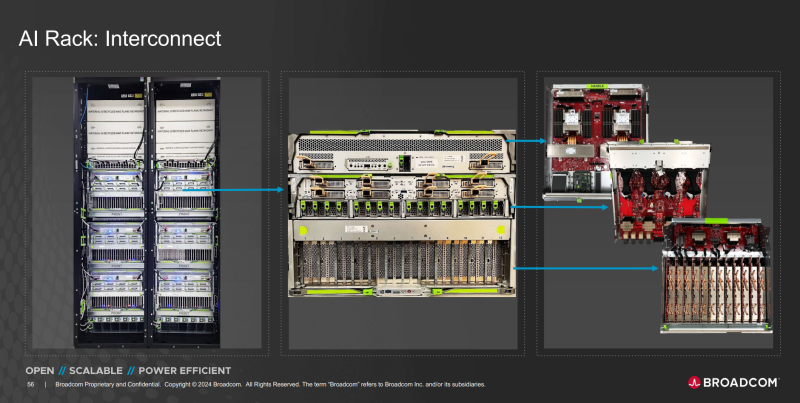

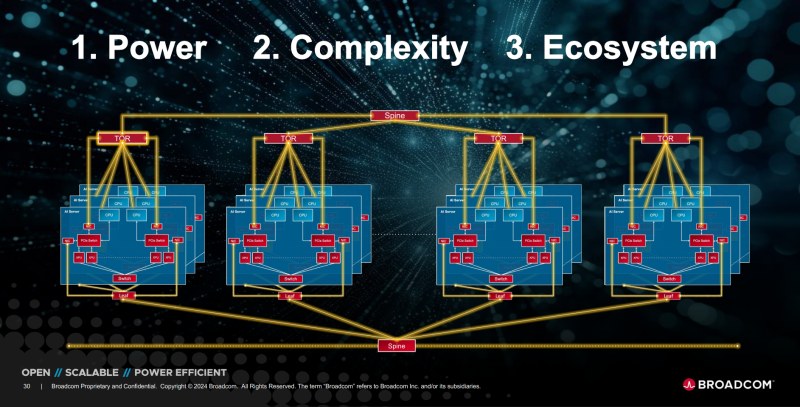

OpenAI и Broadcom совместно разработают и развернут ИИ-ускорители на 10 ГВтOpenAI и Broadcom объявили о заключении соглашения о стратегическом сотрудничестве с целью совместного создания и дальнейшего развёртывания кастомных ИИ-ускорителей общей мощностью 10 ГВт. Речь идёт об вертикально интегрированных решениях уровня стоек и ЦОД. OpenAI отметила в пресс-релизе, что при разработке собственных чипов и систем сможет интегрировать имеющиеся достижения в создании передовых моделей и продуктов непосредственно в аппаратное обеспечение. «Стойки, полностью масштабируемые с использованием Ethernet и других сетевых решений Broadcom, удовлетворят растущий глобальный спрос на ИИ и будут развёрнуты на объектах OpenAI и в партнёрских ЦОД», — сообщила компания. Начало развертывания систем запланировано на II половину 2026 года, а завершение — на конец 2029 года. «Партнёрство с Broadcom — критически важный шаг в создании инфраструктуры, необходимой для раскрытия потенциала ИИ и предоставления реальных преимуществ людям и бизнесу», — заявил Сэм Альтман (Sam Altman), соучредитель и генеральный директор OpenAI. Он отметил, что разработка собственных ускорителей дополняет более широкую экосистему партнёров, которые вместе создают потенциал, «необходимый для расширения возможностей ИИ на благо всего человечества». Чарли Кавас (Charlie Kawwas), президент группы полупроводниковых решений Broadcom сообщил, что кастомные ускорители «прекрасно сочетаются со стандартными сетевыми решениями Ethernet для масштабирования и горизонтального масштабирования», позволяя создать оптимизированную по стоимости и производительности ИИ-инфраструктуру нового поколения. По его словам, стойки будут включать комплексный набор решений Broadcom для Ethernet, PCIe и оптических соединений. Как пишет The Register, президент OpenAI Грег Брокман (Greg Brockman) рассказал, что при разработке ускорителя компания смогла использовать собственные ИИ-модели, которые позволили оптимизировать и ускорить процесс. По его словам, благодаря этому удалось увеличить плотность размещения компонентов. «Вы берёте компоненты, которые уже оптимизированы людьми, просто указываете для них вычислительные мощности, и модель сама предлагает решение», — цитирует Брокмана SiliconANGLE. Компании не уточнили, какие именно продукты Broadcom будут использоваться в рамках партнёрства. Вполне возможно, что это будет анонсированный на прошлой неделе Ethernet-коммутатор TH6-Davisson, оптимизированный для ИИ-кластеров и обеспечивающий пропускную способность до 102,4 Тбит/с, что, по заявлению компании, вдвое превышает показатели изделий ближайшего конкурента. Также Broadcom поставляет линейку PCIe-коммутаторов серии PEX и ретаймеры. Ранее в этом месяце OpenAI заключила соглашение с AMD на поставку ИИ-ускорителей AMD нескольких поколений общей мощностью 6 ГВт для обеспечения своей ИИ-инфраструктуры. По предварительным оценкам, стоимость контракта составляет $60–$80 млрд. В сентябре NVIDIA объявила о соглашении с OpenAI на поставку ускорителей для развёртывания ИИ-инфраструктуры мощностью не менее 10 ГВт с сопутствующими инвестициями в размере $100 млрд. Broadcom в сентябре сообщила о получении заказа от нового клиента на разработку и поставку кастомного ИИ-чипа на сумму более $10 млрд. По мнению аналитиков, речь шла как раз об OpenAI. Создание сети взаимозависимостей означает, что несколько технологических компаний с оборотом в миллиарды долларов кровно заинтересованы в успехе OpenAI, отметил The Register. При этом OpenAI заявляет, что у неё не будет положительного денежного потока ещё четыре года и вместе с тем планирует в течение этого периода значительно увеличить расходы на инфраструктуру ЦОД. Такой подход вызывает опасения у экспертов, заявляющих, что подобные сделки указывают на своего рода пузырь на ИИ-рынке, поскольку компании оперируют такими терминами, как гигаватты и токены, вместо таких «скучных старых терминов», как выручка или доход.

14.10.2025 [10:00], Сергей Карасёв

«Базис» и MIND Software представляют первое в России коробочное HCI-решение для ускорения цифровой трансформации бизнесаКомпании MIND Software и «Базис» объявили о запуске первого в России полностью интегрированного HCI-решения. В его основу легла платформа для управления динамической инфраструктурой Basis Dynamix Standard, в которую встроена распределённая программно-определяемая система хранения данных MIND uStor. Разработанное MIND Software и «Базис» решение позволяет бизнесу создавать гиперконвергентную инфраструктуру (HCI, Hyper Converged Infrastructure), максимально сбалансированную по утилизации аппаратных ресурсов, без избыточных сервисов и точек отказа. Все необходимые для создания инструменты доступны заказчику «из коробки», без сложной настройки и длительного внедрения — для запуска системы достаточно нескольких кликов, и через 15 минут кластер полностью готов к работе. Управление гиперконвергентной инфраструктурой осуществляется из единой панели с графическим интерфейсом. Представленный продукт объединяет преимущества платформы Basis Dynamix Standard, такие как лёгкость развёртывания и гибкость управления, с надёжностью и экономичностью СХД MIND uStor. Новое HCI-решение позволяет значительно сократить время развёртывания ИТ-инфраструктуры и снизить операционные издержки, что особенно актуально для компаний, стремящихся ускорить цифровую трансформацию. Антон Груздев, генеральный директор MIND Software, отметил: «Интеграция MIND uStor и Dynamix Standard позволяет нам сделать современные технологии хранения данных более доступными и простыми во внедрении. Мы стремимся избавить заказчиков от сложностей с настройкой и дать им возможность сразу сосредоточиться на эффективности и масштабировании бизнеса». Дмитрий Сорокин, технический директор компании «Базис», добавил: «Поиск технологических партнёров и новых возможностей для развития продуктов — важная часть стратегии "Базиса". Мы давно и успешно сотрудничаем с MIND, и глубокая интеграция с MIND uStor — логичный шаг в развитии нашей платформы Dynamix Standard. Кроме того, мы видим значительный интерес бизнеса к HCI-платформам с прозрачной архитектурой и высокой степенью автоматизации, а значит, наше сотрудничество принесёт пользу рынку в целом».

14.10.2025 [09:54], Сергей Карасёв

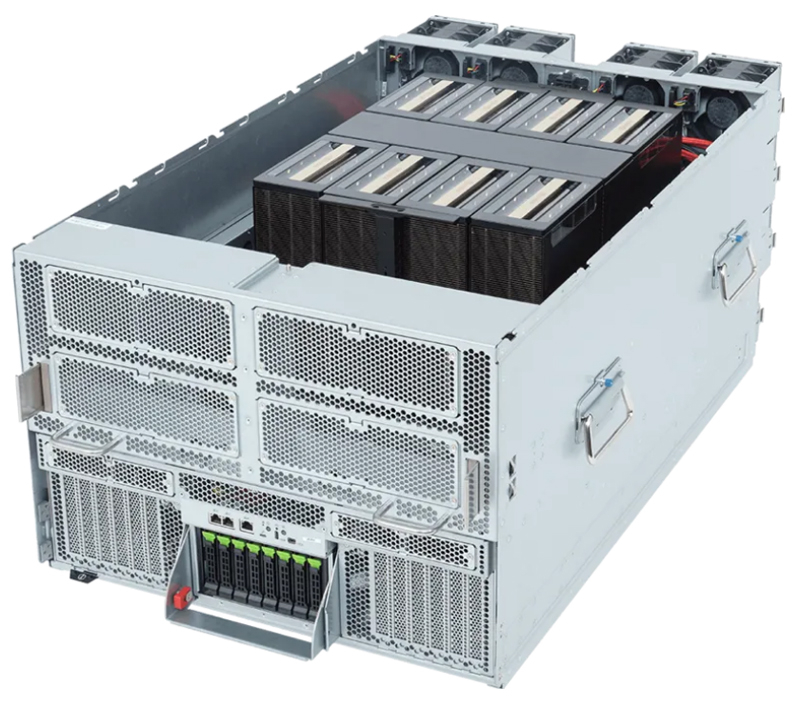

Giga Computing представила ИИ-сервер TO86-SD1 на платформе NVIDIA HGX B200Компания Giga Computing, подразделение Gigabyte, анонсировала высокопроизводительный сервер TO86-SD1 для обучения ИИ-моделей, инференса и ресурсоёмких HPC-задач. Новинка выполнена в форм-факторе 8OU в соответствии со стандартом OCP ORv3. Возможна установка двух процессоров Intel Xeon 6500P/6700P (Granite Rapids-SP) с показателем TDP до 350 Вт. Доступны 32 слота для модулей оперативной памяти DDR5 (RDIMM 6400 или MRDIMM 8000). Во фронтальной части предусмотрены отсеки для восьми SFF-накопителей с интерфейсом PCIe 5.0 (NVMe); поддерживается горячая замена. Есть коннектор M.2 2280/22110 для SSD (PCIe 5.0 x4). Упомянута поддержка CXL 2.0. Сервер несёт на борту ИИ-ускорители NVIDIA HGX B200 поколения Blackwell в конфигурации 8 × SXM. Суммарный объём памяти HBM3E составляет 1,4 Тбайт. Доступны 12 слотов PCIe 5.0 x16 для карт расширения FHHL с доступом через лицевую панель корпуса. Говорится о совместимости с NVIDIA BlueField-3 DPU и NVIDIA ConnectX-7 NIC.

Источник изображения: Giga Computing В оснащение входят контроллер ASPEED AST2600, два сетевых порта 10GbE на базе Intel X710-AT2, выделенный сетевой порт управления 1GbE, разъёмы USB 3.2 Gen1 Type-C, Micro-USB и Mini-DP. Применяется система воздушного охлаждения с четырьмя 92-мм вентиляторами в области материнской платы и двенадцатью 92-мм кулерами в GPU-секции. Диапазон рабочих температур — от +10 до +35 °C. Заявлена совместимость с Windows Server, RHEL, Ubuntu, Citrix, VMware ESXi.

14.10.2025 [02:00], Сергей Карасёв

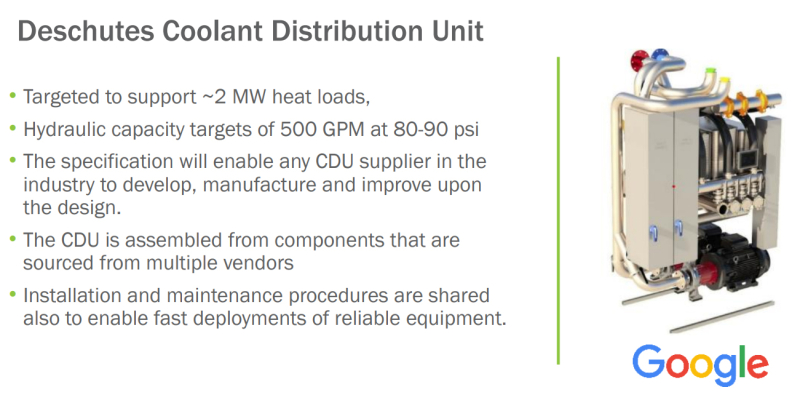

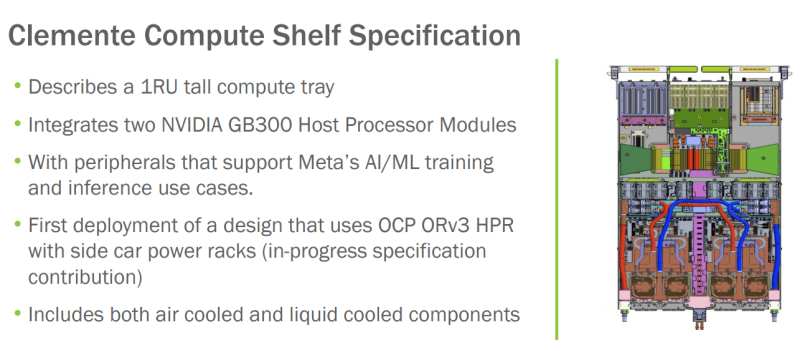

OCP запустила инициативу Open Data Center for AI для стандартизации инфраструктуры передовых ИИ ЦОД с мегаваттными стойкамиНекоммерческая организация Open Compute Project Foundation (OCP) анонсировала инициативу Open Data Center for AI по стандартизации компонентов физической инфраструктуры дата-центров, ориентированных на задачи ИИ и другие ресурсоёмкие нагрузки. Проект Open Data Center for AI является частью программы OCP Open Systems for AI, которая была представлена в январе 2024 года при участии Intel, Microsoft, Google, Meta✴, NVIDIA, AMD, Arm, Ampere, Samsung, Seagate, SuperMicro, Dell и Broadcom. Цель заключается в разработке открытых стандартов для кластеров ИИ и ЦОД, в которых размещаются такие системы. Запуск Open Data Center for AI продиктован быстрым развитием экосистемы дата-центров, результатами, полученными в рамках OCP Open Systems for AI, и новым открытым письмом о сотрудничестве, подготовленным Google, Meta✴ и Microsoft. В настоящее время, как отмечается, отрасль ЦОД сталкивается с проблемами, связанными с тем, что разрозненные усилия её участников, включая гиперскейлеров и колокейшн-провайдеров, порождают различные требования к проектированию инфраструктуры. Это замедляет внедрение инноваций и увеличивает сроки развёртывания передовых площадок. Цель Open Data Center for AI заключается в том, чтобы стандартизовать требования к системам электропитания, охлаждения и телеметрии, а также к механическим компонентам в ЦОД. Предполагается, что это обеспечит взаимозаменяемость элементов физической инфраструктуры дата-центров. При реализации инициативы Open Data Center for AI планируется использовать уже имеющиеся наработки сообщества OCP в области блоков распределения охлаждающей жидкости (CDU) и блоков распределения питания (PDU). Это, в частности, проект Mt. Diablo, который реализуется Meta✴, Microsoft и Google. Он предполагает создание общих стандартов электрических и механических интерфейсов. Идея заключается в разделении стойки на независимые шкафы для компонентов подсистемы питания и вычислительного оборудования. При этом планируется переход от единой шины питания постоянного тока с напряжением 48 В на архитектуру 400 В DC (Diablo 400). Ещё одним проектом, наработки которого пригодятся в рамках Open Data Center for AI, назван CDU Deschutes, разработанный Google. Это решение с резервными теплообменниками и насосами обеспечивает уровень доступности 99,999 %. Система Deschutes рассчитана на тепловые нагрузки до 2 МВт. Открытая спецификация позволит любой компании совершенствовать конструкцию CDU и производить изделия данного типа. Наконец, упоминаются серверные шасси Clemente, разработанные в Meta✴. Это узлы 1U, содержащие два суперчипа NVIDIA Grace Blackwell GB300 для ресурсоёмких ИИ-нагрузок. Платформа предполагает применение жидкостного охлаждения для CPU, GPU и коммутатора, а также воздушного охлаждения для других компонентов. |

|