Материалы по тегу: сжо

|

27.04.2026 [10:17], Руслан Авдеев

Необычная СЖО Airsys LiquidRack «опрыскивает» серверыAirsys представила новую интегрированную систему жидкостного охлаждения LiquidRack, предназначенное для ИИ-сред средней плотности, ЦОД, телекоммуникаций и периферийных вычислений. LiquidRack включает модули распределения жидкости, насосы и управления непосредственно на уровне серверов. Это позволяет заполнить «пробел» между обычными системами воздушного охлаждения и крупными СЖО, которые требуют отдельные модули распределения охлаждающей жидкости (CDU). Система поддерживает 0,5 до 8 кВт на сервер и до 80 кВт на стойку 10U. Диэлектрическая жидкость буквально распыляется на вертикально размещённые серверы в специальных кассетах. Нагретая жидкость попадает в пластинчатый теплообменник, где отдаёт тепло воде, отправляемой во внешний контур. По словам представителя Airsys, большинство операторов ЦОД ищут практичный, гибкий и «бесшовный» путь перехода с воздушного на жидкостное охлаждение. Это поможет справиться с высокой плотностью размещения оборудования, дефицитом электроэнергии и будет способствовать выполнению требований ESG-повестки. Бескомпрессорная система совместима с драйкулерами, чиллерами и адиабатическими системами охлаждения. Это означает, что её можно развернуть на действующих объектах. При этом она использует на 80 % меньше жидкости, чем погружные СЖО.

Также Airsys представила новейший вариант системы воздушного охлаждения UniCool — UniCool-Max. Она обеспечивает до 60 кВт охлаждающей мощности и предназначена для модульных ЦОД и помещений с высокотемпературным оборудованием — телеком-объектов и аппаратных комнат. Компания заявляет, что UniCool-Max не только помогает лучше справляться с высокими тепловыми нагрузками, но значительнее надёжнее традиционных компрессорных систем.

20.04.2026 [17:38], Владимир Мироненко

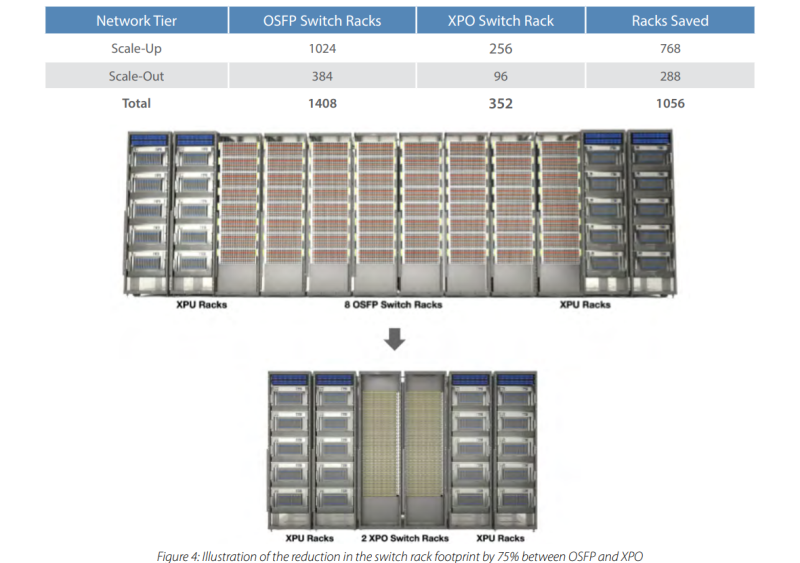

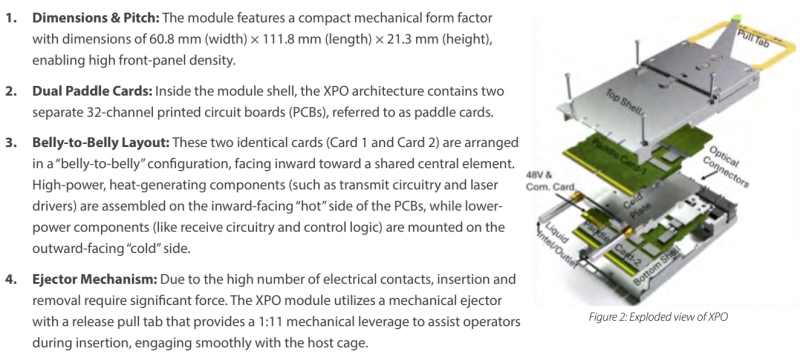

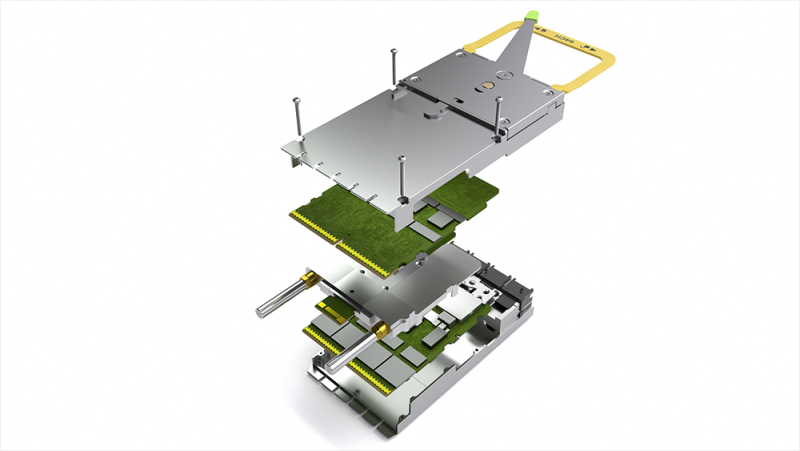

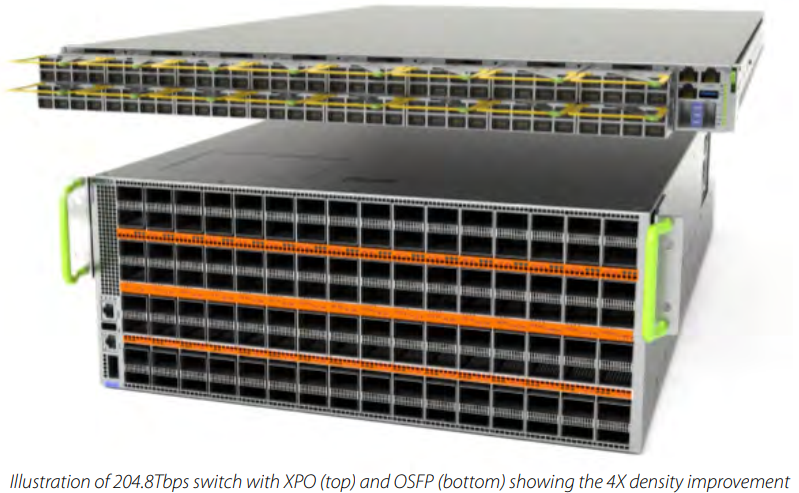

Ещё капельку: XPO-модули повысят плотность сетей в ИИ ЦОД, но CPO всё равно не избежатьЭкосистема XPO (eXtra-dense Pluggable Optics) набирает обороты после презентации на OFC 2026, поскольку производители объединяются вокруг нового формата подключаемых 12,8-Тбит/с модулей, разработанного для ИИ-инфраструктуры, сообщил ресурс Converge Digest. Инициатива, возглавляемая Arista Networks и поддерживаемая растущей группой поставщиков оптических и кремниевых компонентов, ориентирована на следующее поколение ИИ-кластеров, где плотность портов, полоса пропускания и тепловые ограничения будут основными факторами, ограничивающими производительность. Модуль XPO помещает 64 200G-канала (224 Гбит/с PAM4) в то же пространство, что и два модуля OSFP. В 1OU помещается 16 модулей XPO, что даёт 204,8 Тбит/с на юнит или 6,5 Пбит/с на ORv3-стойку. Это примерно вчетверо больше в сравнении 1.6T-модулями OSFP 1,6T, сообщил ресурс The Next Platform. XPO поддерживает интегрированное жидкостное охлаждение (водоблок), позволяет использовать любые типы оптики, а также предлагает значительное повышение отказоустойчивости. XPO поддерживает оптические стандарты SR, DR, FR, LR и ZR/ZR+, а также совместим с LPO. По словам Андреаса Бехтольсхайма (Andreas Bechtolsheim), соучредителя и главного архитектора Arista, в ИИ ЦОД мощностью 400 МВт с 1024 стойками, в каждой из которых размещено по 128 GPU, из расчёта 12,8 Тбит/с на вертикальное масштабирование и 1,6 Тбит/с для горизонтального масштабирования на каждый GPU при использовании коммутаторов с OSFP плотностью 1,6 Пбит/с на стойку потребуется более 1400 стоек. XPO позволит сократить количество стоек на 75 %, попутно сэкономив 44 % площади ЦОД. Бехтольсхайм отметил, что крупные ИИ ЦОД будут охлаждаться жидкостью, и коммутаторы, используемые в них, также должны изначально поддерживать СЖО. Он допустил, что можно добавить охлаждающие пластины с жидкостным охлаждением на модули OSFP с плоской верхней панелью, но это не улучшит существенно тепловые характеристики. В случае XPO водоблок интегрируется внутрь модуля и способен отводить более 400 Вт как от маломощных, так и высокопроизводительных модулей, таких как 8×1.6T-ZR/ZR+, утверждает Бехтольсхайм.  Еще одно дополнительное преимущество заключается в том, что при жидкостном охлаждении компонентов XPO они работают с температурой на 20–25 °C ниже в ZR-модуле на 12,8 Тбит/с, чем в модуле OSFP-ZR на 1,6 Тбит/с с воздушным охлаждением. Кроме того, модули XPO конструктивно значительно проще, чем модули OSPF, что также повышает надёжность. «Каждая 32-канальная плата имеет только один микроконтроллер и один набор преобразователей напряжения, что на 75 % меньше общих компонентов по сравнению с четырьмя модулями OSPF», — сообщил Бехтольсхайм. Вместе с тем повышение плотности размещения ведёт и к повышению энергопотребления. По оценкам Arista, 1,6-Пбит/с стойка с OSFP потребляет порядка 32 кВт, тогда как 6,5-Пбит/с XPO-стойка требует уже 128 кВт. Однако XPO-модули рассчитаны на питание 48/50 В DC непосредственно от общей шины всей стойки и уже сами отдают трансиверам 3,3 В, что способствуют упрощению всей конструкции, повышению компактности и снижению энергопотерь. Arista объявила о заключении многостороннего соглашения (MSA) на поставку XPO, к которому присоединились около 45 ведущих поставщиков оптических модулей, включая Lightmatter, Eoptolink Technology и TeraHop. Ожидается, что серийное производство XPO начнётся в 2027 году. Впрочем, XPO можно рассматривать как временное решение до начала действительно массового внедрения интегрированной оптикой (CPO).

25.03.2026 [12:08], Сергей Карасёв

ZutaCore представила водоблок для NVIDIA RTX Pro 6000 Blackwell Server EditionРазработчик систем прямого безводного двухфазного жидкостного охлаждения ZutaCore анонсировал водоблок OmniTherm для ускорителя NVIDIA RTX Pro 6000 Blackwell Server Edition. Новинка позволяет повысить плотность монтажа ИИ-карт в составе серверов, ориентированных на корпоративные и облачные среды. Решение OmniTherm обеспечивает возможность применения двухфазного охлаждения. При этом используется герметичная конструкция с диэлектрической жидкостью. Теплоноситель при контакте с чипом закипает и превращается в пар, который конденсируется в отдельном контуре. Блок OmniTherm позволяет реализовать однослотовую систему охлаждения, благодаря чему достигается экономия пространства внутри сервера. Переход на СЖО также помогает повысить энергетическую эффективность оборудования, снизить уровень шума и вибрации (благодаря отсутствию вентиляторов). ZutaCore отмечает, что OmniTherm отводит тепло не только от кристалла GPU, но и от других расположенных рядом дорогостоящих компонентов, включая чипы памяти НВМ. Снижение тепловой нагрузки на эти элементы может повысить долговременную стабильность и минимизировать вероятность сбоев. Кроме того, ZutaCore представила облачную платформу HyperCool Cloud, предназначенную для управления системами жидкостного охлаждения в комплексных средах. Эта платформа практически в режиме реального времени предоставляет информацию о работе различного оборудования, включая блоки распределения охлаждающей жидкости (CDU).

23.03.2026 [09:31], Сергей Карасёв

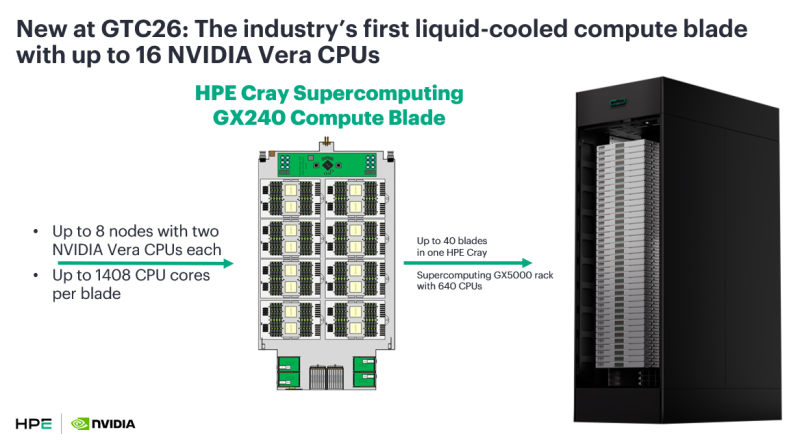

HPE представила узлы на базе NVIDIA Vera для платформы Cray Supercomputing GX5000Компания HPE анонсировала новые решения семейства NVIDIA AI Computing by HPE, ориентированные на крупномасштабные ИИ-платформы и суперкомпьютерные системы. О намерении использовать такие инфраструктурные продукты в числе прочих сообщили Аргоннская национальная лаборатория (ANL) Министерства энергетики США (DOE), Hudson River Trading (HRT), Корейский институт научно-технической информации (KISTI) и Центр высокопроизводительных вычислений HLRS при Штутгартском университете в Германии. В частности, представлены новые узлы для суперкомпьютерной платформы HPE Cray Supercomputing GX5000 — blade-серверы HPE Cray Supercomputing GX240. Эти устройства могут нести на борту до 16 процессоров NVIDIA Vera (88C/176T). В одной стойке могут быть размещены до 40 узлов, что в сумме даёт 640 чипов Vera и 56 320 ядер Olympus. Реализовано жидкостное охлаждение. Система предназначена для решения наиболее ресурсоёмких вычислительных задач в области ИИ. Новые серверы появятся на рынке в следующем году. Для платформы HPE Cray Supercomputing GX5000 также будут доступны коммутаторы NVIDIA Quantum-X800 InfiniBand, предоставляющие 144 порта с пропускной способностью до 800 Гбит/с. В этих устройствах реализованы развитые функции снижения энергопотребления. Кроме того, HPE готовит OCP-серверы высокой плотности Compute XD700 для обучения LLM и инференса. В основу данной системы положена платформа NVIDIA HGX Rubin NVL8, а одна стойка может насчитывать до 128 ускорителей Rubin. Данное решение появится в начале 2027-го. Помимо этого, анонсирована стоечная система нового поколения NVIDIA Vera Rubin NVL72 by HPE — это флагманская ИИ-платформа, разработанная для моделей с более чем 1 трлн параметров. Конфигурация включает 36 процессоров Vera, 72 чипа Rubin, интерконнект NVIDIA NVLink шестого поколения, сетевые адаптеры NVIDIA ConnectX-9 SuperNIC и DPU NVIDIA BlueField-4. Система поступит в продажу в декабре 2026 года.

21.03.2026 [13:08], Сергей Карасёв

От чистки ковров к СЖО: Ecolab планирует купить CoolIT почти за $5 млрдАмериканская компания Ecolab, по сообщению Datacenter Dynamics, рассматривает возможность приобретения поставщика систем жидкостного охлаждения CoolIT Systems. Стоимость сделки может составить $4,75 млрд, а завершить транзакцию планируется позднее в текущем году. В настоящее время CoolIT принадлежит фондам, управляемым инвестиционной компанией KKR. Последняя приобрела разработчика СЖО в 2023 году: тогда актив оценивался в $270 млн. В начале марта 2026-го стало известно о том, KKR намерена продать CoolIT, получив при этом около $3 млрд. Теперь же говорится, что стоимость сделки может и вовсе составить почти $5 млрд. Ecolab (ранее известная как Economics Laboratory), базирующаяся в Миннесоте, была основана более века назад — в 1923 году. Изначально фирма специализировалась на поставках средств для быстрой очистки ковровых покрытий в различных помещениях, таких как гостиничные номера. Сейчас Ecolab предлагает продукцию и услуги по очистке и мониторингу воды для ряда отраслей, включая пищевую промышленность, здравоохранение, гостиничный бизнес и производство. В ноябре 2025-го компания представила собственные решения в области СЖО.

Источник изображения: CoolIT Предполагается, что, объединив технологии CoolIT с опытом Ecolab в области водоснабжения, химии и цифрового обслуживания, стороны смогут предложить клиентам комплексные системы охлаждения, повышающие эффективность и надёжность при одновременном сокращении потребления воды и энергии. По оценкам Ecolab, на фоне быстрого внедрения СЖО в дата-центрах для ИИ-задач выручка CoolIT в течение ближайшего года достигнет $550 млн. Сделка потенциально позволит Ecolab существенно увеличить продажи в соответствующей области.

10.03.2026 [17:10], Руслан Авдеев

KKR задумала продать производителя СЖО CoolIT почти в 10 раз дороже, чем покупалаАмериканский инвестиционный гигант KKR рассчитывает хорошо заработать на продаже одной из именитых IT-компаний, работающей на рынке систем охлаждения с 2001 года. Бум ИИ привёл к тому, что оценочная стоимость компании CoolIT Systems выросла в несколько раз, сообщает The Financial Times. По данным знакомых с ситуацией источников, KKR и её консультанты работают над продажей компании за $3 млрд. CoolIT, переориентировавшаяся с выпуска систем охлаждения для игровых ПК на СЖО для дата-центров, в 2023 году, на момент покупки KKR контрольного пакета, стоила всего $270 млн. Миноритарной долей владеет суверенный государственный инвестор Mubadala из ОАЭ. По информации источников, пока обсуждение продажи CoolIT находится на ранней стадии и гарантии того, что сделка вообще состоится, отсутствуют. Тем не менее, несколько компаний уже выбраны в качестве потенциальных «стратегических» покупателей. По данным Datacenter Dynamics, ранее CoolIT привлекла около $10 млн в ходе четырёх раундов финансирования. В числе предыдущих инвесторов: Business Development Bank of Canada, nVent, Kline Hill Partners, Vistara Capital Partners, Inovia Partners, AVAC Group и Chart Venture Partners. Масштабная эволюция инфраструктуры ЦОД и развитие ИИ-технологий стали импульсом к росту сделок, напрямую не связанных с компаниями технологического сектора. В частности, речь идёт об энергетике и промышленных сделках с участием поставщиков для ИИ-инфраструктуры. Как свидетельствуют данные НКО American Edge Project, в США уже строятся или планируются к строительству около 3 тыс. дата-центров, не считая 4 тыс. уже действующих площадок. Это неизбежно увеличивает потенциальный спрос на оборудование и сервисы CoolIT. Тем не менее, инвесторы начинают ставить под сомнение окупаемость многих инвестиций крупных компаний в новые дата-центры. В 2025 году производственная компания Eaton заплатила $9,5 млрд за связанный с теплообменными решениями бизнес Boyd Corporation. Предполагается, что это позволит расширить портфолио решений для ЦОД. Купленный бизнес, вероятно, уже в 2026 году принесёт около $1,7 млрд выручки, причём большая её часть приходится на СЖО-решения. Конкурент Vertiv также купил компанию PurgeRite сходного профиля в том же году, заплатив около $1 млрд. На днях частные инвестиционные компании Global Infrastructure Partners (GIP, принадлежит BlackRock) и EQT заключили сделку на $33 млрд, организовав покупку энергокомпании AES Corporation. В своё распоряжение они получили бизнес, генерирующий возобновляемую энергию в огромных объёмах для дата-центров. В последние годы эксперты называют KKR одним из самых агрессивных частных инвесторов, скупающих ЦОД. В 2021 году совместно с GIP она приобрела американского оператора ЦОД CyrusOne. Сделка обошлась в $15 млрд, включая долг.

08.03.2026 [14:50], Сергей Карасёв

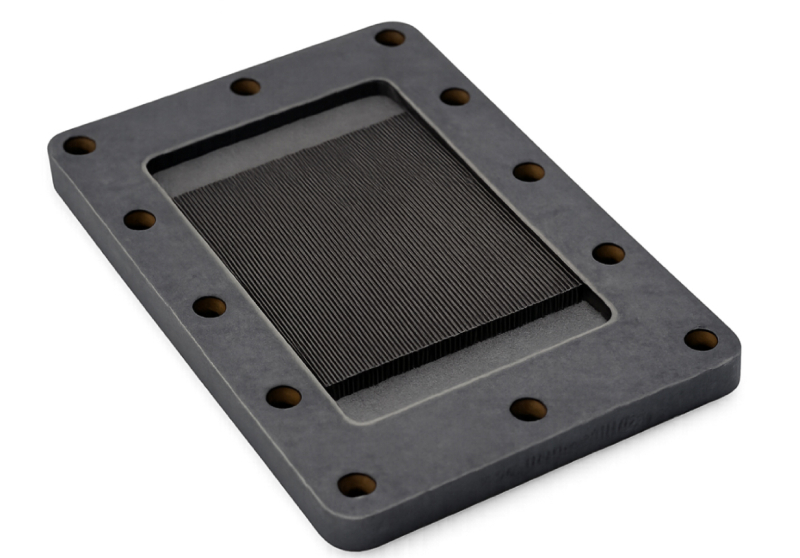

Карборунд-алмазные водоблоки Coherent Thermadite 800 вдвое теплопроводнее и к тому же легче медныхКомпания Coherent анонсировала охлаждающие пластины Thermadite 800 Liquid Cold Plates (LCP) для систем жидкостного охлаждения, рассчитанных на ИИ-ускорители следующего поколения. Новые изделия, как утверждается, способны снизить температуру чипа более чем на 15 °C по сравнению с обычными медными аналогами. Thermadite представляет собой композитный материал на основе реакционно-связанного карбида кремния (RB-SiC), который формируется путём инфильтрации кремния в пористую заготовку из карбида кремния и углерода. А благодаря включению алмаза в матрицу SiC материал Thermadite обеспечивает высокую теплопроводность, низкий коэффициент теплового расширения, жёсткость и стабильность размеров. Такие характеристики позволяют использовать Thermadite для отвода тепла от мощных электронных компонентов, в частности, от GPU в передовых ИИ-ускорителях. По заявлениям Coherent, Thermadite 800 обладает теплопроводностью 800 Вт/м⋅К — примерно вдвое больше, чем у меди. Кроме того, материал имеет приблизительно на 60 % меньшую плотность, чем медь, что позволяет использовать его в системах, к массе которых предъявляются жёсткие требования. При этом устраняются проблемы с деформацией и надёжностью, которые могут возникать в обычных металлических охлаждающих пластинах при работе под высоким давлением. Пластины Thermadite 800 имеют сложную микроканальную архитектуру, оптимизированную под конкретные чипы: это даёт возможность эффективно отводить тепло от наиболее горячих зон при минимизации расхода охлаждающей жидкости. В результате, снижаются общие эксплуатационные расходы.

06.03.2026 [16:01], Сергей Карасёв

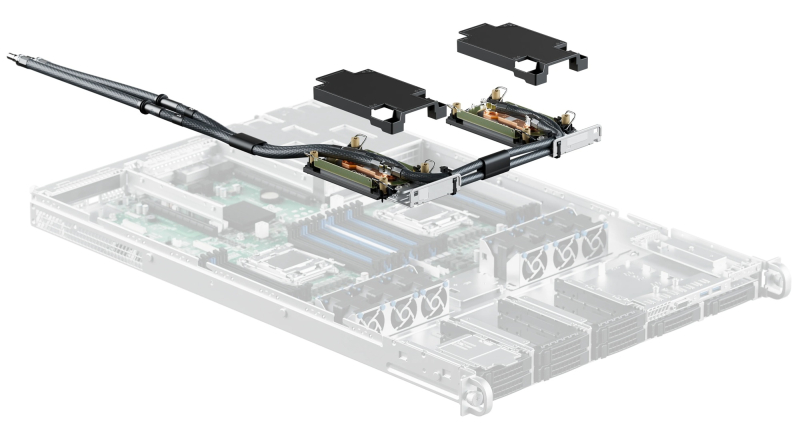

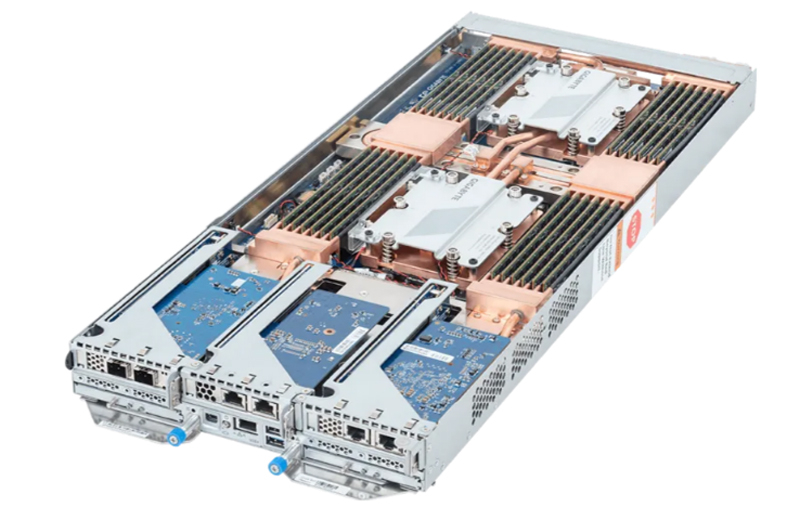

10-узловой сервер Gigabyte B683-Z80-LAS1 на платформе AMD EPYC Turin оснащён СЖОКомпания Gigabyte Technology анонсировала сервер B683-Z80-LAS1 высокой плотности, предназначенный для облачного хостинга, вычислительных ИИ-нагрузок и других ресурсоёмких приложений. Устройство выполнено в форм-факторе 6U с десятью узлами. Каждый узел рассчитан на установку двух процессоров AMD EPYC 9005 Turin или EPYC 9004 Genoa в исполнении Socket SP5 (LGA 6096), показатель TDP которых может достигать 500 Вт. Реализована 12-канальная подсистема оперативной памяти с 24 слотами для модулей DDR5-4800/6400. Конфигурация узлов включает контроллер ASPEED AST2600 с интерфейсом Mini-DP, сетевой порт управления 1GbE (RJ45), три коннектора для низкопрофильных карт расширения PCIe 5.0 x16, два порта USB 3.2 Gen1 Type-A (5 Гбит/с) и два посадочных места для накопителей типоразмера E3.S (NVMe). Сервер оснащён системой прямого жидкостного охлаждения, которая охватывает не только CPU, но и все другие ключевые компоненты, в том числе модули ОЗУ, накопители, а также карты расширения. Утверждается, что применённое решение позволяет отводить до 90 % генерируемого тепла, что обеспечивает высокую эффективность даже при больших нагрузках. Кроме того, задействованы четыре системных вентилятора диаметром 80 мм. Диапазон рабочих температур — от +10 до +35 °C.

Источник изображений: Gigabyte Technology Питание обеспечивают 12 блоков мощностью 3200 Вт с сертификатом 80 PLUS Titanium. Собственно серверное шассе оборудовано двумя дополнительными сетевыми портами управления. Габариты устройства составляют 447 × 262,3 × 900 мм, масса — около 38 кг.

06.03.2026 [14:36], Руслан Авдеев

Шведская Alfa Laval представила экологичную СЖО для ЦОД FreeWaterLoopШведская промышленная группа Alfa Laval выходит на рынок оборудования для дата-центров. Она анонсировала выпуск новую внешнюю систему жидкостного охлаждения FreeWaterLoop. По словам компании, в новой СЖО используется комбинация передовых инженерных решений с сфере насосостроения, высокопроизводительных технологий теплообмена и фильтрации — они объединены в единый, полностью интегрированный модуль. Alfa Laval сообщила, что система использует стабильные температуры и теплопроводность природных водоёмов и минимизирует водопотребление, возвращая чистую воду туда, откуда она была забрана. Кроме того, FreeWaterLoop позволяет уменьшить размер охладительных установок дата-центров, занимая меньше пространства, чем классические системы воздушного охлаждения оборудования. По словам Alfa Laval, наблюдаются беспрецедентные изменения на рынке ЦОД, поскольку развитие ИИ ведёт к росту тепловых нагрузок, заказчику тем временем требуют всё более устойчивую инфраструктуру. Alfa Laval использует свои сильные стороны для создания нового поколения эффективных и надёжных решений в сфере терморегулирования. Основанная в 1883 году шведская компания Alfa Laval занимается как разработкой, так и производством. Она поставляет бойлеры, вентили, насосы, теплообменники и прочие компоненты для судостроения, энергетики и пищевой промышленности. Компания заявила, что в случае с FreeWaterLoop речь идёт об одном из самых быстрых циклов разработки для решений такого масштаба. Это отражает общие амбиции Alfa Laval, свидетельствует о быстром процессе принятия решений в компании и активной поддержке ЦОД с помощью масштабируемых инноваций. Ещё в 2024 году сообщалось, что через несколько лет СЖО займут треть рынка систем охлаждения для ЦОД. Впрочем, новости февраля 2026 года свидетельствуют о том, что с повсеместным внедрением придётся повозиться. AWS резко сократила развёртывание СЖО для Trainium3, решив обойтись преимущественно воздушным охлаждением, хотя ранее сама с нуля разработала собственную систему жидкостного охлаждения в кратчайшие сроки.

28.02.2026 [09:48], Сергей Карасёв

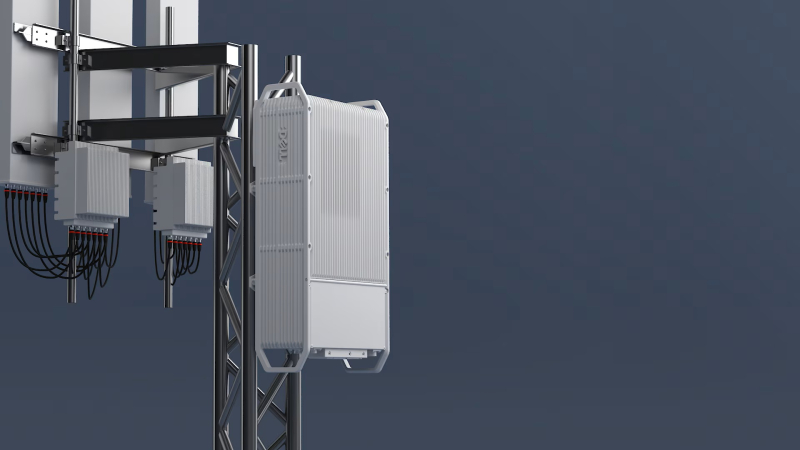

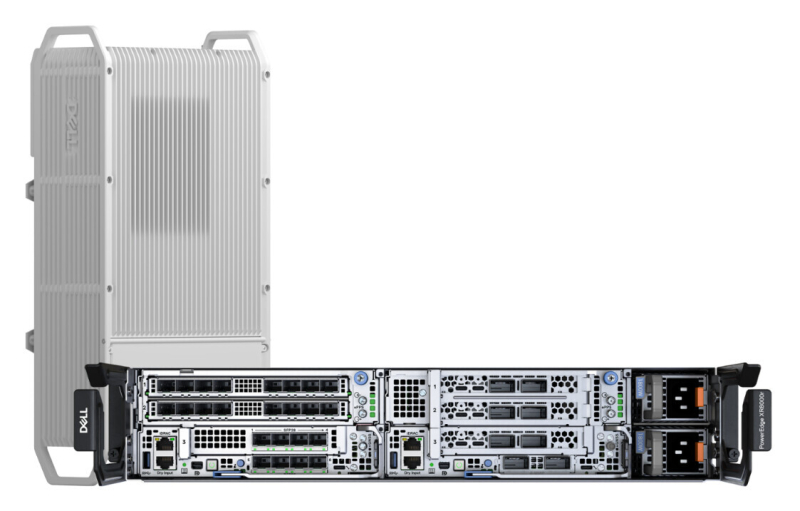

Dell представила подвесной уличный сервер PowerEdge XR9700 с замкнутой СЖОDell анонсировала сервер PowerEdge XR9700, предназначенный для инфраструктур Cloud RAN и ИИ-приложений на периферии. Устройство рассчитано на эксплуатацию в неблагоприятных условиях, в том числе на открытом воздухе: оно может монтироваться на опорах линий электропередач, крышах и фасадах зданий. Новинка заключена в корпус объёмом около 15 л. Говорится о сертификации IP66 и GR-3108 Class 4: серверу не страшны пыль, влага и воздействие прямого солнечного излучения. Диапазон рабочих температур простирается от -40 до +46 °C. В основу PowerEdge XR9700 положена аппаратная платформа Intel Xeon 6 SoC — Granite Rapids-D (до 72 P-ядер, TDP до 325 Вт). Также возможна установка ИИ-ускорителей и различных сетевых карт, в том числе для обработки L1-трафика. Задействована система жидкостного охлаждения с замкнутым контуром, а ребристая внешняя поверхность работает в качестве радиатора. Без СЖО с таким уровнем тепловыделения CPU/GPU и в таком компактном корпусе уже вряд ли можно обойтись. Отмечается, что с технической точки зрения устройство идентично модели PowerEdge XR8720t, которая дебютировала в октябре прошлого года. В зависимости от конфигурации это решения располагает четырьмя или восемью слотами для модулей DDR5. Возможна установка до трёх SSD формата M.2 (NVMe). В оснащение могут входить два порта 100GbE QSFP и восемь портов 10/25GbE SFP. Реализованы интерфейсы USB 3.0 Type-A, UCB Type-C, Mini-DisplayPort и пр. Заявлена поддержка Wind River SUSE Linux Enterprise Server/RT, Ubuntu Server LTS и Red Hat Enterprise Linux/RT. Интегрированный контроллер удалённого доступа Dell (iDRAC) обеспечивает мониторинг и управление. Говорится о совместимости с существующим набором решений для периферийных вычислений в области телекоммуникаций. В продажу PowerEdge XR9700 поступит во II половине текущего года. |

|