Материалы по тегу: сервер

|

20.01.2026 [12:12], Сергей Карасёв

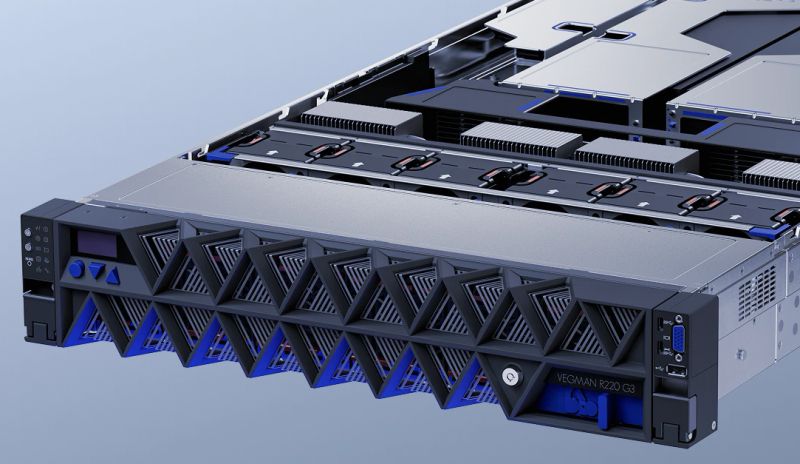

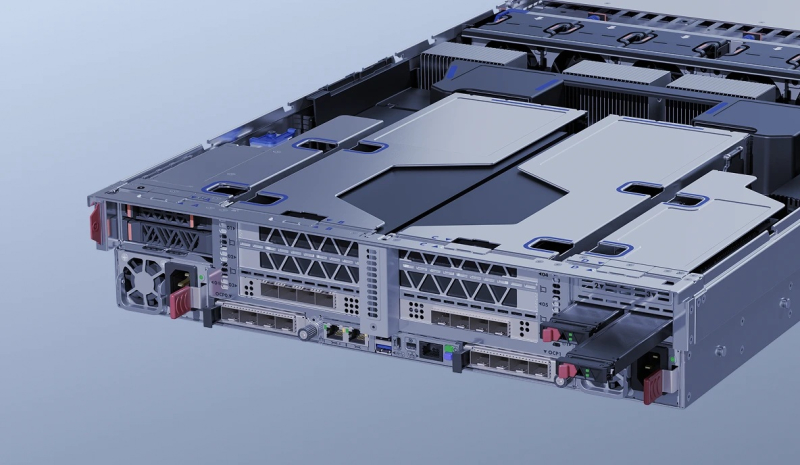

YADRO выпустила отечественные серверы Vegman R220 G3 на базе Intel Xeon Emerald RapidsКомпания YADRO, входящая в «ИКС Холдинг», объявила о доступности универсальных серверов Vegman R220 G3 на аппаратной платформе Intel. Устройства подходят для широкого спектра задач — от хранения и аналитики данных до НРС-приложений и нагрузок ИИ, говорит компания. Новинки выполнены в форм-факторе 2U. Допускается установка двух процессоров Xeon Sapphire Rapids или Xeon Emerald Rapids с показателем TDP до 350 Вт. Возможно использование до 8 Тбайт оперативной памяти DDR5-4400/5600 RDIMM в конфигурации 32 × 256 Гбайт. Во фронтальной части в зависимости от модификации могут быть установлены до 12 накопителей LFF (SAS/SATA/NVMe) или до 24 накопителей SFF (SAS/SATA плюс 16 × NVMe). Сзади предусмотрены посадочные места для четырёх изделий SFF (или 2 × SFF и 2 × M.2/E1.S). Допускается формирование массивов RAID 0/1/10/5/50/6/60. Реализована поддержка CXL 1.1. Есть два сетевых порта 1GbE и выделенный сетевой порт управления 1GbE (все с разъёмами RJ45). Доступны до 11 слотов PCIe 5.0 с учетом OCP 3.0 SFF и гнезда под контроллер RAID/HBA. Спереди находятся два порта USB 3.1 Type-C, по одному разъёму USB 2.0 Type-A и D-Sub, сзади — два порта USB 3.1 Type-A, последовательный интерфейс (разъём USB Type-C) и коннектор Mini DisplayPort (BMC). Питание обеспечивают два блока мощностью до 2700 Вт с сертификатом 80 PLUS Platinum. Применено воздушное охлаждение с шестью вентиляторами диаметром 60 мм с возможностью горячей замены. Диапазон рабочих температур — от +10 до +35 °C при относительной влажности от 20 % до 80 %. Заявлена совместимость с Astra Linux, ALT Linux, RED OS, zVirt и пр. С серверами поставляется ПО управления «YADRO Суприм» и набор инструментов Vegman Satellites. Реализована поддержка доступа через IPMI 2.0, WebUI, CLI, SNMP, Redfish. Устройства Vegman R220 G3 включены в Единый реестр российской радиоэлектронной продукции Минпромторга, что подтверждает соблюдение требований локализации.

12.01.2026 [14:41], Сергей Карасёв

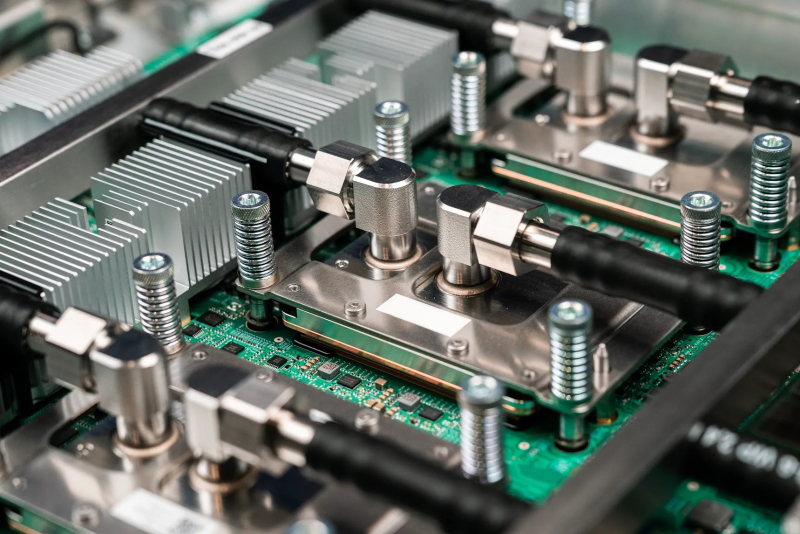

ASRock Rack показала ИИ-сервер на базе NVIDIA HGX B300 с СЖО ZutaCore HyperCoolКомпания ASRock Rack на выставке CES 2026 продемонстрировала ИИ-сервер 4U16X-GNR2/ZC, первая информация о котором была раскрыта в октябре прошлого года. Новинка создана в партнёрстве с разработчиком систем жидкостного охлаждения ZutaCore. Устройство выполнено в форм-факторе 4U. Возможна установка двух процессоров Intel Xeon 6700E (Sierra Forest-SP) или Xeon 6500P/6700P (Granite Rapids-SP). Доступны 32 слота для модулей оперативной памяти DDR5, три разъёма PCIe 5.0 x16 для карт FHHL и два сетевых порта 1GbE на базе контроллера Intel I350-AM2. Задействована аппаратная платформа NVIDIA HGX B300. Для отвода тепла используется система прямого жидкостного охлаждения ZutaCore HyperCool. Это двухфазное решение основано на применении специальной диэлектрической жидкости, которая не вызывает коррозии. Утверждается, что конструкция HyperCool безопасна для IT-оборудования и гарантирует сохранение работоспособности даже в случае утечки. СЖО поставляется в полностью собранном виде, что сокращает время монтажа в стойку. Сервер 4U16X-GNR2/ZC оборудован 12 фронтальными отсеками для SFF-накопителей с интерфейсом PCIe 5.0 x4 (NVMe); допускается горячая замена. Кроме того, есть внутренний разъём для одного SSD типоразмера М.2 (PCIe 5.0 x2). За питание отвечают десять блоков мощностью 3000 Вт с сертификатом 80 Plus Titanium. Габариты машины составляют 900 × 448 × 175 мм. Отмечается, что в стандартной стойке 42U могут быть размещены до восьми подобных серверов, что обеспечивает высокую плотность вычислительной мощности для наиболее ресурсоёмких нагрузок ИИ.

12.01.2026 [13:16], Сергей Карасёв

Supermicro представила SuperBlade-сервер на базе Intel Xeon 6900 с СЖОКомпания Supermicro анонсировала сервер SBI-622BA-1NE12-LCC семейства SuperBlade, предназначенный для построения вычислительных платформ высокой плотности. Устройство будет предлагаться в вариантах с воздушным и прямым жидкостным охлаждением: в первом случае в шасси типоразмера 6U могут быть размещены пять узлов, во втором — десять. Каждый узел SuperBlade поддерживает установку двух процессоров Intel Xeon 6900 поколения Granite Rapids, насчитывающих до 128 производительных P-ядер. Показатель TDP может достигать 500 Вт. Доступны 24 слота для модулей оперативной памяти DDR5-6400/8800 суммарным объёмом до 3 Тбайт. Предусмотрены два посадочных места для накопителей E1.S. Опционально могут быть также установлены два NVMe SSD формата M.2 2280 или M.2 22110. Реализованы три слота PCIe 5.0 x16 для карт формата FHHL, HHHL/LP и OCP 3.0. В оснащение входят контроллер Aspeed AST2600 и адаптер Intel E810-XXVAM2, на базе которого реализованы два сетевых порта 25GbE. Шасси, в которое монтируются серверные узлы SBI-622BA-1NE12-LCC, оснащено модулями управления и Ethernet-коммутаторами с резервированием. Питание обеспечивают восемь блоков с сертификатом 80 Plus Titanium. Диапазон рабочих температур — от +10 до +35 °C. По заявлениям Supermicro, передовой дизайн шасси 6U обеспечивает сокращение количества кабелей на 93 % и экономию пространства на 50 % по сравнению с серверами в форм-факторе 1U с сопоставимой конфигурацией. Новинка ориентирована на решение НРС-задач в таких областях, как производство, финансы, научные исследования, энергетика, моделирование климата и пр.

27.12.2025 [00:45], Владимир Мироненко

Google избавляется в России от устаревших серверов GGCGoogle разослала российским интернет-провайдерам уведомления о том, что планирует забрать устаревшие кеширующие серверы Dell R720, срок службы которых давно закончился, сообщил ресурс РБК со ссылкой на источники среди провайдеров. Эти серверы используются в системе Google Global Cache (GGC) для кеширования наиболее востребованного контента с целью более быстрой его загрузки местными пользователями. После ухода с российского рынка в 2022 году Google больше не модернизировала систему GGC. В марте 2025 года из-за того, что её российская «дочка» находится в состоянии банкротства, Google отключила пиринговые соединения с некоторыми российскими точками обмена трафиком (IX) и ЦОД. В письмах, направленных интернет-провайдерам, являющимся партнёрами GGC, компания отметила, что будет выводить из эксплуатации серверы, которые сняты с производства и не имеют гарантийного обслуживания, с 26 января 2026 года. В связи с этим Google попросила операторов отключить и извлечь из стойки серверы, а также предоставить адрес, где их можно забрать. Источник РБК также сообщил, что вопросами передачи оборудования для Google занимается европейская компания MPK Asset Solutions. По его словам, часть серверов компания уже вывезла. При этом конкурсный управляющий по делу о банкротстве ООО «Гугл» заявил РБК, что не имеет информации о вывозе оборудования Google из России. Комментируя планы Google вывезти серверы из России, эксперты отметили, что речь идёт о старом оборудовании, официальная поддержка которого была прекращена ещё в 2018 году. Также они считают, что могут возникнуть сложности с его вывозом из-за отсутствия правовых оснований и продолжающейся процедуры банкротства юрлица Google в России. Ранее Google предложила операторам, причём не только российским, вместо GGC использовать прямое присоединение к своей сети. Google, равно как и другие гиперскейлеры, уже давно занимается строительством собственной глобальной сети. В апреле Google объявила о запуске Cloud WAN, полностью управляемой корпоративной WAN-платформы, обеспечившей доступ к её всемирной сетевой инфраструктуре всем организациям и компаниям.

25.12.2025 [22:52], Сергей Карасёв

Это вам не игрушки: Linux-планировщик, разработанный для Valve Steam Deck, оказался хорош и для серверов Meta✴Компания Meta✴, по сообщению ресурса Phoronix, использует на своих серверах планировщик задач Linux, который изначально был разработан для портативной игровой консоли Valve Steam Deck. Об этом инженеры гиперскейлера рассказали на мероприятии Linux Plumbers Conference в Токио. Речь идёт о решении SCX-LAVD, созданием которого по контракту с Valve занималась фирма Igalia, специализирующейся на Linux. Ранее планировщик SCX-LAVD уже применялся в различных проектах по разработке игрового софта для Linux, включая CachyOS Handheld Edition, Bazzite и др. Оказалось, что SCX-LAVD эффективно работает не только на портативных устройствах, но и на полноценных серверах. В Meta✴ рассматривали это решение в качестве «планировщика по умолчанию» для Linux-серверов с различным аппаратным оснащением и в разных сценариях использования, при которых не требуется специализированный планировщик. Специалисты Meta✴ пришли к выводу, что SCX-LAVD хорошо функционирует на серверах при наращивании ресурсов CPU и RAM. При этом обеспечивается необходимая балансировка нагрузки.

Источник изображения: Meta✴ В целом, как подчеркивается, SCX-LAVD демонстрирует производительность, аналогичную или даже превосходящую показатели EEVDF (Earliest Eligible Virtual Deadline First) — нового алгоритма планирования задач в ядре Linux, который заменяет старый планировщик CFS (Completely Fair Scheduler).

22.12.2025 [08:07], Сергей Карасёв

Российские двухсокетные серверы Amur Terra поддерживают чипы Intel Xeon Emerald RapidsРоссийский производитель вычислительной техники Amur представил серверы семейства Terra A02R на аппаратной платформе Intel. В серию вошли модели 12S2S и 24S2S формата 2U и версия 24S12S2S типоразмера 4U. Все новинки внесены в реестр Минромторга РФ, протестированы на совместимость с реестровыми российскими ОС и прикладным ПО, говорит компания. Устройства оснащены материнской платой на наборе логики Intel C741A. Они могут нести на борту два процессора Intel Xeon Sapphire Rapids или Xeon Emerald Rapids. Поддерживается до 8 Тбайт оперативной памяти DDR5-4400/4800/5600 МГц RDIMM/LRDIMM в виде 32 модулей. Базовая модель Terra A02R 12S2S оборудована 12 фронтальными отсеками для накопителей LFF/SFF с интерфейсом SATA/SAS (опционально NVMe). Дополнительно могут быть реализованы два тыльных слота для SFF-устройств SATA. Этот сервер предназначен для работы с большими массивами данных в памяти, построения систем виртуализации, поддержки критически важных бизнес-приложений и пр.

Источник изображений: Amur Модификация Terra A02R 24S2S допускает установку 24 фронтальных SFF-накопителей SATA/SAS/NVMe и двух тыльных SFF-устройств SATA (опционально). Машина подходит для создания файловых серверов, систем виртуализации высокой плотности и VDI, аналитики и работы с СУБД, требующими высоких скоростей чтения, включая PostgreSQL, Tantor, MySQL.  Сервер Terra A02R 24S12S2S рассчитан на 24 фронтальных и 12 тыльных накопителей LFF/SFF с интерфейсом SATA/SAS (плюс два опциональных SFF-устройства SATA сзади). Таким образом, могут формироваться системы хранения высокой ёмкости — на уровне 1 Пбайт.  Все новинки располагают контроллером Aspeed AST2600, двумя блоками питания мощностью 1300/1600 Вт с горячей заменой и резервированием, портами D-Sub (спереди и сзади), USB 3.0 (по два спереди и сзади), 1GbE (RJ45) и последовательным портом. Слоты расширения в стандартной конфигурации выполнены по схеме 1 × PCIe 5.0 x16 FHFL, 2 × PCIe 5.0 x8 FHFL+FHHL, 2 × OCP 3.0. Альтернативная схема — 2 × PCIe 5.0 x16 FHFL+FHHL, 2 × PCIe 5.0 x8 HHHL или 1 × PCIe 5.0 x16 HHHL. Возможна установка двух GPU полной высоты, полной длины и двойной толщины (например, NVIDIA A100, H100). Диапазон рабочих температур — от +5 до +35 °C при относительной влажности от 35 % до 80 % без конденсации.

13.12.2025 [15:53], Сергей Карасёв

Мировой рынок серверов бьёт рекорды благодаря ИИ: квартальная выручка превысила $110 млрд, а Китай резко нарастил свою долюКомпания International Data Corporation (IDC) обнародовала результаты исследования мирового рынка серверов в III квартале уходящего года. Продажи в денежном выражении достигли рекордных $112,4 млрд: это на 61,1 % больше по сравнению с аналогичным периодом прошлого года, когда отгрузки оценивались в $69,79 млрд. При этом продажи СХД показали минимальный рост год к году. Квартальная выручка от продаж серверов с архитектурой x86 увеличилась на 32,8 % — до $76,3 млрд. Системы с процессорами на других архитектурах принесли производителям $36,2 млрд, показав рост на 192,7 % в годовом исчислении. Более половины от общего объёма отрасли обеспечили серверы, оборудованные ускорителями: на фоне стремительного внедрения ИИ поставки таких машин в денежном выражении поднялись на 49,4 % по сравнению с III четвертью 2024 года. С географической точки зрения самые высокие темпы роста продемонстрировали США — плюс 79,1 % в годовом исчислении: этому способствовало увеличение продаж ИИ-серверов на 105,5 %. Канада показала прибавку в размере 69,8 %. В Китае зафиксировано увеличение поставок в денежном выражении на 37,6 %: при этом на КНР пришлась почти пятая часть квартальной выручки в мировом масштабе. В Азиатско-Тихоокеанском регионе (без учёта Китая и Японии) рост составил 37,4 %, в регионе ЕМЕА (Европа, Ближний Восток и Африка) — 31,0 %, в Японии — 28,1 %. В Латинской Америке продажи поднялись на 4,1 %. Рейтинг ведущих поставщиков серверов по итогам III квартала 2025 года возглавляет Dell Technologies с выручкой в размере $9,3 млрд и долей 8,3 %. На втором месте располагается Supermicro с $4,5 млрд и 4,0 %, а замыкает тройку IEIT Systems с $4,14 млрд и 3,7 %. На четвёртой и пятой строках находятся Lenovo и НРЕ, у которых выручка составила соответственно $4,0 млрд и $3,4 млрд, а рыночная доля — 3,6 % и 3,0 %. При этом у всех перечисленных компаний доли сократились по сравнению с III кварталом 2024 года.

10.12.2025 [10:42], Сергей Карасёв

«Гравитон» выпустил Edge-сервер С2062И на платформе «Тундра» с чипами Intel Xeon Cascade Lake-SPРоссийский производитель вычислительной техники «Гравитон» сообщил о доступности сервера С2062И семейства Edge, предназначенного для решения различных задач на периферии. Устройство, в частности, подходит для создания систем обеспечения безопасности, IoT-платформ, телекоммуникационных решений и пр. Сервер, о подготовке которого впервые сообщалось ещё в 2024 году, выполнен в форм-факторе 2U на платформе «Тундра»: задействована материнская плата собственной разработки типоразмера E-ATX на наборе логики Intel C621. Допускается установка двух процессоров Intel Xeon поколения Cascade Lake-SP в исполнении LGA 3647. Доступны 16 слотов для модулей оперативной памяти DDR4 суммарным объёмом до 2 Тбайт. Устройство оснащено пятью слотами PCIe 3.0 х16 и одним разъёмом PCIe 3.0 x8.

Источник изображений: «Гравитон» Во фронтальной части располагаются шесть отсеков для SFF-накопителей SATA/SAS с возможностью горячей замены. Есть контроллер Aspeed AST2500, четыре сетевых порта 1GbE и выделенный сетевой порт управления 1GbE. На лицевой панели, помимо пяти гнёзд RJ45, находятся четыре порта USB 3.0, аналоговый интерфейс D-Sub и последовательный порт.  Сервер оборудован съёмной передней панелью с противопылевым фильтром. Установлены два блока питания с резервированием мощностью 800 Вт. Устройство оптимизировано для работы в условиях ограниченного пространства. Говорится о совместимости с различными отечественными операционными системами, включая RedOS, «Альт Линукс», Astra Linux и др. Модель С2062И внесена в реестр Минпромторга России.

03.12.2025 [09:33], Владимир Мироненко

Foxconn поможет Google c TPU-серверами, а Google поможет Foxconn с «умными» роботамиFoxconn получила крупный заказ Google на поставку TPU-узлов, сообщил ресурс Taiwan Economic Daily со ссылкой на информированные источники. С учётом того, что Meta✴ планирует использовать ИИ-ускорители TPU в своих ИИ ЦОД в 2027 году, у Foxconn появилась возможность укрепить партнёрство с обоими гиперскейлерами. Да и самой Google уже сейчас катастрофически не хватает TPU для собственного облака. Foxconn уже является ключевым поставщиком платформ NVIDIA, хотя последняя всё больше ужесточает контроль над производством. По данным источников, ИИ-серверы для Google в основном поставляются в виде стоек с TPU. В этом году Google анонсировала тензорный ускоритель седьмого поколения TPU v7 Ironwood, первый чип компании, специально созданный для инференса, хотя область его применения также включает обучение крупномасштабных моделей и сложное обучение с подкреплением (RL). На его базе можно создавать кластеры (Pod) с объединением в единый вычислительный комплекс до 9216 чипов. По собственным данным Foxconn, он уже способна выпускать более 1000 ИИ-стоек в неделю. К концу 2026 года компания планирует увеличить этот показатель до более 2000 ед./нед. Также планы Foxconn включают расширение присутствия в США, где компания намерена не только осуществлять сборку серверов, но и наладить производство ключевых компонентов, таких как кабели, сетевое оборудование, системы теплоотвода и электропитания. Помимо выпуска ASIC-серверов, сотрудничество Foxconn и Google включает создание роботов, управляемых ИИ. Foxconn заключила партнерство с Intrinsic, робототехнической компанией, входящей в состав Alphabet, материнской компании Google, с целью создания совместного предприятия в США для строительства завода по выпуску роботов с поддержкой ИИ. Партнёры планируют интегрировать ИИ-платформу Intrinsic и интеллектуальную производственную платформу Foxconn для создания адаптивных интеллектуальных робототехнических решений, что ещё больше повысит эффективность производственных объектов Foxconn и всей её экосистемы. В прошлом месяце Google выпустила большую языковую модель Gemini 3, которая, как утверждается, превзошла OpenAI GPT-5 по нескольким ключевым показателям и ИИ-модели других конкурентов, что также способствовало росту популярности TPU. Согласно данным инсайдеров, Google призвала цепочку поставок ускориться в связи с предстоящим поступлением новых крупных заказов на TPU.

02.12.2025 [18:20], Сергей Карасёв

Российская ИИ-система Delta Sprut XL поддерживает до 25 GPU

delta computers

gpu

granite rapids

h200

hardware

intel

nvidia

ocp

rtx

sierra forest

xeon

ии

сделано в россии

сервер

Российская компания Delta Computers представила OCP-систему Delta Sprut XL, предназначенную для ресурсоёмких нагрузок, таких как обучение ИИ-моделей, инференс, научное моделирование и задачи HPC. В основу новинки положена аппаратная платформа Intel Xeon 6. CPU-секция допускает установку двух процессоров Sierra Forest-SP или Granite Rapids-SP с показателем TDP до 330 и 350 Вт соответственно: в первом случае могут быть задействованы в общей сложности до 288 E-ядер, во втором — до 172 P-ядер. Доступны 32 слота для модулей оперативной памяти DDR5-6400 RDIMM или DDR5-8000 MRDIMM суммарным объёмом до 8 Тбайт. Могут быть установлены четыре SFF-накопителя U.2 толщиной 15 мм с интерфейсом PCIe 5.0 (NVMe) или восемь таких SSD толщиной 7 мм. Кроме того, есть два коннектора M2.2280 (PCIe). Реализованы четыре слота PCIe 5.0 x16 для карт типоразмера HHHL и слот OCP 3.0 (PCIe 5.0). Присутствуют разъёмы USB 3.0 Type-A и miniDP, а также выделенный сетевой порт управления 1GbE. В системе Delta Sprut XL ускорители на базе GPU устанавливаются в отдельные модули. В общей сложности могут использоваться до 20 карт NVIDIA H200 или до 25 экземпляров NVIDIA RTX Pro 6000 Blackwell Server Edition. Каждый квартет NVIDIA H200 объединён при помощи NVLink. «Delta Computers представляет GPGPU-платформу, способную консолидировать до 20 ускорителей NVIDIA H200 в одном кластере. При этом необходимость использования InfiniBand или 400GbE появляется лишь в случае потребности у заказчика в ещё большем количестве ускорителей — при таком сценарии предусмотрены отдельные слоты расширения для объединения нескольких платформ Delta Sprut XL в единый кластер», — отмечает компания. Питание обеспечивается посредством централизованного шинопровода OCP на 12 или 48 В. Применено встроенное ПО Delta BMC, предназначенное для мониторинга (сбор телеметрии, отслеживание состояния платформы, её модулей и компонентов) и удалённого администрирования серверного оборудования. Эта прошивка включена в реестр Минцифры РФ и сертифицирована ФСТЭК. |

|