Материалы по тегу: google

|

25.04.2026 [21:46], Владимир Мироненко

Google инвестирует до $40 млрд в партнёра-конкурента Anthropic, выплатив авансом $10 млрдНа этой неделе стало известно о планах Google инвестировать до $40 млрд в ИИ-стартап Anthropic при его предварительной оценке в $350 млрд, что почти соответствует сумме, в которую компания была оценена в ходе раунда финансирования в феврале. $10 млрд стартап получит авансом, ещё $30 млрд будет выделено при достижении определённых целевых показателей, пишет Bloomberg. Несмотря на наличие собственных конкурирующих моделей Gemini AI, Google оказывает финансовую поддержку Anthropic, которая является одновременно и партнёром, и конкурентом. Как и OpenAI, Anthropic привлекает крупные инвестиции от компаний, у которых она покупает чипы и вычислительные мощности ЦОД, что вызывает обоснованные опасения у некоторых аналитиков относительно цикличности этих сделок. Компания извлекает выгоду из популярности своих ИИ-решений, включая модель Claude Code, ускоряющую разработку ПО. Anthropic становится доминирующим игроком на рынке ИИ-инструментов для разработки ПО, в которые сама Google также вложила значительные средства. По словам инсайдеров, внутри Google растёт обеспокоенность тем, что она теряет позиции на этом рынке. Вместе с тем Google продолжает активно инвестировать в разработку собственных моделей Gemini, которые обеспечивают работу функций ИИ в поисковой системе, Gmail и других приложениях. В этом месяце Anthropic представила свою новейшую модель Claude Mythos ограниченной группе партнёров. Anthropic заявила, что Mythos — её самая мощная модель на сегодняшний день, имеющая значительные возможности для применения в сфере кибербезопасности. В феврале 2026 года компания привлекла $30 млрд инвестиций при оценке в $380 млрд. Раунд возглавили сингапурский суверенный фонд GIC и Coatue, также в нём участвовали, помимо других инвесторов, Microsoft и NVIDIA. В октябре прошлого года Anthropic заключила сделку с Google, обеспечивающую ей доступ к ИИ-ресурсам мощностью более 1 ГВт с возможностью использования до 1 млн TPU. После этого компании расширили партнёрство при участии Broadcom, договорившись о предоставлении Anthropic 3,5 ГВт ИИ-мощностей на базе Google TPU. Согласно новому инвестиционному соглашению, Google Cloud предоставит Anthropic ещё 5 ГВт мощностей в течение следующих пяти лет с возможностью дальнейшего масштабирования. Пятилетнее соглашение может стоить около $200 млрд, подсчитали The Financial Times. Ранее на этой неделе Anthropic заключила сделку с Amazon, в рамках которой обязуется потратить более $100 млрд в течение следующих десяти лет на чипы Trainium и вычислительные мощности AWS, а Amazon обязалась инвестировать в стартап $5 млрд сразу, а затем ещё $20 млрд в течение определённого времени. Также в этом месяце стартапом было подписано многолетнее соглашение с неооблаком CoreWeave о предоставлении ИИ-мощностей для дальнейшего развития семейства моделей Claude.

23.04.2026 [01:20], Владимир Мироненко

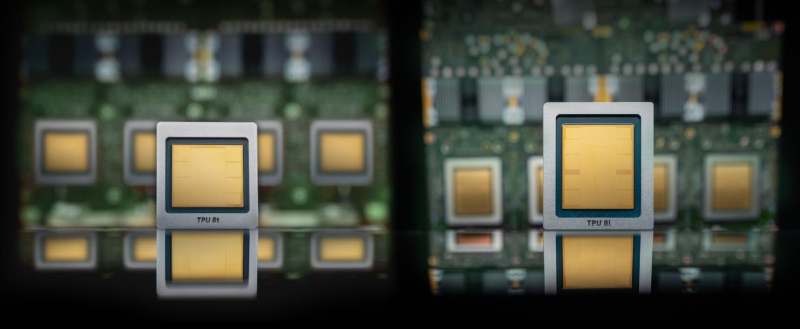

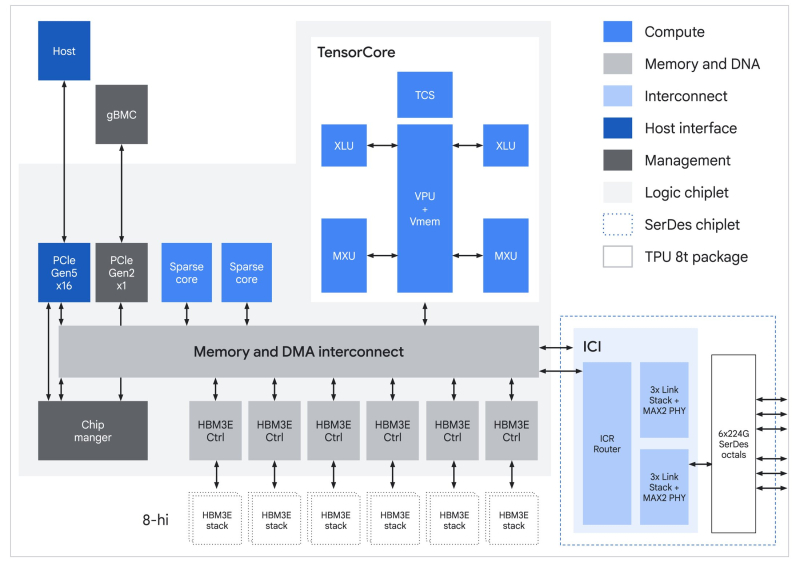

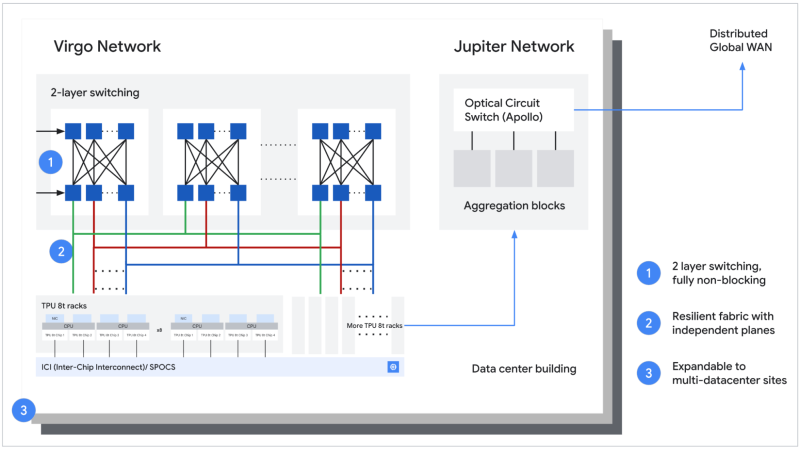

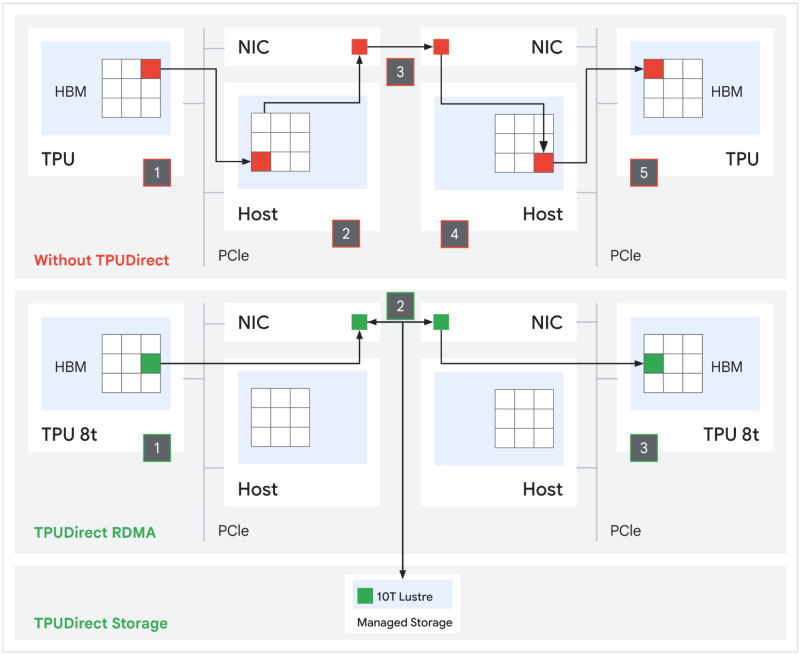

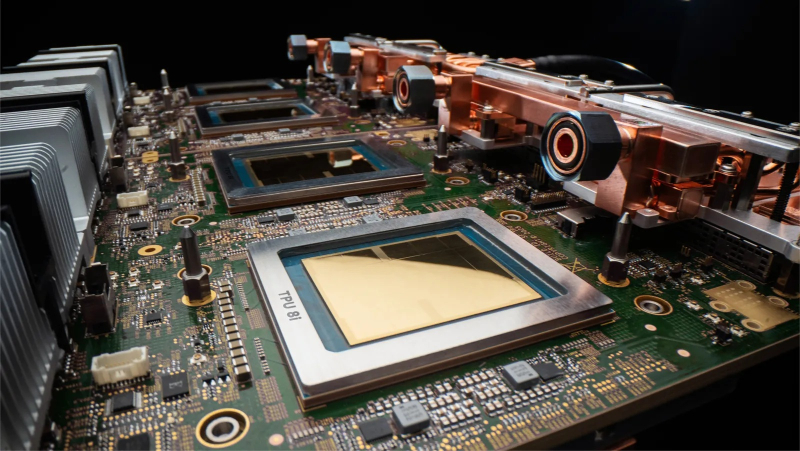

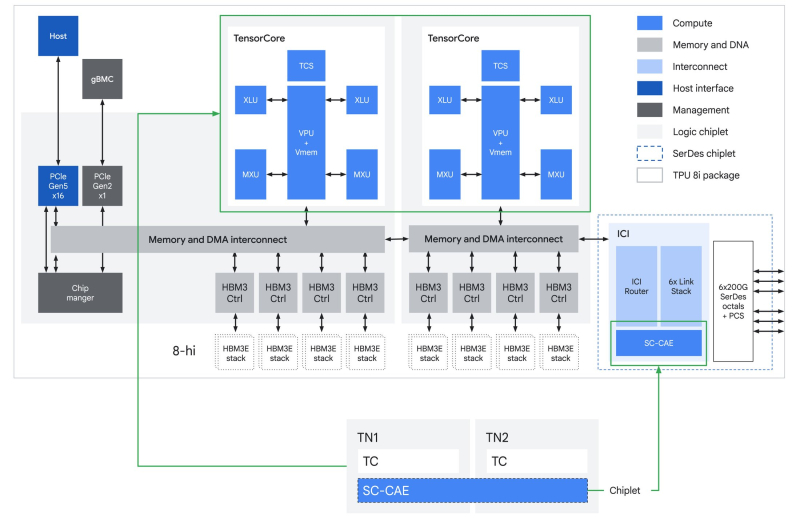

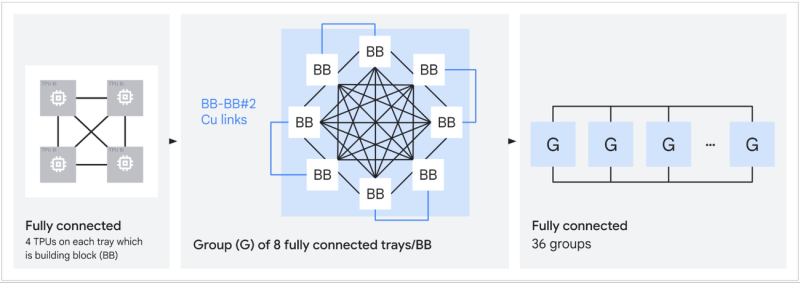

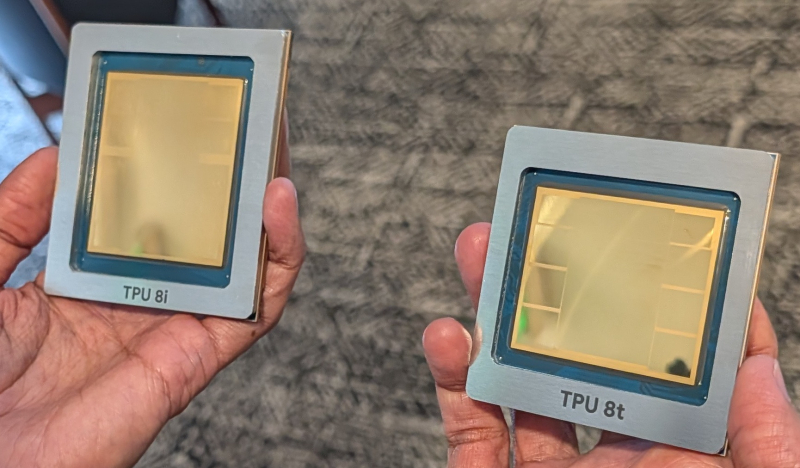

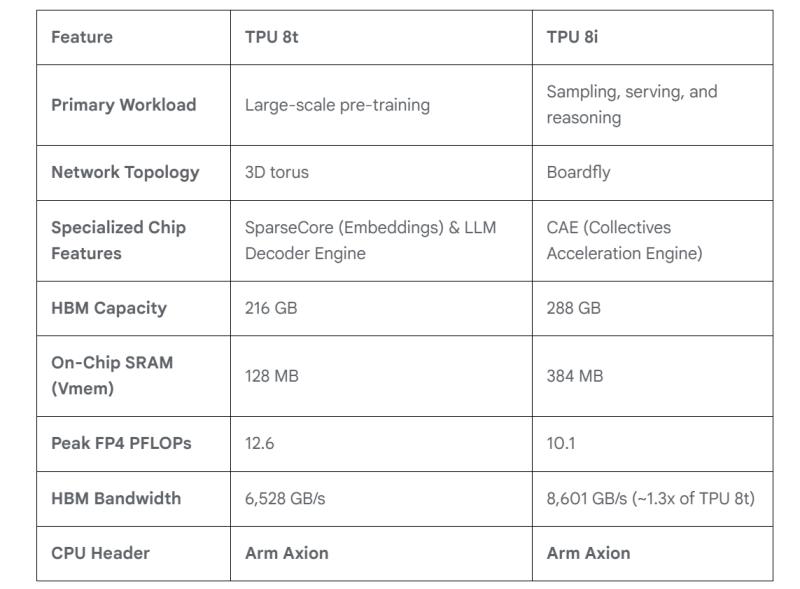

Для обучения и инференса — Google анонсировала ИИ-ускорители TPU 8t и TPU 8iGoogle представила два TPU восьмого поколения: TPU 8t (Sunfish) для обучения ИИ и TPU 8i (Zebrafish) для ИИ-инференса. Компания и раньше экспериментировала с различными вариантами TPU, в частности, со своими чипами пятого поколения V5p и V5e, но последние поколения, такие как Trillium и Ironwood, в основном следовали единому подходу. По словам Амина Вахдата (Amin Vahdat), старшего вице-президента и главного технолога Google по ИИ и инфраструктуре, TPU 8t и TPU 8i — результат десятилетней разработки (первые TPU были анонсированы в мае 2016 г.), специально созданные для обеспечения работы суперкомпьютеров следующего поколения с высокой эффективностью и масштабируемостью. Вахдат описывает TPU 8t как «мощную платформу для обучения», созданную для «сокращения цикла разработки моделей с месяцев до недель». Она предлагает в 2,8 раза лучшее соотношение цены и производительности, чем предыдущее поколение. В TPU 8t используются векторные, матричные и SparseCore-ядра, дополненные 128 Мбайт SRAM и 216 Гбайт HBM3e (6,5 Тбайт/с). FP4-производительность составляет до 12,6 Пфлопс (также поддерживаются BF16/FP8/INT8). Для вертикального масштабирования используется межчиповый интерконнект (ICI) со скоростью 19,2 Тбит/с (в каждую сторону), для горизонтального — 400 Гбит/с. Кластер с TPU 8t может масштабироваться до 9,6 тыс. чипов, предлагая 2 Пбайт памяти HBM, 121 Эфлопс и вдвое большую межчиповую пропускную способность по сравнению с Ironwood, позволяя самым сложным моделям использовать единый, огромный пул памяти. 8t-кластеры объдиняет сеть Virgo Network, которая использует плоскую двухуровневую неблокирующую топологию, обеспечивает четырёхкратное увеличение пропускной способности в ЦОД и построена на коммутаторах с высокой степенью защиты, что сокращает количество сетевых уровней. В рамках одного ЦОД Virgo Network позволяет объединить до 134 тыс. чипов, что даёт до 47 Пбит/с неблокирующих соединений и более 1,6 Ифлопс с почти линейным масштабированием. А в рамках нескольких ЦОД в единый кластер можно объединить более 1 млн TPU. В TPU 8t используются технологии TPUDirect RDMA и TPUDirect Storage. TPU Direct RDMA обеспечивает прямую передачу данных между HBM и NIC, минуя CPU и DRAM хоста, а TPUDirect Storage напрямую связывает память TPU и СХД, таким как 10T Lustre, которая обеспечивает до 10 Тбайт/с, что даёт на порядок более быстрый доступ к хранилищу в сравнении с Ironwood и позволяет доставлять петабайты данных к ускорителям. Кроме того, TPU 8t получили расширенные возможности RAS. К ним относятся телеметрия в реальном времени для десятков тысяч чипов, автоматическое обнаружение неисправных каналов ICI и перенаправление трафика без прерывания задания, а также оптическая коммутация каналов (OCS), которая перенастраивает оборудование в случае сбоев без участия человека. Всё это позволяет довести уровень утилизации чипа до 97 %. В свою очередь, TPU 8i создан для обработки «сложной, совместной, итеративной работы множества специализированных агентов», которые появляются с развитием агентного ИИ. TPU 8i использует 288 Гбайт памяти HBM (8,6 Тбайт/с) в паре с 384 Мбайт SRAM — втрое больше, чем в предыдущем поколении. По словам Google, такой объём SRAM помогает TPU 8i удерживать большую часть KV-кеша на кристалле, что значительно сокращает время простоя ядер во время декодирования длинных контекстов. Компания отказалась от SparseCores в пользу нового встроенного механизма ускорения коллективных операций (CAE), снижая задержки на уровне кристалла и разгружая коллективные коммуникации, которые в противном случае привели бы к простою тензорных ядер чипа, отметил The Register. TPU 8i масштабируется до 1152 чипов в одном кластере (впрочем, в каждый момент активно не более 1024): 11,6 Эфлопс и 331,8 Тбайт HBM. ICI у 8i такой же, что у 8t, однако для объединения чипов используется топология Boardfly вместо 3D-тора, поскольку для MoE-инференса важно меньшее количество сетевых переходов между чипами. Эти инновации обеспечивают на 80 % лучшую производительность на доллар по сравнению с предыдущим поколением, позволяя предприятиям обслуживать почти вдвое больше клиентов при тех же затратах, сообщила компания. Как TPU 8t, так и 8i работают на базе собственного Arm-процессора Axion и поддерживают СЖО. Компания также заявила, что оптимизировала эффективность всей системы для обеспечения интегрированного управления питанием, которое может регулировать потребление энергии в зависимости от спроса в реальном времени, что приводит к повышению производительности на ватт до двух раз по сравнению с Ironwood. TPU 8 станут общедоступными на Google Cloud Platform позже в этом году в виде отдельных инстансов или как часть полнофункциональной платформы AI Hypercomputer, которая объединяет все сетевые ресурсы, хранилище, вычислительные мощности и ПО, необходимые для развёртывания или обучения LLM в масштабе.

21.04.2026 [19:38], Руслан Авдеев

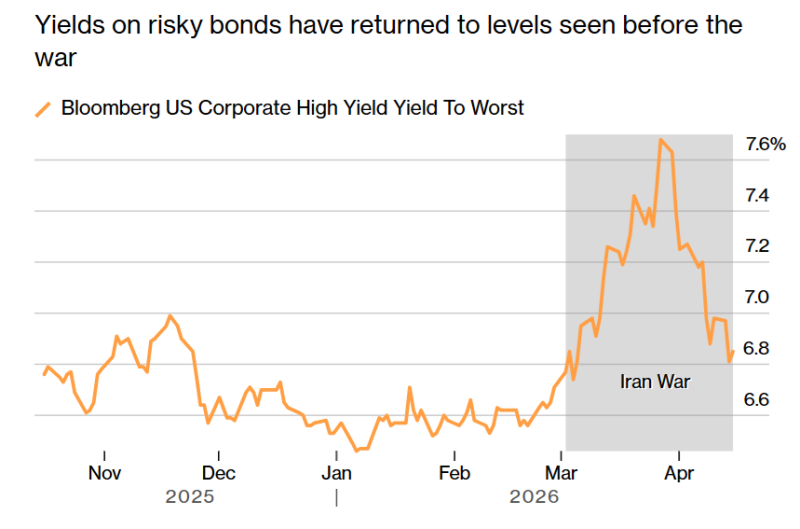

Google и CoreWeave взялись за «мусорные» облигации на миллиарды долларовПоддерживаемая Google рекордная сделка по привлечению инвестиций и дополнительная продажа облигаций компанией CoreWeave обеспечили новое вливание в индустрию ИИ, на этот раз в объёме $6,7 млрд, сообщает Bloomberg. При это речь идёт о высокодоходных, но высокорисковых «мусорных» облигациях. Связанная с Google сделка под руководством Morgan Stanley оценивается в $5,7 млрд, хотя общая сумма заявок от всех желающих составила $19 млрд. Средства пойдут на строительство двух дата-центров в кампусе Meridian Arc HoldCo в округе Салливан (Sullivan, Индиана). Мощности ЦОД будут сданы в аренду неооблаку Fluidstack, а сама сделка поддерживается Google. Тем временем провайдер облачной инфраструктуры CoreWeave продал новый пакет облигаций на сумму $1 млрд под 9,75 % с погашением в 2031 году, всего через неделю после предыдущего размещения ценных бумаг на $1,75 млрд. По данным Datacenter Dynamics, в марте 2026 года CoreWeave получила взаймы $8,5 млрд для поддержки закупок ИИ-ускорителей для Meta✴. Неооблачный провайдер наращивает свою долговую нагрузку для расширения инфраструктуры, к концу 2025 года совокупный долг компании составил $21,6 млрд. Ранее в текущем году она получила $2 млрд инвестиций от NVIDIA.

Источник изображения: Bloomberg Быстрое распространение ИИ вызвало беспрецедентный дефицит свободных мощностей ЦОД, ИИ-ускорителей и электроэнергии для обеспечения их работы. Для финансирования компании буквально воюют за все доступные на рынке средства от «мусорных» облигаций до проектного финансирования. За последние недели резиденты Уолл-Стрит обеспечили финансирование на десятки миллиардов долларов, даже несмотря на то, что конфликт на Ближнем Востоке заставил некоторых потенциальных участников снизить активность. Но по мере того как у многих растёт оптимизм относительно перспектив долгосрочного мира, стоимость заёмных средств для компаний всех типов постепенно снижается. Meridian Arc HoldCo представляет собой совместное предприятие Next Frontier и Fluidstack, именно оно выпустило пятилетние облигации для финансирования ЦОД в Индиане; компания поддерживается Google. Заём на $5,7 млрд с доходностью 6,25 % — это крупнейший выпуск высокодоходных облигаций в США, связанных с ИИ. Кроме того, это крупнейшая сделка такого рода, организованная единственной финансовой структурой с Уолл-Стрит. Размещение завершилось всего через день после старта официальной маркетинговой компании. Размещение побило собственный рекорд Morgan Stanley. Ранее рекордным считалось размещение облигаций в интересах криптомайнера TeraWulf в 2025 году на $3,2 млрд, также поддержанное Google и сделанное в интересах Fluidstack. Fluidstack занимается строительством высокопроизводительной вычислительной инфраструктуры, в этой сфере наблюдается бум на фоне взрывного развития ИИ-проектов. Недавно компания анонсировала сделку с Anthropic на $50 млрд, предусматривающую строительство кастомных ЦОД для разработчика ИИ-моделей. В феврале 2026 года Google привлекла со помощью облигаций $32 млрд для поддержки растущих капитальных расходов. Техногигант рассчитывает, что последние составят в 2026 году $185 млрд, большая доля которых пойдёт на ЦОД и ИИ-инфраструктуру. Кроме того, Google снова поддержала Fluidstack, купив облигации на $1,3 млрд.

19.04.2026 [21:20], Владимир Мироненко

Google договаривается с Marvell о разработке двух кастомных чипов для ИИ-инференсаКомпания Google (Alphabet) ведёт переговоры с Marvell Technology о совместной разработке двух кастомных чипов, предназначенных для более эффективного ИИ-инференса, сообщил ресурс The Information со ссылкой на информированные источники. Как отметил The Information, эти переговоры свидетельствуют о стремлении Google, исторически зависящей от Broadcom в отношении базовой инфраструктуры TPU, к диверсификации поставщиков. Этот потенциальный альянс в области разработки чипов является прямым ответом на меняющуюся экономику ИИ, когда огромные вычислительные затраты на обучение масштабных моделей быстро уступают место постоянным ежедневным расходам на инференс. Один из чипов относится к подсистеме памяти TPU, второй — собственно TPU следующего поколения, созданный специально для запуска ИИ-моделей. Эти чипы предназначены для совместной работы, при этом каждый из них выполняет свою часть задачи. Как подчёркивается в публикации, «текущие обсуждения направлены на разработку полупроводников исключительно для нужд Google». Помимо технической оптимизации ИИ-инференса, привлечение Marvell — это классическая тактика диверсификации поставщиков, пишет Startup Fortune. Broadcom долгое время занимала исключительно доминирующее положение на рынке заказных чипов, тесно сотрудничая с Google в разработке TPU. Но сильная зависимость от одного партнёра по проектированию неизбежно создаёт ценовые разногласия и узкие места. Добавление ещё одного партнёра даёт Google более сильные рычаги влияния во время переговоров по контрактам, а также защищает её ЦОД от геополитических и логистических сбоев. Следует отметить, что авторитет Marvell заметно вырос за последнее время. Компания недавно заключила многомиллиардное партнёрство с NVIDIA, ориентированное на оптические сети и кастомные чипы. Её акции выросли более чем на 50 % с начала года, в основном благодаря доверию инвесторов к её опыту в области инфраструктуры данных и проектирования заказных чипов. Вместе с тем Broadcom остается ключевым партнёром в реализации планов Google. В этом месяце компании подписали соглашение о продолжении работы над новыми чипами до 2031 года, сообщается в документе, направленном Broadcom регулятору. Если переговоры пройдут успешно, Marvell укрепит свой статус ведущей альтернативы Broadcom в сегменте разработки кастомных ИИ-микросхем. Также следует ждать, что капитальные затраты гиперскейлеров будут всё больше смещаться в сторону оптимизации инференса, а не просто увеличения вычислительной мощности. Аналитики отрасли в настоящее время прогнозируют, что поставки серверных ASIC для ИИ-вычислений утроятся к 2027 году, и эта тенденция почти полностью обусловлена потребностями в развёртывании больших языковых моделей.

15.04.2026 [17:54], Руслан Авдеев

Microsoft получит 30 тыс. ИИ-ускорителей NVIDIA Vera Rubin, от которых отказалась OpenAI, отменившая проект Stargate NorwayКомпании Microsoft и Nscale расширили партнёрство. Техногигант арендует у Nscale 30 тыс. ИИ-ускорителей NVIDIA Vera Rubin в норвежском ЦОД, которые изначально предназначались для проекта OpenAI Stargate Norway. Дополнительные вычислительные мощности станут доступны в 2027 году. Это фактически второй значимый отказ от развития кампусов Stargate в Европе. Ранее OpenAI приостановила создание ИИ ЦОД в Великобритании. А кампус Stargate в ОАЭ и вовсе находится под угрозой атак со стороны Ирана.

Источник изображения: Nscale По имеющимся данным, ускорители для Microsoft разместят в 230-МВт дата-центре в Квандале (Kvandal) в непосредственной близости от Нарвика (Narvik) на севере Норвегии. Площадка строится усилиями совместного предприятия норвежской промышленной группы Aker и Nscale. По некоторым данным, уход OpenAI из Норвегии был обусловлен неспособностью компании заключить взаимовыгодное соглашение с Nscale, передаёт Bloomberg. Тем не менее, OpenAI всё равно получит доступ к ИИ-мощностям в Норвегии посредством Microsoft Azure — компания так или иначе обязана потратить $250 млрд на облако Microsoft. В США OpenAI тоже отказалась от расширения флагманского кампуса Stargate в Техасе, и эти мощности тоже достанутся Microsoft. Microsoft уже имеет договорённости с Nscale, связанные с использованием норвежской площадки, в сентябре 2025 года было подписано соглашение об аренде мощностей на $6,2 млрд. Во сколько обойдётся новое, будет объявлено позже. Также компании уже подписали соглашения в Великобритании, Техасе и Португалии. Британские ЦОД Nscale тоже простаивать не будут — по данным Datacenter Dynamics, Google заключила сделку об аренде мощностей в Лондоне. Правда, это не те мощности, что изначально создавались для OpenAI.

10.04.2026 [23:09], Владимир Мироненко

Intel поставит Google несколько поколений Xeon и IPUIntel и Google объявили об углублении многолетнего партнёрства в области инфраструктуры ИИ и облачных вычислений, охватывающего как развёртывание процессоров, так и совместную разработку специализированных чипов инфраструктуры (IPU). За два дня до этого компания стала партнёром по производству микрочипов для мегапроекта Tesla Terafab. В итоге акции Intel за неделю выросли на треть. Intel и Google отметили, что по мере ускорения внедрения ИИ-инфраструктура становится всё более сложной и гетерогенной, что приводит к увеличению зависимости от CPU для оркестрации, обработки данных и повышения производительности на системном уровне. В рамках сотрудничества с Intel компания Google планирует использовать несколько поколений процессоров Intel Xeon для улучшения производительности, энергоэффективности и TCO в своих инстансах. Intel уже делает кастомные Xeon для AWS. Стороны подчеркнули, что одних только ускорителей недостаточно для удовлетворения потребностей современной ИИ-инфраструктуры. «ИИ меняет подход к построению и масштабированию инфраструктуры. Масштабирование ИИ требует большего, чем просто ускорители — оно требует сбалансированных систем. CPU и IPU играют центральную роль в обеспечении производительности, эффективности и гибкости, необходимых для современных рабочих нагрузок ИИ», — сообщил генеральный директор Intel Лип-Бу Тан (Lip-Bu Tan). Как отметил ресурс The Next Web, Intel потратила последние два года на переориентацию с рынка универсальных вычислений, где она когда-то доминировала, на процессоры и специализированные инфраструктурные чипы, которые играют структурную роль в развёртывании ИИ и которые постоянно недооценивали в рамках концепций, ориентированных на GPU. Одновременно компания развивает бизнес по производству кастомных чипов для ИИ-рынка. Амин Вахдат (Amin Vahdat), старший вице-президент и главный технолог Google по инфраструктуре ИИ отметил: «Процессоры и инфраструктурное ускорение остаются краеугольным камнем систем ИИ — от организации обучения до инференса и развёртывания. Intel является надёжным партнёром уже почти два десятилетия, и её план развития Xeon даёт нам уверенность в том, что мы сможем и дальше удовлетворять растущие требования к производительности и эффективности наших рабочих нагрузок». Что важно, партнёрство охватывает несколько поколений Intel Xeon, а не текущий цикл обновления оборудования Google. Партнёрство также включает расширенную совместную разработку IPU (DPU) — специализированных программируемых ускорителей на базе ASIC, предназначенных для разгрузки сетевых функций, функций хранения, функций безопасности и т.п., которые на масштабах гиперскейлера позволяют существенно сэкономить и упростить управление инфраструктурой. Ранее компании совместно разработали свой первый IPU Mount Evans. Момент для анонса партнёрства выбран подходящий. Рабочие нагрузки ИИ смещаются от обучения на ускорителях, что позволить себе могут немногие, к масштабируемому инференсу, который является распределённым, чувствительным к задержкам, непрерывным и требовательным к ресурсам CPU для оркестрации, работы с данными и управления системой в целом. По-видимому, собственные процессоры Google Axion пока не слишком годятся на эту роль. Впрочем, для внешних заказчиков компания точно так же предлагает инстансы с чипами NVIDIA, хотя её собственные TPU пользуются огромным спросом. Впрочем, расширение сотрудничество можно объяснить и более прозаично — дефицит серверных процессоров на рынке усиливается, так что заранее договориться о поставках с крупным игроком, да ещё имеющим собственное производство на территории США, всегда выгодно.

07.04.2026 [16:22], Руслан Авдеев

Инвесторы требуют от Amazon, Microsoft и Google прозрачности отчётов о расходах воды и электроэнергии в ЦОД СШАПомимо давления, по разным причинам оказываемого на Amazon, Microsoft и Google общественностью, более внимательнее к деятельности гиперскейлеров стали и инвесторы, сообщает Reuters. От компаний теперь требуют более подробных отчётов о расходах электроэнергии и воды. Reuters сообщает, что более десятка инвестиционных компаний желают знать об использовании воды и мерах её экономии на фоне желания IT-гигантов расширить вычислительные мощности. Бостонская Trillium Asset Management, управляющая активами на сумму более $4 млрд, в декабре 2025 года обратилась к Alphabet, желая получить ясность относительно достижения гиперскейлером климатических целей, поскольку потребности дата-центров компании только растут. В 2020 году техногигант обещал сократить вредные выбросы вдвое, а к 2030 году перейти на безуглеродные источники энергии, но, по данным Trillium, выбросы выросли на 51 % (а за полтора десятка лет и вовсе на 1515 %), и теперь инвесторам очень интересно, когда компания намерена добиться климатических целей. Инвестфонд Green Century Capital Management сообщил о переговорах с NVIDIA для «вынесения резолюции», в соответствии с которой будут приняты меры для того, чтобы краткосрочные выгоды от ИИ не достигались ценой долгосрочных климатических и финансовых рисков. В первую очередь инвесторы требуют больше информации о расходе воды. По статистике Mordor Intelligence, в 2025 году североамериканские ЦОД использовали без малого 1 млрд м3 питьевой воды, что приблизительно равно годовой потребности Нью-Йорка.

Источник изображения: Parsing Eye/unspalsh.com Хотя Meta✴, Google и Amazon всё активнее используют в своих дата-центрах СЖО с замкнутым контуром, экономно расходующие воду, данные о реальных водных затратах значительно различаются, поскольку нет единых стандартов отчётности. В отчёте Meta✴ за 2025 год раскрыто потребление воды только на принадлежащих и используемых компании участках, но не на тех, которые она арендовала или на объектах в стадии строительства. Общее водопотребление увеличилось на 51 %, с 3,726 млрд м3 в 2020 году до 5,637 млрд м3 в 2024 году. В отчёте Google за 2025 год есть общие данные об объектах, находящихся в собственности или аренде, но информация об объектах, управляемых третьими сторонами отсутствует. По словам Amazon, компания всё чаще раскрывает данные о потреблении воды на конкретных объектах и стремится быть «хорошим соседом», инвестируя в повышение эффективности, ввод в эксплуатацию новых источников энергии и сокращение водопользования. Microsoft заявляет, что экоустойчивость является «основной ценностью» компании и она активно решает проблемы устойчивого развития, в то же время ускоряя разработку решений для достижения долгосрочного эффекта. Инвесторы подчёркивают, что решающее значение имеют именно данные о расходе на отдельных объектах, поскольку партнёры гиперскейлеров могут лучше оценить операционные риски и эффективность управления ресурсами. Так, Calvert Research and Management заявляет, что компании недостаточно подробно рассказывали о потреблении воды и его влиянии на местных жителей. Впрочем, инвесторы обычно ратуют не за экологию, а за надёжный возврат вложенных средств — недостаточная прозрачность отчётов тормозит строительство и развите всё более дорогостоящих ЦОД. Лоббистская группа Коалиция ЦОД (Data Center Coalition), куда входят четыре крупнейших гиперскейлера, заявляет, что улучшение взаимодействия с местными жителями — один из ключевых приоритетов в минувшем году. Жители должны понимать, что проекты не создадут дополнительной нагрузки на местные ресурсы, а люди будут защищены как плательщики коммунальных услуг. По мере того, как число ЦОД растёт, всё чаще случаются и перебои с водой и питанием близлежащих поселений, что вызывает всё большее беспокойство.

07.04.2026 [15:54], Сергей Карасёв

Anthropic развернёт 3,5 ГВт ИИ-мощностей на базе Google TPUАмериканская компания Anthropic, занимающаяся разработками в сфере ИИ, сообщила о расширении использования облачной инфраструктуры Google Cloud, а также ускорителей Google TPU. Это поможет в масштабировании больших языковых моделей (LLM), а также в развитии агентного ИИ и корпоративных приложений. О том, что Anthropic намерена закупить огромную партию чипов Google TPU, стало известно в конце прошлого года. Тогда говорилось, что будут приобретены около 1 млн ускорителей TPU v7 (Ironwood) общей мощностью примерно 1 ГВт. Позднее сообщалось, что часть изделий будет куплена напрямую у Broadcom, которая занимается выпуском TPU для Google. Как теперь отмечается, в общей сложности Anthropic получит доступ к «нескольким гигаваттами мощности на базе TPU»: ввод этих вычислительных ресурсов в эксплуатацию ожидается в начале 2027 года. Доступ к части ускорителей будет осуществляться посредством Google Cloud Platform (GCP). Ресурс The Register уточняет, что в общей сложности Anthropic получит 3,5 ГВт мощностей для ИИ-вычислений с использованием Google TPU. Вместе с тем Anthropic прогнозирует значительное увеличение выручки: ожидается, что в 2026 году она превысит $30 млрд. Недавно компания провела раунд финансирования на $30 млрд, в результате чего её капитализация достигла $380 млрд. Anthropic подчёркивает, что всего за два месяца количество её клиентов, которые платят не менее $1 млн ежегодно, поднялось в два раза, превысив 1 тыс. Сообщается также, что Anthropic продолжает расширять использование облачных сервисов Google Cloud, включая BigQuery, Cloud Run и AlloyDB. Тысячи клиентов получают доступ к ИИ-моделям Anthropic Claude именно через платформу Google Cloud: в числе таких пользователей названы Coinbase, Cursor, Palo Alto Networks, Replit и Shopify.

20.03.2026 [14:52], Руслан Авдеев

1 ГВт в подарок: Google посадит на «диету» свои ИИ ЦОД во время пиковых нагрузок на энергосетиGoogle модернизировала управлением питанием своих ЦОД в США, добавив возможность гибко регулировать их энергопотребление, что позволяет снизить нагрузку на энергосети в пиковые часы, когда электричество особенно востребовано. Не слишком срочные вычислительные нагрузки будут переноситься на другое время или даже в другие ЦОД. Первые эксперименты в этом направлении компания начала ещё в 2023 году. Компания объявила, что в рамках программы контроля спроса интегрировала в свои долгосрочные энергоконтракты с рядом коммунальных компаний на территории США совокупные мощности на 1 ГВт. Возможности Google по оптимизации спроса в зависимости от нагрузок на электросети позволяют ограничивать или переносить выполнение части задач в сфере ИИ и/или машинного обучения в своих ЦОД, чтобы стабилизировать состояние сети. На практике управлять энергией можно не только во время пиковых нагрузок, но и тогда, когда сетям просто не хватает энергии. После того, как компания продемонстрировала свою технологию управления потреблением электричества совместно с энергокомпанией Omaha Public Power District в 2024 году, в 2025 году было объявлено о соглашениях с Indiana Michigan Power (I&M) и Tennessee Valley Authority (TVA). На этот раз подписаны соглашения с Entergy Arkansas, Minnesota Power и DTE Energy, предполагающие взаимодействие для оптимизации управления энергоснабжением.

Источник изображения: Google Системы умного управления энергетикой начали применять во всём мире. Так, в конце 2025 года ведущий оператор электросетей Великобритании National Grid провёл первое в стране испытание «гибкой» системы электроснабжения дата-центров при участии Nebius и с использованием ИИ-системы управления нагрузками и питанием Emerald AI. Последняя смогла обеспечить энергопотребление на заданном уровне, сократить спрос на энергию до −40 % и сохранить исполнение критических нагрузок в штатном режиме.

12.03.2026 [12:28], Руслан Авдеев

Google завершила сделку по покупке Wiz за $32 млрд, обеспечив облачным клиентам новые инструменты защитыGoogle анонсировала закрытие крупнейшей покупки компании в своей истории — Wiz считается ведущей платформой по обеспечению безопасности для облачных и ИИ-сред. Бизнес Wiz присоединится к Google Cloud в миссии по защите клиентов во всех облачных экосистемах, говорит компания. Google подчёркивает, что в эпоху ИИ всё больше компаний и правительств переносят важные данные в облака. Поскольку организации действуют в облачных средах и активно используют ИИ, злоумышленники тоже применяют искусственный интеллект для атак с повышенной скоростью и интенсивностью. По словам Google, Wiz предлагает простую в использовании платформу безопасности с глубоким знанием облачных сред и особенностей разработки — компания способна работать со всеми ключевыми облачными средами и помогает реагировать на инциденты кибербезопасности. Это дополнит облачные возможности Google Cloud, включая её собственные механизмы и инструменты киберзащиты. Вместе компании предоставят унифицированную платформу безопасности, позволяющую организациям распознавать угрозы, предотвращать их и реагировать на них. Это поможет противостоять даже угрозам нового типа, организованным с помощью ИИ, защищать ИИ-модели и использовать искусственный интеллект для помощи экспертам в сфере информационной безопасности. Платформа также предоставит набор инструментов, процессов и политик для всех ключевых облачных сред на всех уровнях.

Источник изображения: Google Cloud Объединённые возможности упростят обеспечение мультиоблачной безопасности, расширяя возможности компаний по использованию облаков разных провайдеров. Компании и правительства смогут оптимизировать и автоматизировать защиту, одновременно масштабируя команды, занимающиеся обеспечением кибербезопасности, и снижая стоимость этой защиты. Комбинированная платформа также поможет защитить и малый бизнес, часто не имеющий опыта и ресурсов для самозащиты от всё более сложных и разрушительных киберугроз. Продукты Wiz, по данным Google, будут по-прежнему доступны во всех ключевых облачных средах, включая AWS, Google Cloud, Microsoft Azure и Oracle Cloud. При этом Google Cloud продолжит предоставлять клиентам выбор, предлагая партнёрские решения по обеспечению безопасности в Google Cloud Marketplace. Google пыталась приобрести Wiz ещё в 2024 году, предложив $23 млрд, но руководство стартапа отказалось от сделки, намереваясь выйти на биржу вместо превращения в дочернюю структуру Google. Wiz провела семь раундов финансирования, в ходе которых привлекла $1,9 млрд . Весной 2025 года Google предложила стартапу уже $32 млрд. 10 % этой суммы Google обязана была выплатить стартапу, если покупка в итоге не состоится. |

|