Материалы по тегу: облако

|

28.11.2025 [17:29], Владимир Мироненко

Alibaba и ByteDance натренировались тренировать передовые ИИ-модели в ЦОД Юго-Восточной АзииВедущие китайские компании, включая Alibaba и ByteDance, используют для обучения своих самых передовых больших языковых моделей (LLM) дата-центры за пределами страны по всей Юго-Восточной Азии, поскольку в Китае у них нет доступа к продвинутым ускорителям NVIDIA из-за экспортных ограничений США, пишет The Financial Times со ссылкой на информированные источники. По их словам, после введением администрацией США в апреле ограничений на продажи NVIDIA H20, предназначенных только для Китая, наблюдается устойчивая тенденция роста обучения ИИ-моделей китайских технологических компаний за рубежом. Один из операторов сингапурских ЦОД назвал такой выбор вполне очевидным: «Для обучения самых современных моделей нужны лучшие чипы, и всё это соответствует законодательству». В настоящее время в Сингапуре и Малайзии идёт бурное развитие бизнеса ЦОД, чему способствует и спрос со стороны Китая. Многие из них оснащены высокопроизводительными ускорителями NVIDIA. По словам источников, используется довольно простая схема. Китайские компании заключают договор аренды на использование зарубежных ЦОД, принадлежащих и управляемых некитайскими компаниями. Это соответствует требованиям экспортного контроля США, поскольку правило AI Diffusion rule («Правило распространения ИИ»), принятое в начале года при Джо Байдене (Joe Biden) для регулирования режима экспортного контроля ИИ-технологий и призванное закрыть эту лазейку, было отменено президентом США Дональдом Трампом в мае. Китайские компании не раз ловили на использовании зарубежных площадок — что в этом году, что в прошлом. Но есть и исключения. Например, DeepSeek обучает свои ИИ-модели, по словам осведомленных источников, внутри страны. Как сообщают источники, знакомые с ситуацией, DeepSeek удалось создать запас чипов NVIDIA до вступления в силу запретов на экспорт в США. Компания также тесно сотрудничает с китайскими производителями чипов, включая лидера отрасли Huawei, чтобы оптимизировать и разработать следующее поколение ИИ-ускорителей, сообщают источники. При этом Huawei рассматривает партнёрство с DeepSeek как стратегическую возможность для продвижения своих продуктов в КНР. За последний год ИИ-модели Qwen от Alibaba и Doubao от ByteDance получили признание в мире как одни из эффективных LLM. Qwen также получила широкое распространение среди разработчиков за пределами Китая, поскольку является open source-моделью. При этом большинство китайских компаний предпочитают использовать для обучения передовые ускорители NVIDIA, но вот для инференса, который становится всё более важным, они всё чаще обращаются к чипам местного производства. Китайские технологические компании также используют ЦОД в Юго-Восточной Азии для обслуживания своих зарубежных клиентов, поскольку те же Alibaba и ByteDance стремятся увеличить свою долю на мировом рынке облачных вычислений. Китайские компании также расширяют использование ЦОД в других регионах, например, на Ближнем Востоке. Вместе с тем, в связи с действующим в Китае запретом на вывод личных данных за пределы страны, тюнинг моделей для местных клиентов необходимо проводить в Китае, сообщили представители отрасли.

28.11.2025 [14:51], Руслан Авдеев

SAP предложила клиентам из Евросоюза суверенное ИИ-облако EU AI CloudНемецкая SAP представила европейское суверенное ИИ-облако EU AI Cloud, которое может быть развёрнуто в ЦОД самой SAP, на «доверенной европейской инфраструктуре» или on-premise в рамках SAP Sovereign Cloud. Над предложением SAP работала совместно с североамериканской Cohere, последняя предоставляет платформу North для развёртывания ИИ-агентов в частных инфраструктурах. Также предполагается прямая интеграция решений Mistral AI, OpenAI и др. Будут доступны IaaS, PaaS и SaaS. Основная задача EU AI Cloud — предоставить клиентам из Евросоюзая доступ к передовым ИИ-моделям с соблюдением GDPR, EU AI Act и прочих регуляций, касающихся хранения, передачи и обработки данных. В частности, IaaS-вариант EU AI Cloud гарантирует, что все данные останутся в ЕС и будут обрабатываться в сети европейских дата-центров SAP. Версия on-premise на базе SAP Sovereign Cloud On-Site обеспечивает клиенту полный контроль над данными и их обработкой, а также «юридический суверенитет». Доступ к платформе также организован через суверенное немецкое облачное решение SAP, работающее на базе Microsoft Azure — Delos Cloud. Проект Delos Cloud предлагает сервисы Microsoft Azure, которыми SAP управляет независимо от Microsoft. Физически они базируются в ЦОД в Германии и отделены от сети Microsoft, а также спроектированы с учётом требований Германии к безопасности данных и инфраструктуры. Также новое решение будет доступно в виде SaaS у некоторых других гиперскейлеров.

Источник изображения: SAP В сентябре 2025 года OpenAI тоже объявила, что сервисы для Германии будут доступны через Delos Cloud. Ранее SAP обещала предоставить 4 тыс. ускорителей для ИИ-нагрузок Delos. Сервисы SAP сегодня доступны в десятках ЦОД по всему миру. По данным компании, она располагает 32 площадками в Северной Америке, двумя — в Южной, 33 — в Европе, 15 — в Африке и на Ближнем Востоке, 20 — в Азии и 4 — в Австралии. Недавно компания объявила, что намерена инвестировать более €20 млрд ($23,3 млрд) в расширение суверенного облачного сервиса в Европе. Примечательно, что глава SAP Кристиан Кляйн (Christian Klein) ранее заявлял, что не видит смысла в построении в Европе собственной облачной инфраструктуры в противовес созданной здесь американскими гиперскейлерами. Доля местных игроков годами остаётся низкой, так что отказаться от услуг заокеанских компаний практически невозможно.

27.11.2025 [23:19], Владимир Мироненко

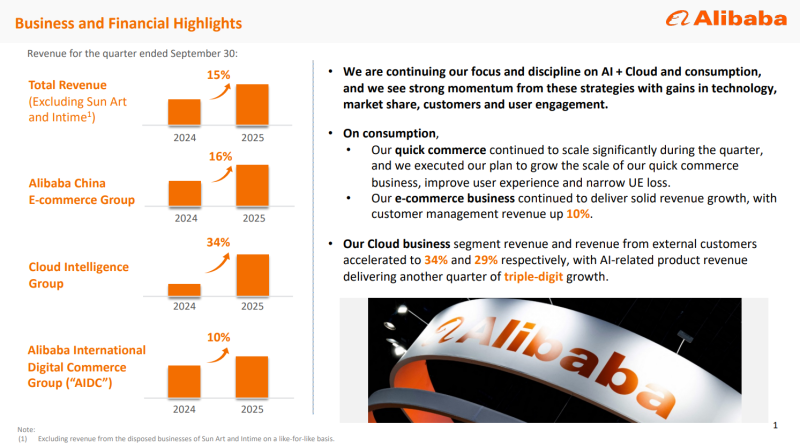

Сословное право доступа: из-за дефицита ИИ-серверов Alibaba Cloud вынужденно разделила клиентов на категорииAlibaba Group сообщила финансовые результаты за II квартал 2026 финансового года, завершившийся 30 сентября. Группа отметила значительный рост выручки своего облачного подразделения благодаря буму в сфере ИИ. В связи с этим генеральный директор Alibaba Group Эдди Ву (Eddie Wu) заявил, что группа может увеличить расходы на ИИ-инфраструктуру сверх своего трёхлетнего прогноза, если спрос на ИИ-технологии останется высоким. Однако общая выручка за квартал увеличилась всего на 5 % в годовом исчислении до ¥247,8 млрд ($35 млрд), а прибыль упала на 52 % по сравнению с прошлым годом до ¥20,99 млрд ($2,95 млрд). При этом выручка Cloud Intelligence Group увеличилась на 34 % год к году до ¥39,8 млрд ($5,6 млрд) против консенсус-прогноза аналитиков, опрошенных LSEG (по данным CNBC), в размере ¥37,9 млрд. Это выше роста в размере 26 % год к году в предыдущем квартале. Эдди Ву заявил, что «значительные» инвестиции группы в ИИ способствовали росту её выручки. Ранее компания объявила о планах инвестировать не менее ¥380 млрд ($53 млрд) в течение трёх лет в развитие своей инфраструктуры облачных вычислений и ИИ. «Высокий спрос на решения для ИИ ещё больше ускорил развитие нашего подразделения Cloud Intelligence Group: выручка выросла на 34 %, а выручка от продуктов, связанных с ИИ, достигла трехзначного показателя роста в годовом исчислении девятый квартал подряд», — сообщил Ву в квартальном отчёте. Согласно публикации The Register, гендиректор заявил, что «спрос на ИИ ускоряется» и углубляется благодаря спросу «во всех аспектах корпоративной деятельности… с применением в разработке продуктов, на всех этапах производственных процессов». «Мы даже не успеваем за ростом спроса со стороны клиентов, в том числе и в плане скорости развёртывания новых серверов», — добавил он. В связи с этим компания вынужденно приняла решение ограничить доступ к ним, разделяя клиентов по масштабу использования облачных мощностей. «Если клиент использует все наши облачные сервисы, охватывающие хранилища, Big Data и пр., то, конечно, он получит более высокий приоритет», — пояснил гендиректор. «Если же клиент просто арендует GPU для решения каких-то очень простых задач по инференсу, то его потребности, соответственно, будут иметь более низкий приоритет», — добавил он. Ставка делается и на программные оптимизации. Ву также выступил с опровержением опасений по поводу того, что ИИ — это инвестиционный пузырь, поддержав генерального директора NVIDIA Дженсена Хуанга (Jensen Huang) и генерального директора Lenovo Юаньцина Яна (Yuanqing Yang). Во-первых, по его словам, спрос на ИИ очень высок — Alibaba уже использует GPU на полную мощность — как последние модели, так и решения трёх-пятилетней давности. Во-вторых, он уверен в том, что всё лучшее в сфере ИИ ещё впереди, а по мере совершенствования базовых моделей Alibaba появятся новые сценарии использования, что привлечёт клиентов. Кроме того, компания разрабатывает собственные ИИ-ускорители T-Head PPU. Alibaba сообщила, что за последние 12 месяцев вложила ¥120 млрд ($16 млрд) в связанные с ИИ капитальные расходы. Это гораздо меньше, чем квартальные расходы Google, AWS, Microsoft или Meta✴. Только у AWS капзатраты за последний квартал составили около $34,2 млрд. В ходе общения с инвесторами Эдди Ву заявил, что нынешних капвложений может оказаться недостаточно, то есть, придётся их нарастить. Вместе с тем санкции США на поставку актуальных ускорителей и недостаток локальных аналогов сдерживает развитие Alibaba и других китайских игроков, отметил Bloomberg. Акции группы на фондовой бирже в Гонконге выросли во вторник на 2 %, а незадолго до открытия торгов на Нью-Йоркской фондовой бирже — на 2,4 %. С начала года акции Alibaba выросли более чем на 90 % благодаря оптимизму инвесторов относительно её прогресса в области ИИ, пишет AP News. Способность Alibaba контролировать расходы и одновременно инвестировать в облачные операции — это то, за чем инвесторы будут следить в долгосрочной перспективе, полагает Bloomberg.

27.11.2025 [21:00], Руслан Авдеев

Airbus уже семь лет переезжает с Microsoft Office на Google Workspace, но полностью отказаться от Excel и Word всё не получаетсяОсвободиться от офисных программ Microsoft сложнее, чем может показаться. Французская Airbus начала перевод 130 тыс. своих сотрудников с пакета Microsoft Office на облачную платформу Google Workspace более семи лет тому назад, но так его и не закончила, хотя изначально планировалось завершить миграцию в течение 18 мес., сообщает The Register. В 2018 году авиагигант объявил о миграции на облачные инструменты Google. И хотя сегодня более ⅔ из 150 тыс. сотрудников Airbus полностью перешли на новое ПО, значительная часть из них всё равно параллельно пользуется программами Microsoft. Так, сотрудники финансового отдела традиционно используют Excel, поскольку Google Таблицы не поддерживают требуемые размеры файлов — некоторые документы содержат по 20 млн ячеек. Коммерческий, закупочный и юридический отделы требуют надёжного отслеживания изменений в документах, но в Google Документах такая функция всё ещё не полностью совместима с режимом правок в Word. В результате ПО Google не может справиться со сложным форматированием документов и комментариями в Word-документах. В Google обещали, что 100-% совместимость появится в 2026 году, т.е. через 20 лет после запуска Google Docs. Некоторые источники в Airbus на условиях анонимности подтвердили, что проблемы с совместимостью сохраняются, поэтому многие вынуждены продолжить пользоваться Excel. При этом компания по-прежнему платит Microsoft за лицензии, но масштаб проблемы и объём расходов не называются. Существуют и другие препятствия, не имеющие отношения к Google. Так, секретные документы нельзя размещать в облаке, поэтому работа над военными проектами ведётся в локально развёрнутом ПО Microsoft.

Источник изображения: Jeremy/unsplash.com Впрочем, руководство Airbus хвалит Google за готовность работать над своим программным обеспечением для улучшения совместимости и повышения функциональности Workspace. Airbus — важный клиент Google, поэтому руководство последней считает жизненно важным сохранить партнёра с огромным числом пользователей с учётом того, что Google претендует на соперничество с Microsoft, обладающей огромной пользовательской базой. Впрочем, у Microsoft есть собственные значимые недостатки. Так, в сентябре 2025 года сообщалось, что компания намерена запретить перепродажу корпоративных лицензий Office и Windows компаниям, уже не испытывающим в них нужды — в Великобритании дело дошло до суда. А обвинения Microsoft в неконкурентном поведении уже стали привычными.

26.11.2025 [09:50], Руслан Авдеев

У Amazon насчитали более 900 ЦОД в полусотне стран, но компании всё равно этого малоИнфраструктура ЦОД Amazon, вероятно, гораздо масштабнее, чем принято считать. Выяснилось, что более 50 стран стали прибежищем для свыше 900 дата-центров компании, включая совсем небольшие объекты для периферийных сервисов, сообщает Bloomberg со ссылкой на данные SourceMaterial. Крупнейшие кампусы AWS находятся в США, в Вирджинии и Орегоне. Однако у компании есть множество как собственных ЦОД, так и арендованных на долгий срок объектов. Компания размещает стойки в сотнях колокейшн-ЦОД, при этом на них приходится лишь приблизительно 20 % всех вычислительных мощностей AWS. Где-то AWS размещает всего несколько стоек, а где-то, как во Франкфурте и Токио, арендует крупные ЦОД целиком. Согласно документам об энергопотреблении, крупнейшие арендуемые AWS ЦОД, вероятно, расположены во Франкфурте, Монреале, Мумбаи, Сеуле, Сингапуре и Токио или окрестностях этих мегаполисов. Точное местоположение дата-центров не раскрывается, но документы дают некоторое представление о возможностях компании. Они же свидетельствуют о том, что AWS является одним из крупнейших в мире арендаторов колокейшн-площадей. По словам New Relic, помогающей бизнесам управлять технологической инфраструктурой, помимо крупных ЦОД у гиперскейлеров обычно есть и более мелкие облачные объекты, но провайдеры не любят раскрывать их локации. Всего на начало 2024 года AWS пользовалась услугами более 440 колокейшн-ЦОД. Ещё более 220 дополнительных объектов относятся к периферийным, так что полноценными дата-центрами их назвать сложно. Они часто размещаются рядом с мегаполисами и на территории телеком-хабов. Как сообщают в AWS, хотя компания владеет и управляет большинством своих ЦОД, используются и возможности сторонних организаций, чтобы быстро реагировать на меняющиеся требования клиентов. При выходе на новые рынки или изменении спроса AWS опирается на сторонние компании, наращивая мощности для новых клиентов и ИИ-проектов. А, к примеру, в Китае, компания и вовсе обязана работать через местных партнёров. В конце 2023 года Amazon заявила, что имеет втрое больше дата-центров, чем ближайший конкурент. Речь шла о Microsoft, которая в то время имела портфолио из 300 объектов. Baxtel говорит о присутствии Amazon в 449 ЦОД на 49 рынках. DC Byte оценивает парк AWS в 364 объекта в 33 странах. Впрочем, точно установить количество невозможно, поскольку соглашения об аренде обычно носят конфиденциальный характер. В целом, судя по документам, Amazon имеет соглашения, как минимум, со 180 организациями в рамках колокейшн-договоров. По имеющимся данным, компания владеет зданиями общей площадью более 2,4 млн м2 и ещё примерно столько же арендует. Несмотря на огромный парк ЦОД, дела у компании не всегда идут гладко. Не всегда она успевает за спросом и не всегда может обеспечить необходимое качество услуг. Так, согласно Business Insider, нехватка ИИ-мощностей AWS и проблемы с производительностью заставили многих клиентов обратиться к соперникам. Тем не менее, в III квартале облако Amazon принесло $33 млрд и остаётся самым прибыльным в компании, т.ч. только в этом году объём капитальных затрат составит $125 млрд. Масштабы бизнеса стали очевидны в октябре, когда сбой AWS вывел из строя онлайн-сервисы по всему миру.

25.11.2025 [16:24], Руслан Авдеев

Нехватка ИИ-мощностей и проблемы с производительностью вынудили многих клиентов AWS обратиться к конкурентамЛетом 2025 года облачный бизнес Amazon (AWS) с трудом справлялся с растущим спросом на ИИ и упустил часть доходов. Сервис Bedrock занимает ключевое место в развитии ИИ-проектов компании. Однако летом Bedrock столкнулся с нехваткой мощностей, из-за чего некоторые клиенты ушли к конкурентам, в том числе к Google, сообщает Business Insider. Это привело к потерям десятков миллионов долларов и отложенной выручки. Например, проект Fortnite стоимостью $10 млн достался Google Cloud после того, как AWS не смогла выделить ей необходимые квоты (лимит на токены или вызовы API). Согласно внутреннему документу AWS, попавшему в распоряжение журналистов, нефтетрейдер Vitol также перенёс проекты из AWS, а некоторые крупные клиенты, включая Atlassian и GovTech Singapore, летом были вынуждены ожидать увеличения квот, что привело к «отсроченным продажам» минимум на $52,6 млн. Более того, задержки с одобрением выделения мощностей и отказ в обработке нерегулярных, вынудили Stripe, Robinhood и Vanguard отказаться от переноса нагрузок в Bedrock. Подчёркивается, что проблемы Bedrock потенциально ведут к потерям выручки и проблемам с клиентами. Это объясняет, почему облачные компании стремятся построить как можно больше ИИ ЦОД. Высокий спрос хорош только тогда, когда можно его удовлетворить и удержать клиентов от перехода к конкурентам. Бывшие и действующие сотрудники AWS отмечают, что проблемы с вычислительными мощностями были одними из наиболее значимых для компании в сентябре. AWS и раньше испытывала проблемы с нехваткой мощностей даже для собственных нужд, но сейчас ситуация обострилась. Тем временем в Amazon утверждают, что Bedrock быстро растёт, а AWS стремительно наращивает мощности для удовлетворения спроса, за 12 месяцев добавив 3,8 ГВт. Это больше, чем смогу получить любой другой облачный провайдер. AWS удвоила мощность с 2022 года и намерена сделать то же самое к 2027 году. Компания и далее намерена быть «очень агрессивной» в деле масштабирования вычислительных мощностей, причём AWS может монетизировать новые мощности «практически незамедлительно», а Bedrock имеет не меньший потенциал роста, чем EC2. Частично проблемы с Bedrock могут быть связаны с тем, что компания отдаёт предпочтение крупным клиентам. В октябре заявлялось, что большинство задач Bedrock выполняется с помощью «доморощенных» ИИ-чипов Trainium, но в основном нагрузки приходятся на нескольких очень крупных клиентов, которые, по-видимому, готовы вкладываться в развитие инструментов на не самой популярной платформе. Ожидается, что компании среднего размера в ближайшие месяцы тоже начнут использовать Trainium нового поколения. Впрочем, последние иногда всё ещё не могут конкурировать с чипами NVIDIA. Впрочем, помешала Bedrock не только нехватка мощностей. Так, Figma, Intercom и Wealthsimple предпочли использовать LLM Claude в Google Cloud или на платформе самой Anthropic из-за недостатка функций и высокой задержки в Bedrock. Британская госслужба Government Digital Service рассматривала переход в Microsoft Azure только потому, что Claude 3.7 Sonnet работала медленнее на платформе Bedrock. Thomson Reuters также выбрала Google Cloud для своего ИИ-продукта CoCounsel, поскольку сервис AWS оказался на 15–30 % медленнее и не имел ключевых правительственных сертификатов. В документе AWS отмечается, что платформа Bedrock уступает Google. Для моделей Gemini квоты в пять-шесть раз выше, а Gemini Pro побеждает Claude в Bedrock во многих бенчмарках. Хуже того, Gemini Flash обеспечивает сравнимое качество при кратно меньших затратах. Некоторые стартапы буквально «сбежали» по этой причине. TainAI перенесла 40 % задач на Gemini Flash, отказавшись от Claude в Bedrock и экономя тем самым $85 тыс./день, а Hotel Planner намеревалась перейти в Google Cloud или к OpenAI. Всё это было ещё до запуска Gemini 3. Ещё более важная проблема, согласно документу, заключается в том, что у AWS нет целостного видения ИИ-инференса, хотя это ключевой сервис Bedrock. Это сыграло на руку не только гиперскейлерам, но и компаниями поменьше. Без чёткой стратегии AWS рискует упустить одну из самых привлекательных возможностей на рынке ИИ. Но этим проблемы не ограничиваются. Октябрьский сбой AWS продемонстрировал зависимость мировой Сети от лидера облачного рынка, так что многие задумались о переносе хотя бы части нагрузок на другие платформы, а Евросоюз рассматривает необходимость ограничения возможностей американских облачных гигантов. В последние недели инвесторы обеспокоены расходами на ИИ, опасаясь возникновения очередного пузыря на рынке IT. В этом контексте дефицит мощностей для Amazon играет двоякую роль. Это свидетельствует, что спрос со стороны клиентов до сих пор высок. С другой стороны, дефицит — ещё одна причина тратить больше денег в развитие инфраструктуры, что повышает риск возникновения пузыря. Amazon утверждает, что намерена выделить $125 млрд на капитальные затраты в текущем году, и ещё больше — в 2026-м.

25.11.2025 [14:05], Владимир Мироненко

AWS потратит $50 млрд на расширение облачных мощностей для правительства США: +1,3 ГВт на ИИ и HPCAmazon объявила о планах инвестировать до $50 млрд в расширение инфраструктуры ИИ и HPC для правительства США. Компания начнёт реализацию проектов в 2026 году и планирует добавить почти 1,3 ГВт вычислительной мощности в регионах AWS Top Secret, AWS Secret и AWS GovCloud (US) на всех уровнях секретности путём строительства новых ЦОД. Федеральные агентства получат расширенный доступ к комплексным ИИ-сервисам AWS, включая SageMaker, Bedrock, Nova и Anthropic Claude. Также в их распоряжение будут предоставлены ведущие модели класса open-weight foundation, ИИ-ускорители Trainium и ИИ-инфраструктура NVIDIA, что позволит им разрабатывать индивидуальные решения в области ИИ, оптимизировать большие наборы данных и повышать производительность труда, сообщила Amazon. Ранее AWS, Google, Oracle, Microsoft, xAI и др. IT-гиганты предоставили госслужбам США существенные скидки на облачные услуги в рамках программы OneGov. Это позволит государственным агентствам ускорить обработку информации и принятие решений. Интеграция ИИ с моделированием и имитацией позволит им решать за считанные часы самые сложные задачи, на которые раньше уходили недели или месяцы, а также «автоматически обнаруживать угрозы и разрабатывать планы реагирования», обрабатывая спутниковые снимки, данные датчиков и исторические закономерности в «беспрецедентном масштабе». «Наши инвестиции в специализированную правительственную инфраструктуру ИИ и облачные технологии коренным образом изменят подход федеральных агентств к использованию суперкомпьютинга, — заявил генеральный директор AWS Мэтт Гарман. — Мы предоставляем агентствам расширенный доступ к передовым возможностям ИИ, которые позволят им ускорить выполнение критически важных задач — от кибербезопасности до разработки лекарств. Эти инвестиции устраняют технологические барьеры, сдерживавшие развитие правительства, и укрепляют лидирующие позиции Америки в эпоху ИИ». Компания отметила, что этот шаг подчёркивает позицию AWS как лидера в области государственных облачных вычислений, поддерживающего более 11 тыс. государственных учреждений. AWS уже давно предоставляет правительству США выделенные облачные регионы. В 2011 году она запустила AWS GovCloud (US-West), AWS Top Secret-East — изолированное облако для секретных рабочих нагрузок — в 2014 году, AWS Secret Region — в 2017 году, с 2018 года добавила второй регион GovCloud (US-East), AWS Top Secret-West, а в октябре 2025 года — AWS Secret-West. Компания не раскрывает точное местоположение ЦОД и регионов. Как пишет Data Center Dynamics, другие страны также доверяют AWS свою самую секретную информацию. В Великобритании в 2021 году сообщили, что три британских разведывательных агентства использовали AWS для хранения совершенно секретных данных. В 2024 году AWS получила контракт стоимостью $1,3 млрд правительства Австралии на строительство ЦОД для совершенно секретной информации — спецслужбы получат возможность работы без использования открытого интернета.

25.11.2025 [13:42], Андрей Крупин

Yandex B2B Tech открыла доступ к Alice AI LLM — самому мощному семейству нейросетей «Яндекса»Yandex B2B Tech (бизнес-группа «Яндекса», объединяющая технологии и инструменты компании для корпоративных пользователей, включая продукты Yandex Cloud и «Яндекс 360») сообщила о доступности пользователям облачной платформы Yandex Cloud нового семейства генеративных моделей — Alice AI LLM. Alice AI LLM является флагманской ИИ-разработкой компании «Яндекс». Модель построена на архитектуре MoE (Mixture of Experts) с технологией тренировки на основе обучения с подкреплением (Online RL). Нейросеть понимает около 20 языков (в том числе японский) и может быть использована для решения сложных задач: поиска по базам знаний и генерации результатов на основе найденной информации (RAG-сценарий), анализа документов, построения отчётов и аналитики, извлечения информации и автоматизации заполнения полей, форм и баз CRM, а также для создания «человеко-ориентированных» ИИ-ассистентов.

Источник изображения: пресс-служба «Яндекса» / company.yandex.ru Alice AI LLM доступна через OpenAI-совместимые Completions API и Responses API, а также собственный API генерации текста в форматах REST и gRPC. Модель поддерживает интеграцию с популярными open source-библиотеками LangChain, AutoGPT и LlamaIndex. В Yandex B2B Tech подчёркивают, что стоимость использования Alice AI значительно ниже, чем у опенсорсных нейросетей, благодаря оптимизированному под русский язык разделению текста на токены. В один токен в Alice AI помещаются примерно 4–5 символов на кириллице, а в опенсорсных моделях — примерно 2–3 символа. Таким образом, конечная стоимость использования Alice AI в 1,5–2 раза ниже открытых моделей с той же тарификацией. Кроме того, запросы пользователя к нейросети и ответы модели тарифицируются по-разному: токены «на вход» нейросети стоят в четыре раза дешевле, чем «на выход», что позволяет использовать модель более экономно.

24.11.2025 [22:25], Владимир Мироненко

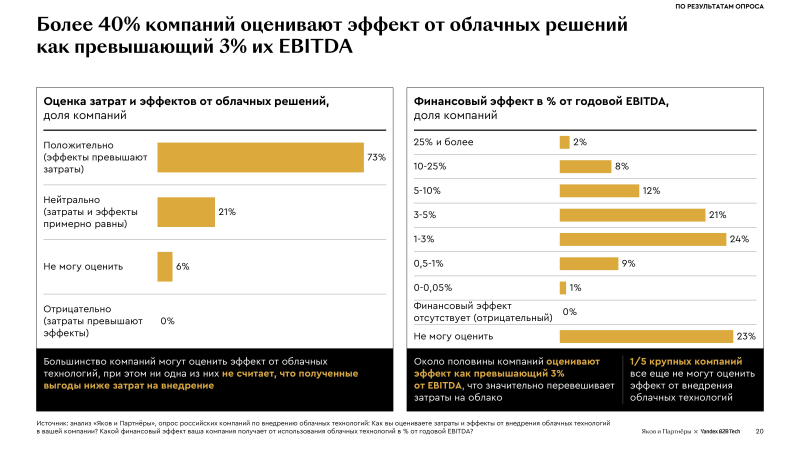

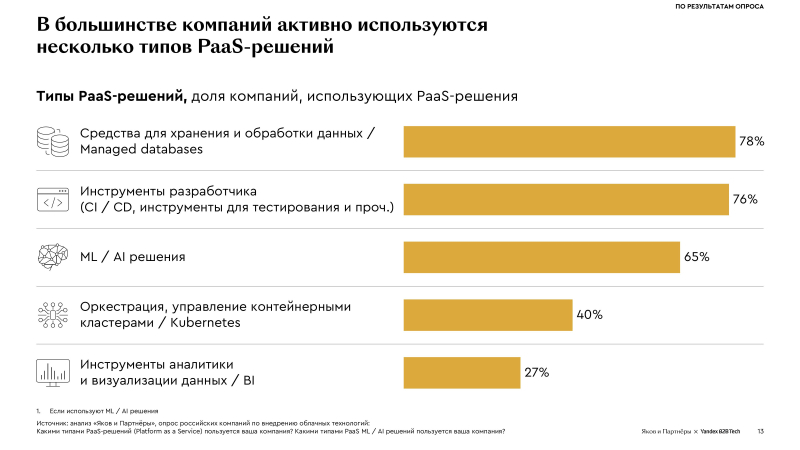

Внедрение облачных технологий увеличивает прибыль компаний, показало исследование Yandex B2B Tech и «Яков и Партнёры»Согласно совместному исследованию консалтинговой компании «Яков и Партнёры» и Yandex B2B Tech «Облачные технологии: тренды и перспективы развития», российские компании продолжают наращивать масштабы использования облачных сервисов, получая от внедрения облачных решений заметный финансовый эффект. В основу исследования легли результаты опроса руководителей 200 крупных российских компаний из 17 отраслей. По оценкам экспертов, большей частью высоким уровнем внедрения ИИ могут похвастать компании с высоким уровнем использования облаков — таких 30 %. При низком уровне использования облаков уровень внедрения ИИ составляет не более 2 %. Около половины компаний оценивают эффект от внедрения облачных решений как превышающий 3 % их EBITDA, что значительно больше затрат на облако. В цифровых отраслях финансовый эффект ещё выше: более 5 % EBITDA у компаний в сфере ИТ и технологий электронной коммерции, а также телекоме и медиа. У 73 % респондентов эффект превысил затраты, у 2 % — он оказался выше 25 %, но 23 % опрошенных всё ещё не могут его оценить. При этом главный результат внедрения компании видят не в прямой экономии, а в улучшение масштабируемости, повышении доступности данных и надёжности инфраструктуры. В этих условиях около половины компаний тратят на облачные решения более 5 % от годового ИТ-бюджета, а свыше 30 % планируют увеличить расходы в будущем. Большинство участников опроса (94 %) планируют и дальше использовать облачные технологии, причем 44 % намерены масштабировать существующие решения, 28 % — применять технологии в новых сценариях, 26 % — использовать облачные технологии в тех же объёмах. Половина компаний планирует увеличить количество провайдеров облачных услуг. При этом ключевым критерием при выборе компании называют качество платформы и сопутствующих сервисов, превышающим по значимости цену и модель ценообразования. Согласно опросу, компании быстро переходят к гибридной модели: более 70 % используют одновременно публичное облако и on-premise инфраструктуру. Проникновение решений PaaS и SaaS составляет 65–66 %, при этом свыше половины компаний (52 %) комбинируют IaaS-, PaaS- и SaaS. Компании активно используют PaaS для ускорения разработки, анализа данных и внедрения AI-технологий, в большинстве случаев — несколько типов. Наиболее востребованы решения для хранения и обработки данных (78 % респондентов), инструменты для разработчиков (76 %), сервисы в области ML и ИИ (65 %), оркестрация, управление контейнерными кластерами (40 %) и инструменты аналитики и визуализации данных (27 %). Отмечено, что аналитические платформы ускоряют подготовку отчётов более чем в два раза, автоматизация консультаций снижает нагрузку на клиентскую поддержку на 20 %, а генеративные сервисы для создания карточек товаров увеличивают скорость публикации в десятки раз. В исследовании отмечено, что глобальный рынок публичных облаков увеличился с 2020 по 2024 гг. почти втрое, до почти $600 млрд, и, согласно прогнозу, достигнет $1,26 трлн в 2028 году. По словам «Яков и Партнёры», на публичные облака приходится больше 60 % мирового рынка ПО, и при позитивном сценарии к 2030 году доля может составить порядка 80 %. При этом в России этот рынок всё ещё является недостаточно зрелым, занимая около 35 % рынка ПО. Вместе с тем прогнозируемые темпы его роста будут превышать мировые, и в течение следующих пяти лет рынок вырастет приблизительно в три раза, практически сравнявшись с on-premise. Согласно прогнозу экспертов, в 2030 году российский рынок облаков по основным типам решений достигнет рекордных 1,24 трлн руб. Основными драйверами его роста являются цифровизация отраслей и спрос на гибкие решения. Рынок включает в себя все облачные решения ПО, а также потребление частных облаков и внутригрупповое потребление решений облачных провайдеров. На внешнее потребление приходится около 70 %.

22.11.2025 [12:23], Сергей Карасёв

В Microsoft Azure появились инстансы с Intel Xeon 6 и CXL-памятьюКорпорация Microsoft в партнёрстве с SAP и Intel запустила в облаке Azure новые виртуальные машины семейства M-Series с технологией Compute Express Link (CXL). В настоящее время эти инстансы работают в режиме закрытого тестирования. Интерконнект CXL основан на интерфейсе PCIe: он обеспечивает высокоскоростную передачу данных с малой задержкой между хост-процессором и буферами памяти, акселераторами, устройствами ввода/вывода и пр. На днях была обнародована спецификация CXL 4.0, которая предусматривает поддержку линий с пропускной способности до 128 ГТ/с. Новые инстансы Azure базируются на процессорах Intel Xeon 6500P и 6700P поколения Granite Rapids-SP. В этих чипах реализована технология CXL Flat Memory Mode, которая позволяет оптимизировать соотношение вычислительных мощностей и ресурсов памяти. Это обеспечивает улучшенную масштабируемость без ущерба для производительности, что важно при работе с приложениями, требовательными к объёму памяти. В случае представленных виртуальных машин Azure поддержка CXL способствует более эффективной работе SAP S/4HANA. В частности, достигается большая гибкость в плане конфигурирования платформы, что помогает удовлетворять потребности конкретных бизнес-пользователей при одновременном снижении совокупной стоимости владения. «Инновационная архитектура инстансов с поддержкой CXL Flat Memory Mode ориентирована на повышение экономической эффективности и оптимизацию производительности программных решений SAP», — отмечает Intel. |

|