Материалы по тегу: ии

|

05.11.2025 [14:55], Руслан Авдеев

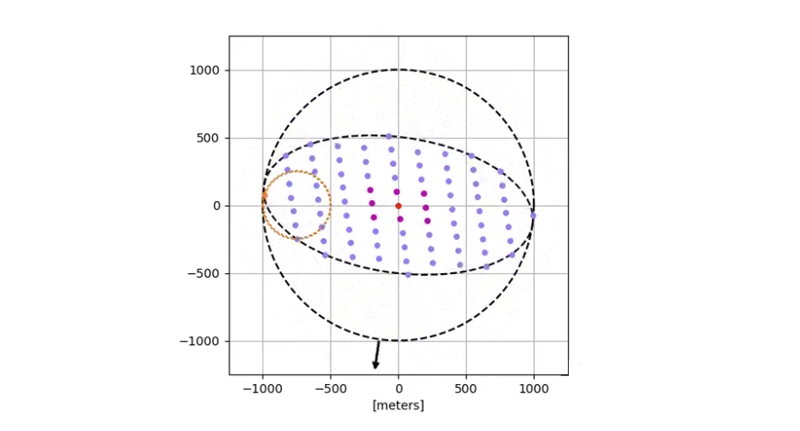

Project Suncatcher: Google рассказала о проекте масштабируемой ИИ-инфраструктуры в космосеGoogle рассказала об инициативе Project Suncatcher, предусматривающей использование группировок спутников-ЦОД на основе фирменных ИИ-ускорителей TPU. Предполагается, что спутники будут работать на солнечной энергии, в изобилии поступающей в околоземное пространство, сообщает пресс-служба техногиганта. Спутники будут связаны оптическими каналами. Размещать спутники в космосе компания намерена не случайно. При выборе подходящей орбиты солнечная панель может быть в восемь раз производительнее, чем на Земле и генерировать электричество практически непрерывно, не завися от погодных условий, что сведёт к минимуму потребность в использовании аккумуляторов. В будущем космос может стать оптимальным местом для масштабных ИИ-вычислений. Project Suncatcher предполагает создание относительно небольших спутниковых группировок с питанием от солнечных элементов, оснащённых TPU-ускорителями. Возможность использования оптических соединений друг с другом обеспечивает огромный потенциал масштабирования. Кроме того, к минимуму сводится воздействие на земные ресурсы. Компания опубликовала документ Towards a future space-based, highly scalable AI infrastructure system design, в котором описала прогресс в решении фундаментальных задач, связанных с реализацией проекта, включая высокоскоростную связь между спутниками. Учитываются орбитальная динамика и влияние радиации на вычислительные компоненты. Модульная структура обеспечит создание высокомасштабируемой ИИ-инфраструктуры в космосе в будущем.

Источник изображения: Javier Miranda/unsplash.com Предлагаемая система представляет собой сеть спутников на солнечно-синхронной низкой околоземной орбите, которые будут практически постоянно находиться под солнечными лучами. Выбор орбиты позволяет максимально эффективно использовать солнечную энергию и снизить потребность в использовании тяжёлых бортовых аккумуляторов. Тем не менее, предстоит решить ряд задач на пути к цели. Сначала необходимо обеспечить высокоскоростные оптические соединения с низкой задержкой в рамках распределённого космического ЦОД. Для того, чтобы производительность была сопоставима с земными аналогами, необходимо обеспечить связь в десятки терабит в секунду. Этого, возможно, удастся добиться с помощью спектрального уплотнения (DWDM) и пространственного мультиплексирования. Впрочем, для обеспечения необходимой пропускной способности необходима мощность сигнала в тысячи раз выше, чем в традиционных системах дальнего радиуса действия. Ожидается, что частично решить проблему можно будет, разместив спутники очень близко друг к другу (километры или даже меньше). Компания уже начала стендовые испытания подходящих технологий и добилась с парой приёмопередатчиков скорости передачи 800 Гбит/с в каждом направлении (всего 1,6 Тбит/с). Также пришлось разработать модели орбитальной динамики близко расположенных спутников, поскольку те должны летать гораздо более «компактно», чем любая существующая система. На динамику орбит, например, влияют несферичность гравитационного поля Земли и потенциальное сопротивление разреженной атмосферы при их движении. Модели показывают, что при размещении спутников на расстоянии в сотни метров друг от друга, скорее всего, потребуются лишь незначительные манёвры по поддержанию стабильности группировок в пределах нужной орбиты. Стоит отметить и необходимость обеспечения устойчивости TPU к условиям низкой околоземной орбиты. TPU v6e Trillium прошёл испытания в пучке протонов с энергией 67 МэВ для проверки их устойчивости к радиации. Наиболее чувствительными компонентами оказались HBM-модули, но в целом результаты оказались многообещающими для компонентов «из коробки» — TPU Trillium удивительно устойчивы к радиации для применения в космосе.

Источник изображения: Google Ключевую роль в успехе сыграет экономическая целесообразность проекта и стоимость запуска. Исторически именно высокие затраты на запуск были одним из основных препятствий для создания крупномасштабных космических систем. Тем не менее в Google прогнозируют, что к середине 2030-х гг. цены могут снизиться до менее $200/кг. В компании сообщают, что при таком уровне затрат стоимость запуска и эксплуатации космического ЦОД может стать приблизительно сопоставимой с заявленными затратами на питание эквивалентного наземного дата-центра в расчёте на кВт·ч/год. Предварительный анализ показывает, что непреодолимых физических и экономических препятствий для вычислений в космосе не имеется, но ещё предстоит решить ряд инженерных задач вроде проблем управления температурным режимом, обеспечения высокоскоростной наземной связи и надёжности орбитальных систем. Для решения этих задач следующим этапом станет учебная миссия при участии компании Planet, в рамках которой планируется запустить два прототипа спутников уже к началу 2027 года. Будет на практике проверена работа TPU и оптических межспутниковых каналов связи. В конечном итоге группировки гигаваттного масштаба возможно, выиграют от применения новых вычислительных архитектур, более подходящих для космической среды. Космических проектов в последние годы реализуется немало. Так, буквально в конце октября появилась новость, что Crusoe развернёт облачную платформу на спутнике Starcloud.

05.11.2025 [14:37], Владимир Мироненко

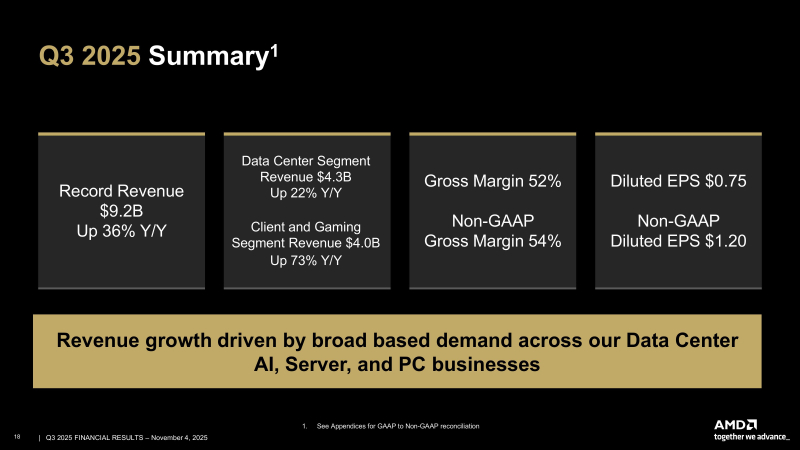

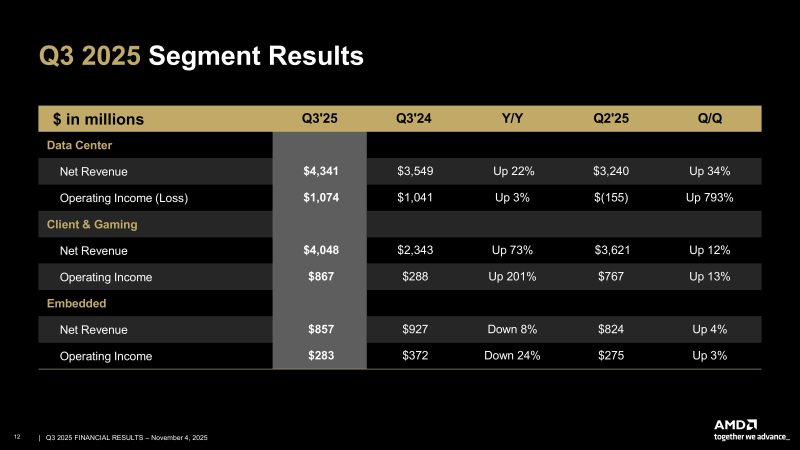

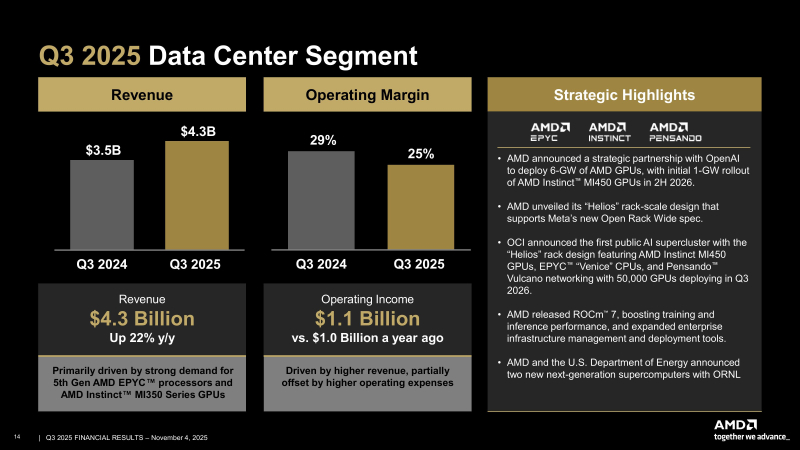

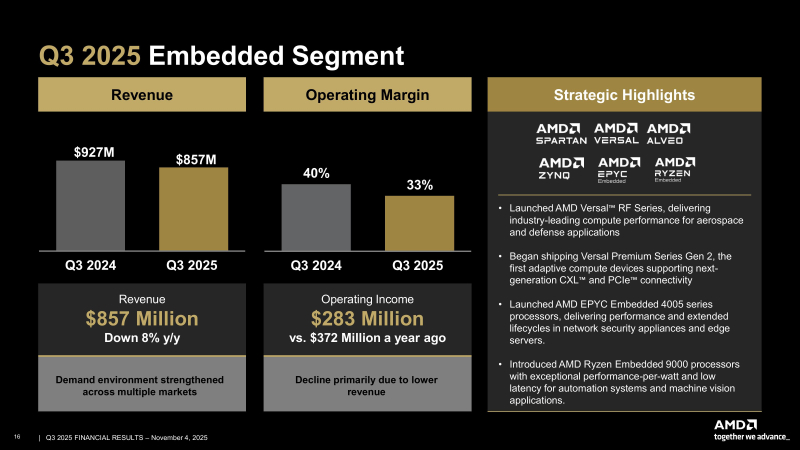

AMD объявила о рекордной квартальной выручке и предсказала дальнейший значительный ростAMD сообщила о рекордной выручке в III квартале 2025 года, составившей $9,25 млрд, что на 36 % больше результата аналогичного периода 2024 года и превышает консенсус-прогноз аналитиков, опрошенных LSEG, в размере $8,74 млрд (по данным CNBC). Скорректированная прибыль (Non-GAAP) на разводнённую акцию также превысила прогноз LSEG — $1,20 против ожидавшихся $1,16. Чистая прибыль (GAAP) AMD увеличилась в годовом исчислении на 61 % — до $1,24 млрд, или $0,75 на разводнённую акцию, с $771 млн, или $0,47 на акцию годом ранее. В IV квартале AMD ожидает выручку около $9,6 млрд ± 300 млн, что соответствует росту на 25 % в середине диапазона. Это превышает консенсус-прогноз LSEG в $9,15 млрд. AMD также прогнозирует скорректированную валовую рентабельность в размере 54,5 % за квартал, что совпадает с консенсус-прогнозом StreetAccount. AMD заявила, что прогноз не включает выручку от поставок чипов Instinct MI308 в Китай. То же самое компания отмечала в предыдущем квартале, однако теперь сообщила о возможности получения дохода от этих поставок. «Мы получили несколько лицензий на MI308, — заявила аналитикам генеральный директор AMD Лиза Су (Lisa Su) в ходе конференции по итогам квартала. — Мы продолжаем работать с нашими клиентами над оценкой спроса и общих возможностей». Подразделение ЦОД AMD, которое поставляет CPU и ИИ-ускорители, получило выручку в $4,34 млрд, увеличившуюся на 22 % в годовом исчислении — в основном благодаря высокому спросу на EPYC Turin и Instinct MI350. Это выше прогноза аналитиков StreetAccount в размере $4,13 млрд. Операционная прибыль подразделения ЦОД составила $1,07 млрд, немного превысив прошлогодний показатель $1,04 млрд. Компания ожидает очередного двузначного роста в сегменте в IV квартале благодаря высокому спросу на серверы и продолжающемуся росту продаж ускорителей серии MI350, пишет TrendForce. Выручка в сегменте встраиваемых систем составила $857 млн, снизившись на 8 % по сравнению с аналогичным периодом прошлого года, а операционная прибыль упала до $283 млн с $372 млн годом ранее. Выручка в клиентском и игровом сегментах составила $4,05 млрд (т.е. меньше, чем в сегмнете ЦОД), увеличившись на 73 % в годовом исчислении. В частности, в клиентском сегменте выручка достигла $2,75 млрд, что на 46 % больше консенсус-прогноза StreetAccount в $2,61 млрд. Выручка от игрового направления составила $1,30 млрд, увеличившись год к году в 2,8 раза при консенсус-прогнозе StreetAccount в $1,05 млрд. Говоря о перспективах бизнеса на фоне растущих опасений по поводу грядущего ИИ-пузыря, Лиза Су, как сообщает TrendForce, заявила, что сделка AMD с OpenAI, которая начнётся с поставок ускорителей MI450 на 1 ГВт во II половине 2026 года и в конечном итоге приведёт к развёртывания инфраструктуры на 6 ГВт, может дать мощный импульс бизнесу компании в области ИИ для ЦОД, потенциально принеся более $100 млрд дохода в ближайшие годы. Су также отметила, что компания пока не предоставляет полный прогноз на следующий год, но «исходя из текущих тенденций, мы ожидаем очень высокого спроса в 2026 году». Она добавила, что ожидается дальнейшее наращивание продаж ускорителей MI355 в первой половине 2026 года, тогда как серия MI450 поступит в продажу во второй половине, что обеспечит более резкий рост направления в сегменте ИИ-продуктов для ЦОД. Су признала, что рентабельность производства ускорителей для ЦОД обычно растёт по мере выхода новых продуктов на рынок после первоначального переходного периода. Хотя прогноз на 2026 год пока не определён, она подчеркнула, что основное внимание уделяется увеличению выручки и валовой рентабельности, а также постепенному повышению процентной маржи. Следует отметить, что инвесторы ожидали более высокого роста валовой рентабельности, чем на уровне прогнозов Уолл-стрит. Поэтому акции компании упали примерно на 3 % в ходе торгов, сообщило агентство Reuters, добавив, что в этом году акции AMD выросли более чем вдвое, при этом их рост опережает динамику ценных бумаг лидера рынка — NVIDIA.

05.11.2025 [14:30], Сергей Карасёв

Arista представила 800G-коммутаторы серии R4 для ИИ и облачных платформКомпания Arista анонсировала высокопроизводительные коммутаторы семейства R4 для крупномасштабных кластеров ИИ, дата-центров и облачных платформ. В серию вошли модели 7800R4, 7280R4 и 7020R4 для различных вариантов развёртывания. В основу новинок положен чип Broadcom Jericho3 Qumran3D. Для устройств заявлена поддержка современных архитектур, таких как EVPN, VXLAN, MPLS, SR/SRv6 и Segment Routing-TE. В некоторых моделях реализована технология HyperPort, которая объединяет четыре порта 800GbE в один канал с пропускной способность 3,2 Тбит/с. Модульная система Arista 7800R4 обеспечивает ёмкость до 460 Тбит/с, или до 920 Тбит/с в полнодуплексном режиме. Возможны конфигурации с 576 портами 800GbE, 1152 портами 400GbE или 4608 портами 100GbE. Пропускная способность достигает 173 млрд пакетов в секунду. Задержка — менее 4 мкс. Предусмотрены варианты исполнения 10U, 16U, 23U и 32U. Энергопотребление варьируется от 6,8 до 28 кВт. Упомянута поддержка HyperPort.

Источник изображения: Arista Коммутатор 7280R4, в свою очередь, предлагается в конфигурациях с 32 портами 800GbE (OSFP/QSFP-DD) или с 64 портами 100GbE + 10 портов 800GbE. Ёмкость достигает 25,6 Тбит/с (51,2 Тбит/с в полнодуплексном режиме), пропускная способность — 9,6 млрд пакетов в секунду. Устройство укомплектовано 8-ядерным процессором с архитектурой x86, 64 Гбайт DRAM и SSD вместимостью 480 Гбайт. Версия Arista 7020R4 может оснащаться 48 портами 1/10/25GbE SFP или RJ45 (плюс 4 или 8 восходящих каналов 100GbE). Ёмкость составляет до 2 Тбит/с, пропускная способность — до 1 млрд пакетов в секунду. Коммутатор несёт на борту 4-ядерный чип x86, 32 Гбайт DRAM и SSD на 120 Гбайт. Заявленная задержка находится на уровне 3,8 мкс.

05.11.2025 [14:09], Сергей Карасёв

Toshiba представила HDD серии S300 AI для ИИ-систем видеонаблюденияКорпорация Toshiba анонсировала HDD семейства S300 AI, разработанные для систем видеонаблюдения с использованием ИИ. Накопители оптимизированы для поиска и анализа видеоданных в режиме реального времени. Устройства поддерживают до 64 потоков с камер высокого разрешения и до 32 дополнительных потоков с ИИ, что позволяет осуществлять масштабирование в соответствии с меняющимися требованиями к видеонаблюдению. HDD выполнены в LFF-формате с применением технологии традиционной магнитной записи (CMR). Скорость вращения шпинделя составляет 7200 об/мин; для подключения служит интерфейс SATA-3. Диапазон рабочих температур простирается от +5 до +60 °C (на поверхности). В семейство S300 AI вошли модификации вместимостью 8, 10, 14, 16, 18, 20, 22 и 24 Тбайт. Первые две заполнены воздухом, остальные — гелием. Объём буфера равен соответственно 512 и 1024 МиБ, показатель MTBF (средняя наработка на отказ) — 2,0 и 2,5 млн часов. Установившаяся скорость передачи информации в зависимости от модели варьируется от 281 до 309 Мбайт/с, максимальная рабочая нагрузка достигает 550 Тбайт в год. Устройства рассчитаны на 600 тыс. циклов парковки магнитных головок; возможна эксплуатация в круглосуточном режиме 24/7. Энергопотребление при нагрузке — от 7,41 до 9,63 Вт, во время простоя — от 3,66 до 5,74 Вт. Накопители имеют размеры 147 × 101,85 × 26,1 мм и весят от 730 до 755 г. Реализована технология Rotational Vibration Safeguard (RVS), которая предотвращает негативное влияние вибрации на производительность HDD: это особенно важно для систем с большим количеством накопителей (изделия Toshiba S300 AI могут применяться в составе платформ, насчитывающих до 24 жёстких дисков). На новинки предоставляется пятилетняя гарантия. Поставки устройств вместимостью 8 и 10 Тбайт начнутся в текущем месяце, других модификаций — в I квартале 2026 года.

05.11.2025 [11:51], Руслан Авдеев

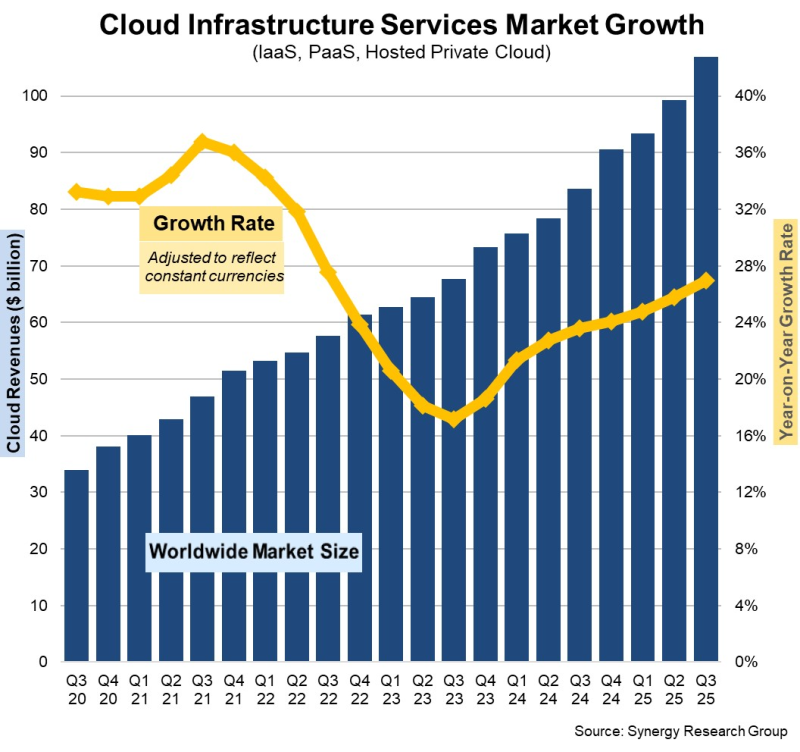

Synergy Research: квартальные затраты компаний на облачную инфраструктуру выросли на рекордные $7,5 млрдСогласно отчёту Synergy Research Group, расходы корпоративных клиентов на облачную инфраструктуру растут рекордными темпами. В текущем квартале они увеличились на $7,5 млрд (квартал к кварталу) — такого прежде не было. В сравнении с аналогичным периодом прошлого года рост составил 28 %, при этом рост показателей год к году происходит уже восьмой квартал подряд. В Synergy отмечают, что основной драйвер роста — генеративный ИИ, в этом сегменте лидером выступает Amazon. Впрочем, как утверждает Synergy, бизнес Microsoft и Google растёт в облачной сфере более быстрыми темпами. Доли рынка AWS, Microsoft и Google составляют 29 %, 20 % и 13 % соответственно. Сравнительно невысокие темпы роста недавно отмечались самой AWS, но компания крупнее конкурентов в облачном бизнесе. В III квартале выручка AWS составила $33 млрд. Для сравнения, Google Cloud заработала лишь $15,16 млрд. Общая выручка Microsoft от облачных решений составила $49,1 млрд. При этом выручка от Intelligent Cloud (в т.ч. Azure) принесла $30,9 млрд. Быстрее всего растут бизнесы провайдеров второго эшелона: CoreWeave, OpenAI, Oracle, Databricks и Huawei. При этом OpenAI и Databricks технически облачными провайдерами не являются, поскольку сами пользуются услугами компаний вроде CoreWeave. Последняя стала, пожалуй, самым значимым неооблаком и уже зарабатывает по $1 млрд в квартал. Как сообщает Synergy, объём рынка IaaS, PaaS и частных облаков (hosted) за квартал составил порядка $106,9 млрд, а выручка за последние двенадцать месяцев — $390 млрд. В основном заработок пришёлся на PaaS и IaaS. Наилучший рост рынка зарегистрирован в Индии, Австралии, Индонезии, Ирландии, Мексике и Южной Африке. Но крупнейшим рынком остаются США, по своим показателям они превосходят весь Азиатско-Тихоокеанский регион. Рынок США в III квартале вырос на 27 %. Европейские лидеры — Великобритания и Германия, самый быстрый рост — в Ирландии, Испании и Италии. В целом, как констатируют эксперты, показатели за III квартал очень впечатляют. Высокие результаты показали все ведущие облачные провайдеры, китайский рынок тоже растёт, а неооблака оказывают на рынок в целом ощутимое влияние. Драйвером роста остаётся генеративный ИИ — так, сегмент GPUaaS растёт более чем на 200 % ежегодно. По мнению экспертов, прогноз на ближайшие годы для облаков весьма благоприятен.

05.11.2025 [10:16], Владимир Мироненко

NVIDIA и Deutsche Telekom строят в Германии ИИ-фабрику стоимостью €1 млрд

b200

deutsche telekom

dgx

hardware

nvidia

omniverse

германия

ии

конфиденциальность

промышленность

цод

NVIDIA и Deutsche Telekom представили первое в мире промышленное ИИ-облако (Industrial AI Cloud) — суверенную корпоративную платформу, запуск которой запланирован на начало 2026 года в рамках совместного проекта стоимостью €1 млрд. Платформа использует передовое оборудование NVIDIA, включая системы DGX B200 и серверы RTX PRO, а также ПО, в том числе NVIDIA AI Enterprise, CUDA-X и Omniverse, полностью интегрированное в облачную и сетевую экосистему Deutsche Telekom. Deutsche Telekom сообщила, что NVIDIA поставит более тысячи систем NVIDIA DGX B200 и серверов NVIDIA RTX PRO с 10 тыс. ускорителей NVIDIA Blackwell. Оборудование уже устанавливается в модернизированном дата-центре в Мюнхене. Объект начнёт работу в I квартале 2026 года, ИИ-производительность его систем составит 500 Пфлопс (точность вычислений не указана). Сообщается, что благодаря запуску этой ИИ-фабрики вычислительная мощность ИИ-решений в Германии увеличится сразу на 50 %. Управление объектом площадью в несколько тысяч квадратных метров будет осуществлять Deutsche Telecom, а компания SAP, занимающаяся разработкой корпоративного программного обеспечения, предоставит свою платформу SAP Business Technology Platform и соответствующие приложения. Европейская компания Polarise, занимающаяся разработкой ЦОД, также будет участвовать в проекте, пишет DataCenter Dynamics. «Благодаря этим вычислительным мощностям Германия станет ведущей в Европе суверенной точкой ИИ-доступа, созданной в рамках исключительно частной инициативы», — отметила Deutsche Telekom. Сообщается, что Industrial AI Cloud — один из первых флагманских проектов инициативы Made for Germany («Сделано для Германии»), в которой участвуют более 100 компаний. Цель инициативы — укрепить позиции Германии как бизнес-площадки и ускорить цифровизацию экономики и управления страны. Компании смогут резервировать вычислительные мощности для разработки промышленных приложений ИИ. Облако также будет обслуживать государственные службы и оборонный сектор, пишет Reuters. Deutsche Telekom сообщила, что среди первых партнёров проекта — Agile Robots, чьи роботы, по слухам, будут использоваться для установки серверных стоек на объекте. Благодаря использованию NVIDIA Omniverse она расширит свои возможности по обучению, тестированию и валидации базовых моделей робототехники для целых парков роботов. Также в числе первых партнёров компания Perplexity, которая будет использовать новый ИИ ЦОД для предоставления услуг ИИ-инференса немецким пользователям и компаниям. Siemens сообщила, что будет использовать облачную платформу для ускорения внедрения промышленного ИИ, в том числе для собственных сервисов и для предложения решений на базе ИИ клиентам и партнёрам. По данным Siemens, такие автопроизводители, как Mercedes-Benz и BMW, будут использовать Industrial AI Cloud для проведения сложных симуляций с использованием цифровых двойников на базе ИИ, что значительно ускорит разработку автомобилей.

05.11.2025 [09:59], Сергей Карасёв

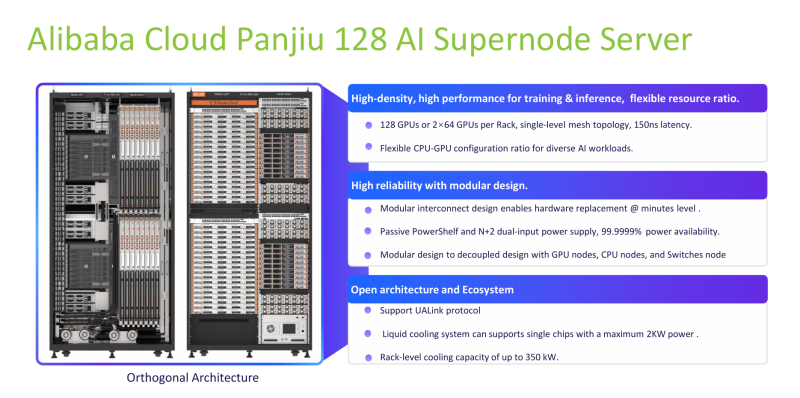

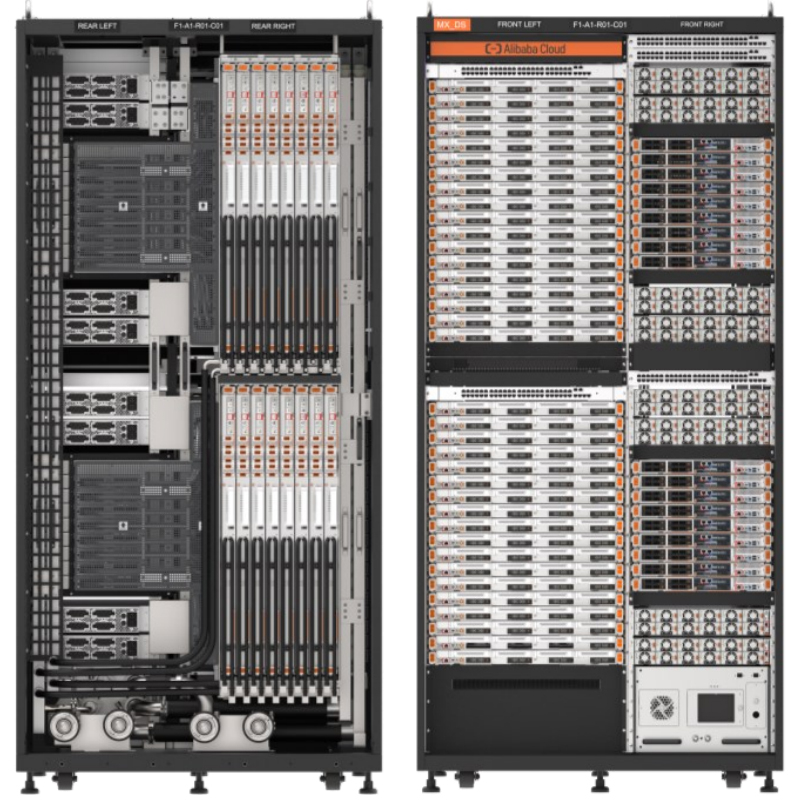

350-кВт ИИ-суперускоритель Alibaba Panjiu 128 Supernode объединяет 128 GPU мощностью до 2 кВтОблачная платформа Alibaba Cloud в ходе мероприятия 2025 OCP Global Summit анонсировала систему Panjiu 128 Supernode, предназначенную для решения наиболее ресурсоёмких задач в сфере ИИ. Новинка представляет собой стойку высокой плотности мощностью до 350 кВт. Решение имеет «ортогональную архитектуру» с возможностью размещения определённых компонентов перпендикулярно друг к другу. Говорится о поддержке до 128 ускорителей на базе GPU и о гибких возможностях в плане конфигурации CPU — GPU. Задействованы фирменные DPU-решения Cloud Infrastructure Processing Unit (CIPU) 2.0 и высокопроизводительные сетевые адаптеры. Кроме того, реализована поддержка протокола UALink, который разрабатывается в качестве альтернативы NVIDIA NVLink.

Источник изображения: Alibaba / OCP Благодаря модульной конструкции упрощаются обслуживание и замена узлов. Стойка оборудована высокоэффективной системой жидкостного охлаждения, которая позволяет использовать ускорители мощностью до 2000 Вт. В состав Panjiu 128 Supernode входят пассивные полки питания. При этом реализована схема энергоснабжения с резервированием N+2, что, по заявлениям Alibaba Cloud, помогает добиться доступности на уровне 99,9999 %. В целом, реализованная архитектура обеспечивает задержки на уровне 150 нс внутри одноуровневой mesh-фабрики. По сравнению с традиционными решениями сопоставимого класса ИИ-система на базе Panjiu 128 Supernode теоретически позволяет повысить производительность инференса на 50 %, говорит компания. Нужно отметить, что спрос на оборудование для ИИ-инфраструктур стремительно растёт. По оценкам IDC, во II квартале текущего года продажи серверов и СХД для ИИ-платформ в денежном выражении достигли $82 млрд, что на 166 % больше по сравнению с аналогичным периодом 2024-го ($30,8 млрд). Причем серверы с ИИ-ускорителями принесли 91,8 % от суммарной выручки.

04.11.2025 [23:12], Владимир Мироненко

Microsoft инвестирует $15,2 млрд в ИИ-инфраструктуру и подготовку кадров в ОАЭВ то время как Объединённые Арабские Эмираты (ОАЭ) проводят свои ежегодные конференции по энергетике и технологиям компания Microsoft поделилась подробностями об инвестициях в эту страну, общая сумма которых за период с 2023 по 2029 год составит $15,2 млрд. «Это не деньги, собранные в ОАЭ. Это деньги, которые мы тратим в ОАЭ. И, как и везде в мире, мы сосредоточены не только на развитии нашего бизнеса, но и на содействии развитию местной экономики», — сообщил Брэд Смит (Brad Smith), заместитель председателя совета директоров и президент Microsoft. По словам Смита, в 2023–2025 гг. общий объём инвестиций Microsoft в ОАЭ составит чуть более $7,3 млрд. Эта сумма включает инвестиции в акционерный капитал G42 в размере $1,5 млрд, более $4,6 млрд капвложений в передовые ИИ-технологии и ЦОД, а также более $1,2 млрд в виде местных операционных расходов и стоимости проданных товаров. В 2026–2029 гг. компания планирует инвестировать ещё $7,9 млрд, из которых $5,5 млрд будут направлены на дальнейшее расширение инфраструктуры, а $2,4 млрд придётся на операционные расходы и продажи. Смит отметил, Microsoft была одной из немногих компаний при предыдущей администрации Белого дома США, получивших экспортные лицензии Министерства торговли на поставку ускорителей в ОАЭ, благодаря чему она накопила в стране эквивалент 21,5 тыс. NVIDIA A100. Фактически это комбинация чипов A100, H100 и H200. Он добавил, что Microsoft стала первой компанией, получившей экспортные лицензии уже при новой администрации, которые позволяют поставить в ОАЭ эквивалент 60,4 тыс. A100, хотя в данном случае это будут уже GB300. Поставки позволят начать в Абу-Даби строительство ИИ ЦОД в рамках майского соглашения между Дональдом Трампом и президентом ОАЭ шейхом Мухаммедом бен Заидом Аль Нахайяном (Mohamed bin Zayed Al Nahyan), которое было приостановлено из-за экспортных ограничений США, пишет TechCrunch . Также Microsoft активно инвестирует в формирование кадров в ОАЭ и планирует к концу 2027 года обучить 1 млн человек. Программа включает в себя повышение квалификации 120 тыс. госслужащих федеральных и местных органов власти, а также обучение 175 тыс. студентов и 39 тыс. преподавателей. Ранее в этом году компания основала в Абу-Даби Глобальный центр развития инженерии (Global Engineering Development Center) для привлечения в ОАЭ технических специалистов мирового уровня. Здесь же был открыт новый центр Microsoft AI for Good Lab, где работают исследователи, специализирующиеся на ИИ-моделях и методах постобучения. А в феврале 2025 года Microsoft, G42 и Университет искусственного интеллекта имени Мохамеда бин Заида (MBZUAI) основали в Абу-Даби Фонд ответственного будущего ИИ (RAIFF), который продвигает этические стандарты ИИ на Ближнем Востоке и в странах глобального Юга.

04.11.2025 [22:46], Руслан Авдеев

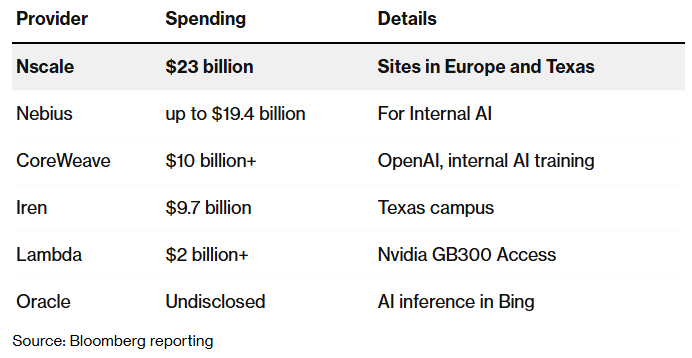

Microsoft потратит более $60 млрд на аренду ИИ-мощностей у неооблаков: подписаны новые сделки с Lambda и IrenLambda анонсировала многомиллиардное соглашение с Microsoft, которой она предоставит десятки тысяч ускорителей NVIDIA, включая новейшие системы GB300 NVL72. Точная сумма сделки не называется. Зато известен объём аналогичной сделки Microsoft с Iren, о которой было объявлено практически одновременно — Iren сдаст в аренду Microsoft ускорители за $9,7 млрд. По оценкам Bloomberg, общий объём соглашений Microsoft с неооблаками перевалил за $60 млрд. Сделка с Lambda расширяет взаимодействие между компаниями, которое развивается уже более восьми лет, и распространяется на множество дата-центров гиперскейл-уровня. Сейчас Lambda занимается строительством гигаваттных ИИ-фабрик, хотя одними из её первых продуктов были рабочие станции. Она относится к немногим независимым операторам ИИ ЦОД в США, конкурирующим с гиперскейлерами в этой сфере. Lambda предоставляет ИИ-облака, готовую аппаратную инфраструктуру и услуги колокации и пр. для обеспечения корпоративных клиентов гибким доступом к высокопроизводительным ИИ-кластеров. В последние годы Lambda активно расширяла бизнес при поддержке крупных инвесторов, в том числе Andreessen Horowitz, Crescent Cove, U.S. Innovation Fund и NVIDIA. Сделка с Microsoft свидетельствует о выходе компании на принципиально новый уровень конкуренции с гиперскейлерами. Это — следствие новой политики Microsoft, всё чаще полагающейся на сторонних партнёров и поставщиков ИИ-инфраструктуры, включая CoreWeave (более $10 млрд), Nscale ($23 млрд) и Nebius (до $19,4 млрд).

Источник: Bloomberg Соглашение с Iren предусматривает доступ к ИИ-ускорителям в течение пяти лет, 20 % от $9,7 млрд Microsoft заплатит вперёд. Кроме того, Iren согласилась потратить $5,8 млрд на закупку ИИ-решений и вспомогательного оборудования у Dell. Microsoft получит мощности в 750-МВт кампусе в Чилдрессе (Childress) в Техасе, где в течение 2026 году будут развёрнуты новые ЦОД с СЖО. Общая арендованная IT-мощность составит 200 МВт. Iren располагает дата-центрами в США и Канаде с 23 тыс. ускорителей, на 1 тыс. из них уже заключены контракты. Точное количество арендованных Microsoft ускорителей не называется.

04.11.2025 [16:35], Сергей Карасёв

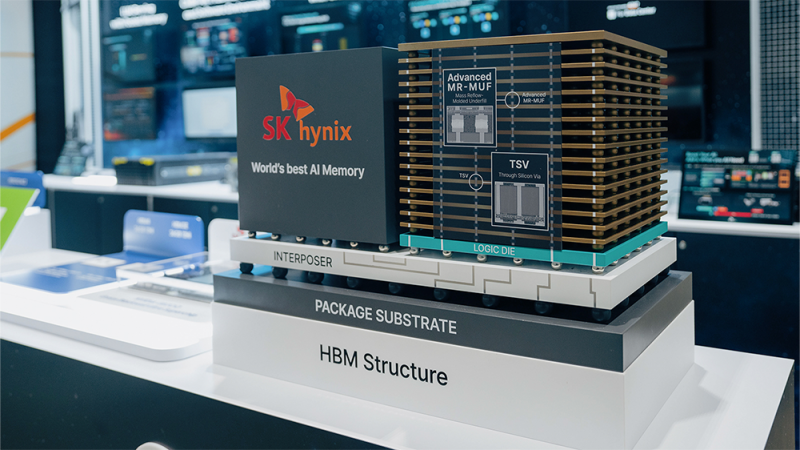

SK hynix разрабатывает AI-D — память для устранения узких мест в ИИ-системахКомпания SK hynix, по сообщению ресурса Blocks & Files, проектирует память нового типа AI DRAM (AI-D) для высокопроизводительных ИИ-платформ. Изделия нового типа будут предлагаться в трёх модификациях — AI-D O (Optimization), AI-D B (Breakthrough) и AI-D E (Expansion), что, как ожидается, позволит устранить узкие места современных систем. SK hynix является одним из лидеров рынка памяти HBM (Hgh Bandwidth Memory) для ИИ-ускорителей. Однако достижения в данной сфере отстают от развития GPU, из-за чего возникает препятствие в виде «стены памяти»: наблюдается разрыв между объёмом и производительностью HBM и вычислительными возможностями ускорителей. Проще говоря, GPU простаивают в ожидании данных. Одним из способов решения проблемы является создание кастомизированных чипов HBM, предназначенных для удовлетворения конкретных потребностей клиентов. Вторым вариантом SK hynix считает выпуск специализированной памяти AI-D, спроектированной для различных ИИ-нагрузок. В частности, вариант AI-D O предполагает разработку энергосберегающей высокопроизводительной DRAM, которая позволит снизить общую стоимость владения ИИ-платформ. Для таких изделий предусмотрено применение технологий MRDIMM, SOCAMM2 и LPDDR5R. Продукты семейства AI-D B помогут решить проблему нехватки памяти. Такие изделия будут отличаться «сверхвысокой ёмкостью с возможностью гибкого распределения». Упомянуты технологии CMM (Compute eXpress Link Memory Module) и PIM (Processing-In-Memory). Это означает интеграцию вычислительных возможностей непосредственно в память, что позволит устранить узкие места в перемещении данных и повысить общее быстродействие ИИ-систем. Ёмкость AI-D B составит до 2 Тбайт — в виде массива из 16 модулей SOCAMM2 на 128 Гбайт каждый. Причём память отдельных ускорителей сможет объединяться в общее адресное пространство объёмом до 16 Пбайт. Любой GPU сможет заимствовать свободную память из этого пула для расширения собственных возможностей по мере роста нагрузки. Наконец, архитектура AI-D E подразумевает использование памяти, включая HBM, за пределами дата-центров. SK hynix планирует применять DRAM в таких областях, как робототехника, мобильные устройства и платформы промышленной автоматизации. |

|