Материалы по тегу: hardware

|

26.09.2025 [00:20], Владимир Мироненко

MWS Cloud направит на развитие дата-центров 6,5 млрд рублейКомпания MWS Cloud (входит в МТС Web Services) планирует в ближайшие годы направить на развитие собственной инфраструктуры дата-центров порядка 6,5 млрд руб. Речь идёт о развитии второго модуля ЦОД GreenBush, строительстве нового ЦОД в Наро-Фоминске и поддержании работы ЦОД «Авантаж», насчитывающем 2240 серверных стоек. «В ближайшие годы мы введём в эксплуатацию почти 2 тысячи серверных стоек в наших дата-центрах», — сообщил исполнительный директор МТС Web Services. Как передаёт «Интерфакс», в этом году MWS Cloud построила новый модуль в ЦОД GreenBushDC на 600 серверных стоек, который запустили в эксплуатацию 25 сентября. С учётом этого общая вместимость дата-центра составила 1300 стоек, а общая мощность выросла до 12 МВт. Инвестиции в строительство нового модуля в течение 2024–2025 гг. составили 2,8 млрд руб. Часть этой суммы учтена в прогнозе инвестиций на развитие ЦОД компании. Планируемая мощность нового модульного ЦОД в Наро-Фоминске уровня Tier III на 1200 стоек составляет 20 МВт. Срок реализации проекта — около 1,5 лет. Планы MWS Cloud включают строительство в GreenBushDC третьего модуля на 600 стоек повышенной мощности. Также в 2026 году планируется запуск в тестовом режиме ИИ-блок в GreenBushDC, где будет ещё 12 стоек мощностью 60–105 кВт с СЖО. Стоимость этого проекта пока не известна. ЦОД MWS Cloud обеспечивает вычислительными мощностями как компании группы МТС, так и ведущие российские предприятия. По словам компании, последние годы спрос на услуги MWS Cloud растёт быстрее средних значений по рынку, что приводит к необходимости соразмерно расширять инфраструктуру ЦОД. У группы МТС 15 ЦОД в России, в том числе два коммерческих дата-центра (GreenBushDC и «Авантаж»), в общей сложности на 10 тысяч стоек. Ещё четыре дата-центра находятся в стадии проектирования и строительства. По оценкам iKS-Consulting, на конец I полугодия 2025 года МТС на рынке коммерческих ЦОД России занимала шестое место по количеству введённых стойко-мест — 2874 шт., как и в конце 2024 года.

25.09.2025 [16:54], Руслан Авдеев

«Европе нужен гиперскейлер»: Nscale привлекла $1,1 млрд инвестиций от Dell, Nokia и NVIDIAКомпания Nscale, начинающий застройщик ЦОД, привлекла $1,1 млрд на развитие бизнеса в Великобритании и за её пределами. В раунде финансирования серии B, возглавляемом Aker ASA, приняли участие Blue Owl, Dell, Fidelity Management & Research Company, G Squared, Nokia, NVIDIA, Point72 и T.Capital, сообщает Datacenter Dynamics. Обязались вложить больше cредств и действующие акционеры, включая Sandton Capital. Ранее сообщалось, что стартап намерен привлечь $2,7 млрд. «Европе нужен гиперскейлер, и Nscale принимает этот вызов», — заявила компания. В последние месяцы лондонская Nscale оказалась в центре внимания благодаря сделкам, связанным с созданием цифровой инфраструктуры с участием OpenAI, NVIDIA и Microsoft. В компании заявляют, что ИИ меняет отрасли, экономику и национальные стратегии, но без ЦОД, ускорителей и ПО всё это невозможно. В Nscale говорят о создании вертикально интегрированной основы для ИИ, призванной стать движущей силой технологических изменений нового поколения. Полученные средства Nscale направят на развитие ИИ-инфраструктуры в Европе, Северной Америке и на Ближнем Востоке, повторив путь CoreWeave. Nscale претендует на создание одной из крупнейших в своём роде глобальных платформ, специально разработанных для удовлетворения растущего спроса на ИИ и реализации революционных решений в беспрецедентных масштабах. Фактически Nscale была основана в 2024 году, когда основатели отказались от криптомайнинг и приобрели ЦОД в Норвегии у своей предыдущей компании Akkon Energy. Сейчас дата-центр, работающий от энергии ГЭС и использующий естественное охлаждение — единственный из имеющихся в распоряжении этого бизнеса. Тем не менее, у компании амбициозные планы по строительству объектов в Великобритании и других странах. В январе Nscale объявила о намерении потратить £2,5 млрд ($3 млрд) в Соединённом Королевстве, построив первый ЦОД в Лоутоне (Loughton, Эссекс). Ввод в эксплуатацию запланирован на 2026 год. Позже стало известно, что в ЦОД разместят суперкомпьютер Microsoft на ускорителях NVIDIA, который станет крупнейшим проектом такого рода в Великобритании. Также Nscale работает с OpenAI для обеспечения работы ЦОД в рамках проекта Stargate UK. Ожидается, что американский партнёр получит доступ к 8 тыс. ускорителей NVIDIA. Компании уже совместно работают над проектом Stargate Norway (Норвегия) — OpenAI в перспективе получит до 100 тыс. ИИ-ускорителей в Квандале (Kvanndal) близ Нарвика (Narvik) на севере Норвегии, строительством которого занимается Aker. Клиентом Nscale и Aker в Норвегии собирается стать и компания Microsoft, заключив контракт на закупку вычислительных мощностей на $6,2 млрд сроком на пять лет. Кроме того, соглашение с Nscale заключила и Nokia. По словам главы последней Джастина Хотарда (Justin Hotard), спрос на создание безопасной масштабируемой инфраструктуры в Европе и мире растёт, а интеллектуальная собственность Nokia и её опыт в области оптических сетей позволит компаниям внедрять инновации, необходимые для будущего ИИ-инфраструктуры.

25.09.2025 [11:37], Сергей Карасёв

Edgecore Networks представила ИИ-сервер AGS8600 на базе AMD EPYC Turin и Instinct MI325XКомпания Edgecore Networks анонсировала сервер AGS8600 формата 8U, построенный на аппаратной платформе AMD. Устройство, уже доступное для заказа, предназначено для решения ресурсоёмких задач в сферах ИИ, машинного обучения, НРС, научных исследований и пр. Система несёт на борту два 64-ядерных процессора EPYC 9575F поколения Turin с показателем TDP в 400 Вт. Доступны 24 слота для модулей оперативной памяти DDR5. Во фронтальной части расположены восемь отсеков для SFF-накопителей U.2 (NVMe): базовая конфигурация включает шесть SSD вместимостью 7,68 Тбайт каждый и два SSD на 1,92 Тбайт. Сервер укомплектован восемью GPU-ускорителями Instinct MI325X с 256 Гбайт памяти HBM3e и производительностью до 2,6 Пфлопс в режиме FP8. Задействованы семь линий Infinity Fabric в расчёте на GPU. В оснащение включены восемь однопортовых сетевых адаптеров BCM957608-P1400GDF00 400G QSFP112-DD PCIe Ethernet NIC. Кроме того, присутствуют два двухпортовых адаптера BCM957608-P2200GQF00 200GbE QSFP112 PCIe Ethernet NIC, выделенный сетевой порт управления 1GbE, контроллер ASPEED AST2600, два порта USB 3.0 и интерфейс D-Sub. За возможности расширения отвечают восемь слотов PCIe 5.0 x16 для карт половинной высоты и четыре разъёма PCIe 5.0 x16 для карт полной высоты. Питание обеспечивают шесть блоков мощностью 3300 Вт с сертификатом 80 Plus Titanium. Применена система воздушного охлаждения с 15 вентиляторами, допускающими горячую замену. Габариты составляют 448 × 850 × 351 мм. Диапазон рабочих температур — от +10 до +35 °C. На сервере используется ОС с ядром Linux. Среди поддерживаемого ПО упомянуты ROCm 6.2.4, RCCL 2.20.5, PyTorch 2.3/2.2/2.1/2.0/1.13, TensorFlow 2.16.1/2.15.1/2.14.1, JAX 0.4.26 и ONNX Runtime 1.17.3.

25.09.2025 [11:28], Сергей Карасёв

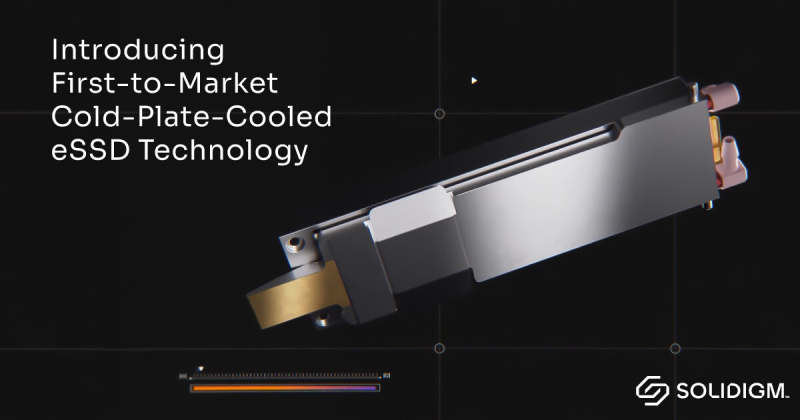

Solidigm представила первые в мире E1.S SSD с СЖО для ИИ-серверовКомпания Solidigm, принадлежащая южнокорейской SK Hynix, анонсировала, как утверждается, первые в мире SSD формата E1.S, оснащённые системой жидкостного охлаждения. Устройства предназначены для использования в безвентиляторных серверах с высокой плотностью компоновки, ориентированных на приложения ИИ. О новой СЖО для SSD впервые стало известно в марте нынешнего года. Решение предполагает использование охлаждающей пластины, которая располагается с одной стороны накопителя. При этом сами водоблоки и SSD монтируются бок о бок в дисковой корзине, что позволяет отводить тепло от обеих сторон твердотельного устройства хранения. Допускается горячая замена накопителей. СЖО подходит для использования с накопителями Solidigm D7-PS1010 стандарта E1.S толщиной 9,5 и 15 мм. Эти изделия, построенные на 176-слойных чипах флеш-памяти TLC 3D NAND, оснащены интерфейсом PCIe 5.0 x4 (NVMe). Доступны варианты вместимостью 3,84 и 7,68 Тбайт. Скорость передачи данных при последовательном чтении достигает 14 500 Мбайт/с, при последовательной записи — 10 500 Мбайт/с (8400 Мбайт/с у модификации на 3,84 Тбайт). Показатель IOPS при произвольном чтении находится в диапазоне 3,2–3,3 млн, при произвольной записи — 315–400 тыс.

Solidigm отмечает, что СЖО обеспечивает целенаправленный отвод тепла непосредственно от критически важных компонентов по обеим сторонам SSD, благодаря чему повышаются стабильность и производительность при высоких нагрузках. При этом увеличивается плотность монтажа компонентов, что помогает экономить пространство в серверах и, в конечном итоге, в дата-центрах. Компания Solidigm сотрудничает с ведущими производителями серверного оборудования для интеграции нового решения в передовые ИИ-системы. В число партнёров, в частности, входит Supermicro. Утверждается, что новые SSD могут использоваться в самых современных архитектурах с жидкостным охлаждением, включая серверы Supermicro на базе NVIDIA HGX B300.

25.09.2025 [07:58], Владимир Мироненко

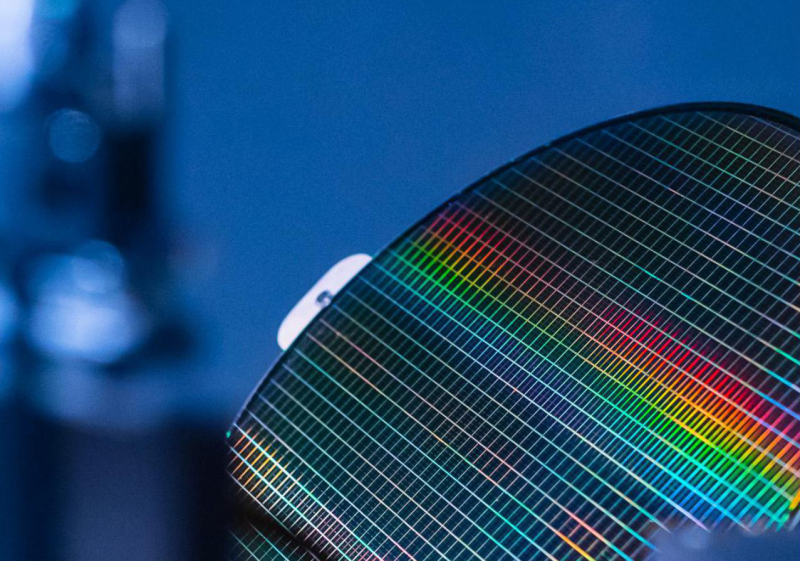

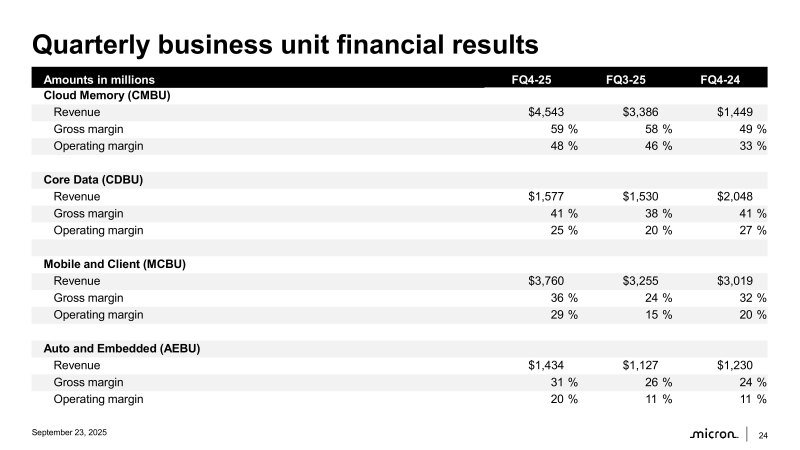

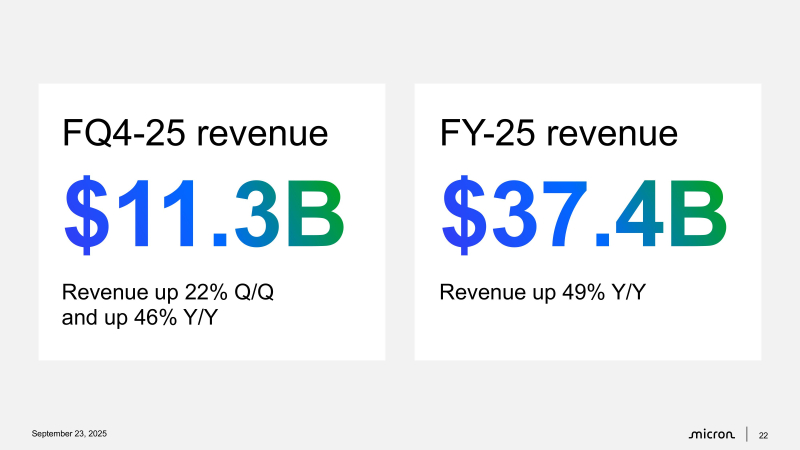

Micron объявила о рекордной выручке за последний квартал и весь 2025 финансовый годКомпания Micron Technology опубликовала финансовые результаты за IV квартал и весь 2025 финансовый год, завершившийся 28 августа, показав рекордную выручку, увеличив валовую прибыль и превысив прогноз по прибыли на акцию. Годовая выручка выросла почти на 50 % до 37,4 млрд, что является новым рекордом для компании. Прибыль на акцию (Non-GAAP) за год достигла $8,29, что на 538 % больше, чем в предыдущем финансовом году. Выручка за IV квартал выросла год к году на 46 % до рекордного значения $11,33 млрд, превысив консенсус-прогноз LSEG в размере $11,22 млрд, согласно данным CNBC. Скорректированная прибыль (Non-GAAP) на разводнённую акцию составила $3,03, что на 59 % больше, чем в предыдущем квартале, и на 157 % больше, чем годом ранее, а также больше консенсус-прогноза LSEG в размере $2,86. Чистая прибыль (GAAP) составила $3,2 млрд, или $2,83 на разводнённую акцию, против $887 млн, или $0,79 на акцию, годом ранее. Валовая прибыль за квартал выросла до 41 %, что на 17 п.п. больше, чем в предыдущем году. Micron изменила структуру отчётности своих бизнес-подразделений. До прошлого квартала у неё было в отчёте четыре бизнес-подразделения, включая Compute and Networking (CNBU), мобильное подразделение (Mobile, MBU) подразделение встраиваемых решений (Embedded, EBU) и подразделение решений для СХД (SBU). Теперь в отчёте указаны подразделения под названиями «Облачная память» (Cloud Memory, CMBU), «Основные данные» (Core Data, CDBU), «Мобильные устройства и клиентские устройства» (Mobile and Client, MCBU) и «Автомобильные и встраиваемые системы» (Auto and Embedded, AEBU). В связи с этим затрудняется анализ данных о производстве решений для СХД. Продажи подразделения CMBU, поставляющего память, включая HBM, для облачных провайдеров, выросла год к году на 214 % до $4,54 млрд, составив 40 % от общей выручки компании. Валовая прибыль подразделения достигла 59 %, что на 120 п.п. больше, чем в предыдущем квартале. Вместе с тем выручка подразделения CDBU, поставляющего чипы памяти для ЦОД, сократилась на 22 % до $1,58 млрд с $2,05 млрд годом ранее. Выручка от продаж DRAM в IV финансовом квартале достигла $8,98 млрд, что на 69 % больше, чем в предыдущем году, и составляет 79 % от общей выручки. Выручка от продаж NAND за IV квартал составила $2,25 млрд. Выручка от HBM за квартал достигла почти $2 млрд, что означает прогноз годовой доходности (ARR) почти в $8 млрд, благодаря стремительному росту продаж HBM3E. Как сообщает Blocks & Files, компания имеет соглашения практически со всеми клиентами на подавляющее большинство поставок HBM3E в 2026 календарном году. «Мы ведём активные переговоры с клиентами о спецификациях и объёмах поставок HBM4 и рассчитываем заключить соглашения о продаже оставшейся части общего объёма поставок HBM на 2026 календарный год в ближайшие месяцы», — сообщила Micron. Micron Санджей Мехротра (Sanjay Mehrotra) заявил, что компания достигла значительного прогресса в строительстве завода по сборке и тестированию HBM в Сингапуре, что позволит увеличить поставки этой памяти с 2027 календарного года. Он также отметил, что техпроцесс 1γ достиг зрелости в рекордные сроки. «Мы стали первыми в отрасли, кто начал поставлять DRAM 1γ, и будем использовать 1γ во всем нашем портфеле DRAM. В этом квартале мы получили первый доход от клиента-гиперскейлера по нашим продуктам DRAM 1γ для серверов», — добавил он. Капитальные затраты компании за квартал составили $4,9 млрд, в основном из-за инвестиций в производство DRAM. У Micron есть шесть клиентов-покупателей памяти HBM. Компания сообщила, что доля поставок HBM, вероятно, снова вырастет и будет соответствовать общей доле DRAM на рынке в III квартале этого календарного года. Поскольку ожидается, что объём рынка HBM в 2026 году составит $50–60 млрд, ожидаемая доля Micron в 22,5 % составит $12,58 млрд, то есть, по $3,1 млрд в квартал, подсчитал Blocks & Files. Micron заявила, что к 2030 году объём целевого рынка HBM достигнет $100 млрд. «Цена на HBM4 на самом деле значительно выше, чем на HBM3E», — сообщил агентству Reuters директор по развитию бизнеса Сумит Садана (Sumit Sadana). «Из-за очень напряженной ситуации в отрасли… мы ожидаем довольно высокой окупаемости инвестиций в наш бизнес HBM», — добавил он. Micron прогнозирует продажи в I квартале 2026 финансового года в размере $12,50 млрд ± $300 млн, по сравнению со средним прогнозом аналитиков в $11,94 млрд, согласно данным, собранным LSEG. Micron также прогнозирует скорректированную валовую прибыль в размере 51,5 % ± 1,0 %, что значительно выше прогнозируемых аналитиками 45,9 %. Рост валовой прибыли обусловлен «лучшей, чем ожидалось, ценовой конъюнктурой», отметил Киннгай Чан (Kinngai Chan), аналитик Summit Insights. Micron заявила, что ожидает рост продаж решений для серверов в 2025 календарном году примерно на 10 %, что «выше предыдущих ожиданий на уровне нескольких процентов», при этом рост как в ИИ-сегментах, так и в сегментах традиционных серверов будет способствовать увеличению спроса на оперативную память.

24.09.2025 [18:13], Руслан Авдеев

AI Pathfinder намерена потратить £18,4 млрд на два ИИ ЦОД в ВеликобританииКомпания AI Pathfinder, новичок на рынке ЦОД, объявила о намерении вложить до £18,4 млрд ($24,86 млрд) в цифровую инфраструктуру Великобритании. В частности, планируется строительство объектов в Англии и Шотландии, сообщает Datacenter Dynamics. Компания готовится потратить £3,4 млрд ($4,6 млрд) на дата-центр в графстве Нортгемптоншир (Northamptonshire). Первую фазу проекта намерены ввести в эксплуатацию ещё до конца текущего года. До £15 млрд ($20,2 млрд) пойдут на ЦОД в Эйршире (Ayrshire) в технопарке i3. Хотя компания не раскрывает точное местоположение нового ЦОД в Англии, она сообщила, что тот будет готов к эксплуатации к декабрю 2025 года. Первый этап строительства включает создание «ИИ-фабрики» на решениях Dell и NVIDIA, способной выполнять сложные ИИ-задачи. В Шотландии первоначальные инвестиции намечены на 2026 год, там будет развёрнуто значительно количество ИИ-ускорителей. Ожидается, что площадка на 1 ГВт превратится в один из крупнейших узлов ИИ-инфраструктуры в Европе, с потенциалом масштабирования до 1,5 ГВт. По данным AI Pathfinder, компания будет использовать мощности для предоставления ИИ-сервисов клиентам из частных и государственных структур, без сдачи в аренду гиперскейлерам. В компании заявляют, что медленное внедрение ИИ может стать экзистенциальным риском для организаций всех профилей, а её платформа «ИИ как услуга» (AI-as-a-Service) позволит бизнесу, госслужбам и публичным сервисам внедрять инновации «со скоростью гиперскейлеров» без ущерба безопасности и конфиденциальности. По некоторым данным, AI Pathfinder является дочерней структурой инвестиционной группы Salamanca Group, специализирующейся на недвижимости. Последний утверждает, что привлёк £14 млрд ($18,9 млрд) на финансирование своих проектов, в том числе не связанных с ЦОД. Обе компании имеют общий адрес в Лондоне, а также «делят» некоторых топ-менеджеров. Как будут финансироваться новые ЦОД и в какие сроки потратят все выделяемые средства, пока не разглашается. На прошлой неделе также были анонсировании крупные инвестиции в ИИ-инфраструктуру Великобритании со стороны американских IT-компаний. Google потратит £5 млрд ($6,9 млрд), а BlackRock — $678 млн. Также об инвестициях в ИИ ЦОД в Великобритании на £1,5 млрд ($2 млрд) заявила CoreWeave, а OpenAI и NVIDIA объявили о запуске проекта Stargate UK совместно с Nscale.

24.09.2025 [16:55], Владимир Мироненко

OpenAI арендует, а не купит чипы у NVIDIA в рамках $100-млрд сделкиВ СМИ появились новые подробности о сделке NVIDIA и OpenAI, в рамках которой чипмейкер инвестирует в OpenAI $100 млрд. Как сообщает газета The Financial Times, переговоры прошли напрямую между гендиректором NVIDIA Дженсеном Хуангом (Jensen Huang) и главой OpenAI Сэмом Альтманом (Sam Altman). Главы компаний обсуждали подробности соглашения практически без официальных консультаций с банками, которые обычно выступают посредниками в подобных случаях. По данным The Information, в числе обсуждаемых вопросов было применение новой бизнес-модели лизинга чипов. Вместо того чтобы напрямую приобретать ускорители NVIDIA, OpenAI фактически будет брать у NVIDIA чипы в аренду с постепенной оплатой, что потенциально снизит первоначальные затраты на 10–15 % в течение пяти лет. Точные условия аренды или лизинга не разглашаются. У кого останутся чипы после окончания срока действия договора, тоже не говорится.

Источник изображения: NVIDIA Данный подход отражает более широкую тенденцию в ИИ-отрасли, где капиталоёмкая ИИ-инфраструктура рассматривается скорее как услуга, чем как основной актив. Такая бизнес-модель позволяют компаниям быстро масштабироваться без значительных капитальных затрат, в то время как NVIDIA обеспечивает себе долгосрочные источники дохода. Как отметил Альтман, сделка знаменует собой «новую модель финансирования <…>, при которой мы можем платить постепенно, а не покупать всё сразу». «Чипы и системы составляют огромную [долю] стоимости, и оплатить её авансом сложно», — добавил он. По словам аналитиков, действия Хуанга, направленные на то, чтобы сделать NVIDIA «предпочтительным стратегическим партнёром OpenAI в области вычислений и сетевых технологий», затруднят переход ИИ-разработчиков на конкурирующие чипы. Также укрепляет позиции компании в отрасли программная платформа NVIDIA CUDA, ставшая стандартным инструментом написания ИИ-приложений. Удерживая ИИ-разработчиков в своей экосистеме, Хуанг инвестирует в OpenAI, а также в десятки других стартапов, занимающихся ИИ-приложениями, облачными вычислениями, робототехникой и здравоохранением, что «многократно окупится для NVIDIA в будущем», говорят эксперты.

24.09.2025 [15:33], Руслан Авдеев

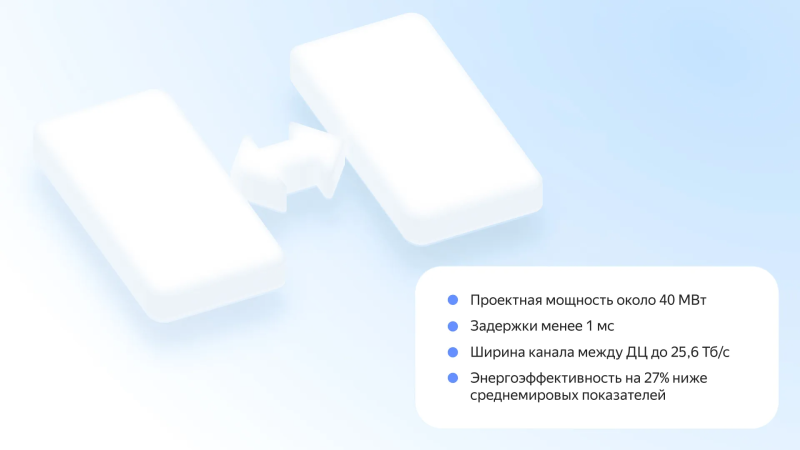

«Яндекс» строит во Владимирской области новый ЦОД, где разместится новая зона доступности Yandex CloudYandex Cloud намерена запустить в начале 2026 года новую зону доступности на базе дата-центра компании, сообщают «Ведомости». Это уже шестой ЦОД «Яндекса», его мощность составит более 40 МВт. Новый объект разместят неподалёку от уже действующего дата-центра «Яндекса». По данным пресс-службы «Яндекса», зона будет обеспечивать (минимальную) задержку до соседней зоны менее 1 мс, а общая ёмкость канала составит 25,6 Тбит/с. В компании подчёркивают, что такие показатели позволят ускорить работу критически важных для банков, ритейлеров и других крупных клиентов сервисов, требующих транзакций, бронирования и запросов во внутренние базы данных. Новая зона доступности получит независимые каналы для связи с другими зонами, что повысит общую надёжность системы. В «Яндексе» подчеркнули, что спрос на облака только увеличивается, в I полугодии 2025-го спрос на vCPU в Yandex Cloud вырос на 29,6 % год к году. Также в компании утверждают, что она первой в России запустила инструменты для проведения учений по отказоустойчивости инфраструктуры. PUE нового объекта будет на уровне 1,1 — благодаря использованию фрикулинга в течение всего года.

Источник изображения: Яндекс Как сообщают «Ведомости», по оценкам экспертов Apple Hills Digital, инвестиции в проект превышают 15–20 млрд руб. Новая зона доступности будет драйвером потребления сервисов текущими клиентами «Яндекса». Эксперты предполагают, что новое решение усилит позиции компании на рынке отечественных облаков. На фоне высокой фрагментированности российского облачного рынка у «Яндекса» сильная позиция, которую дополнительно укрепит открытие новой зоны доступности. В апреле сообщалось, что в Можайском округе Московской области построят очередной дата-центр «Яндекса» с инвестициями в объёме $16 млрд. Ввод в эксплуатацию запланирован на 2027 год.

24.09.2025 [13:37], Сергей Карасёв

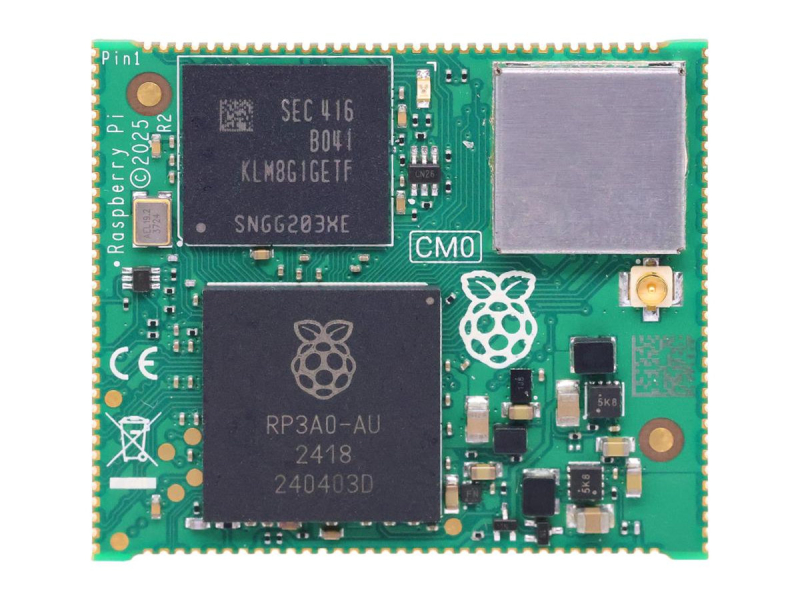

Raspberry Pi готовит вычислительный модуль CM0 с поддержкой Wi-Fi 4 и Bluetooth 4.2 LEКомпания Raspberry Pi, по сообщениям сетевых источников, продемонстрировала в Китае на мероприятии China International Industrial Expo вычислительный модуль Compute Module 0 (CM0). Ожидается, что новинка поступит в продажу по ориентировочной цене от $18. Основой решения служит система Raspberry Pi RP3A0 SiP (System-in-Package), которая содержит процессор Broadcom BCM2710A1 и 512 Мбайт оперативной памяти LPDDR2. В свою очередь, чип BCM2710A1 объединяет четыре вычислительных ядра Arm Cortex-A53 с частотой 1 ГГц, графический ускоритель VideoCore IV с поддержкой OpenGL ES 1.1/2.0 и VPU-блок с возможностью декодирования материалов H.264/MPEG-4 1080p30 и кодирования H.264 1080p30. Новинка будет доступна в модификациях без встроенной флеш-памяти (Raspberry Pi CM0 Lite), а также с накопителем eMMC вместимостью 8 или 16 Гбайт. В оснащение опционально могут быть включены контроллеры Wi-Fi 4 (802.11b/g/n) и Bluetooth 4.2 LE. Говорится о поддержке интерфейсов SDIO (только Raspberry Pi CM0 Lite), HDMI, TV DAC, MIPI DSI (4 линии), DPI (Display Parallel Interface), MIPI CSI (4 линии), PCM, USB 2.0, 28 × GPIO, UART, SPI, 2 × I2C. Размеры вычислительного модуля составляют 39 × 33 мм. Диапазон рабочих температур простирается от -20 до +85 °C. Для новинки будет доступна дополнительная интерфейсная плата Raspberry Pi CM0 I/O Board. Она оснащена разъёмом HDMI, двумя портами Micro-USB (питание и данные), коннекторами MIPI-DSI и MIPI-CSI, слотом для карты microSD и 40-контактной колодкой GPIO. Решение, как отмечает CNX Software, по всей видимости, сможет работать под управлением Raspberry Pi OS.

24.09.2025 [12:52], Руслан Авдеев

Гигаватт в неделю: OpenAI задумала развернуть крупнейшее производство ИИ-инфраструктурыПо словам главы OpenAI Сэма Альтмана (Sam Altman), ИИ-сервисы растут удивительными темпами, а в будущем они будут ещё более впечатляющими. По его мнению, по мере того как искусственный интеллект становится всё «умнее», доступ к нему становится базовым драйвером экономики и, в конце концов, такой доступ, возможно, признают одним из фундаментальных прав человека. Практически каждый захочет, чтобы ИИ всё больше работал от его имени. Для того, чтобы обеспечить мировые потребности в инференсе и обучении ИИ-моделей для их дальнейшего совершенствования, уже сегодня закладываются основы для значительного расширения строительства ИИ-инфраструктуры. Как утверждает Альтман, если ИИ останется на той траектории развития, которую прогнозируют в компании, пользователям будут доступны весьма впечатляющие возможности. Возможно, обладая 10 ГВт вычислительных мощностей, ИИ сможет найти способ лечения рака или оптимизировать процесс получения знаний для каждого учащегося в мире персонально. Если же человечество будет ограничено в вычислительных мощностях, придётся выбирать, чему отдать приоритет. При этом никто не хочет делать такой сложный выбор, поэтому стоит наращивать вычислительную инфраструктуру. Год назад Альтман убеждал власти США в необходимости постройки целой сети 5-ГВт ЦОД для обеспечения национальной безопасности. OpenAI рассчитывает создать производство, способное создавать 1 ГВт ИИ-инфраструктуры еженедельно. Выполнить этот план будет нелегко, на это уйдут годы и потребуются инновации на всех уровнях, от чипов до энергетики, строительства и робототехники. Тем не менее бизнес активно работает по всем этим направлениям и считает эпохальные изменения возможными. В OpenAI считают, что речь идёт о самом важном инфраструктурном проекте за всю историю, причём компания немало делает в США уже сегодня. При этом Альтман отметил, что «прямо сейчас» некоторые страны строят заводы по производству чипов и новые энергетические мощности намного быстрее, чем в США, но Альтман и его единомышленники намерены изменить такое положение дел. В следующую пару месяцев компания намерена раскрыть некоторые из своих планов, чтобы претворить их в жизнь. Позже в этом году компания расскажет и про финансовую сторону вопроса. С учётом того, что увеличение вычислительных мощностей способствует росту выручки, у компании уже есть некоторые «интересные новые идеи». На днях сообщалось, что OpenAI потратит $100 млрд на аренду резервных ИИ-серверов у облачных провайдеров, а чуть позже появились данные, что NVIDIA инвестирует в OpenAI $100 млрд, в основном пойдут на покупку её же ускорителей. |

|