Материалы по тегу: hardware

|

24.04.2026 [17:11], Сергей Карасёв

Meta✴ возьмёт на вооружение «десятки миллионов» Arm-ядер AWS Graviton5Компания Meta✴, по сообщению The Register, объявила о расширении сотрудничества с облаком AWS. Речь идёт об использовании Arm-процессоров Graviton5 для поддержания определённых ИИ-нагрузок, в частности, агентных систем. Сама AWS говорит о невероятном спросе на собственные процессоры. Крупным заказчиком является, например, Uber. AWS представила чипы Graviton5 в конце прошлого года. Эти изделия содержат 192 ядра Neoverse V3 (Poseidon), каждое из которых имеет 2 Мбайт кеша L2. Общий объём L3-кеша составляет 192 Мбайт. Присутствуют 12 каналов памяти DDR5-8800. Утверждается, что прирост производительности достигает 25 % по сравнению с процессорами Graviton предыдущего поколения. Meta✴ намерена использовать для своих задач «десятки миллионов» ядер Graviton5. Таким образом, компания станет одним из крупнейших клиентов, применяющих чипы собственной разработки AWS. Руководитель отдела инфраструктуры Meta✴, заявил, что сотрудничество с AWS направлено на диверсификацию вычислительных ресурсов. По его словам, это необходимо в свете реализации масштабных проектов в области ИИ. Ранее Meta✴ объявила о стратегическом партнёрстве с компанией Arm Holdings, которое направлено на «масштабирование эффективности ИИ на каждом уровне вычислений, охватывающем ПО и инфраструктуру ЦОД». В частности, Meta✴ намерена использовать чипы Arm AGI, специально оптимизированные для агентного ИИ. Однако, как уточняет The Register, эти изделия начнут поступать в дата-центры Meta✴ не ранее конца текущего года, поэтому компания пока будет разворачивать соответствующие нагрузки на базе Graviton5 в облаке AWS. Аналитики Counterpoint Research прогнозируют, что к 2029 году на Arm-решения будет приходиться до 90 % рынка серверных ASIC-изделий, ориентированных на ИИ. Между тем сама Meta✴ проектирует фирменные ИИ-ускорители MTIA, которые в зависимости от модификации могут применяться для обучения моделей, инференса и пр.

24.04.2026 [14:10], Владимир Мироненко

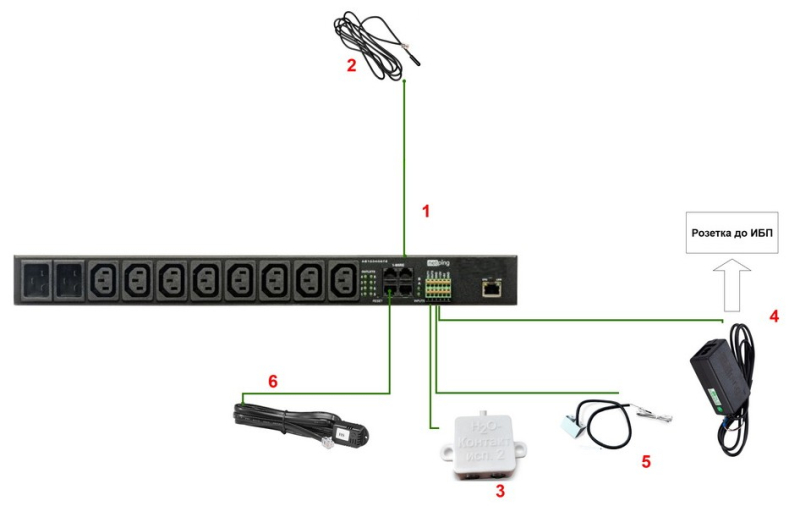

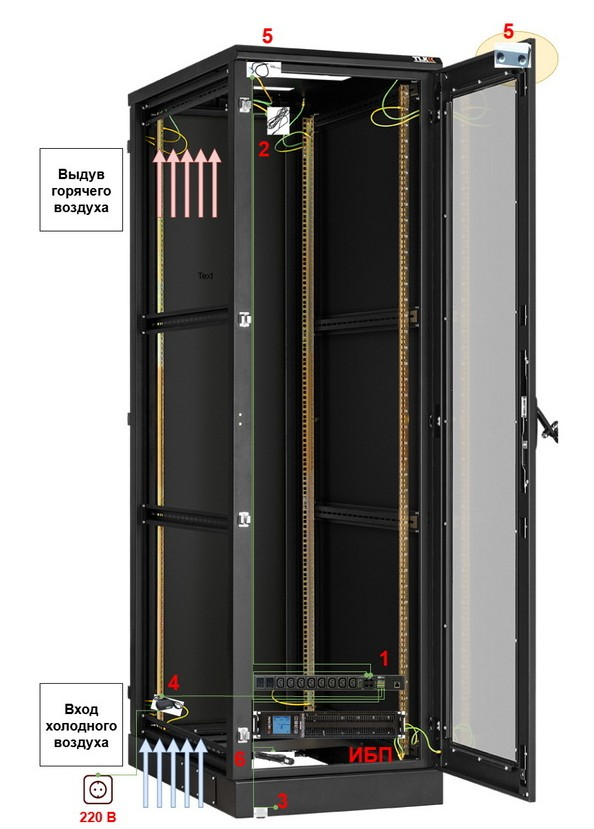

Организация мониторинга серверной на базе контроллеров NetPingСерверная является одной из наиболее уязвимых частей ИТ-инфраструктуры. Любое отклонение от нормальных условий эксплуатации оборудования способно привести к отказам сервисов, потере данных и простою бизнес-процессов. Именно поэтому мониторинг серверной должен рассматриваться не как дополнительная функция, а как обязательный элемент инженерной инфраструктуры. Варианты построения системы мониторингаСистема может быть реализована в различных конфигурациях в зависимости от масштаба инфраструктуры. В небольших проектах используется один контроллер, который обслуживает одну серверную. В более сложных случаях применяется несколько контроллеров, объединённых в единую систему мониторинга. Для удалённых объектов возможно использование моделей с GSM-модулем, что обеспечивает передачу уведомлений даже при отсутствии основной сети связи.

Источник изображений: NetPing Контроллеры NetPing Использование контроллеров NetPing в составе системы мониторинга позволяет не только фиксировать аварийные события, но и выявлять отклонения в работе оборудования до их перехода в критическое состояние. Например, постепенный рост температуры в верхней части стойки может указывать на ухудшение работы системы охлаждения или засорение воздушных фильтров. Контроль разницы температур между верхней и нижней частью шкафа даёт представление о правильности организации воздушных потоков и эффективности охлаждения. Фиксация кратковременных пропаданий питания позволяет выявить нестабильность электросети, которая может быть незаметна при обычной эксплуатации. Таким образом, система мониторинга на базе NetPing используется не только для реагирования на аварии, но и как инструмент анализа состояния инфраструктуры. Пример наполнения серверного шкафа

Расположение контроллера NetPing и датчиков внутри серверного шкафа Для мониторинга стойки можно использовать следующий комплект:

В основе системы используется контроллер NetPing 8/PWR-220 v7.6/ETH, объединяющий функции мониторинга и управления. Устройство собирает данные с датчиков, передаёт их во внешние системы через SNMP, HTTP API или посредством email-уведомлений, а также позволяет управлять нагрузкой через встроенные реле. При исчезновении питания на основном вводе устройство автоматически переключает все розетки на резервный ввод.

Контроллер NetPing 8/PWR-220 v7.6/ETH и набор датчиков позволяют реализовать полноценный мониторинг серверного шкафа без сложной интеграции. Решение обеспечивает контроль ключевых параметров и снижает риск аварий при эксплуатации оборудования.

24.04.2026 [11:15], Руслан Авдеев

Tesla развернула ИИ-кластер Cortex 2 на территории Gigafactory в ТехасеTesla ввела в эксплуатацию кластер Cortex 2 для обучения ИИ, расположенный на территории кампуса Gigafactory Texas. Это знаменует новый шаг на пути компании к расширению собственных вычислительных мощностей для создания систем автономного вождения, робототехники и других задач в сфере ИИ, сообщает Converge Digest. В презентации для акционеров, посвящённой итогам I квартала 2026 года, компания указала, что кластер Cortex 2 находится на стадии «раннего масштабирования». Установленная годовая производительность составляет эквивалент более 130 тыс. ИИ-ускорителей NVIDIA H100. Кроме того, имеется ещё и кластер Cortex 1, эквивалентный 100 тыс. H100. По данным Tesla, Cortex 2 уже выполняет задачи обучения моделей. Кроме того, компания разрабатывает и архитектуру Dojo 3 для суперкомпьютеров нового поколения, чтобы снизить затраты на обучение в будущем. Развитие ИИ-инфраструктуры Tesla напрямую связывается с с масштабированием планов по созданию роботизированных такси и Optimus. В материалах отчёта также упоминается, что расширение вычислительных мощностей осуществляется в рамках более масштабного плана развития в сфере аккумуляторных технологий, материалов и сервисов мобильности.

Источник изображения: Tesla Кроме того, в отчёте указано на запуск в апреле системы FSD (Supervised) версии 14.3, улучшении «обучения с подкреплением» и обработки в системах машинного зрения, задержка инференса сокращена на 20 %. Кроме того, т.н. Digital Optimus обозначен как следующий этап развития ИИ-платформы Tesla. Также раскрыты планы компании в полупроводниковой отрасли. Было заявлено, что Tesla расширяет сферу производства и намерена заняться выпуском полупроводников, начиная с мощностей Research Fab на территории Gigafactory в Техасе. Сообщалось, что в апреле компания окончательно завершила разработку чипа нового поколения AI5. Также объявлено, что партнёрство со SpaceX направлено на создание «крупнейшего в истории» завода по выпуску чипов, с вертикальной интеграцией, включающей логические микросхемы, память и передовые технологии упаковки. Утверждение о масштабе, конечно, является словами самой Tesla, но оно косвенно свидетельствует о том, насколько агрессивно компания сейчас связывает ИИ-вычисления, разработку чипов и производственную стратегию.

24.04.2026 [11:05], Сергей Карасёв

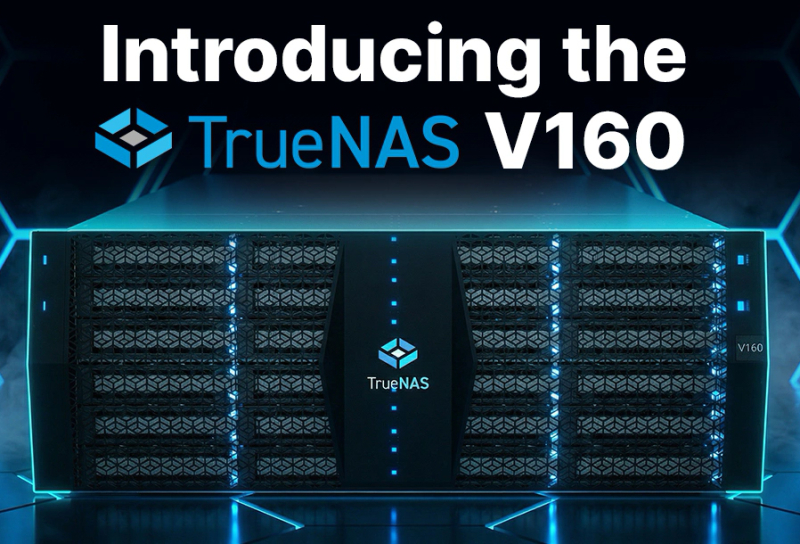

Гибридная СХД TrueNAS V160 обеспечивает пропускную способность до 60 Гбайт/сКомпания TrueNAS (ранее — iXsystems) анонсировала гибридную систему хранения V160, предназначенную для задач ИИ, машинного обучения и работы с базами данных. Новинка позволяет формировать платформы с оптимальным сочетанием производительности и стоимости, что важно в условиях стремительного роста цен на SSD. СХД выполнена в форм-факторе 4U. Применены два контроллера TrueNAS пятого поколения на основе неназванного 32-ядерного процессора AMD EPYC с 768 Гбайт оперативной памяти DDR5 каждый. Доступны 24 отсека для NVMe SSD или SAS HDD вместимостью соответственно до 122,8 Тбайт и 26 Тбайт (7200 об/мин). Система позволяет задействовать до 24 Тбайт адаптивного кеша. Заявленная пропускная способность в зависимости от выбранной конфигурации достигает 60 Гбайт/с. Допускается подключение до шести дисковых полок с NVMe SSD или до четырнадцати полок с SAS HDD на 102 отсека, что позволяет создавать конфигурации, насчитывающие более 1400 накопителей. При использовании исключительно SSD суммарная вместимость может достигать 20 Пбайт, в случае HDD — 35 Пбайт. Сетевые порты имеют следующую конфигурацию: 4 × 100/200GbE, 2 × 400GbE, 4 × FC16, 2 × FC32. Реализована поддержка протоколов SMBv2, SMBv3, NFSv3, NFSv4 w/RDMA, iSCSI, iSER, FC, NVMe-oF/RDMA, S3. Питание обеспечивают два блока с сертификатом 80 Plus Titanium, резервированием и возможностью горячей замены. Заявленная доступность СХД превышает 99,999 %. В качестве программной платформы применяется TrueNAS Enterprise 25.10 (используется файловая система OpenZFS). Доступны файловое, блочное и объектное хранилища со сжатием и дедупликацией. Говорится о совместимости с VMware, Proxmox, Hyper-V, Xen, OpenShift, Kubernetes.

24.04.2026 [09:11], Руслан Авдеев

Бум дата-центров помогает угольным электростанциям США дымить и дальшеСогласно отчётам, приуроченным к Дню Земли, рост числа дата-центров в США помогает продлевать сроки эксплуатации угольных электростанций. Поддержка работы станций на ископаемом топливе мешает «зелёному переходу» и усугубляет состояние окружающей среды, сообщает The Register. Авторы подчёркивают, что использовать для электроснабжения технологий будущего электростанции далёкого прошлого — абсурд. Хотя в последнее десятилетие возобновляемая энергетика активно развивается в США, начавшийся недавно бум строительства ЦОД стремительно увеличивает спрос на электричество. В результате энергокомпании вынуждены продолжать эксплуатацию некоторых электростанций на ископаемом топливе, вместо того чтобы закрыть их. Более того, некоторые ЦОД переходят на питание от угольных электростанций. Сообщалось, что правительство намерено отложить их вывод из эксплуатации. В исследовании «Энергетический переход под угрозой» (Energy Transition at Risk) использованы сведения Управления энергетической информации США (EIA), свидетельствующие о замедлении темпов вывода из эксплуатации наиболее вредных для экологии США электростанций. Также упоминается о новых и новых заявках на строительство газовых электростанций, в том числе объектов для локальной выработки электроэнергии на территориях при дата-центрах — это позволяет операторам не зависеть от магистральных электросетей.

Источник изображения: Gabriela/unsplash.com Представленные в отчёте данные свидетельствуют, что около 40 % запланированных выводов из эксплуатации угольных электростанций или их перевод на другое топливо не состоялись. Утверждается, что если бы электростанции выводили темпами, характерными для 2022 года, все они закрылись бы к 2040 году, однако с нынешними темпами они будут работать до 2065 года. Параллельно растут мощности газовых электростанций. По данным на декабрь 2025 года, к 2030 году планировалось вывести 13,2 ГВт таких источников из эксплуатации, но одновременно запустят 41,8 ГВт новых. Такие станции служат 30–40 лет. В докладе «Электростанции, работающие на ископаемом топливе, останутся в эксплуатации дольше» (Fossil fuel power plants are staying online longer), подсчитано, что сейчас работают 15 «электростанций-зомби», которые давно должны были закрыться. Только в 2023 году они выбросили в атмосферу почти 65 млн т парниковых газов. Более того, загрязняющие вещества вроде диоксида серы (SO2) и оксиды азота (NOx) не только вредны сами по себе, но и способствуют накоплению озона вблизи земной поверхности. Кроме того, угольные электростанции выбрасывают и ртуть. По словам авторов докладов, необходимо повысить энергоэффективность, устранить барьеры для перехода на чистую энергетику и ускорить вывод из эксплуатации электростанций на ископаемом топливе. Впрочем, они сомневаются, что при администрации Дональда Трампа эти цели достижимы. Президент США неоднократно критиковал ветроэнергетику и принимал меры по ограничению поддержки возобновляемой энергетики в целом, а также принял меры для реанимации угольных проектов. Также был издан запрет на одобрение новых проектов ветряной и солнечной энергетики на федеральных землях. Основной мотив заключается в том, что победа над Китаем в гонке ИИ важнее, чем предотвращение климатических изменений.

23.04.2026 [14:54], Руслан Авдеев

Gartner: нефтяной кризис не затормозит IT-индустрию — в ИИ готовы вкладываться всеНа следующий день после того, как Международное энергетическое агентство (IEA) заявило, что война на Ближнем Востоке создаёт серьёзнейший энергетический кризис за мировую историю, агентство Gartner сообщила о вероятном росте расходов на IT почти на 3 п.п., сообщает The Register. Стремительный рост цен на нефть и газ, вызванный кризисом, по мнению Gartner, не имеет прямого влияния на расходы в IT. И хотя косвенное влияние на уверенность бизнеса и потребителей не исключено, это пока не подтверждается цифрами. В Gartner прогнозируют, что мировые расходы на IT вырастут в 2026 году на 13,5 % до $6,31 трлн. В феврале агентство прогнозировало рост на 10,8 %, до $6,15 трлн. Подчёркивается, что цена на нефть мало соотносится с ростом расходов. Отчасти кризис оказал влияние лишь на цены на электричество в некоторых странах, например в АТР, где это стало реальной проблемой. Единственным значимым эффектом можно признать изменение уверенности бизнеса, но пока не произошло и этого. За пределами сегментов облачной инфраструктуры и ИИ, инвестиции в IT тоже находятся в относительно нормальном состоянии. Расходы на потребительские IT-решения растут всего на 4,1 %, и то из-за изменения стоимости памяти. Даже рост корпоративных IT-расходов оценивается приблизительно в 7 %, а показатель в 13,5 % достигается только с учётом расходов гиперскейлеров. А без учёта ЦОД и ИИ-серверов общий рост расходов составит текущем году 7,2 %. Таким образом, строительство ЦОД, совместные разработки новых технологий для ИИ, создание ИИ-моделей и т.п. оказывают существенное влияние на рынок. При этом в долгосрочной перспективе, вероятно, корпоративные пользователи окупят инвестиции. Ожидается, что к 2026 году компании выйдут из периода «избавления от иллюзий» в отношении ИИ-проектов. Сейчас ожидания находятся на самом низком уровне и выход будет найден к началу 2027 года. IT-руководители ищут ПО на базе ИИ у своих текущих поставщиков. Более мелкие проекты помогают добиться немедленных улучшений. В контексте ИИ-агентов в 2026 году ожидается гораздо больше провальных проектов, после чего индустрия выйдет на «плато продуктивности» — станет понятно, что именно следует делать с этими технологиями, а сами они станут более надёжными, предсказуемыми и стабильными, но это вряд ли произойдёт раньше 2030 года. Впрочем, прогноз основан на предположении, что война на Ближнем Востоке будет «относительно кратковременным конфликтом». Если она продлится весь год, мир, вероятно, потеряет доверие к мировой экономике, и IT-бюджеты некоторых компаний могут пострадать от этого. Впрочем, даже если это произойдёт, в гонке поставщиков ИИ-технологий вряд ли что-то изменится, поскольку игроки этого рынка оперируют «четырёхлетними циклами».

23.04.2026 [11:38], Сергей Карасёв

Selectel представил российский «AI-Сервер» с поддержкой до 16 GPUРоссийский провайдер облачной инфраструктуры Selectel анонсировал «AI-Сервер» — высокопроизводительную систему формата 8U, ориентированную на ресурсоёмкие нагрузки, такие как обучение ИИ-моделей, инференс, рендеринг, финансовое моделирование, виртуальные рабочие столы и аналитика в реальном времени. В состав платформы входят плата Selectel SSE-MB-201 и специализированное шасси SSECH-812. Задействованы два процессора Intel Xeon 6 6500/6700 поколения Granite Rapids-SP. Поддерживается до 8 Тбайт оперативной памяти DDR5-6400 в виде 32 модулей. Могут быть установлены 12 накопителей с интерфейсом NVMe/SAS/SATA, а также два SSD типоразмера M.2 с интерфейсом PCIe 5.0. Упомянуты контроллер BMC AST2600, модуль TPM 2.0, 176 линий PCIe (PCIe 5.0 / CXL и OCP 3.0) и два сетевых порта 1GbE. Сервер допускает монтаж до 16 ускорителей на базе GPU формата FHFL двойной ширины или до восьми ускорителей FHFL тройной ширины. В частности, могут применяться карты NVIDIA H100, H200, RTX Pro 6000 Blackwell Server Edition и др. Питание обеспечивают семь блоков мощностью 2000 Вт с сертификатом 80 Plus Platinum. Selectel разрабатывает BIOS и BMC собственными силами: это, как утверждается, даёт полный контроль над процессом и возможность оперативно вносить изменения и дорабатывать функциональность в соответствии с запросами заказчиков. Подчёркивается, что усиленные подсистемы питания и охлаждения рассчитаны на высокую плотность ускорителей и длительную работу под нагрузкой. Конструкция упрощает обслуживание и эксплуатацию сервера в ЦОД. «Запуск нового AI-сервера является частью стратегии Selectel по формированию собственного портфеля серверных решений, включая специализированные инфраструктурные продукты для задач в сфере ИИ. Новая аппаратная платформа обеспечит стабильную, быструю и предсказуемую работу AI-моделей в реальных условиях с полным контролем над данными и производительностью», — говорит компания.

23.04.2026 [09:40], Руслан Авдеев

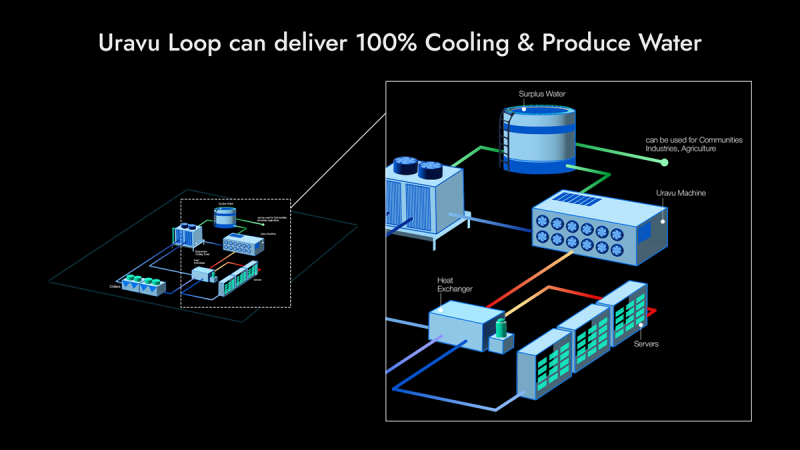

Как на Татуине: индийская Uravu будет добывать питьевую воду из воздуха с помощью «мусорного» тепла ЦОДИндийский стартап Uravu предложил систему, в которой соль является ключевым ингредиентом, способствующим эффективному охлаждению серверных стоек. Более того, метод позволяет получать воду непосредственно из тёплого воздуха, проходящего через системы охлаждения ЦОД, сообщает Datacenter Dynamics. Основанный в 2012 году стартап Uravu предложил добавить в контур охлаждения влагопоглотитель на основе солёной воды — благодаря этому можно будет извлекать воду из «отработанного» тёплого воздуха. Потом её можно повторно использовать для охлаждения оборудования, а излишки воды можно даже продавать. Разработчики явно вдохновлялись решениями с пустынной планеты Татуин, показанной во франшизе «Звёздные войны» — там вода тоже добывалась непосредственно из воздуха. Поэтому и свою установку они назвали Tatooine. Tatooine использует низкотемпературное (+35–65 °C) избыточное тепло, отдаваемое системами охлаждения. Модуль-абсорбент (поглотитель) забирает тёплый воздух, из части которого извлекается вода. Другая часть вступает в контакт с поглотителем на основе солёной воды, участвуя в процессах тепло- и массообмена. После солевой раствор передаётся в десорбер, где выделяет влагу в виде пара при помощи вакуумного насоса. Сконденсированная вода имеет на выход температуру +27–32 °C, что соответствует верхней границе рекомендаций ASHRAE. Гиперскейлеры допускают работу серверов и при таких температурах. Абсорбент Uravu начинает отбирать избыточное тепло при разнице с температурой окружающей среды в +4 °C. По оценке самой компании, Tatooine во многих сценариях позволят вообще не использовать традиционные чиллеры или драйкулеры, а на 1 МВт мощности ЦОД система способна отдавать до 30 м3/сут. чистой дистиллированной воды. Показатель может колебаться в зависимости от условий окружающей среды и уровня влажности, но как минимум 5 м3/сут. готовой для питья или других нужд воды она будет давать. Использование отработанного тепла позволяет улучшить показатели энергетической эффективности (PUE) и эффективности использования воды (WUE) дата-центров. Последний и вовсе достигает отрицательных значений — вода не просто восстанавливается, а извлекается в избытке, поэтому её можно продавать близлежащим потребителям. Уже сегодня Uravu имеет партнёрские соглашения с предприятиями других секторов, поставляя им «воду из воздуха». В частности, одна из её систем используется для производства бутилированной воды в Бангалоре, хотя и в скромных объёмах (всё те же 5 м3 /сут.). Компания начала взаимодействовать с участниками OCP и разработала 125-кВт демо-систему, подходящую для небольших и пилотных проектов. Следующая цель — блок на 1 МВт, с прицелом на создание модульного решения и стандартизацию производства. Разработка начнётся в 2026 году, условия проекта согласованы с неким «крупным провайдером». Также ведутся переговоры с пятью другими компаниями, занимающимися цифровой инфраструктурой. От венчурных фондов Uravu привлекла $4,7 млн и намерена инициировать раунд финансирования серии A до конца текущего года. Это не первые решения, использующие тепло ЦОД и сопутствующую воду. Так, в 2025 году появилась новость, что AirJoule разработала технологию «превращения» тепла дата-центров в дистиллированную воду, а в Нью-Йоркском университете (NYU) разработали необычную систему охлаждения на основе минералов. Благодаря им выделяемое на заводах тепло можно использовать для охлаждения дата-центров. Дефицит воды является большой проблемой для многих стран. В Индии проживают 18 % населения Земли, но на неё приходится лишь 4 % мировых водных ресурсов. По оценкам Всемирного банка, 600 млн жителей страны живут в районах, где воды не хватает, а, тем временем, потребление воды в стране к 2030 году может удвоиться, что только усугубит проблему. При этом ЦОД участвуют в конкуренции за воду наравне с людьми.

23.04.2026 [09:09], Руслан Авдеев

Войн нет, энергии хватает, народ дружелюбный: Scala Data Centers призвала присмотреться к ИИ ЦОД в БразилииБразилия стремится привлечь инвестиции ИИ-бизнесов, полагаясь на геополитические преимущества региона. В частности, местный строитель ЦОД Scala Data Centers предлагает свои объекты иностранным бизнесам, в первую очередь из США и Китая, сообщает Datacenter Knowledge. В конце 2026 года должно начаться строительство т.н. Scala AI City, проект уже одобрен властями. Поддерживаемая DigitalBridge Group компания начала переговоры с техногигантами из США и КНР, желая привлечь в «ИИ-суперкампус» размером с город крупного клиента. Как утверждает Scala, нестабильность на Ближнем Востоке подчёркивает привлекательность бразильского рынка, изолированного от зон крупных конфликтов. По данным Scala, первый этап строительства обойдётся приблизительно в $500 млн, которые пойдёт непосредственно на инфраструктуру. В несколько раз больше потратит сам арендатор — облачный провайдер на ИИ-оборудование. Предполагается, что американские и китайские провайдеры могли бы использовать в Scala AI City отдельные ЦОД, не рискуя безопасностью своих данных. Компания уже получила разрешение на получение до 5 ГВт электроэнергии в окрестностях Порту-Алегри (Porto Alegre) в штате Риу-Гранди-ду-Сул — приблизительно столько потребляет Сан-Паулу или Лондон.

Источник изображения: Scala Data Centers Наличие в Южной Америке многочисленных возобновляемых источников энергии и оптоволоконных магистралей, а также энергосеть с многочисленными перекрёстными подключениями делают Бразилию оптимальным региональным игроком в контексте бума ИИ ЦОД. Удары беспилотников по дата-центрам в ОАЭ и Бахрейне в целом заставляют компании переосмысливать принципы размещения в мире критической инфраструктуры. Власти штатов и муниципалитетов Бразилии всеми силами стремятся привлечь инвестиции в ЦОД, это должно стимулировать местную экономику и способствовать созданию технологических центров. Для сравнения, во многих штатах США бизнес и политики сталкиваются с недовольством общественности — иногда доходит до стрельбы и изгнания чиновников. Scala Data Centers была сформирована DigitalBridge в 2020 году после покупки ЦОД-активов у бразильской UOL Diveo. Японская SoftBank Group купила DigitalBridge приблизительно за $4 млрд в 2025 году. В текущем году компания планирует расширить и другие проекты ЦОД в Бразилии. Так, кампус в Сан-Паулу, куда уже инвестировано порядка R$12 млрд ($2,4 млрд), будет расширен до 600 МВт.

23.04.2026 [01:20], Владимир Мироненко

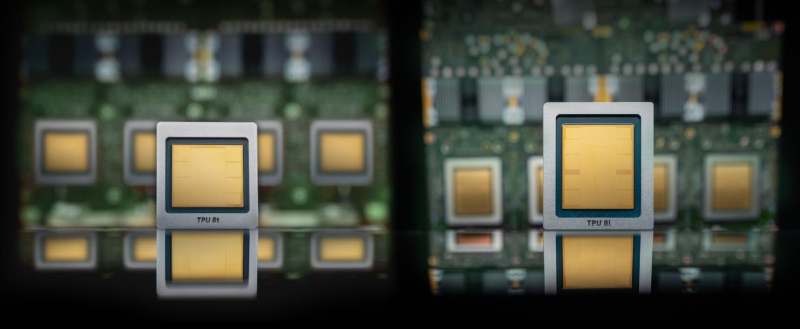

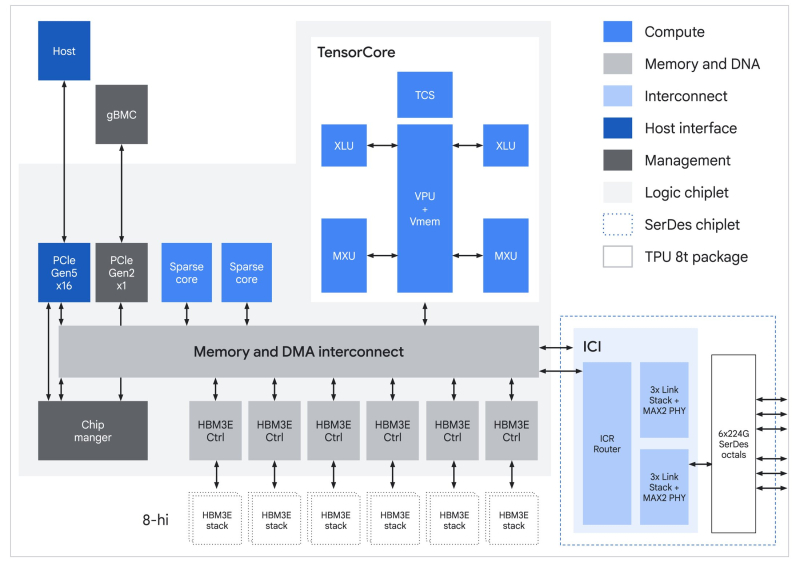

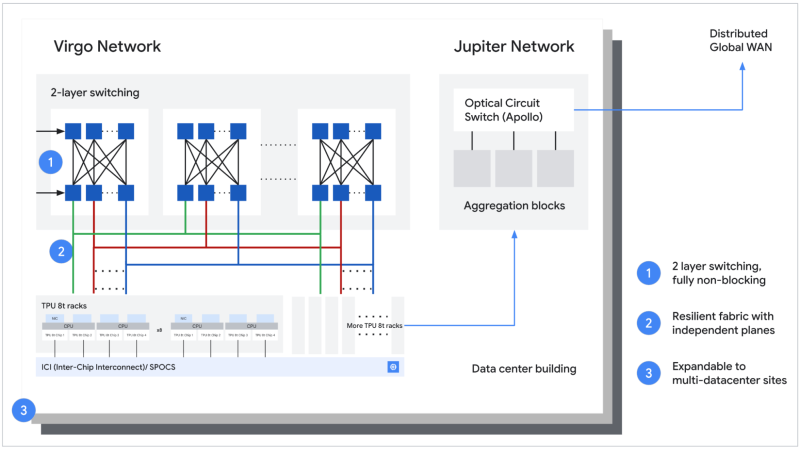

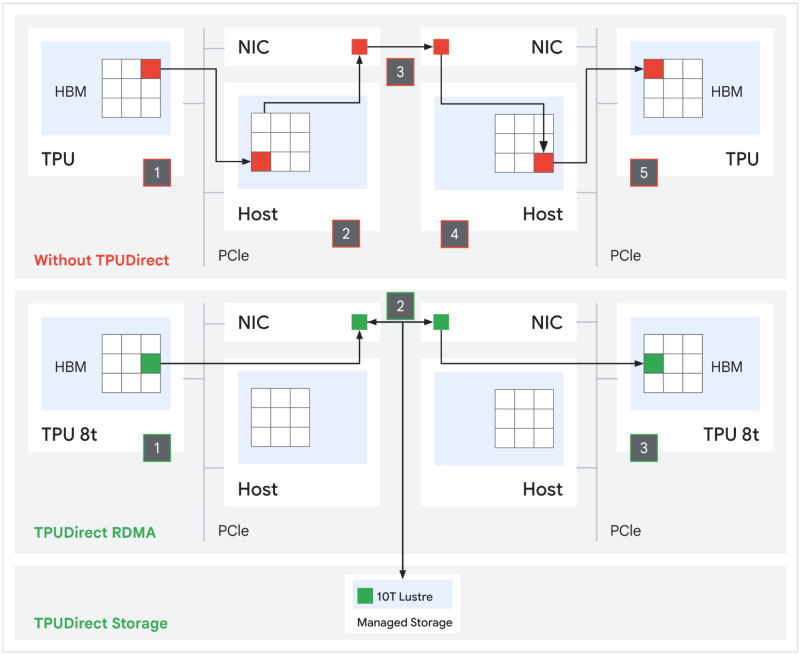

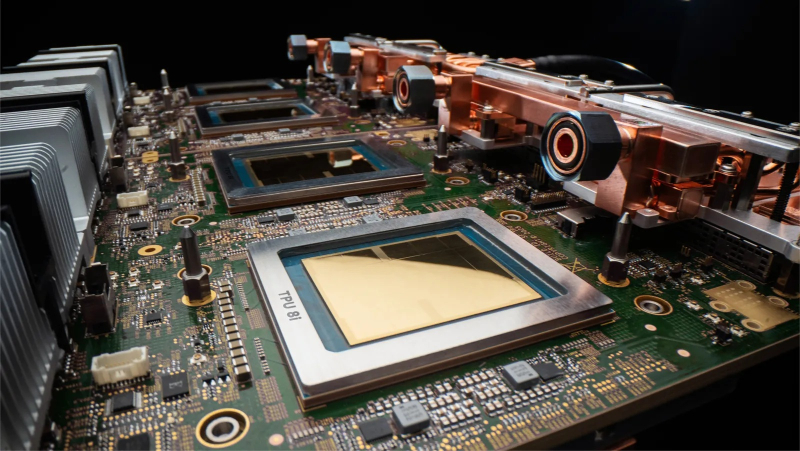

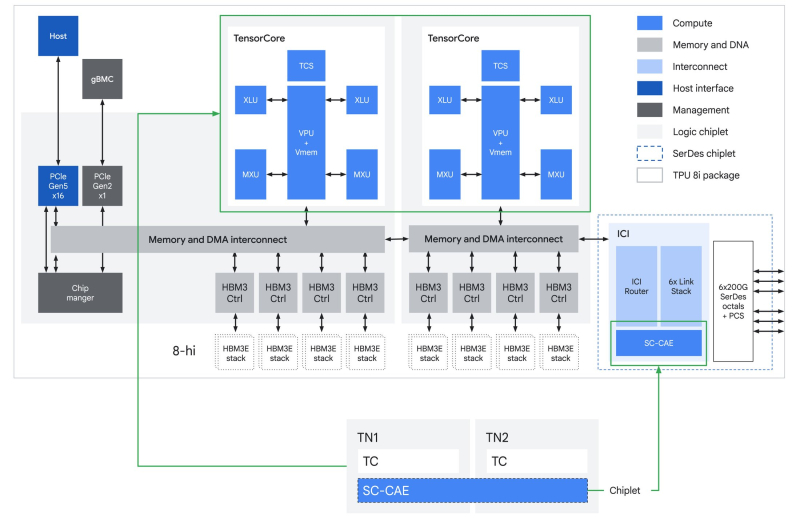

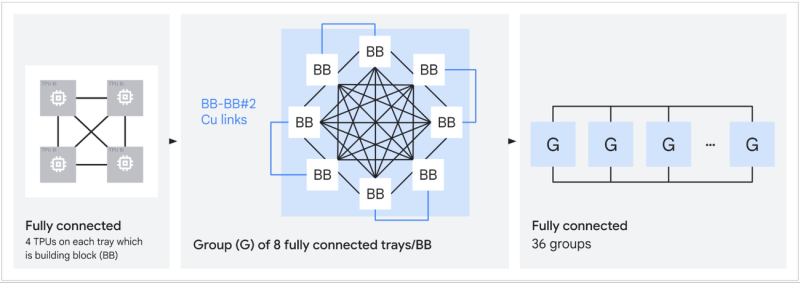

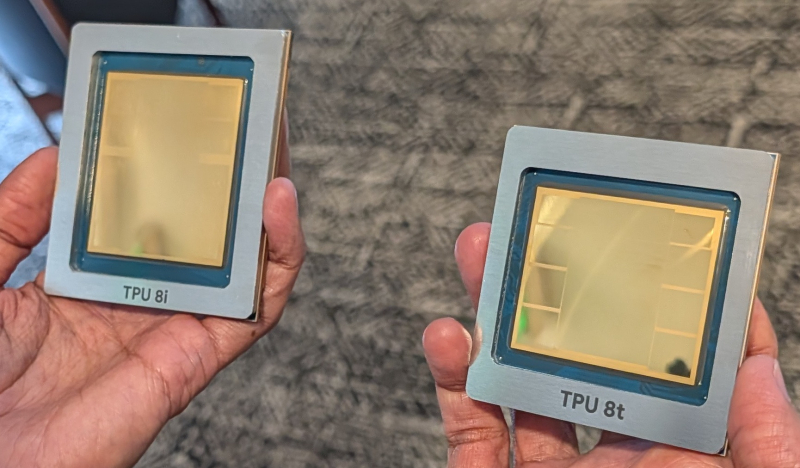

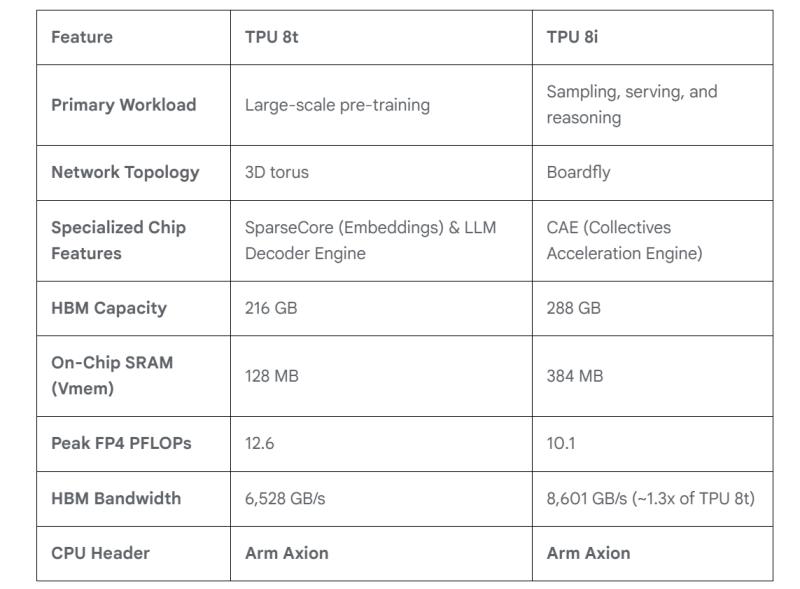

Для обучения и инференса — Google анонсировала ИИ-ускорители TPU 8t и TPU 8iGoogle представила два TPU восьмого поколения: TPU 8t (Sunfish) для обучения ИИ и TPU 8i (Zebrafish) для ИИ-инференса. Компания и раньше экспериментировала с различными вариантами TPU, в частности, со своими чипами пятого поколения V5p и V5e, но последние поколения, такие как Trillium и Ironwood, в основном следовали единому подходу. По словам Амина Вахдата (Amin Vahdat), старшего вице-президента и главного технолога Google по ИИ и инфраструктуре, TPU 8t и TPU 8i — результат десятилетней разработки (первые TPU были анонсированы в мае 2016 г.), специально созданные для обеспечения работы суперкомпьютеров следующего поколения с высокой эффективностью и масштабируемостью. Вахдат описывает TPU 8t как «мощную платформу для обучения», созданную для «сокращения цикла разработки моделей с месяцев до недель». Она предлагает в 2,8 раза лучшее соотношение цены и производительности, чем предыдущее поколение. В TPU 8t используются векторные, матричные и SparseCore-ядра, дополненные 128 Мбайт SRAM и 216 Гбайт HBM3e (6,5 Тбайт/с). FP4-производительность составляет до 12,6 Пфлопс (также поддерживаются BF16/FP8/INT8). Для вертикального масштабирования используется межчиповый интерконнект (ICI) со скоростью 19,2 Тбит/с (в каждую сторону), для горизонтального — 400 Гбит/с. Кластер с TPU 8t может масштабироваться до 9,6 тыс. чипов, предлагая 2 Пбайт памяти HBM, 121 Эфлопс и вдвое большую межчиповую пропускную способность по сравнению с Ironwood, позволяя самым сложным моделям использовать единый, огромный пул памяти. 8t-кластеры объдиняет сеть Virgo Network, которая использует плоскую двухуровневую неблокирующую топологию, обеспечивает четырёхкратное увеличение пропускной способности в ЦОД и построена на коммутаторах с высокой степенью защиты, что сокращает количество сетевых уровней. В рамках одного ЦОД Virgo Network позволяет объединить до 134 тыс. чипов, что даёт до 47 Пбит/с неблокирующих соединений и более 1,6 Ифлопс с почти линейным масштабированием. А в рамках нескольких ЦОД в единый кластер можно объединить более 1 млн TPU. В TPU 8t используются технологии TPUDirect RDMA и TPUDirect Storage. TPU Direct RDMA обеспечивает прямую передачу данных между HBM и NIC, минуя CPU и DRAM хоста, а TPUDirect Storage напрямую связывает память TPU и СХД, таким как 10T Lustre, которая обеспечивает до 10 Тбайт/с, что даёт на порядок более быстрый доступ к хранилищу в сравнении с Ironwood и позволяет доставлять петабайты данных к ускорителям. Кроме того, TPU 8t получили расширенные возможности RAS. К ним относятся телеметрия в реальном времени для десятков тысяч чипов, автоматическое обнаружение неисправных каналов ICI и перенаправление трафика без прерывания задания, а также оптическая коммутация каналов (OCS), которая перенастраивает оборудование в случае сбоев без участия человека. Всё это позволяет довести уровень утилизации чипа до 97 %. В свою очередь, TPU 8i создан для обработки «сложной, совместной, итеративной работы множества специализированных агентов», которые появляются с развитием агентного ИИ. TPU 8i использует 288 Гбайт памяти HBM (8,6 Тбайт/с) в паре с 384 Мбайт SRAM — втрое больше, чем в предыдущем поколении. По словам Google, такой объём SRAM помогает TPU 8i удерживать большую часть KV-кеша на кристалле, что значительно сокращает время простоя ядер во время декодирования длинных контекстов. Компания отказалась от SparseCores в пользу нового встроенного механизма ускорения коллективных операций (CAE), снижая задержки на уровне кристалла и разгружая коллективные коммуникации, которые в противном случае привели бы к простою тензорных ядер чипа, отметил The Register. TPU 8i масштабируется до 1152 чипов в одном кластере (впрочем, в каждый момент активно не более 1024): 11,6 Эфлопс и 331,8 Тбайт HBM. ICI у 8i такой же, что у 8t, однако для объединения чипов используется топология Boardfly вместо 3D-тора, поскольку для MoE-инференса важно меньшее количество сетевых переходов между чипами. Эти инновации обеспечивают на 80 % лучшую производительность на доллар по сравнению с предыдущим поколением, позволяя предприятиям обслуживать почти вдвое больше клиентов при тех же затратах, сообщила компания. Как TPU 8t, так и 8i работают на базе собственного Arm-процессора Axion и поддерживают СЖО. Компания также заявила, что оптимизировала эффективность всей системы для обеспечения интегрированного управления питанием, которое может регулировать потребление энергии в зависимости от спроса в реальном времени, что приводит к повышению производительности на ватт до двух раз по сравнению с Ironwood. TPU 8 станут общедоступными на Google Cloud Platform позже в этом году в виде отдельных инстансов или как часть полнофункциональной платформы AI Hypercomputer, которая объединяет все сетевые ресурсы, хранилище, вычислительные мощности и ПО, необходимые для развёртывания или обучения LLM в масштабе. |

|