Материалы по тегу: облако

|

10.11.2025 [15:00], Владимир Мироненко

Фирменные ИИ-ускорители Amazon всё ещё не могут конкурировать с чипами NVIDIA, считают некоторые стартапыНекоторые стартапы считают, что ИИ-чипы Trainium и Inferenetia собственной разработки Amazon менее конкурентоспособны, чем ускорители NVIDIA, сообщил ресурс Business Insider со ссылкой на внутреннюю документацию AWS. Согласно июльскому «конфиденциальному» внутреннему документу Amazon, ИИ-стартап Cohere обнаружил, что чипы Amazon Trainium 1 и 2 «уступают по производительности» ускорителям NVIDIA H100. Стартап отметил, что доступ к Trainium2 был «крайне ограничен», а в работе наблюдались частые перебои. Amazon и её подразделение Annapurna Labs всё еще изучают возникшие у Cohere «проблемы с производительностью», но прогресс в решении этих проблем был «ограниченным», отмечено в официальном документе. Также в нём упоминается стартап Stability AI, разработавший, в том числе, ИИ-генератор изображений Stable Diffusion, который высказывал схожие претензии. В частности, говорится, что чипы Amazon Trainium2 уступают NVIDIA H100 по задержке, что делает их «менее конкурентоспособными» с точки зрения скорости и стоимости. Ставка Amazon на чипы собственной разработки является частью её усилий по обеспечению конкурентоспособности в ИИ-гонке. Её прибыльность основана в том числе на использовании собственных процессоров Graviton вместо дорогостоящих чипов Intel. И сейчас Amazon тоже стремится задействовать собственные чипы для обработки ИИ-нагрузок. Если некоторые клиенты AWS не захотят использовать Trainium и будут настаивать на том, чтобы AWS запускала свои облачные ИИ-системы с использованием чипов NVIDIA, которые гораздо дороже её собственных решений, это отразится на её прибыли от облачных вычислений, отметил Business Insider. Рынок стартапов давно является важным для AWS, поэтому их претензии имеют большое значение для компании. Представитель Amazon заявил, что компания «благодарна» клиентам за отзывы, которые помогают сделать её чипы «еще лучше и более широко используемыми». Он добавил, что кейс с Cohere «не является актуальным», отметив, что её чипы Trainium и Inferentia «достигли отличных результатов» с такими клиентами, как Ricoh, Datadog и Metagenomi. «Мы очень довольны ростом и внедрением Trainium2, который на данном этапе в основном используется небольшим числом очень крупных клиентов, таких как Anthropic», — написал представитель в электронном письме ресурсу Business Insider. AWS утверждает, что ее собственные ИИ-ускорители предлагают на 30-40 % лучшие ценовые характеристики, чем нынешнее поколение GPU. Компания обладает «невероятными талантами» в области проектирования чипов и работает над новыми поколениями ускорителей. «Мы рассчитываем привлечь больше клиентов, начиная с Trainium 3, превью которого ожидается позже в этом году», — сказал представитель Amazon. Генеральный директор Amazon Энди Джасси (Andy Jassy) заявил во время отчёта о доходах компании, что чипы Trainium2 «полностью распределены по подписке» и теперь являются «многомиллиардным» бизнесом, который последовательно увеличивается на 150 % от квартала к кварталу. Жалобы клиентов Amazon на её чипы поступали и раньше. Согласно июльскому документу, стартап Typhoon обнаружил, что устаревшие ускорители NVIDIA A100 в три раза экономичнее для определённых рабочих нагрузок, чем чипы Inferentia2 от AWS, ориентированные на инференс. В свою очередь, исследовательская группа AI Singapore установила, что серверы AWS G6, оснащённые ускорителями NVIDIA, более экономичны по сравнению с Inferentia2 при различных вариантах использования. В прошлом году клиенты облака Amazon также отмечали «проблемы при внедрении» её пользовательских ИИ-чипов, которые создают «проблемные области», что ведёт к снижению их использования. Эти проблемы нашли отражение в доле рынка Amazon. По данным исследовательской компании Omdia, NVIDIA доминирует на рынке ИИ-чипов с долей более 78 %. За ней следуют Google и AMD, владеющие по чуть более 4 %. AWS занимает лишь шестое место с 2 % рынка. Наглядно иллюстрирует проблемы Amazon в этом отношении соглашение AWS и OpenAI стоимостью $38 млрд. Сделка предполагает использование облачных ИИ-серверов на базе ускорителей NVIDIA, без упоминания чипов Trainium. Ускорители NVIDIA не только обеспечивают высокую производительность, но подкрепляются широко распространённой платформой CUDA. Это качество особенно ценно при разработке крупных проектов в области ИИ с высоким уровнем риска, когда надёжность и имеющийся опыт могут сыграть решающую роль. В июльском документе сотрудники Amazon отметили, что технические ограничения и другие проблемы, связанные со сравнением пользовательских ИИ-чипов компании и ускорителей NVIDIA, стали «критическим препятствием» для клиентов, задумывающихся о переходе на чипы AWS. До публикации отчёта о доходах Amazon на прошлой неделе аналитики Bank of America соблюдали осторожность в оценке прогресса Tranium. В аналитической заметке, опубликованной в конце октября, они предупредили, что инвесторы «скептически» относятся к возможностям Trainium, и что «неясно», проявится ли высокий спрос на них «за пределами Anthropic». Недавно AWS запустила проект Project Rainier — ИИ-кластер из полумиллиона чипов Trainium2, которые будут использоваться для обучения LLM следующего поколения Anthropic. Ожидается, что к концу года Anthropic получит более 1 млн чипов Trainium2, но решение по этому вопросу ещё не принято. Если реализация проекта будет успешной, это станет огромным подспорьем для Amazon. Вместе с тем в прошлом месяце Anthropic подписала многомиллиардный контракт на использование Google TPU, отметив, что продолжит использовать Trainium. Хотя Anthropic публично признала сложность использования архитектур с разными чипами, представитель Amazon сообщил Business Insider, что Anthropic продолжает расширять использование Trainium и подчеркнул стремление компании предлагать клиентам широкий спектр аппаратных опций в рамках своих облачных сервисов. В ходе общения с аналитиками на прошлой неделе Джасси подчеркнул, что AWS сосредоточена на предоставлении «нескольких вариантов чипов». Он отметил, что цель состоит не в том, чтобы заменить чипы NVIDIA, а в том, чтобы предоставить клиентам больше выбора. Этой стратегии AWS придерживается и в других областях облачных вычислений, сказал он. «В истории AWS никогда не было случая, чтобы какой-то один игрок в течение длительного периода времени владел всем сегментом рынка, а затем мог удовлетворить потребности всех во всех аспектах», — сказал Джасси. В долгосрочной перспективе не слишком удачные продажи собственных ускорителей не лучшим образом скажутся на AWS. Компания понимает, что её решения могут быть менее производительны и удобны, поэтому и предлагает их по меньшей цене, чем ускорители NVIDIA. Однако стоимость их производства сравнима со стоимостью производства чипов такого же класса, и со временем она будет только расти. Проще говоря, Amazon меньше зарабатывает на своих чипах, а в худшем случае может терять на них деньги.

10.11.2025 [12:05], Сергей Карасёв

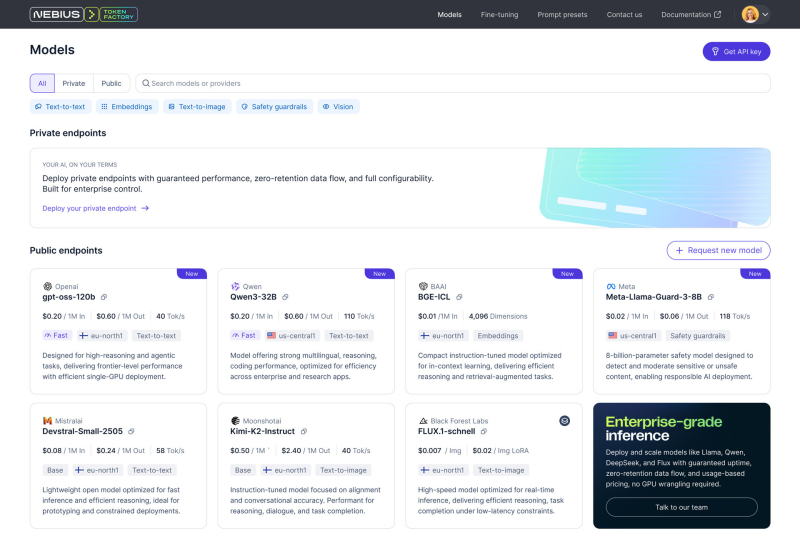

Фабрика токенов: Nebius, бывшая Yandex NV, запустила платформу Token Factory для инференса на базе открытых ИИ-моделейКомпания Nebius (бывшая материнская структура «Яндекса») представила платформу Nebius Token Factory для инференса: она позволяет разворачивать и оптимизировать открытые и кастомизированные ИИ-модели в больших масштабах с высоким уровнем надёжности и необходимым контролем. Nebius отмечает, что применение закрытых ИИ-моделей может создавать трудности при масштабировании. С другой стороны, открытые и кастомизированные модели позволяют устранить эти ограничения, но управление ими и обеспечение безопасности остаются технически сложными и ресурсоёмкими задачами для большинства команд. Платформа Nebius Token Factory призвана решить существующие проблемы: она сочетает гибкость открытых моделей с управляемостью, производительностью и экономичностью, которые необходимы организациям для реализации масштабных проектов в сфере ИИ. Nebius Token Factory базируется на комплексной ИИ-инфраструктуре Nebius. Новая платформа объединяет высокопроизводительный инференс, пост-обучение и управление доступом. Обеспечивается поддержка более 40 open source моделей, включая новейшие версии Deep Seek, Llama, OpenAI и Qwen. Среди ключевых преимуществ Nebius Token Factory заявлены соответствие требованиям корпоративной безопасности (HIPAA, ISO 27001 и ISO 27799), предсказуемая задержка (менее 1 с), автоматическое масштабирование пропускной способности и доступность на уровне 99,9 %. Инференс выполняется в дата-центрах на территории Европы и США без сохранения данных на серверах Nebius. Задействована облачная экосистема Nebius AI Cloud 3.0 Aether, что, как утверждается, обеспечивает безопасность корпоративного уровня, проактивный мониторинг и стабильную производительность. Отмечается, что Nebius Token Factory может применяться для решения широкого спектра ИИ-задач: от интеллектуальных чат-ботов, помощников по написанию программного кода и генерации с дополненной выборкой (RAG) до высокопроизводительного поиска, анализа документов и автоматизированной поддержки клиентов. Интегрированные инструменты тонкой настройки и дистилляции позволяют компаниям адаптировать большие открытые модели к собственным данным. При этом достигается сокращение затрат на инференс до 70 %. Оптимизированные модели затем можно быстро разворачивать без ручной настройки инфраструктуры.

09.11.2025 [13:38], Сергей Карасёв

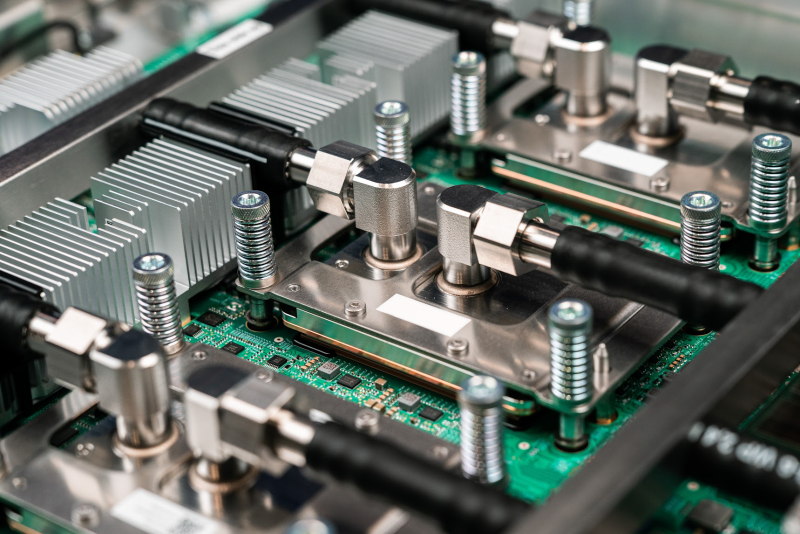

Nebius Аркадия Воложа развернула в Великобритании платформу AI Cloud на базе NVIDIA HGX B300Компания Nebius (бывшая материнская структура «Яндекса» Yandex N.V.) объявила о своём первом развёртывании ИИ-инфраструктуры в Великобритании. Кластер Nebius AI Cloud расположен в кампусе Longcross Park на площадке Ark Data Centres недалеко от Лондона. Как отмечает основатель и генеральный директор Nebius Аркадий Волож, Великобритания является одним из ведущих ИИ-центров в мире. Поэтому для компании создание кластера на территории этой страны имеет большое значение. Кластер состоит из 126 стоек с оборудованием, размещённых в трёх машинных залах. В рамках первой фазы проекта установлены 4 тыс. ускорителей NVIDIA HGX B300 (Blackwell Ultra) в составе серверов пятого поколения (Gen5) собственной разработки Nebius. Вторая фаза предполагает монтаж ещё 3 тыс. ускорителей B300. Общая мощность системы — 16 МВт. По заявлениям Nebius, британский кластер AI Cloud использует передовые энергоэффективные технологии охлаждения, сетевое подключение NVIDIA Quantum-X800 InfiniBand с низкой задержкой и надёжную локальную систему генерации электроэнергии. Говорится о полной интеграции с программной платформой NVIDIA AI Enterprise, предназначенной для разработки и развёртывания ИИ-приложений. Объединяя нашу облачную инфраструктуру с новейшими технологиями NVIDIA, мы предоставляем организациям по всей Великобритании возможность обучать, развёртывать и масштабировать модели и приложения ИИ быстрее, безопаснее и эффективнее, чем когда-либо», — говорит Волож. Британский кластер использует облачную платформу Nebius AI Cloud 3.0 Aether, которая разработана специально для создания и использования ИИ в таких областях, как здравоохранение, финансы, науки о жизни, корпоративный сектор и государственная сфера. Говорится о поддержке сквозного шифрования и о полном соответствии стандартам защиты данных GDPR и CCPA. Ранее Nebius сообщила о запуске своего первого кластера AI Cloud в Израиле, который расположился на площадке в Модиине (Modiin). У Nebius также имеются дата-центры в Финляндии, Франции и США.

09.11.2025 [00:35], Владимир Мироненко

Создание Microsoft массивной ИИ-инфраструктуры в ОАЭ повышает риск утечки технологий и ресурсов в КитайПоддержка Microsoft масштабного развёртывания ИИ-инфраструктуры в ОАЭ, объём инвестиций которой в 2023–2029 гг. в различные проекты в стране составит $15,2 млрд, вызывает опасения у экспертов по поводу обеспечения безопасности, пишет ресурс Dark Reading. В партнёрстве с местной ИИ-компанией G42, поддерживаемой суверенным фондом благосостояния ОАЭ, Microsoft строит первую очередь ИИ-кампуса с новейшими ускорителями NVIDIA. За время президентства Джо Байдена (Joe Biden) Microsoft поставила в ОАЭ эквивалент 21,5 тыс. ускорителей NVIDIA A100. А при администрации Дональда Трампа (Donald Trump) компания получила экспортные лицензии, которые позволяют поставить в ОАЭ эквивалент ещё 60,4 тыс. A100. В прошлом году Microsoft инвестировала в G42 $1,5 млрд. В мае этого года пять компаний — Cisco, NVIDIA, OpenAI, Oracle и SoftBank Group — объединили усилия с G42 для создания Stargate UAE — вычислительного кластера мощностью 1 ГВт в рамках проекта по строительству 5-ГВт ИИ-кампуса. Что касается безопасности, то при заключении Microsoft соглашения об инвестициях в G42 обеим сторонам пришлось согласовать обязательный рамочный документ — Межправительственное соглашение о гарантиях (IGAA) — для соблюдения передовых требований в области кибербезопасности, физической безопасности, экспортного контроля и политики «Знай своего клиента» (KYC). Однако, по неофициальным данным, одним из условий сделки Microsoft с G42 также был отказ ОАЭ от сотрудничества с Китаем и вывод ряда китайских решений из инфраструктуры страны. Безопасность — ключевой элемент уравнения, особенно учитывая, что ОАЭ считаются «сложным» партнёром для США, говорит Джанет Иган (Janet Egan), старший научный сотрудник и заместитель директора программы технологий и национальной безопасности Центра новой американской безопасности (CNAS), указав на то, что в ОАЭ не демократический режим и поддерживаются тесные партнёрские отношения с Китаем, в том числе по вопросам безопасности. «США стремятся приблизить [ОАЭ] к своей орбите и геостратегическому партнёрству, но в то же время должны быть очень осторожны, чтобы не вооружить другую страну, которая может затем сместить или отделить свои интересы от интересов США», — отметила Иган. Опасения понятны — контролировать дата-центры с новейшими технологиями за пределами США гораздо сложнее. Это касается и возможных утечек, и готовности к атакам любого рода. Кроме того, КНР уже не раз ловили на использовании облачной инфраструктуры с передовыми чипами через посредников. Этот вопрос снова был поднят в связи со сделками между G42 и Cerebras. Последняя не только является разработчиком ИИ-ускорителей, но и поставщиком облачных ИИ-решений. ОАЭ — важный союзник США в регионе и самый активный в мире разработчик ИИ-технологий — согласно отчёту Microsoft «AI Diffusion Report» страна занимает первое место по уровню использования ИИ. Страна всерьёз собирается стать ИИ-сверхдержавой. Впрочем, это не мешает, к примеру, китайской Alibaba Cloud развиваться в стране, а Huawei — пытаться продать ОАЭ собственные ускорители Ascend, пока США тянули с разрешением на поставки чипов NVIDIA. По словам вице-председателя и президента Microsoft Брэда Смита (Brad Smith), при администрации Байдена компания проделала «значительную работу… для соответствия строгим требованиям кибербезопасности, национальной безопасности и другим технологическим требованиям, предъявляемым лицензиями на экспорт чипов». Последние разрешения на экспорт чипов, выданные нынешней администрацией Белого дома, потребовали ещё более строгих технологических гарантий, отметил Dark Reading.

08.11.2025 [12:47], Владимир Мироненко

Минюст США одобрил крупнейшую сделку Alphabet — покупку стартапа Wiz за $32 млрдAlphabet, материнская компания Google, получила одобрение Министерства юстиции США на покупку стартапа Wiz в области облачной кибербезопасности, сообщил на этой неделе исполнительный директор Wiz Ассаф Раппапорт (Assaf Rappaport) на мероприятии Wall Street Journal. Это крупнейшая для Google сделка на сегодняшний день. Официального сообщения Минюста США по этому поводу пока не поступало, но его одобрение фактически уже получило ранее подтверждение в заявлении Федеральной торговой комиссии (FTC) от 24 октября, согласно которому сделке был предоставлен «статус предоставления», сообщил SiliconANGLE. Прежде чем дать разрешение регулятор, как сообщается, провёл тщательную проверку сделку вместе с другими антимонопольными органами. Раппапорт отметил, что до завершения сделки предстоит получить одобрение Великобритании, ЕС, Японии и других стран, поскольку Google и Wiz ведут деятельность по всему миру. Представитель Google подтвердил ресурсу The Register факт получения одобрения Минюста США, добавив, что теперь Google и Wiz переходят к обсуждению мнения других юрисдикций о сделке. «Расширение доступа к решениям безопасности для мультиоблачных сред, как это приобретение, предоставит компаниям и правительствам больше выбора в способах защиты», — сообщил он в электронном письме. В отдельном заявлении Google отметила, что флагманское предложение Wiz — унифицированная платформа облачной безопасности, объединяющая «все основные облака и среды разработки кода» на единой панели управления — отличается от сервисов облачной безопасности, которые компания предлагает в настоящее время, что делает приобретение вполне естественным шагом. Google уже пыталась приобрести Wiz в 2024 году, предложив $23 млрд, но генеральный директор стартапа ответил отказом, намереваясь выйти на биржу вместо того, чтобы стать дочерней компанией Google. Wiz провела 7 раундов финансирования, в ходе которых привлекла $1,9 млрд, включая раунд в $1 млрд при оценке рыночной стоимости в $12 млрд в мае 2024 года. Весной 2025 года Google предложила стартапу уже $32 млрд, причём 10 % этой суммы Google обязана выплатить стартапу, если покупка в итоге не состоится. Сделка является крупнейшим приобретением Alphabet, которое значительно расширит портфель услуг облачной безопасности Google. Программная платформа Wiz позволяет компаниям обнаруживать уязвимости и вредоносную активность в своих облачных системах, предоставляя им всю необходимую информацию в одном месте в любом масштабе для более быстрого анализа и принятия обоснованных решений. Функции платформы также включают ранжирование уязвимостей, позволяющее пользователям оценивать уязвимости и неправильные настройки на основе серьёзности, подверженности риску, возможности использования, радиуса действия и влияния на бизнес. Платформа поддерживает AWS, Microsoft Azure, Google Cloud Platform и Kubernetes. Комментируя сделку, Дэнни Брикман (Danny Brickman), соучредитель и генеральный директор компании Oasis Security, занимающейся управлением идентификационными данными, сообщил, что приобретение улучшит предложения Google в области безопасности, отметив, что «инвестиции Google в Wiz являются ярким подтверждением той важной роли, которую компании нового поколения, занимающиеся кибербезопасностью, играют в современном облачном ИИ-управляемом мире. Это не только подтверждает огромную ценность инновационных решений в области кибербезопасности, но и указывает на хорошие перспективы отрасли в целом».

07.11.2025 [22:12], Владимир Мироненко

VAST Data и CoreWeave заключили сделку на $1,17 млрдИИ-стартап VAST Data объявил о заключении сделки с облачным провайдером CoreWeave стоимостью $1,17 млрд, в рамках которой CoreWeave будет использовать VAST AI OS в качестве основной платформы управления данными для своей облачной ИИ-инфраструктуры. Финансовые подробности сделки, включая сроки действия не раскрываются. VAST лишь сообщил, что такие контракты обычно заключаются на три-пять лет. «Объединяя инфраструктуру CoreWeave и VAST AI, компании создают новый класс интеллектуальной архитектуры данных, предназначенной для поддержки непрерывного обучения, инференса в реальном времени и обработки больших объёмов данных для критически важных отраслей», — сообщается в пресс-релизе. Говорится, что расширенное партнёрство подтверждает давнюю приверженность CoreWeave использованию VAST AI OS в качестве основной платформы данных, укрепляя позиции VAST в качестве ключевого компонента ИИ-облака CoreWeave. VAST также сообщил, что его программно-определяемое хранилище построено на базе бесконечно масштабируемой архитектуры, которую можно развернуть в крупных ЦОД, где требуется надёжность и масштабируемость. Платформа управления данными VAST AI OS объединяет сервисы данных — DataSpace, DataBase, DataStore, DataEngine, AgentEngine, InsightEngine — поверх архитектуры DASE (Distributed and Shared Everything). Стек хранения CoreWeave включает локальные, объектные и распределённые файловые сервисы хранения. Локальное хранилище поддерживает эфемерные тома до 60 Тбайт, в то время как выделенные кластеры используют технологии VAST, WEKA, DDN, IBM Spectrum Scale и Pure Storage. Уровень объектного хранилища S3 использует локальный ускоритель передачи объектов (LOTA) для кеширования данных непосредственно на узлах GPU. Соглашение позволяет CoreWeave «управлять и защищать сотни петабайт данных одновременно. Кроме того, мы совместимы с POSIX и подходим для совместного доступа между несколькими экземплярами», заявили в Coreweave ресурсу Blocks & Files. VAST Data и CoreWeave планируют согласовать планы развития своих продуктов, чтобы улучшить хранение и доступ к данным для рабочих ИИ-нагрузок и повысить эффективность работы. Разрабатываемое VAST Data ПО позволяет компаниям эффективно хранить и обрабатывать большие объёмы информации, используемой для обучения и эксплуатации ИИ-систем, и получать доступ к неструктурированным данным, таким как электронные письма, сообщения клиентов, видео и PDF-файлы. Компания взимает с клиентов плату в зависимости от ёмкости и используемых функций. В числе партнёров VAST Data компания NVIDIA, заключившая с ней соглашение по созданию собственной инфраструктуры обработки данных. В прошлом году на встрече с главой VAST Data Ренен Халлак (Renen Hallak) генеральный директор и основатель NVIDIA Дженсен Хуанг (Jensen Huang) высоко оценил решения компании и заявил, что рассчитывает на сотрудничество с ней в течение следующих 80 лет, пишет CRN. Также среди партнёров стартапа ведущие провайдеры облачных услуг (AWS и др.), неооблака (Nebius и др.), лаборатории ИИ (xAI и др.), сообщил соучредитель VAST Джефф Денворт (Jeff Denworth) в интервью агентству Reuters. Сделка может помочь компании в привлечении финансирования. В августе сообщалось, что VAST ведёт переговоры о привлечении нескольких миллиардов долларов нового капитала при оценке до $30 млрд. Среди потенциальных инвесторов — фонд Alphabet CapitalG и NVIDIA. VAST Data оценивалась в $9,1 млрд после раунда финансирования в 2023 году. Инвесторы рассматривают компанию как потенциального кандидата на IPO.

07.11.2025 [17:07], Руслан Авдеев

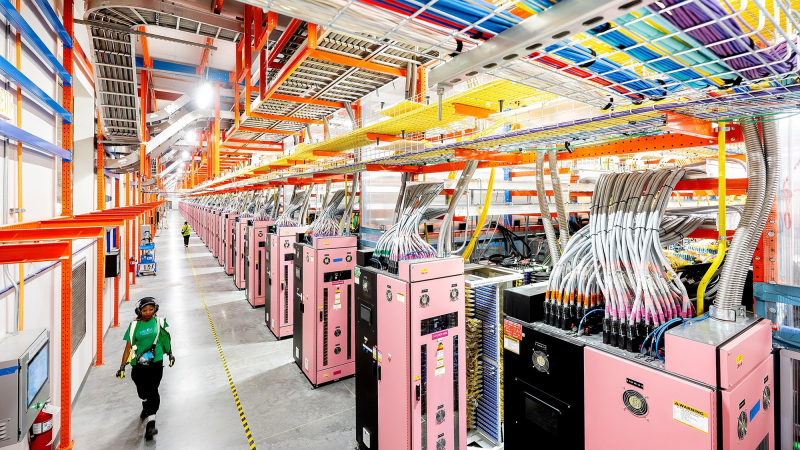

Iren резко улучшила финансовые показатели и занялась строительством 3-ГВт ИИ-платформы AI CloudIren Ltd. отчиталась о результатах работы в I квартале 2026 финансового года, который закончился 30 сентября 2025 года (). Благодаря быстрому расширению сегмента AI Cloud и заключению серии многолетних контрактов общая выручка компании выросла на 355 % год к году до $240,3 млн. Показатель скорректированной EBITDA увеличился на 3568 % до $91,7 млн. Чистая прибыль (правда, с учётом нереализованной прибыли) составила $384,6 млн против убытка годом ранее. Такие рекордные показатели связаны со стремительным ростом спроса на ИИ-вычисления со стороны гиперскейлеров и корпоративных клиентов. Мощность инфраструктуры IREN вскоре вырастет до 3 ГВт. К концу 2026 года компания намерена иметь парк из 140 тыс. ИИ-ускорителей, на которые придётся лишь лишь 16 % энергетического портфолио. Компания заключила многолетние соглашения с Together AI, Fluidstack и Fireworks AI, в результате чего плановая выручка AI Cloud в годовом исчислении составит более $500 млн к концу I квартала 2026 года. Iren также упомянула ранее анонсированный контракт с Microsoft на сумму $9,7 млрд, который и внесёт основной вклад в годовую регулярную выручку (ARR, Annual Recurring Revenue) сегмента AI Cloud, запланированную на уровне $3,4 млрд.

Источник изображения: Iren Iren сообщила не только о росте клиентской базы, но и о наличии $1,8 млрд денежных средств или их эквивалентов, выпуске бескупонных конвертируемых облигаций на $1 млрд и привлечении целевых $400 млн на приобретение ускорителей для поддержки роста. 160-МВт площадка в Британской Колумбии до конца года будет переведена с ASIC-чипов для майнинга на ИИ-ускорители. В техасском Чилдрессе (Childress) Iren намерена ускорить строительство 750-МВт кампуса уровня Tier III с поддержкой СЖО и плотностью стоек 130–200 кВт для обучения высокопроизводительных ИИ-моделей. Площадка Sweetwater Hub мощностью 2 ГВт будет развёрнута в две фазы: 1,4 ГВт — в апреле 2026 года, 600 МВт — в конце 2027 года. Это часть портфолио объектов IREN, общая мощность которого составит 3 ГВт. По мнению экспертов Converge Digest, переход с ASIC-майнеров на ИИ-решения аналогичен мерам, принятым компаниям вроде CoreWeave и Crusoe Energy, в своё время перешедших с майнинговых проектов на работу с искусственным интеллектом. Это знаменует более широкий поворот в индустрии на создание ИИ ЦОД с высокой энергетической плотностью с заключением долговременных контрактов с гиперскейлерами.

07.11.2025 [14:16], Владимир Мироненко

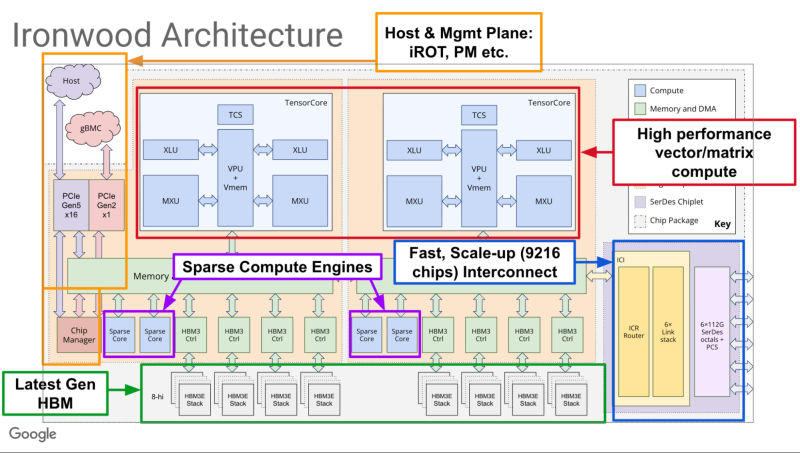

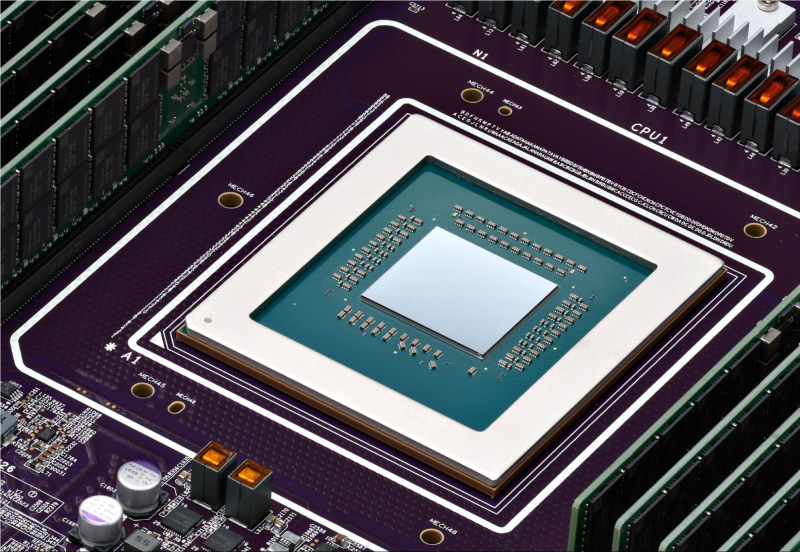

Google объявила о доступности фирменных ИИ-ускорителей TPU Ironwood и кластеров на их основеGoogle объявила о доступности в ближайшие недели ИИ-ускорителя седьмого поколения TPU v7 Ironwood, специально разработанного для самых требовательных рабочих нагрузок: от обучения крупномасштабных моделей и сложного обучения с подкреплением (RL) до высокопроизводительного ИИ-инференса и обслуживания моделей с малой задержкой. Google отметила, что современные передовые ИИ-модели, включая Gemini, Veo, Imagen от Google и Claude от Anthropic, обучаются и работают на TPU. Многие компании смещают акцент с обучения этих моделей на обеспечение эффективного и отзывчивого взаимодействия с ними. Постоянно меняющаяся архитектура моделей, рост агентных рабочих процессов и практически экспоненциальный рост спроса на вычисления определяют новую эру инференса. В частности, ИИ-агенты, требующие оркестрации и тесной координации между универсальными вычислениями и ускорением машинного обучения, создают новые возможности для разработки специализированных кремниевых процессоров и вертикально оптимизированных системных архитектур. TPU Ironwood призван обеспечить новые возможности для инференса и агентных рабочих нагрузок. TPU Ironwood был представлен в апреле этого года. По данным Google, он обеспечивает десятикратное увеличение пиковой производительности по сравнению с TPU v5p и более чем четырёхкратное увеличение производительности на чип как для обучения, так и для инференса по сравнению с TPU v6e (Trillium), что делает Ironwood самым мощным и энергоэффективным специализированным кристаллом компании на сегодняшний день. Ускорители объединяются в «кубы» — 64 шт. TPU в 3D-торе, объединённых интерконнектом Inter-Chip Interconnect (ICI) со скоростью 9,6 Тбит/с на подключение. Google сообщила, что на базе Ironwood можно создавать кластеры, включающие до 9216 чипов (42,5 Эфлопс в FP8), объединённых ICI с агрегированной скоростью 88,5 Пбит/с с доступом к 1,77 Пбайт общей памяти HBM, преодолевая узкие места для данных даже самых требовательных моделей. Компания отметила, что в таком масштабе сервисы требуют бесперебойной доступности. Её гарантирует технология оптической коммутации (OCS), которая реализуется как динамическая реконфигурируемая инфраструктура. А если клиенту требуется больше мощности, Ironwood масштабируется в кластеры из сотен тысяч TPU. Своим клиентам, пользующимся решениями на TPU, компания предлагает возможности Cluster Director в Google Kubernetes Engine. Это включает в себя расширенные возможности обслуживания и понимания топологии для интеллектуального планирования и создания высокоустойчивых кластеров. Для предобучения и постобучения компания предлагает новые улучшения MaxText, высокопроизводительного фреймворка LLM с открытым исходным кодом, которые упрощают внедрение новейших методов оптимизации обучения и обучения с подкреплением, таких как контролируемая тонкая настройка (SFT) и оптимизация политики генеративного подкрепления (GRPO) — алгоритм обучения с подкреплением (RL). Также улучшена поддержка vLLM, что позволит с минимальными усилиями перенести инференс с GPU на TPU. А GKE Inference Gateway позволит снизить задержку выдачи первого токена (TTFT). Никуда не делась и поддержка JAX с PyTorch.

07.11.2025 [12:16], Владимир Мироненко

Google представила инстансы N4A и C4A Metal на базе фирменных Arm-процессоров AxionGoogle представила новые инстансы на базе фирменных Arm-процессоров Axion: N4A и C4A Metal. N4A — самая экономичная виртуальная машина серии N на сегодняшний день, которая уже доступна в тестовом режиме (Preview Mode). N4A предлагает до двух раз лучшее соотношение цены и производительности, чем сопоставимые виртуальные машины текущего поколения на базе x86. N4A доступен в готовых и настраиваемых конфигурациях: до 64 vCPU, 512 Гбайт DDR5 и сетевым подключением 50 Гбит/с. N4A предлагается в конфигурациях с высокой производительностью процессора (2 Гбайт RAM на vCPU), стандартной (4 Гбайт на vCPU) и с высокой производительностью памяти (8 Гбайт на vCPU). Виртуальные машины N4A поддерживают новейшие решения для хранения данных Hyperdisk, включая Hyperdisk Balanced, Hyperdisk Throughput и Hyperdisk ML (будет доступно позже), обеспечивая до 160 тыс. IOPS и пропускную способность 2,4 Гбайт/с на инстанс. N4A демонстрирует высокие результаты в ряде отраслевых бенчмарков, отражающих ключевые рабочие нагрузки. Например, по сравнению с аналогичными x86-инстансами текущего поколения N4A обеспечивает до 105 % лучшее соотношение цены и производительности для вычислительных нагрузок, до 90 % — для масштабируемых веб-серверов, до 85 % — для Java-приложений и до 20 % — для баз данных общего назначения. N4A доступен в виде превью для Compute Engine, Google Kubernetes Engine (GKE), Dataproc и Batch, а поддержка Dataflow и других сервисов появится в ближайшее время. C4A Metal — первый инстанс Google на базе Arm-архитектуры на bare metal-серверах. Он включает до 96 vCPU, до 768 Гбайт DDR5, сетевое подключение со скоростью до 100 Гбит/с и полную поддержку Google Cloud Hyperdisk, включая варианты хранения Hyperdisk Balanced, Extreme, Throughput и блочный доступ. Этот инстанс оптимизирован для специализированных рабочих нагрузок, таких как гипервизоры и разработка нативных приложений для Arm-архитектуры. Как облачное решение, C4A Metal обеспечивает снижение совокупной стоимости владения (TCO), предлагая предсказуемые эксплуатационные расходы. Компания отметила, что, запуская конвейеры разработки и тестирования на физических экземплярах процессоров Axion с использованием C4A Metal, разработчики Android могут получить выгоду от нативной производительности, устраняя накладные расходы на управление эмуляцией, такие как медленные уровни трансляции инструкций. Кроме того, они могут значительно сократить задержки для инструментов сборки Android и автоматизированных систем тестирования, что приведёт к ускорению циклов обратной связи. C4A Metal также решает проблемы производительности, связанные с вложенной виртуализацией, что делает его отличной платформой для масштабируемых сред Cuttlefish (Cloud Android). После сегодняшнего анонса портфолио инстансов на базе процессоров Axion теперь включает три варианта: N4A, C4A и C4A Metal. Вместе серии C и N позволяют снизить общие расходы на ведение бизнеса без ущерба для производительности или требований к конкретной рабочей нагрузке, отметила компания. «Независимо от того, используете ли вы Ironwood и Axion вместе или комбинируете их с другими вычислительными решениями, доступными на базе AI Hypercomputer, этот системный подход обеспечивает вам максимальную гибкость и производительность для самых требовательных рабочих нагрузок», — заявила Google.

06.11.2025 [22:34], Владимир Мироненко

Qualcomm и Arm разошлись во мнениях по поводу развития ИИ-вычисленийQualcomm и Arm опубликовали в среду квартальные отчёты, дав разные прогнозы относительно рынка процессоров для инференса, пишет The Register. Генеральный директор Qualcomm Криштиану Амон (Cristiano Amon) сообщил аналитикам в ходе телефонной конференции, посвященной квартальным финансовым результатам о том, что его компания выйдет на рынок ЦОД с чипами, предназначенными для выполнения задач инференса и потребляющими меньше энергии, чем «железо» конкурентов. Амон рассказал, что Qualcomm разрабатывает SoC и плату для неё, поскольку «рост ИИ-ЦОД смещается от обучения к специализированным рабочим нагрузкам инференса, и ожидается, что эта тенденция усилится в ближайшие годы». Вместе с тем он отметил, что Qualcomm не сможет отчитаться о «существенной» выручке в сегменте ЦОД до 2027 года. Генеральный директор Arm Рене Хаас (Rene Haas) тоже придерживается мнения, что энергопотребление является «узким местом» в ЦОД, и что спрос сместится с обучения на инференс, вместе с тем считая, что такого рода задачи будут выполняться и за пределами дата-центров. Он отметил растущий спрос на различные архитектуры и вычислительные решения, позволяющие выполнять инференс не в облаке. «Очевидно, что вы не будете полностью полагаться на что-то, что находится на периферии. Но сегодня всё наоборот. Всё на 100 % зависит от облака. И мы думаем, что это изменится», — заявил Хаас во время телефонной конференции с аналитиками, посвящённой финансовому отчёту Arm. Qualcomm анонсировала новую серию чипов для ИИ ЦОД AI200/AI250, заявив, что ИИ-стартап Humain, основанный суверенным фондом Саудовской Аравии, станет одним из их заказчиков. В ходе телефонной конференции Амон сообщил, что Qualcomm ведёт переговоры с другим крупным заказчиком-гиперскейлером, отметив, что они проходят успешно, пишет Reuters. Выручка Qualcomm в IV квартале 2025 финансового года, завершившемся 28 сентября 2025 года, составила $11,27 млрд, что на 10 % больше, чем годом ранее, и выше консенсус-прогноза аналитиков, опрошенных LSEG, в размере $10,79 млрд. В полупроводниковом сегменте (QCT) выручка компании составила $9,82 млрд, превысив результат годичной давности на 13 %. При этом выручка в автомобильном сегменте выросла на 17 % до $1,05 млрд, в сегменте Интернета вещей — на 7 % до $1,81 млрд. Скорректированная прибыль на акцию составила $3,00 при прогнозе от LSEG в размере $2,88. Из-за единовременной налоговой выплаты в размере $5,7 млрд компания завершила квартал с чистым убытком в $3,12 млрд, или $2,89 на акцию, тогда как годом ранее у неё была чистая прибыль в размере $2,92 млрд, или $2,59 на акцию. Выручка Qualcomm за 2025 финансовый год составила $44,3 млрд, что на 14 % больше показателя предыдущего финансового года. Чистая годовая прибыль снизилась на 45 % до $5,5 млрд. В I квартале 2026 финансового года Qualcomm прогнозирует выручку в размере $11,8–$12,6 млрд, что соответствует среднему значению в $12,2 млрд. По данным LSEG, это превышает консенсус-прогноз аналитиков в $11,62 млрд. Скорректированная прибыль на акцию, согласно ожиданиям компании, составит $3,30–$3,50 при прогнозе Уолл-стрит в размере $3,31 на акцию. Arm объявила о выручке во II квартале 2026 финансового года в размере $1,14 млрд, что на 34 % больше, чем годом ранее, а также больше прогноза аналитиков в размере $1,06 млрд, пишет Reuters. Третий квартал подряд выручка компании превышает $1 млрд. Выручка компании от роялти выросла год к году на 21 % до рекордных $620 млн, а от лицензирования — на 56 % до $515 млн благодаря новым крупным соглашениям в сфере вычислительных технологий нового поколения. Скорректированная операционная прибыль (Non-GAAP), достигла $467 млн, а скорректированная прибыль на акцию (Non-GAAP), составила $0,39, что в обоих случаях превышает прогноз, отметил ресурс Converge! Network Digest. Финансовый директор Джейсон Чайлд (Jason Child) сообщил инвесторам, что наибольший вклад в рост выручки внесли смартфоны, но «более высокие ставки роялти за чип в ЦОД, где мы по-прежнему наблюдаем рост доли кастомных чипов для гиперскейлеров», безусловно, не были помехой. Arm отметила, что набирает обороты вклад своей архитектуры в развитие облачного ИИ: более 1 млн ядер Arm Neoverse уже развёрнуто в инфраструктуре гиперскейлеров. Ожидается, что доля процессоров Arm в установленных ведущими гиперскейлерами чипах в этом году достигнет почти 50 %. Среди новых игроков на этом рынке компания отметила Google, которая уже перенесла более 30 тыс. облачных приложений на Arm-чипы Axion, включая Gmail и YouTube, и намерена перенести большую часть из более чем 100 тыс. своих приложений. Также в минувшем квартале Microsoft расширила использование процессоров Cobalt 100 на базе Arm до 29 регионов по всему миру. «Открытие пяти новых ЦОД Stargate AI, все из которых основаны на Arm как стратегической вычислительной платформе, подчёркивает роль Arm в обеспечении масштабируемого ИИ», — отметила компания. Доля Arm на рынке серверных процессоров действительно достигла 25 %, но во многом благодаря внедрению интегированных в суперчипы NVIDIA процессорам Grace. |

|