Материалы по тегу: ocp

|

01.12.2022 [18:11], Сергей Карасёв

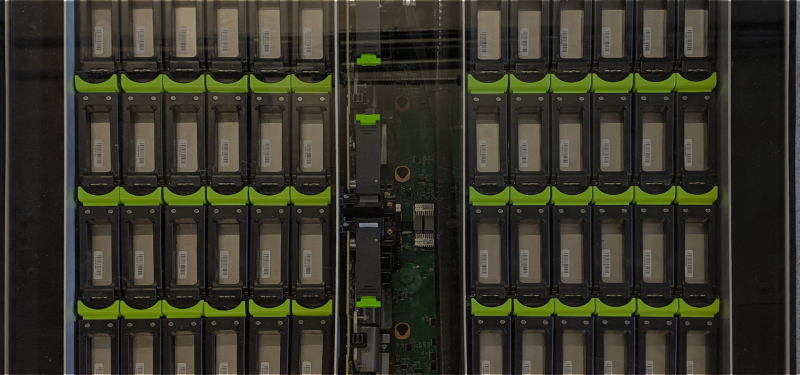

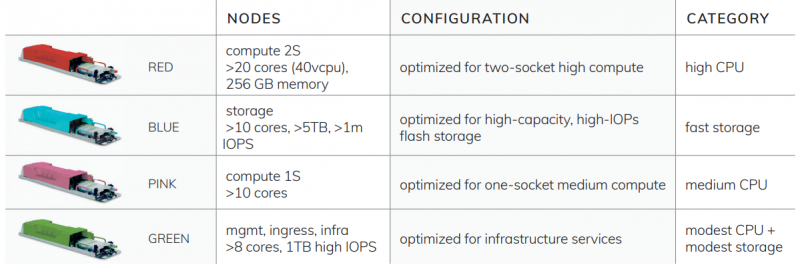

Iceotope и Meta✴ показали возможность иммерсионного охлаждения HDDКомпании Iceotope и Meta✴ продемонстрировали возможность иммерсионного (погружного) охлаждения систем хранения данных (СХД) на основе HDD. В ходе эксперимента было показано, что такой подход обеспечивает ряд преимуществ перед традиционным воздушным охлаждением. В тесте использовалась стандартная коммерческая СХД высокой плотности формата 4OU, содержащая 72 жёстких диска, два односокетных серверных узла, две платы расширения SAS, сетевую карту, модуль распределения питания и другие компоненты. При этом система охлаждения была модифицирована путём добавления специального диэлектрического контура, теплообменника и насоса. Накопители были погружены в непроводящую жидкость.  ✴/Iceotope/ASME " height="441" width="709" /> ✴/Iceotope/ASME " height="441" width="709" />

Источник изображения: Meta✴/Iceotope/ASME Говорится, что применение иммерсионного охлаждения для HDD возможно благодаря тому, что современные диски с заполнением гелием имеют герметичную конструкцию. Результаты эксперимента показали, что в случае погружного охлаждения разница температур между всеми 72 накопителями составила всего 3 °C — независимо от расположения HDD в шасси. Накопители способны надёжно функционировать при температуре жидкости на входе в стойку до +40 °C. Другим преимуществом иммерсионного подхода является то, что он позволяет сократить уровень вибрации, которая может приводить к некорректной работе накопителей или даже провоцировать их выход из строя. В целом, для работы системы погружного охлаждения требуется менее 5 % мощности, потребляемой самой СХД.

21.10.2022 [13:26], Сергей Карасёв

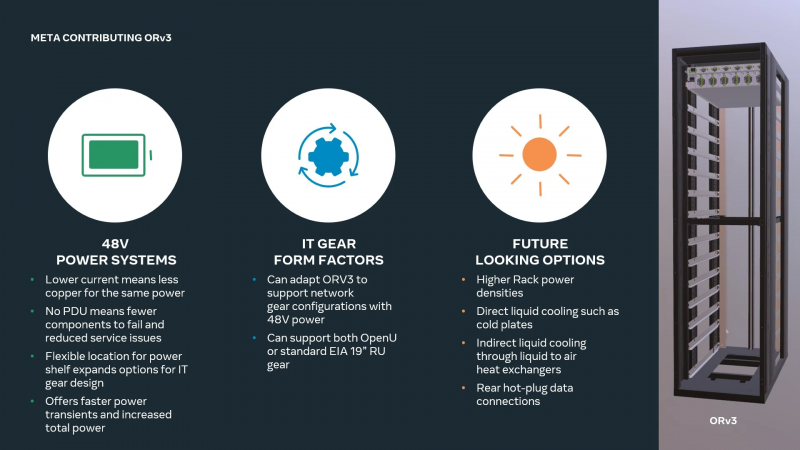

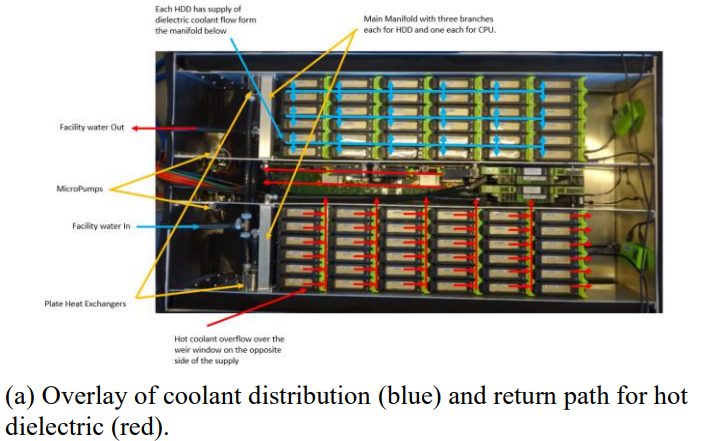

Meta✴ готова к массовому внедрению СЖО в своих дата-центрахКомпания Meta✴ в ходе саммита OCP (Open Compute Project) рассказала о планах по внедрению жидкостного охлаждения в своих ЦОД. Речь идёт об использовании гибридной системы AALC (Air-Assisted Liquid Cooling), предусматривающей совмещение компонентов воздушного охлаждения и жидкостного контура. Отмечается, что по мере развития машинного обучения и метавселенных всё острее встаёт проблема эффективного отвода тепла от оборудования. Дело в том, что внедряемые алгоритмы требуют больших вычислительных мощностей, что приводит к увеличению энергозатрат. Система AALC предназначена для охлаждения серверов в ЦОД, которые изначально могли быть и не спроектированы под использование СЖО. Отметим, что QCT уже представила аналогичное, полностью интегрированное решение.

Источник изображений: Meta✴ AALC совместима со стойкой Open Rack v3 (ORV3), которая, впрочем, может интегрироваться и с другими вариантами СЖО. Система AALC в исполнении Meta✴ использует водоблоки для самых горячих компонентов, которые подключаются к отдельной стойке с помпами и прочим оборудованием. На задней панели или двери стойки располагается теплообменник, позволяющий охлаждать жидкость за счёт воздуха, циркулирующего в ЦОД. Прототипы решения справляются с охлаждением оборудования мощностью до 40 кВт на стойку. ORV3 также предлагает общую архитектуру стойки и подсистемы питания для устранения разрыва между нынешними и будущими ЦОД. Обеспечивается широкий спектр вариантов использования, включая поддержку Grand Teton. Модуль питания для общей на всю стойку шины 48 В DC не имеет жёстко определённого расположения и может устанавливается в любом месте стойки, что обеспечивает гибкость конфигурации. При этом он может быть не один, так что пиковая мощность может достигать 30 кВт на стойку. Усовершенствованный ИБП обеспечивает работу в течение 4 мин. при мощности 15 кВт (против 1,5 мин. у решения предыдущего поколения). Этот блок также может монтироваться в любом месте стойки, а дополнительно возможно применение второго резервного блока. Всё это позволит Meta✴ уже сейчас развёртывать в ЦОД высокоплотную инфраструктуру для ИИ и иных требовательных к питанию и охлаждению решений.

18.10.2022 [19:00], Сергей Карасёв

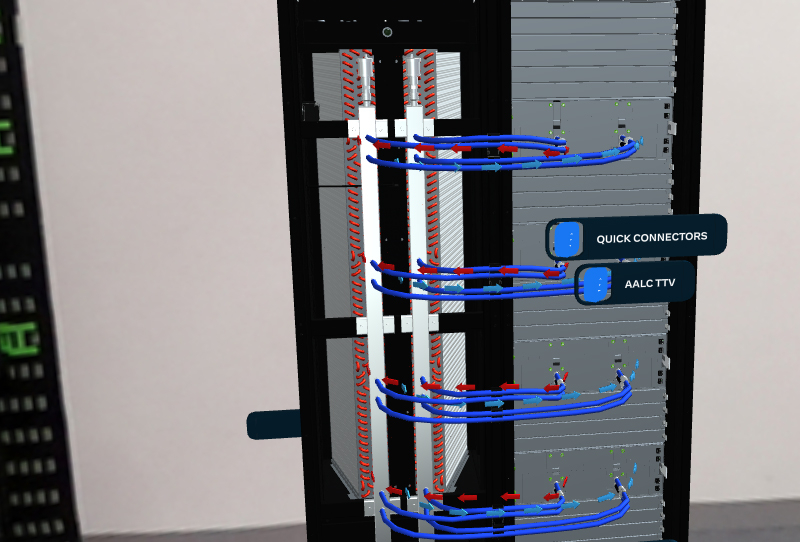

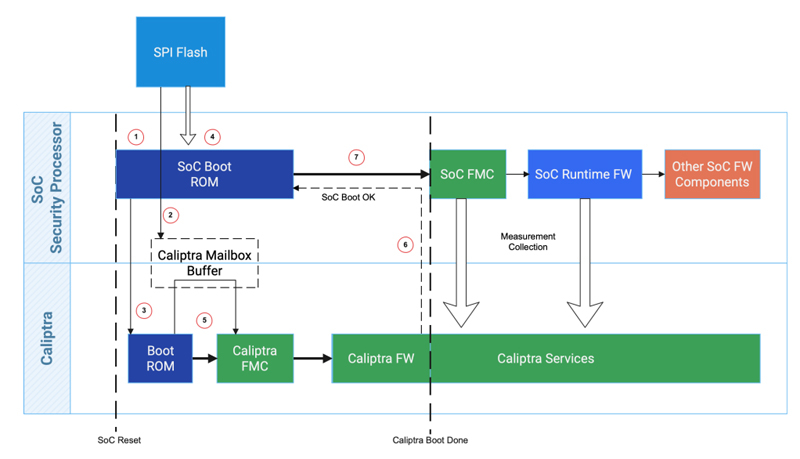

AMD, Google, Microsoft и NVIDIA представили Caliptra — проект по повышению безопасности каждого чипаВ ходе саммита OCP (Open Compute Project) анонсирована открытая спецификация Caliptra 0.5, призванная повысить безопасность процессоров, ускорителей, накопителей и практически любых систем-на-чипе (SoC). Речь идёт об аппаратной реализации технологии Root of Trust (RoT). Она предназначена для проверки целостности и подлинности прошивок и другого встроенного, а также системного программного обеспечения.  RoT гарантирует, что только доверенное ПО может исполняться на чипе. Отмечается, что традиционно средства RoT отделены от SoC и обычно обеспечиваются материнской платой. Однако новые бизнес-модели, предполагающие периферийные и облачные вычисления, предъявляют повышенные требования к обеспечению безопасности. Спецификация Caliptra 0.5 как раз и решает данную проблему.

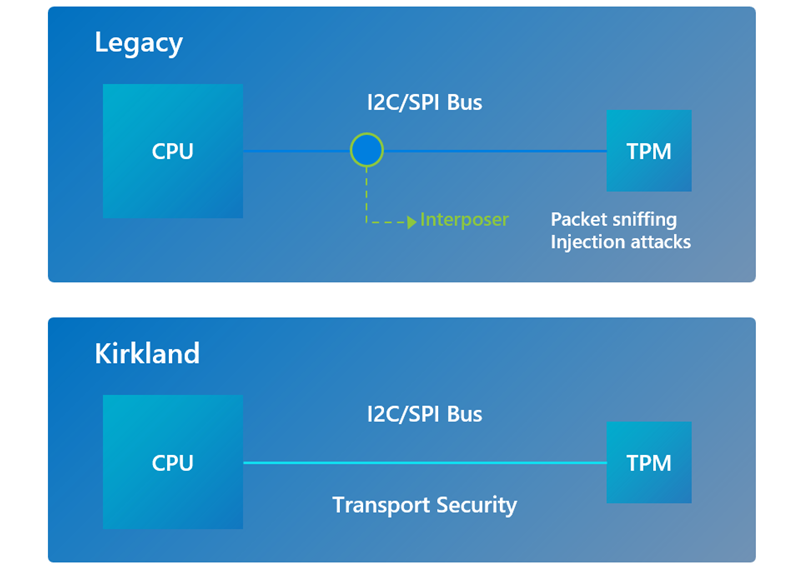

Источник изображений: Caliptra В разработке решения приняли участие AMD, Google, Microsoft и NVIDIA. Спецификация будет поддерживаться различными аппаратными изделиями следующего поколения — CPU, GPU, SSD, NIC и иные ASIC. Отмечается, что Caliptra 0.5 RTL (IP-блоки на базе RISC-V с необходимой обвязкой) распространяется через CHIPS Alliance (Common Hardware for Interfaces, Processors and Systems) — консорциум, который работает над созданием целого спектра открытых решений для SoC и высокоплотных упаковок чипов.  «Существует потребность в улучшенной прозрачности и согласованности низкоуровневой аппаратной безопасности. Мы открываем исходный код Caliptra вместе с нашими партнёрами для удовлетворения этих потребностей», — отмечает Microsoft. Также компания совместно с Google, Infineon и Intel представила Project Kirkland, направленный на создание защищённого канала связи между CPU и TPM с использованием программных средств.

Источник: Microsoft Спецификация Caliptra 0.5 доступна здесь для оценки. На основе отзывов будет выработан окончательный стандарт, отвечающий различным потребностям в зависимости от варианта использования. Кроме того, доступен исходный код, что поможет членам сообщества интегрировать решение в свои микросхемы. Говорится также, что выход спецификации знаменует собой важный шаг вперёд в сторону общеотраслевого сотрудничества в области информационной безопасности.

29.04.2022 [22:04], Алексей Степин

Meta✴ синхронизирует время в своих дата-центрах с помощью модулей Orolia Spectratime на базе рубидиевых атомных часовТакой масштабный проект, как метавселенная, создаваемая ныне Meta✴, будет включать в себя огромное количество серверов в дата-центрах по всей планете, которые будут обслуживать единое виртуальное пространство. Функционирование столь сложного проекта, естественно, не может не зависеть от точной синхронизации часов, и чем точнее этот процесс, тем лучше. С целью обеспечения идеальной точности синхронизации Meta✴ будет использовать в своих серверах «карты времени» Orolia. Они используют открытый протокол и разработаны в сотрудничестве с самой Meta✴. Модули Orolia Spectratime mRO-50 пользуются компактными рубидиевыми атомными часами, чья точность уступает лишь гораздо более дорогим цезиевым собратьям, используемым в качестве первичного стандарта частоты.

Плата Orolia/Meta✴ имеет форм-фактор FHHL и интерфейс PCI Express x4 Благодаря использованию новых плат синхронизации Meta✴ надеется добиться снизить максимальное расхождение часов в разных ЦОД до уровня менее 100 мкс. Ранее Meta✴ удалось снизить этот параметр с 10 мс до 100 мкс благодаря использованию сигналов GNSS. В 2021 году был показан прототип PCIe-адаптера, которым компания поделилась с инициативой Time Appliance Project (TAP), действующей в рамках Open Compute Project (OCP).

Модуль рубидиевых атомных часов Orolia mRO-50 На основе разработок Meta✴ Time Card в итоге и был создан адаптер точного времени Orolia ART Card. Сейчас пришло время для второго поколения, которое получило название ART2. Сам модуль Orolia Spectratime mRO-50 генерирует стабильный сигнал частотой 10 МГц, отклонения которой не превышают 4×10-10 при изменении температуры и 1×10-11 в день в процессе трёхмесячной эксплуатации.

26.03.2022 [00:48], Владимир Агапов

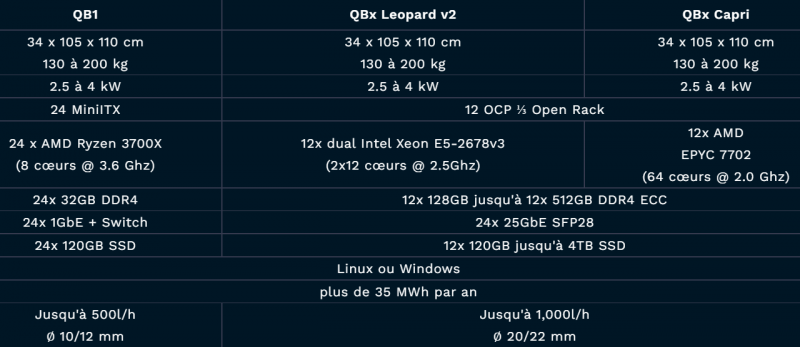

Микро-ЦОД вместо котельной — Qarnot предложила отапливать дома б/у серверами«Зелёная» экономика, переход на которую стремится осуществить всё больше стран, требует радикального сокращения вредного воздействия техносферы на окружающую среду. Один из эффективных способов достижения этой задачи связан с включением в полезный оборот побочных продуктов экономической деятельности. В случае дата-центров таким продуктом является тепло. Великобритания, Дания и другие страны направляют тепло от ЦОД в отопительные системы домов, а Норвегия обогревает им омаровые фермы и планирует обязать дата-центры отдавать «мусорное» тепло на общественные нужды. Французская компания Qarnot решила посмотреть на эту задачу под другим углом, разработав в 2017 г. концепцию электрообогревателя для жилых и офисных помещений на процессорах AMD и Intel. В 2018 г. Qarnot продолжила изыскания и выпустила криптообогреватель QC-1. А недавно она порадовала своих заказчиков следующим поколением отопительных устройств QB, которое создано в сотрудничестве с ITRenew. Новые модули используют OCP-серверы, которые ранее работали в дата-центрах гиперскейлеров. Оснащённые водяным охлаждением, они обогревают помещения пользователей и обеспечивают дополнительные мощности для периферийных облачных вычислений. Система отводит 96% тепла, производимого кластером серверов, которое попадает в систему циркуляции воды. IT-часть состоит из процессоров AMD EPYC/Ryzen или Intel Xeon E5 в составе OCP-платформ Leopard, Tioga Pass или Capri с показателем PUE, который, по словам разработчиков, стремится к 1,0. При этом вся система практически бесшумная, поскольку вентиляторы отсутствуют. В компании заявляют, что с февраля уже развёрнуто 12 000 ядер, и планируется довести их число до 100 000 в течении 2022 года. Среди предыдущих заказчиков систем отопления Qarnot числятся жилищные проекты во Франции и Финляндии, а также банк BNP и клиенты, занимающиеся цифровой обработкой изображений. По словам технического директора Qarnot Клемента Пеллегрини (Clement Pellegrini), QB приносит двойную пользу экологии, используя не только «мусорное» тепло, но и оборудование, которое обычно утилизируется. У ITRenew уже есть очень похожий совместный проект с Blockheating по обогреву теплиц такими же б/у серверами гиперскейлеров.

14.11.2021 [21:11], Владимир Мироненко

LiquidStack и Microsoft продемонстрировали ИИ-серверы с двухфазным иммерсионным охлаждениемLiquidStack, дочернее предприятие BitFury, специализирующееся на разработке иммерсионных СЖО, и Microsoft продемонстрировали на OCP Global Summit стандартизированное решение с двухфазным погружным жидкостным охлаждением. Демо-серверы Wiwynn, разработанные в соответствии со спецификациями OCP Open Accelerator Infrastructure (OAI), были погружены в бак LiquidStack DataTank 4U, способный отводить порядка 3 кВт/1U (эквивалент 126 кВт на стойку). LiquidStack сообщила, что она впервые оптимизировала серверы OCP OAI для охлаждения путем погружения в жидкость. По словам компании, её двухфазные иммерсионные СЖО DataTank предоставляют наиболее эффективное решение, которое требует немного пространства и потребляет меньше энергии, чем другие системы охлаждения, и вместе с тем повышает плотность размещения компонентов и их производительность.

Фото: LiquidStack В демо-серверах использовались ИИ-ускорители Intel Habana Gaudi, погружённые в жидкий диэлектрик (от 3M) с низкой температурой кипения, который наиболее эффективно отводит тепло благодаря фазовому переходу. Данное решение должно помочь достижению показателя PUE в пределах от 1,02 до 1,03, поскольку оно практически не потребляет энергию. LiquidStack утверждает, что у её СЖО эффективность теплоотвода примерно в 16 раз выше, чем у типичных систем воздушного охлаждения. По мнению компании, системы высокопроизводительных вычислений (HPC) уже сейчас слишком энергоёмки, чтобы их можно было охлаждать воздухом. Поэтому следует использовать платы, специально предназначенные для жидкостного охлаждения, а не пытаться адаптировать те, что были созданы с расчётом на воздушные системы — при использовании СЖО вычислительная инфраструктура может занимать на 60% меньше места.

Изображение: Microsoft LiquidStack и Wiwynn являются партнёрами. В апреле Wiwynn инвестировала в LiquidStack $10 млн. Также Wiwynn протестировала серверы с погружным жидкостным охлаждением в центре обработки данных Microsoft Azure в Куинси (штат Вашингтон). Microsoft, как и другие гиперскейлеры, уже некоторое время изучает возможности иммерсионных СЖО.

06.10.2021 [13:07], Сергей Карасёв

«Яндекс», «ЛАНИТ», Gigabyte и ВТБ вложат 1 млрд руб. в российский завод по выпуску серверовВ России неподалёку от Рязани, на территории индустриального парка «Рязанский», началось строительство нового завода по производству серверов. Проект реализуется совместным предприятием, созданным «Яндексом», группой компаний «ЛАНИТ», разработчиком компьютерной техники Gigabyte и банком ВТБ. На заводе будет выпускаться оборудование под торговой маркой Openyard. В частности, планируется организовать производство серверов, систем хранения данных, шлюзов и компонентов умных устройств. Участники проекта на начальном этапе вложат в новую производственную площадку более миллиарда рублей. Пуско-наладочные работы намечены на третий квартал следующего года: их выполнят специалисты Gigabyte. Первый сервер со сборочных линий должен сойти до конца 2022-го. «Первая очередь будет включать производственные линии, лаборатории и тестовые зоны. Здесь будут выполняться все операции, начиная от поверхностного монтажа компонентов и заканчивая испытаниями готовой продукции», — говорится в сообщении.

Фото: Яндекс Производимые в Рязани серверы будут спроектированы на основе разработок и технологий «Яндекса». Отмечается, что выбор места для строительства завода продиктован хорошей транспортной доступностью, наличием необходимых коммуникаций и близостью учебных заведений, которые готовят профильных специалистов.

26.08.2021 [03:07], Алексей Степин

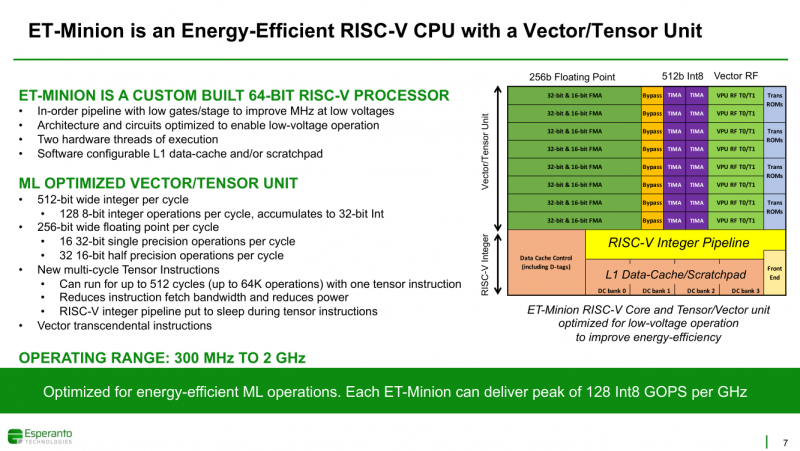

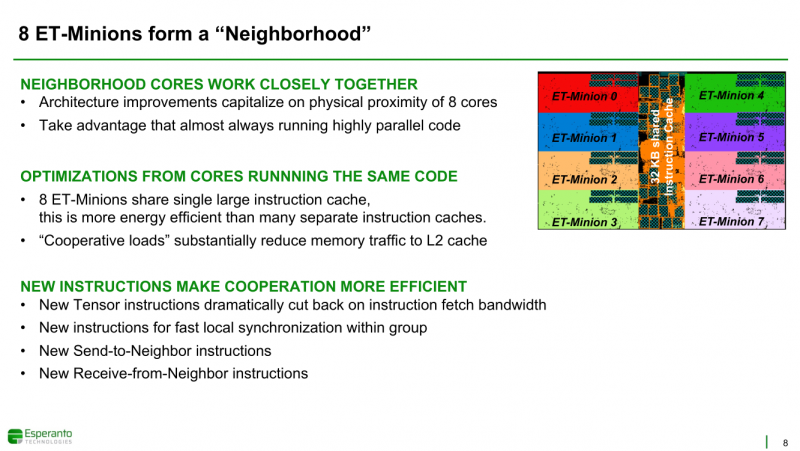

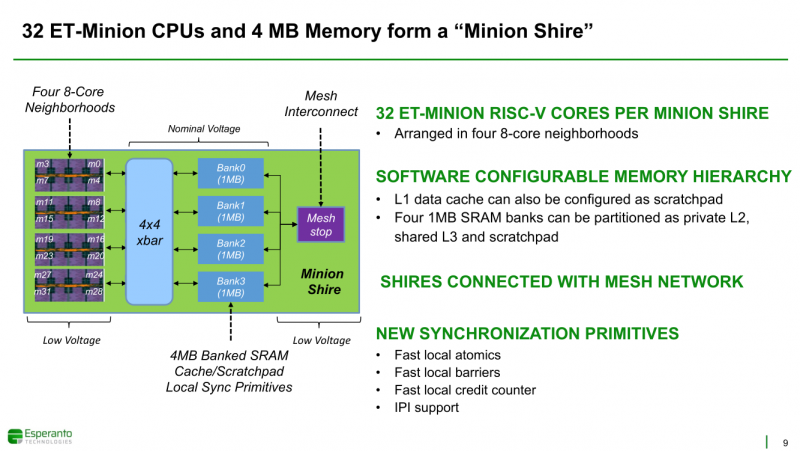

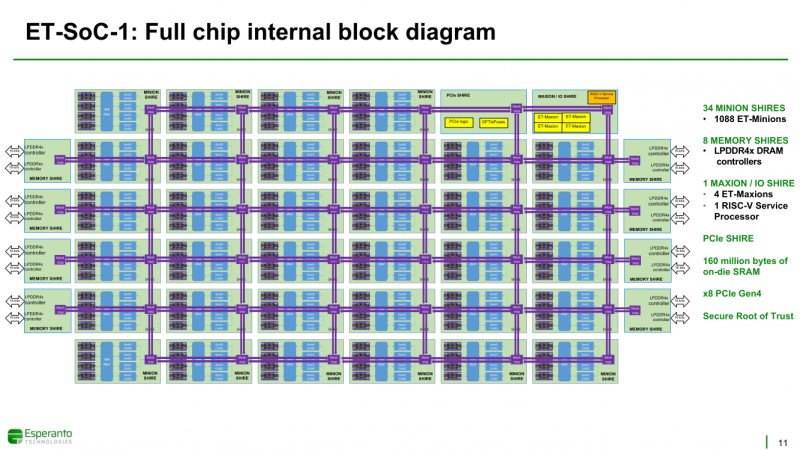

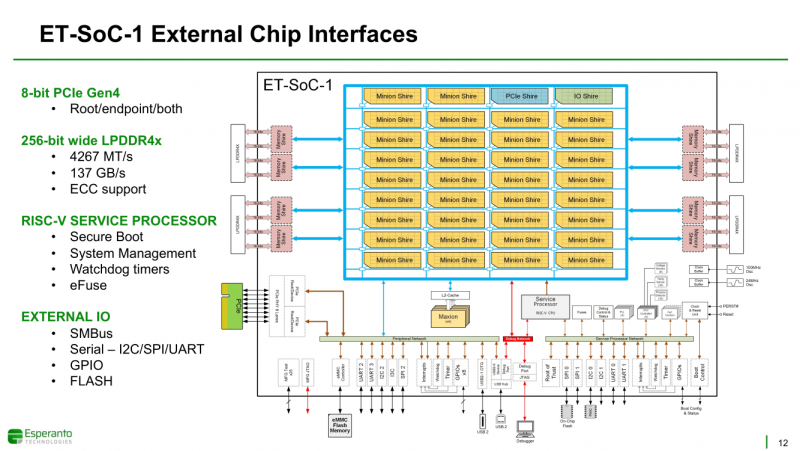

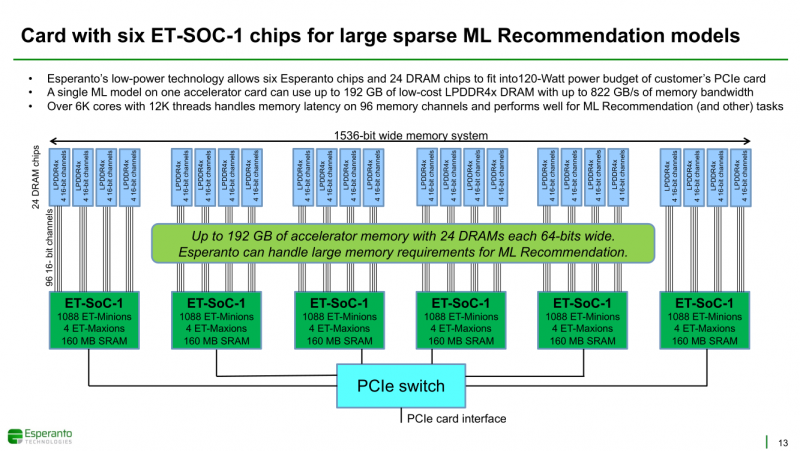

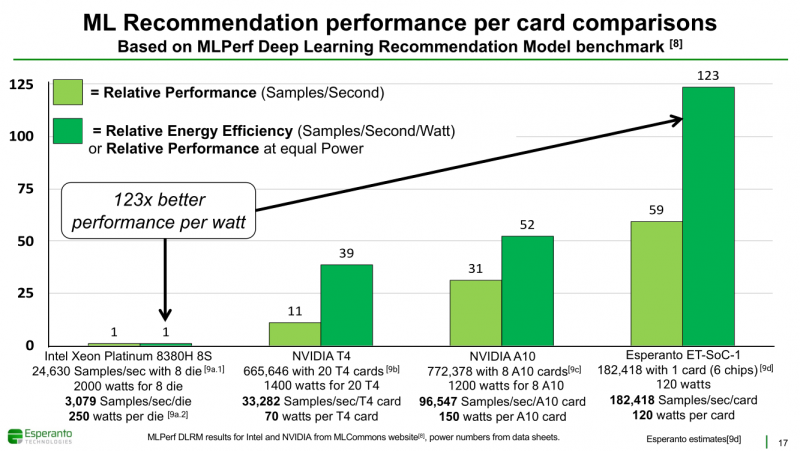

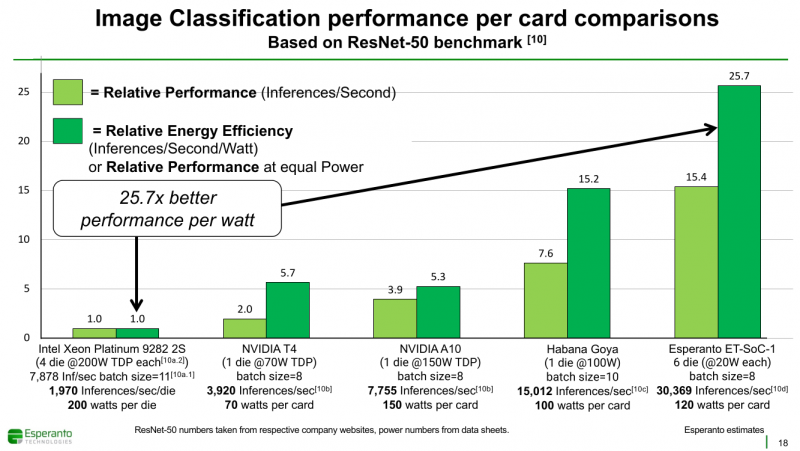

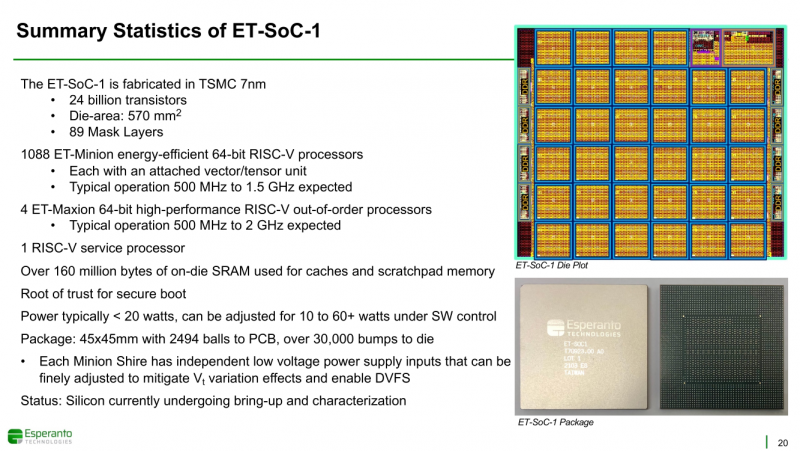

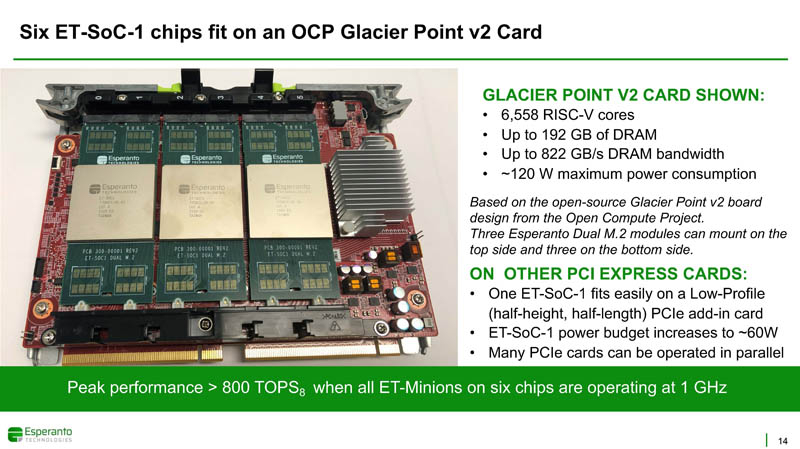

Получены первые образцы 1000-ядерного суперкомпьютера-на-чипе Esperanto ET-SoC-1Рекомендательные системы, активно используемые социальными сетями, рекламными платформами и т.д. имеют специфические особенности. От них требуется высокая скорость отклика, но вместе с тем их ИИ-модели весьма объёмны, порядка 100 Гбайт или более. А для их эффективной работы нужен ещё и довольно большой кеш. Для инференса чаще всего используется либо CPU (много памяти, но относительно низкая скорость) или GPU (высокая скорость, но мало памяти), но они не слишком эффективны для этой задачи. При этом существуют ещё и физические ограничения со стороны гиперскейлеров: в сервере не так много полноценных PCIe-слотов и свободного места + есть жёсткие ограничения по энергопотреблению и охлаждению (чаще всего воздушному). Всё это было учтено компанией Esperanto, чьей специализацией является разработка чипов на базе архитектуры RISC-V. На днях она получила первые образцы ИИ-ускорителя ET-SoC-1, который она сама называет суперкомпьютером-на-чипе (Supercomputer-on-Chip).  Новинка предназначена для инференса рекомендательных систем, в том числе на периферии, где на первый план выходит экономичность. Компания поставила для себя непростую задачу — весь комплекс ускорителей с памятью и служебной обвязкой должен потреблять не более 120 Вт. Для решения этой задачи пришлось применить немало ухищрений. Самое первое и очевидное — создание относительно небольшого, но универсального чипа, который можно было бы объединять с другими такими же чипами с линейным ростом производительности. Для достижения высокой степени параллелизма основой такого чипа должны стать небольшие, но энергоэффективные ядра. Именно поэтому выбор пал на 64-бит ядра RISC-V, поскольку они «просты» не только с точки зрения ISA, но и по транзисторному бюджету. Чип ET-SoC-1 сочетает в себе два типа ядер RISC-V: классических «больших» ядер (ET-Maxion) с внеочередным выполнением у него всего 4, зато «малых» ядер (ET-Minion) с поддержкой тензорных и векторных вычислений — целых 1088. На комплекс ядер ET-Maxion возлагаются задачи общего назначения и в ИИ-вычислениях он напрямую не участвует, зато позволяет быть ET-SoC-1 полностью автономным, так как прямо на нём можно запустить Linux. Помогает ему в этом ещё один служебный RISC-V процессор для периферии. А вот ядра ET-Minion довольно простые: внеочередного исполнения инструкций в них нет, зато есть поддержка SMT2 и целый набор новых инструкций для INT- и FP-операций с векторами и тензорами. За каждый такт ядро ET-Minion способно выполнять 128 INT8-операций с сохранением INT32-результата, 16 FP32-операций или 32 — FP16. «Длинные» тензорные операции могут непрерывно исполняться в течение 512 циклов (до 64 тыс. операций), при этом целочисленные блоки в это время отключаются для экономии питания. Система кешей устроена несколько непривычным образом. На ядро приходится 4 банка памяти, которые можно использовать как L1-кеш для данных и как быструю универсальную память (scratchpad). Восемь ядер ET-Minion формируют «квартал» вокруг общего для них кеша инструкций, так как на таких задачах велика вероятность того, что инструкции для всех ядер действительно будут одни и те же. Кроме того, это энергоэффективнее, чем восемь индивидуальных кешей, и позволяет получать и отправлять данные большими блоками, снижая нагрузку на L2-кеш. Восемь «кварталов» формируют «микрорайон» с коммутатором и четырьмя банками SRAM объёмом по 1 Мбайт, которые можно использовать как приватный L2-кеш, как часть общего L3-кеша или как scratchpad. Посредством mesh-сети «микрорайоны» общаются между собой и с другими блоками: ET-Maxion, восемь двухканальных контроллеров памяти, два root-комплекса PCIe 4.0 x8, аппаратный RoT. Суммарно на чип приходится порядка 160 Мбайт SRAM. Контроллеры оперативной памяти поддерживают модули LPDDR4x-4267 ECC (256 бит, до 137 Гбайт/с). Тактовая частота ET-Minion варьируется в пределах от 500 МГц до 1,5 ГГц, а ET-Maxion — от 500 МГц до 2 ГГц. В рамках OCP-блока Glacier Point V2 компания объединила на одной плате шесть ET-SoC-1 (всего 6558 ядер RISC-V), снабдив их 192 Гбайт памяти (822 Гбайт/с) — это больше, нежели у NVIDIA A100 (80 Гбайт). Такая связка развивает более 800 Топс, требуя всего 120 Вт. В среднем же она составляет 100 ‒ 200 Топс на один чип с потреблением менее 20 Вт. Это позволяет создать компактный M.2-модуль или же наоборот масштабировать систему далее. Шасси Yosemite v2 может вместить 64 чипа, а стойка — уже 384 чипа. В тесте MLPerf для рекомендательных систем производительность указанной выше связки из шести чипов в пересчёте на Ватт оказалась в 123 раза выше, чем у Intel Xeon Platinum 8380H (250 Вт), и в два-три раза выше, чем у NVIDIA A10 (150 Вт) и T4 (70 Вт). В «неудобном» для чипа тесте ResNet-50 разница с CPU и ускорителем Habana Goya уже не так велика, а вот с решениями NVIDIA, напротив, более заметна. При этом о поддержке со стороны ПО разработчики также подумали: чипы Esperanto могут работать с широко распространёнными фреймворками PyTorch, TensorFlow, MXNet и Caffe2, а также принимать готовые ONNX-модели. Есть и SDK для C++, а также драйверы для x86-хостов. Опытные образцы изготовлены на TSMC по 7-нм техпроцессу. Кристалл площадью 570 мм2 содержит 24 млрд транзисторов. Чип имеет упаковку BGA2494 размерами 45 × 45 мм2. Энергопотребление (а вместе с ним и производительность) настраивается в диапазоне от 10 до 60+ Ватт. Потенциальным заказчикам тестовые чипы станут доступны до конца года. Компания также готова адаптировать ET-SoC-1 под другие техпроцессы и фабрики, но демо на базе OCP-платформы и сравнение с Cooper Lake — это недвусмысленный намёк для Facebook✴, что Esperanto будет рада видеть её в числе первых клиентов.

23.11.2020 [23:34], Владимир Мироненко

Б/У серверы Facebook✴ и Microsoft будут отапливать теплицы с помидорами

ff

hardware

itrenew

microsoft

ocp

микро-цод

нидерланды

отопление

периферийные вычисления

сельское хозяйство

сжо

экология

Производитель OCP-систем ITRenew объединил усилия с голландским облачным хостинг-провайдером Blockheating, чтобы предложить контейнеризированные дата-центры «всё-в-одном», которые поставляют ненужное тепло в теплицы. Blockheating производит микро-ЦОД с жидкостным охлаждением, благодаря чему «мусорное» тепло может передаваться с водой (t°=65 °C) в близлежащие теплицы. В рамках партнёрства контейнеры будут укомплектованы стоечными серверами и системами хранения Sesame от ITRenew. Согласно совместному заявлению компаний, в Нидерландах имеется более 3700 га коммерческих теплиц. Один микро-ЦОД может обогревать два гектара теплиц летом и полгектара зимой. Этого, по словам Blockheating, достаточно для выращивания тонны помидоров в год. Что более важно, тепло, выделяемое в виде отходов ЦОД, обходится намного дешевле природного газа, сжигаемого фермерами для обогрева теплиц. Blockheating заявила о разработке «нового способа водяного охлаждения серверов», который делает его рентабельным. В 2019 году компания провела испытания тестового ЦОД мощностью 60 кВт в Венло, недалеко от границы с Германией (на фото выше). Сейчас решения Blockheating имеют мощность 200 уже кВт. Поскольку они охлаждаются жидкостью, это устраняет потребность в установке оборудования для кондиционирования воздуха и повышает энергоэффективность.

Blockheating В свою очередь системы ITRenew Sesame, устанавливаемые в микро-ЦОД, используют б/у-оборудование гиперскейлеров вроде Facebook✴ и Microsoft. Таким образом, снижается стоимость покупки и владения, почти на четверть сокращаются выбросы CO2 и объёмы электронного мусора, связанные с ИТ-индустрией.

20.05.2020 [00:10], Юрий Поздеев

Б/У серверы Facebook✴ и Microsoft обретут новый дом благодаря ITRenew SesameГиганты Google, Facebook✴ и Microsoft каждый год покупают огромное количество серверов, которые могут работать и до 10 лет. Однако через 2–3 года они заменяются на новые, более производительные модели, так как для гиперскейлеров это проще и быстрее, чем строить или расширять ЦОД. При объемах закупок от 100 тыс. серверов в год каждый квартал более 10 тыс. единиц оборудования выводится из эксплуатации. Утилизировать всю эту технику было бы слишком расточительно, ведь даже серверы возрастом 2–3 года из ЦОД гиперскейлеров мощнее многих серверов, которые используются на предприятиях сегодня. ITRenew предлагает разумный выход из ситуации. ITRenew подписала с гиперскейлерами контракты на выкуп старого оборудования. Впрочем, «старое» — не совсем подходящее слово, так как оно отработало в среднем от 2 до 5 лет. Компания помогает значительно снизить издержки, дав, с одной стороны, возможность гипескейлерам вернуть часть вложенных средств, а с другой — снизить затраты на 40-50% для небольших предприятий, которые оснащают свои дата-центры.

Стойки ITRenew Sesame Для многих компаний это единственная возможность купить оборудование такого класса, так как ODM вроде Wiwynn, Inspur, Quanta продают его только гиперскейлерам 1-го уровня (Amazon, Facebook✴, Google) и не собираются менять свою модель продаж, поскольку у них нет проблем со сбытом своей продукции. Еще один важный момент, на который обращают большое внимание в Европе и США, связан с экологией. То, что техника продолжает использоваться, а не уничтожается, позволяет экономить ресурсы и не загрязнять окружающую среду. Это особенно важно в свете того, что Китай закрыл ввоз подобного оборудования для утилизации и сортировки. И пока тенденция агрессивного обновления крупнейших дата-центров сохраняется, объем выведенной из эксплуатации техники будет расти. Может сложиться впечатление, что покупка б/у оборудования — это удел отсталых и бедных компаний, которые не хотят вкладывать деньги в развитие IT. Однако это далеко не так! Оборудованием от ITRenew комплектуются целые дата-центры, например, шведский ЦОД Hydro66. Все оборудование в ITRenew проходит обязательную процедуру обслуживания: компоненты с малым остаточным ресурсом заменяются новыми или снятыми с других единиц техники. Затем всё проверяется, настраивается и упаковывается для транспортировки новым владельцам. Несмотря на то, что оборудование из дата-центров гиперскейлеров выпущено разными производителями (Wiwynn, Quanta и другими), оно проходит процедуру стандартизации и настройки, после чего управлять и поддерживать его гораздо проще, чем «зоопарком» обычного серверного оборудования разных брендов. Кроме того, многие компоненты таких систем открыты — они будут иметь полноценную поддержку долгие годы. Одна из причин, почему продажа б/у-оборудования от гиперскейлеров до сих по не стала действительно массовым явления, в том, что оно имеет OCP-исполнение, отличное от принятых в корпоративном мире стандартов. Это касается и шасси, и прошивок, и ПО. Именно поэтому ITrenew создала серию платформ, готовых принятть OCP-оборудование, со всем необходимым ПО для оркестрации Kubernetes. Sesame позволит объединить до 20 стоек (более 750 узлов) в один кластер с 25GbE-подключение. Слоган нового решения: «Сила гиперскейлеров для всех». Звучит довольно громко, однако так оно и есть. Теперь даже мелкие компании могут приобрести производительное оборудование, которое не стоит огромных денег. А для «самых маленьких» компания предлагает Sesame Fast Start, мини-стойку на колёсиках со всем необходимым. Fast-Start помещается под столом — она рассчитана на 5 узлов суммарной мощностью до 1600 Вт и имеет 10GbE-коммутатор. |

|