Материалы по тегу: hardware

|

30.10.2025 [16:25], Руслан Авдеев

В России намерены построить 15 электростанций совокупной мощностью 3,2 ГВт15 электростанций совокупной мощностью 3,2 ГВт намерены построить в Российской Федерации. Объекты возведут на юге страны, в Москве и Подмосковье, сообщает «Коммерсантъ». По данным издания, планы строительства новой энергетической инфраструктуры раскрыты в сообщении правительства, посвящённого итогам совещания о вопросах развития электроэнергетики. Заявляется, что новые электростанции призваны обеспечить «растущие потребности данных субъектов в электроэнергии». Особое внимание участники мероприятия посвятили состоянию энергетической системы Сибири. Сообщается, что для удовлетворения спроса на электроэнергию в регионе в будущем планируется построить энергомост постоянного тока (HVDC). Пропускная способность проекта составит до 1,5 ГВт, предусмотрено и создание новых генерирующих мощностей более чем на 1 ГВт.

Источник изображения: Etienne Girardet/unsplash.com Тема дефицита электроснабжения ЦОД стала актуальной на территории Российской Федерации. Так, в середине октября президент РФ призвал ориентировать «объекты локальной генерации» на снабжение электричеством местных дата-центров, в числе прочего речь шла об использовании угольных электростанций.

30.10.2025 [16:18], Руслан Авдеев

Полмиллиона ускорителей Trainium2: AWS развернула для Anthropic один из крупнейших в мире ИИ-кластеров Project RainierAWS объявила о запуске одного из крупнейших в мире ИИ-кластеров Project Rainier. Фактически амбициозный проект представляет собой распределённый между несколькими ЦОД ИИ-суперкомпьютер — это важная веха в стремлении AWS к развитию ИИ-инфраструктуры, сообщает пресс-служба Amazon. Платформа создавалась под нужды Anthropic, которая буквально на днях подписала многомиллиардный контракт на использование Google TPU. В рамках Project Rainier компания AWS сотрудничала со стартапом Anthropic. В проекте задействовано около 500 тыс. чипов Trainium2, а вычислительная мощность в пять раз выше той, что Anthropic использовала для обучения предыдущих ИИ-моделей. Project Rainier применяется Anthropic для создания и внедрения моделей семейства Claude. К концу 2025 года предполагается использование более миллиона чипов Trainium2 для обучения и инференса. В рамках Project Rainier в AWS уже создали инфраструктуру на основе Tranium2, на 70 % превосходящую любую другую вычислительную ИИ-платформу в истории AWS. Проект охватывает несколько дата-центров в США и не имеет аналогов среди инициатив AWS. Он задуман как гигантский кластер EC2 UltraCluster из серверов Trainium2 UltraServer. UltraServer объединяет четыре физических сервера, каждый из которых имеет 16 чипов Trainium2. Они взаимодействуют через фирменный интерконнект NeuronLink, обеспечивающий быстрые соединения внутри системы, что значительно ускоряет вычисления на всех 64 чипах. Десятки тысяч UltraServer объединяются в UltraCluster посредством фабрики EFA. Эксплуатация такого ЦОД требует повышенной надёжности. В отличие от большинства облачных провайдеров, AWS создаёт собственное оборудование и может контролировать каждый компонент, от чипов до систем охлаждения и архитектуру дата-центров в целом. Управляющие ЦОД команды уделяют повышенное внимание энергоэффективности, от компоновки стоек до распределения энергии и выбора методов охлаждения. Кроме того, в 2023 году вся энергия, потребляемая Amazon, полностью компенсировалась электричеством из возобновляемых источников. В Amazon утверждают, что в последние пять лет компания является крупнейшим покупателем возобновляемой энергии и стремится к достижению нулевых выбросов к 2040 году.

Источник изображения: AWS Миллиарды долларов инвестируются в ядерную энергетику и АКБ, а также крупные проекты в области возобновляемой энергетики для ЦОД. В 2024 году компания объявила о внедрении новых компонентов для ЦОД, сочетающих технологии электропитания, охлаждения и аппаратного обеспечения, причём не только для строящихся, но и уже для имеющихся объектов. Новые компоненты, предположительно, позволят снизить энергопотребление некоторых компонентов до -46 % и сократить углеродный след используемого бетона на 35 %.

Источник изображения: AWS Для новых объектов, строящихся в рамках Project Rainier и за его пределами, предусмотрено использование целого ряда новых технологий для повышения энергоэффективности и экоустойчивости. Некоторые технологии связаны с рациональным использованием водных ресурсов. AWS проектирует объекты так, чтобы использовать минимум воды, или вовсе не использовать её. Один из способов — отказ от её применения в системах охлаждения на многих объектах большую часть года, с переходом на охлаждение наружным воздухом.

Источник изображения: AWS Так, один из объектов Project Rainier в Индиане будет максимально использовать именно уличный воздух, а с октября по март дата-центры вовсе не станут использовать воду для охлаждения, с апреля по сентябрь в среднем вода будет применяться по несколько часов в день. Согласно отчёту Национальной лаборатории им. Лоуренса в Беркли (LBNL), стандартный показатель WUE для ЦОД 0,375 л/кВт·ч. В AWS этот показатель равен 0,15 л/кВт·ч, что на 40 % лучше, чем в 2021 году.

30.10.2025 [13:51], Владимир Мироненко

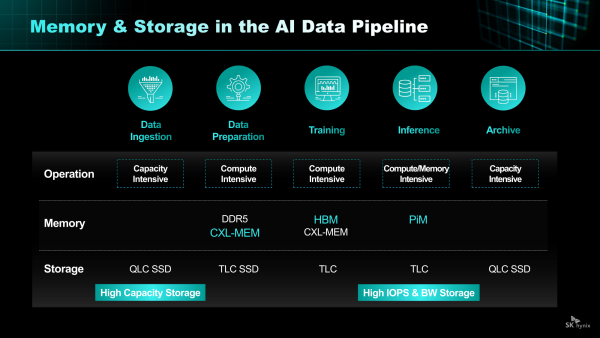

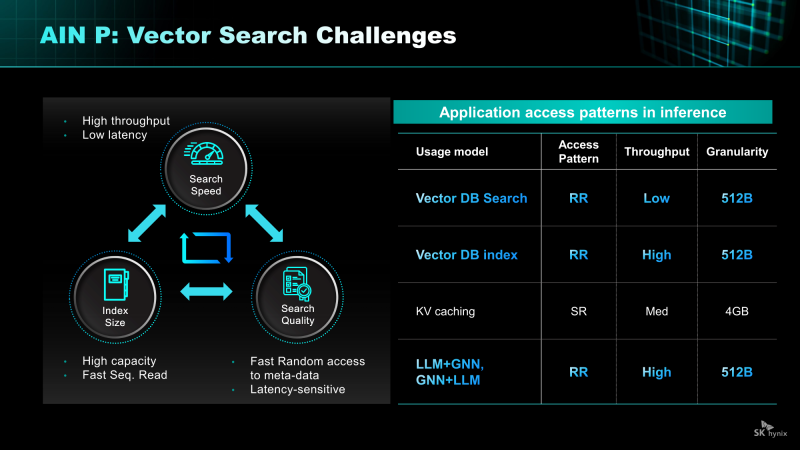

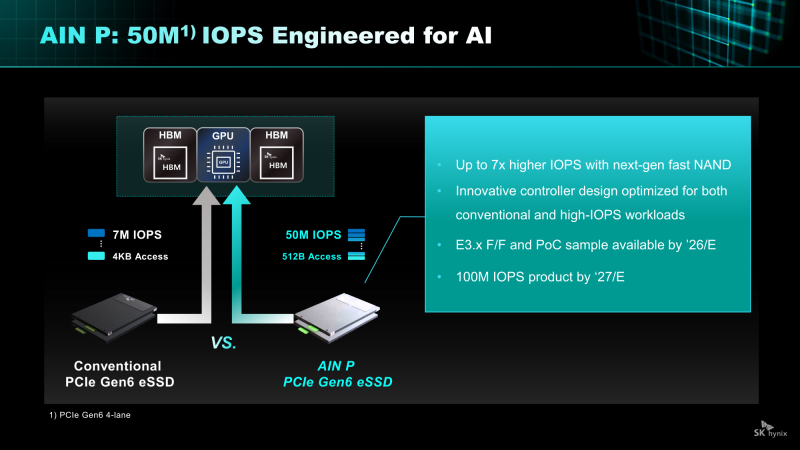

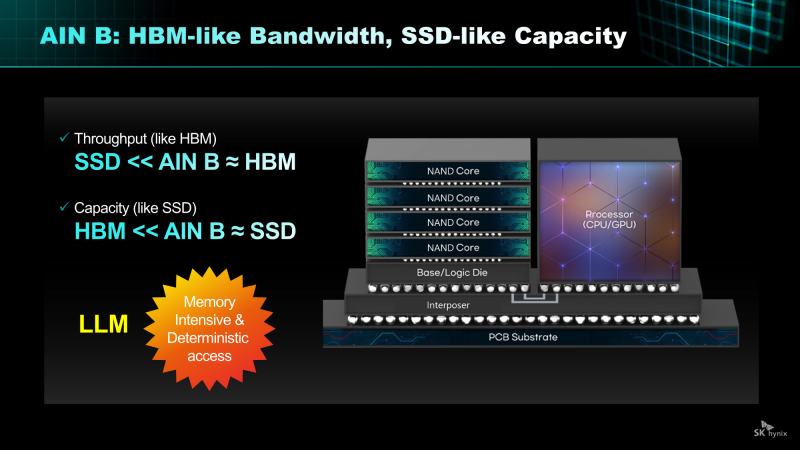

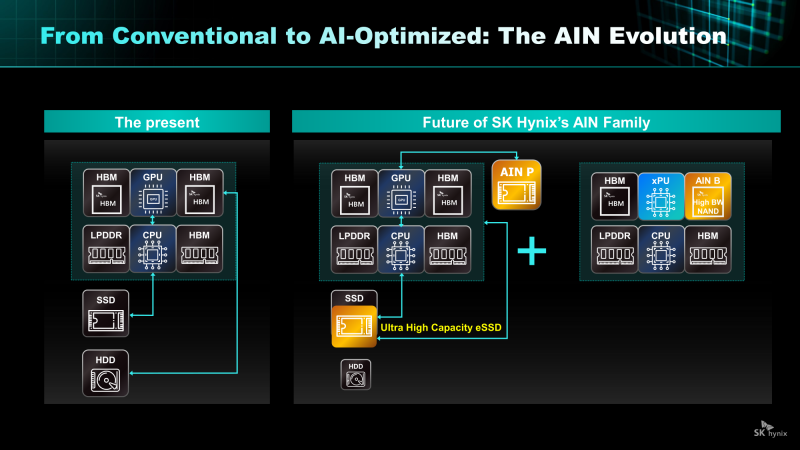

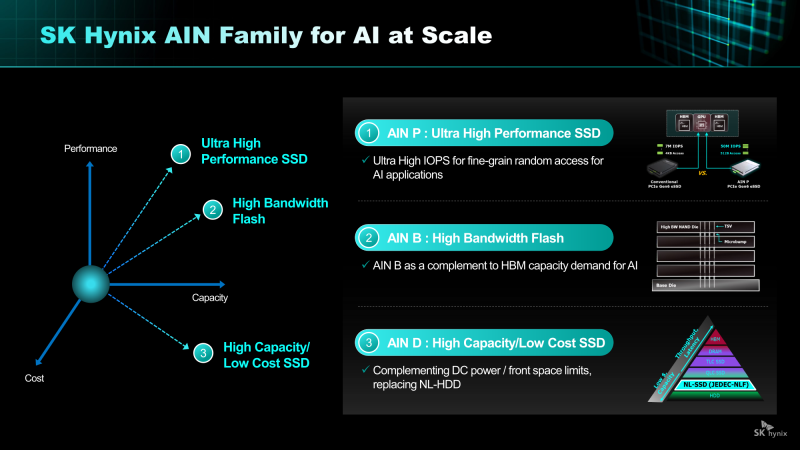

От Nearline SSD до HBF: SK hynix анонсировала NAND-решения AIN для ИИ-платформКомпания SK hynix представила стратегию развития решений хранения на базе NAND нового поколения. SK hynix заявила, что в связи с быстрым ростом рынка ИИ-инференса спрос на хранилища на базе NAND, способных быстро и эффективно обрабатывать большие объёмы данных, стремительно растёт. Для удовлетворения этого спроса компания разрабатывает серию решений AIN (AI-NAND), оптимизированных для ИИ. Семейство будет включать решения AIN P, AIN B и AIN D, оптимизированные по производительности, пропускной способности и плотности соответственно. AIN P (Performance) — это решение для эффективной обработки больших объёмов данных, генерируемых в рамках масштабных рабочих нагрузок ИИ-инференса. Продукт значительно повышает скорость обработки и энергоэффективность, минимизируя узкие места между хранилищем и ИИ-операциями. SK hynix разрабатывает NAND-память и контроллеры с новыми возможностями и планирует выпустить образцы к концу 2026 года. Как пишет Blocks & Files, накопитель AIN P, как ожидается, получит поддержку PCIe 6.0 и обеспечит 50 млн IOPS на 512-байт блоках, тогда как сейчас производительность случайного чтения и записи с 4-Кбайт блоками составляет порядка 7 млн IOPS у накопителей PCIe 6.0. То есть AIN P будет в семь раз быстрее, чем нынешние корпоративные PCIe 6.0 SSD, и, по заявлению SK hynix, достичь 100 млн IOPS можно будет уже в 2027 году. Такой SSD будет выполнен в форм-факторе EDSFF E3.x и оснащён контроллером, предназначенным для выполнения как обычных рабочих нагрузок, так и с высоким показателем IOPS. AIN D (Density) — это высокоплотное решение Nearline (NL) SSD для хранения больших объёмов данных с низкими энергопотреблением и стоимостью, подходящее для хранения ИИ-данных. Компания стремится увеличить плотность QLC SSD с Тбайт до Пбайт, создав решение среднего уровня, сочетающее в себе скорость SSD и экономичность HDD. AIN D от SK hynix как раз предназначен для замены жёстких дисков. Компания также упоминает некий стандарт JEDEC-NLF (Near Line Flash?), который пока не существует. При этом SK hynix пока не упоминает PLC NAND и не приводит данные о ёмкости AIN D. AIN B (Bandwidth) — это HBF-память с увеличенной за счёт вертикального размещения нескольких модулей NAND пропускной способностью. Ключевым в данном случае является сочетание структуры стекирования HBM с высокой плотностью и экономичностью флеш-памяти NAND. AIN B предложит большую ёмкость, чем HBM, примерно на уровне ёмкости SSD. AIN B может увеличить эффективную ёмкость памяти GPU и, таким образом, устранить необходимость покупки/аренды дополнительных GPU для увеличения ёмкости HBM, например, для хранения содержимого KV-кеша. Компания рассматривает различные стратегии развития AIN B, например, совместное использование с HBM для повышения общей ёмкости системы, поскольку стек HBF может быть совмещён со стеком HBM на одном интерпозере. SK hynix и Sandisk работают над продвижением стандарта HBF. Они провели в рамках 2025 OCP Global Summit мероприятие HBF Night, посвящённое этому вопросу. Рании компании подписали меморандум о стандартизации HBF в целях расширения технологической экосистемы. «Благодаря OCP Global Summit и HBF Night мы смогли продемонстрировать настоящее и будущее SK hynix как глобального поставщика решений памяти, процветающего на быстро развивающемся ИИ-рынке», — заявила SK hynix, добавив, что на рынке устройств хранения данных на базе NAND следующего поколения SK hynix будет тесно сотрудничать с клиентами и партнёрами, чтобы стать ключевым игроком.

30.10.2025 [12:20], Сергей Карасёв

ASUS представила ИИ-сервер XA NB3I-E12 на базе NVIDIA HGX B300Компания ASUS анонсировала сервер XA NB3I-E12 на аппаратной платформе NVIDIA HGX B300, предназначенный для интенсивных нагрузок ИИ. В качестве потенциальных заказчиков системы названы предприятия, которые работают с большими языковыми моделями (LLM) и НРС-приложениями: это могут быть научно-исследовательские структуры и финансовые организации, компании автомобильного сектора и пр. Сервер выполнен в форм-факторе 9U. Возможна установка двух процессоров Intel Xeon 6700P поколения Granite Rapids с показателем TDP до 350 Вт. Доступны 32 слота для модулей оперативной памяти DDR5-6400 RDIMM / 3DS RDIMM. Во фронтальной части расположены 10 посадочных мест на SFF-накопителей (NVMe). Предусмотрены четыре слота расширения PCIe 5.0 х16 и один слот PCIe 5.0 х8. Система имеет архитектуру 8-GPU (NVIDIA HGX B300 288GB 8-GPU). Задействованы сетевые адаптеры NVIDIA ConnectX-8 и DPU NVIDIA BlueField-3. Реализованы два сетевых порта 10GbE с разъёмами RJ45 на основе контроллера Intel X710-AT2 и выделенный сетевой порт управления (RJ45). Питание обеспечивают 10 блоков мощностью 3200 Вт с сертификатом 80 PLUS Titanium. Применяется воздушное охлаждение; диапазон рабочих температур — от +10 до +35 °C. ASUS отмечает, что сервер имеет модульную конструкцию, благодаря чему минимизируется использование кабелей, упрощается обслуживание и повышается ремонтопригодность. Габариты устройства составляют 945 × 447 × 394,5 мм, масса — примерно 120 кг без установленных накопителей.

30.10.2025 [11:55], Сергей Карасёв

Компактное хранилище QNAP NASbook TBS-h574TX рассчитано на накопители E1.S SSDКомпания QNAP Systems анонсировала сетевое хранилище NASbook TBS-h574TX в компактном «настольном» форм-факторе, ориентированное на профессиональных пользователей, которые занимаются видеомонтажом, созданием визуальных эффектов и анимации. Устройство выполнено на аппаратной платформе Intel Alder Lake. Применён процессор Core i5-1235U с десятью ядрами (2P+8E), функционирующими на тактовой частоте до 4,4 ГГц. В состав чипа входит графический ускоритель Intel Iris Xe. Объём оперативной памяти составляет 16 Гбайт (без возможности расширения), интегрированной флеш-памяти — 5 Гбайт. Кроме того, доступны модификации с 12-ядерным чипом Core i5-1340PE (4P+8E) с тактовой частотой до 4,5 ГГц и 8-ядерным процессором Core i3-1320PE (4P+4E) с такой же максимальной частотой. Объём ОЗУ у этих версий составляет соответственно 16 и 12 Гбайт. Новинка располагает пятью отсеками для накопителей. Могут устанавливаться SSD типоразмера E1.S толщиной до 15 мм с интерфейсом PCIe 3.0 x2 или M.2 2280 (NVMe) с радиатором охлаждения толщиной до 4,5 мм. Покупателям, в частности, предлагаются варианты с пятью предустановленными SSD стандарта E1.S вместимостью 1,92 или 3,84 Тбайт каждый с суммарной ёмкостью соответственно 9,6 и 19,2 Тбайт. Хранилище оснащено сетевыми портами 2.5GbE и 10GbE, интерфейсом HDMI 1.4b, разъёмом USB 2.0, двумя портами USB 3.2 Gen2, а также двумя портами Thunderbolt 4, которые можно использовать для прямого подключения к рабочим станциям под управлением Windows и macOS. Для охлаждения применяются два вентилятора диаметром 40 мм. Диапазон рабочих температур — от 0 до +40 °C. Габариты составляют 60 × 215 × 199 мм, масса — 2,24 кг (без установленных накопителей). Питание устройство получает от сетевого адаптера мощностью 120 Вт; заявленное типовое энергопотребление — 46 Вт. Производитель предоставляет трёхлетнюю гарантию.

29.10.2025 [18:08], Руслан Авдеев

NVIDIA и General Atomics создали виртуальный терморядерный реактор с помощью ИИ

general atomics

hardware

omniverse

ии

разработка

сша

термоядерная энергия

цифровой двойник

энергетика

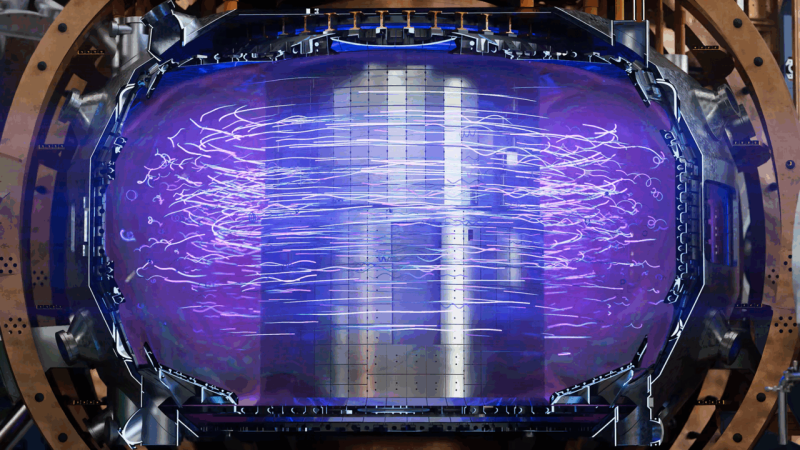

NVIDIA совместно с General Atomics и группой других партнёров создали цифровой двойник термоядерного реактора с использованием ИИ-технологий. В проекте приняли участие Суперкомпьютерный центр Сан-Диего (SDSC), вычислительный центр ALCF при Аргоннской национальной лаборатории (ANL) и вычислительный центр при Национальной лаборатории им. Лоуренса в Беркли (LBNL), сообщает пресс-служба NVIDIA. Проект построен на платформе NVIDIA Omniverse с использованием CUDA-X. Суперкомпьютеры Polaris в ALCF и Perlmutter в NERSC использовались для обучения трёх «суррогатных» ИИ-моделей, призванных имитировать работу более сложных систем. Проект призван помочь учёным создать работающие в земных условиях коммерческие термоядерные технологии. В General Atomics уверены, что возможность виртуальных исследований с помощью цифровых двойников — настоящий прорыв в термоядерной энергетике, а взаимодействие с NVIDIA позволяет тестировать, совершенствовать и проверять идеи на порядок быстрее, чем обычно. Это ускорит путь к коммерческой термоядерной энергетике. В термоядерных реакторах используется плазма, разогретая до миллионов градусов, поэтому прогнозирование её поведения достаточно быстро для поддержания работы реакторов — сложнейшая задача. ИИ позволяет радикально сократить время моделирования процессов внутри реактора, что даёт возможность виртуально «взаимодействовать», изучая различные сценарии работы без риска повреждения самого реактора. Если в норме на моделирование поведения плазмы уходят недели даже на быстрейших суперкомпьютерах, то суррогатные ИИ-модели, обученные на десятилетиях реальных данных, считают всё за секунды и продолжают совершенствоваться. Модели, включая EFIT (для равновесия плазмы), CAKE (для границы плазмы) и ION ORB (для плотности теплового потока от испускаемых ионов), способны помочь операторам поддерживать стабильность плазмы в реальном времени, снижая риск повреждения и ускоряя исследования. Сейчас NVIDIA и General Atomics создают полностью интерактивного цифрового двойника токамака DIII-D в среде Omniverse на базе серверов RTX PRO и DGX Spark. Виртуальный реактор объединяет данные датчиков, данные физического моделирования, инженерные модели и «суррогатные» ИИ-модели, создавая единую интерактивную среду в реальном времени, которая позволяет быстро принимать решения. Двойник синхронизирован с физическим реактором DIII-D, что позволяет международной команде из 700 ученых, представляющих 100 организаций, проверять идеи и запускать различные сценарии без применения реального оборудования. Ключевые элементы управления можно изучить с помощью цифрового двойника. Это позволяет лучше подготовиться к реальным экспериментам. Термоядерные технологии чрезвычайно востребованы на рынке. В январе разработчик термоядерных реакторов Helion, имеющий долгосрочный договор с Microsoft, привлёк $425 млн. В мае сообщалось, что Microsoft надеется, что ИИ ускорит создание термоядерных реакторов, которые смогут запитать ещё больше ИИ ЦОД. В июне появилась информация, что Google вложилась в разработчика термоядерных реакторов TAE Technologies.

29.10.2025 [16:01], Сергей Карасёв

NVIDIA представила проект Omniverse DSX для ускоренного создания ИИ-фабрик гигаваттного масштабаNVIDIA анонсировала Omniverse DSX Blueprint — референсный проект, ориентированный на создание дата-центров гигаваттного масштаба для обучения и запуска наиболее крупных моделей ИИ. По общей мощности такие объекты будут сопоставимы с ядерными реакторами. Проект предполагает создание цифровых двойников в Omniverse с использованием реальных инженерных данных. Благодаря этому формируется единая среда, в которой партнёры могут планировать, прорабатывать и оптимизировать каждый аспект масштабного дата-центра для ресурсоёмких задач ИИ — от систем электропитания и охлаждения до вычислительных и сетевых компонентов. На практике Omniverse DSX Blueprint выступает в качестве эталонной архитектуры и программного уровня управления для ЦОД, мощность которых может варьироваться от 100 МВт до нескольких ГВт. Решение протестировано в исследовательском центре NVIDIA AI Factory на площадке Digital Realty в Манассасе (Manassas) в Вирджинии (США). Проект лежит в основе реальных дата-центров, включая площадку Switch мощностью 2 ГВт в Джорджии и площадку Stargate мощностью 1,2 ГВт в Абилине (Техас). Одним из ключевых элементов Omniverse DSX Blueprint является DSX Flex — это внешняя система, связывающая ЦОД с региональными электросетями и источниками возобновляемой энергии для задействования около 100 ГВт недоиспользуемой мощности сети путём динамической балансировки спроса и предложения. Ещё один компонент — DSX Boost: данная система регулирует управление питанием и распределение рабочей нагрузки в дата-центре, что позволяет добиться либо снижения энергопотребления примерно на 30 %, либо повышения пропускной способности GPU до 30 % при том же уровне энергопотребления. Третий элемент — DSX Exchange — выступает в качестве защищённой инфраструктурной среды передачи данных и управления. Референсный проект Omniverse DSX Blueprint призван помочь компаниям создавать масштабные ИИ-фабрики с нуля, используя оборудование NVIDIA и её партнёров. При этом гарантируется совместимость вычислительных и сетевых компонентов, а также инженерного оборудования. После виртуального проектирования объекта партнёры NVIDIA, такие как Bechtel и Vertiv, поставляют готовые к подключению модули, протестированные на заводе. Это значительно сокращает время сборки и обеспечивает масштабируемость, помогая быстрее достичь окупаемости. Архитектура проекта подразумевает, что после запуска физической ИИ-фабрики её цифровой двойник можно будет использовать в качестве операционной среды для мониторинга, проверки и дальнейшей оптимизации процессов.

29.10.2025 [15:27], Руслан Авдеев

Нет энергии и кадров: OpenAI призвала Трампа вводить по 100 ГВт мощностей в год, а иначе Китай выиграет гонку в сфере ИИВ OpenAI хотят, чтобы администрация президента США Дональда Трампа (Donald Trump) каждый год строила дополнительные генерирующие мощности на 100 ГВт. Это необходимо, чтобы не допустить отставания Соединённых Штатов от Китая в сфере ИИ-технологий, сообщает The Register. В компании утверждают, что электроэнергия стала «стратегическим активом», критически важным для создания ИИ-инфраструктуры. Последняя должна обеспечить лидерство США в сфере, самой значимой «со времён появления электричества». Пока, как сообщает издание, Китай опережает США по темпам строительства новых мощностей — только в 2024 году страна добавила 429 ГВт в сравнении с 51 ГВт в США. В OpenAI подчёркивают, что лидерство Китая в наращивании мощностей ставит под угрозу положение Соединённых Штатов. В OpenAI утверждают, что администрация Трампа должна привлечь частный сектор для строительства 100 ГВт новых энергетических мощностей ежегодно. Компания сообщает о партнёрстве с коммунальными компаниями Висконсина для наращивания мощности недавно анонсированного нового кампуса ЦОД Stargate. Утверждается, что компания будет возвращать часть электроэнергии в сеть или потреблять меньше электричества, чтобы защитить потребителей от роста цен, связанных с дефицитом. Впрочем, многие штаты уже столкнулись с ростом счетов из-за ИИ ЦОД.

Источник изображения: Isis França/unsplash.com Дополнительно OpenAI прогнозирует дефицит кадров, считая, что в следующие пять лет США понадобится на 20 % больше квалифицированных рабочих для обслуживания новых дата-центров и энергетических мощностей. В компании предполагают, что США справится с этой проблемой благодаря опыту «мыслить, действовать и строить масштабно». Предполагается, что США смогут сохранить лидерство в сфере ИИ. Стоит отметить, что недавно Google подписала соглашение с NextEra Energy о перезапуске АЭС Duane Arnold Energy Center (DAEC) к 2029 году, после чего Google станет доступно 615 МВт в течение 25 лет. Рядом Google планирует построить до шести ЦОД. Microsoft и Constellation Energy заключили похожий договор, предусматривающий возобновление работы АЭС Three Mile Island для снабжения электричеством ЦОД Microsoft. Поставки начнутся даже раньше, чем планировалось. Meta✴ получит всю энергию действующей АЭС Clinton Clean Energy Center (CCEC) с 2027 года, а AWS просто стала соседом действующей АЭС.

29.10.2025 [14:30], Руслан Авдеев

IXcellerate запустила в Москве ЦОД MOS3 на 2,4 тыс. стойко-мест, которые уже распроданыIXcellerate сообщила о вводе в эксплуатацию недавно построенного дата-центра MOS3, общая ёмкость которого составляет 2,4 тыс. стойко-мест, а мощность — 30 МВт. Это четвёртый и последний ЦОД в границах Северного кампуса в московском районе Алтуфьево. Объект полностью готов к эксплуатации. Уже работают 1,4 тыс. стойко-мест, ещё 1 тыс. законтрактована, они начнут функционировать к январю 2026 года. Все стойки зарезервировали ещё на этапе строительства имеющиеся и новые клиенты компании. Утверждается, что MOS3 спроектирован в соответствии с требованиями стандартов Tier III и PCI DSS. Энергоснабжение объекта обеспечивается через десять городских вводов по 10 кВ. Средняя проектная нагрузка на стойку — 8 кВт, возможно увеличение до 25 кВт. Схема резервирования — 2N на уровне стойки и 8/7 N на уровне ДГУ и ИБП, это позволит продолжать работу даже в неблагоприятных обстоятельствах, клиентам гарантируют доступ на уровне 99,982 %.

Источник изображения: IXcellerate Построенный с нуля (greenfield) объект находится в четырёхэтажном здании, общая площадь составляет 7,367 тыс. м2, площадь участка 3 га. Здание для шести машинных залов построено на месте бывшего кирпичного завода в соответствии со строительными нормами Москвы (МГСН), прежние строения полностью снесены. Строительные материалы для дата-центра выпускались на территории России, экобезопасны, соответствуют ГОСТ, защищают от огня и неблагоприятной погоды, 150-мм фасадные панели имеют предел огнестойкости 150 минут. ЦОД защищён от несанкционированного проникновения (до 6 уровней физической безопасности). При строительстве ЦОД использовали передовые технологии обеспечения пожарной и физической безопасности, стабильного охлаждения в машинных залах по схеме «чиллер–фанкойл» — объект круглогодично работает в режиме свободного охлаждения. Дополнительно применяются 12 прецизионных кондиционеров с драйкулерами и конденсаторами с водяным охлаждением, позволяющими отапливать административные помещения, снижая общие затраты. Среднегодовой коэффициент PUE составляет менее 1,3 при полной нагрузке.

Источник изображения: IXcellerate Дата-центр MOS3 включён в единую экосистему IXcellerate, его клиенты имеют возможность получать облачные или телеком-услуги любого из 50 партнёров компании, а также подключаться к пиринговым платформам Eurasia Peering и MSK-IX. На сегодняшний день экосистема IXcellerate насчитывает пять действующих ЦОД. Всего в Северном и Южном кампусах на конец 2025 года будет насчитываться 10 329 стойко-мест. Благодаря этому IXcellerate может считаться вторым по ёмкости оператором коммерческих дата-центров в России. В сентябре сообщалось, что рынок коммерческих дата-центров в России показал антирекорд по приросту стойко-мест в I половине 2025 года по данным iKS-Consulting.

28.10.2025 [22:35], Владимир Мироненко

Министерство энергетики США получит два суперкомпьютера на чипах AMD общей стоимостью $1 млрд: Discovery и Lux AI

amd

epyc

hardware

hpc

hpe

mi350

mi400

oracle

oracle cloud infrastructure

ornl

venice

ии

облако

суперкомпьютер

сша

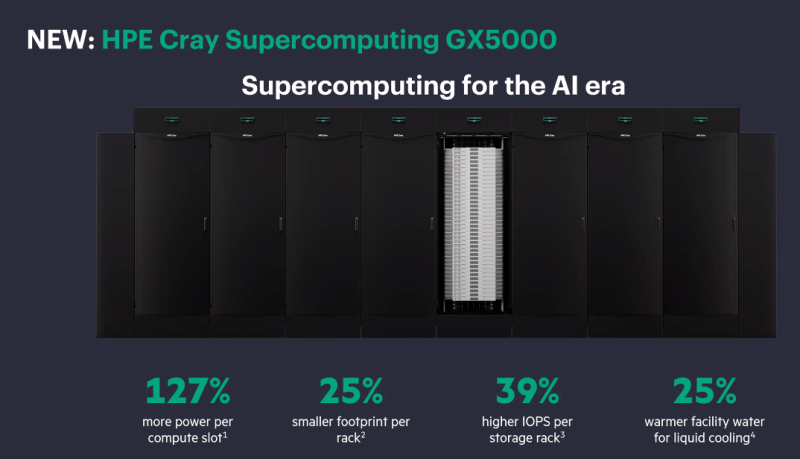

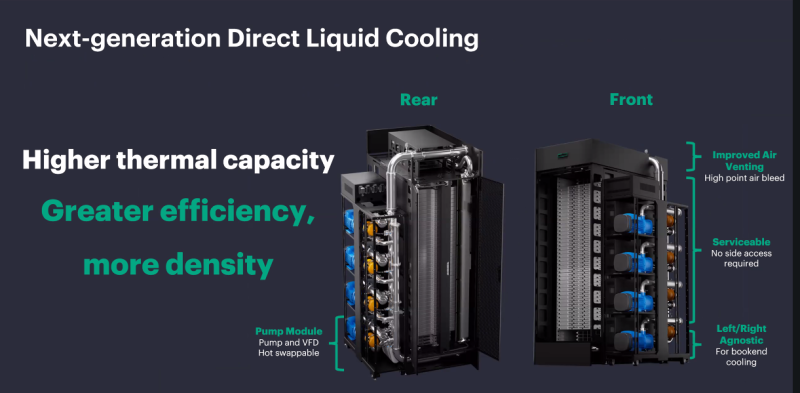

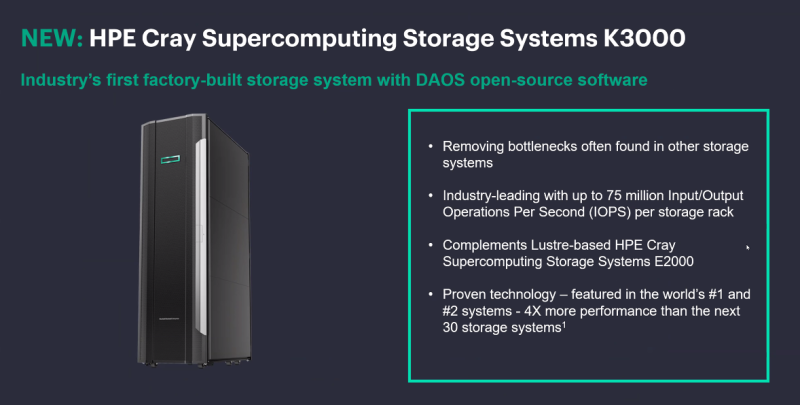

Министерство энергетики США (DOE) заключило с AMD контракт стоимостью $1 млрд с целью строительства двух суперкомпьютеров HPE для решения масштабных научных задач в области ядерной энергетики, здравоохранения и национальной безопасности. Министр энергетики Крис Райт (Chris Wright) сообщил агентству Reuters, что создание HPC-систем даст мощный импульс развитию ядерной и термоядерной энергетики, оборонных технологий и национальной безопасности, а также разработке лекарственных препаратов. Учёные и компании пытаются воспроизвести термоядерный синтез, который, в том числе, подпитывает солнечную энергию. «Мы добились значительного прогресса, но плазма нестабильна, и нам необходимо воссоздать центр Солнца на Земле», — заявил Райт. Он выразил уверенность, что ИИ-системы позволят открыть практические пути для использования энергии термоядерного синтеза в ближайшие два-три года, а также помогут управлять ядерным арсеналом США и ускорить разработку лекарств, моделируя способы лечения рака вплоть до молекулярного уровня. «Я надеюсь, что в ближайшие пять-восемь лет мы превратим большинство видов рака, многие из которых сегодня являются смертным приговором, в контролируемые состояния», — сказал Райт. Первым планируется запустить в эксплуатацию в течение следующих шести месяцев суперкомпьютер Lux с облачным доступом. Он будет основан на узлах HPE ProLiant Compute XD685 с СЖО, которые объединяют ИИ-ускорителях Instinct MI355X, CPU AMD EPYC, а также DPU Pensando. Система разработана AMD совместно с HPE, Oracle (OCI) и Ок-Риджской национальной лабораторией (ORNL). Глава AMD Лизу Су (Lisa Su) сообщила, что запуск Lux будет самым быстрым развёртыванием суперкомпьютера таких размеров в её практике. «Именно такой скорости и гибкости мы хотели бы добиться для программ США в области ИИ искусственного интеллекта», — сказала она. По словам директора ORNL, Lux будет обладать примерно в три раза большей вычислительной мощностью по сравнению с существующими системами. Второй, более продвинутый суперкомпьютер под названием Discovery станет преемником экзафлопсной машины Frontier в ORNL и будет практически на порядок быстрее её. Его разработкой занимаются ORNL, HPE и AMD. Discovery будет основан на платформе HPE Cray Supercomputing GX5000, поддерживающей до 25 кВт на узел и охлаждение водой с температорой +40 °C. Узлы получат процессоры AMD EPYC Venice, которые, как ожидается, появятся во II половине 2026 года, а также специализированные ускорители Instinct MI430X с полноценной поддержкой FP64-вычислений — они также должны появиться в следующем году. Для интерконнекта будет задействован HPE Slingshot следующего поколения, сроки выхода которого не называются. Discovery получит новейшую СХД Cray SC Storage Systems K3000 с объектным хранилищем DAOS, которое дополнит имеющуюся СХД на базе Cray SC Storage Systems E2000 с Lustre. Ранее HPE наняла инженеров, занимавшихся разработкой DAOS в Intel, и включила их в свою команду по работе над СХД. По словам HPE, K3000 предложит до 75 млн IOPS на стойку. HPE не раскрывает, сколько узлов, процессоров и ускорителей будет использоваться в Discovery, а также какой объём памяти будет у системы. Ожидается, что Discovery будет поставлен в 2028 году и готов к эксплуатации в 2029 году. Оценочная стоимость системы — $500 млн. Министерство энергетики США разместит суперкомпьютеры, компании предоставят оборудование и средства на капитальные затраты, а вычислительные мощности будут распределены между обеими сторонами, сообщил представитель министерства. Он отметил, что эти суперкомпьютеры на базе чипов AMD станут первыми в ряду подобных партнёрств министерства с частными компаниями в стране. По аналогичной схеме будет финансироваться создание ИИ-суперкомпьютера Solstice. |

|