Материалы по тегу: hardware

|

20.03.2026 [14:52], Руслан Авдеев

1 ГВт в подарок: Google посадит на «диету» свои ИИ ЦОД во время пиковых нагрузок на энергосетиGoogle модернизировала управлением питанием своих ЦОД в США, добавив возможность гибко регулировать их энергопотребление, что позволяет снизить нагрузку на энергосети в пиковые часы, когда электричество особенно востребовано. Не слишком срочные вычислительные нагрузки будут переноситься на другое время или даже в другие ЦОД. Первые эксперименты в этом направлении компания начала ещё в 2023 году. Компания объявила, что в рамках программы контроля спроса интегрировала в свои долгосрочные энергоконтракты с рядом коммунальных компаний на территории США совокупные мощности на 1 ГВт. Возможности Google по оптимизации спроса в зависимости от нагрузок на электросети позволяют ограничивать или переносить выполнение части задач в сфере ИИ и/или машинного обучения в своих ЦОД, чтобы стабилизировать состояние сети. На практике управлять энергией можно не только во время пиковых нагрузок, но и тогда, когда сетям просто не хватает энергии. После того, как компания продемонстрировала свою технологию управления потреблением электричества совместно с энергокомпанией Omaha Public Power District в 2024 году, в 2025 году было объявлено о соглашениях с Indiana Michigan Power (I&M) и Tennessee Valley Authority (TVA). На этот раз подписаны соглашения с Entergy Arkansas, Minnesota Power и DTE Energy, предполагающие взаимодействие для оптимизации управления энергоснабжением.

Источник изображения: Google Системы умного управления энергетикой начали применять во всём мире. Так, в конце 2025 года ведущий оператор электросетей Великобритании National Grid провёл первое в стране испытание «гибкой» системы электроснабжения дата-центров при участии Nebius и с использованием ИИ-системы управления нагрузками и питанием Emerald AI. Последняя смогла обеспечить энергопотребление на заданном уровне, сократить спрос на энергию до −40 % и сохранить исполнение критических нагрузок в штатном режиме.

20.03.2026 [14:52], Руслан Авдеев

Blue Origin подала заявку на запуск более 51 тыс. спутников-ЦОДКомпания основателя Amazon Джеффа Безоса (Jeff Bezos) подала заявку в Федеральную комиссию по связи США (FCC) на вывод на орбиту до 51,6 тыс. спутников, представляющих собой компактные космические дата-центры, сообщает The Register. В поданном 19 марта заявлении утверждается, что «неутолимый» спрос на ИИ-нагрузки означает, что орбитальные ЦОД должны стать дополнением к земной инфраструктуре дата-центров. Правда, многие эксперты утверждают, что подходящих технологий для создания космических ЦОД пока не существуют, так что они, вероятно всего, будут ненадёжными и непрактичными. Blue Origin утверждает, что космические ЦОД позволят американским компаниям, так или иначе связанным с ИИ-проектами, добиться успеха в области машинного обучения, автономных систем, аналитики и др. Компания признаёт, что создать всю необходимую инфраструктуру на Земле будет непросто, но решить проблему способны помочь космические ЦОД. Спутники-ЦОД постоянно работают от солнечных элементов питания, не требуют земли и энергетической инфраструктуры, что значительно снизит издержки на вычислительные мощности в сравнении с наземными альтернативами. Blue Origin в рамках инициативы Project Sunrise намерена развернуть десятки тысяч спутников на солнечно-синхронных орбитах на высоте 500–1800 км. Наклоны орбит составят от 97° до 104°, на каждой орбитальной плоскости будет находиться 300–1000 спутников. Blue Origin заявила, что намерена использовать для связи спутников друг с другом оптическую связь, а для контакта с Землёй будет использоваться разработанная ей же технология космической связи TeraWave.

Источник изображения: NASA Стоит отметить, что Blue Origin пока не запустила ни одного спутника TeraWave и только дважды запускала свою ракету New Glenn, предназначенную для вывода на орбиту космических ЦОД. Согласно документам, первый из более 5 тыс. аппаратов TeraWave должен отправиться в космос до конца 2027 года. Значительная часть поданных материалов касается использования спектра в рамках Project Sunrise и обещаний не создавать проблем другим заинтересованным сторонам. Тем не менее в документах отмечено, что заявление в Международный союз электросвязи (International Telecommunications Union), также имеющий право голоса в подобных вопросах, пока не подано и проект ещё далёк от практической реализации. Стоит отметить, что не так давно заявку на размещение миллиона спутников-ЦОД на орбите подала компания SpaceX, причём заблокировать её одобрение потребовала родственная Blue Origin компания Amazon Leo, назвавшая идею «спекулятивной» и «нереалистичной» и потребовавшая «технических подробностей», хотя сам Безос ратует за космические ЦОД гигаваттного масштаба. Теперь причина такого агрессивного поведения в отношении конкурента более-менее ясна. У Google тоже есть проект создания космических ЦОД — Project Suncatcher.

20.03.2026 [14:18], Руслан Авдеев

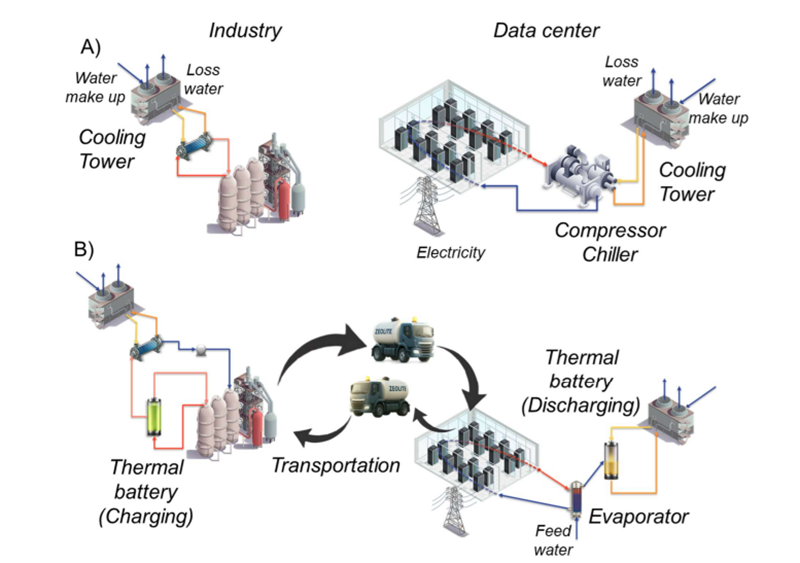

«Мусорное» тепло заводов охладит ЦОД благодаря цеолитовым блокамВ Нью-Йоркском университете (NYU) разработали необычную систему охлаждения на основе минералов. Благодаря им выделяемое на заводах тепло можно использовать для охлаждения дата-центров, сообщает Datacenter Dynamics. Эксперименты ведутся с цеолитами — эти минералы выступают своеобразными «тепловыми аккумуляторами». Они имеют множество микропор и в сухом виде активно поглощают водяной пар. При нагревании до достаточно высокой температуры цеолит отдаёт накопленную воду. Сушить цеолит можно на промышленных предприятиях с помощью выделяемого «мусорного» тепла с температурой ниже 200 °C. Это позволяет «заряжать» цеолитовый теплоаккумулятор, освобождая его от воды и приводя в состояние готовности к поглощению новой влаги в дата-центре. Исследователи утверждают, что такая технология может заменить компрессионные чиллеры, применяемые в классических системах охлаждения ЦОД. Цеолиты уже давно применяются для водоочистки, нефтепереработки и т.п. и стоят не очень дорого. Более того, они не теряют свойства и всегда готовы к поглощению воды. Учёные сравнили решение на основе цеолитовых теплоаккумуляторов с традиционными вариантами с компрессорными чиллерами и предприятиями, отводящими тепло с помощью градирен. Выяснилось, что использование тепла промышленных предприятий для «перезарядки» цеолита позволяет снизить совокупное потребление электричества у ЦОД и завода более чем на 75 %, а дата-центр отдельно может сократить расход электричества на охлаждение до 86 %. В результате показатель PUE улучшится приблизительно на 12 %. Утверждается, что комбинированная система охлаждения потребляет на 15–25 % больше воды, но учёные уверены, что в целом водные ресурсы даже экономятся, поскольку отработанное тепло тратится на «зарядку» теплоаккумуляторов, а не рассеивается в атмосфере. Даже с учётом энергии, расходуемой на перевоз тонн цеолитовых блоков, система всё равно позволяет экономить энергию во многих сценариях, в некоторых случаях — более чем на 40 % при использовании электрических грузовиков. Использование для перевозок железной дороги обеспечивает дополнительную экономию. Пока речь всё ещё идёт лишь о моделировании системы, предстоит решить ещё немало инженерных проблем. Исследователи сообщают, что необходимо создать долговечные, быстро работающие аккумуляторы с возможностью многократного циклического применения. Для координации действий между ЦОД и заводами потребуются новые бизнес-модели. Университет объявил, что уже начались переговоры с несколькими отраслевыми лидерами для возможного масштабирования решения. Согласно исследованиям Калифорнийского университета в Риверсайде без внедрения новых технологий к 2030 году дополнительно может потребоваться 2,6–5,49 млн м3 воды в дни пикового спроса ЦОД в США. Для сравнения: Нью-Йорк за сутки потребляет около 3,8 млн м3. Над альтернативными технологиями охлаждения работают и другие структуры. Так, Karman Industries представила систему охлаждения ИИ ЦОД с углекислым газом.

20.03.2026 [11:44], Сергей Карасёв

Платформа NVIDIA DGX Rubin NVL8 использует процессоры Intel Xeon 6Корпорация Intel сообщила о том, что в составе платформы NVIDIA DGX Rubin NVL8 для агентного ИИ применяются CPU поколения Xeon 6. Эти чипы отвечают за критически важные функции, такие как управление памятью, оркестрация задач и распределение рабочей нагрузки. Система DGX Rubin NVL8 несёт на борту два процессора Xeon 6776P семейства Granite Rapids. Изделия содержат 64 вычислительных ядра с возможностью одновременной обработки до 128 потоков инструкций. Базовая тактовая частота составляет 2,3 ГГц, максимальная — 3,9 ГГц. В режиме Priority Core Turbo (PCT) с восемью ядрами частота достигает 4,6 ГГц. Показатель TDP равен 350 Вт. CPU специально оптимизированы Intel для ИИ-узлов. «Intel Xeon 6 обеспечивает превосходную производительность, эффективность и совместимость с обширной экосистемой программного обеспечения x86, на которую полагаются клиенты при выполнении инференса в масштабе», — говорит Джефф Маквей (Jeff McVeigh), корпоративный вице-президент и генеральный директор стратегических ЦОД-программ Intel.

Источник изображения: NVIDIA В состав DGX Rubin NVL8 входят восемь ускорителей Rubin с суммарным объёмом памяти 2,3 Тбайт (пропускная способность — 160 Тбайт/с). Задействованы восемь однопортовых адаптеров NVIDIA ConnectX-9 VPI (до 800 Гбит/с NVIDIA Infiniband и Ethernet), а также два DPU NVIDIA BlueField-4. Общая пропускная способность шины NVIDIA NVLink достигает 28,8 Тбайт/с. Энергопотребление — приблизительно 24 кВт. Заявленное ИИ-быстродействие на задачах инференса NVFP4 составляет до 400 Пфлопс, при обучении моделей NVFP4 — 280 Пфлопс, при обучении FP8/FP6 — 140 Пфлопс. Среди поддерживаемого софта упомянуты NVIDIA DGX OS, Ubuntu, Red Hat Enterprise Linux, Rocky Linux.

20.03.2026 [11:35], Сергей Карасёв

NVIDIA представила архитектуру хранения данных BlueField-4 STX для ИИ-системКомпания NVIDIA анонсировала модульную эталонную архитектуру BlueField-4 STX, которая поможет предприятиям, облачным провайдерам и операторам дата-центров в создании высокопроизводительных платформ хранения данных, оптимизированных для задач ИИ. Отмечается, что в традиционных ЦОД применяются хранилища общего назначения, обладающие большой вместимостью. Однако они зачастую не способны обеспечивать скорость отклика, необходимую для работы ИИ-агентов: таким системам требуются доступ к информации в реальном времени и контекстная память. Архитектура STX призвана устранить существующие узкие места. Технологической основой STX является DPU NVIDIA BlueField-4, который объединяет Arm-процессор NVIDIA Grace/Vera, 128 Гбайт LPDDR5, 512 Гбайт SSD, сетевой адаптер NVIDIA ConnectX-9 SuperNic (1,6 Тбит/с) и коммутатор PCIe 6.0 с 48 линиями. Используются микросервисы NVIDIA DOCA и программное обеспечение NVIDIA AI Enterprise. Утверждается, что архитектура STX обеспечивает в четыре раза более высокую энергоэффективность по сравнению с традиционными архитектурами хранения, построенными на основе CPU. В целом, как отмечается, STX предоставляет основу для создания универсального механизма обработки данных, ускоряющего полный жизненный цикл ИИ — от обучения и аналитики до инференса на базе агентов. Первой реализацией STX в масштабе стойки является новая платформа хранения NVIDIA CMX с контекстной памятью, которая расширяет память GPU. О поддержке NVIDIA STX сообщили такие компании, как Cloudian, DDN, Dell Technologies, Everpure, Hitachi Vantara, HPE, IBM, MinIO, NetApp, Nutanix, VAST Data и WEKA. Производством систем на базе STX займутся AIC, Supermicro и Quanta Cloud Technology (QCT). Внедрить платформу в числе прочих намерены CoreWeave, Crusoe, IREN, Lambda, Mistral AI, Nebius, OCI и Vultr. Решения на базе STX станут доступны во II половине текущего года.

19.03.2026 [14:25], Руслан Авдеев

Nscale купит 8-ГВт кампус AIPCorp Monarch — Microsoft достанется 1,35 ГВт ИИ-мощностейБританская Nscale подписала соглашение о покупке американской American Intelligence & Power Corporation (AIPCorp). В сделку входит кампус ЦОД в Западной Вирдджинии мощностью до 8 ГВт, сообщает Datacenter Dynamics. Здесь Nscale рассчитывает построить одну из крупнейших в мире ИИ-фабрик. Компания также подписала письмо о намерениях, в соответствии с которым Microsoft с конца 2027 года арендует на новом месте 1,35 ГВт ИИ-мощностей на базе NVIDIA Vera Rubin NVL72, в том числе облачных. AIPCorp основана в начале 2026 года компаниями Fidelis New Energy и 8090 Industries. Кампус Monach Compute Campus занимает более 910 га в Западной Вирджинии, к 2031 году мощность должна составить до 8 ГВт. На первом этапе планируется ввести в эксплуатацию 2 ГВт к 2028 году. Ранее газовые генераторные установки G3500 соответствующей мощности согласилась предоставить компания Caterpillar. Ввод установок в эксплуатацию запланирован на I половину 2028 года. Поначалу кампус Monarch будет питаться от собственной микросети, но со временем он сможет подключиться к магистральной энергосети для возврата в неё излишков энергии. Nscale также рассматривает возможность захвата углерода для компенсации выбросов, связанных с площадкой. Команда AIP и Fidelis New Energy Organization присоединятся к подразделению Nscale Energy & Power, что, как ожидается, поможет поддержать развитие кампуса Monarch.

Источник изображения: Fidelis New Energy По словам Nscale, целью AIPCorp всегда было создание вертикально интегрированной модели, объединяющей генерацию электроэнергии и вычислительные мощности. Комбинация двух факторов позволит Nscale дать быстрорастущему рынку ИИ интегрированную неооблачную платформу без «узких мест», оптимальную для масштабирования. В рамках сделки Nscale выбрала финансовым консультантом Morgan Stanley. У Nscale большие планы экспансии. В конце 2025 года сообщалось, что компания потратит $865 млн на размещение ИИ-оборудования в США, а на днях появилась информация, что Nscale привлекла ещё $2 млрд на свои проекты. Nscale имеет довольно тесные связи с Microsoft. Так, в декабре 2025 года руководитель подразделения ИИ-инфраструктуры Microsoft Нидхи Чаппелл (Nidhi Chappell) перешла в Nscale на аналогичную позицию.

19.03.2026 [13:36], Руслан Авдеев

GMI Cloud развернёт в Японии суверенную ИИ-инфраструктуру стоимостью $12 млрдАмериканская GMI Cloud запускает в Японии суверенный проект по созданию ИИ-инфраструктуры стоимостью $12 млрд. Совместно с Wistron в Кагосиме (Kagoshima) компания планирует запустить ИИ-фабрику для задач «физического ИИ» (робототехника, автономный транспорт, производство), сообщает Datacenter Dynamics. ЦОД в приморском городе на острове Кюсю (Kyushu) будет находиться на территории объекта Kai Shin Digital Infrastructure. Она, в свою очередь, представляет собой совместное предприятие CDIB Capital и Shin-Etsu Science Industry. Впервые Kai Shin Digital Infrastructure объявила о планах строительства ЦОД в Кагосиме в октябре 2025 года. Первоначальная мощность объекта составит 350 МВт с дальнейшим масштабированием до 1 ГВт. Строительство начнётся в конце 2026 года. Известно, что компания является партнёром NVIDIA, но пока подробности об ИИ-оборудовании для площадки почти отсутствуют. Есть данные, что проект будет обеспечивать доступ к ИИ-вычислениям, при этом он должен соответствовать требованиям к суверенитету, определённым для японских организаций. На сайте GMI сообщается, что платформа будет использовать ускорители Vera Rubin.

Источник изображения: GMI Cloud Партнёрство с Wistron тоже началось не вчера. Так, в декабре 2025 года сообщалось, что Wistron потратит $0,9 млрд на расширение производства сетевого и ИИ-оборудования и инвестиции в облако GMI. По данным последней, новый дата-центр будет «зелёным и устойчивым», хотя как именно это будет достигнуто, тоже не сообщается. Судя по одному из рендеров, на крыше зданий будут расположены солнечные панели. GMI рассчитывает использовать для своей суверенной инфраструктурной ИИ-платформы VAST AI от VAST Data, которая позиционируется как первая платформа, созданная с нуля для управления «жизненным циклом» ИИ. Она является единой основой для систем хранения данных, управления базами данных и вычислительной средой. Это избавляет пользователей от необходимости связывать десятки разрозненных инструментов для обучения, инференса, обеспечения работы ИИ-агентов и всех промежуточных этапов.

Источник изображения: GMI Cloud В конце 2025 года GMI представила планы строительства ЦОД на Тайване мощностью 16 МВт за $500 млн. Он должен вмещать около 7 тыс. ИИ-ускорителей NVIDIA GB300 в 96 стойках. Также GMI управляет дата-центрами в США, на Тайване, в Сингапуре, Таиланде и Японии. В данное время компания стремится построить дата-центр мощностью 50 МВт в США. GMI основана в 2023 году и имеет штаб-квартиру в Калифорнии. Первоначально компания работала как оператор ЦОД, обеспечивавший майнинг биткоинов, но с тех пор она изменила профиль деятельности, занявшись реализацией ИИ-проектов. В ноябре 2024 года GMI привлекла $82 млн в рамках раунда финансирования серии А. Согласно официальным данным, на сегодня у неё есть мощности в пяти дата-центрах.

19.03.2026 [12:01], Сергей Карасёв

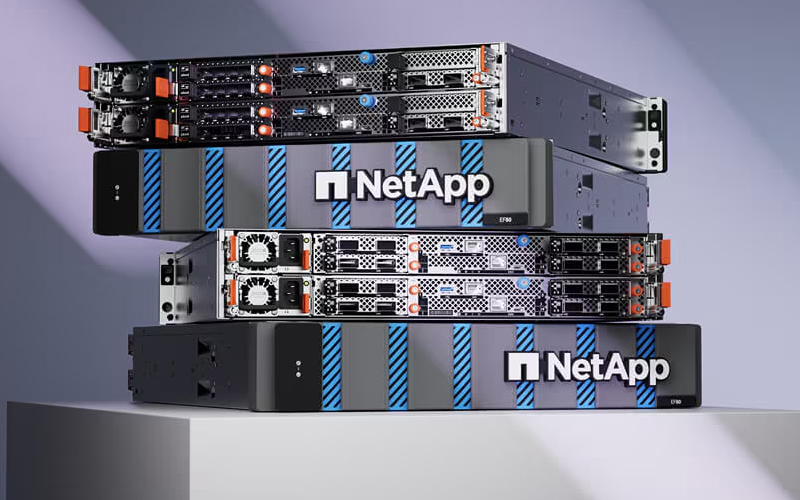

NetApp выпустила СХД EF50 и EF80 типа All Flash для задач ИИКомпания NetApp анонсировала новые СХД семейства EF-Series, ориентированные на ресурсоёмкие нагрузки, в том числе на задачи ИИ, приложения HPC и транзакционные базы данных. Дебютировали модели EF50 и EF80 типа All Flash в форм-факторе 2U с возможностью установки 24 SSD (NVMe). Устройства оснащены двумя активными контроллерами. Говорится о поддержке Fibre Channel (FC), NVMe/RoCE, iSCSI1 и InfiniBand, а также параллельных файловых систем, таких как Lustre и BeeGFS. Возможно формирование массивов RAID 0/1/5/6/10. Развитые функции защиты данных и диагностические инструменты, по заявлениям NetApp, обеспечивают доступность более 99,9999 %. Старшая из двух новинок, EF80, располагает 64 Гбайт памяти на контроллер, 12 портами 200Gb NVMe/IB, NVMe/RoCE, 24 портами 64Gb NVMe/FC и 24 портами 64Gb SCSI FC. Заявленная максимальная скорость передачи данных при чтении составляет 110 Гбайт/с, при записи — 57 Гбайт/с. Показатель IOPS достигает 5 млн. Максимальное энергопотребление находится на уровне 1758 Вт, типовое — 1235 Вт.

Источник изображения: NetApp Версия EF50 получила 32 Гбайт памяти на контроллер. Реализованы 16 портов 64Gb NVMe/FC и 16 портов 64Gb SCSI FC. Скорость при чтении — до 41 Гбайт/с, при записи — до 30 Гбайт/с. Величина IOPS составляет до 1,7 млн. Максимальное энергопотребление равно 1451 Вт, типовое — 1041 Вт. Обе СХД обеспечивают внутреннюю вместимость до 1,5 Пбайт, а энергоэффективность находится на отметке 63,7 Гбайт/с на кВт. Применяется программная платформа SANtricity OS 12.0; при этом обеспечивается совместимость с клиентскими ОС Windows Server, Linux и macOS.

18.03.2026 [14:17], Сергей Карасёв

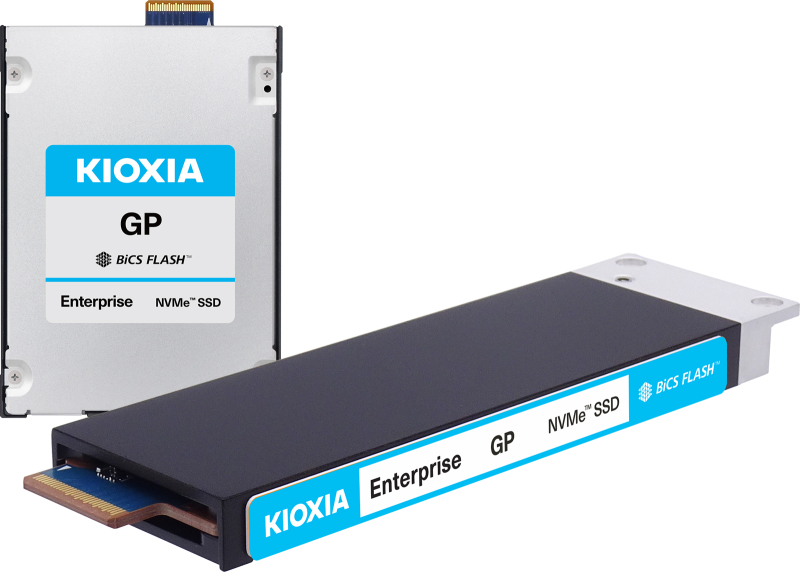

Kioxia анонсировала SSD серии GP на базе XL-Flash для ИИ-нагрузокКомпания Kioxia объявила о разработке высокопроизводительных накопителей Super High IOPS SSD семейства GP, ориентированных на ресурсоёмкие ИИ-нагрузки. Пробные поставки этих изделий планируется организовать к концу текущего года. Особенность Super High IOPS SSD заключается в том, что графический ускоритель в составе системы может получать прямой доступ к такому накопителю. В такой конфигурации флеш-память используется для расширения встроенной памяти HBM, объёма которой зачастую оказывается недостаточно для задач ИИ. Скоростные показатели устройств Kioxia GP пока не раскрываются. Отмечается, что новые накопители разработаны в рамках инициативы NVIDIA Storage-Next, которая предполагает создание чипов флеш-памяти NAND и сопутствующих контроллеров следующего поколения. Ранее говорилось, что подобные SSD будут оснащаться интерфейсом PCIe 6.0, а показатель IOPS на первом этапе составит около 25 млн с последующим повышением до 100 млн. В основу изделий Kioxia GP положены высокопроизводительные чипы флеш-памяти XL-Flash (SCM) с низкой задержкой. Новинки будут предлагаться в различных форм-факторах, включая SFF. Kioxia также отмечает, что для масштабных задач инференса подходят её SSD семейства CM9, оборудованные интерфейсом PCIe 5.0. Речь, в частности, идёт о накопителях вместимостью 25,6 Тбайт на основе флеш-чипов TLC. Такие устройства рассчитаны на три полных перезаписи в сутки (3 DWPD). Поставки этих изделий начнутся в III квартале нынешнего года.

18.03.2026 [12:14], Руслан Авдеев

Великобритания выделит £45 млн на ИИ-суперкомпьютер Sunrise для моделирования физики термоядерного синтезаВласти Великобритании намерены выделить £45 млн (порядка $60 млн) на новый ИИ-суперкомпьютер Sunrise, специально предназначенный для моделирования процессов, сопутствующих термоядерному синтезу. Систему планируют ввести в эксплуатацию летом 2026 года в кампусе Управления по атомной энергии Великобритании (UKAEA), сообщает The Register. Sunrise позиционируется как самый мощный ИИ-суперкомпьютер, специально предназначенный для исследований в сфере термоядерной энергетики. Система мощностью 1,4 МВт финансируется министерским Департаментом энергетической безопасности и нулевых выбросов (Department for Energy Security and Net Zero, DESNZ). Она должна заработать в июне и станет первым элементом «Зоны роста ИИ» (AI Growth Zone) в Калхэме (Оксфордшир). Задача Sunrise — объединение HPC- и ИИ-вычислений, оптимизированных для исследования физических процессов. Это позволит более точно моделировать различные события и создавать цифровых двойников сложных термоядерных систем до проведения дорогостоящих экспериментов в реальном мире. Сообщается, что ИИ-производительность составит до 6,76 Эфлопс. Машина получит узлы Dell PowerEdge с AMD EPYC и Instinct (всего 672 шт.), а также хранилище WEKA. По данным UKAEA, за классические вычислительные мощности отвечают 192 двухпроцессорных узла с 56-ядерными Intel Xeon Max (Sapphire Rapids с HBM). Intel является одной из компаний, поддерживающих проект, наряду с образовательными и государственными структурами — Кембриджским университетом и самим UKAEA.

Источник изображения: Kristina Gadeikyte Gancarz/unsplash.com Представители властей подчёркивают, что система поможет решать ключевые задачи, связанные с термоядерным синтезом, от моделирования турбулентности плазмы до разработки материалов для реакторов и совершенствования технологий для получения тритиевого топлива. Кроме того, предполагается создание цифровых двойников оборудования, что позволит снизить затраты и риски. Суперкомпьютер будет работать на ряд британских энергетических инициатив, включая программу LIBRTI (Lithium Breeding Tritium Innovation), призванную решить проблему производства трития, а также флагманский правительственный проект STEP, предполагающий создание прототипа электростанции на основе сферического токамака. Великобритания рассчитывает построить его в Ноттингемшире в 2040-х гг. Sunrise является частью более широкой инициативы британского правительства, предусматривающей расширение мощностей для ИИ и HPC. Ранее в 2026 году правительство страны подтвердило инвестиции £36 млн (порядка $48 млн) в суперкомпьютерный центр в Кембридже. Тем временем кампус в Калхэме, вероятно, станет центром ИИ-вычислений, связанных с исследованиями в сфере энергетики. Пока не известно, поможет ли искусственный интеллект значительно ускорить довольно медленное продвижение к созданию коммерческих термоядерных проектов. Великобритания делает ставку на то, что увеличение вычислительных мощностей поможет решить одну из ключевых задач физики, имеющих важнейшее прикладное значение. Ещё в 2025 году сообщалось, что на появление коммерческих термоядерных реакторов рассчитывает Microsoft, средства в технологию вкладывают и другие компании — например, в сентябре 2025 года Commonwealth Fusion Systems привлекла на развитие своей термоядерной программы ещё $863 млн, а NVIDIA и General Atomics создали виртуальный термоядерный реактор с помощью ИИ. Впрочем, коммерческих версий термоядерных реакторов пока не существует. |

|