Материалы по тегу: ии

|

27.04.2026 [19:20], Руслан Авдеев

Телеком-отрасли Бангладеш грозит коллапс из-за нехватки топливаБоевые действия на Ближнем Востоке негативно сказываются на всех сферах экономики по всему миру из-за нарастающего топливного кризиса. Ассоциация операторов мобильной связи Бангладеш (Association of Mobile Telecom Operators of Bangladesh, AMTOB) в связи с этим предупредила правительство о вероятном отключении телеком-сетей, сообщает Datacenter Dynamics. Беда не пришла одна — на страну обрушились штормы, вызвав отключения электроэнергии, поэтому восстанавливать электроснабжение ещё труднее, чем обычно. AMTOB представляет собой торговую ассоциацию, объединяющую операторов мобильной связи страны: Grameenphone, Robi, Banglalink, Teletalk и др. В открытом письме к правительству AMTOB призвала министров в приоритетном порядке обеспечить стабильные поставки топлива и электроэнергии для нужд телекоммуникационной инфраструктуры. Согласно тексту заявления, любой длительный дефицит способен негативно сказаться на состоянии связи в общенациональном масштабе и привести к параличу цифровой экономики. Подчёркивается, что телеком-отрасль уже ощущает последствия нехватки энергии. По некоторым оценкам, Бангладеш импортирует порядка 95 % энергоресурсов, поэтому страна находится в особенно уязвимом положении с учётом того, что большая часть топлива поставляется именно с Ближнего Востока. По данным Reuters, Бангладеш был вынужден даже запросить у США временного освобождения от соблюдения санкций в отношении топлива из недружественных Штатам стран.

Источник изображения: Salman Preeom/unspalsh.com По данным AMTOB, телеком-отрасли нужны срочные меры поддержки, включая бесперебойную приоритетную поставку топлива для основных объектов телеком-сети, гарантированное наличие топлива для питания базовых станций, эксплуатируемых четырьмя мобильными операторами и четырьмя компаниями, управляющими вышками. Также необходимо топливо для технического обслуживания связанного с телеком-проектами транспорта, сокращение отключений электричества на критически важных телеком-объектах и максимально быстрое восстановление электроснабжения после штормов и сбоев из-за плохой погоды. Сегодня телеком-инфраструктура Бангладеш включает приблизительно 45 тыс. вышек, множество операторских ЦОД различного масштаба, центров управления сетью (NOC) и другие компоненты, обслуживающие 185 млн. человек. В AMTOB подчёркивают, что объекты в стране во многом зависят от дизельной и бензиновой электрогенерации, особенно в периоды отключения централизованной подачи электричества, веерных отказов и/или стихийных бедствий. Пока ситуация на Ближнем Востоке ожидает прояснения, но совсем недавно Иран не только блокировал пролив, но и наносил удары по дата-центрам AWS в ОАЭ и Бахрейне, а также пригрозил уничтожить строящийся ЦОД Stargate в ОАЭ.

27.04.2026 [15:30], Андрей Крупин

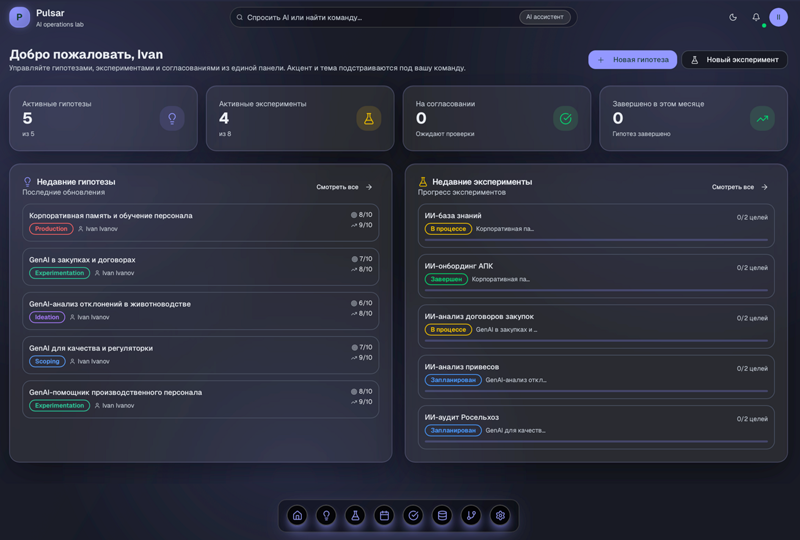

«К2Тех» запустил платформу для управления ИИ-гипотезами и оценки экономического эффекта инициативСистемный интегратор «К2Тех» представил «ИИ-офис» — платформу для работы с инициативами в области искусственного интеллекта. Решение ориентировано на компании, которые переходят от локальных пилотных проектов к масштабному внедрению ИИ-технологий в рабочие процессы. Продукт помогает структурировать весь цикл внедрения: от сбора и приоритизации гипотез до запуска проектов и точного расчёта возврата инвестиций (Return On Investment, ROI). «ИИ-офис» предоставляет единое пространство для всех инициатив организации в сфере технологий машинного обучения и искусственного интеллекта на базе нейронных сетей. В системе предусмотрены инструменты, которые позволяют вести сквозной трекинг каждой идеи: от контроля статусов и назначения ответственных до расчёта финансово-экономической модели и мониторинга хода проверки.

Источник изображения: ai-office.k2.tech В состав платформы включены следующие инструменты:

На платформе «ИИ-офис» уже собраны реализованные бизнес-сценарии «К2Тех» и партнёров компании для различных отраслей и функций предприятия. Данный каталог кейсов позволяет организациям выбирать подходящие гипотезы и на их основе выстраивать собственные решения. Среди примеров — мониторинг кредитно-гарантийных сделок, ускорение обработки заявок, автоматическая генерация проектной документации и интеллектуальный анализ статистических данных по внешнеэкономической деятельности.

27.04.2026 [13:45], Владимир Мироненко

SUSE анонсировала SUSE AI Factory with NVIDIA, упрощающую предприятиям создание собственных ИИ-стековSUSE объявила о запуске платформы SUSE AI Factory with NVIDIA, разработанной специально для решения строгих глобальных задач обеспечения цифрового суверенитета. SUSE AI Factory with NVIDIA представляет собой предварительно протестированный унифицированный программный стек для корпоративного ИИ, созданный на основе SUSE AI и NVIDIA AI Enterprise, призванный преодолеть разрыв между локальной разработкой и масштабируемым корпоративным развёртыванием, позволяя предприятиям создавать, управлять и масштабировать рабочие ИИ-нагрузки на периферии сети, в ЦОД и в публичных облачных средах, сохраняя при этом более жесткий контроль над данными и инфраструктурой. Как отметил StorageReview.com, SUSE позиционирует SUSE AI Factory with NVIDIA как стандартизированный программный слой для корпоративного ИИ, а не как автономную модель или сервис. Стек объединяет несколько компонентов NVIDIA, включая микросервисы NIM, открытые модели Nemotron, NeMo для разработки и управления агентами, Run:ai для оркестрации GPU, NVIDIA Kubernetes Operators, OpenShell для безопасной поддержки среды выполнения агентов и NemoClaw, который использует SUSE K3s в качестве части эталонной архитектуры для более безопасного развёртывания автономных агентов.

Источник изображения: SUSE SUSE AI Factory with NVIDIA стандартизирует развёртывание и запуск приложений ИИ, позволяя разработчикам создавать и тестировать приложения в изолированной среде, в то время как команды платформы управляют развёртыванием либо через единый интерфейс на основе Rancher, либо с помощью автоматизированных рабочих процессов GitOps для управления в масштабе предприятия. Это позволит сократить время настройки и ускорит переход от концепции к производству, уменьшая операционные издержки без необходимости использования разрозненных инструментов. SUSE AI Factory with NVIDIA включает в себя следующие возможности:

27.04.2026 [13:35], Сергей Карасёв

«Гравитон» представил российские серверы на базе Intel Xeon для облаков, виртуализации и ИИ

emerald rapids

gpu

granite rapids

hardware

intel

sapphire rapids

sierra forest

xeon

гравитон

сделано в россии

сервер

Российский разработчик и производитель вычислительной техники «Гравитон» представил шесть серверов на аппаратной платформе Intel, предназначенных для реализации масштабных IT-проектов в сегментах, где наличие техники в реестре Минпромторга РФ не является обязательным требованием. В зависимости от модификации устройства подходят для решения различных задач — от облачных сервисов и виртуализации до нагрузок ИИ и НРС. В частности, дебютировали модели СН2124И5 и СН2127И5 в форм-факторе 4U и 7U соответственно. Они рассчитаны на два процессора Xeon Sapphire Rapids или Xeon Emerald Rapids с TDP до 350 Вт. Поддерживается до 8 Тбайт оперативной памяти DDR5 в виде 32 модулей. У сервера СН2124И5 слоты расширения выполнены по схеме 10 × PCIe 5.0 х16 FHFL + 1 × OCP NIC. Есть 12 фронтальных отсеков для LFF-накопителей NVMe/SATA/SAS и два коннектора M.2 2280/22110 (PCIe 5.0). Возможна установка восьми GPU с энергопотреблением до 350 Вт. В свою очередь, система СН2127И5 имеет аналогичные характеристики, но позволяет использовать до восьми GPU с TDP до 600 Вт. Кроме того, анонсированы серверы СН2122И6 (2U), СН2242И6 (2U), СН2124И6 (4U) и СН2127И6 (7U) с поддержкой двух чипов Xeon 6 (Sierra Forest-SP/Granite Rapids-SP) с показателем TDP до 350 Вт. У первой из этих систем слоты расширения выполнены по схеме 6 × PCIe 5.0 х16 FHFL + 2 × OCP NIC (или 6 × PCIe 5.0 х16 FHFL + 2 × PCIe 5.0 х8 HHHL + 2 × OCP NIC), у трёх других — 10 × PCIe 5.0 х16 FHFL + 1 × OCP NIC. Во всех случаях возможно использование до 8 Тбайт памяти DDR5 (32 модуля).

Источник изображений: «Гравитон» Модель СН2122И6 поддерживает следующие накопители: 12 × LFF NVMe/SATA/SAS во фронтальной части, 2 × SFF SATA/SAS или 4 × SFF NVMe/SATA/SAS, а также 2 × M.2 2280/22110 (PCIe 5.0). Модификации СН2242И6, СН2124И6 и СН2127И6 рассчитаны на накопители в конфигурации 12 × LFF NVMe/SATA/SAS и 2 × M.2 2280/22110 (PCIe 5.0). Две старшие версии поддерживают восемь GPU с TDP до 350 и 600 Вт.  Все серверы располагают контроллером Aspeed AST2600 с выделенным сетевым портом управления 1GbE и воздушной системой охлаждения. Устанавливаются блоки питания мощностью до 3000 Вт с сертификатом 80 Plus Platinum. Заявлена совместимость с Windows и Linux. Гарантия производителя составляет три года.

26.04.2026 [15:38], Руслан Авдеев

Oklo, NVIDIA и LANL задействуют ИИ для разработки плутониевого топлива и создания передовой атомной инфраструктурыЗанимающаяся разработкой малых модульных реакторов (SMR) американская компания Oklo совместно с NVIDIA и Лос-Аламосской национальной лабораторией США (LANL) займутся научно-прикладными проектами. Они выделят ресурсы на развитие атомной инфраструктуры, исследования с помощью ИИ и разработок, связанных с созданием ядерного топлива — в лаборатории, расположенной в штате Нью-Мексико, сообщает Datacenter Dynamics. В соглашении оговорено сотрудничество в области ИИ, цифровых двойников, моделирования и симуляция для развития критической инфраструктуры и ускоренного внедрения атомной энергетики. По словам Oklo, соглашение касается как внедрения реакторов, так и HPC, а также использования экспертных знаний мирового уровня в области науки о топливе и материаловедении. Предполагается, что это будет способствовать созданию плутониевого топлива для реактора Pluto, выбранного Министерством энергетики США (DoE) в рамках плана Reactor Pilot Program. Также инициатива направлена на обеспечение надёжного энергоснабжения в рамках миссии Genesis, которую прозвали новым Манхэттенским проектом. В рамках партнёрства компании обучат ИИ-модели на данных в области физики и химии — с их помощью будет поддерживаться проверка качества топлива и научно-исследовательские работы, касающиеся энергоносителей на основе плутония. Также ИИ будет способствовать исследованиям в области выработки электроэнергии, обеспечения надёжности энергосистем, резервирования и стабилизации энергоснабжения для поддержки развития ИИ ЦОД в национальной лаборатории.

Источник изображения: Oklo Находящаяся в Нью-Мексико Лос-Аламосская национальная лаборатория США принимала участие в исходном Манхэттенском проекте. Сегодня лаборатория — один из ключевых научных центров Министерства энергетики США, занимающихся ядерными исследованиями. Американская Oklo разрабатывает 75-МВт SMR Aurora Powerhouse. Реактор планируют ввести в эксплуатацию в 2027 году. Oklo входит в число 11 ключевых атомных компаний, отобранных для участия в пилотной программе DoE, посвящённой новым ядерным реакторам и разработке передового ядерного топлива. Oklo — один из наиболее активных разработчиков SMR по количеству заключённых сделок, в основном для питания ЦОД. Совокупный объём заказов уже превысил 14 ГВт, хотя часть сделок не имеет обязательной юридической силы. Среди самых значимых сделок: поставка ЦОД Switch до 12 ГВт до 2044 года; 1,2 ГВт для Meta✴ до 2030 года; 500 МВт для Equinix и до 100 МВт для Prometheus Hyperscale (Wyoming Hyperscale). В последние годы NVIDIA активно взаимодействовала с компаниями, реализующими атомные энергетические проекты, а также инвестировала в них средства. В частности, речь идёт о проектах компаний TerraPower и Commonwealth Fusion Systems (CFS), занимающихся в атомных разработках, в т.ч. в сфере термоядерного синтеза. В январе NVIDIA заключила партнёрское соглашение с CFS и Siemens для «строительства» цифровой копии термоядерного реактора CFS. Это должно помочь упростить начало его коммерческой эксплуатации.

26.04.2026 [14:20], Владимир Мироненко

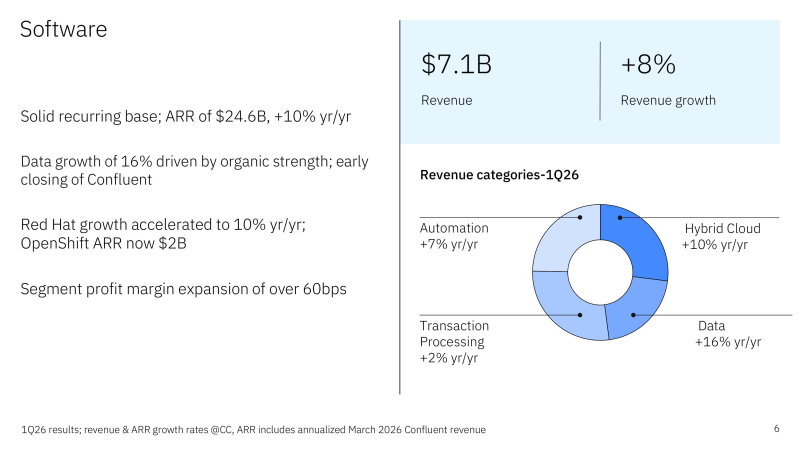

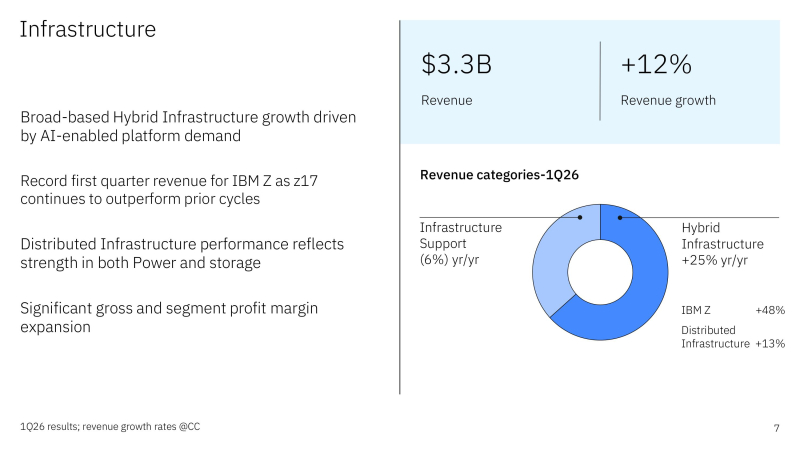

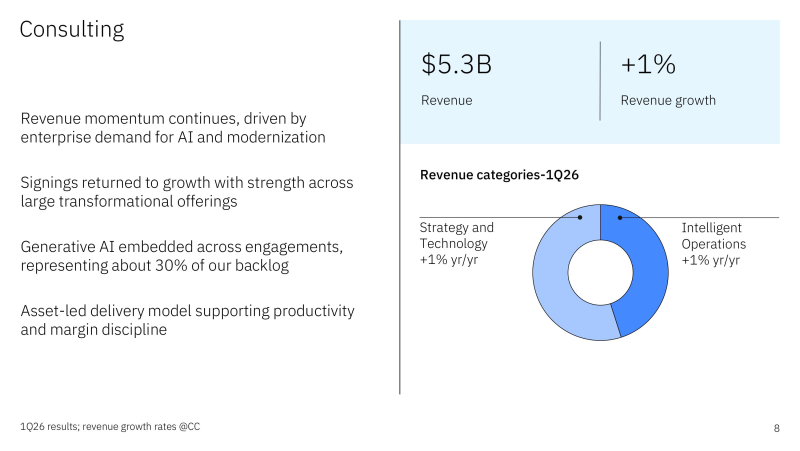

Акции IBM упали из-за нежелания компании увеличить прогноз выручкиIBM объявила финансовые результаты за I квартал 2026 года, завершившийся 31 марта. Несмотря на то, что выручка и прибыль превзошла прогнозы Уолл-стрит, акции компании упали на внебиржевых торгах более чем на 7 % в начале торгов после закрытия биржи, поскольку компания отказалась повысить прогнозы на весь год, сообщил ресурс SiliconANGLE. Выручка компании выросла год к году на 9 % до $15,92 млрд, превысив консенсус-прогноз аналитиков, опрошенных LSEG, в размере $15,62 млрд. Скорректированная прибыль на акцию (Non-GAAP) составила $1,91 при прогнозе $1,81. Чистая прибыль (GAAP) увеличилась на 15 % до $1,22 млрд, или $1,28 на акцию, с $1,06 млрд, или $1,12 на акцию, в I квартале 2024 года. Прогноз на весь год остался без изменений: IBM по-прежнему ожидает прирост свободного денежного потока в размере около $1 млрд и рост выручки более чем на 5 %. «Я не думаю, что мы когда-либо повышали прогнозы в I квартале», — заявил финансовый директор IBM Джим Кавана (Jim Kavanaugh). Выручка от консалтинга увеличилась на 4 % до $5,27 млрд, что чуть меньше прогноза аналитиков StreetAccount в размере $5,28 млрд. Наибольший вклад в выручку внесла разработка ПО, продажи которого составили $7,05 млрд, что на 11 % больше, чем годом ранее и выше консенсус-прогноза аналитиков, опрошенных StreetAccount, в $7,02 млрд. При этом выручка подразделения по автоматизации увеличилась на 10 %, выручка подразделения по обработке данных и ИИ — на 19 %, выручка от обработки транзакций — на 6 %. Рост продаж в высокорентабельном подразделении гибридных облачных решений, включающем Red Hat, составил 13 %. Однако рост выручки от RHEL замедлился по сравнению с IV кварталом, отметил Кавана. «Я думаю, это связано с отсутствием федеральных соглашений и шатдауном правительства в IV квартале, а также с очень нарушенной цепочкой поставок оборудования», — сказал он. Выручка инфраструктурного подразделения (IBM Infrastructure), занимающегося продажей серверов, СХД, коммутаторов и системного ПО, составила $3,33 млрд, что на 15 % больше, чем годом ранее, превысив прогноз StreetAccount в $3,16 млрд. Рост выручки от продаж аппаратного обеспечения мейнфреймов z составил 51 %, при этом мейнфрейм z17, ориентированный на ИИ, опережает по продажам предыдущие циклы выпуска продукта. Продажи гибридной инфраструктуры выросли на 28 %, распределённой инфраструктуры — на 17 %. По состоянию на закрытие торгов в минувшую среду акции IBM упали с начала 2026 года примерно на 15%, в то время как индекс S&P 500 за тот же период вырос на 4 %. Акции компании обрушились за один день в феврале на 13 % после заявления ИИ-стартапа Anthropic о том, что ИИ может помочь компаниям модернизировать ПО на COBOL. «ИИ усиливает аргументы в пользу мейнфреймов, а не ослабляет их», — написал старший вице-президент IBM по ПО в комментариях в своем посте в LinkedIn. Gartner и вовсе предрекает провал подавляющему большинству попыток портировать старый код на новые платформы с помощью ИИ. В середине марта IBM завершила приобретение компании Confluent, за $11 млрд. Хотя сделка была завершена примерно на два месяца раньше запланированного срока, это не повлияло на целевые показатели рентабельности IBM. Кавана заявил, что рост операционной маржи до налогообложения остаётся в рамках запланированного 1 %.

25.04.2026 [21:46], Владимир Мироненко

Google инвестирует до $40 млрд в партнёра-конкурента Anthropic, выплатив авансом $10 млрдНа этой неделе стало известно о планах Google инвестировать до $40 млрд в ИИ-стартап Anthropic при его предварительной оценке в $350 млрд, что почти соответствует сумме, в которую компания была оценена в ходе раунда финансирования в феврале. $10 млрд стартап получит авансом, ещё $30 млрд будет выделено при достижении определённых целевых показателей, пишет Bloomberg. Несмотря на наличие собственных конкурирующих моделей Gemini AI, Google оказывает финансовую поддержку Anthropic, которая является одновременно и партнёром, и конкурентом. Как и OpenAI, Anthropic привлекает крупные инвестиции от компаний, у которых она покупает чипы и вычислительные мощности ЦОД, что вызывает обоснованные опасения у некоторых аналитиков относительно цикличности этих сделок. Компания извлекает выгоду из популярности своих ИИ-решений, включая модель Claude Code, ускоряющую разработку ПО. Anthropic становится доминирующим игроком на рынке ИИ-инструментов для разработки ПО, в которые сама Google также вложила значительные средства. По словам инсайдеров, внутри Google растёт обеспокоенность тем, что она теряет позиции на этом рынке. Вместе с тем Google продолжает активно инвестировать в разработку собственных моделей Gemini, которые обеспечивают работу функций ИИ в поисковой системе, Gmail и других приложениях. В этом месяце Anthropic представила свою новейшую модель Claude Mythos ограниченной группе партнёров. Anthropic заявила, что Mythos — её самая мощная модель на сегодняшний день, имеющая значительные возможности для применения в сфере кибербезопасности. В феврале 2026 года компания привлекла $30 млрд инвестиций при оценке в $380 млрд. Раунд возглавили сингапурский суверенный фонд GIC и Coatue, также в нём участвовали, помимо других инвесторов, Microsoft и NVIDIA. В октябре прошлого года Anthropic заключила сделку с Google, обеспечивающую ей доступ к ИИ-ресурсам мощностью более 1 ГВт с возможностью использования до 1 млн TPU. После этого компании расширили партнёрство при участии Broadcom, договорившись о предоставлении Anthropic 3,5 ГВт ИИ-мощностей на базе Google TPU. Согласно новому инвестиционному соглашению, Google Cloud предоставит Anthropic ещё 5 ГВт мощностей в течение следующих пяти лет с возможностью дальнейшего масштабирования. Пятилетнее соглашение может стоить около $200 млрд, подсчитали The Financial Times. Ранее на этой неделе Anthropic заключила сделку с Amazon, в рамках которой обязуется потратить более $100 млрд в течение следующих десяти лет на чипы Trainium и вычислительные мощности AWS, а Amazon обязалась инвестировать в стартап $5 млрд сразу, а затем ещё $20 млрд в течение определённого времени. Также в этом месяце стартапом было подписано многолетнее соглашение с неооблаком CoreWeave о предоставлении ИИ-мощностей для дальнейшего развития семейства моделей Claude.

25.04.2026 [11:15], Руслан Авдеев

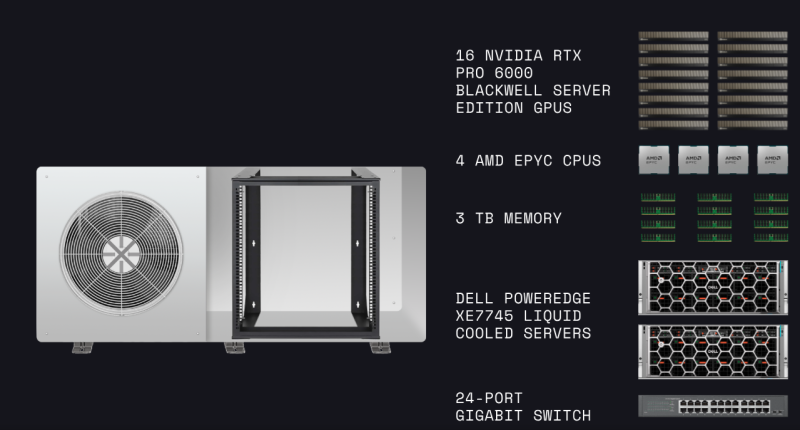

Электрощит с ИИ-сервером: SPAN анонсировала «распределённый ЦОД» XFRAЗанимающаяся выпуском умных распределительных электрощитов компания SPAN представила решение XFRA, позиционирующееся, как «распределённый дата-центр». Предполагается использование свободных мощностей в жилых домах и коммерческой недвижимости для ИИ-вычислений, сообщает Datacenter Dynamics. Каждый из вычислительных узлов оснастят двумя серверами Dell Poweredge XE7745 с СЖО — всего четыре процессора AMD EPYC, 3 Тбайт RAM и 16 ускорителей NVIDIA RTX Pro 6000 Blackwell. Для управления разработана собственная платформа оркестрации XFRA Cloud. SPAN будет использовать функции управления питанием в своих распределительных щитах для отдачи вычислительным узлам свободных энергомощностей, не используемых в данный момент владельцами объектов. SPAN подчёркивает, что XFRA не станет заменой полноценным ЦОД, но дополнит их, ускоряя рост вычислительных мощностей на периферийных участках электросети. Внедрение XFRA силами американского девелопера PulteGroup стартует в 2026 году. По имеющимся данным, уже сформировано портфолио проектов, позволяющее выйти на гигаваттный масштаб в 2027 году.

Источник изображения: SPAN PulteGroup заявила, что XFRA представляет собой решение, позволяющее снизить затраты на строительство. Строительство домов с щитами SPAN, системой XFRA и резервными аккумуляторами не просто снизит расходы на эксплуатацию жилья, но и позволит использовать энергетическую инфраструктуру объектов в интересах всей энергосистемы. SPAN входит в лоббистскую группу Utilize, созданную в марте 2025 года. Последняя выступает за «более умное, быстрое и доступное» использование имеющейся в США сетевой инфраструктуры. В число участников также входят Google, Tesla и производитель климатического оборудования — компания Carrier.

Источник изображения: SPAN Бизнес уже активно использует серверы в домах и коммерческих помещениях, но, в первую очередь, в несколько иных целях. Так, British Gas заключила соглашение с Heata, в рамках которого в Великобритании будет тестироваться облачная платформа с серверами в жилых домах. Каждый сервер подключен к системе домашнего отопления, аккумулирующей тепло в ходе работы сервера. Британская коммунальная UK Power Networks (UKPN) в рамках программы SHIELD (Smart Heat and Intelligent Energy in Low-income Districts) начала устанавливать в домах микро-ЦОД на базе Raspberry Pi — для отопления домохозяйств малоимущих и оплаты их коммунальных услуг.

24.04.2026 [21:42], Владимир Мироненко

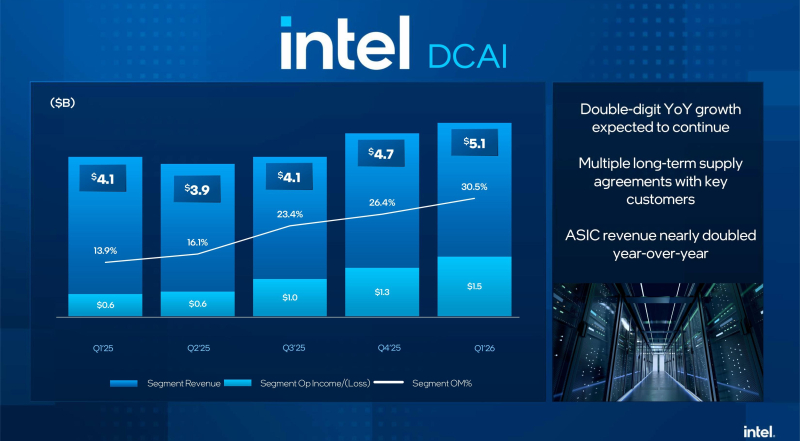

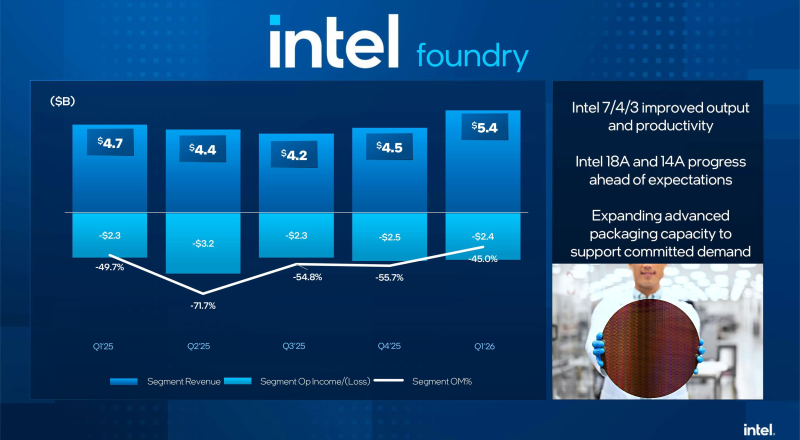

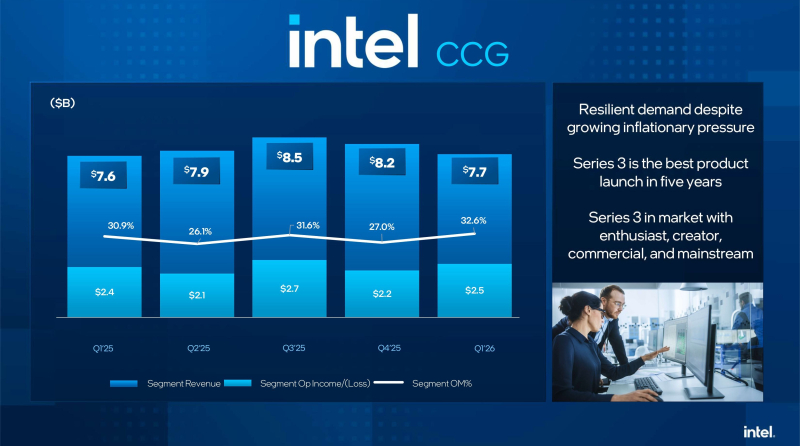

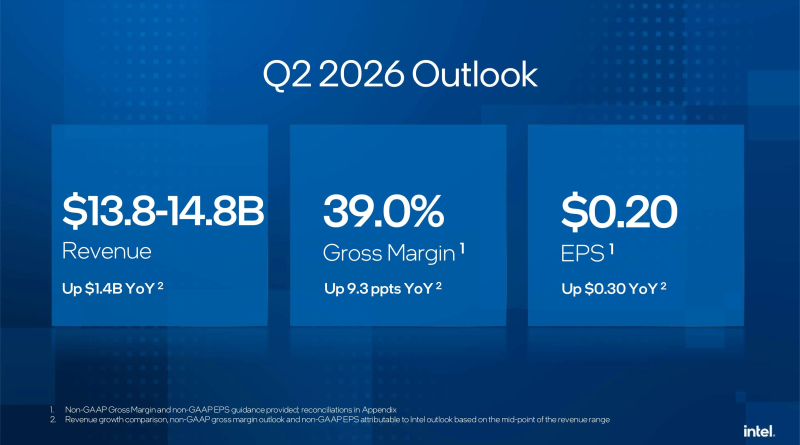

CPU нужны всем, особенно ИИ: Intel шестой квартал подряд бьёт прогнозы по выручкеIntel сообщила о результатах I квартала 2026 финансового года, завершившегося 28 марта, которые значительно превзошли ожидания Уолл-стрит. По словам генерального директора Лип-Бу Тана (Lip-Bu Tan), уже шестой квартал подряд выручка Intel превосходит собственные прогнозы компании. Выручка Intel выросла год к году на 7,2 % до $13,58 млрд при среднем прогнозе экспертов, опрошенных LSEG, в размере $12,42 млрд. До этого выручка снижалась в годовом исчислении в пяти из семи последних кварталов. Финансовый директор Intel Дэвид Зинснер (David Zinsner) рассказал, что часть этих продаж пришлась на старые или не очень хорошо работающие чипы, которые Intel отложила для детальной проверки. «В I квартале нам удалось проанализировать запасы готовой продукции и найти возможности для продажи товаров, которые, как мы думали, мы не сможем реализовать», — сказал Зинснер. Скорректированная прибыль на акцию (non-GAAP) составила $0,29 при прогнозе $0,01. Согласно GAAP компания сработала с убытком в размере $0,73 на акцию, что отражает обесценение гудвилла в подразделении Mobileye на $3,79 млрд. После публикации финансового отчёта акции компании выросли на 19 % на внебиржевых торгах, увеличив рыночную капитализацию на $64 млрд, и внеся вклад в 81-процентный рост с начала года, пишет Reuters. Intel сообщила, что прогнозирует выручку во II квартале в диапазоне от $13,8 до $14,8 млрд и скорректированную прибыль на акцию в размере $0,20 в середине прогноза. Это значительно выше прогнозов аналитиков, ожидающих выручку в $13,07 млрд и прибыль на акцию в размере $0,09. Наиболее сильный рост показало подразделение Datacenter and AI Group (DCAI), которое специализируется на продуктах для ЦОД и ИИ, увеличившее выручку на 22 % до $5,05 млрд благодаря растущему спросу на CPU. Операционная прибыль подразделения составила $1,54 млрд. Зинснер отметил сильный рост продаж ASIC, выручка от которых выросла более чем на 30 % по сравнению с предыдущим кварталом и почти вдвое по сравнению с прошлым годом. «В последние месяцы мы видим явные признаки того, что CPU вновь утверждает себя в качестве незаменимой основы эры ИИ. Теперь CPU служит уровнем оркестрации и критически важной плоскостью управления для всего стека ИИ, — заявил генеральный директор Intel Лип-Бу Тан. — Это не просто наши мечты, это то, что мы слышим от наших клиентов». Выручка подразделения Intel Foundry, которое занимается производством чипов, составила $5,42 млрд, что выше год к году на 16 %. Выручка от внешних продаж составила $174 млн за квартал. При этом его операционный убыток составил $2,44 млрд. Годом ранее у подразделения тоже были убытки, составившие $2,32 млрд при выручке $4,67 млрд. Как ожидается, убытки сократятся в течение года, поскольку производство 18A продолжает наращивать объёмы, а выход годной продукции продолжает улучшаться, сообщил финдиректор. По его словам, в этом квартале Intel Foundry показало результаты, превзошедшие ожидания, обеспечило стабильное улучшение выхода годной продукции и достигло ключевых показателей по 14A. Intel также сообщила, что присоединилась к проекту Terafab в качестве стратегического партнёра наряду со SpaceX, xAI и Tesla Илона Маска (Elon Musk). Компания будет помогать в «проектировании, изготовлении и упаковке сверхвысокопроизводительных микросхем», которые также будут использоваться аэрокосмической компанией SpaceX. Intel вернула контроль над заводом Fab 34 в Ирландии. «Соглашение отражает продолжающийся рост бизнеса Intel, подкрепленный растущей и важной ролью процессоров в эпоху ИИ и значительно укрепленным балансом», — отметила компания. Выручка потребительской группы Client Computing Group (CCG) выросла на 1 % до $7,73 млрд, её операционная прибыль составил $2,52 млрд. Аналитик EMarketer Джейкоб Борн (Jacob Bourne) сообщил SiliconANGLE, что Маск, возможно, не единственный клиент, ожидающий запуска техпроцесса Intel 14A. «Ситуация с внутренним производством продолжает приносить Intel дивиденды, а обязательства Tesla по программе 14A намекают на появление новых клиентов, поскольку геополитическая обстановка подталкивает покупателей ИИ к размещению производства в США», — сказал он. «Спрос на серверные процессоры, связанный с развитием инфраструктуры ИИ, обеспечивает Intel более стабильную базу доходов, менее зависимую от цикла ПК, поэтому её восстановление выглядит не как мимолетный всплеск, а скорее как более устойчивая, долгосрочная восходящая траектория», — добавил аналитик.

24.04.2026 [18:23], Руслан Авдеев

Microsoft вложит $18 млрд в ЦОД, ИИ и облака в АвстралииMicrosoft объявила о намерении инвестировать в расширение инфраструктуры и работы в сфере ИИ и облачных технологий в Австралии AU$25 млрд ($18 млрд) до конца 2029 года, сообщает Datacenter Dynamics. По словам главы компании Сатьи Наделы (Satya Nadela), выступавшего в Сиднее, это позволит расширить инфраструктуру Azure в стране более чем на 140 %. Новые инвестиции — продолжение политики Microsoft, в конце 2023 года пообещавшей вложить AU$5 млрд ($3,18 млрд). Тогда заявлялось, что это крупнейшая инвестиция компании за всю 40-летнюю историю её присутствия на континенте. С правительством страны подписан меморандум о взаимопонимании, в соответствии с которым Microsoft намерена соответствовать недавно названных официальным «ожиданиям» властей в отношении ЦОД и строителей ИИ-инфраструктуры, предполагающим приоритет национальных интересов Австралии, поддержку «зелёного перехода», ответственное использование воды, создание рабочих мест и др. В рамках «зелёного перехода» Microsoft увеличит мощности возобновляемой энергетики в стране с учётом собственных целей по достижению «углеродного нейтралитета» к 2030 году. Дополнительно компания намерена расширить сотрудничество с госструктурами в области КИИ и обучить к 2028 году 3 млн жителей Австралии навыкам работы с ИИ. Также в июле 2025 года Microsoft подписано пятилетнее соглашение с местным Министерством обороны на сумму AU$495 млн ($324,71 млн). Военные намерены использовать облачные мощности компании. К концу 2025 года Microsoft владела и управляла тремя дата-центрами на континенте и строила ещё три объекта в окрестностях Сиднея и Мельбурна. У компании имеются облачные регионы в Канберре, Новом Южном Уэльсе и провинции Виктория — необходимые мощности арендуются у сторонних провайдеров. Ранее появилась информация, что Google рассматривает возможность инвестировать в Австралию AU$20 млрд ($14,2 млрд), но компанию беспокоят высокие налоги. AWS строит ЦОД для австралийского правительства — в июле 2024 года было объявлено, что он предназначен для обработки совершенно секретной информации. Правительство намерено инвестировать в новые системы в следующие десять лет AU$2 млрд ($1,3 млрд). Летом 2025 года сообщалось, что в ближайшие четыре года AWS потратит AU$20 млрд (US$13 млрд) на инфраструктуру дата-центров в Австралии. Тогда это была крупнейшая публичная инвестиция в технологическую сферу страны за всю её историю. |

|