Материалы по тегу: ии

|

30.01.2026 [10:43], Сергей Карасёв

Lightmatter представила оптический VLSP-движок Guide для ИИ-платформ нового поколенияКомпания Lightmatter, специализирующаяся на разработке ИИ-ускорителей и других продуктов на основе фотоники, объявила о «фундаментальном прорыве» в лазерной архитектуре для систем передачи данных: представлена т.н. платформа сверхмасштабируемой фотоники — Very Large Scale Photonics (VLSP). Первым изделием на её основе стал оптический движок Guide, ориентированный на ИИ-системы следующего поколения. Отмечается, что современные решения CPO (Co-Packaged Optics) и NPO (Near-Package Optics) базируются на дискретных лазерных диодах на основе фосфида индия (InP), интегрированных в модули ELSFP (External Laser Small Form Factor Pluggable). Однако эти архитектуры сталкиваются с трудностями, обусловленными ограничениями по мощности. Компоненты, при изготовлении которых используется эпоксидная смола, уязвимы к термическому повреждению. Вместе с тем для удвоения полосы пропускания требуется кратное увеличение количества ELSFP, что приводит к соответствующему повышению стоимости и энергопотребления, а также к увеличению занимаемого пространства. Кроме того, в случае дискретных лазеров могут возникать проблемы с обеспечением точного разнесения длин волн. Изделие Guide VLSP, как утверждается, устраняет существующие ограничения. Новая интегрированная архитектура по сравнению с дискретными лазерными модулями позволяет сократить количество компонентов, предлагая при этом значительно более высокую производительность и улучшенную надёжность. Технология предусматривает возможность масштабирования от 1 до 64+ длин волн при одновременном снижении сложности сборки. В результате значительно повышается плотность компоновки: платформа Guide первого поколения обеспечивает коммутационную способность до 100 Тбит/с в 1U-шасси. Для сравнения, в случае обычных решений потребовалось бы 18 модулей ELSFP в шасси высотой 4U. Движок Guide используется в валидационных платформах Passage M-Series и L-Series (Bobcat). Говорится, что изделие обеспечивает пропускную способность до 51,2 Тбит/с на лазерный модуль в случае NPO и CPO. Выходная мощность составляет не менее 100 мВт в расчёте на оптическое волокно. Возможна генерация 16 длин волн с мультиплексированием. Поддерживаются двунаправленные фотонные каналы связи, в которых две сетки длин волн с шагом 400 ГГц чередуются с точным смещением на 200 ГГц (±20 ГГц). Новая платформа уже доступна заказчикам для тестирования. Между тем компания Lightmatter сообщила о заключении сразу нескольких партнёрских соглашений. В частности, планируется интеграция решений Synopsys в платформу Lightmatter Passage 3D Co-Packaged Optics. В сотрудничестве с Global Unichip Corp. (GUC) Lightmatter намерена заняться разработкой CPO-продуктов для гиперскейлеров, ориентированных на ИИ. Кроме того, Lightmatter и Cadence объединили усилия с целью ускорения разработки передового интерконнекта для ИИ-инфраструктур.

29.01.2026 [23:55], Владимир Мироненко

Непоколебимая вера в ИИ: Meta✴ удвоит капзатраты в 2026 годуMeta✴ Platforms сообщила финансовые результаты IV квартала и всего 2025 года, завершившегося 31 декабря 2025 года. Выручка компании за квартал составила $59,89 млрд, что больше год к году на 24% при консенсус-прогнозе аналитиков, опрошенных LSEG, в размере $58,59 млрд (по данным CNBC). При этом чистая прибыль выросла год к году на 9% до $22,77 млрд. Прибыль на разводнённую акцию составила $8,88 (+11%), что выше прогноза от LSEG в размере $8,23 на разводнённую акцию. За 2025 год выручка Meta✴ достигла $200,97 млрд, увеличившись год к году на 22%. Чистая прибыль составила $60,46 млрд (падение на 3%) или $23,49 на разводнённую акцию. В I квартале 2026 года компания прогнозирует выручку в пределах от $53,5 до $56,5 млрд, что немного меньше результата IV квартала, но выше прогноза аналитиков, опрошенных LSEG, в размере $51,41 млрд. На фоне этого прогноза выручки, превзошедшего ожидания экспертов, акции Meta✴ подскочили на 10%. Meta✴ заявила, что общие расходы в 2026 году составят от $162 до $169 млрд. При этом капитальные затраты, связанные с ИИ, в 2026 году, как ожидается, составят от $115 до $135 млрд, что превышает прогнозы аналитиков в $110,7 млрд. Это почти вдвое больше, чем капитальные затраты компании в 2025 году, которые составили $72,2 млрд. Роста затрат направлен на поддержку подразделения Meta✴ Superintelligence Labs (MSL), а также основной повседневной деятельности компании, заявила финансовый директор Сьюзан Ли (Susan Li). Ранее компания пообещала потратить $600 млрд на ИИ ЦОД, инфраструктуру и кадры. В начале этого месяца компания Meta✴ представила новую инициативу под названием Meta✴ Compute, направленную на расширение ИИ-инфраструктуры и улучшение управления своей растущей сетью ИИ ЦОД, заявив о планах построить десятки гигаватт мощностей в течение этого десятилетия и сотни гигаватт в будущем. Meta✴ считает, что эта ставка на развитие ИИ окупится с лихвой. «Несмотря на значительное увеличение инвестиций в инфраструктуру, в 2026 году мы ожидаем получить операционную прибыль, превышающую прибыль 2025 года», — сказала Ли. Глава компании Марк Цукерберг (Mark Zuckerberg) считает значительные затраты оправданными, отметив, что Meta✴ сейчас наблюдает значительное ускорение развития ИИ: «Я ожидаю, что 2026 год станет годом, когда эта волна ещё больше ускорится по нескольким направлениям. Мы начинаем видеть, как агенты действительно работают. Это откроет возможности для создания совершенно новых продуктов и трансформирует наш подход к работе». «Мы начинаем видеть потенциал ИИ, который понимает наш личный контекст, включая нашу историю, наши интересы, наш контент и наши отношения. Ценность агентов во многом обусловлена уникальным контекстом, который они могут видеть», — отметил глава Meta✴. По его словам, Meta✴ также работает над объединением больших языковых моделей (LLM) с системами рекомендаций, которые лежат в основе Facebook✴, Instagram✴, Threads и ёе рекламных систем, что, как ожидается, позволит увеличить доходы от рекламы. Т.е. рост вложений в инфраструктуру связан и с увеличением сложности и размера своих ИИ-моделей, которые должны помочь в подборе рекламных объявлений для пользователей. В IV квартале компания уже удвоила количество ускорителей, используемых для обучения генеративной модели ранжирования рекламы GEM (Generative Ads Recommendation Model), позволяющей в реальном времени определять, какие объявления будут максимально уместными для конкретного пользователя. «Сегодня наши системы помогают людям оставаться на связи с друзьями, понимать мир и находить интересный и развлекательный контент. Но вскоре мы сможем понимать уникальные личные цели людей и персонализировать ленты, чтобы показывать каждому человеку контент, который помогает ему улучшить свою жизнь так, как он этого хочет», — заявил Цукерберг.

29.01.2026 [18:20], Руслан Авдеев

ИИ и облака вместо телефонов: Telefónica превратит десятки «медных» АТС в периферийные ЦОДИспанский оператор связи и ЦОД Telefónica ускоряет реализацию стратегии расширения периферийных вычислений. Для этого компания переоборудует ненужные более телефонные АТС с медными компонентами в мини-ЦОД на 1–2 МВт. Среднесрочная цель — развернуть в стране более 100 таких узлов, сообщает Datacenter Dynamics. После полного отключения аналоговой телефонной связи в Испании большое количество АТС с медными кабельными системами осталось без дела, поэтому Telefónica España начала переделывать их в распределённые периферийные ЦОД небольшой мощности. Новые ЦОД ориентированы на предоставление ИИ и облачных сервисов с низкой задержкой — они находятся вблизи от конечных потребителей и призваны укрепить цифровой суверенитет страны. На сегодня уже эксплуатируется 12 подобных узлов, коммерческие услуги компания намерена начать предоставлять после завершения тестовой фазы. На горизонте 5–7 лет планируется развернуть более 100 таких дата-центров. Вторую жизнь получит и сеть связанных электростанций. Новые edge-узлы интегрируют с ВОЛС и 5G-сетями. Новый план — часть общеевропейского проекта развития периферийных вычислений, в его рамках Telefónica выделена субсидия в размере €93 млн ($111 млн). Компания дополнила её собственными средствами, хотя объёмы инвестиций не раскрываются. Также в европейском проекте участвуют телеком-операторы Orange, Deutsche Telekom и Telecom Italia.

Источник изображения: Telefonica К концу 2026 года Telefónica рассчитывает запустить ещё 17 периферийных узлов, дополняя свои лидирующие позиции в сегментах FTTH — на её долю приходится более 31 млн подключенных домохозяйств — и 5G, это способствует цифровой трансформации в стране. Telefónica отмечает, что её т.н. Edge Plan выводит Испанию на передний край инноваций в Европе в контексте обеспечения технологического суверенитета, позволяя создавать местную инфраструктуру без помощи «неевропейских» вендоров. Периферийная архитектура комбинирует эластичность облака с возможностью обработки данных в непосредственной близости от их источника. Это минимизирует задержки и в то же время обеспечивает соответствие сопутствующих процессов европейским правовым нормам. Стремление обрести технологический суверенитет, в первую очередь от США, в последнее время стало ключевым вектором деятельности для многих европейских компаний и политиков. Так, Франция в январе 2025 года объявила, что местных госслужащих переведут с Zoom и Teams на суверенный видеочат Visio. Суверенные решения предлагают европейцам и европейские компании вроде SAP, а вот техногиганты из США не пользуются былой популярностью — не так давно Microsoft признала что не может обеспечить настоящий суверенитет европейских данных, поскольку вынуждена подчиняться в первую очередь законам США.

29.01.2026 [16:57], Сергей Карасёв

Китайский конкурент NVIDIA H20 — Alibaba представила ИИ-ускоритель Zhenwu 810E с 96 Гбайт HBM2eКомпания T-Head Semiconductor, подразделение китайского интернет-гиганта Alibaba Group Holding, представила ИИ-ускоритель собственной разработки Zhenwu 810E. Изделие, как утверждается, может использоваться для обучения ИИ-моделей и инференса, а также для решения других ресурсоёмких задач, например, в области автономного вождения. В основу новинки положены аппаратная и программная архитектуры, полностью разработанные специалистами T-Head. Решение оснащено 96 Гбайт памяти HBM2e. Применен проприетарный интерконнект ICN (Inter-Chip Network), обеспечивающий пропускную способность до 700 Гбайт/с — у каждого чипа есть семь таких интерфейсов для прямого объединения с другими чипами. Для подключения к хосту используется шина PCIe 5.0 x16. В плане производительности Zhenwu 810E, по имеющейся информации, превосходит ускоритель NVIDIA A800, а также некоторые GPU китайского производства. Подчеркивается, что новое решение T-Head способно составить конкуренцию NVIDIA H20. Напомним, что и A800, и H20 разработаны специально для китайского рынка в соответствии с американскими требованиями по контролю над экспортом высокопроизводительных процессоров. Некоторые источники также предполагают, что модернизированная версия чипа Zhenwu сможет обеспечить производительность, превосходящую показатели NVIDIA A100.

Источник изображения: T-Head Alibaba уже использует Zhenwu 810E для обучения своих больших языковых моделей Qianwen, а также для ИИ-инференса. Кроме того, на базе новых чипов в сочетании с облачными сервисами Alibaba предоставляются услуги более чем 400 клиентам, включая Государственную электросетевую компанию (SGCC), Китайскую академию наук (CAS) и стартап по производству электромобилей Xpeng. Собственные ИИ-чипы проектируют и многие другие китайские компании. В частности, местный стартап Iluvatar CoreX недавно поделился планами по выпуску GPU-ускорителей, превосходящих по возможностям NVIDIA Rubin. Соответствующие разработки также ведут Kunlunxin (Baidu), Zixiao (Tencent), MetaX, Moore Threads и Biren. Но ведущими игроками рынка ИИ-чипов КНР остаются NVIDIA и Huawei.

29.01.2026 [16:38], Владимир Мироненко

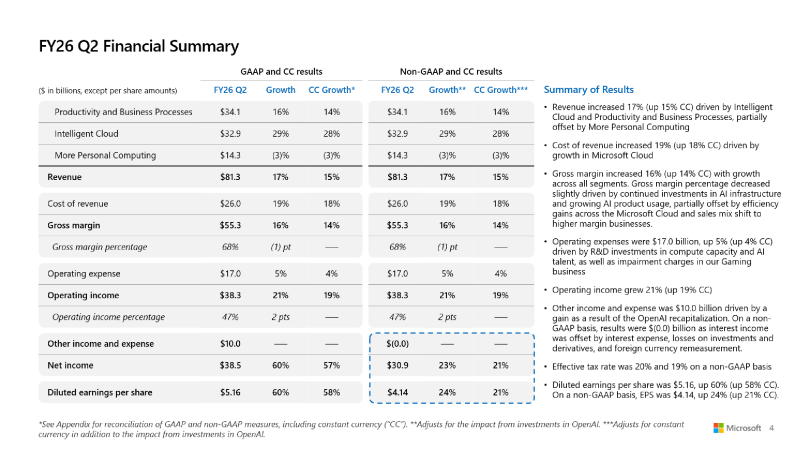

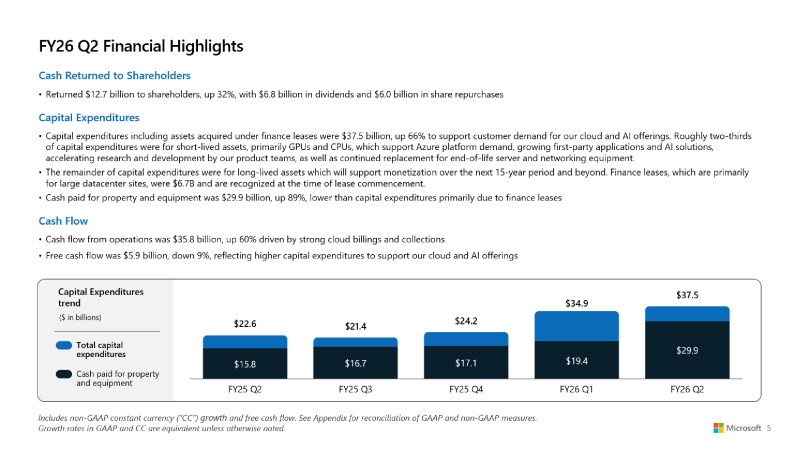

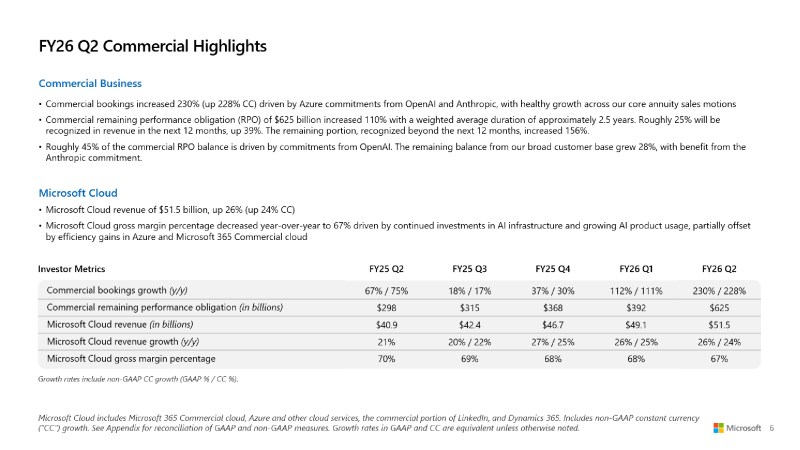

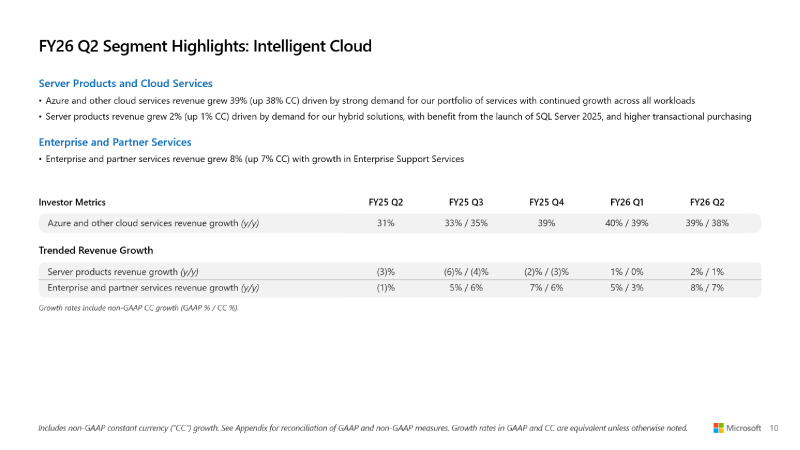

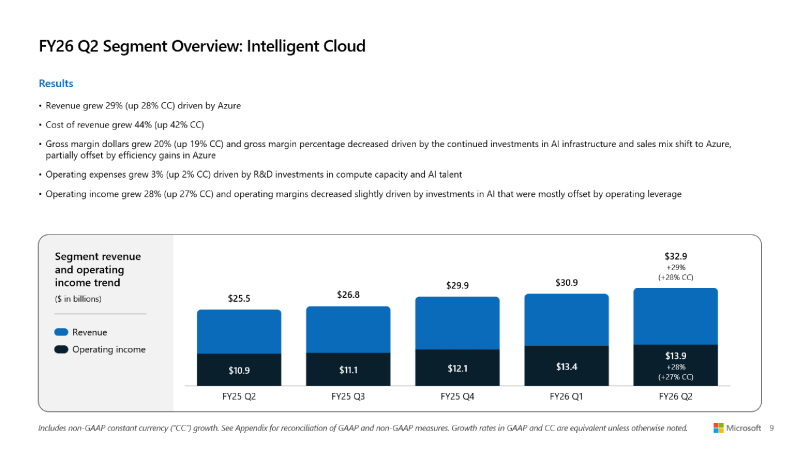

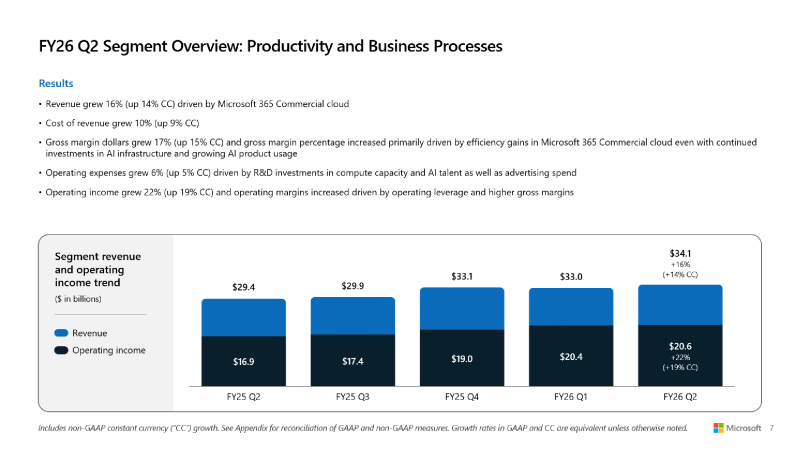

Microsoft превысила прогнозы Уолл-стрит, но её акции упали из-за замедления роста облачных сервисовMicrosoft объявила результаты за II квартал 2026 финансового года, закончившийся 31 декабря 2025 года. Несмотря на то, что результаты компании превысили прогнозы Уолл-стрит, её акции упали на 7 % на внебиржевых торгах в среду после сообщения о замедлении роста облачных сервисов, пишет ресурс CNBC. Скорректированная прибыль (Non-GAAP) Microsoft на разводнённую акцию составила $4,14 при объёме продаж в $81,27 млрд, в то время как аналитики, опрошенные LSEG, ожидали $3,97 скорректированной прибыли при выручке в размере $80,27 млрд. Microsoft уточнила, что скорректированная прибыль не включает влияние инвестиций компании в OpenAI. Согласно отчёту Microsoft, её выручка за второй финансовый квартал выросла на 16,7 % по сравнению с аналогичным периодом предыдущего финансового года. Чистая прибыль (GAAP) составила $38,46 млрд или $5,16 на акцию, что на 60 % выше показателя годом ранее в $24,11 млрд или $3,23 на акцию. Валовая маржа компании была самой низкой за три года, составив чуть более 68 %. «Выручка Microsoft Cloud в этом квартале превысила $50 млрд, что отражает высокий спрос на наш портфель услуг», — сообщила Эми Худ (Amy Hood), исполнительный вице-президент и главный финансовый директор Microsoft, добавив, что компания превзошла ожидания по выручке, операционной прибыли и прибыли на акцию. Выручка Microsoft Cloud выросла на 26 % до $51,5 млрд, а оставшиеся коммерческие обязательства компании по исполнению контрактов, представляющие собой незаработанную выручку и суммы, которые будут признаны в качестве выручки позже, выросли на 110 % до $625 млрд. Это стало возможным благодаря оставшимся коммерческим обязательствам OpenAI перед Microsoft в области облачных сервисов на сумму $250 млрд в течение квартала. Microsoft заявила, что 45 % оставшихся коммерческих обязательств связаны с OpenAI, а оставшаяся часть суммы выросла на 28 %. «Портфель заказов действительно хорош, но информация о том, что OpenAI составляет 45 % от их портфеля, возвращает нас к вопросу: сможет ли OpenAI достичь этих финансовых целей, чтобы расплатиться с Oracle, Microsoft и многими другими поставщиками?» — задался вопросом аналитик Jefferies Брент Тилл (Brent Thill) в программе Closing Bell Overtime на CNBC. Остальная часть оставшихся обязательств по коммерческому выполнению контрактов «больше, чем у большинства конкурентов, более диверсифицирована, чем у большинства конкурентов, и, честно говоря, я думаю, что мы очень уверены в этом», — сказала Эми Худ. Она отметила, что Microsoft остаётся «мастштабным поставщиком» для OpenAI. Microsoft сообщила, что чистые убытки от инвестиций в OpenAI составила $7,58 млрд, или $1,02 на акцию. Компания также отметила, что её прочие доходы во II финансовом квартале составили $9,97 млрд, что обусловлено рекапитализацией OpenAI, пишет ресурс Constellationr. Сегмент Microsoft Intelligent Cloud, включающий облачную инфраструктуру Azure, принес $32,91 млрд выручки (рост 29 %), что больше консенсус-прогноза StreetAccount в размере $32,40 млрд. Рост Azure и других облачных сервисов составил 39 % по сравнению с 40-% ростом в I финансовом квартале. Аналитики, опрошенные StreetAccount и CNBC, ожидали рост на 39,4 и 38,9 % соответственно. Выручка в сегменте «Производительность и бизнес-процессы» (Microsoft Productivity and Business Processes) выросла на 16 % до $34,12 млрд, что выше консенсус-прогноза в $33,48 млрд аналитиков, опрошенных StreetAccount. Доход от облачного сервиса Microsoft 365 увеличился на 17 %, от потребительского облачного сервиса Microsoft 365 — на 29 %, от LinkedIn — на 11 %, от Dynamics 365 — на 19 %. В настоящее время у компании 15 млн коммерческих подписчиков Microsoft 365 Copilot. До этого момента Microsoft не сообщала о количестве пользователей, имеющих доступ к Copilot. У Copilot есть потенциал роста. В настоящее время Microsoft располагает более чем 450 млн платных коммерческих пользователей Microsoft 365. Сегмент More Personal Computing, включающий Windows, Xbox, Surface и Bing, принес $14,25 млрд выручки (падение год к году на 3 %), что ниже консенсус-прогноза аналитиков StreetAccount в $14,38 млрд. В отчётном квартале капитальные затраты и финансовая аренда Microsoft составили $37,5 млрд, что на 66 % больше в годичном исчислении и выше прогноза аналитиков, опрошенных Visible Alpha, в $34,31 млрд. Худ сообщила, что примерно две трети из них приходится на краткосрочные активы, такие как GPU и CPU (согласно MarketBeat). Microsoft активно инвестирует в ЦОД для удовлетворения спроса на ИИ и другие облачные вычислительные услуги. Однако компания ожидает снижения капитальных затрат в третьем финансовом квартале, подчеркнул ресурс Investors. «Мы находимся только на начальных этапах распространения ИИ, и Microsoft уже построила бизнес в сфере ИИ», — заявил генеральный директор Microsoft Сатья Надела (Satya Nadella). «В общей сложности за этот квартал мы добавили почти один гигаватт вычислительных мощностей», — сообщил он во время телефонной конференции. Наделла подчеркнул необходимость создания решений для «гетерогенных и распределённых» рабочих нагрузок ИИ и заявил, что Microsoft оптимизирует свои решения, ориентируясь на «токены на ватт на доллар», что, по его словам, способствует повышению эффективности использования и снижению общей стоимости владения за счет полупроводниковых компонентов, систем и ПО. Он отметил «50-% увеличение пропускной способности» для рабочих нагрузок инференса OpenAI, обеспечивающих работу Copilot, и сказал, что Microsoft соединила площадки ЦОД через AI WAN, создав, по его словам, «первую в своем роде суперфабрику ИИ» для ЦОД Fairwater. В III финансовом квартале Microsoft прогнозирует выручку в размере от $80,65 до $81,75 млрд. Средний показатель составил $81,2 млрд, что соответствует консенсус-прогнозу LSEG в $81,19 млрд. Прогноз компании по квартальному росту облачных сервисов Azure составил от 37 до 38 % при консенсус-прогнозе StreetAccount в размере 37,1 %. Ожидаемая операционная маржа компании в III квартале 2026 финансового года равна 45,1 %, что ниже консенсус-прогноза StreetAccount в 45,5 %. Операционные расходы будут включать инвестиции в вычислительные мощности и персонал для ИИ.

29.01.2026 [13:01], Руслан Авдеев

STT GDC запускает в Сингапуре экспериментальный дата-центр с HVDC-питаниемОператор ЦОД ST Telemedia Global Data Centres (STT GDC) анонсировал запуск тестового ЦОД FutureGrid Accelerator с питанием постоянным током в Сингапуре — это первый в Юго-Восточной Азии инфраструктурный объект с высоковольтным High Voltage Direct Current (HVDC) энергоснабжением, сообщает Datacenter Dynamics. Расположенная при центре Electrification and Power Grids Centre (EPGC) Наньянского технологического университета (NTU) Сингапура на острове Джуронг, первая в регионе площадка демонстрирует интеграцию HVDC-технологий с реальными ИИ-нагрузками. Это позволит удовлетворять требованиям к высокой плотности размещения и высокой отказоустойчивости вычислений нового поколения в сфере ИИ. Проект совместно разработан STT GDC и Liteon при поддержке Energy Research Institute при NTU и детища NTU — компании Amperesand. Фактически чипы в ИИ-серверах работают от постоянного тока, но дата-центры изначально получают и распределяют переменный. Это ведёт в постоянной конвертации AC–DC, что приводит к энергопотерям. Гиперскейлеры пытаются добиться большей энергетической плотности стоек, используя прямое DC-питание. Солнечные и ветряные электростанции, как и многие топливные ячейки, также генерируют постоянный ток. STT GDC добавляет, что HVDC также повышает энергоэффективность, что ведёт к меньшим выбросам CO2 и использованию меньшего количества меди. FutureGrid Accelerator, по словам создателей — стратегическая инвестиция в достижение сингапурского цифрового лидерства в долгосрочной перспективе. Сотрудничество мировых лидеров ИИ-индустрии над этим проектом позволяет строить инфраструктуру, готовую к будущим ИИ-нагрузкам, в то же время находясь на передовом крае внедрения экоустойчивых технологий. Тестовая площадка позволит оценить производительность HVDC-систем с нагрузками не менее 325 кВт, используя архитектуру Liteon и твердотельные трансформаторы Solid State Transformer (SST) Amperesand. STT GDC планирует внедрять технологию в будущих ЦОД в Сингапуре, а позже — масштабировать её использование на все мировые рынки. Компания также подписала меморандум о взаимопонимании с местными образовательными и научными учреждениями: Institute of Technical Education (ITE), Singapore Polytechnic (SP), NTU Singapore и National University of Singapore (NUS) для расширения пула талантов в городе-государстве. Соглашения помогут в течение пяти лет обучить более 8 тыс. сингапурцев в рамках программ, посвящённых ИИ-инфраструктуре и устойчивым энергетическим системам. Внимание будет уделяться не только IT и экоустойчивости, но и финансовой стороне вопроса, маркетингу и другим смежным дисциплинам. Прпоекты с применением постоянного тока сегодня — не редкость. Например, ещё в конце 2024 года Microsoft и Meta✴ представили дизайн ИИ-стойки с раздельными шкафами для питания и IT-оборудования с переходом на архитектуру 400 В DC. В мае 2025 года было объявлено, что Google готовит мегаваттные стойки с питанием 400 В DC, тогда же сообщалось, что Infineon и NVIDIA разрабатывают архитектуру HVDC-питания 800 В DC для ИИ ЦОД. В октябьре 2025 года появилась информация, что OCP запустила инициативу Open Data Center for AI для стандартизации инфраструктуры передовых ИИ ЦОД с мегаваттными стойками, в числе прочего уделялось внимание и технологиям HVDC. Наконец, тогда же опубликована новость, что ABB поддержит NVIDIA во внедрении 800 В DC питания для мегаваттных ИИ-стоек.

29.01.2026 [10:39], Руслан Авдеев

NVIDIA, Microsoft и Amazon ведут переговоры об инвестициях до $60 млрд в OpenAINVIDIA, Microsoft и Amazon ведут переговоры о новых инвестициях в OpenAI. Предполагается, что компании готовы вложить в бизнес партнёра до $60 млрд, сообщает The Information. Как заявляет The Information со ссылкой на «лицо, знакомое с ситуацией», NVIDIA — действующий инвестор, чьи чипы активно используются для работы с ИИ-моделями OpenAI, ведёт переговоры о том, чтобы вложить до $30 млрд. Microsoft, давно поддерживающая OpenAI, также ведёт переговоры, но готова потратить лишь менее $10 млрд. При этом Amazon (AWS), готовая стать новым инвестором, обсуждает о вложении значительно больше $10 млрд, потенциально — даже более $20 млрд. Сообщается, что OpenAI близка к тому, чтобы получить юридически не обязывающие меморандумы о договорённостях (term sheets) или инвестиционные обязательства от названных компаний. NVIDIA, Microsoft, Amazon и OpenAI пока новости не комментируют. Ранее сообщалось, что SoftBank Group ведёт переговоры об инвестициях дополнительных $30 млрд в OpenAI. Масштаб инвестиций Amazon может зависеть от отдельных переговоров, предусматривающих возможное расширение сделки по аренде облачных серверов у Amazon компанией OpenAI и заключение коммерческого соглашения о продаже OpenAI своих продуктов — Amazon может оформить корпоративные подписки на ChatGPT. Сейчас OpenAI пытается бороться с ростом цен на обучение и эксплуатацию своих ИИ-моделей на фоне ужесточающейся конкуренцией с компанией Google и более мелкими игроками. Впрочем, плохо контролируемые инвестиции могут быть весьма опасными. Так, американские банки уже крайне неохотно дают деньги Oracle, из-за уже имеющихся обязательств последней перед OpenAI. На днях сообщалось, что OpenAI готовит крупнейший в своей истории раунд финансирования на $50 млрд при участии инвесторов Ближнего Востока.

29.01.2026 [10:20], Руслан Авдеев

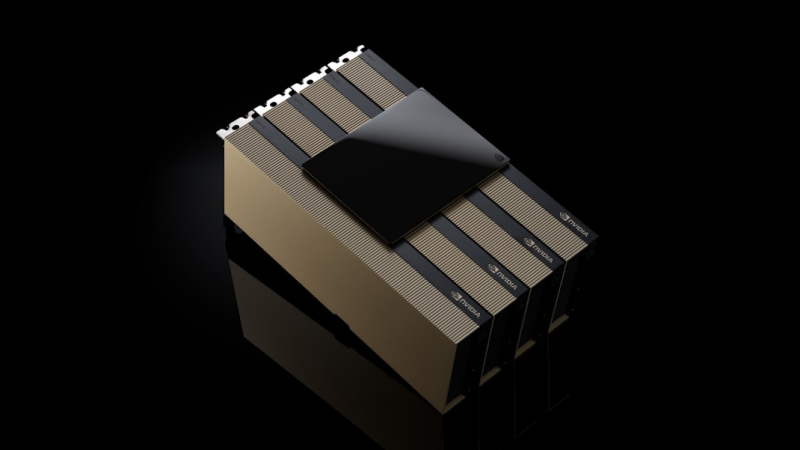

Конец неопределённости: Пекин одобрил импорт NVIDIA H200Китайские власти начали выдавать разрешения на импорт в страну ИИ-ускорителей NVIDIA H200. Это положит конец неопределённости, царившей после того, как поставки второго по производительности чипа NVIDIA в Поднебесную одобрили представители американских властей, сообщает гонконгская SCMP. Первая партия, как сообщают источники, поступит местным техногигантам, остро нуждающимся в передовых ускорителях. Впрочем, ожидается, что поддерживаемые государством компании вроде телеком-операторов, смогут покупать такие чипы только под жёстким контролем. Пока одобрены поставки более 400 тыс. ускорителей компаниям ByteDance, Alibaba Group Holding и Tencent Holdings, прочие бизнесы продолжают ожидать получения разрешений. В самой NVIDIA новости не комментируют. Это важные изменения китайской политики после того, как Пекин временно придержал поставки H200 ранее в январе 2026 года уже после того, как Вашингтон одобрил экспорт. Это отражает желание китайских властей сохранить баланс между необходимостью покупать передовые ИИ-чипы и стремлением добиться самодостаточности в этой сфере.

Источник изображения: NVIDIA По мнению экспертов, неограниченный доступ к закупкам чипов NVIDIA нанёс бы удар местной китайской индустрии ИИ-полупроводников. Поэтому регуляторам необходимо установить некоторые рамки для ограничения доли использования ИИ-ускорителей иностранного производства и управления спросом. Ранее допускалось, что китайские компании обяжут закупать определённое количество чипов местного производства при покупке H200 у NVIDIA. По мнению экспертов Национального университета Сингапура, одобрение Пекином импорта H200 вызвано стратегическими мотивами — это обеспечит дальнейшее ускоренное развитие китайских ИИ-технологий. Стоит отметить, что разрешение на поставки H200 довольно прохладно принято многочисленными политическими и бизнес-группами в США. Например, глава компании Anthropic сравнил такие продажи с поставками ядерного оружия Северной Корее.

29.01.2026 [08:43], Руслан Авдеев

Microsoft построит в Висконсине третий «самый передовой» ИИ ЦОД в мире по проекту FairwaterMicrosoft получила разрешение на строительство 15 дополнительных дата-центров в кампусе Маунт Плезант (Mount Pleasant, Висконсин), сообщает Datacenter Dynamics. Дополнительные объекты возведут на участке близ существующего кампуса Microsoft Project Fairwater на месте несостоявшегося производства Foxconn. На одном участке планируется построить девять дата-центров, каждый площадью более 53 тыс. м2, на втором — ещё шесть, площадью не менее 52 тыс. м2 каждый. Строительство ИИ ЦОД началось в 2023 году, изначально планировалось освоить более 127 га земли. В том же году техногигант получил разрешение ещё на 404 га. С тех пор компания скупает землю вокруг. В частности, она купила площадью 64 га за $43 млн в августе 2024 года. В сентябре 2025 года Microsoft сообщила, что намерена вложить в следующие три года в развитие кампуса дополнительные $4 млрд — помимо тех $3,3 млрд, что уже потрачены на Project Fairwater, который сама компания называет самым передовым в мире. Аналогичный ЦОД по проекту Fairwater запущен в Атланте (Джорджия).

Источник изображения: Dave Hoefler/unsplash.com Существующая площадка занимает территорию в 127,5 га и вмещает три больших двухэтажныъ здания общей площадью 111 483 м2. Для строительства потребовалось 74,9 км забивных свай глубокого заложения, около 12 тыс. т строительной стали, 193 км подземных кабелей среднего напряжения и 116,8 км трубопроводов для инженерных систем. Ранее в январе 2026 года компания объявила, что приостановила строительство на территории кампуса, оценивая масштабы и последние изменения технологий, а также то, как это может повлиять на строительство объектов. На тот момент представитель Microsoft заявлял, что нет причин думать, что масштабы или «природа» проекта изменятся. Теперь, судя по всему, концепцию всё же значительно пересмотрели. В Висконсине Microsoft рассматривала строительство дата-центра в Каледонии (Caledonia), но отказалась от проекта всего через несколько недель после его анонса.

28.01.2026 [23:51], Владимир Мироненко

SK hynix создала на базе Solidigm американскую «дочку» для инвестиций в ИИ-решенияЮжнокорейская компания SK hynix объявила о создании в США новой компании, специализирующейся на решениях в сфере ИИ с предварительным названием AI Company (AI Co.). Новая компания будет сформирована путём реструктуризации Solidigm (SK hynix NAND Product Solutions Corp.), калифорнийской «дочки» SK hynix по производству SSD корпоративного класса, образованной в 2021 году в результате покупки NAND-бизнеса Intel за $9 млрд. При этом её бизнес-операции будут переданы новой дочерней компании, которая будет называться Solidigm Inc., «для обеспечения преемственности бренда». Новая структура призвана укрепить конкурентоспособность SK hynix в области технологий памяти для ИИ-платформ, включая высокоскоростную память (HBM). Компания заявила, что эта инициатива знаменует собой переход от традиционной роли производителя памяти к роли ключевого партнёра в решениях для ИИ ЦОД. Полученные в этой роли возможности будут объединены для создания синергии с дочерними компаниями и филиалами SK Group. SK hynix отметила, что благодаря своему бизнесу по производству SSD корпоративного класса, Solidigm уже является ключевым игроком в экосистеме ИИ ЦОД. Включение Solidigm в состав AI Company направлено на поиск возможностей для сотрудничества и развития бизнеса, которые могут создать синергию с различными направлениями бизнеса в ИИ-индустрии. Официальное название AI Company будет объявлено в феврале. Сначала будет сформирована временная управленческая команда и совет директоров, после чего запланирован переход к постоянной управленческой группе, состоящей из местных экспертов с глубокими знаниями рынка США. Для обеспечения первоначального финансирования SK hynix инвестирует в AI Company $10 млрд. Причём эта сумма будет структурирована как резерв на привлечение капитала, в рамках которого средства будут использоваться по запросу AI Co. для финансирования инвестиций. SK hynix планирует осуществлять через AI Co. стратегические инвестиции в ИИ-компании и расширять сотрудничество с американскими новаторами в сфере ИИ. SK hynix стремится укрепить своё лидерство в области производства памяти, одновременно развивая возможности решений по всей цепочке создания стоимости в ИИ ЦОД, поскольку растёт спрос на оптимизацию на системном уровне для решения проблем с узкими местами в передаче данных, отметил ресурс Korea IT Times. Первоначально SK hynix планирует сосредоточиться на ПО для оптимизации ИИ-систем, а затем постепенно расширять инвестиции в экосистему ИИ ЦОД. Недавно сообщалось о том, что SK hynix на три месяца ускорила график запуск завода по производству микросхем в южнокорейском Йонъине (Yongin), поскольку компания вкладывает большие деньги в освоение ИИ-волны. На поставках для ЦОД можно заработать ещё больше, поскольку, по крайней мере в краткосрочной перспективе, это создало дефицит памяти в потребительском секторе, отметил ресурс Hothardware. Также в этом месяце стало известно, что SK hynix инвестирует ₩19 трлн ($12,9 млрд) в строительство нового завода по упаковке и тестированию чипов для ИИ-технологий в Чхонджу (Cheongju). Планы по созданию нового предприятия в США также соответствуют политике США, стимулирующей размещение производства в стране с помощью регулирования пошлин на поставки извне. SK hynix уже строит в Индиане научно-исследовательский центр по производству современных микросхем и их упаковке стоимостью $3,87 млрд, о котором было объявлено ещё в 2024 году. Завод будет производить HBM для ИИ-ускорителей, начало его работы запланировано на 2028 год, пишет ресурс CNBC. |

|