Материалы по тегу: ии

|

03.02.2026 [15:41], Владимир Мироненко

Snowflake теперь будет сотрудничать с OpenAI напрямую, минуя MicrosoftКомпания Snowflake, специализирующаяся на облачных решениях для обработки данных с использованием ИИ, объявила о заключении партнёрского соглашения с OpenAI на сумму $200 млн с целью разработки и внедрения специализированных ИИ-решений для общих корпоративных клиентов. Сделка знаменует переход от прежнего доступа клиентов Snowflake к OpenAI при посредничестве Microsoft к прямым отношениям Snowflake с OpenAI. В рамках партнёрства модели OpenAI будут доступны в управляемом сервисе Snowflake Cortex AI и Snowflake Intelligence, что позволит 12,6 тыс. клиентов Snowflake создавать и развёртывать приложения и ИИ-агентов непосредственно на управляемых корпоративных данных во всех трёх основных публичных облаках. Эта сделка позиционирует OpenAI как одного из основных поставщиков моделей на платформе Snowflake, наряду с Anthropic, Meta✴ и Mistral AI, отметил ресурс SiliconANGLE. Как указано в пресс-релизе, основные преимущества партнёрства включают:

Партнёрство также распространяется на взаимное использование технологий внутри компаний. В Snowflake заявили, что OpenAI использует Snowflake в качестве платформы данных для отслеживания экспериментов и аналитики, а Snowflake задействует ChatGPT Enterprise для повышения производительности труда своих сотрудников и принятия решений. Сообщается, что несколько клиентов, включая платформу для дизайна Canva и производителя фитнес-браслетов WHOOP, уже используют совместное предложение для ускорения исследований, аналитики и принятия внутренних решений. Напомним, что в начале декабря Snowflake объявила о сделке с ИИ-лабораторией Anthropic на сумму $200 млн с целью обеспечения доступа клиентов к агентному ИИ в дополнение к их существующим данным. Объявление о сделке Snowflake и OpenAI сделано на фоне усиления конкуренции на рынке данных и ИИ, отметило агентство Reuters. Конкурент Snowflake — компания Databricks продолжает агрессивно масштабироваться. Недавно она привлекла $4 млрд инвестиций при оценке рыночной стоимости в $134 млрд для финансирования развития своей платформы Agent Bricks и растущего набора продуктов ИИ.

03.02.2026 [14:51], Андрей Крупин

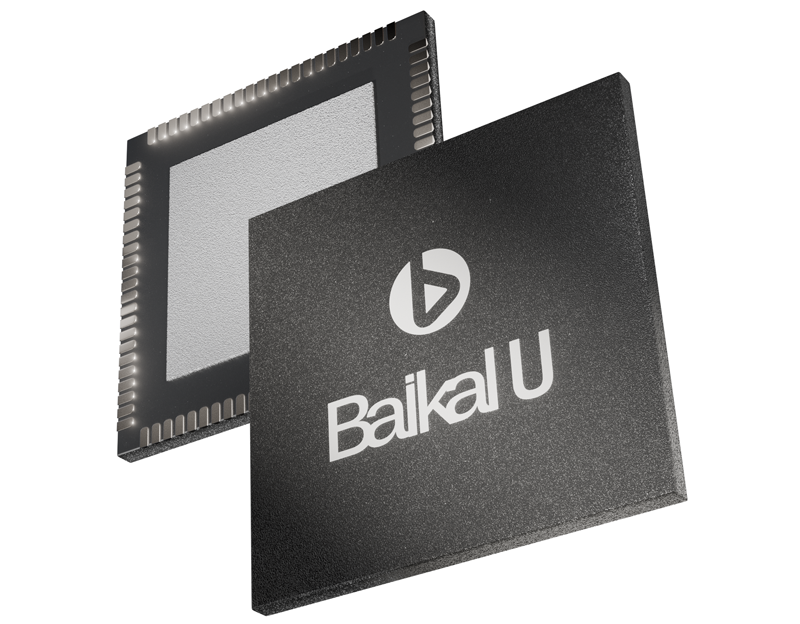

«Байкал Электроникс» открыл свободный доступ к документации на серийный микроконтроллер Baikal-UРоссийский разработчик микропроцессоров «Байкал Электроникс» запустил публичный портал, содержащий полный комплект документации на серийный микроконтроллер Baikal-U (BE-U1000). На площадке представлены сведения технического характера, принципиальные схемы, чертежи печатных плат, SDK, API и прочая информация для разработчиков устройств на базе упомянутого изделия. BE-U1000 представляет собой трёхъядерный 32-бит микроконтроллер общего назначения, в основу которого положена архитектура RISC-V. Характеристики устройства позволяют применять его в индустрии интернета вещей, автоматизированных системах управления технологическими процессами, машиностроении, робототехнике, промышленной автоматике, управлении электродвигателями и других отраслях. Изделие включено в реестр Минпромторга РФ и подходит для программ импортозамещения, а также государственных закупок.

Микроконтроллер Baikal-U (источник изображения: baikalelectronics.ru) По словам компании «Байкал Электроникс», размещённая в открытом доступе документация призвана упростить процесс разработки аппаратных решений на базе отечественного микроконтроллера Baikal-U, сократить время интеграции и сделать работу удобной для инженерных команд, технологических партнёров, сообществ разработчиков и образовательных проектов.  Портал будет регулярно обновляться и дополняться — планируется публикация новых практических примеров применения Baikal-U и прикладных заметок, а также дальнейшее улучшение пользовательского опыта при работе с продуктами компании.

03.02.2026 [14:45], Руслан Авдеев

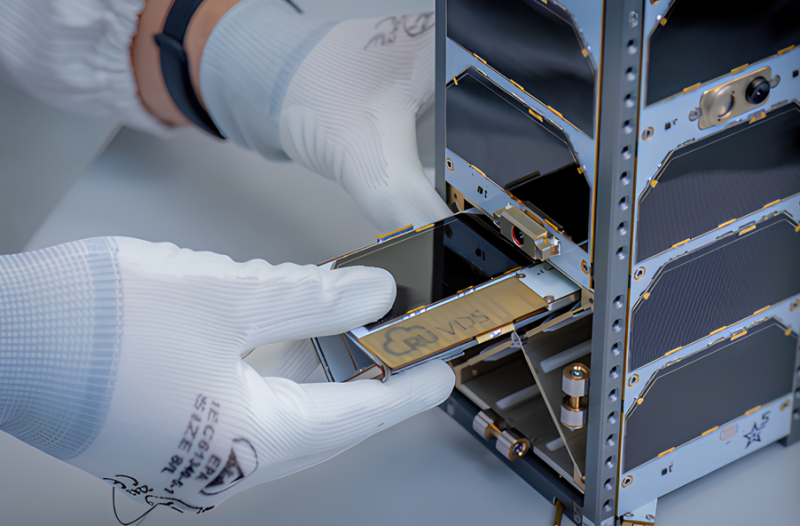

Спутник-платформа RuVDS для разработки космического ПО успешно выведен на орбитуРазработанный ОКБ «Пятое поколение» (АО «ОКБ5») материнский космический аппарат Mule 4T успешно вывел на орбиту спутник-платформу RUVDSSat1 российского хостинг-провайдера RuVDS, предназначенную для тестирования ПО в космосе и выполнения других испытательных задач. Все спутники формата TriSAT, в том числе RUVDSSat1, управляются ОКБ с Земли. Пуск всех аппаратов TriSAT состоялся 28 декабря 2025 года с помощью ракеты-носителя «Союз-2.1б». С этого дня до начала февраля RUVDSSat1 был пристыкован к Mule 4T и функционировал в сервисном режиме. После расстыковки с материнским аппаратом руководство проекта начало испытания аппаратов в самостоятельном полёте. По словам главы RuVDS, с февраля начался самостоятельный орбитальный этап проекта — цель первого этапа достигнута, на орбиту доставлены «лучшие статьи техноэнтузиастов». На следующих этапах планируется предоставить разработчикам ПО для спутников доступ к RUVDSSat1. Пока проводится подготовка, после неё аппарат начнёт выполнять обязанности «спутника-платформы». Расчётный срок службы аппарата RUVDSSat1 составляет 1 год. По словам ОКБ «Пятое поколение», пуск можно назвать успешным в полной мере, поскольку Mule 4T штатно вывел нагрузку на целевые орбиты. Принадлежащий RUVDS спутник перешёл к автономной работе и лётных испытаний. Пока ОКБ ожидает подтверждения лётных характеристик по результатам программы испытаний. Возможные отклонения параметров и режимов, получив телеметрию, проанализирует наземная команда. Миссия, в рамках которой планируется реализовать несколько инициатив, направленных на отработку перспективных IT-решений для космоса, носит научно-исследовательский характер. Компания RuVDS известна необычными проектами. Например, ещё в 2024 году сообщалось, что она развернёт ЦОД на дрейфующей льдине в Арктике, сбросив оборудование с борта самолёта. Летом 2025 года она запустила виртуальный ЦОД на мощностях «Ростелекома» в Заполярье. А свой первый т.н. тайнисат компания запустила в 2023 году.

03.02.2026 [12:31], Руслан Авдеев

Индия объявила 20 лет налоговых каникул для гиперскейлеров, использующих местные ЦОД для обслуживания зарубежных облачных клиентовИндия анонсировала 20 лет налоговых льгот для гиперскейлеров, использующих дата-центры, расположенные в стране, для обслуживания клиентов со всего мира, сообщает CNBC. Предполагается, что такое предложение может привлечь связанные с ИИ бизнесы в активно развивающийся регион. Правда, стремление многих стран к цифровому суверенитету может помешать этим планам. По словам экспертов, стоимость инфраструктуры ЦОД в Индии и без того невысока, а в совокупности с налоговыми каникулами использование индийских ЦОД для гиперскейлеров станет ещё привлекательнее в сравнении с хабами в Сингапуре, ОАЭ и Ирландии. По мнению экспертов, это изменит положение Индии — она станет не только «рынком потребления» услуг ЦОД, но и глобальным хабом для облачных и ИИ-вычислений. Пока же гиперскейлеры сталкиваются со значительными рисками, связанными с корпоративными налогами, если имеют в Индии «значительное экономическое присутствие». Сегодня работа ЦОД иностранных гиперскейлеров в Индии рассматриваются как «постоянное представительство», а прибыль от этой деятельности облагается налогом в 35 %, не считая дополнительных сборов. Теперь облачные сервисы, предоставляемые зарубежными гиперскейлерами с использованием дата-центров, принадлежащих местным застройщикам и управляемых ими же, будут пользоваться налоговыми каникулами до 2047 года. Ожидается, что это ускорит инвестиции в ЦОД. Пока роль Индии в мировой гонке ИИ была ограничена, поскольку стране недостаёт ИИ-моделей местного происхождения, производства чипов и больших ЦОД в сравнении с США и Китаем. Предложенные налоговые каникулы и инвестиции, которые они, вероятно, принесут, могут усилить роль Индии в глобальной гонке технологий искусственного интеллекта. Многие техногиганты уровня Microsoft уже анонсировали миллиардные инвестиции в местную ИИ-инфраструктуру. Ещё более крупные инвестиции готовит Amazon. Помимо попыток привлечь гиперскейлеров, Индия имеет большие амбиции в сфере ИИ-полупроводников, поощряя их разработку и производство в стране. Налоговые каникулы должны сыграть на руку местным IT-компаниям и облачным бизнесам вроде Infosys, Wipro, TCS, HCL Tech и Jio, равно как и местным строителям ЦОД. Среди выгодоприобретателей от налоговых каникул, вероятно, будет Google, совместно с местной AdaniConneX намеренная построить дата-центр за $15 млрд на территории нового ИИ-хаба на юге Индии. В последние годы спрос на ЦОД значительно вырос, в основном в связи с масштабированием ИИ-задач, требующих огромных вычислительных мощностей, электроэнергии, охлаждения и сетевой инфраструктуры. В глобальный рынок ЦОД в 2025 году вложили более $61 млрд. Сегодня мощность индийских ЦОД составляет около 1,2 ГВт, но в следующие пять лет рынок должен преодолеть отметку в 3 ГВт. Согласно январскому докладу JLL, мировая мощность ЦОД составила около 100 ГВт и должна удвоиться до 200 ГВт к 2030 году благодаря буму ИИ. В Индии считают, что налоговые каникулы уберут крупнейшее препятствие для выхода зарубежных гиперскейлеров на индийский рынок. По мнению экспертов, поскольку рынки Азиатско-Тихоокеанского региона уровня Японии, Австралии, Китая и Сингапура достигли «зрелости», а Сингапур, ко всему прочему, ещё и страдает от дефицита земли и других ресурсов, Индия может стать новым перспективным местом для развития инфраструктуры ЦОД. В стране много места для крупномасштабных строек ЦОД, а в сравнении с ИИ-хабами в Европе, цены на электричество довольно невысоки. С учётом растущих возможностей развития возобновляемой энергии, критической для питания дата-центров, модель индийского технологического рывка выглядит вполне убедительно. Как заявляют индийские эксперты, налоговые каникулы для зарубежных облачных компаний могут стать катализатором крупных глобальных инвестиций, увеличения экспортной выручки и приведут к созданию долгосрочных рабочих мест и других возможностей.

02.02.2026 [15:05], Руслан Авдеев

Oracle намерена взять в долг ещё $50 млрд на строительство ИИ ЦОД и уже выпустила новые облигации на $25 млрдУ инвесторов Oracle появился новый повод для беспокойства. Компания объявила о плане по привлечению $45–$50 млрд в 2026 году для расширения мощностей ИИ ЦОД, сообщает Silicon Angle. Облачный гигант объявил, что привлечёт заёмные средства и продаст часть акций. Это поможет удовлетворить спрос на вычислительные ресурсы со стороны OpenAI, Meta✴, AMD, NVIDIA, xAI, TikTok и др. Тем временем инвесторы всё настороженнее относятся к планам компаний осуществлять масштабные инвестиции в ИИ-инфраструктуру. Особенное беспокойство вызывает Oracle, взявшая немало кредитов для финансирования проектов ЦОД. После достижения рекордного максимума 10 сентября 2025 года акции компании показали рекордное же падение, упав более чем на 50 %. Это уже привело к сокращению рыночной капитализации компании более чем на $460 млрд. В минувшее воскресенье Oracle сообщила, что привлечёт половину необходимых средств за счёт выпуска ценных бумаг, обеспеченных акциями, а также обыкновенных акций, в т.ч. конвертируемых привилегированных акций, а также программы размещения акций на рынке. Вторую половину привлекут благодаря единовременному выпуску облигаций в начале 2026 года. В 2025 году компания уже привлекла $18 млрд за счёт выпуска корпоративных облигаций.

Источник изображения: Aneta Pawlik/unsplash.com Одна из проблем отношений инвесторов с Oracle в том, что способность компании гасить долги, вероятно, будет зависеть от успехов OpenAI, обязавшейся потратить $300 млрд на облачную инфраструктуру Oracle. Впрочем, несмотря на рыночную капитализацию в $500 млрд, OpenAI пока лишь теряет миллиарды долларов ежегодно и не обнародовала чёткого плана по получению прибыли в долгосрочной перспективе. Всё зависит от возможностей привлекать частное финансирование. Именно это стало причиной того, что многие инвесторы скептически относятся к планам Oracle. Ранее в январе 2025 года на компанию подала в суд группа держателей облигаций, утверждающих, что понесла значительные убытки из-за сокрытия Oracle факта необходимости продажи дополнительных долговых обязательств для развития парка ЦОД, уже на $38 млрд. Пока цена акций Oracle стремительно падает, инвесторы в панике скупают кредитные дефолтные свопы (CDS), т.е. фактически страховку от невыполнения компанией долговых обязательств. В результате стоимость страховки от дефолта компании стала самой дорогой за более чем пять лет — имеющие средства на финансирование этого бизнеса сомневаются в кредитоспособности компании. Впрочем, эксперты рынка не настолько обеспокоены расходами компании на инфраструктуру, поскольку рассчитывают на жизнеспособность её долгосрочных инвестиций независимо от дальнейшей судьбы OpenAI. В январе 2026 года, на фоне слухов о том, что один из ключевых инвесторов Blue Owl не стал финансировать ЦОД за $10 млрд в Мичигане, компания Constellation Research заявила, что Oracle, вероятно, сможет найти альтернативных инвесторов. Даже если случится худшее и OpenAI не справится с выполнением своих обязательств перед Oracle, вместо неё найдутся много покупателей мощностей из числа корпоративных клиентов. Заявляется, что корпоративные траты на ИИ больше не будут конкурировать с пользовательскими тратами на ИИ, цены на токены значительно снизятся, поэтому ИИ станет гораздо доступнее для всех. Корпоративные клиенты и облачные провайдеры только выиграют от роста бизнеса, это будет выгодно и для долгосрочных инвесторов. UPD 03.02.2026: в двух отдельных документах, поданных в Комиссию по ценным бумагам и биржам США (SEC), Oracle объявила о заключении соглашения о распределении акций на сумму $20 млрд и выпуске облигаций на сумму $25 млрд со сроком погашения в 2029 году. Попутно она публично прокомментировала слухи о возможных проблемах с OpenAI: «Сделка между NVIDIA и OpenAI никак не повлияет на наши финансовые отношения с OpenAI. Мы по-прежнему абсолютно уверены в способности OpenAI привлекать средства и выполнять свои обязательства».

02.02.2026 [15:00], Руслан Авдеев

Корпорация XxX: Илон Маск задумал объединить X, xAI и SpaceXНа минувшей неделе заключение сделок в сфере ИИ резко ускорилось. Судя по всему, речь может идти о начале периода высокой активности на соответствующем рынке и одним из ключевых игроков выступит Илон Маск (Elon Musk), строящий настоящую технологическую империю, сообщает Silicon Angle. Один из самых обсуждаемых сюжетов — возможное создание мультимиллиардером мегакорпорации из своих компаний. По данным нескольких СМИ, Маск раздумывает над возможностью объединения xAI, которой уже принадлежит соцсеть X, с космической компанией SpaceX с последующим выходом на IPO. Сама SpaceX намерена получить разрешение на размещение в космосе до миллиона дата-центров. В общую структуру может попасть и Tesla. По словам одного из инвесторов, потенциальная структура может считаться «Berkshire Hathaway XXI века». Тем временем Anthropic ищет всё новые источники финансирования. Компания обсуждает инвестиции на $20 млрд с Sequoia Capital, Coatue и, возможно, NVIDIA и Microsoft. OpenAI тоже ведёт переговоры с Amazon, NVIDIA, SoftBank и Microsoft о привлечении $60 млрд и больше, обсуждается и возможность выхода на IPO ближе к концу 2026 года. При этом The Wall Street Journal сообщает, что вероятное финансирование OpenAI компанией NVIDIA на $100 млрд приостановлено, хотя сам глава NVIDIA Дженсен Хуанг (Jensen Huang) это опровергает. Активное участие в связанных с искусственным интеллектом сделках начала принимать и компания Apple. Не так давно она приобрела израильский ИИ-стартап Q.ai приблизительно за $2 млрд — довольно крупное для её бизнес-концепции приобретение. Это косвенно свидетельствует об интересе Apple к ИИ-разработкам для носимых устройств, в чём нет ничего неожиданного. Впрочем, эксперты и участники рынка не устают предупреждать о рисках ИИ. Глава Anthropic Дарио Амодеи (Dario Amodei) выпустил длинное эссе, в котором пришёл к выводу, что человечество, вероятно, не готово к наступлению эры ИИ. Что касается более приземлённых прогнозов, аналитики IT-рынка Дэйв Велланте (Dave Vellante) и Эрик Брэдли (Erik Bradley) предполагают, что в 2026 году вложения в ИИ могут начать реально окупаться. При этом, по их мнению, традиционные модели SaaS, возможно, ожидают сложности, хотя некоторые компании вроде Snowflake могут стать исключениями. Наконец, ещё одна неутешительная новость — по их мнению, цены на оборудование, вероятно, продолжат расти. Главными бенефициарами гонки ИИ являются не столько разработчики систем искусственного интеллекта, сколько компании, поставляющие инструменты для них — Samsung, Sandisk, Western Digital, Seagate, ASML и др. отмечают высокий спрос на свои комплектующие, оборудование и сопутствующие технологии и чувствуют себя весьма уверенно. Про NVIDIA и говорить нечего. В то же время инвесторы охладели к акциям крупных поставщиков ПО корпоративного уровня. Ценные бумаги ServiceNow, SAP и Microsoft подешевели, несмотря на неплохие отчёты. В основном это происходит из-за инвесторов, которые опасаются, что ИИ заменит часть программных продуктов. Впрочем, Велланте предполагает, что крупные игроки смогут адаптироваться благодаря востребованности своих программ. Например, IBM сумела превзойти прогнозы Уолл-Стрит благодаря росту продаж ПО и инструментов для ИИ. С другой стороны, Amazon (AWS) объявила о намерении сократить ещё тысячи сотрудников. Предполагается, что такие меры будут приниматься не на поквартальной основе, но прекратится ли серия увольнений, можно будет увидеть уже через несколько месяцев. Oracle, несколько потерявшей доверие инвесторов, предлагается уволить 20–30 тыс. сотрудников и продать непрофильные активы. UPD: Маск подтвердил переговоры о слиянии SpaceX и xAI.

02.02.2026 [13:25], Руслан Авдеев

Microsoft заключила облачную сделку с Perplexity на $750 млн, но любимым провайдером ИИ-поисковика всё равно останется AWSИИ-стартап Perplexity заключил сделку с Microsoft на сумму $750 млн — компания будет использовать ресурсы облачного сервиса Azure. Тем самым она расширяет свой бизнес и более не полагается на единственного облачного партнёра в лице Amazon (AWS), сообщает Bloomberg. Perplexity основана в 2022 году, а после привлечения $200 млн в сентябре 2025 года её стоимость оценивалась в $20 млрд. Одним из значимых инвесторов компании является NVIDIA. По информации источников издания, соглашение сроком на три года позволит развёртывать ИИ-модели Perplexity с помощью сервиса Microsoft Foundry. Perplexity заявляет, что перенаправлять средства, предназначавшиеся для оплаты услуг AWS, не намерена. AWS останется «предпочтительным поставщиком» облачной инфраструктуры для Perplexity, в ближайшие недели планируется даже расширение этого партнёрства. На сегодня Perpexity является одним из наиболее высоко оцениваемых ИИ-стартапов, но ему приходится жёстко конкурировать с Google и OpenAI в нише поиска информации в интернете. Кроме того, компания привлекла намного меньше капитала, чем OpenAI и Anthropic, в последнее время активно развивающих инфраструктуру. Крупные бизнесы обычно арендуют доступ к облакам у нескольких провайдеров, получая доступ к уникальным услугам и ограничивая зависимость от единственного поставщика. В эру ИИ это особенно актуально, поскольку приходится экспериментировать с новыми инструментами.

Источник изображения: Microsoft/Perplexity Значительная часть бизнеса Perplrexity построена на платформе AWS и сервисе Amazon Bedrock для доступа к ИИ-моделям Perplexity. В 2023 году компания сообщила о полном переходе на облачные решения Amazon, а последняя называет Perplexity одним из ключевых клиентов в сфере ИИ. Однако недавно компании ввязались в судебную тяжбу. Amazon подала иск против Perplexity, давшей возможность делать покупки на маркетплейсе Amazon с помощью своего ИИ-агента Comet, что создаёт конкуренцию продуктам самой Amazon. Perplexity назвала действия Amazon «угрозой выбору пользователей» и подчеркнула, что компания вложила в AWS «сотни миллионов» долларов. Что касается Microsoft, сделка позволит укрепить позиции Azure в качестве платформы для создания ИИ-приложений и развёртывания моделей разных поставщиков. Например, Microsoft долгое время эксклюзивно предлагала доступ к моделям OpenAI, а в ноябре заключила аналогичное соглашение с Anthropic. Microsoft объявила, что клиенты рассчитывают на использование нескольких моделей в рамках любой рабочей нагрузки, а компания предлагает «самый широкий выбор моделей» среди крупных поставщиков соответствующих услуг. Утверждается, что более 1,5 тыс. клиентов Microsoft Foundry прибегают к помощи моделей OpenAI и Anthropic. По данным Microsoft, число клиентов, тратящих в квартал более $1 млн, к концу прошлого года выросло квартал к кварталу на 80 %. Новость о сделке появилась вскоре после публикации квартального финансового отчёта Microsoft. Хотя бизнес растёт и в сегменте облачных вычислений, инвесторы обеспокоены большими капитальными затратами на ИИ-инфраструктуру, а также тем, что значительная часть обязательств компании приходится на единственный бизнес — OpenAI.

02.02.2026 [11:13], Сергей Карасёв

Hitachi Vantara: устаревшая инфраструктура данных оборачивается $108 млрд неэффективных инвестиций в ИИИсследование, проведённое компанией Hitachi Vantara, говорит о том, что устаревшая инфраструктура хранения и обработки данных оказывает негативное влияние на реализацию ИИ-проектов. В частности, по этой причине неэффективными в глобальном масштабе оказываются до $108 млрд инвестиций в ИИ-сфере в год. Инфраструктурные недостатки мешают 58 % организаций в США и Канаде извлечь выгоду из использования ИИ. В опросе приняли участие более 1200 руководителей высшего звена, включая глав IT-подразделений, из 15 стран, в том числе 307 респондентов из США и Канады. Около 84 % этих предприятий заявили о слишком быстром повышении сложности их инфраструктуры данных, что мешает управлению. Более половины — 57 % — опрошенных утверждают, что это затрудняет выявление утечек информации. А 59 % опасаются, что критическая потеря данных будет катастрофической для их компании. Как показало исследование, 98 % организаций используют, тестируют или оценивают ИИ, однако возможности предприятий в плане масштабирования таких проектов и получения выгоды от них значительно различается. В США и Канаде 42 % компаний считаются зрелыми в плане работы с данными. Вместе с тем 58 % организаций сталкиваются с различными трудностями, включая структурные недостатки и сложности с автоматизацией. Примерно 84 % респондентов, чьи компании обладают высоким уровнем зрелости в области работы с данными, сообщили об измеримой рентабельности инвестиций в ИИ по сравнению с 48 % предприятий, отстающих в соответствующей области. Одним из ключевых факторов успеха при реализации ИИ-проектов является качество данных: об этом заявили 59 % респондентов. Среди организаций с развитой инфраструктурой данных 59 % говорят, что ИИ имеет решающее значение для их бизнеса, против всего 18 % среди компаний с более слабой базой. О внедрении средств автоматизации в таких группах предприятий сообщили соответственно 65 % и 27 % опрошенных, о наличии отказоустойчивой архитектуры — 82 % и 19 %.

02.02.2026 [10:17], Руслан Авдеев

Ещё один криптомайнер отказывается от биткоинов в пользу ИИ — Bitfarms переоборудует свои ЦОД под NVIDIA Vera RubinКриптомайнинговая компания Bitfarms готовится к упразднению бывшего объекта для майнинга биткоинов в штате Вашингтон — он будет переделан в HPC/ИИ ЦОД, сообщает Datacenter Dynamics. Обновлённый объект, как ожидается, будет готов к декабрю 2026 года, он пополнит растущее число дата-центров, пользующихся прохладным климатом и относительно низкими региональными ценами на электроэнергию. Объект Bitfarms на площади около 2,4 га получит ЦОД уровня Tier III площадью до 9290 м2, а также офисные помещения. По словам представителя Bitfarms, компания продолжает реализацию стратегии инфрастурктурного развития для HPC и ИИ, а в её распоряжении — полностью профинансированная цепочка поставок. Объект в Вашингтоне планируется оборудовать для использование ИИ-ускорителей NVIDIA GB300 с СЖО. Подключенная мощность объекта составляет 18 Мт и таковой, вероятно, и останется. Компания подчёркивает, что основная задача — развитие инфраструктуры для поддержки ускорителей Vera Rubin нового поколения в большей части её портфолио. Для этого доступны почти $1 млрд наличных средств, неиспользованные кредитные линии, биткоины и другие варианты финансирования. Bitfarms планирует свернуть майнинговые операции в следующие два года и уже назначила ответственного за переоборудованием объектов в США, Канаде и Аргентине. Например, мощность объекта в Шэроне (Sharon, США) вырастет с 30 МВт до 110 МВт.

Источник изображения: Bitfarms Изменить стратегию Bitfarms пришлось после того, как компания отчиталась о чистых убытках в объёме $46 млн в III квартале 2025 года. Тогда руководство компании заявило, что ИИ-инфраструктура обещает гораздо большую отдачу, чем криптомайнинг. Хотя доля объекта в Вашингтоне составляет менее 1 % от общего портфолио компании, её руководство полагает, что одно лишь его преобразование для предоставления GPUaaS потенциально может принести больше чистого операционного дохода, чем компания когда-либо получала в результате майнинга биткоинов. Это не единственная майнинговая компания, отказывающаяся от своей основной деятельности в последнее время. Буквально на днях появились новости о том, что Riot Platforms сменит профиль и сдаст AMD 25 МВт мощностей ЦОД.

02.02.2026 [09:19], Сергей Карасёв

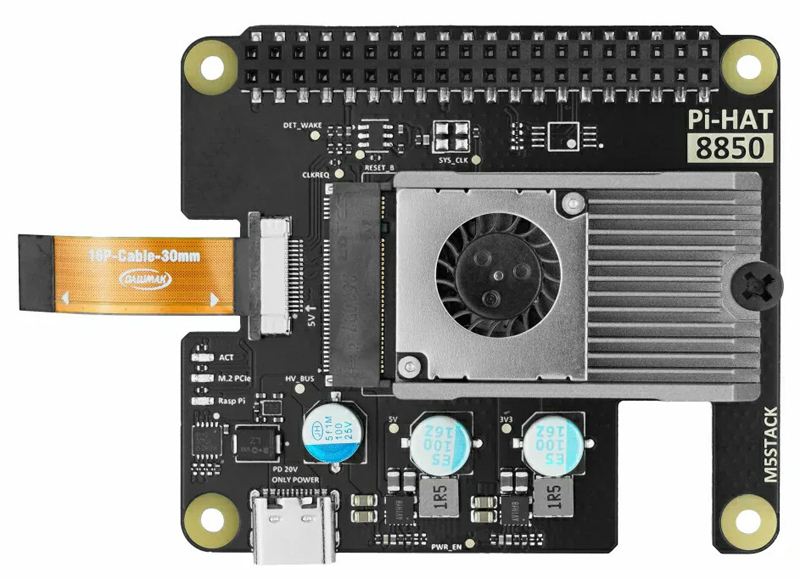

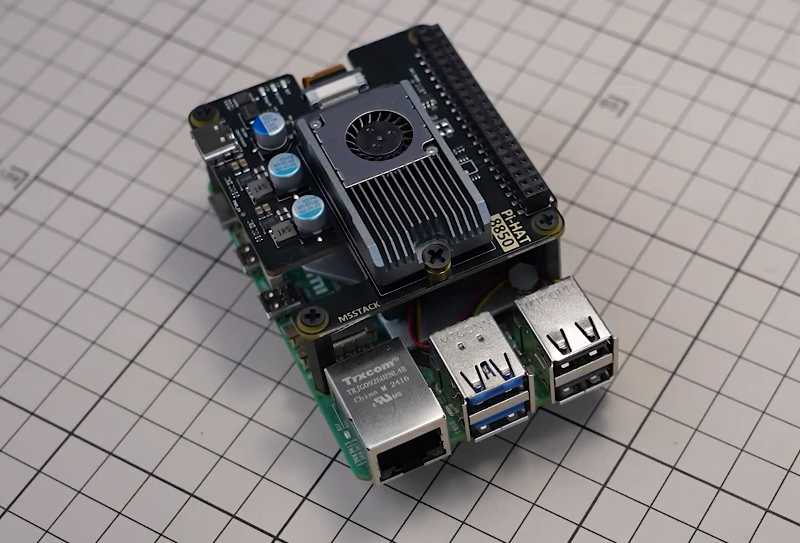

Карта на прибавление «ума»: M5Stack выпустила для Raspberry Pi 5 ИИ-ускоритель с 8 Гбайт RAMКомпания M5Stack, по сообщению CNX Software, выпустила комплект AI-88502 LLM Accelerator M.2 Kit — это ИИ-ускоритель для одноплатного компьютера Raspberry Pi 5, предназначенный для работы с большими языковыми моделями (LLM) и приложениями машинного зрения. Новинка представляет собой альтернативу изделию Raspberry Pi AI HAT+ 2. Основой анонсированного решения служит модуль M5Stack LLM-8850 формата M.2 M-Key 2242 с интерфейсом PCIe 2.0 x2. Он оснащён чипом Axera AX8850 с восемью ядрами Cortex-A55 с частотой 1,7 ГГц и нейропроцессорным узлом (NPU), обеспечивающим ИИ-производительность до 24 TOPS на операциях INT8. Встроенный VPU-блок предоставляет возможность кодирования и декодирования видеоматериалов H.264/H.265 в формате 8К со скоростью соответственно 30 и 60 к/с. В оснащение входят 8 Гбайт LPDDR4x-4266. Модуль имеет размеры 42,6 × 24,0 × 9,7 мм и весит 14,7 г. Максимальное энергопотребление — 7 Вт.

Источник изображений: CNX Software Изделие M5Stack LLM-8850 устанавливается на плату-адаптер Pi HAT 8850. Она оснащена 16-контактным коннектором FFC PCIe 2.0/3.0 x1 и 40-контактной колодкой GPIO. Питание 9/12/20 В подаётся через разъём USB Type-C PD 3.0. Габариты платы составляют 65,0 × 58,0 × 12,7 мм, масса — 31,9 г. Диапазон рабочих температур простирается от 0 до +60 °C. В комплект также входят кулер с вентилятором и радиатором для охлаждения модуля М.2 и крепёж для монтажа на одноплатный компьютер Raspberry Pi 5.  Набор M5Stack AI-88502 LLM Accelerator M.2 Kit предлагается по цене $215. Заявлена возможность использования следующих ИИ-моделей:

|

|