Материалы по тегу: software

|

26.07.2025 [14:55], Сергей Карасёв

В Европе запущена первая метаоблачная ИИ-платформа Fact8raКомпания OpenNebula Systems объявила о запуске Fact8ra — это, как утверждается, первая в Европе платформа «ИИ как услуга» (AI-as-a-Service) на основе мультиоблачной архитектуры. Инициатива является важным этапом на пути формирования европейской суверенной инфраструктуры ИИ. Любопытно, что в Китае создаётся похожая платформа, но по совсем иным причинам — в результате не слишком удачного планирования значительная часть вычислительных мощностей простаивает без дела. Система Fact8ra предлагает многопользовательскую среду для развёртывания частных экземпляров больших языковых моделей (LLM) с открытым исходным кодом. Платформа объединяет НРС-мощности, публичное облако и периферийные ресурсы по всему ЕС. Fact8ra основана на суверенном облачном стеке ИИ, включающем решения OpenNebula, а также другие европейские технологии open source, такие как openSUSE и MariaDB. Поначалу Fact8ra объединит GPU-серверы в восьми странах ЕС: Франции, Германии, Италии, Латвии, Нидерландах, Польше, Испании и Швеции. Отмечается, что Fact8ra способна агрегировать ресурсы поставщиков публичных облачных сервисов, периферийных площадок, суперкомпьютерных центров и финансируемых ЕС фабрик ИИ. В частности, будут объединены мощности Arsys, CloudFerro, IONOS, Leaseweb, OVHcloud, Scaleway, StackScale и Tiscali. Говорится о расширенной поддержке ИИ-ускорителей NVIDIA. Fact8ra поддерживает работу с различными LLM, включая Mistral Nemo 12B, EuroLLM 9B, Salamandra 7B и Italia 9B. Кроме того, реализована интеграция с внешними каталогами ИИ-моделей, в том числе Hugging Face. Поначалу пользователям будут доступны возможности инференса, а затем появятся функции тонкой настройки и обучения моделей ИИ. Fact8ra реализуется как часть программы IPCEI-CIS (Important Project of Common European Interest on Next Generation Cloud Infrastructure and Services) — это европейский проект развития облачной инфраструктуры и услуг следующего поколения. Инициатива стоимостью €3 млрд была одобрена Европейской комиссией в декабре 2023 года. Проект поддерживается 12 государствами-членами ЕС и более чем 120 индустриальными партнёрами. Целями являются стимулирование исследований и увеличение инвестиций в технологии периферийных и облачных вычислений в ЕС, а также создание децентрализованной периферийной инфраструктуры. Ранее в рамках IPCEI-CIS была анонсирована суверенная облачная платформа Virt8ra.

25.07.2025 [23:35], Андрей Крупин

ВТБ провёл крупнейшее в России импортозамещение системы управления знаниямиВТБ, второй по величине банк в РФ по размеру активов, сообщил о реализации масштабного проекта в области импортозамещения программного обеспечения. Речь идёт о замене зарубежной системы управления знаниями на российский продукт «Плюс7 Маяк», разработанный компанией DIS Group и зарегистрированный в реестре отечественного ПО. Система управления знаниями «Плюс7 Маяк» предназначена для повышения эффективности внешних коммуникаций и внутрикорпоративных взаимодействий. В основу платформы положена постоянно обновляемая база информации и интерфейсы интеграции с внешними системами, включая CRM, телефонию, корпоративный веб-сайт, чат-боты и другие компоненты. Решение может использоваться для оптимизации работы контакт-центра, создания бизнес-википедии для повышения внутренней эффективности или создания справочника для работников продаж. В инфраструктуре ВТБ программный комплекс «Плюс7 Маяк» обеспечивает работу 53 тысяч сотрудников банка, обслуживающих более 26 млн клиентов.

Источник изображения: Nathan Dumlao / unsplash.com «Переход на отечественное решение повысил производительность и ускорил обслуживание клиентов за счёт более оперативного предоставления информации и ответов сотрудниками банка. Обновление системы прошло без простоев и сбоев и не отразилось на качестве обслуживания пользователей услуг», — отметил руководитель департамента технологического развития общебанковских систем ВТБ Никита Рыбченко. «Для нашей команды было важно, чтобы новая система не просто работала, а действительно повышала эффективность сотрудников в ежедневном взаимодействии с клиентами. Сейчас для специалистов реализована единая точка входа для поиска накопленных знаний банка, всей информации о продуктах, услугах, акциях, внутренних и клиентских процессах, часто задаваемых вопросах и ответах. Это особенно важно для тех, кто работает с клиентами ежедневно», — подчеркнула руководитель департамента анализа, координации и продуктового развития ВТБ Юлия Копытова. ВТБ активно занимается реализаций программ в сфере импортозамещения. В 2021–2024 гг. общие расходы банка в данном направлении составили 90 млрд рублей, в первую очередь речь идёт о расходах на программное обеспечение. Одним из важных и масштабных шагов на пути отказа от зарубежного ПО стал переход финансовой организации на российскую ОС Astra Linux, а также миграция с офисных продуктов Microsoft на российский «МойОфис». В инфраструктуре ВТБ задействованы многие другие решения отечественных разработчиков, среди которых — система резервного копирования RuBackup, VDI-инструменты компании «Базис», СУБД Postgres Pro Enterprise и прочий софт.

25.07.2025 [22:24], Андрей Крупин

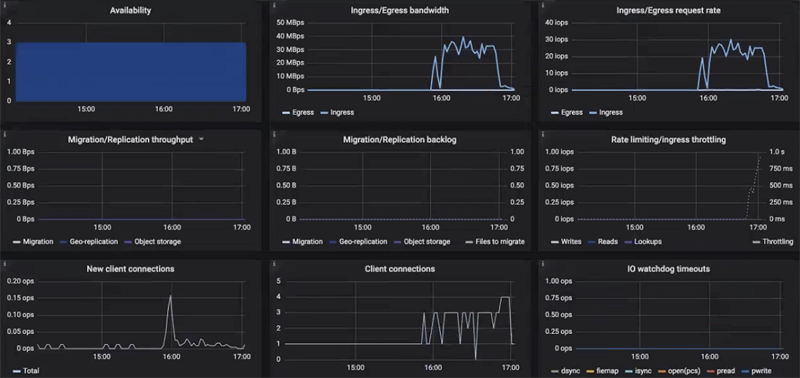

Вышел релиз обновлённого «Кибер Хранилища» с массой оптимизаций для работы с кластерами S3Российская компания «Киберпротект», занимающаяся разработкой систем резервного копирования, защиты от утечек данных (DLP) и инфраструктурного программного обеспечения, сообщила о выпуске новой версии программно-определяемого хранилища данных «Кибер Хранилище» 6.7. «Кибер Хранилище» представляет собой готовое решение для создания многоцелевой инфраструктуры хранения данных на основе стандартного серверного оборудования x86 с любыми типами накопителей (HDD, SSD, NVMe). Продукт позволяет развернуть несколько пулов хранения с разными показателями производительности и стоимости хранения, объединённых централизованными инструментами управления и мониторинга. Безопасность хранимых данных обеспечивается ролевой моделью, защищённым доступом к инструментам администрирования и средствами шифрования файлов. «Кибер Хранилище» создано в РФ, включено в реестр российского ПО и совместимо со всеми серверными платформами отечественного производства, что позволяет создавать программно-аппаратные комплексы, удовлетворяющие требованиям регуляторов по безопасности и импортозамещению.

Средства мониторинга программного комплекса «Кибер Хранилище» (источник изображения: cyberprotect.ru) В релизе «Кибер Хранилища» 6.7 реализована функциональность, обеспечивающая возможность доступа под одним доменным именем (FQDN) к системе кластеров, работающих в режиме георепликации. Это позволяет сделать любое приложение, использующее S3-хранилище, катастрофоустойчивым без использования специализированных балансировщиков. В дополнение к этому был упрощён процесс развёртывания крупных кластеров S3. Теперь «Кибер Хранилище» обеспечивает возможность задавать целевое число экземпляров сервисов и автоматически распределяет их по узлам кластера. Такой подход упрощает поэтапное развёртывание в крупных инсталляциях, помогая избегать некорректного размещения избыточного числа экземпляров сервисов на отдельных узлах. Среди прочих улучшений — возможность автоматизированного обновления системы для закрытых контуров, средства сбора диагностической информации о состоянии сервисов объектного хранилища S3 и инструменты автоматического восстановления работы хранилища при массовом выходе из строя оборудования хранения кластера S3, увеличенная производительность операций чтения/записи данных индекса за счёт избыточного кодирование данных и репликации индекса. Также проведены работы по поддержке высокопроизводительного аппаратного обеспечения и современных технологий его использования, в частности сетевых карт Chelsio и технологии Intel VROC.

25.07.2025 [15:29], Владимир Мироненко

400 жертв уязвимости в Microsoft SharePoint — лишь верхушка айсбергаНесмотря на призывы Microsoft к пользователям платформы SharePoint Server установить свежие обновления софта для защиты от вируса-вымогателя Warlock, который может быть внедрён в их системы через цепочку уязвимостей ToolShell, не все компании выполнили это и по-прежнему остаются беззащитными перед хакерами, передаёт Computer Weekly. 19 июля 2025 года Центр реагирования на угрозы безопасности Microsoft (MSRC) опубликовал в блоге сообщение, посвящённое активным атакам, использующим уязвимости CVE-2025-49706 и CVE-2025-49704, которые затрагивают только on-premise серверы SharePoint, но не затрагивают SharePoint Online в Microsoft 365. Microsoft сообщила, что выпустила новые комплексные обновления безопасности для всех поддерживаемых версий SharePoint Server (Subscription Edition, 2019 и 2016), которые защищают от этих и новых уязвимостей CVE-2025-53770 и CVE-2025-53771. Microsoft рекомендует немедленно установить апдейты. «Лаборатория Касперского» обнаружила, что новые уязвимости связаны с уязвимостью CVE-2020-1147, которая была обнаружена в 2020 году и, по-видимому, не была корректно закрыта. По словам Глобального центра исследования и анализа угроз в «Лаборатории Касперского» (Kaspersky GReAT), эксплойт для CVE-2020-1147 похож на эксплойт ToolShell. Ранее компания заявила, что среди тех, кто эксплуатировал уязвимости, были выявлены якобы поддерживаемые правительством Китая группировки Linen Typhoon и Violet Typhoon, а также пока не классифицированная группировка Storm-2603, которая в прошлом демонстрировала связи с группировками, занимающимися вирусами-вымогателями, такими как LockBit. Ряд кибератак на пользователей SharePoint Server был связан с использованием программ-вымогателей. Установив связь с Warlock, Microsoft обновила информацию об атрибуции, индикаторах компрометации (IoC), рекомендациях по смягчению последствий и защите, а также об обнаружении и поиске угроз. По данным Shadowserver Foundation, по состоянию на 23 июля в Великобритании доступны через интернет около 600 экземпляров SharePoint, а в мире их число приближается к 11 тыс. Около 424 экземпляров SharePoint имеют уязвимости безопасности CVE-2025-53770 и CVE-2025-53771. Примерно четверть их находится в США. В заявлении Национального центра кибербезопасности Великобритании (NCSC) указано, что Microsoft и NCSC осведомлены о существовании эксплойта наблюдают активные атаки, направленные на SharePoint Serve. Кевин Робертсон (Kevin Robertson), главный технический директор компании Acumen Cyber, специализирующейся на управляемом обнаружении и реагировании (MDR), заявил, что отсутствие исправлений для ранее обнаруженных уязвимостей CVE-2025-49704 и CVE-2025-29706, которые бы полностью устранили предыдущие проблемы, оставило организации полностью беззащитными. Он отметил, что публичные данные о 400 скомпрометированных жертвах могут быть каплей в море. Кроме того, не все организации ещё успели установить патч, а значит, их среды по-прежнему полностью уязвимы.

24.07.2025 [17:30], Руслан Авдеев

Покупку VMware компанией Broadcom за $61 млрд пытаются оспорить в ЕвросоюзеХотя со времён покупки VMware за $61 млрд прошло довольно много времени, а сама сделка подверглась тщательной проверке со стороны регуляторов, у Broadcom могут возникнуть новые проблемы. Как сообщает Bloomberg, ассоциация европейских облачных операторов Cloud Infrastructure Service Providers in Europe (CISPE) подала иск в Европейский суд общей юрисдикции, утверждая, что Еврокомиссия не выдвинула никаких условий, мешающих Broadcom злоупотреблять доминирующим положением на рынке. CISPE, куда входят AWS и Microsoft, заявила, что била тревогу, обращаясь в антимонопольные органы Евросоюза в связи с неблаговидными методами работы Broadcom, но «никаких существенных мер» для решения этих проблем предпринято не было. В результате сделки Broadcom получила контроль над ПО VMware для виртуализации, основным инструментом, используемым многими облачными компаниями. В CISPE утверждают, что после сделки Broadcom повысила цены на ПО и ввела ограничения на лицензирование, превратив ключевой инструмент в жёстко контролируемый продукт. CISPE заявляет, что доминирование ПО VMware на рынке виртуализации означает, что новые условия лицензирования Broadcom затрагивают практически всех европейских облачных операторов и их пользователей. Год назад CISPE прямо говорила, что новая лицензионная политика Broadcom грозит банкротством небольшим облачным провайдерам. Когда Еврокомиссию предупреждали о такой возможности, она бездействовала, и теперь ей необходимо пересмотреть своё решение.

Источник изображения: VMware В ближайшем будущем расположенный в Люксембурге суд вынесет решение о том, следует ли регуляторам пересмотреть решение об одобрении покупки. До завершения сделки в ноябре 2023 года компаниями пришлось заручиться согласиями регуляторов Евросоюза, Великобритании, Южной Кореи, Японии, Китая и других юрисдикций. Выдвинутые Китаем условия для одобрения были особенно жёсткими — в частности, требовалось обеспечение совместимости серверного ПО VMware с оборудованием конкурентов компании Broadcom. В декабре 2023 года европейские регуляторы одобрили сделку, отметив, что Broadcom предложила «всеобъемлющие» обязательства в части доступности и совместимости. Эти обязательства развеяли потенциальные опасения антимонопольных органов. Впрочем, после закрытия сделки поведение Broadcom оказалось под вопросом. Компания разрывала действующие контракты и вводила новые условия лицензирования. Компания также начала оказывать давление на крупных заказчиков, в том числе европейских. В CISPE считают, что всё это нанесло серьёзный ущерб европейским пользователям облачных сервисов. Впрочем, это только одна сторона истории — Евросоюз готов признать, что отказаться от американских облаков «почти невозможно». В июле 2024 года Microsoft заключила с CISPE соглашение, обязывающее её выплатить €20 млн ($21,7 млн) и разработать продукт Azure Local, который позволит членам CISPE запускать ПО Microsoft на своих платформах по ценам, эквивалентным ценам в облаке самой Microsoft. Однако Microsoft не смогла выполнить условия сделки. Взамен Microsoft позволит предлагать своё ПО на условиях оплаты по факту использования через программу CSP-Hoster (CSP-H), которая будет иметь «ценовые условия, более соответствующие условиям Microsoft Azure». Кроме того, Microsoft 365 Local теперь можно будет развернуть в европейской облачной инфраструктуре, причём участники CISPE более не обязаны предоставлять Microsoft данные о своих клиентах. Предложение доступно членам CISPE и поставщикам, которые присоединятся к CISPE в ближайшие месяцы. Однако гиперскейлерам и ряду других облачных поставщиков эта опция доступна не будет.

24.07.2025 [15:50], Руслан Авдеев

AWS закрыла ИИ-лабораторию в ШанхаеAmazon Web Services закрыла лабораторию, занимавшуюся разработками в сфере искусственного интеллекта в Шанхае (КНР). Речь идёт о центре Amazon Web Services AI Shanghai Lablet, открывшемся в 2018 году, сообщает The Financial Times. Сколько сотрудников работало в китайском подразделении, не уточняется. Бывший сотрудник лаборатории сообщил, что структура ликвидируется в связи со «стратегическими изменениями на фоне напряжённости в отношениях США и Китая». Предполагается, что в основном сотрудники занимались разработкой инструментов для ИИ и вопросами обработки естественного языка. По имеющимся данным, именно шанхайская лаборатория сыграла ключевую роль в создании open source инструмента Deep Graph — библиотека предназначалась для работы с графовыми нейросетями. Хотя ранее в этом месяце США отменили правила, запрещавшие NVIDIA и AMD поставлять в КНР ослабленные ИИ-ускорители, представители американских властей подчеркнули, что в будущем контроль за продажами таких чипов вновь может быть ужесточён. В новейшем программном документе Белого дома AI Action Plan рекомендуется «использовать творческие подходы к обеспечению экспортного контроля» и противостоянию с соперниками в целом уделяется немало внимания.

Источник изображения: Jerry Zhang/unsplash.com Также не исключается, что закрытие ИИ-лаборатории связано с недавней волной сокращений в AWS по собственной инициативе, которая коснулась «как минимум сотни» должностей. Вероятно, это коснулось и подразделения AWS, занимающегося обучением и сертификацией. Как сообщал представитель Amazon, после тщательного анализа деятельности организации, её приоритетов и целей на будущее принято трудное бизнес-решение о ликвидации некоторых ролей в командах AWS. Сокращают работы над ИИ в Китае и некоторые другие компании. Ранее сообщалось, что консалтинговая McKinsey & Co. приказала местному подразделению воздержаться от проектов, связанных с системами генеративного ИИ. В китайском подразделении работают более 1 тыс. сотрудников. В начале марта появилась информация, что IBM закроет в стране R&D-центр, оставив без работы 1,8 тыс. сотрудников. Впрочем, IBM поспешила заверить, что не уходит из КНР. В 2025 году Microsoft предложила «релокацию» 700–800 сотрудникам в Китае. По данным СМИ, речь идёт о специалистах в сфере ИИ и облаков. По некоторым расчётам, это около 10 % от общего числа сотрудников в филиале, относящемся к Азиатско-Тихоокеанскому региону, в основном действующем в Китае. Предполагается, что ранее компания уже закрыла лабораторию IoT and AI Insider Lab в Шанхае. С 2017 года такие центры по всему миру в основном помогают клиентам компании создавать подключенные устройства с ИИ-функциями. Буквально на днях представитель Microsoft заявил о смене политики в отношении госзаказчиков из Минобороны США — теперь ни одна инженерная команда из Китая не будет оказывать техподдержку облаку Пентагона и связанным сервисам. Дело в том, что Microsoft, как оказалось, передавала данные из Пентагона на аутсорс китайским коллегам.

24.07.2025 [14:31], Руслан Авдеев

От атак на Microsoft SharePoint уже пострадали более 400 организаций, включая атомщиков СШАEyeSecurity, первой сообщившая о массовой эксплуатации уязвимости нулевого дня ToolShell в Microsoft SharePoint в прошлую пятницу, поделилась новыми данными. По её сведениям, число жертв продолжающихся атак превысило 400 организаций, включая, например, Министерство энергетики США, сообщает The Register. Компания сообщила об уязвимости ещё до того, как её существование подтвердили в Microsoft. 23 июля исследователи отчитались о регистрации четырёх волнах атак 17–19 июля, 21 июля начались «множественные волны». Пострадало в том числе и Министерстве энергетики США (DoE). По словам DoE, 18 июля уязвимость «оказала негативное влияние» как на само министерство, так и на Национальное управление по ядерной безопасности (NNSA), отвечающее за обслуживание ядерного оружия Америки. Благодаря широкому применению облачного решения Microsoft 365 и систем обеспечения кибербезопасности высокой эффективности пострадали лишь немногие системы. Все системы DoE восстанавливаются, а NNSA принимает необходимые меры для снижения рисков и переходит на другие решения, если это нужно. Как свидетельствуют данные Check Point Research, от атак пострадали и другие правительственные учреждения и важнейшие правительственные системы, от телекоммуникаций до программного обеспечения. По оценкам компании, 7 июля одной из первых жертв атак стало «крупное западное правительство».

Источник изображения: Unspalsh/Unsplash.com Уязвимости касаются SharePoint Enterprise Server 2016, SharePoint Server 2019 и SharePoint Server Subscription Edition. Microsoft впервые подтвердила наличие уязвимостей поздно вечером 19 июля, заявив, что компании «известно об активных атаках на on-premise развёртывания SharePoint Server с использованием уязвимостей, частично устраненных в июльском обновлении безопасности». К вечеру 21 июля вышли обновления для всех трёх продуктов. Патчи блокируют возможность удалённого выполнения кода CVE-2025-53770, связанную с ранее известной уязвимостью CVE-2025-49704, а также с уязвимостью CVE-2025-53771, которая открывает доступ к ещё одному известному ранее багу CVE-2025-49706. Объединение уязвимостей позволяет злоумышленникам обходить процесс аутентификации и удалённо исполнять вредоносный код по сети. На GitHub был опубликован пример такой атаки. Некоторые пострадавшие компании теперь атакованы зловредом Warlock. Google и Microsoft обвинили в атаках китайских кибершпионов и похитителей данных, а недавно Редмонд предупредил, что эксплойтами могут воспользоваться и другие злоумышленники. Компания Microsoft пока не ответила на вопросы журналистов, в том числе о точном количестве организаций, подвергшихся атаке. В начале июля появилась информация о росте цен на продукты компании, включая SharePoint Server, хотя, в свете последний событий, цену следовало бы снизить.

23.07.2025 [17:20], Владимир Мироненко

Идея создания национального аналога SAP не нашла поддержки у бизнесаПредложение правительства о создании консорциума для разработки национальной ERP-системы, появившееся после сообщения о том, что «Севергрупп» до сих не удалось найти отечественную замену немецкой SAP, покинувшей Россию в 2022 году, не нашло поддержки у бизнеса, пишет РБК. Ранее против этой инициативы выступила «1С». На заседании правления Ассоциации предприятий компьютерных и информационных технологий (АПКИТ), которая включает крупнейшие компании по разработке и внедрению ПО, дистрибуции и системной интеграции, пришли к выводу о нецелесообразности расходования государственных средств на создание национальной ERP, когда на рынке уже имеются зрелые решения. К тому же это противоречит политике правительства, предложившего ранее механизм «рынок в обмен на инвестиции», когда компании инвестируют средства в доработку своих программ в обмен на упрощение процедуры госзакупок. Представитель Минцифры сообщил РБК, сейчас формируется состав участников нового консорциума, который должен выявить проблемы, мешающие переходу на российские ERP, предложить пути их преодоления и сказать, чем может помочь государство, добавив, что сейчас ряд российских компаний ведёт эту работу на базе Национального центра компетенций по информсистемам управления холдингом (АНО НЦК ИСУ). Индустриальные центры компетенций (ИЦК) помогают в доработке и внедрении уже существующих на рынке ERP, но не занимаются разработкой новых. Вместе с тем «Севергрупп» ведёт переговоры о повторном создании консорциума для доработки отечественной ERP, поскольку используемая сейчас платформа SAP без регулярных обновлений устареет. Также поддержала идею создания консорциума корпорация «Галактика», но только при участии в нём вендоров наряду с крупнейшими пользователями. В свою очередь, в группе «УльтимаТек» предложили для ускорения замещения SAP в крупных компаниях признать ERP-системы частью критической информационной инфраструктуры. В РЖД сообщили, что полностью перейдут в 2027 году на платформу «1С». Это решение выбрали и в «Росатоме», причём недостающие функции разрабатывает дочерняя компания «Гринатом». В «Ростехе» рассказали, что совместно с 1С разрабатывают и внедряют ERP-платформу на предприятиях «Объединённой авиастроительной корпорации» и «Объединённой двигателестроительной корпорации», планируя в дальнейшем запустить её на других своих предприятиях.

22.07.2025 [11:44], Руслан Авдеев

«Нейроаналитик» «Яндекса» ускорит анализ и визуализацию данныхYandex B2B Tech создала «Нейроаналитика», ИИ-агента, предназначенного для аналитики и визуализации данных. Отмечается, что агент снизит нагрузку на сотрудников-аналитиков и позволит ускорить формирование отчётов, а также проверку бизнес-гипотез в среднем на 30 %. Внешние компании получат доступ к первому варианту агента в сентябре 2025 года. Доступ к новой версии Yandex DataLens с ИИ-агентом будет предоставляться как в облаке, так и в формате on-premise. В пресс-службе компании сообщают, что с помощью нового инструмента можно будет искать инсайты и делать выводы, основанные на информации, отображённой в виде таблиц и графиков. Кроме того, ИИ-агент поможет формировать и редактировать «сложные визуализации» полученной информации. Агент «Нейроаналитик» будет встроен в интерфейс Yandex DataLens в виде чата и будет поддерживать обращения к нейросети на естественном языке — для того, чтобы перестроить визуализацию или, например, изменить расчётную формулу. ИИ-модель по запросу скорректирует соответствующие параметры. Будущее BI-платформы (Business Intelligence), предназначенной для сбора, анализа, визуализации и интерпретации данных с целью поддержки принятия бизнес-решений в компании видят в развитии новых функций на базе ИИ. Отмечается, что с такими функциями аналитика станет доступнее для разных позиций в компаниях.

Источник изображения: Miguelangel Miquelena/unsplash.com Первыми доступ к «Нейроаналитику» получили сотрудники подразделений «Яндекса». Только за первые две недели работы инструмент протестирован 4 тыс. человек. Отмечается, что ПО будет полезно как аналитикам, так и всем, кто работает с большими массивами информации. Кроме того, аналитика пригодится и в личных проектах — для анализа рынка акций или даже изучения динамики цен на товары в маркетплейсе. В основе «Нейроаналитика» лежат технологии Yandex Cloud AI Studio. На платформе доступны новейшие генеративные нейросети «Яндекса», ИИ-модели синтеза и распознавания речи, а также актуальные LLM и VLM на open source основе. Товарный знак «Яндекс Нейроаналитик» уже зарегистрирован «Роспатентом».

22.07.2025 [09:20], Андрей Крупин

Плохо прогнозируемый эффект от применения ИИ — один из основных барьеров, сдерживающих его использование в промышленностиСложности с расчётом и прогнозированием совокупного эффекта от применения систем искусственного интеллекта являются ключевым барьером для их повсеместного развёртывания в индустриальной среде. Об этом свидетельствует исследование, проведённое ФГАУ «Цифровые индустриальные технологии» совместно с компанией «К2Тех» в рамках проходившей в Екатеринбурге международной промышленной выставки «Иннопром-2025». Проблему с плохо прогнозируемым эффектом от применения ИИ отметили более 61 % опрошенных представителей предприятий из отраслей машиностроения, нефтегазохимии, энергетики, горной металлургии и добычи. Также среди основных барьеров респонденты выделили риски кибербезопасности (более 53 %), нехватку на рынке реальных эффективных кейсов внедрения (более 46 %), отсутствие квалифицированных кадров (более 38 %). Ещё одна проблема — неготовность IT-инфраструктуры. На 100 % готова и автоматизирована она оказалась лишь у 7 % респондентов. У остальных она не полностью готова для запуска и масштабирования нагрузок. Более 30 % промышленных предприятий назвали существенным барьером также нехватку бюджетов.

Источник изображения: Julia Reushenova / unsplash.com Исследование показало, что более половины промышленных предприятий в перспективе ожидают, что повсеместное внедрение современных систем, построенных с использованием технологий машинного обучения и искусственного интеллекта на базе нейронных сетей, поможет увеличить эффективность планирования и прогнозирования, снизить издержки и риски аварий на производстве. «Сложно просчитать эффект от применения систем искусственного интеллекта. Самое очевидное — это сокращение трудозатрат на рутинных операциях. Но если мы копнём чуть глубже, не до конца известно, какой совокупный эффект даст нам ИИ в будущем. При этом организации, которые не начнут применять эту технологию, будут неконкурентоспособны», — прокомментировал результаты исследования директор по отраслевым решениям для машиностроения компании «К2Тех» Евгений Васильев. |

|