Материалы по тегу: nvidia

|

08.03.2026 [14:20], Сергей Карасёв

ИИ-облако Iren закупит 50 тыс. ускорителей NVIDIA B300Неооблачная компания Iren объявила о заключении соглашения о покупке более 50 тыс. ускорителей NVIDIA B300. Эта сделка позволит Iren расширить общий парк установленных ускорителей примерно до 150 тыс. ед., что к концу 2026 года обеспечит доход от облачных ИИ-вычислений в размере свыше $3,7 млрд. Закупаемые ускорители NVIDIA B300 в течение этого года будут развёрнуты в существующих дата-центрах Iren с воздушным охлаждением в Маккензи (Британская Колумбия, Канада) и Чилдрессе (Техас, США). При этом подчёркивается, что площадки компании в Чилдрессе и Канал-Флэтс (Британская Колумбия) располагают возможностями для дальнейшего наращивания вычислительных мощностей. За последние восемь месяцев Iren привлекла $9,3 млрд в виде предоплат от клиентов, конвертируемых облигаций, лизинга и средств для приобретения оборудования. В частности, были получены $3,6 млрд на закупку ИИ-ускорителей для нужд Microsoft. Iren намерена использовать эти и другие источники средств для финансирования дополнительных капитальных затрат в размере приблизительно $3,5 млрд: деньги пойдут на покупку серверов, хранилищ, сетевых устройств и вспомогательного оборудования, а также на оплату труда. Условия соглашений предусматривают выполнение платежей после отгрузки техники — это повышает эффективность использования оборотного капитала. «Наращивание мощностей до 150 тыс. ускорителей ставит Iren в число крупнейших мировых поставщиков облачной инфраструктуры для ИИ», — говорит Дэниел Робертс (Daniel Roberts), соучредитель и один из генеральных директоров компании. На сегодняшний день Iren управляет несколькими кампусами ЦОД общей мощностью 810 МВт. Ещё 2,1 ГВт находятся в стадии строительства, 1 ГВт — в стадии разработки. Компания, ранее фокусировавшаяся на майнинге криптовалют, переориентирует свои ресурсы на задачи в сфере ИИ.

07.03.2026 [22:57], Владимир Мироненко

Oracle и OpenAI передумали расширять флагманский ИИ ЦОД Stargate в Техасе, чем может воспользоваться Meta✴Oracle и OpenAI отказались от планов расширения флагманского ИИ ЦОД в Абилине (Abilene, Техасе), одного из первый объектов проекта Stargate, сообщил Bloomberg. Строительство этого ЦОД на территории Clean Campus компании Lancium осуществляет разработчик проекта Crusoe Energy. Объект находится в ведении Oracle в интересах OpenAI. В сентябре прошлого года были введены в эксплуатацию два здания ЦОД, а в этом году планируется запуск ещё шести, в результате чего его мощность составит около 1,2 ГВт. Далее Oracle и OpenAI планировали увеличить мощность до 2 ГВт. Переговоры об этом между Oracle, Crusoe и OpenAI велись с середины 2025 года, но планы изменились. По словам источников, переговоры затянулись из-за проблем с финансированием, а также в связи с часто меняющимися прогнозами спроса OpenAI и изменением взглядов на Stargate, что в итоге привело к их срыву. Также на отношения между Oracle и Crusoe повлияли проблемы с надёжностью функционирования объекта. По словам источников, ранее в этом году ЦОД не функционировали в течение нескольких дней из-за зимней непогоды, повлиявшей на работу части оборудования жидкостного охлаждения. Вместе с тем, компании заверили что их партнёрство по-прежнему прочное, и что арендованная Oracle площадка в Абилине быстро развивается. «Crusoe и Oracle работают в тесном сотрудничестве, чтобы создать одну из крупнейших в мире ИИ-фабрик в Абилине, — говорится в заявлении Crusoe. — Наше сотрудничество позволяет создавать масштабную инфраструктуру быстрее, чем кто-либо другой в отрасли». Также в силе осталась договорённость OpenAI с Oracle, согласившейся поставить для неё 4,5 ГВт мощностей ЦОД. Как сообщает Bloomberg, эта сделка по-прежнему находится в процессе, и компании объявили о ряде проектов в других локациях, например, об объекте недалеко от Детройта, принадлежащем Related Digital. Что касается отказа от расширения проекта в Абилине, то после публикации статьи Bloomberg руководитель отдела инфраструктуры OpenAI Сачин Катти (Sachin Katti) сообщил в соцсетях следующее: «Наша флагманская площадка Stargate — один из крупнейших кампусов ИИ ЦОД в Соединённых Штатах. Мы рассматривали возможность дальнейшего расширения, но в конечном итоге решили разместить дополнительные мощности в других местах». «Сегодня у нас в разработке более полудюжины площадок в нескольких штатах, включая площадку, которую мы строим совместно с Oracle в Висконсине, где на этой неделе были установлены первые стальные балки», — добавил он, о чём сообщил Data Center Dynamics. По данным The Information, полноценное электроснабжение на площадке в Абилине будет доступно только через год, к тому времени OpenAI надеется использовать ускорители NVIDIA Vera Rubin вместо ускорителей Blackwell, которые будут установлены в Абилине, поэтому компания предпочла изменить планы. Кроме того, недалеко от первого техасского кампуса Stargate строится и второй — 1,4-ГВт ИИ ЦОД в округе Шакелфорд (Shackelford, Техас) возводится под началом Vantage Data Centers. Как рассказали источники, когда Crusoe начала подыскивать арендаторов для своего ЦОД в Абилине, к процессу подключилась NVIDIA. Чтобы избежать появления на этой площадке продукции конкурирующего разработчика чипов AMD, компания, как сообщается, внесла Crusoe депозит в размере $150 млн для обеспечения аренды площадки. Сообщается, что провал переговоров между Oracle и OpenAI создал возможность для Meta✴ по аренде запланированной для расширения площадки в Абилине, и NVIDIA ведёт с ней переговоры по этому поводу. Сделка между Crusoe и Meta✴ пока не подписана. Добавим, что только в этом году Meta✴ планирует направить на капитальные затраты до $135 млрд. В свою очередь, OpenAI намерена инвестировать в вычислительные мощности около $600 млрд к 2030 году, что гораздо меньше ранее заявленных $1,4 трлн к 2033 году. При этом до $300 млрд из этой суммы планируется выделить Oracle, которая сама испытывает трудности с финансированием строительства своих ЦОД, накапливает долги и планирует уволить тысячи сотрудников для снижения расходов.

06.03.2026 [17:01], Руслан Авдеев

Инференс-нагрузки Perplexity прописались в облаке CoreWeaveКомпания CoreWeave объявила о заключении долгосрочного соглашения с Perplexity. Стратегическое партнёрство призвано обеспечить выполнение рабочих ИИ-нагрузок последней, также предусмотрено пилотное внедрение в обеих организациях новых сервисов. Утверждается, что CoreWeave позволяет клиентам переходить от разработки непосредственно к внедрению без перепроектирования систем и инструментов. Соглашение предусматривает, что платформа CoreWeave будет использоваться Perplexity для инференса нового поколения. Выделенные кластеры на основе суперускорителей NVIDIA GB200 NVL72 гарантируют соответствие инфраструктуры облачного провайдера изменению задач Perplexity и высоким требованиям экосистемы на основе Sonar и Search API. В своё время Perplexity начинала с выполнения задач инференса с помощью CoreWeave Kubernetes Service и применения платформы W&B Models для (до-)обучения моделей и управления ими на всех этапах, от экспериментального до ввода в эксплуатацию. Дополнительно CoreWeave повсеместно внедрит в своей организации инструменты Perplexity Enterprise Max, что позволит её специалистам искать информацию в интернете и внутренней базе данных, проводить углублённые исследования, анализировать данные и визуализировать их. Партнёрство является свидетельством «мультиоблачной» стратегии Perplexity. Чуть более месяца назад Microsoft заключила крупную облачную сделку с Perplexity, но ключевым провайдером ИИ-поисковика останется AWS.

Источник изображения: CoreWeave/Perplexity Это лишь последняя из удачных сделок CoreWeave, сдающей в аренду мощности даже таким компаниям, как Microsoft, Meta✴ и OpenAI. В 2025 году компания получила средства от NVIDIA, которая арендовала свои же ускорители у CoreWeave. В сентябре 2025 года компания обязалась выкупить у неооблачного оператора все нераспроданные мощности. CoreWeave на волне роста спроса на облачные услуги удвоит в 2026 году капитальные затраты, хотя некоторые инвесторы сомневаются в целесообразности таких мер.

06.03.2026 [08:58], Руслан Авдеев

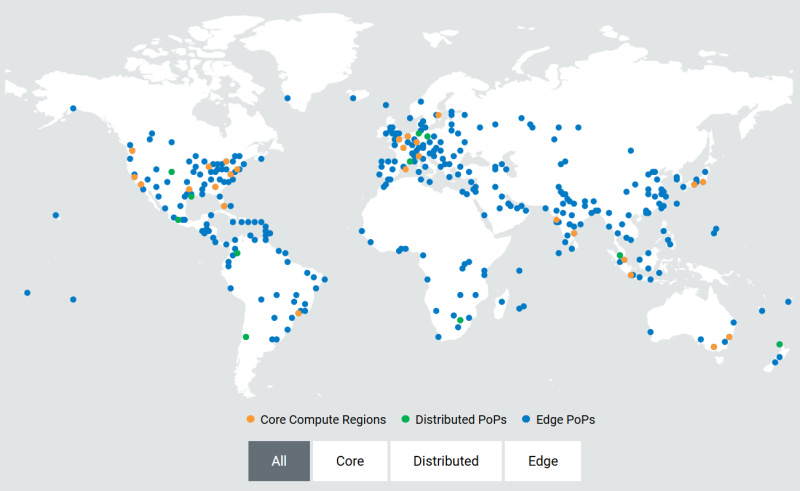

Akamai развернёт тысячи ускорителей NVIDIA RTX Blackwell для распределённого инференсаОблачный провайдер Akamai анонсировал покупку «тысяч» ИИ-ускорителей для развития своей распределённой облачной инфраструктуры по всему миру. Развёртывание новых чипов позволит создать единую оптимизированную ИИ-платформу для быстрого и распределённого инференса в глобальной сети Akamai. По словам компании, она готовит базовую инфраструктуру для «физического» и «агентного» ИИ, где решения необходимо принимать в режиме реального времени. Ранее компания анонсировала проект Akamai Inference Cloud. Как заявляет Akamai, пока крупные облачные бизнесы расширяют проекты обучения ИИ, компания сосредоточилась на удовлетворении потребностей эпохи инференса. Централизованные ИИ-фабрики имеют важное значение для создания моделей, но для их масштабной эксплуатации необходима децентрализованная «нервная система». Внедрение NVIDIA Blackwell в распределённая инфраструктуру, как ожидается, позволит ИИ взаимодействовать с «физическим» миром на местах — с системами автономной доставки, умными энергосетями, роботами-хирургами, антифрод-системами т.п. — без географических и финансовых ограничений, характерных для классических облаков. Интеграция ускорителей Blackwell обеспечит:

Предоставляя инструментарий для выполнения задач ближе к конечным пользователям, Akamai обеспечивает высокую пропускную способность и, как утверждается, одновременно снижает задержку до 2,5 раз. Это позволит бизнесам экономить до 86 % на инференсе в сравнении с обычными облачными компаниями-гиперскейлерами. Платформа объединяет серверы на основе ускорителей NVIDIA RTX Pro 6000 Blackwell Server Edition с DPU NVIDIA BlueField-3 и распределённую облачную инфраструктуру Akamai с 4,4 тыс. точек присутствия. Cloudflare применяет платформу с «бессерверным» инференсом в более чем 200 городах. Её Workers AI обеспечивают глобальный инференс с задержкой менее 100 мс без специального выделения кластеров ускорителей. Fastly применяет платформу периферийных вычислений, но предлагает меньшее количество локальных точек присутствия (PoP) для выполнения задач на GPU/CPU.

03.03.2026 [17:18], Руслан Авдеев

NVIDIA инвестировала $4 млрд в поставщиков лазеров и фотоники для ИИ ЦОД Lumentum и CoherentNVIDIA инвестирует по $2 млрд в Lumentum Holdings и Coherent Corp., выпускающие оптическое сетевое оборудование. Сделки также включает «многомиллиардные» обязательства по закупке определённых лазерных компонентов и доступ к ним в будущем, сообщает Silicon Angle. В случае Coherent речь идёт и о других оптоэлектронных комплектующих. В марте 2025 года NVIDIA представила серию коммутаторов Spectrum-X и Quantum-X для дата-центров, использующих интегрированную фотонику (CPO), что позволило отказаться от использования трансиверов, упростить инфраструктуру и снизить энергопотребление сетевых интерконнектов. Lumentum и Coherent выпускают компоненты для таких систем, причём первая ещё осенью прошлого года начала наращивать производственные мощности по их выпуску. Lumentum входит в число ключевых поставщиков лазерных модулей, оптимально подходящих для CPO — с механизмом терморегулирования и оптимизацией сетевой производительности. Выручка Lumentum в 2025 году составила $655,5 млн. Компания производит и иное сетевое оборудование, в том числе классические трансиверы и оптические коммутаторы (OCS), а также поставляет индустриальные лазеры, например, для сварки металлов. Coherent также выпускает и промышленные лазеры, и оптические решения для дата-центров. Так, недавно компания представила оптимизированный CPO-модуль. Кроме того, Coherent предлагает инструменты для разработки оптических сетевых решений. Coherent и Lumentum используют средства NVIDIA для поддержки исследований и конструкторских разработок. Также компании работают над тем, чтобы нарастить производство в США. После объявления о новых инвестициях акции компаний поднялись в цене более чем на 10 %. Доля NVIDIA на рынке Ethernet-коммутаторов стремительно растёт, во многом благодаря спросу на её же ИИ-платформы. Этот сегмент становится всё более прибыльным для компании. При этом агрессивная политика NVIDIA уже привела к дефициту лазеров.

03.03.2026 [10:50], Сергей Карасёв

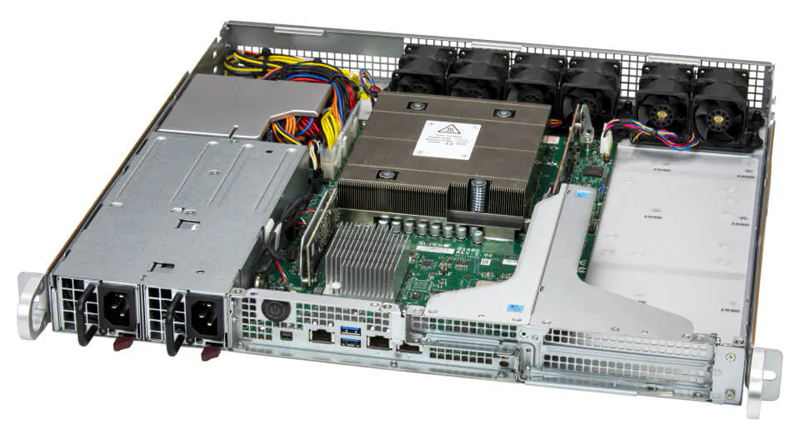

Supermicro представила серверы на базе NVIDIA Grace для инфраструктур AI-RANSupermicro анонсировала серверы на платформе NVIDIA Grace, ориентированные на применение в составе систем AI-RAN. Дебютировали устройства ARS-111L-FR, ARS-221GL-NR и ARS-111GL-NHR, использующие дизайн NVIDIA Aerial RAN Computer (ARC). Модель ARS-111L-FR выполнена в форм-факторе 1U. Задействован один чип NVIDIA Grace, объединяющий 72 вычислительных ядра Arm Neoverse V2 (Armv9). Говорится об использовании 240 Гбайт памяти LPDDR5X. Возможна установка двух ускорителей NVIDIA L4. Сервер оборудован двумя коннекторами M.2 для NVMe SSD с интерфейсом PCIe 5.0 x4, двумя посадочными местами для SFF-накопителей NVMe, двумя слотами для карт PCIe 5.0 x16 FHFL, одним разъёмом PCIe 5.0 x16 HHHL, портами 1GbE (RJ45), USB 3.2 Gen1 (5 Гбит/с) и mini-DP. Могут устанавливаться два блока питания мощностью до 800 Вт с сертификатом 80 Plus Titanium.

Источник изображений: Supermicro Устройство ARS-221GL-NR, в свою очередь, заключено в корпус 2U. Используется сборка Grace Superchip, которая состоит из двух кристаллов Grace и чипов памяти LPDDR5x общим объёмом до 960 Гбайт. Во фронтальной части располагаются отсеки для NVMe-накопителей E1.S с возможностью горячей замены. Есть два разъёма M.2 M-key 22110 для SSD с интерфейсом PCIe 5.0 x4 (NVMe), три слота для карт PCIe 5.0 x16 FHFL и два слота для карт PCIe 5.0 x16 FHFL двойной ширины. Реализованы порты 1GbE (RJ45), USB 3.0 Type-A (×2) и mini-DP. Питание обеспечивают три блока на 2000 Вт с сертификатом 80 Plus Titanium.  Сервер ARS-111GL-NHR типоразмера 1U несёт на борту NVIDIA GH200. Могут быть установлены до восьми NVMe-накопителей E1.S и два NVMe SSD формата M.2. Доступны два слота для карт PCIe 5.0 x16 FHFL, порты 1GbE (RJ45), USB 3.0 и mini-DP. За питание отвечают два блока мощностью 2000 Вт с сертификатом 80 Plus Titanium. Все новинки оснащены воздушным охлаждением.

02.03.2026 [15:01], Сергей Карасёв

NVIDIA, Ericsson, Nokia и партнёры займутся развитием 6G с использованием ИИ и открытых платформNVIDIA объявила о намерении совместно с партнёрами развивать мобильные сети 6G с применением ИИ, а также открытых и безопасных решений. В инициативе принимают участие Booz Allen, BT Group, Cisco, Deutsche Telekom, Ericsson, MITRE, Nokia, OCUDU Ecosystem Foundation, ODC, SK Telecom, SoftBank и T-Mobile. Проект направлен на формирование «открытой, интеллектуальной и отказоустойчивой» инфраструктуры 6G, способствующей ускорению инноваций в глобальном масштабе. Отмечается, что системы 6G, помимо обеспечения традиционной связи, станут основой для физического ИИ, поддерживая работу миллиардов автономных устройств, транспортных средств, датчиков и роботов. Это значительно повышает требования к безопасности и доверию. Архитектуры, лежащие в основе обычных беспроводных сетей, не способны удовлетворить меняющиеся запросы. Поэтому NVIDIA и партнёры намерены развивать программно-определяемые платформы для беспроводных сетей, изначально созданные с использованием ИИ и открытых разработок. Внедрение ИИ планируется на всех уровнях — RAN, на периферии и в ядре сети. Такой подход позволит сетям 6G обеспечивать безопасную связь, интеллектуальные функции и поддержку принятия решений. Благодаря программно-определяемой архитектуре сети 6G смогут развиваться с течением времени, обрастая новыми функциями. Воспользоваться их преимуществами смогут все участники отрасли — от глобальных операторов и провайдеров услуг до стартапов, исследователей и разработчиков. В целом, как ожидается, сети 6G создадут основу для эры физического ИИ.

28.02.2026 [23:59], Владимир Мироненко

Hyundai инвестирует более $6 млрд в ИИ ЦОД, роботов, водородную и солнечную энергетику

hardware

hyundai

nvidia

водород

ии

инвестиции

робототехника

солнечная энергия

финансы

цод

энергетика

южная корея

Hyundai Motor Group и правительство Южной Кореи подписали соглашение об инвестировании около ₩9 трлн ($6,26 млрд) с целью строительства объединённого инновационного центра в районе Сэмангым (Saemangeum) города Кунсан (Gunsan), который будет включать в себя ИИ ЦОД, завод по производству робототехники и производство водородной/солнечной энергии, сообщило агентство Reuters со ссылкой на министерство земельных ресурсов страны. По данным ведомства, около ₩5,8 трлн (около $4,04 млрд) Hyundai инвестирует в строительство ИИ ЦОД, в котором будет развёрнуто 50 тыс. NVIDIA Blackwell. ЦОД будет оснащён «массивным» хранилищем для хранения огромных массивов данных для обучения, разработки программно-определяемых транспортных средств (SDV) и внедрения «умных заводов», заявили в Hyundai. Ожидается, что интегрированная платформа позволит ускорить исследования и разработку продукции по всей цепочке создания стоимости. Ещё ₩400 млрд (около $278,8 млн) будет выделено на строительство завода по производству роботов, в том числе носимых (экзоскелетов). Также компания инвестирует ₩1 трлн (около $697,2 млн) в строительство электролизерной установки с протонообменной мембраной (Proton Exchange Membrane, PEM) мощностью 200 МВт для производства экологически чистого водорода с использованием возобновляемых источников энергии на месте. Hyundai планирует со временем достичь общей мощности электролизеров в 1 ГВт на внутреннем рынке. Hyundai утверждает, что её технология PEM достигла более чем 90 % локализации, что способствует технологической независимости Южной Кореи и расширению экспортных возможностей экологически чистого водорода, сообщил ресурс Data Center Knowledge. Оставшуюся часть суммы в размере ₩1,3 трлн (около $906,6 млн) компания направит в солнечную энергетику — строительство солнечных электростанций гигаваттного масштаба к 2035 году на основе действующей с 2021 года 99-МВт электростанции. Hyundai рассматривает ЦОД как «мозг» своей ИИ-экосистемы, объединяющий данные производства, логистики и эксплуатации транспортных средств для развития ИИ внутри страны. В центре также будет создан «умный город» с водородными технологиями на основе ИИ, который интегрирует технологии в единую экосистему. Строительство ЦОД, солнечной инфраструктуры и объекта по производству водорода планируется начать в 2027 году и завершить в 2029 году. По прогнозам Hyundai, эти инвестиции принесут экономический эффект в размере около ₩16 трлн (примерно $11 млрд) и позволят создать около 71 тыс. рабочих мест.

26.02.2026 [15:14], Владимир Мироненко

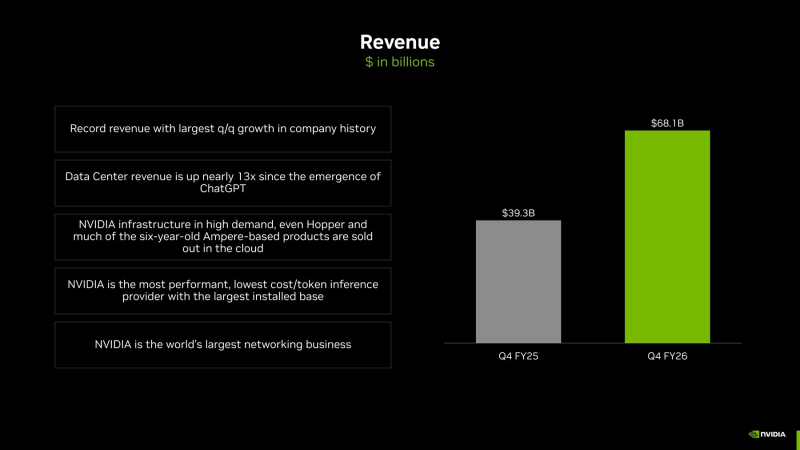

И без Китая всё отлично: квартальные показатели NVIDIA превзошли ожидания благодаря растущим продажам решений для ЦОДNVIDIA опубликовала отчёт о финансовых результатах за IV квартал и 2026 финансовый год, закончившийся 25 января 2026 года. Результаты компании превзошли ожидания Уолл-стрит. Общая выручка NVIDIA за IV финансовый квартал составила $68,13 млрд, что на 20 % больше, чем в III квартале, и на 73 % больше, чем годом ранее, превысив прогноз аналитиков, опрошенных LSEG, в размере $66,21 млрд (по данным CNBC). Скорректированная чистая прибыль на разводнённую акцию (Non-GAAP) составила $1,62 при прогнозе от LSEG в размере $1,53. Чистая прибыль (GAAP) составила $42,96 млрд или $1,76 на разводнённую акцию, тогда как годом ранее эти показатели равнялись $22,09 млрд и $0,89 соответственно. Валовая маржа (GAAP) выросла примерно на 160 базисных пунктов по сравнению с III кварталом и достигла 75 % в отчётном квартале, что соответствует прогнозам Уолл-стрит и немного превосходит ожидания компании. NVIDIA ожидает, что в текущем квартале маржа сократится на 10 базисных пунктов. В I квартале 2027 финансового года компания также ожидает получить выручку в размере $78 млрд ± 2 % (без учёта продаж для ЦОД в Китае) при прогнозе аналитиков в размере $72,6 млрд. «Спрос на вычислительные ресурсы растет экспоненциально — наступил переломный момент в развитии агентного ИИ. Grace Blackwell с NVLink сегодня является лидером в области инференса, обеспечивая на порядок меньшую стоимость токена, а Vera Rubin ещё больше укрепит это лидерство», — сказал Дженсен Хуанг (Jensen Huang), основатель и генеральный директор NVIDIA. «Внедрение агентов в корпоративном секторе стремительно растет. Наши клиенты стремятся инвестировать в вычислительные мощности для ИИ — в фабрики, которые обеспечивают промышленную революцию в области ИИ и их будущий рост», — добавил он. Более 91 % продаж компании приходится на сегмент решений для ЦОД, выручка которого составила $62,3 млрд, что на 75 % больше год к году, а также превысило ожидания аналитиков в $60,69 млрд, согласно данным StreetAccount. В этом сегменте выручка от поставки решений для вычислений выросла на 58 % год к году до $51,33 млрд, а выручка от продаж сетевого оборудования увеличилась за квартал на 263 % до $10,98 млрд. Финансовый директор Колетт Кресс (Colette Kress) объяснила быстрый рост бизнеса «продолжающимся наращиванием вычислительной инфраструктуры NVLink для систем GB200 и GB300, а также развитием платформ Ethernet и InfiniBand». NVIDIA отметила, что гиперскейлеры «остаются нашей крупнейшей категорией клиентов», на которые приходится чуть более 50 % выручки в сегменте решений для ЦОД. Колетт Кресс также заявила, что, хотя администрация США одобрила поставки «небольших объёмов» чипов H200 для китайских клиентов, а Китай формально разрешил закупки, компания пока не получила от них никакой выручки. «Мы не знаем, будет ли разрешён какой-либо импорт в Китай», — сказала Кресс. Это заявление в корне отличается от её сообщения в прошлом месяце о скорых поставках в КНР и о том, что власти США «лихорадочно работают» над уточнением деталей соглашения о разделе доходов. «Чтобы сохранить свои лидирующие позиции в области вычислительных мощностей для ИИ, Америка должна взаимодействовать с каждым разработчиком и быть предпочтительной платформой для каждого коммерческого предприятия, включая предприятия в Китае, — сказала она. — Мы продолжим взаимодействовать с правительствами США и Китая и отстаивать способность Америки конкурировать на мировом рынке». Среди других направлений деятельности NVIDIA, выручка от игрового бизнеса за IV финансовый квартал выросла год к году на 47 % до $3,7 млрд, хотя и уменьшилась на 13 % по сравнению с предыдущим кварталом. Автомобильное и робототехническое подразделение компании увеличило продажи год к году на 6 % до $604 млн, что ниже ожиданий аналитиков в $654,8 млн, согласно данным StreetAccount. В сегменте профессиональной визуализации продажи выросли на 159 % до $1,3 млрд, значительно превысив прогноз аналитиков в $755,4 млн, согласно данным StreetAccount. По итогам за 2026 финансовый год выручка NVIDIA составила $215,94 млрд, что на 65 % больше, чем годом ранее. Валовая маржа (GAAP) составила 71,1 % против 75,0 % годом ранее (падение — 3,9 п.п.). Чистая прибыль (GAAP) равна $120,07 млрд или $4,9 на разводнённую акцию против $72,88 млрд (рост 65 %) или $2,94 на разводнённую акцию годом ранее.

25.02.2026 [11:55], Сергей Карасёв

Akash Systems начала поставки первых в мире GPU-серверов с алмазным охлаждениемКомпания Akash Systems, базирующаяся в Сан-Франциско (Калифорния, США), объявила о начале поставок первых в мире ИИ-серверов, оснащённых системой алмазного охлаждения Diamond Cooling. Заказчиком выступил NxtGen AI PVT Ltd — крупнейший в Индии государственный облачный провайдер. Технология Diamond Cooling основана на применении синтетических алмазов. Этот материал обладает самой высокой теплопроводностью из всех известных соединений. Akash Systems подчёркивает, что синтетические алмазы способны отводить тепло от чипов в пять раз эффективнее по сравнению с медью, что открывает качественно новые возможности в плане охлаждения современного оборудования высокой плотности для дата-центров, ориентированных на задачи ИИ и НРС. Akash Systems поставляет серверы на базе NVIDIA H200, для охлаждения которых применяется система Diamond Cooling. В отличие от стандартных ЦОД, оборудование в которых функционирует при температурах от +24 до +29 °C, серверы с технологией Diamond Cooled способны обеспечивать максимальную производительность при температуре окружающей среды до +50 °C. Благодаря этому снижаются общие требования к системам охлаждения дата-центров, что позволяет уменьшить эксплуатационные расходы. Среди одного из ключевых преимуществ Diamond Cooling разработчики называют устранение теплового троттлинга: это обеспечивает наилучшее быстродействие при выполнении ресурсоёмких задач, таких как обучение больших языковых моделей (LLM) и инференс. Кроме того, достигается повышение производительности (Флопс/Вт) до 15 % на каждый сервер. Плюс к этому существенно сокращается общее энергопотребление ЦОД, поскольку отпадает необходимость в интенсивном охлаждении. «Система Diamond Cooling решает две самые сложные проблемы в гонке ИИ — повышение энергоэффективности и сокращение капиталовложений. В ситуации, когда увеличение вычислительной мощности на 1–2 % имеет большое значение, повышение на 15 % фактически меняет правила игры», — говорит доктор Феликс Эджекам (Felix Ejeckam), соучредитель и генеральный директор Akash Systems. |

|