Материалы по тегу: mtia

|

15.04.2026 [16:37], Руслан Авдеев

Broadcom поможет Meta✴ в создании нескольких поколений ИИ-ускорителейMeta✴ объявила о заключении нового соглашения с Broadcom. Оно расширяет уже имеющееся партнёрство, направленное на разработку собственных ИИ-ускорителей для IT-гиганта, сообщает Silicon Angle. На начальном этапе Meta✴ планирует развернуть собственные ускорители общей мощностью 1 ГВт для обучения ИИ-моделей и инференса. В конечном итоге партнёры планируют развернуть ускорители на основе технологий Broadcom совокупной мощностью несколько гигаватт. Отдельно Broadcom подчеркнула, что новые чипы MTIA — первые в ИИ-индустрии, использующие 2-нм техпроцесс. По словам главы Meta✴ Марка Цукерберга (Mark Zuckerberg), в MTIA будут использоваться наработки Broadcom в сфере проектирования, упаковки и сетевых решений. Ранее сообщалось, что Meta✴ столкнулась с трудностями при выпуске новых чипов MTIA, но Broadcom опровергла эту информацию, заявив, что поставки уже осуществляются, а для следующего поколения XPU планируется масштабировать производство.

Источник изображения: Meta✴ В марте Meta✴ объявила о разработке четырёх новых вариантов MTIA. Первую версию чипа представили ещё в 2023 году. MTIA дают определённую независимость от дорогостоящих и труднодоступных моделей NVIDIA и AMD. Как и чипы Google и AWS, они представляют собой специализированные ASIC, меньше и дешевле классических ИИ-ускорителей — но их вполне достаточно для выполнения узкого круга задач. Google представила свои первые TPU задолго до бума ИИ, ещё в 2015 году. В 2018 году Amazon представила первые чипы Trainium. Обе компании полагались на технологии Broadcom для разработки своих продуктов. В последние месяцы Broadscom анонсировала ряд сделок, касающихся своих кастомных XPU. Так, Anthropic получит Google TPU на 3,5 ГВт, часть чипов будет поставляться самой Broadcom. Кроме того, Broadcom помогает Fujitsu в создании 2-нм процессора MONAKA. В 2026 году Meta✴ анонсировала ряд многомиллиардных сделок по закупке ИИ-ускорителей в рамках обязательства выделить более $135 млрд на капитальные затраты в 2026 финансовом году. Ранее она обязалась использовать 6 ГВт ИИ-ускорителей AMD, миллионы чипов NVIDIA, а также чипы, совместно разработанные с Arm. Кроме того, компания намерена потратить миллиарды долларов на аренду ускорителей у CoreWeave и Nebius.

12.03.2026 [09:13], Сергей Карасёв

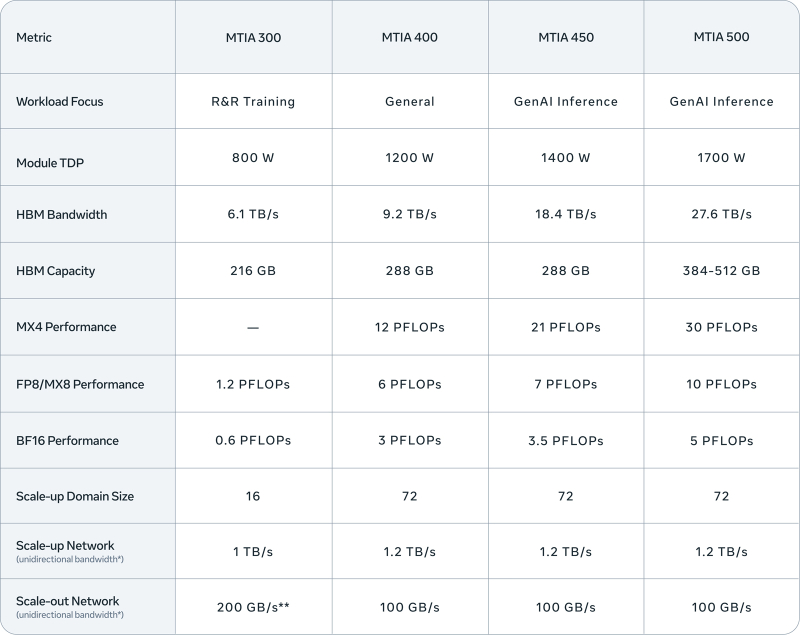

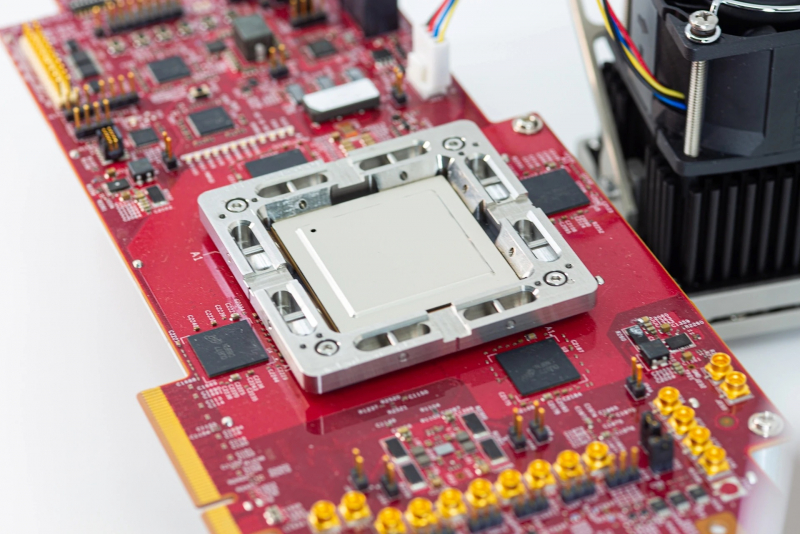

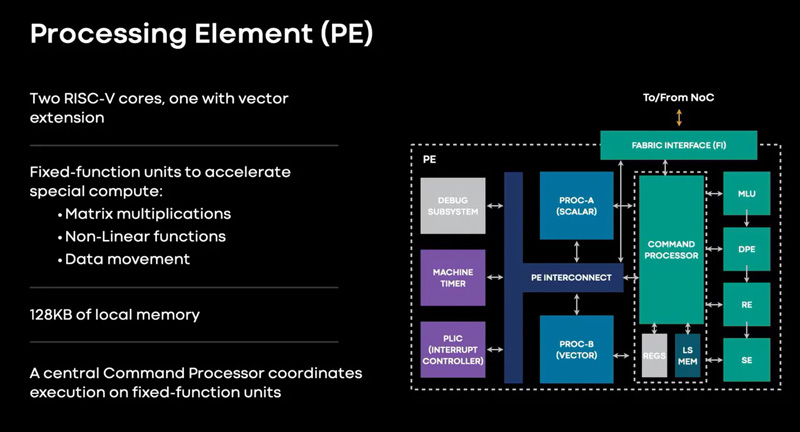

Meta✴ представила четыре новых ИИ-ускорителя MTIA — с FP8-производительностью до 10 ПфлопсКомпания Meta✴ анонсировала ИИ-ускорители MTIA (Meta✴ Training and Inference Accelerator) сразу четырёх новых поколений. Это решения MTIA 300, 400, 450 и 500: внедрение некоторых из них уже началось, тогда как развёртывание других запланировано на текущий и следующий годы. Устройства ориентированы на различные ИИ-нагрузки, включая инференс и генеративные сервисы. ИИ-процессор MTIA первого поколения (MTIA 100), напомним, дебютировал в 2023 году: изделие получило в общей сложности 128 ядер RISC-V и 128 Мбайт памяти SRAM. В 2024-м вышло решение второго поколения MTIA 200 с повышенной производительностью. В каждом из четырёх новых продуктов, по заявлениям Meta✴, упор сделан на улучшении вычислительных характеристик, пропускной способности памяти и эффективности. Конструкция ускорителя MTIA 300 включает один вычислительный чиплет, два сетевых чиплета (NIC) и несколько стеков HBM. Каждый вычислительный чиплет состоит из матрицы процессорных элементов (PE), содержащих по два векторных ядра RISC-V. Объём памяти HBM составляет 216 Гбайт, её пропускная способность — 6,1 Тбайт/с. Заявленная ИИ-производительность в режимах FP8/МХ8 достигает 1,2 Пфлопс. Показатель TDP равен 800 Вт. Реализован движок DMA для взаимодействия с локальной памятью. Ускоритель, уже применяющийся в дата-центрах Meta✴, оптимизирован для задач обучения по принципу Rephrase and Respond (R&R).

Источник изображений: Meta✴ Ступенью выше располагается решение MTIA 400 общего назначения. Оно объединяет два вычислительных чиплета, а объём памяти HBM увеличен до 288 Гбайт (пропускная способность — 9,2 Тбайт/с). У этого ускорителя быстродействие на операциях FP8/МХ8 составляет до 6 Пфлопс. Величина TDP равна 1200 Вт. 72 ускорителя MTIA 400, «провязанные» в одной стойке, образуют единый масштабируемый домен. При этом может использоваться жидкостное охлаждение с воздушной поддержкой или полностью жидкостное охлаждение. На сегодняшний день Meta✴ завершила тестирование MTIA 400 и находится на этапе внедрения изделий. Вариант MTIA 450, в свою очередь, ориентирован на задачи инференса в сфере генеративного ИИ. Этот ускоритель также использует 288 Гбайт памяти HBM, но её пропускная способность достигает 18,4 Тбайт/с. Значение TDP подросло до 1400 Вт. Решение обеспечивает ИИ-производительность в режимах FP8/МХ8 до 7 Пфлопс, в режиме МХ4 — 21 Пфлопс. MTIA 450 также поддерживает смешанные вычисления с низкой точностью без дополнительного программного преобразования данных. Внедрение этой модели в ЦОД Meta✴ намечено на начало 2027 года. Наконец, самый мощный из готовящихся ускорителей — MTIA 500 — также рассчитан на инференс в сфере генеративного ИИ. Используется конфигурация вычислительных чиплетов 2 × 2, окруженных несколькими стеками HBM и двумя сетевыми чиплетами. Это устройство может использовать от 384 до 512 Гбайт памяти HBM с пропускной способностью до 27,6 Тбайт/с. Показатель TDP достигает 1700 Вт. Заявленная производительность FP8/МХ8 — до 10 Пфлопс, МХ4 — до 30 Пфлопс. Массовое внедрение MTIA 500 запланировано на 2027 год. На системном уровне MTIA 400, 450 и 500 используют одно и то же шасси, стойку и сетевую инфраструктуру. Это обеспечивает возможность модернизации с минимальными затратами при переходе на изделия следующего поколения.

06.08.2025 [15:23], Руслан Авдеев

Meta✴ заказала ИИ-серверы Santa Barbara с кастомными ASICMeta✴ разместила заказ на поставку ИИ-серверов нового поколения на базе ASIC-модулей у тайваньского производителя Quanta Computer. Компания заказала до 6 тыс. стоек и намерена начать развёртывание серверов Santa Barbara к концу 2025 года, сообщает Datacenter Dynamics. Новые серверы заменят существующие решения Minerva. В отчёте также указано, что серверы нового поколения будут иметь TDP более 180 кВт и потребуют тщательно кастомизированных корпусов, систем водяного охлаждения и других компонентов. Все компоненты будут поставляться компанией SynMing Electronics. По данным отчёта, поставкой ASIC займётся Broadcom, а сборкой серверов — Quanta Computer. Окончательный дизайн будет утверждён в текущем квартале, а пробное производство начнётся в IV квартале 2025 года. Как сообщают «источники в цепочке поставок», IT-гигант завершил разработки проектных решений для двух–трёх новых серверов с кастомными ИИ-ускорителями. Хотя прямо ASIC не упоминается, Meta✴ давно работает над собственными ИИ-чипами Meta✴ Training and Inference Accelerator (MTIA), которые разрабатываются с 2023 года. Компания рассчитывает внедрить чипы в собственные дата-центры, чтобы снизить зависимость от NVIDIA.

Источник изображения: UX Indonesia/unspalsh.com С началом бума генеративного ИИ Meta✴ стремится расширить серверную ИИ-инфраструктуру и самостоятельно разрабатывать ASIC. В феврале 2024 года компания, похоже, искала специалистов по ASIC-решениям, размещая объявления о поиске соответствующих сотрудников в Индии и Калифорнии. В марте 2025 года южнокорейская FuriosaAI, занимающийся разработкой микросхем, отклонила предложение Meta✴ о покупке бизнеса за $800 млн. На прошлой неделе были опубликованы результаты за II квартал 2025 года, согласно которым выручка составила $47,5 млрд, что на 22 % больше по сравнению с аналогичным периодом прошлого года. Прибыль компании выросла на 36 %, составив $18,3 млрд за три месяца, заканчивающиеся 30 июня, но расходы Meta✴ также увеличились на 12 %, до $27 млрд, что связано с ростом затрат на дата-центры, серверы и исследователей в области ИИ. На пресс-конференции, посвящённой финансовым результатам компании, было объявлено, что наибольшая часть капитальных затрат в будущем будет направлена на серверы. Также было заявлено, что компания всё ещё решает, когда будут развёртываться новые мощности.

12.03.2025 [00:25], Владимир Мироненко

Meta✴ начала тестирование собственного ускорителя для обучения ИИ-моделейMeta✴ Platforms приступила к тестированию ИИ-ускорителя собственной разработки, который, в случае успеха, позволит ей снизить зависимость от поставок чипов NVIDIA, пишет Reuters со ссылкой на информированные источники. По словам одного из источников, новый чип Meta✴ представляет собой специализированный ускоритель, то есть ASIC, предназначенный для обработки только ИИ-нагрузок. Небольшую пробную партию чипов Meta✴ изготовила тайваньская TSMC. По словам собеседника Reuters, тестирование началось после завершения фазы Tape-out — это заключительный этап разработки чипов перед началом производства, что является значительным маркером успеха в их разработке, отметило Reuters. Обычно этап Tape-out занимает от трёх до шести месяцев, причём без гарантии, что всё пройдёт успешно, и обходится в десятки миллионов долларов. В случае неудачи Meta✴ потребуется диагностировать проблему и начать всё заново. Этот чип представляет собой новое поколение ИИ-ускорителей, разработанных в рамках программы Meta✴ Training and Inference Accelerator (MTIA). Разработка продвигается с переменным успехом уже много лет. В прошлом году Meta✴ добилась определённых успехов — второе поколение ИИ-ускорителей Meta✴ MTIA оказалось втрое быстрее первого. В прошлом году Meta✴ начала использовать MTIAv2 для инференса рекомендательных систем Facebook✴ и Instagram✴.

Источник изображения: Meta✴ Meta✴ сообщила, что планирует к 2026 году начать использовать собственные ИИ-чипы для обучения моделей. Как и в случае с чипом для инференса, новый ИИ-ускоритель сначала пройдёт проверку в работе с рекомендательными системами, после чего его задействуют для приложений генеративного ИИ, таких как чат-бот Meta✴ AI, заявили в Meta✴. Крис Кокс (Chris Cox), директор по продуктам Meta✴, сообщил, что разработка чипов идёт с переменным успехом, отметив, что руководство компании посчитала ИИ-ускоритель для инференса первого поколения «большим успехом». Однако тестовые испытания он провалил, так что в 2022 году компания стала заказывать ускорители NVIDIA. С тех она остаётся крупным клиентом NVIDIA, используя её чипы как для обучения своих моделей, так и для инференса. Meta✴ прогнозирует общие расходы в 2025 году в размере от $114 до $119 млрд, в том числе до $65 млрд капитальных затрат, в основном связанных с расширением ИИ-инфраструктуры. Использование собственных чипов позволит компании значительно снизить затраты на это направление.

04.02.2024 [21:02], Сергей Карасёв

Meta✴ намерена активно внедрять собственные ИИ-ускорители Artemis (MTIA) в качестве альтернативы решениям NVIDIA и AMDВ 2024 году компания Meta✴, по сообщению The Register, после многих лет разработки может начать массовое внедрение собственных ИИ-чипов. Они станут альтернативой ускорителям NVIDIA и AMD, что поможет снизить зависимость от продукции сторонних поставщиков. В 2024 году компания намерена потратить до $37 млрд на развитие своей инфраструктуры. В настоящее время для поддержания ИИ-нагрузок Meta✴ применяет такие решения, как NVIDIA H100. Ожидается, что к концу 2024 года компания будет иметь в своём распоряжении 350 тыс. этих ускорителей. Вместе с тем Meta✴ проявляет интерес и к изделиям AMD Instinct MI300. Ранее компания высоко оценила возможности Qualcomm Cloud AI 100, но отказалась от них из-за несовершенства ПО. Не приглянулись Meta✴ и чипы Esperanto. Сейчас Meta✴ ведёт разработку собственных ИИ-ускорителей.

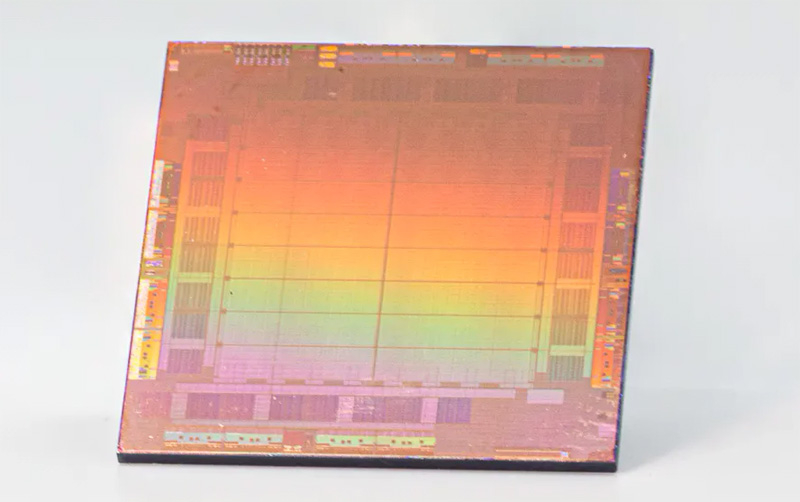

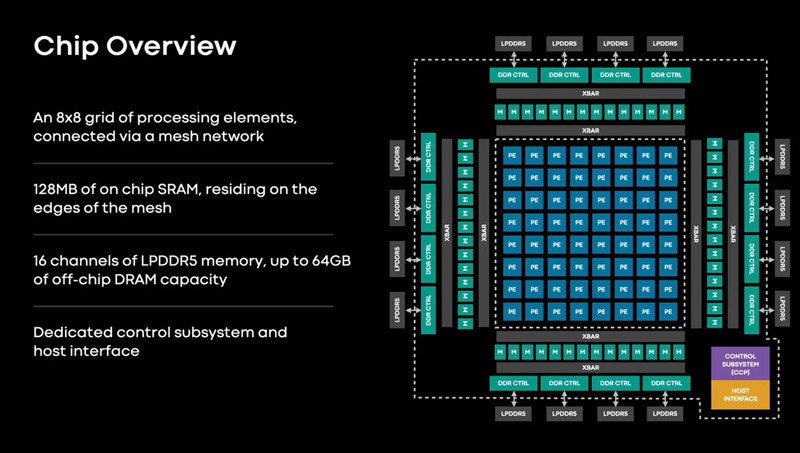

Источник изображения: Meta✴ Весной 2023 года стало известно, что компания создала свой первый ИИ-процессор. Чип под названием MTIA (Meta✴✴ Training and Inference Accelerator; на изображении) представляет собой ASIC в виде набора блоков, функционирующих в параллельном режиме. Задействованы 64 вычислительных элемента в виде матрицы 8 × 8, каждый из которых объединяет два ядра с архитектурой RISC-V. Конструкция включает 128 Мбайт памяти SRAM, а также до 64/128 Гбайт памяти LPDDR5. Показатель TDP равен 25 Вт. Заявленная производительность на операциях INT8 достигает 102,4 TOPS, на операциях FP16 — 51,2 Тфлопс. Процессор производится по 7-нм технологии TSMC.

Источник изображения: Meta✴ Как теперь сообщается, в 2024-м Meta✴ намерена начать активное использование собственных ИИ-ускорителей с кодовым именем Artemis. В их основу лягут компоненты MTIA первого поколения. Чип Artemis, оптимизированный для инференса, будет применяться наряду с ускорителями сторонних поставщиков. При этом, как отметили представители компании, изделия Artemis обеспечат «оптимальное сочетание производительности и эффективности при рабочих нагрузках, специфичных для Meta✴».

Источник изображения: Meta✴ Компания пока не раскрывает ни архитектуру Artemis, ни конкретные рабочие нагрузки, которые будет поддерживать чип. Участники рынка полагают, что Meta✴ будет запускать готовые ИИ-модели на собственных специализированных ASIC, чтобы высвободить ресурсы ускорителей для развивающихся приложений. По данным SemiAnalysis, Artemis получит улучшенные ядра, а компоненты LPDDR5 уступят место более быстрой памяти, использующей технологию TSMC CoWoS. Нужно добавить, что Amazon и Google уже несколько лет используют собственные чипы для ИИ-задач. Например, Amazon недавно ИИ-ускорители Trainium2 и Inferenetia2, тогда как Google в 2023 году представила сразу два новых ускорителя: Cloud TPU v5p и TPU v5e. А Microsoft сообщила о создании ИИ-ускорителя Maia 100.

19.05.2023 [10:20], Сергей Карасёв

Meta✴ представила ИИ-процессор MTIA для дата-центров — 128 ядер RISC-V и потребление всего 25 ВтMeta✴ анонсировала свой первый кастомизированный процессор, разработанный специально для ИИ-нагрузок. Изделие получило название MTIA v1, или Meta✴ Training and Inference Accelerator: оно оптимизировано для обработки рекомендательных моделей глубокого обучения. Проект MTIA является частью инициативы Meta✴ по модернизации архитектуры дата-центров в свете стремительного развития ИИ-платформ. Утверждается, что чип MTIA v1 был создан ещё в 2020 году. Это интегральная схема специального назначения (ASIC), состоящая из набора блоков, функционирующих в параллельном режиме.

Источник изображений: Meta✴ Известно, что при производстве MTIA v1 используется 7-нм технология. Конструкция включает 128 Мбайт памяти SRAM. Чип может использовать до 64/128 Гбайт памяти LPDDR5. Задействован фреймворк машинного обучения Meta✴ PyTorch с открытым исходным кодом, который может применяться для решения различных задач в области компьютерного зрения, обработки естественного языка и пр.  Процессор MTIA v1 имеет размеры 19,34 × 19,1 мм. Он содержит 64 вычислительных элемента в виде матрицы 8 × 8, каждый из которых объединяет два ядра с архитектурой RISC-V. Тактовая частота достигает 800 МГц, заявленный показатель TDP — 25 Вт. Meta✴ признаёт, что у MTIA v1 присутствуют «узкие места» при работе с ИИ-моделями большой сложности: требуется оптимизация подсистем памяти и сетевых соединений. Однако в случае приложений низкой и средней сложности платформа, как утверждается, обеспечивает более высокую эффективность по сравнению с GPU.  В дальнейшем в семействе MTIA появятся более производительные изделия, но подробности о них не раскрываются. Ранее говорилось, что Meta✴ создаёт некий секретный чип, который подойдёт и для обучения ИИ-моделей, и для инференса: это решение может увидеть свет в 2025 году. |

|