Материалы по тегу: hardware

|

27.10.2025 [22:50], Владимир Мироненко

Qualcomm анонсировала ИИ-ускорители AI200 и AI250 — прошлое поколение чипов популярным не стало, но компания обещала исправитьсяQualcomm Technologies представила решения нового поколения для ЦОД, оптимизированные для ИИ-инференса — стоечные суперускорители Qualcomm AI200 и AI250. После их анонса акции Qualcomm подскочили на 15 %, показав самый большой внутридневной рост за более чем шесть месяцев, сообщил Bloomberg. Ожидается, что новые решения станут новой точкой роста компании. Она демонстрировала уверенный рост прибыли в течение последних двух лет, но инвесторы отдавали предпочтение акциям других технологических компаний. Qualcomm AI200 — специализированное стоечное решение для ИИ-инференса, обеспечивающее низкую совокупную стоимость владения (TCO). Платформа оптимизирована для инференса больших языковых и мультимодальных моделей (LLM, LMM) и других ИИ-нагрузок. AI200 включает карты с 768 Гбайт LPDDR. Чип основан на NPU Hexagon, которые используются в последних поколениях Snapdragon. Qualcomm AI250 получил инновационную архитектуру, построенную на принципах предельно близкого расположения быстрой памяти к вычислительным ядрам (Near-Memory Computing, NMC), что обеспечит качественно новый уровень эффективности и производительности ИИ-инференса. По словам Qualcomm, новая архитектура обеспечивает более чем десятикратный прирост эффективной пропускной способности памяти и значительное снижение энергопотребления. Это позволит проводить дезагрегированный ИИ-инференс для более эффективного использования оборудования. Оба продукта будут предлагаться отдельно и в составе стоек с полным жидкостным охлаждением, PCIe-коммутаторами для вертикального масштабирования и Ethernet — для горизонтального, а также поддержкой конфиденциальных вычислений. Энергопотребление стойки составит 160 кВт, что ставит новинки в один ряд с GB200 NVL72. Компания отметила, что её программный ИИ-стек гиперскейл-класса, охватывающий все этапы — от прикладного уровня до системного ПО — оптимизирован для ИИ-инференса. Стек поддерживает ведущие фреймворки машинного обучения, механизмы инференса, фреймворки генеративного ИИ и методы оптимизации инференса LLM/LMM, такие как дезагрегированное обслуживание. Обещаны бесшовный перенос моделей и развёртывание моделей платформы Hugging Face в один клик посредством библиотеки Efficient Transformers и пакета Qualcomm AI Inference Suite от Qualcomm. Qualcomm отметила, что её ПО предоставляет готовые к использованию приложения и ИИ-агенты, комплексные инструменты, библиотеки, API и сервисы. Прошлое поколение ускорителей CloudAI 100 не снискало успеха во многом из-за слабой программной экосистемы. От этого же страдала и AMD, которая ускоренными темпами навёрстывает упущенное. Qualcomm AI200 и AI250 поступят в продажу в 2026 и 2027 годах соответственно. Qualcomm также сообщила, что придерживается ежегодного плана развития направления ЦОД, ориентированного на достижение лидирующей в отрасли производительности ИИ-инференса, энергоэффективности и минимальной совокупной стоимости владения (TCO). Кроме того, компания решила вернуться на рынок серверных процессоров. Первым заказчиком анонсированных решений Qualcomm станет саудовский государственный ИИ-стартап Humain, который планирует развернуть 200 МВт ИИ ЦОД на базе новых чипов, начиная с 2026 года. Ранее было заключено соглашение с Cerebras, в рамках которого планировалось использовать для инференса именно чипы Qualcomm, в том числе в Саудовской Аравии. Ещё одним крупным игроком в ИИ-сделках здесь является Groq. Qualcomm запоздало пытается занять заметную долю рынка ИИ-оборудования. Компания считает, что новые решения в области памяти и энергоэффективности, основанные на технологиях для мобильных устройств, привлекут клиентов, несмотря на относительно поздний выход на рынок. Под руководством Криштиану Амона (Cristiano Amon) компания стремится диверсифицировать бизнес, больше не полагаясь на смартфоны, рост продаж которых замедлился. Qualcomm «занимала эту нишу, не торопясь и наращивая мощь», — заявил Дурга Маллади (Durga Malladi), старший вице-президент компании. По его словам, Qualcomm ведёт переговоры со всеми крупнейшими заказчиками о развёртывании стоек на базе своего оборудования.

27.10.2025 [16:10], Руслан Авдеев

Aligned Data Centers и Calibrant Energy развернут «первое в своём роде» аккумуляторное энергохранилище для ЦОД ёмкостью 62 МВт∙чКомпания Aligned Data Centers объединила усилия с Calibrant Energy для создания в США «первой в своём роде» системы хранения энергии на основе АКБ (BESS), которая позволит ввести строящийся ЦОД в эксплуатацию на годы раньше, чем планировалось. Такой компромиссный вариант позволяет не дожидаться полноценной модернизации местной энергосети и вместе с тем не требует полностью автономного питания ЦОД. В рамках соглашения Calibrant в 2026 году построит BESS мощностью 31 МВт (62 МВт∙ч) для кампуса ЦОД Aligned Pacific Northwest в Хиллсборо (Hillsboro, Орегон). BESS является многообещающим решением в условиях продолжающегося дефицита электроэнергии для ЦОД. В данным конкретном случае BESS отслеживает состояние региональной энергосети. Энергохранилище предназначено для разрядки в периоды пикового спроса, что повышает стабильность работы и энергосети, и ЦОД. Наличие такой BESS ускоряет одобрение регулятором присоединения к сети. Речь идёт о первом случае в США, когда аккумуляторное энергохранилище специально строится для ускорения подключения к энергосети и обеспечения крупного ЦОД. По словам Aligned, стратегический проект меняет подходы к росту на рынках с ограниченным предложением электроэнергии. BESS позволяет превратить «потенциальную сетевую нагрузку» в «динамический сетевой актив» для ускорения роста бизнеса. Aligned представила планы создания крупного кампуса ЦОД в Хиллсборо ещё в 2023 году. Кампус находится в орегонском регионе Silicon Forest («Кремниевый лес») к западу от Портленда, наряду с объектами Intel, Flexential и QTS. По завершении строительства кампус площадью около 11 га будет обеспечен мощностью более 100 МВт. Сейчас техасская Aligned Data Centers управляет в США 50 объектами общей мощностью 5 ГВт. Партнёры подтвердили, что рассматривают реализацию аналогичных проектов и на других рынках. Новость появилась вскоре после того, как консорциум, включающий NVIDIA, BlackRock, Microsoft и xAI объявил о покупке Aligned Data Centers за $40 млрд.

27.10.2025 [13:42], Руслан Авдеев

BNP Paribas: только инвестиции в ИИ удерживают экономику США от рецессииПо словам финансовых экспертов, в США сложилась ситуация, при которой рецессию в экономике страны предотвращают преимущественно капитальные вложения в сферу ИИ. Строительство инфраструктуры ЦОД и разработка ИИ-моделей обеспечивают экономический рост на фоне потрясений, характерных для других секторов экономики, сообщает The Register. Как свидетельствуют многочисленные источники, это компенсирует негативное влияние высоких процентных ставок и «хаотичную» торговую политику президента США. По словам BNP Paribas, именно ИИ удержал экономику от рецессии. Подчёркивается, что рост расходов убедил бизнесы в неизбежности устойчивого роста. Как считают эксперты Apollo Global Management, «в настоящее время роста корпоративных капиталовложений помимо ИИ практически нет». Несмотря на повышение ставок ФРС, расходы на ИИ практически не сократились — в отличие от типичного поведения инвесторов в таких случаях. Это объясняется тем, что инвестиции в ЦОД в конечном счёте финансируются за счёт роста стоимости акций компаний «великолепной семёрки», включая Microsoft, Amazon, Alphabet и NVIDIA. По расчётам Omdia, мировые капиталовложения в дата-центры в 2025 году превысят $657 млрд, это почти вдвое больше, чем пару лет назад, а основным игроком остаются США. Только годовые расходы Amazon на дата-центры превышают $100 млрд, что примерно равно ВВП Коста-Рики.

Источник изображения: Vitaly Gariev/unspalsh.com По расчётам некоторых экспертов, 92 % экономического роста США в первых двух кварталах 2025 года пришлось на оборудование и ПО для обработки информации. Предполагается, что в конечном счёте ИИ будет помогать экономике, позволяя делать больше с меньшими затратами. Отчасти это уже происходит, но революционных изменений пока не отмечено. Это подтверждается многочисленными исследованиями, свидетельствующими, что несмотря на миллиардные вливания в ИИ, окупаемость инвестиций в этой сфере остаётся неопределённой. Проведённое в США исследование показало, что бизнес инвестировал в ИИ-инициативы десятки миллиардов долларов, но 95 % из них не получили никакой отдачи. По оценкам консультантов Bain & Company, при сохранении нынешней кривой расходов технологический сектор должен обеспечивать к 2030 году продаж в сфере ИИ на $2 трлн ежегодно, поэтому велики опасения относительно формирования очередного финансового пузыря. О вероятности формирования пузыря сообщали Goldman Sachs и Банк Англии. Особенно беспокоит аналитиков оценка OpenAI в $500 млрд, поскольку компания, хотя и известная революционными технологиями, пока не приносит прибыли. Сам её глава Сэм Альтман (Sam Altman) признал, что отрасль ИИ находится в пузыре, но сам он, похоже, не видит в этом ничего страшного, даже с учётом того, что в недавнем отчёте появилась информация, что компания теряет приблизительно втрое больше денег, чем зарабатывает. Правда, фактически за её услуги платят лишь 5 % из 800 млн пользователей ChatGPT.

27.10.2025 [13:26], Владимир Мироненко

Миллиард туда, миллиард сюда: Supermicro снизила прогноз по выручке, но не видит оснований для беспокойстваSupermicro опубликовала предварительный отчёт в преддверии оглашения результатов за I квартал 2026 финансового года, завершившийся 30 сентября, которые будут обнародованы 4 ноября. Ожидаемая выручка компании в минувшем квартале составит $5 млрд при собственном прогнозе от $6,0 до $7,0 млрд. Снижение выручки объясняется тем, что из-за изменений в конструкции поставляемого оборудования завершение работ переносится на следующий квартал, то есть для беспокойства нет никакого повода. Однако инвесторы не приветствуют подобные «сюрпризы», и стоимость акций Supermicro упала, пишет The Register. Акционеры компании уже сталкивались с подобными новостями, когда Supermicro сообщила в апреле предварительные финансовые результаты за III квартал 2025 финансового года, закончившийся 31 марта — выручка оказалась ниже прогноза более чем на $1 млрд. Компания объявила об этом после задержки с предоставлением годового отчёта за 2024 год, поскольку у руководства не было уверенности в корректности внутренней отчётности. Нанятый аудитор Ernst & Young отказался от дальнейшего сотрудничества, что поставило Supermicro под угрозу делистинга на фондовой бирже NASDAQ, хотя в итоге проблемы были решены. Согласно отчёту, «недавние проекты получили более $12 млрд, поставка которых запланирована на II квартал 2026 финансового года». Также указано, что наблюдается устойчивый спрос на системы Supermicro на базе NVIDIA GB300, B300, RTX Pro, AMD 355X LC, поставки которых уже начались. The Register оценил позитивно обе новости, поскольку речь идёт новом оборудовании для ИИ-вычислений, которое в настоящее время пользуется высоким спросом, и $12 млрд представляет собой крупную сумму, которая составляет более трети от $33 млрд выручки, прогнозируемой Supermicro на весь 2026 финансовый год. Перенос реализации проекта на II квартал из-за модернизации вызывает интерес, поскольку нет информации о характере манипуляций, вызвавших задержку. The Register полагает, что задержка вызвана необходимостью закупки деталей, не включенных в первоначальную сделку (возможно, других ускорителей или большего объёма памяти, компонентов, которых не хватает), а это означает, что Supermicro не сможет выполнить поставку согласно указанной в контракте конфигурации.

27.10.2025 [11:16], Сергей Карасёв

Axelera AI представила ИИ-чип Europa с производительностью 629 TOPSНидерландский стартап Axelera AI анонсировал ИИ-ускоритель (AIPU) под названием Europa, предназначенный для таких задач, как генеративные сервисы и приложения компьютерного зрения. По заявлениям разработчиков, чип может использоваться в оборудовании разного класса — от периферийных устройств до корпоративных серверов. В состав Europa AIPU входят восемь «ядер ИИ второго поколения», которые используют векторные движки и технологию цифровых вычислений в оперативной памяти (D-IMC), разработанные специалистами Axelera. Заявленная ИИ-производительность достигает 629 TOPS на операциях INT8. Кроме того, чип содержит 16 специализированных векторных ядер с архитектурой RISC-V, сгруппированных в два кластера: они предназначены для операций пред- и постобработки, не связанных с ИИ. Пиковая производительность блока RISC-V достигает 4915 GOPS (млрд операций в секунду). Интегрированный декодер H.264/H.265 ускоряет выполнение медиазадач. Процессор располагает 256-бит интерфейсом памяти LPDDR5 с пропускной способностью 200 Гбайт/с и 128 Мбайт памяти L2 SRAM. Новинка будет предлагаться в различных форм-факторах, включая компактное исполнение с размерами 35 × 35 мм и карты расширения PCIe 4.0 х4 в различных конфигурациях, в частности, с одним чипом и 16 Гбайт памяти, а также с четырьмя чипами и 256 Гбайт памяти. Разработчикам предоставляет комплект Voyager SDK, который позволяет полностью раскрыть потенциал процессора. В целом, как утверждается, новинка обеспечивает в 3–5 раз более высокую производительность в расчёте на 1 Вт и $1 по сравнению с ведущими отраслевыми решениями в той же категории. Поставки Europa AIPU и PCIe-карт начнутся в I половине 2026 года.

27.10.2025 [10:09], Руслан Авдеев

Для майнинга и ИИ: ГЭС Itaipu запитает дата-центры американской X8 Cloud и канадской Hive DigitalАмериканский стартап X8 Cloud Infrastructure заявил о намерении построить в Парагвае комплекс ИИ ЦОД и облачных сервисов с использованием энергии местной ГЭС Itaipu. Та же электростанция поможет и расширению дата-центра Yguazu компании Hive Digital из Канады, сообщает Datacenter Dynamics. На днях X8 Cloud подписала соглашение с Национальным управлением по электроснабжению Парагвая (Ande) о строительстве «крупнейшей ИИ-инфраструктуры в Латинской Америке». Утверждается, что площадка близ Асунсьона (Asunción) обеспечит в регионе доступ к ИИ-технологиям мирового уровня, но по цене до 70 % ниже общепринятой. Первый ЦОД мощностью 50 МВт заработает в начале 2026 года, а к 2027 году мощность доведут до 500 МВт. Объекты будут питаться исключительно от ГЭС Itaipu, эксплуатацией которой совместно занимаются Бразилия и Парагвай. Установленная мощность станции составляет 14 ГВт. Сообщается, что ЦОД обеспечит бразильским компаниям ИИ-инфраструктуру под юрисдикцией США, при этом соответствующую бразильским нормативам защиты данных, с прозрачным управлением. Кроме того, X8 Cloud обещает низкие затраты на обучение ИИ-моделей и инференс. В будущем компания намерена расширить свою деятельность на территории Бразилии и Аргентины, доведя мощности до 5 ГВт. Канадский криптомайнер Hive Digital Technologies также объявил о расширении деятельности в регионе — мощность ЦОД Yguazu, целиком запитанного от той же ГЭС, будет увеличена с 300 МВт до 400 МВт к III кварталу 2026 года. Компания объявила о бизнес-планах в Парагвае в 2024 году, а затем приобрела площадку у Bitfarms в январе 2025 года. По данным компании, Yguazu уже приносит 8,5 BTC/день. После обновления кампуса ЦОД он станет крупнейшим объектом такого рода в стране, а Hive будет располагать 540 МВт возобновляемой энергии в трёх странах: 400 МВт в Парагвае, по 140 МВт в Канаде и Швеции. Рост майнинга биткоинов в Парагвае поддерживается местными законами. В частности, использование энергии для майнинга не облагается налогами с 2027 года, причём льготы касаются именно криптомайнинга. Именно ГЭС, возможно, позволит превратить Парагвай в региональный хаб ЦОД.

27.10.2025 [08:47], Руслан Авдеев

Монголия рассчитывает привлечь инвестиции в развитие ЦОДВласти Монголии надеются привлечь в страну операторов и застройщиков ЦОД. По словам главы Фонда национального благосостояния Монголии им. Чингисхана Темуулен Баяраа (Temuulen Bayaraa), страна располагает огромной территорией и очень благоприятным климатом для размещения ЦОД, сообщает Datacenter Dynamics. В интервью CNBC глава фонда добавила, что в стране уже работают над созданием специальных экономических зон для размещения дата-центров. Фонд национального благосостояния, основанный в 2024 году, имеет в резерве на $1,4 млрд и намерен привлечь инвесторов доступом к «чистой» энергии. Структура управляется государственной холдинговой компанией Erdenes Mongol, которой принадлежит часть горнодобывающих активов страны. К особым экономическим зонам относится проект «умного» города Хунну (Hunnu City) в 50 км от Улан-Батора. Город должен занять площадь 31 тыс. га, запитан он будет от геотермальных электростанций.

Источник изображения: Vince Gx/unsplash.com В целом рынок дата-центров в Монголии пока очень мал. По данным Data Center Map, в Монголии имеется всего два дата-центра, причём оба в Улан-Баторе: правительственный ЦОД и ЦОД местной телеком-компании Unitel. По статистике Uptime Institute, в стране пять ЦОД, имеющих сертификат Tier II: по два принадлежат XacBank и Khan Bank, а один — Банку Монголии. Все пять находятся в районе Улан-Батора. О наличии собственных ЦОД также говорят S Systems (Shunkhlai Group) и Mobinet (Newcomm Group). Строительством дата-центров занимается и монгольская IT-компания CT Group JSC. Впрочем, привлекательность монгольских территорий для инвесторов, желающих строить дата-центры — под вопросом. В соседнем регионе Внутренняя Монголия (Китай) наспех построенные избыточные мощности ЦОД так и остались невостребованными. Дело в том, что заказчики из густонаселённых восточных районов предпочитают использовать новые кампусы на западе исключительно для хранения, но не обработки данных. Этому мешают высокая задержка доступа, а также дороговизна каналов связи.

26.10.2025 [14:20], Сергей Карасёв

d-Matrix представила систему SquadRack для ИИ-инференса со сверхнизкой задержкойКомпания d-Matrix анонсировала систему SquadRack — стоечное решение для пакетного инференса со сверхнизкой задержкой. Это, как утверждается, первый в отрасли продукт данного класса. В его разработке приняли участие специалисты Arista, Broadcom и Supermicro. В основу SquadRack положена серверная платформа Supermicro X14 AI. Судя по изображениям, используется модель SYS-522GA-NRT, которая допускает установку двух процессоров Intel Xeon 6900 (Granite Rapids) и 24 модулей оперативной памяти DDR5-8800. Доступны 24 фронтальных отсека для SFF-накопителей U.2/U.3 (NVMe). Устройство выполнено в форм-факторе 5U. Система SquadRack предусматривает использование ускорителей d-Matrix Corsair. Их архитектура основана на модифицированных ячейках SRAM для вычислений в памяти (DIMC), работающих на скорости около 150 Тбайт/с. По заявлениям d-Matrix, решение обеспечивает непревзойдённую производительность ИИ-инференса: быстродействие достигает 2,4 Пфлопс (8-бит вычисления). Кроме того, задействованы IO-карты d-Matrix JetStream, предназначенные для распределения нагрузок инференса. Одна такая карта может обслуживать до четырёх экземпляров Corsair, обеспечивая сетевую задержку на уровне 2 мкс. Решение SquadRack также оборудовано PCIe-коммутаторами Broadcom для масштабирования в пределах одного узла. В свою очередь, связь между узлами обеспечивают коммутаторы Arista Leaf Ethernet, подключённые к картам JetStream. Применяется программный стек d-Matrix Aviator. В одну стойку могут быть установлены до восьми экземпляров SquadRack, что позволяет с высокой скоростью обрабатывать модели ИИ, насчитывающие до 100 млрд параметров. В целом, возможно масштабирование до сотен узлов в нескольких серверных стойках.

26.10.2025 [14:15], Сергей Карасёв

Micron представила 192-Гбайт модули памяти SOCAMM2 для ИИ-серверовКомпания Micron Technology анонсировала компактные модули оперативной памяти SOCAMM2 (Small Outline Compression Attached Memory Modules), предназначенные для использования в серверах для задачи ИИ. Изделия, выполненные на энергоэффективных чипах LPDDR5X, имеют ёмкость 192 Гбайт. Модули SOCAMM первого поколения были анонсированы в марте нынешнего года. Их размеры составляют 14 × 90 мм. При изготовлении применяется техпроцесс DRAM 1β (пятое поколение 10-нм класса), а объём равен 128 Гбайт. Решения SOCAMM2 производятся по наиболее передовой технологии Micron — DRAM 1γ (шестое поколение памяти 10-нм класса). По сравнению с оригинальными модулями ёмкость SOCAMM2 увеличилась в полтора раза при сохранении прежних габаритных размеров. Энергетическая эффективность при этом повысилась более чем на 20 %. По сравнению с сопоставимыми по классу решениями DDR5 RDIMM энергоэффективность улучшена более чем на 66 %. Заявленная скорость передачи данных достигает 9,6 Гбит/с на контакт. Таким образом, по заявлениям Micron, технологии, положенные в основу SOCAMM2, превращают маломощную память LPDDR5X, изначально разработанную для смартфонов, в эффективные решения для дата-центров. При этом модульная конструкция SOCAMM2 и инновационная технология стекирования повышают удобство обслуживания и облегчают проектирование серверов с жидкостным охлаждением. Пробные поставки образцов новой памяти уже начались. Micron принимает активное участие в разработке спецификации JEDEC SOCAMM2 и тесно сотрудничает с отраслевыми партнёрами с целью вывода решений на коммерческий рынок. Пока что модули SOCAMM используются в NVIDIA GB300.

25.10.2025 [22:49], Сергей Карасёв

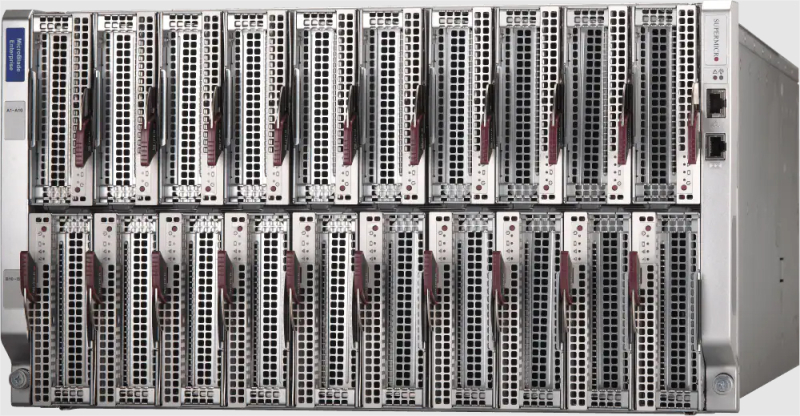

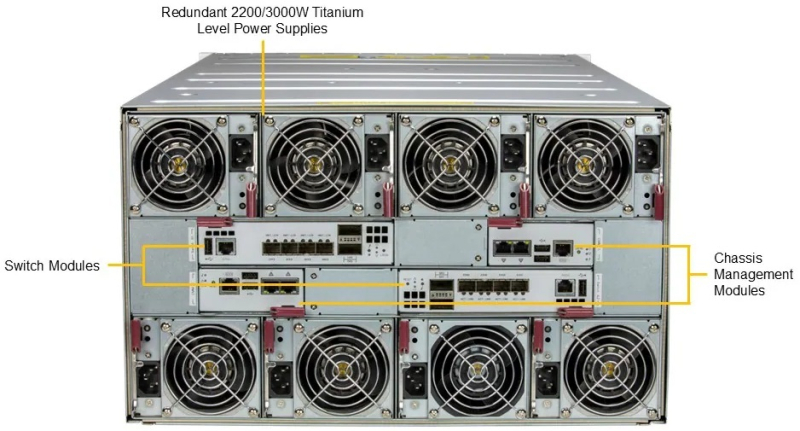

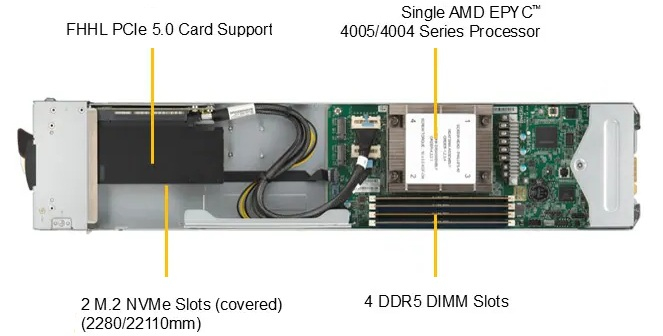

Микрооблако с микро-EPYC: Supermicro представила 20-узловой сервер на базе процессоров AMD GradoКомпания Supermicro анонсировала сервер 6U20N MicroBlade (MBA-315R-1G x20), построенный на аппаратной платформе AMD. Система может применяться для решения таких задач, как облачные вычисления, ИИ-инференс, веб-хостинг, потоковая передача видео и пр.

Источник изображений: Supermicro Устройство, выполненное в форм-факторе 6U, имеет 20-узловую конфигурацию. Каждый узел может нести на борту один процессор EPYC 4005 Grado с 16 вычислительными ядрами (32 потока) и показателем TDP до 170 Вт. Применяется воздушное охлаждение. Доступны четыре слота для модулей оперативной памяти DDR5-5600 суммарным объёмом до 192 Гбайт. Каждый узел оснащён двумя сетевыми интерфейсами 25GbE на базе Mellanox ConnectX-4, контроллером Aspeed AST2500 BMC и двумя коннекторами M.2 для SSD (NVMe). Опционально могут устанавливаться два накопителя U.2 (NVMe). Кроме того, возможен монтаж GPU-ускорителя формата FHHL с интерфейсом PCIe 5.0. Сервер 6U20N MicroBlade может нести на борту два Ethernet-коммутатора и два модуля управления. Питание обеспечивают восемь блоков мощностью 2200/3000 Вт с сертификатом 80 Plus Titanium. Диапазон рабочих температур простирается от +10 до +35 °C. В одну серверную стойку стандарта 48U могут быть установлены до восьми таких систем, что в сумме даст 160 вычислительных узлов. В целом, как отмечается, серверы MicroBlade на процессорах EPYC 4005 построены на основе уникальной модульной архитектуры Supermicro, которая обеспечивает сокращение количества кабелей до 95 %, экономию пространства до 70 % и снижение энергопотребления на 30 % по сравнению с традиционными серверами типоразмера 1U. |

|