Материалы по тегу: all-flash

|

09.02.2026 [10:09], Сергей Карасёв

Synology готовит сетевое хранилище FS200T на шесть SATA SSDКомпания Synology, по сообщению NAS Compares, готовит к выпуску NAS в «настольном» форм-факторе FS200T на аппаратной платформе Intel. Устройство, ориентированное прежде всего на небольшие офисы, поступит в продажу во II половине текущего года. Применён процессор Celeron J4125 поколения Gemini Lake Refresh. Чип содержит четыре ядра (без многопоточности) с тактовой частотой 2,0–2,7 ГГц. Показатель TDP равен 10 Вт. Объём оперативной памяти DDR4 в базовой конфигурации составляет 4 Гбайт (без поддержки ECC), в максимальной — 8 Гбайт (два модуля SO-DIMM). Устройство располагает шестью фронтальными отсеками для SFF-накопителей с интерфейсом SATA-3 (допускается горячая замена). По имеющейся информации, могут применяться только фирменные SSD семейства Synology SAT5200 корпоративного класса: стоимость таких изделий варьируется от €160 за модель вместимостью 480 Гбайт до €1900 за вариант на 7 Тбайт. Таким образом, в максимальной конфигурации цена NAS перевалит за €11 тыс. Впрочем, как ожидается, в дальнейшем будет обеспечена поддержка накопителей сторонних производителей, что снизит общую стоимость. Хранилище оснащено одним портом 2.5GbE (RJ45) и одним портом 1GbE (RJ45), а также двумя разъёмами USB 3.2 Gen1 (5 Гбит/с). Габариты составляют 121 × 151 × 175 мм, масса — 1,4 кг. В тыльной части располагается вентилятор охлаждения диаметром 80 мм. Задействована фирменная программная платформа Synology DiskStation Manager (DSM) с набором экосистемных приложений.

08.02.2026 [15:03], Сергей Карасёв

До 1,4 Пбайт и 60 Гбайт/с в 1U: вышла All-Flash СХД TrueNAS R60Компания TrueNAS анонсировала высокопроизводительные СХД семейства R60, ориентированные на задачи ИИ и НРС, а также на приложения, связанные с анализом данных. Устройства типа All-Flash выполнены в форм-факторе 1U, а максимальная внутренняя вместимость может превышать 1 Пбайт. Дебютировали модификации TrueNAS R60-S и TrueNAS R60-P: первая оснащена неназванным процессором с 16 вычислительными ядрами (32 потока), вторая — с 32 (64 потока). Объём оперативной памяти DDR5-6400 составляет соответственно 64–128 Гбайт и 256 Гбайт. Во фронтальной части располагаются 12 отсеков для SFF-накопителей с интерфейсом PCIe 4.0 или PCIe 5.0 (NVMe); возможна горячая замена. Могут использоваться SSD вместимостью до 122 Тбайт. Таким образом, в максимальной конфигурации суммарная ёмкость достигает 1,46 Пбайт, а с учётом компрессии 2,5:1 эффективная ёмкость составляет до 3,6 Пбайт. Пропускная способность, как утверждается, составляет до 60 Гбайт/с. Обе модели допускают подключение до четырёх дисковых полок SAS, а старшая версия — двух полок NVMe. Общая вместимость может достигать 7 Пбайт. Системы хранения оснащаются одним или двумя сетевыми портами 400GbE и двумя или четырьмя портами 200/100/25GbE. Имеется также выделенный сетевой порт управления. Питание обеспечивают два блока с резервированием (сертификация 80 Plus Titanium). Типовое энергопотребление находится в пределах 350–600 Вт. Диапазон рабочих температур простирается от +10 до +35 °C. Габариты составляют 710 × 438 × 43,5 мм. Говорится о поддержке протоколов SMB v1/2/3, NFSv3 и v4, AFP, FTP, WebDAV, iSCSI, NVMe-oF (TCP, RDMA/RoCE) и S3, а также гипервизоров KVM, Citrix XenServer, Microsoft Hyper-V. Используется открытая файловая система OpenZFS, обеспечивающая высокую надёжность, защиту от повреждения данных, моментальные снимки и автоматическое восстановление в случае сбоев. Заявлена совместимость с облачными платформами iX-Storj, Amazon S3, BackBlaze B2 Cloud, Google Cloud и Microsoft Azure.

03.02.2026 [08:38], Владимир Мироненко

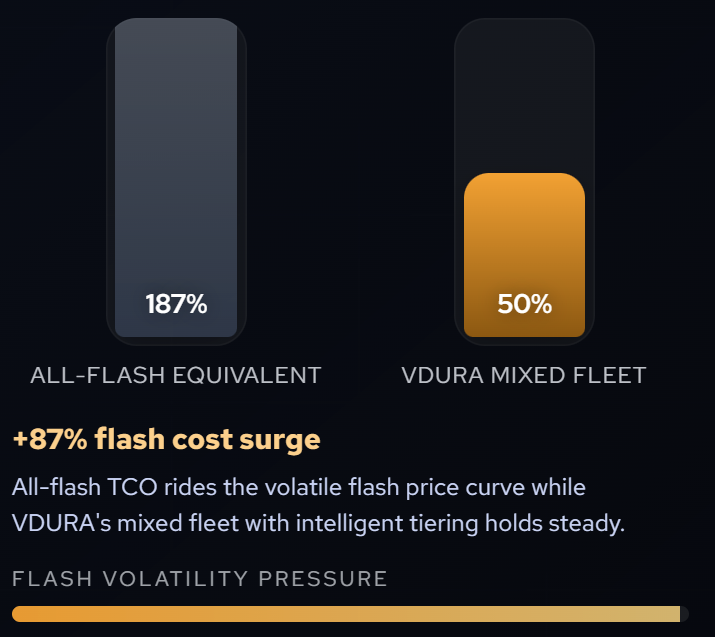

VDURA предложила программу Flash Relief Program для смягчения дефицита флеш-памятиVDURA, заявившая, что теперь SSD корпоративного класса уже в 16 раз дороже HDD аналогичной ёмкости, анонсировала программу Flash Relief Program, в рамках которой клиенты получат доступ к хранилищам, по ёмкости и быстродействию не уступающие массивам VAST Data и WEKA, но вполовину дешевле с точки зрения TCO. В условиях дефицита NAND-памяти цены на SSD выросли в два-три раза, а гибридная архитектура VDURA, использующая накопители разных типов, обеспечивает превосходную производительность и ёмкость при вдвое меньшей стоимости, заявила компания.

Источник изображения: VDURA Как сообщает VDURA, клиенту достаточно предоставить требования к конфигурации файлового хранилища VAST, WEKA или любой другой высокопроизводительной All-Flash СХД, включая требования по производительность (пропускная способность, IOPS, задержка) и требования к ёмкости (сырая, полезная, эффективная), а VDURA в течение 24 ч. предоставит конкурирующее предложение, которое:

VDURA называет следующие преимущества своего продукта:

Предложение VDURA заключается в том, что её гибридная параллельная ФС на основе SSD/HDD может компенсировать рост цен на SSD лучше, чем что-либо, предлагаемое производителями массивов All-Flash, отметил ресурс Blocks & Files. Если цены на SSD продолжат расти и не будет решена проблема дефицита, подобные заявления могут заставить потенциальных покупателей массивов All-Flash переключиться на гибридные системы СХД с автоматическим многоуровневым хранением данных. И даже использование б/у SSD, как предлагает VAST Data, вряд ли поможет в такой ситуации.

30.01.2026 [10:54], Владимир Мироненко

Спасите наши SSD: VAST Data запустила программу VAST Amplify для повышения эффективности использования имеющихся накопителейВ ответ на растущий дефицит флеш-памяти компания VAST Data, специализирующаяся на инфраструктуре для ИИ, представила программу VAST Amplify, разработанную для того, чтобы помочь организациям увеличить эффективную ёмкость имеющихся у них SSD. Взаимодействие компании с клиентом в рамках VAST Amplify проходит в несколько этапов. Сначала производится исследование инфраструктуры, в ходе которого VAST анализирует всю среду хранения данных клиента, чтобы выявить участки недоиспользуемых SSD, фрагментации между разрозненными системами и связанные с устаревшей архитектурой потери, которые снижают эффективную ёмкость. Затем следует быстрая квалификация платформы — процесс быстрой сертификации существующих серверов и SSD клиента для использования в экосистеме VAST, позволяющий обойти зависимость от новых окон распределения оборудования. После этого с помощью восстановления и интеграции мощностей перепрофилированное оборудование объединяется в единое унифицированное пространство имён на базе ОС VAST AI. Это преобразует фрагментированную, привязанную к серверам флеш-память в глобально доступный пул высокопроизводительного хранилища, где мощность может динамически распределяться для любого приложения, устраняя ограничения, связанные с серверными границами или устаревшими архитектурами. Защита данных осуществляется на уровне платформы с использованием высокоэффективного кодирования с исправлением ошибок, а не традиционных методов, требующих интенсивной репликации и потребляющих в два-три раза больше «сырого» места. Это увеличивает полезную ёмкость при сохранении отказоустойчивости в масштабе. Как сообщается, программа обеспечивает шестикратное увеличение эффективной ёмкости, благодаря использованию базовой архитектуры VAST Data — Disaggregated Shared Everything (DASE) — и набору передовых программных технологий. В отличие от традиционных систем, которые выполняют редукцию данных в изолированных узлах или томах, подход VAST является глобальным и всеобъемлющим. Одним из ключевых элементов является непрерывная глобальная редукция на основе сходства. Эта технология ищет и устраняет повторяющиеся паттерны данных по всему кластеру хранения, а не только в одном файле, наборе данных или томе. Это позволяет существенно увеличить эффективную ёмкость при фиксированном объёме флеш-памяти, особенно в ИИ-средах, где наборы обучающих данных могут содержать огромное количество похожей или дублирующейся информации. Большую роль играет архитектура записи, оптимизированная для SCM (Storage Class Memory). Все входящие данные сначала записываются в сверхбыстрый SCM-буфер, что позволяет системе «поглощать» случайные и «импульсные» записи, а затем интеллектуально организовывать и записывать данные на базовые SSD большими последовательными блоками, что снижает коэффициент усиления записи, повышает износостойкость и срок службы флеш-накопителей, поддерживая при этом низкую задержку без необходимости использования дорогостоящего оборудования с избыточным резервированием. Благодаря сочетанию этих методов, операционная система VAST AI OS позволяет значительно увеличить эффективную ёмкость при фиксированном объёме физической флеш-памяти, говорит компания. Впрочем, Dell, крупный поставщик более традиционных СХД, не одобряет подход VAST Data, который фактически подразумевает использование б/у SSD.

25.01.2026 [14:36], Сергей Карасёв

Пир во время чумы: ExaGrid представила 17-Пбайт All-Flash СХД для резервного копированияКомпания ExaGrid анонсировала новые системы хранения типа All-Flash, предназначенные для резервного копирования больших объёмов информации. Устройства, как утверждает производитель, обеспечивают высокий уровень безопасности, включая «воздушный зазор». В серию вошли четыре модели — EX90-SSD, EX135-SSD, EX270-SSD и EX540-SSD. Все они выполнены в форм-факторе 2U. «Сырая» вместимость составляет соответственно 131, 184, 369 и 737 Тбайт, полезная ёмкость — 108, 161, 323 и 645 Тбайт. Новинки могут масштабироваться до 32 устройств в одной системе, что позволяет формировать платформы резервного копирования общим объёмом до 17,3 Пбайт. По заявлениям ExaGrid, на сегодняшний день это самый высокий показатель для решений такого класса.

Источник изображения: ExaGrid Системы ExaGrid имеют двухуровневую архитектуру. Это, в частности, зона приёма (Landing Zone), куда поступают необработанные данные: восстановление отсюда осуществляется максимально быстро. Второй уровень — зона хранения (Repository Zone), недоступная для сети: этот слой использует дедупликацию, из-за чего время восстановления увеличивается. Устройства построены на фирменном софте ExaGrid 8. Говорится о совместимости с большим количеством приложений и утилит резервного копирования, включая Veeam, Commvault, Rubrik, NetBackup, Cohesity, Oracle RMAN Direct и пр. Среди ключевых возможностей упомянуты средства автоматического обнаружения угроз и защиты (выявляют аномалии, уведомляют о рисках и обеспечивают восстановление информации), неизменяемые объекты данных, функция отложенного удаления, различные варианты аварийного восстановления. Реализована блокировка времени хранения данных на основе искусственного интеллекта для восстановления после атак программ-вымогателей.

21.01.2026 [13:03], Сергей Карасёв

Dell представила All-Flash СХД PowerStore 5200Q для QLC SSDКомпания Dell расширила ассортимент СХД серии PowerStore, анонсировав модель 5200Q типа All-Flash. Новинка позволяет сформировать интеллектуальное хранилище, обеспечивающее ускорение работы с блочными, файловыми и виртуальными томами. Устройство выполнено на аппаратной платформе Intel. Применены два контроллера, функционирующие в режиме «активный — активный». В общей сложности задействованы четыре неназванных процессора Xeon с 96 вычислительными ядрами, работающими на частоте 2,2 ГГц. Объём оперативной памяти составляет 1152 Гбайт. СХД имеет типоразмер 2U. Во фронтальной части расположены 25 отсеков для SFF-накопителей NVMe. Могут применяться SSD на основе чипов памяти QLC вместимостью 15,36 и 30,72 Тбайт. Питание обеспечивают два блока с резервированием. В общей сложности могут быть использованы до 24 сетевых Front-end-портов в следующей конфигурации: 16 × FC16/32, 24 × 10GbE, 24 × 10/25GbE или 8 × 100GbE. Секция Back-end включает порты 100GbE QSFP. Кроме того, предусмотрен выделенный сетевой порт управления 1GbE. Говорится о поддержке протоколов FC, NVMe/FC, iSCSI, NVMe/TCP, NFSv3/4/4.1/4.2; CIFS SMB 2/3.0/3.02/3.1.1, FTP и SFTP. В связке с СХД могут функционировать до трёх модулей расширения формата 2U, рассчитанных на 24 накопителя SFF (NVMe) каждый. Таким образом, в общей сложности система с учётом устройств расширения может содержать до 93 накопителей SFF и четыре изделия NVRAM. В составе кластера количество SSD может достигать 372 штук при суммарной вместимости 23,6 Пбайт с учётом компрессии. В качестве программной платформы применяется PowerStore OS.

17.01.2026 [13:25], Владимир Мироненко

Дефицит — не оправдание: Dell против б/у SSD в СХДDell предостерегла компании от повторного использования SSD на фоне острого дефицита флеш-памяти, связанного с бурным развитием ИИ-технологий. По словам компании, флеш-накопители изнашиваются со временем, а повторное использование старых носителей увеличивает вероятность ускоренного выхода из строя, недоступности, а в худшем случае катастрофической потери данных. В связи с тем, что ситуация с дефицитом SSD может продолжаться в течение ближайших 12 мес. и даже более, VAST Data стала придерживаться стратегии Flash Reclaim, в рамках которой предполагается повторное использование клиентами накопителей, перемещая SSD из СХД её конкурента, например, Dell PowerScale, в шасси под управлением ПО VAST. Как утверждает VAST, её ПО позволяет лучше справляться с сокращением объёма данных и требует меньше места на SSD при защите от сбоев, что обеспечивает возможность хранения большего объёма данных. Дэвид Ной (David Noy), вице-президент по управлению продуктами в Dell, ранее занимавший пост вице-президента по управлению продуктами в VAST Data, отметил, что предложенная VAST Data «переработка» флеш-накопителей как стратегия — отличный маркетинговый ход, но не более. «Это может звучать прагматично, но несёт в себе реальный риск. Для поставщиков ПО для хранения данных это признак того, что в отчаянные времена требуются отчаянные меры», — заявил он ресурсу Blocks & Files. В отличие от поставщиков AFA, таких как VAST и Pure, Dell поддерживает многоуровневое хранение данных на устройствах All-Flash, гибридных и дисковых массивах. Это даёт гибкость и возможность задействовать меньше SSD. Ной утверждает, что у компаний, специализирующихся только на поставках AFA, мало места для манёвра при изменении рыночной конъюнктуры. Нет многоуровневого хранения, нет гибкости и нет запаса прочности на случай роста цен на флеш-память или увеличения сроков поставки. «Мы не заставляем клиентов переходить на флеш-память. И это важно — особенно с учётом того, что цены на флеш-память растут быстрее, чем на жёсткие диски, в то время как дисковые накопители остаются в несколько раз более экономичными для больших объёмов данных», — заявил он.

12.01.2026 [09:54], Владимир Мироненко

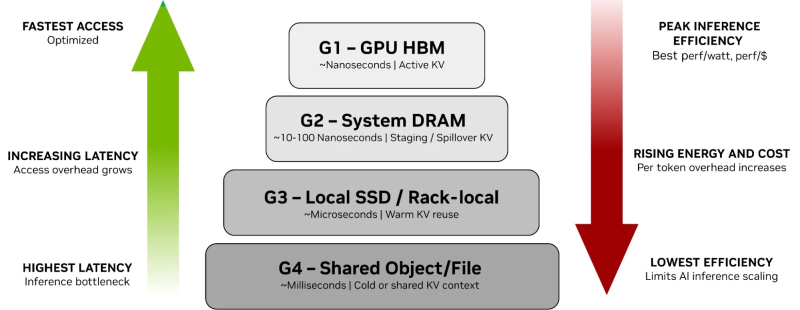

От NVMe к GPU: NVIDIA представила платформу хранения контекста инференса ICMSPВместе с официальным анонсом ИИ-платформы следующего поколения Rubin компания NVIDIA также представила платформу хранения контекста инференса NVIDIA Inference Context Memory Storage Platform (ICMSP), позволяющую решить проблемы хранения KV-кеша, который становится всё крупнее по мере роста LLM и решаемых задач. При выполнении инференса контекст растёт по мере генерации новых токенов, часто превышая доступную память ускорителя. В этом случае старые записи вытесняются из памяти, сначала в системную память, а потом на диск, чтобы не пересчитывать всё заново, когда они снова понадобятся. Проблемы существенно усугубляются при работе с агентным ИИ и обработке рабочих нагрузок с большим контекстом. Агентный ИИ приводит к появлению контекстных окон в миллионы токенов, а объём моделей может составлять уже триллионы параметров. В настоящее время эти системы полагаются на долговременную память для хранения контекста, позволяя агентам опираться на предыдущие рассуждения и расширять их на протяжении многих шагов, а не начинать с нуля при каждом запросе. По мере увеличения контекстных окон растут требования к ёмкости KV-кеша, делая эффективное хранение и повторное использование данных, в том числе совместное использование различными сервисами инференса, крайне важными для повышения производительности системы. Контекст инференса является производным и пересчитываемым, что требует архитектуры хранения, которая отдаёт приоритет энергоэффективности и экономичности, а также скорости и масштабируемости, а не традиционной надёжности хранения данных. NVIDIA отметила, что ИИ-фабрикам необходим дополнительный, специально разработанный уровень контекста, который рассматривает KV-кеш как собственный класс данных, предназначенный для ИИ, а не принудительно помещает его в дефицитную память HBM или в хранилище общего назначения. Платформа ICMSP использует DPU BlueField-4 для создания специализированного уровня памяти, чтобы преодолеть разрыв между высокоскоростной памятью GPU и масштабируемым общим хранилищем. Хранилище KV-кеша на основе NVMe должно эффективно обслуживать ускорители, узлы, стойки и кластеры целиком, говорит компания. Платформа ICMSP создаёт новый уровень (G3.5 на схеме выше) — флеш-память, подключённая через Ethernet и оптимизированная специально для KV-кеша. Этот уровень выступает в качестве долговременной агентной памяти на уровне ИИ-инфраструктуры, достаточно большой для одновременного хранения общего, развивающегося контекста многих агентов, но при этом достаточно близко расположенной для частой работы с памятью ускорителей и хостов. BlueField-4 отвечает за аппаратное ускорение размещения кеша и устранение накладных расходов на подготовку и перемещение данных и обеспечение безопасного, изолированного доступа к ним узлов с GPU, снижая зависимость от CPU хоста и минимизируя сериализацию и работу с системной памятью хоста. Программные продукты, такие как фреймворк DOCA, механизм разгрузки KV-кеша Dynamo и входящее в комплект ПО NIXL (Nvidia Inference Transfer Library), обеспечивают интеллектуальное, ускоренное совместное использование данных KV-кеша между ИИ-узлами. А Spectrum-X Ethernet обеспечивает оптимизированный RDMA-интерконнект, который связывает ICMS и узлы GPU. KV-кеш принципиально отличается от корпоративных данных: он является временным, производным и может быть пересчитан в случае потери. В качестве контекста инференса он не требует надёжности, избыточности или обширных механизмов защиты данных, разработанных для долговременных записей. Выделяя KV-кеш как отдельный, изначально предназначенный для ИИ класс данных, ICMS устраняет избыточные накладные расходы, обеспечивая повышение энергоэффективности до пяти раз по сравнению с универсальными подходами к хранению данных, сообщила NVIDIA. А своевременная подготовка и отдача данных более полно нагружает ускорители, что позволяет увеличить темп генерации токенов до пяти раз. Как сообщила NVIDIA, первоначальный список её партнёров, готовых обеспечить поддержку ICMSP с BlueField-4, который будет доступен во II половине 2026 года, включает AIC, Cloudian, DDN, Dell, HPE, Hitachi Vantara, IBM, Nutanix, Pure Storage, Supermicro, VAST Data и WEKA.

30.12.2025 [12:39], Сергей Карасёв

Intel Core Ultra, 6 × SSD и 6″ сенсорный дисплей: представлен мобильный NAS UnifyDrive UP6Компания UnifyDrive представила мобильное сетевое хранилище данных UP6 с уникальным набором характеристик. Новинка, ориентированная на профессиональных пользователей, позволяет работать с большими массивами информации в полевых условиях без необходимости использования ноутбука или внешнего источника питания. Устройство выполнено на процессоре Intel Core Ultra 5 125H поколения Meteor Lake: чип объединяет 14 вычислительных ядер в конфигурации 4Р+8Е+2LPE (18 потоков) с максимальной тактовой частотой 4,5 ГГц. В состав изделия входят графический блок Intel Arc и нейропроцессорный узел Intel AI Boost с ИИ-производительностью до 11 TOPS на операциях INT8. Объём оперативной памяти DDR5 может достигать 96 Гбайт (базовая конфигурация NAS включает 16 Гбайт ОЗУ). Хранилище UnifyDrive UP6 оснащено флеш-модулем eMMC 5.1 вместимостью 32 Гбайт, слотами SD UHS-II и CFexpress. Предусмотрены коннекторы для шести SSD формата М.2 с интерфейсом PCIe 4.0: суммарная ёмкость может достигать 48 Тбайт (6 × 8 Тбайт). Присутствуют адаптеры Wi-Fi 6 (802.11ax) с поддержкой диапазонов 2,4/5 ГГц (Intel AX201) и Bluetooth 5.2, сетевой контроллер 10GbE (RJ45), два порта Thunderbolt 4 (40 Гбит/с), по одному порту USB 3.2 Gen2 Type-А и USB Type-C. Одной из особенностей новинки является встроенный сенсорный дисплей с диагональю 6″ и разрешением 2160 × 1080 пикселей. Через него можно управлять настройками, просматривать медиаматериалы и пр. Для вывода изображения на внешний монитор имеется интерфейс HDMI 2.1 (4K/60 Гц). К хранилищу может быть подключён внешний ускоритель на базе GPU для повышения производительности при выполнении ИИ-задач. Ещё одна особенность — внутренняя аккумуляторная батарея, выполняющая функции источника бесперебойного питания: её зарядка хватит примерно на два часа автономной работы NAS. Устройство заключено в корпус с габаритами 170 × 147 × 43 мм, а масса составляет около 1,3 кг. Внешнее питание подаётся через разъём USB PD Type-C (19 В / 6,32 A). Приём заказов на новинку уже начался: цена начинается с $1600. Поставки будут организованы в январе наступающего года.

09.12.2025 [11:17], Сергей Карасёв

«Карманный» NAS Youyeetoo NestDisk для четырёх М.2 SSD оснащён парой портов 2.5GbEКомпания Youyeetoo выпустила компактное сетевое хранилище NestDisk на аппаратной платформе Intel Alder Lake-N. Устройство, заключенное в корпус с размерами 146 × 97,5 × 32 мм, может использоваться для создания частного облака в офисных или домашних условиях. Базовая конфигурация предусматривает использование чипа Intel Processor N150 (4C/4T; до 3,6 ГГц; 6 Вт) с графическим ускорителем Intel UHD Graphics. В наиболее мощном варианте применяется процессор Core 3 N355 (8C/8T; до 3,9 ГГц; 15 Вт). Объём оперативной памяти LPDDR5 может составлять 6, 12 или 16 Гбайт. В оснащение входит флеш-модуль eMMC вместимостью 64 Гбайт. Внутри есть место для четырёх NVMe SSD формата M.2 2280 с интерфейсом PCIe 3.0 x2 (один из слотов также поддерживает установку SATA-накопителя) суммарной вместимостью до 16 Тбайт. Скорость передачи данных достигает 1969 Мбайт/с. Допускается формирование массивов RAID 0/1/5/6. Устройство располагает двумя сетевыми портами 2.5GbE RJ45 на базе контроллера Intel I226V, тремя портами USB 3.1 Type-A и аудиогнездом на 3,5 мм. Возможен вывод изображения одновременно на три дисплея через два интерфейса HDMI 2.0 и разъём USB 3.2 Gen2 Type-C (DisplayPort). Присутствуют адаптеры Wi-Fi 6 и Bluetooth 5.2. Питание подаётся через дополнительный коннектор USB Type-C от сетевого блока мощностью 65 Вт. Для охлаждения задействован вентилятор диаметром 30 мм с низким уровнем шума. NAS использует программную платформу OpenMediaVault на ядре Linux. Но при необходимости можно загрузить TrueNAS, Unraid, Ubuntu и даже Windows. Цена начинается со €170 в варианте с чипом Intel Processor N150 и 12 Гбайт ОЗУ. |

|