Материалы по тегу: ии

|

05.08.2025 [11:28], Владимир Мироненко

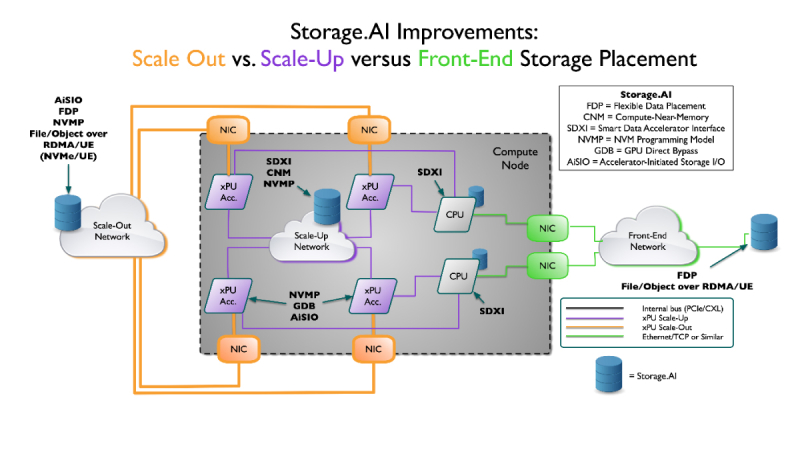

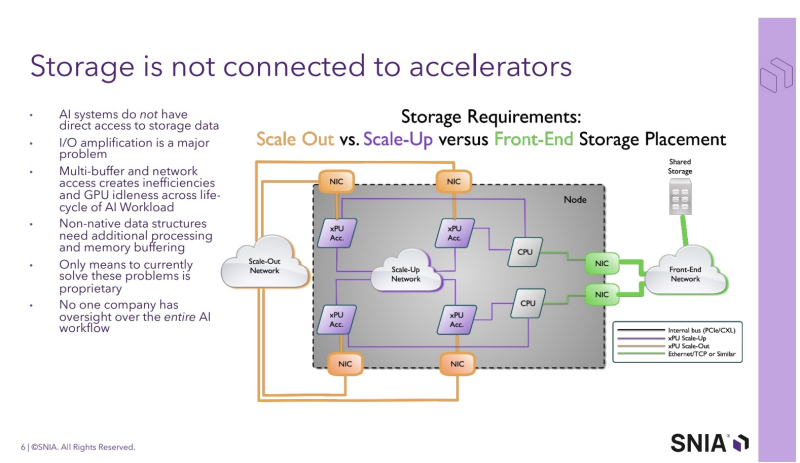

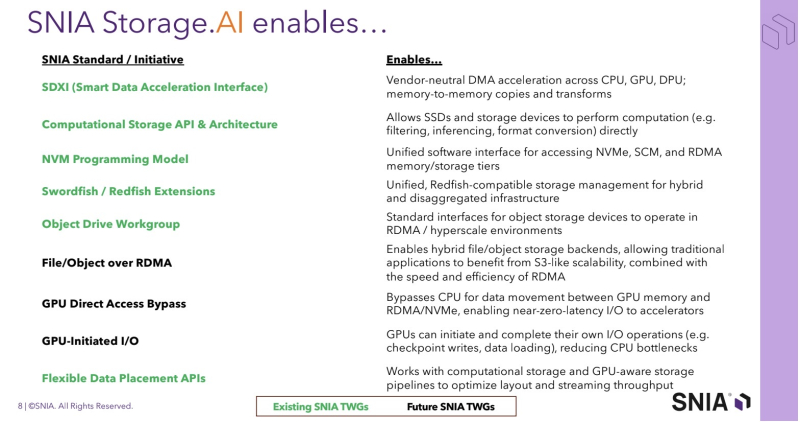

SNIA анонсировала проект Storage.AI для стандартизации обработки ИИ-нагрузокStorage Networking Industry Association (SNIA) — некоммерческая организация, специализирующаяся на технологиях обработки и оптимизации данных — анонсировала проект Storage.AI, основанный на открытых стандартах для эффективных сервисов обработки данных, связанных с рабочими ИИ-нагрузками. Проект будет сфокусирован на стандартных для отрасли, непатентованных и нейтральных подходах к решению задач, связанных с обработкой данных для ИИ, с целью оптимизации производительности, энергоэффективности и экономичности соответствующих рабочих процессов. К инициативе уже присоединились AMD, Cisco, DDN, Dell, IBM, Intel, KIOXIA, Microchip, Micron, NetApp, Pure Storage, Samsung, Seagate, Solidigm и WEKA. Отдельно отмечается отсутствие NVIDIA — крупнейшего поставщика ИИ-ускорителей. Как указано в пресс-релизе, рабочие ИИ-нагрузки чрезвычайно сложны и ограничены такими факторами, как задержки, доступное пространство, энергопотребление и охлаждение, объём памяти и стоимость. Решение этих проблем в рамках открытой отраслевой инициативы рассматривается как наиболее быстрый путь к оптимизации и широкому внедрению ИИ. По словам Дж. Метца (J Metz), председателя SNIA, беспрецедентные требования со стороны ИИ требуют целостного взгляда на весь конвейер данных — от храненилищ и памяти до сетевых технологий и вычислений. Он подчеркнул, что Storage.AI предоставляет отраслевому сообществу независимую от вендоров платформу, предназначенную для координации широкого спектра сервисов обработки данных и создания эффективных, открытых решений, необходимых для ускоренного внедрения ИИ-технологий. Инициатива координирует ряд технических спецификаций, которые до сих пор существовали обособленно и не были адаптированы под нужды ИИ-нагрузок. Первоначальный набор спецификаций включает:

Предполагается, что в рамках проекта Storage.AI будет создана открытая экосистема эффективных сервисов обработки данных, способных справляться с наиболее сложными задачами, связанными с ИИ-нагрузками, и устранять текущие пробелы в обработке и доступе к данным. В обеспечении широкой поддержки экосистемы также примут участие партнёры SNIA, включая UEC, NVM Express, OCP, OFA, DMTF и SPEC.

05.08.2025 [10:00], Сергей Карасёв

«Базис» внедрил нейросетевые технологии для повышения эффективности процессов«Базис», крупнейший российский разработчик решений для управления динамической ИТ-инфраструктурой, внедрил нейросетевые технологии в бизнес-процессы, связанные с реагированием на инциденты и технической поддержкой продуктов. Использование генеративного искусственного интеллекта позволило на 20–50 % уменьшить затраты времени на рутинные операции, а скорость выполнения связанных с ними задач выросла до 6 раз. В результате эффективность труда выросла, а заказчики компании получили более качественный и оперативный сервис. Разработанные специалистами «Базиса» решения базируются на открытых языковых моделях, способных понимать естественный язык, анализировать большие объёмы технической документации и генерировать программный код. Они интегрированы в существующие рабочие процессы компании и функционируют как цифровые помощники, берущие на себя рутинные операции. Работа нейросети — в том числе её обучение и применение (инференс) — организована в изолированном защищённом контуре. Все инструменты размещены внутри собственной инфраструктуры компании — такой подход обеспечивает полный контроль над данными и исключает риски, связанные с использованием внешних сервисов. Ключевые результаты внедренияСокращение времени реакции на инциденты.Время, которое ответственный инженер тратил на организацию работы в случае инцидента, сократилось на 70 %. Если раньше ему приходилось вручную формировать рабочие группы, создавать коммуникационные каналы и готовить первичную информацию о проблеме, то после внедрения нейросетевых технологий эти процессы были автоматизированы. В результате все необходимые специалисты в максимально короткий срок получают структурированную информацию об инциденте и могут немедленно приступать к его устранению, что критически важно для обеспечения бесперебойной работы сервисов. В планах есть дальнейшее развитие этого направления: на цифрового помощника будет возложен учёт и контроль процесса решения инцидента, ведение его хронологии, он будет «участвовать» в обсуждении и анализе логов, подготовке черновика отчёта и ретроспективы по инциденту. Мгновенный поиск информации.На базе нейросети создан интеллектуальный помощник (цифровой техлид), который мгновенно находит ответы в корпоративной базе знаний и предоставляет готовые решения. Система анализирует запросы пользователей, находит релевантную информацию среди сотен технических документов и формирует точные ответы с конкретными инструкциями. Особенно важно, что помощник успешно обрабатывает запросы даже при нечётких формулировках, понимая суть проблемы и предлагая оптимальные пути решения. Он также предоставляет пользователю процесс размышления и список ссылок на использованную для генерации ответа документацию. Это позволяет специалисту заметить нюансы, которые помощник мог упустить, или прийти к более глубокому пониманию проблемы.

Источник изображения: «Базис» Ускорение разработки скриптов и тестов.Рутинные задачи по написанию несложного кода, которые раньше отнимали часы работы квалифицированных специалистов, теперь выполняются за 10–15 минут. Производительность при решении этих задач выросла в 3–4 раза. Нейросеть взяла на себя написание скриптов, создание тестов и анализ существующих решений. «Внедрение нейросетевых технологий стало логичным шагом в развитии нашей компании. Мы не просто следуем технологическим трендам — мы создаём практические инструменты, которые реально повышают эффективность работы. И за последние полгода мы добились значительных результатов, в том числе благодаря коллегам из "Публичного облака" РТК-ЦОД, которые помогли нам с организацией инфраструктуры. Постепенно мы переходим от простой автоматизации рутинных задач и подготовки документации к интеграции нейросетевых технологий с другими нашими системами и процессами. Это позволит повысить эффективность нашей работы и, как следствие, обеспечить нашим заказчикам более оперативный и качественный сервис», — отметил Денис Романов, директор департамента Professional services компании «Базис».

04.08.2025 [16:21], Руслан Авдеев

AEP увеличит мощности подключений ЦОД на 18 ГВт к 2029 году — Exelon, PPL и PG&E прогнозируют ещё десяткиКлючевая для США коммунальная группа American Electric Power (AEP) сообщила о планах увеличить электрические мощности для ЦОД на 18 ГВт к 2029 году. Не менее впечатляющие цифры обнародовали и некоторые другие коммунальные компании США, а некоторые даже превзошли AEP, сообщает Datacenter Dynamics. В финансовом отчёте AEP за II квартал говорится о росте операционной прибыли на акцию, что в первую очередь обусловлено увеличением числа подключаемых дата-центров. Именно на их долю придётся наибольшая часть новой нагрузки из 24 ГВт, прогнозируемой к концу десятилетия. Благодаря развитию рынка ЦОД объём проектов в очереди на подключение к сети вырос до 190 ГВт, что привело к увеличению пятилетнего инвестиционного плана на 30 % — до $70 млрд. Средства распределены на развитие передачи электроэнергии (50 %), генерации (40 %) и распределительных сетей (10 %). Сообщается, что на все 24 ГВт уже подписаны будущие соглашения, что защищает от возможных колебаний спроса.

Источник изображения: Randy Laybourne/unsplash.com Энергокомпания зафиксировала рост пикового спроса на электроэнергию более чем на 4 ГВт по сравнению с прошлым годом. Основная причина — ввод в эксплуатацию новых ЦОД в Индиане, Огайо и Техасе. По словам руководства компании, район её ответственности чрезвычайно привлекателен для операторов ЦОД: здесь есть достаточное количество оптоволоконных соединений, доступ к воде и крупнейшая в стране ЛЭП, включая магистральную сеть на 765 кВ. Впрочем, в компании признают, что в сфере ЦОД остаётся немало нерешённых задач. Приоритет AEP — предложение инновационных решений. Особо отмечено соглашение с AWS и Cologix о поставке электроэнергии с помощью твёрдооксидных топливных элементов Bloom Energy. В прошлом году AEP Ohio подписала с Bloom соглашение о поставке до 1 ГВт для ЦОД. Также подчёркивается важность нового законодательства для ЦОД. Недавно регуляторы в Огайо утвердили нормы, согласно которым новые дата-центры должны будут оплачивать не менее 85 % заявленной ежемесячной потребности в энергии, даже если фактическое потребление окажется меньше, — для покрытия расходов на инфраструктуру. Тем временем Exelon объявила, что в очереди на подключение к её сетям находятся ЦОД общей мощностью 33 ГВт. Компания обслуживает более 10 млн клиентов в Делавэре, Иллинойсе, Мэриленде, Нью-Джерси, Пенсильвании и Вашингтоне, контролируя шесть коммунальных предприятий. Из этих 33 ГВт 17 ГВт уже находятся в очереди на подключение, а ещё 16 ГВт, вероятно, будут официально добавлены в этом году. От общего объёма 10 % должны быть подключены к 2028 году, ещё треть — к 2030-му и 75 % — к 2034-му. Для удовлетворения спроса владелец сетей даже рассматривает возможность строительства собственных электростанций. Правда, в нескольких штатах такая практика запрещена по антимонопольным соображениям, но законы могут пересмотреть на фоне энергодефицита. В целом финансовые показатели компании заметно различаются по штатам.

Источник изображения: Miguel Bruna/unsplash.com Также появились данные о показателях за II квартал крупнейшей в Калифорнии коммунальной компании Pacific Gas and Electric Company (PG&E). Сейчас в очереди на подключение к её сетям находятся ЦОД суммарной мощностью 10 ГВт, которые должны быть подключены в течение ближайших десяти лет. Ещё в мае речь шла о 8,7 ГВт, а в феврале — о 5,5 ГВт. Из этих 10 ГВт 17 проектов дата-центров суммарной мощностью 1,5 ГВт находятся в завершающей стадии проектирования. Их ввод в эксплуатацию намечен на 2026–2030 гг. Большинство объектов расположено в Кремниевой долине. Предполагается, что подключения благоприятно скажутся на стоимости электричества для налогоплательщиков, обеспечив экономию на уровне 1–2 % в месяц. Кроме того, рост спроса позволит активнее использовать энергетическую инфраструктуру: по данным PG&E, в зоне ответственности компании она задействована лишь на 45 %. При этом компания сможет получать за это больше дохода. Однако, несмотря на прогресс в подключении ЦОД, финансовые показатели PG&E во II квартале оказались слабыми: операционные и эксплуатационные расходы выросли на 3,7 %. Ранее компанию обвиняли в причастности к пожарам из-за неудовлетворительного обслуживания сетей, что вынудило увеличить расходы. В прошлом году компания объявила о планах построить три ЦОД в Сан-Хосе (San Jose) общей мощностью 200 МВт. Проект реализуется совместно с Westbank. В прошлом месяце PG&E подписала первое в своём роде соглашение с Сан-Хосе об оптимизации и гарантиях поставок энергии для дата-центров и других крупных клиентов. Также недавно компания заключила соглашение с бизнесом Smart Wires о проекте по повышению надёжности сети и поддержке роста энергопотребления ЦОД в Сан-Хосе. Наконец, PPL Electric, которая в основном обслуживает Пенсильванию, объявила, что запросы со стороны ЦОД вырастут с 800 МВт в 2026 году до 14,4 ГВт в 2034-м. Часть проектов общей мощностью 5 ГВт уже были публично анонсированы. Среди них гигантский ИИ ЦОД AWS стоимостью $20 млрд, а также целый ряд других объектов поменьше. В конце 2024 года сообщалось, что в 2028 году на дата-центры США может прийтись уже 12 % энергопотребления всей страны.

04.08.2025 [14:17], Владимир Мироненко

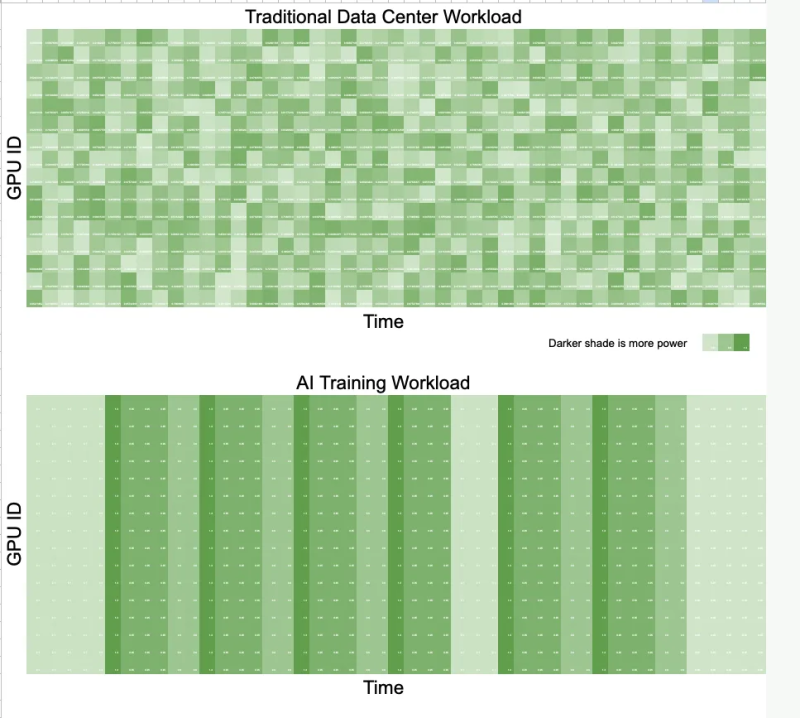

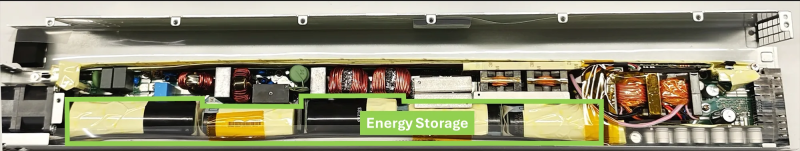

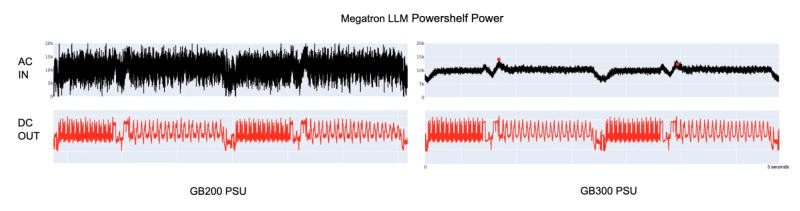

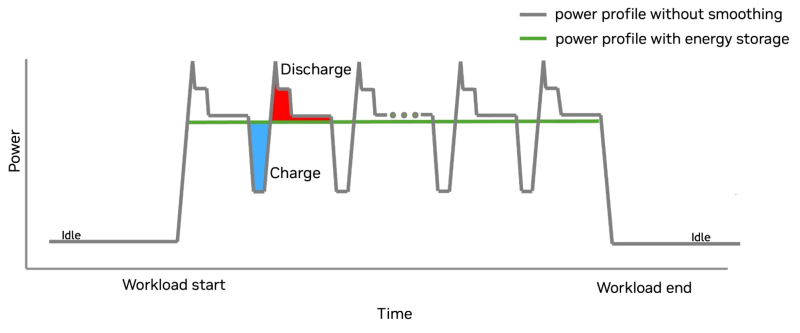

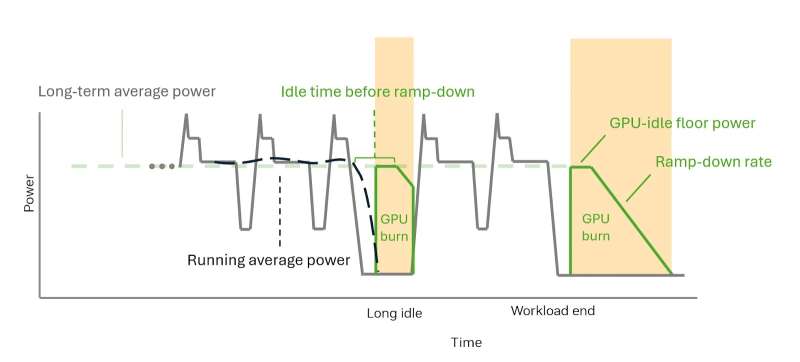

Суперускоритель с «батарейкой» — NVIDIA GB300 NVL72 получили особые блоки питания для сглаживания энергопотребленияNVIDIA представила решение для платформы GB300 NVL72, которое позволяет смягчать колебания напряжения, вызванные синхронной работой тысяч ускорителей (GPU) при работе ИИ-систем, и снижать пиковую нагрузку на сеть до 30 %. Подобные колебания крайне негативно влияют на энергосеть и других потребителей. Новое решение NVIDIA также будет использоваться в системах GB200 NVL72. В процессе обучения ИИ-моделей тысячи ускорителей работают синхронно и выполняют одни и те же вычисления с разными данными. Эта синхронизация приводит к колебаниям мощности на уровне сети — падению напряжения или появлению излишков энергии при внезапных простоях, в отличие от традиционных рабочих нагрузок ЦОД, где ускорители работают асинхронно и некоррелированные задачи «сглаживают» нагрузку. Meta✴ даже пришлось в качестве временной меры добавить в PyTorch опцию PYTORCH_NO_POWERPLANT_BLOWUP, которая загружает ускорители бессмысленной работой в моменты простоя. Для решения этой проблемы компания оснастила NVIDIA GB300 блоком питания с конденсаторами, т.е. накопителями энергии, разработанными с привлечением компании LITEON Technology, а также необходимым аппаратным и программным обеспечением. На разных этапах работы системы используется несколько механизмов, включая ограничение мощности, накопление энергии и «сжигание» энергии — функция NVIDIA GPU Burn. Электролитические конденсаторы обеспечивают равномерное энергопотребление непосредственно в стойке. Они занимают почти половину объёма БП и обеспечивают накопление 65 джоулей энергии на каждый ускоритель. Накопитель (конденсатор) заряжается при низком потреблении энергии ускорителем и разряжается при высоком. Этот своего рода буфер помогает снизить колебания энергопотребления, что продемонстрировано в сравнительных тестах GB200 и GB300 при одинаковой нагрузке. GB300 снижает пиковую нагрузку на сеть на 30 %, обеспечивая при этом аналогичную мощность для ускорителей. GB300 ограничивает скачки, пошагово увеличивая энергопотребление ускорителя. Ограничение по мощности увеличивается постепенно, в соответствии с возможностями сети. По завершении задания, программный драйвер, реализующий алгоритм сглаживания энергопотребления, активирует аппаратное снижение энергопотребления. Ускоритель продолжает потреблять постоянную мощность благодаря функции NVIDIA GPU Burn, ожидая возобновления нагрузки. Если нагрузка не возобновляется, ускоритель плавно снижает энергопотребление. Если нагрузка на ускоритель возобновляется, функция NVIDIA GPU Burn мгновенно отключается. После завершения нагрузки ускоритель с помощью NVIDIA GPU Burn постепенно снижает энергопотребление со скоростью, соответствующей возможностям сети, а затем отключается. Эти параметры контролируются такими настройками, как минимальное энергопотребление в режиме ожидания и время постепенного снижения нагрузки, которые можно настроить с помощью NVIDIA SMI или Redfish. Такой полный контроль энергопотребления снижает нагрузку на электросеть и делает планирование заданий более предсказуемым. Как отметил ресурс The Futurum Group, благодаря предложенной NVIDIA схеме питания ЦОД больше не нужно строить с учётом пиковых потребностей в мощности. Вместо этого их можно масштабировать ближе к средним показателям использования, что означает возможность размещения большего количества оборудования в том же пространстве или снижение общих затрат на электроэнергию. Суперконденсаторы в качестве энергетического буфера для всего объекта целиком предлагает Siemens, хотя уже есть и более компактные решения размером со стойку. Кроме того, поскольку сглаживание потребления мощности ограничено стойкой без её подачи обратно в сеть, операторы получают больше контроля над энергопотреблением. Такое сочетание аппаратного и программного обеспечения обеспечивает масштабируемость и делает ЦОД дружественными к энергосети, независимо от того, используют ли они системы GB200 или GB300 NVL72. Как отметил ресурс ServeTheHome, использование дополнительных аккумулирующих модулей в стойке, предложенное LITEON, также поможет более равномерному распределению нагрузки между крупными ИИ-кластерами. Сантьяго Грихальва (Santiago Grijalva), профессор электротехники и вычислительной техники в Технологическом институте Джорджии, назвал новую технологию «довольно серьёзным событием», учитывая доминирующую роль NVIDIA в этой области. «Но это решение ограничено высококлассными системами NVIDIA, — указал он в электронном письме ресурсу Utility Dive. — Это решение конкурирует с решениями Tesla и аппаратными оптимизациями Meta✴, предлагая существенное, но не революционное усовершенствование существующих методов управления питанием».

04.08.2025 [10:16], Руслан Авдеев

Новый ИИ ЦОД в Вайоминге будет потреблять больше энергии, чем все дома штатаСогласно расчётам компании Rocky Mountain Power, новый ИИ-объект в Вайоминге, вероятно, будет потреблять больше электричества, чем все жилые дома штата вместе. Это лишь очередное свидетельство тренда, когда ИИ-инфраструктура развивается быстрее, чем может адаптироваться энергетическая инфраструктура. Это ставит новые задачи перед коммунальными службами, правительствами и потребителями, сообщает TechRepublic. На днях сообщалось, что Crusoe и Tallgrass построят в Вайоминге ИИ ЦОД мощностью 1,8 ГВт. Поскольку обучение ИИ-моделей и инференс становятся всё более ресурсоёмкими задачами, крупные ЦОД меняют подход к энергопотреблению и водопользованию в США. Согласно отраслевым оценкам, на дата-центры уже приходится 4,4 % потребления местного электричества, а к 2028 году оно может вырасти до 12 %. По другим оценкам, в 2028 году на дата-центры США может прийтись уже 12 % энергопотребления всей страны. Некоторые коммунальные компании предупреждают, что спрос на электроэнергию в США может вырасти на 50 % за 5 лет. Отмечается, что с такими темпами роста не может справиться ни один штат. В некоторых случаях планируется строительство гигаваттных ЦОД. При этом обращение к ИИ обычно дороже простого интернет-поиска — например, типичный запрос в ChatGPT требует около 2,9 Вт·ч, а при стандартном веб-поиске расходуется около 0,3 Вт·ч. Растущая нагрузка на энергосистему уже ведёт к изменению стратегии местных коммунальных компаний. Так, Pacific Gas & Electric (PG&E) отказалась выводить из эксплуатации три угольные электростанции, а операторы электросетей Техаса экстренно объявили об ожидаемом росте спроса на электричество. Более того, при президенте Дональде Трампе похоже, готовы и вовсе покончить с «зелёной повесткой». Вайоминг уже стал ключевой локацией для размещения новой ИИ-инфраструктуры благодаря «географической стабильности» и подключению к национальной энергетической магистрали, проложенной вдоль трассы I-80. Компании вроде Microsoft и Meta✴ ведут свою деятельность в штате. Планируемый Meta✴ ЦОД гиперскейл-уровня площадью более 364 га недалеко от Шайенна (Cheyenne) должен заработать в течение трёх лет.

Источник изображения: Gustavo Quepóns/unsplash.com Немалую роль играет и связанное с ИИ потребление воды, особенно в засушливых регионах. Многие ИИ-ЦОД применяют испарительные системы охлаждения, потребляющие немало водных ресурсов. Каждый ЦОД, по некоторым оценкам, может потреблять 2 тыс. м³ воды в день, что приблизительно эквивалентно водопотреблению 6,5 тыс. американских домохозяйств. Особенно сложная ситуация обстоит в западных штатах США, таких как Невада, Юта и Колорадо, где уже наблюдается дефицит воды. Так, в некоторых районах Невады прогнозируется спрос на электричество, который может потребовать расширения энергосистемы штата на 40 % в следующие 10 лет. Front Range в Колорадо намерена утроить мощность ЦОД, при этом каждый новый ЦОД будет потреблять 160 МВт — общее энергопотребление будет больше, чем у сталелитейных заводов и горнодобывающих предприятий. Экономические и экологические последствия такого прогресса могут переложить на плечи потребителей. ЦОД США, возможно, скоро будут потреблять больше энергии, чем целые страны. По одной из оценок, в будущем на них придётся столько же энергопотребления, сколько потребляла Польша в 2023 году. Один Amazon, если построит все запланированные объекты, будет потреблять до 49 ТВт·ч ежегодно, что примерно сопоставимо с энергопотреблением всей Невады в 2024 году. Хотя отдельные штаты уже начинают выпускать законы, посвящённые развитию энергетики и «зелёной» энергетики для потребителей с высоким спросом, к 2030 году расходы на соответствие требованиям к инфраструктуре могут достичь $2 трлн. При этом генерация энергии приведёт к расходам на здравоохранение в объёме $5,7-9,2 млрд из-за увеличения выбросов, связанных с энергетикой. По мнению экспертов, издержки, вероятно, будут переложены на плечи потребителей — в связи с повышением счетов на коммунальные услуги и экологическими последствиями. По мере распространения ИИ его энергопотребление может напрямую влиять на бюджеты домохозяйств, отражаясь не только в тратах на цифровые сервисы, но и в ежемесячных платежах за электроэнергию.

04.08.2025 [09:00], Сергей Карасёв

Basis Dynamix возглавил рейтинг российских платформ виртуализации CNewsПлатформа серверной виртуализации Basis Dynamix Enterprise заняла первое место в ежегодном рейтинге портала CNews. Решение, впервые признанное лидером рейтинга в 2024 году, снова получило наивысшую оценку и в 2025 году по совокупности технических, эксплуатационных и нормативных характеристик. Платформа набрала 645 баллов, опередив ближайшего конкурента на 50 баллов. В общей сложности эксперты проанализировали 10 российских продуктов, позволяющих управлять виртуальными серверами. Такие решения используются для быстрого развёртывания инфраструктуры и управления виртуальными дата-центрами и сетевыми функциями при помощи готовых инструментов.

Источник изображения: «Базис» Методологией рейтинга стала балльная система оценки по девяти категориям, охватывающим ключевые характеристики платформ виртуализации. В числе параметров — функциональные возможности, поддержка различных режимов работы, совместимость с российскими операционными системами, наличие встроенных инструментов управления, возможности интеграции, обеспечение отказоустойчивости, соответствие требованиям информационной безопасности и сертификация по линии ФСТЭК. Баллы присваивались за наличие подтверждённого соответствия требованиям — по итоговой сумме рассчитывался финальный рейтинг. Подробную разбивку можно узнать на странице исследования. Повторное признание в рейтинге CNews подтверждает, что платформа Basis Dynamix соответствует требованиям зрелого импортонезависимого решения. Функциональность системы охватывает ключевые аспекты — от производительности и катастрофоустойчивости до встроенных средств защиты от актуальных киберугроз. Рейтинг платформ виртуализации от CNews — один из наиболее авторитетных в отрасли. Он основан на экспертной оценке, обратной связи пользователей и сопоставлении ключевых технических характеристик. Для компаний и организаций, которые формируют отказоустойчивую ИТ-инфраструктуру на базе отечественного ПО, исследование служит внешней валидацией при выборе решений, которые отвечали бы требованиям управляемости и информационной безопасности. В свою очередь, вендоры получают ориентир для развития разработок с учетом критериев, критически важных для достижения технологической независимости государства.

03.08.2025 [12:14], Сергей Карасёв

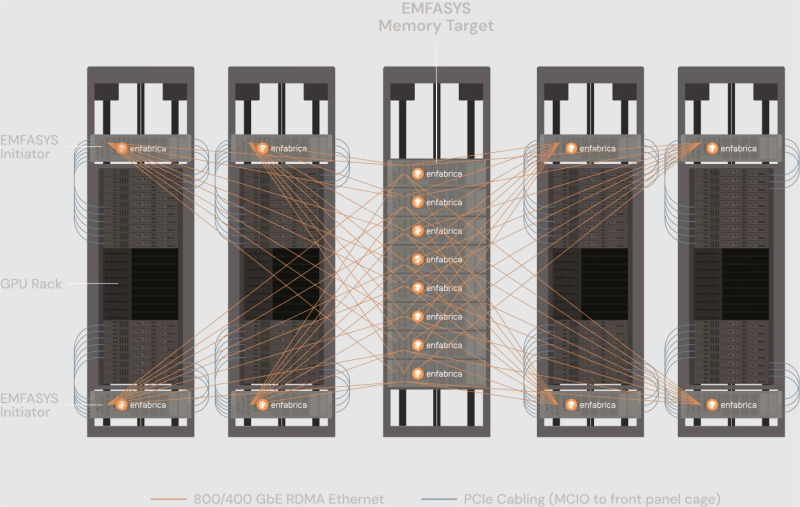

Enfabrica представила технологию EMFASYS для расширения памяти ИИ-системКомпания Enfabrica анонсировала технологию EMFASYS, которая объединяет Ethernet RDMA и CXL для создания пулов памяти, предназначенных для работы с серверными ИИ-стойками на базе GPU. Решение позволяет снизить нагрузку на HBM-память ИИ-ускорителей и тем самым повысить эффективность работы всей системы в целом. Enfabrica основана в 2019 году. Стартап предлагает CXL-платформу ACF на базе ASIC собственной разработки, которая позволяет напрямую подключать друг к другу любую комбинацию GPU, CPU, DDR5 CXL и SSD, а также предоставляет 800GbE-интерконнект. Компания создала чип ACF SuperNIC (ACF-S) для построения высокоскоростного интерконнекта в составе кластеров ИИ на основе GPU. В рамках платформы EMFASYS специализированный пул памяти подключается к GPU-серверам через чип-коммутатор ACF-S с пропускной способностью 3,2 Тбит/с, который объединяет PCIe/CXL и Ethernet. Поддерживаются интерфейсы 100/400/800GbE, 32 сетевых порта и 160 линий PCIe. Могут быть задействованы до 144 линий CXL 2.0, что позволяет использовать до 18 Тбайт памяти DDR5 (в перспективе — до 28 Тбайт). Вместо копирования и перемещения данных между несколькими чипами на плате Enfabrica использует один SuperNIC, который позволяет представлять память в качестве целевого RDMA-устройства для приложений ИИ. Высокая пропускная способность памяти достигается за счёт распределения операций более чем по 18 каналам на систему. Время доступа при чтении измеряется в микросекундах. Программный стек на базе InfiniBand Verbs обеспечивает массовую параллельную передачу данных с агрегированной полосой пропускания между GPU-серверами и памятью DRAM через группы сетевых портов 400/800GbE. Enfabrica отмечает, что рабочие нагрузки генеративного, агентного и рассуждающего ИИ растут экспоненциально. Во многих случаях таким приложениям требуется в 10–100 раз больше вычислительной мощности на запрос, чем большим языковым моделям (LLM) предыдущего поколения. Если память HBM постоянно загружена, дорогостоящие ускорители простаивают. Технология EMFASYS позволяет решить проблему посредством расширения памяти: в этом случае ресурсы GPU используются более полно, а заявленная экономия достигает 50 % в расчёте на токен на одного пользователя.

03.08.2025 [10:17], Сергей Карасёв

Rebellions и Marvell займутся разработкой решений для суверенного ИИЮжнокорейская компания Rebellions, занимающаяся созданием специализированных ИИ-чипов, объявила о сотрудничестве с американским разработчиком процессоров, микроконтроллеров и телекоммуникационных изделий Marvell Technology. Цель партнёрства — выпуск высокопроизводительных и энергоэффективных ИИ-решений для суверенных платформ в Азиатско-Тихоокеанском регионе и на Ближнем Востоке. Стартап Rebellions основан в 2020 году. Компания проектирует чипы для инференса, способные обеспечить энергоэффективность и высокую производительность при небольших задержках. В январе 2024 года Rebellions провела раунд финансирования Series B, в ходе которого на развитие было привлечено $124 млн. Позднее стартап получил $15 млн от Wa’ed Ventures — венчурного подразделения саудовского нефтегазового и химического гиганта Aramco. Кроме того, фирма Rebellions объявила о слиянии с разработчиком ИИ-чипов Sapeon Korea, который был выделен из SK Telecom в 2016 году. В заявлении Rebellions говорится, что инфраструктура ИИ становится всё более важной в плане обеспечения национальной конкурентоспособности. На этом фоне наблюдается переход от стандартизированных архитектур на базе GPU к специализированным системам, построенным с применением ASIC. Такой трансформации способствуют суверенные инициативы и проекты региональных поставщиков облачных услуг, которым требуется инфраструктура, обеспечивающая масштабируемость, эффективность и контроль. Предполагается, что новое партнёрство позволит Rebellions разрабатывать кастомизированные ИИ-ускорители с использованием специализированных платформ Marvell. При этом будут использоваться передовые технологии упаковки чипов, высокоскоростные SerDes-блоки и межкомпонентные соединения. Новые чипы, как ожидается, обеспечат возможность высокопроизводительного и энергоэффективного инференса. В целом, сотрудничество позволит объединить достижения Rebellions в области разработки ИИ-решений с передовыми технологиями интеграции кремниевых компонентов Marvell для создания специализированной инфраструктуры ИИ, отвечающей потребностям государственных организаций.

02.08.2025 [21:58], Владимир Мироненко

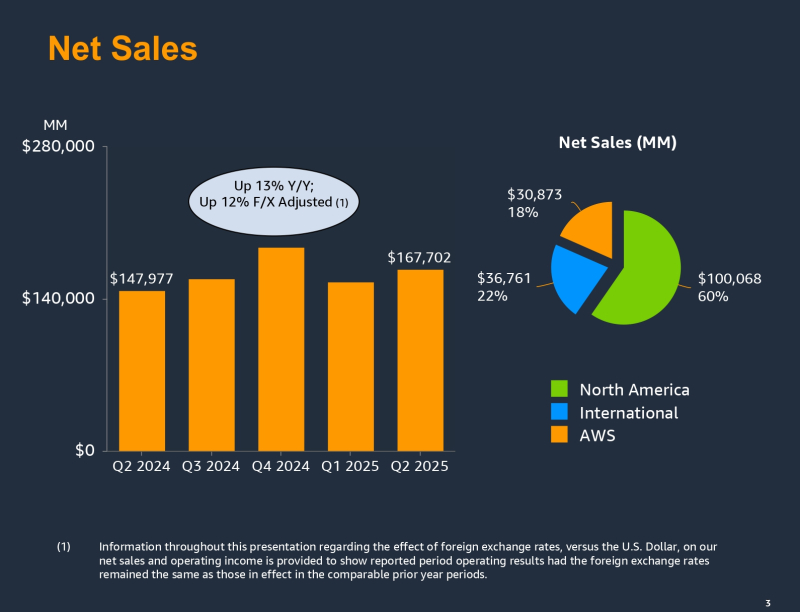

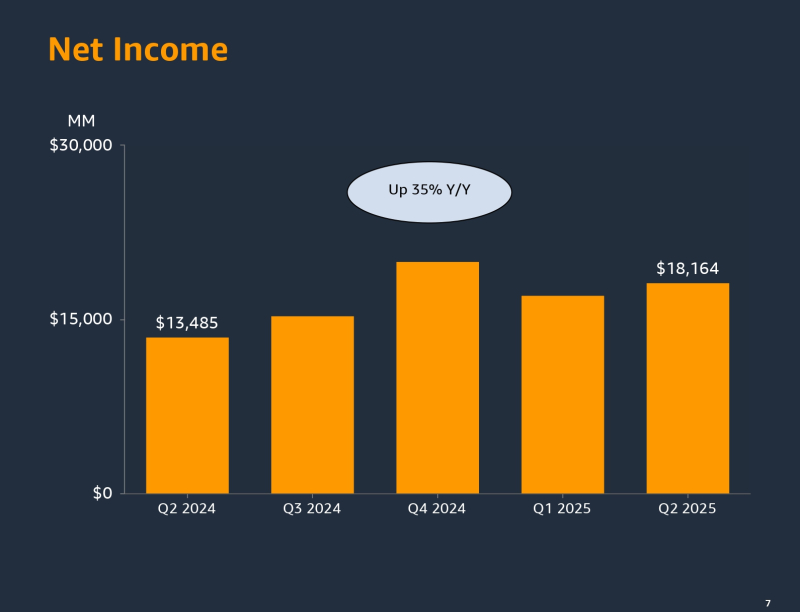

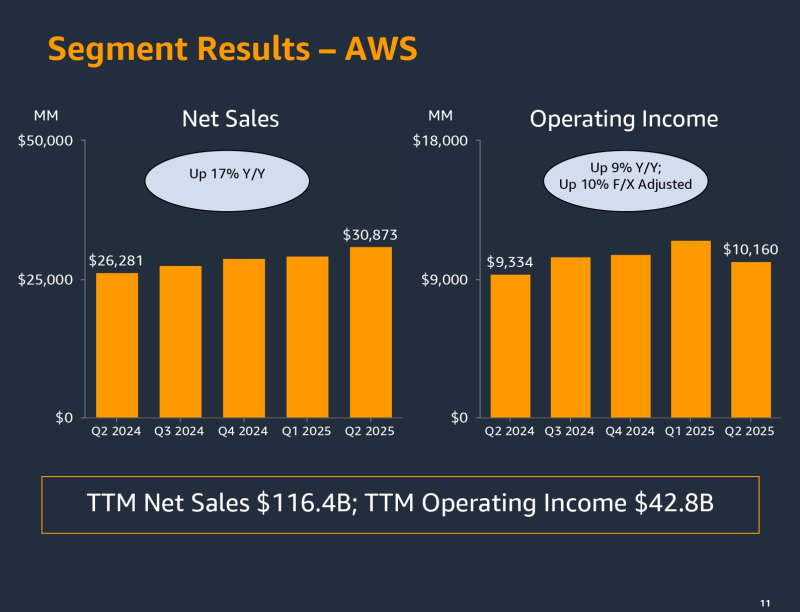

Amazon за год вложит в инфраструктуру рекордные $118 млрд, но рост ИИ ЦОД сдерживает нехватка электроэнергииAmazon.com сообщила о значительном росте выручки и прибыли во II квартале 2025 года, завершившемся 30 июня, но акции гиганта электронной коммерции упали более чем на 7 % после закрытия торгов, поскольку темпы роста её подразделения облачных вычислений Amazon Web Services (AWS) не оправдали ожиданий инвесторов, пишет Reuters. Вместе с тем результаты II квартала показали, что Amazon лучше справляется с меняющейся тарифной политикой США, чем опасались на Уолл-стрит, отметил ресурс CNBC. Amazon увеличила выручку на 13 % до $167,7 млрд, превысив прогноз Уолл-стрит в размере $162.1 млрд. Чистая прибыль компании составила $18,2 млрд, что на 35 % больше результата годом ранее. Прибыль на разводнённую акцию составила $1,68 при прогнозе аналитиков $1,33. Облачное подразделение AWS принесло компании $30,9 млрд, что на 17,5 % больше, чем годом ранее, и на 3 % — чем в предыдущем квартале. Выручка AWS больше, чем у облачных подразделений Microsoft и Google, сообщивших о $29,9 и $13,6 млрд соответственно, но инвесторы отметили значительно более низкие темпы роста выручки AWS. У Google Cloud выручка выросла за последний квартал на 32 % в годовом исчислении, у Microsoft Azure — на 26 %. Согласно публикации Data Center Dynamics, глава Amazon Энди Джасси (Andy Jassy) сказал: «Годовые проценты и темпы роста всегда зависят от базы, с которой вы работаете. И наш бизнес в сегменте AWS значительно крупнее, чем у других. Думаю, доля второго игрока составляет около 65 % от размера AWS». В отчётном квартале у AWS была более низкая рентабельность, чем в предыдущих кварталах. Его операционная прибыль составила $10,2 млрд, что ниже средней оценки аналитиков в $10,9 млрд, согласно StreetAccount. Это чуть более половины операционной прибыли компании, равной $19,2 млрд. Доход AWS составляет небольшую часть общей выручки Amazon, но является ключевым источником прибыли, обычно обеспечивая около 60 % от общей операционной прибыли компании. Во II квартале капитальные вложения Amazon составили $31,4 млрд, что выше прогноза Уолл-стрит, равного $26,4 млрд (по данным The Wall Street Journal). По словам Джасси, Amazon будет тратить примерно столько же в следующих двух кварталах. С учётом того, что капзатраты в I квартале составили $24,3 млрд общая сумма капвложений в 2025 финансовом году составит $118 млрд, что намного больше прогнозируемых $100 млрд. Капитальные вложения Google в последнем квартале составили $22,4 млрд, Microsoft — $24,2 млрд. Энди Джасси отметил ряд факторов, сдерживающих развёртывание облачной инфраструктуры компании и не позволяющий обеспечить растущий спрос на ИИ-сервисы. Наибольшее влияние оказывают проблемы с обеспечением объектов электроэнергией. За ними следуют «периодические ограничения, связанные с чипами, а затем с некоторыми компонентами для производства серверов». Он заявил, что вряд ли эти проблемы решатся в 2025 году, но выразил уверенность, что ситуация будет улучшаться с каждым кварталом. Несмотря на большие вложения в ИИ-инфраструктуру аналитики отмечают, что отсутствие у AWS сильной ИИ-модели вызывает опасения, что компания может отставать от конкурентов в разработке ИИ. Результаты AWS «вызывают тревогу», заявил Дэйв Вагнер (Dave Wagner), управляющий портфелем Aptus Capital Advisers, владеющей акциями Amazon. В ответ Джасси сообщил, что «сейчас ещё слишком рано говорить об ИИ», отметив партнёрство компании с Anthropic, которая обучает свои модели на ускорителях Trainium2 от Amazon. Он добавил, что чипы собственной разработки компании предлагают на 30–40 % лучшее соотношение цены и производительности. «Я думаю, что значительная часть вычислений и инференса в конечном итоге будет выполняться на базе Tranium. И я думаю, что это соотношение цены и производительности будет иметь значение для людей по мере масштабирования», — сообщил руководитель Amazon. Джасси также отметил то, что 85–90 % мировых ИТ-расходов приходится на локальные, а не на облачные решения, и компания ожидает, что ситуация изменится в ближайшие 10–15 лет. Этот сдвиг, по словам Джасси, принесёт пользу AWS. «Значительная часть инференса генеративного ИИ станет просто ещё одним строительным блоком, таким как вычисления, хранение и базы данных. И пользователи захотят запускать эти приложения рядом с теми местами, где работают их другие приложения, где находятся их данные. В AWS обрабатывается гораздо больше приложений и данных, чем где-либо ещё», — отметил глава Amazon. Касаясь миграции из локальной среды в облако, Джасси также отметил несколько новых соглашений с такими компаниями, как PepsiCo, Airbnb, Peloton, Nasdaq, Лондонская фондовая биржа, Nissan Motor, GitLab, SAP, Warner Bros. Discovery, Twelve Labs, FICO, Iberia Airlines, SK Telecom и NatWest. Amazon сообщила о сокращении 14 тыс. рабочих мест в отчётном квартале, в том числе в AWS, книжном подразделении, отделе гаджетов и подкастов, что стало первым сокращением с начала 2024 года. В настоящее время штат компании составляет 1,46 млн человек. Согласно прогнозу Amazon, в III квартале 2025 года выручка будет находиться в диапазоне $174,0– $179,5 млрд, что представляет собой рост год к году от 10 до 13 % и выше консенсус-прогноза аналитиков, опрошенных LSEG, в $173,08 млрд. Прогноз компании по операционной прибыли оказался ниже ожиданий аналитиков — $15,5–$20,5 млрд, что в средней точке ниже целевого показателя Уолл-стрит в $19,45 млрд.

02.08.2025 [15:12], Сергей Карасёв

Нордический Stargate: OpenAI получит в Норвегии 230-МВт ИИ ЦОД со 100 тыс. ИИ-ускорителей NVIDIAКомпания OpenAI анонсировала проект Stargate Norway — это первый в Европе дата-центр для задач ИИ, создающийся в рамках программы OpenAI for Countries. Объект расположится в Норвегии, в Квандале (Kvandal) неподалёку от Нарвика (Narvik) на севере страны. В проекте принимают участие компания Nscale, поставщик ИИ-инфраструктуры с опытом предоставления облачных решений в Европе и Северной Америке, а также инжиниринговая фирма Aker. На начальном этапе мощность нового ЦОД составит 230 МВт с перспективой добавления ещё 290 МВт. К концу 2026 года в дата-центре будут размещены 100 тыс. ИИ-ускорителей NVIDIA, а в последующие годы планируется «значительное расширение». Территория Нарвика выбрана не случайно. Обилие гидроэнергии, её низкая стоимость, прохладный климат и развитая промышленная база региона делают его оптимальным местом для масштабного и устойчивого развития ИИ-платформ. Новый дата-центр будет получать питание исключительно от возобновляемых источников энергии. Упомянуто применение прямого жидкостного охлаждения для дальнейшего повышения энергетической эффективности. Избыточное тепло будет использоваться для централизованного теплоснабжения. Управлять новым ЦОД предстоит совместному предприятию Nscale и Aker с равным долевым участием. Компании выделили около $1 млрд на начальный этап проекта, включая более $250 млн в виде акционерного капитала. Утверждается, что это одна из самых крупных инвестиций в ИИ-инфраструктуру в Европе на сегодняшний день. Площадка в Нарвике обладает потенциалом десятикратного масштабирования и, помимо OpenAI, может использоваться другими клиентами. Aker и Nscale будут в приоритетном порядке предоставлять ресурсы Stargate Norway норвежским стартапам в области ИИ и научным организациям. Излишки мощностей станут доступны государственным и частным пользователям в Великобритании и странах Северной Европы. Добавим, что мегапроект Stargate — это совместное предприятие OpenAI, SoftBank и Oracle по развитию ИИ-инфраструктуры в США. Предполагается, что суммарные затраты на реализацию Stargate достигнут $500 млрд. При этом один из крупнейших ИИ ЦОД Stargate расположится в Объединённых Арабских Эмиратах (ОАЭ): мощность этого кампуса составит 5 ГВт. Впрочем, пока развитие проекта идёт ни шатко, ни валко — OpenAI предпочитает искать ресурсы напрямую. |

|