Лента новостей

|

29.04.2026 [15:46], Владимир Мироненко

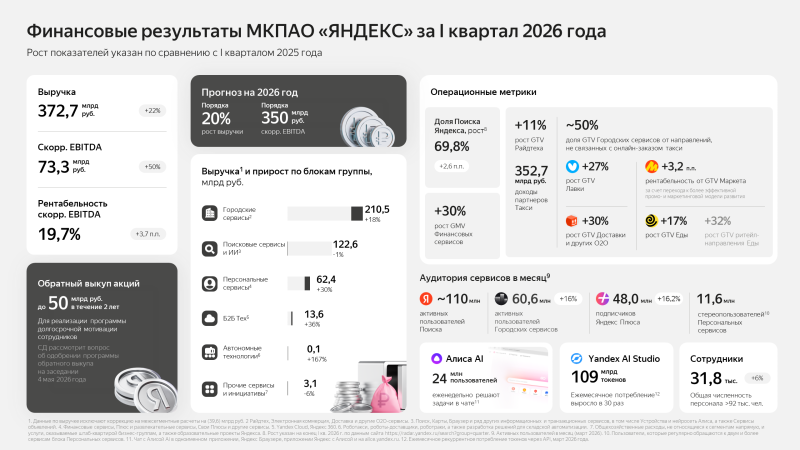

Yandex B2B Tech увеличила выручку на 36 % на фоне растущего спроса на ИИ-решения«Яндекс» сообщила финансовые результаты за I квартал 2026 года. Выручка компании выросла на 22 % год к году до 372,7 млрд руб. Скорректированная чистая прибыль увеличилась в 2,7 раза, составив 34,7 млрд руб., скорректированный показатель EBITDA — в 1,5 раза до 73,3 млрд руб., составив 19,7 % от выручки (рост — на 3,7 п.п.). Выручка бизнес-блока «Б2Б Тех» (Yandex B2B Tech) выросла на 36 % год к году до 13,6 млрд руб. Как отметила компания, росту способствовало продолжающееся расширение клиентской базы и увеличение объёма потребления сервисов в корпоративном сегменте. Важную роль играет и растущий спрос на ИИ-решения, а также развитие сервисов безопасности, инструментов для работы с данными и решений для автоматизации бизнес-процессов. Скорректированный показатель EBITDA вырос на 49 % год к году до 2,6 млрд руб. на фоне увеличения доли PaaS- и SaaS-решений в выручке. Компания прогнозирует дальнейший рост маржинальности во II половине года. «Яндекс» сообщила, что аудитория Yandex Cloud выросла до 60 тыс. клиентов. Более трети крупнейших компаний России из рейтинга РБК‑500 используют для работы цифровых сервисов технологии Yandex Cloud. При этом более половины корпоративных клиентов Yandex Cloud из крупного и среднего сегмента используют её решения для обеспечения информационной безопасности. Всего на крупные компании приходится больше половины совокупной выручки направления. Одним из ключевых драйверов роста Yandex Cloud компания назвала платформу для разработки ИИ-агентов и приложений Yandex AI Studio. Ежемесячное рекуррентное потребление токенов через API на ней увеличилось примерно в 30 раз год к году до 109 млрд токенов в марте 2026 года. На платформе было создано более 16 тыс. ИИ-агентов, на которые в марте 2026 года приходилось 29 % всего клиентского потребления в Yandex AI Studio. Также компания отметила, что ИИ- и ИБ-сервисы остаются фокусными направлениями бизнеса. Выручка от них выросла в два раза год к году. По второму направлению — «Яндекс 360» — у компании насчитывается 175 тыс. организаций-клиентов. Общее количество платных учётных записей «Яндекс 360» выросло до 8,3 млн на конец I квартала 2026 года. Аудитория «Яндекс Телемоста» выросла в три раза год к году, превысив 8,3 млн пользователей. Также сообщается, что «Яндекс 360» продолжает внедрять ИИ и расширять список сервисов, доступных по модели on-premise. Компания сообщила, что сохраняет прогноз на 2026 год: рост выручки порядка 20 % год к году и скорректированный показатель EBITDA порядка 350 млрд руб. Уровень капитальных затрат в 2026 году, как ожидается, составит 10-12 % от выручки, что соответствует среднегодовому значению за последние пять лет — 11 % от выручки.

29.04.2026 [15:34], Сергей Карасёв

Китай анонсировал 2,5-Эфлопс Arm-суперкомпьютер LineShine на домашних процессорахКитайский национальный суперкомпьютерный центр в Шэньчжэне (NSCCSZ) анонсировал проект вычислительного комплекса LineShine (LingSheng), производительность которого после полноценного ввода в эксплуатацию окажется на уровне 2 Эфлопс. Особенностью системы является то, что её конфигурация предполагает применение исключительно CPU-серверов — без ускорителей на базе GPU. Как отмечает ресурс HPC Wire, LineShine будет создаваться в несколько этапов. Одна из секций нового суперкомпьютера получит серверы Huawei Kunpeng с десятками тысяч вычислительных ядер. Предусмотрено использование 428 узлов хранения с суммарной вместимостью 650 Пбайт. Заявленная пропускная способность — 10 Тбайт/с. Вторая секция LineShine предполагает применение 20480 вычислительных узлов, каждый из которых будет оснащён двумя процессорами LX2 на архитектуре Armv9. Конструкция чипов LX2 включает два вычислительных кристалла со 152 ядрами (в сумме 304 ядра) и восемь стеков памяти HBM (32 Гбайт, 4 Тбайт/с). Каждый кристалл использует 128 Гбайт внешней памяти DDR. За обмен данными между блоками DDR и HBM отвечает специальный механизм SDMA. Каждый кристалл поделён на четыре NUMA-домена (38 ядер и 4 Гбайт HBM). Узлы соединены между собой высокоскоростным интерконнектом LingQi, обеспечивающим пропускную способность до 1,6 Тбит/с на узел. Говорится о поддержке режимов FP64/FP32/FP16/INT8. Заявленная производительность LX2 достигает 60,3 Тфлопс на операциях FP64 и 120,6 Тфлопс на операциях FP32. Таким образом, пиковая теоретическая FP64-производительность составляет 2,47 Эфлопс.

Источник изображения: South China Morning Post Для сравнения, самый быстрый на сегодняшний день суперкомпьютер в мире по версии TOP500 — американский комплекс El Capitan — обладает быстродействием 1,809 Эфлопс с пиковым значением 2,821 Эфлопс, но в нём применяются как CPU, так и ускорители (AMD Instinct MI300A). Таким образом, LineShine станет самым мощным НРС-комплексом, построенным исключительно на базе CPU. Другой особенностью машины станет то, что в её составе будут применяться только китайские компоненты, включая процессоры, накопители и сетевое оборудование. При этом официально КНР не участвует в TOP500 уже пять лет, да и в целом не любит рассказывать о своих самых мощных суперкомпьютерах. Нужно отметить, что в Китае действует другой суперкомпьютер экзафлопсного класса — система China New-generation Intelligent Supercomputer (CNIS). Этот комплекс имеет гетерогенную конфигурацию с 5632 вычислительными узлами. Каждый из них наделён двумя 64-бит серверными процессорами на базе CISC с 64 ядрами (2,4 ГГц) и восемью ускорителями GPGPU с архитектурой SIMT с 64 Гбайт HBM (1,8 Тбайт/с). Задействованы 8-канальная подсистема памяти DDR5-6400. Каждый GPGPU обеспечивает пиковую производительность 32,7 Тфлопс в режиме FP64, 65,5 Тфлопс на операциях FP32 и 470 Тфлопс в режиме FP16, что в сумме даёт пиковую теоретическую FP64-произвоидительность на уровне 1,47 Эфлопс.

29.04.2026 [14:46], Руслан Авдеев

Юта одобрила гигантский 9-ГВт ИИ ЦОД Stratos — весь штат потребляет вдвое меньшеНа днях Управление по развитию военных объектов штата Юта (Military Installation Development Authority, MIDA) одобрило строительство 9-ГВт кампуса ЦОД Project Strator гиперскейл-уровня в рамках проекта Wonder Valley. При этом в среднем штат целиком сейчас потребляет около 4 ГВт, сообщает Tom’s Hardware. Похожая ситуация складывается и Вайоминге. Реализацией проекта Stratos занимается компания O'Leary Digital — инфраструктурное подразделение, подконтрольное инвестору Кевину О’Лири (Kevin O'Leary). Объект будет размещён на территории более 16 тыс. га частной земли, в ведении компании будут и 485 га военной и государственной собственности. Уже на первом этапе потребуется приблизительно 3 ГВт, после полного завершения строительства мощность достигнет 9 ГВт. Всю генерацию организуют на месте благодаря близкому расположению трубопровода Ruby Pipeline протяжённостью более 1 тыс. км, пересекающему север Юты по пути из Вайоминга в Орегон. По данным MIDA, новый объект «не будет забирать ни одного электрона» из имеющейся электросети и даже сможет подавать в неё избыточную энергию. Ставка на автономное энергоснабжение позиционирует Stratos в одном ряду с растущим списком ИИ ЦОД, для которых строятся собственные электростанции, без необходимости годами ждать подключения к имеющимся электросетям. Например, запланированный в Огайо кампус SoftBank рассчитан на 10 ГВт с использованием газовой генерации, а недавно Meta✴ решила профинансировать семь новых газовых электростанций для 7-ГВт объекта в Луизиане.

Источник изображения: Arturo Rivera/unsplash.com При этом разработчики обратили особое внимание на меры, принимаемые для минимизации воздействия на бассейн Большого Солёного озера, в том числе использование воздушных систем охлаждения вместо жидкостных. Впрочем, продолжаются переговоры о праве на использование и водных ресурсов. Сам О'Лири привёл совету директоров MDIA «неотразимый» довод в пользу мега-ЦОД, сославшись на активные инвестиции Китая в ИИ-инфраструктуру. Он сообщил, что за последние 24 мес. КНР построила электростанции общей мощностью 400 ГВт, большая часть используется для питания ИИ ЦОД. Инвестор прямо сказал, что соревноваться приходится именно с ними. Также под патронажем О'Лири и его структур планируется строительство кампуса Wonder Valley в Канаде мощностью до 7,5 ГВт. Для привлечения гиперскейлеров MDIA снизило налог на энергетику со стандартных 6 % до 0,5 % и готово вернуть 80 % налогов на недвижимость, уплаченных O'Leary Digital в связи с реализацией проекта. Впрочем, даже при таких низких ставках прогнозируются ежегодные поступления для округа Бокс-Элдер (Box Elder), где разместится ЦОД, в объёме $30 млн/год на начальном этапе и более $100 млн/год после выхода объекта на запланированную мощность. MIDA рассчитывает, что только налог с продаж от ЦОД достигнет $250 млн/год.

29.04.2026 [14:00], Владимир Мироненко

Обновление zVirt 5.0 добавило системе «облегчённую» гипервизорную ОС и возможность миграции между ЦОД без общей СХДРазработчик инфраструктурного ПО корпоративного класса Orion soft объявил о выходе масштабного обновления флагманской платформы для управления виртуализацией zVirt 5.0, ключевой особенностью которого стал её перевод на новую минималистичную гипервизорную ОС собственной сборки, что позволило повысить стабильность её работы, производительность и безопасность. Также с обновлением в zVirt появились функция живой миграции виртуальных машин между ЦОД и планировщик задач виртуальных машин по расписанию наряду с усовершенствованной функциональностью SDN. Для системы крупнейшим обновлением в её истории стал переход на новую гипервизорную платформу zVirt Node 2.0, специально разработанную под задачи системы виртуализации и собранную на базе менеджера пакетов RPM. Платформа отличается обновлённым системным стеком, «облегчённой» архитектурой и уменьшенным объёмом кода, обеспечивая контроль над составом системы, версиями компонентов и процессом обновления. По словам Максима Березина, директора по развитию бизнеса Orion soft, разработчики оставили в zVirt Node 2.0 только те пакеты, которые необходимы непосредственно для работы виртуализации. В итоге получился легковесный гипервизор, который можно ставить прямо на «железо», чтобы обеспечить более стабильную и предсказуемую работу системы, адаптированную под задачи виртуализации. Березин отметил, что по такому же принципу VMware строила свой гипервизор ESXi. К тому же, за счёт уменьшенного объёма кода повышается защищённость решения, так как сокращается поверхность потенциальной атаки. Значимая для крупных инфраструктур функция миграции виртуальных машин между различными ЦОД работает даже в случае отсутствия в дата-центрах общего хранилища данных. Миграция доступна как в онлайн-режиме — до двух виртуальных машин одновременно, так и в офлайн-режиме — до 32 объектов одновременно. В результате этого обновления zVirt обеспечивает выполнение всех возможных сценариев миграции виртуальных машин, которые раньше предоставляла VMware. Также был доработан планировщик задач виртуальных машин по расписанию. Он позволяет автоматизировать рутинные операции, такие как запуск, выключение и перезагрузка виртуальных машин, создание и удаление снимков. Управление планированием производится через веб-интерфейс Hosted Engine. Кроме того, разработчик включил в обновление дополнительные возможности SDN: балансировку трафика на уровнях L3–L4, поддержку протокола BGP для динамической маршрутизации, поддержку трансляции портов на логическом маршрутизаторе. Это позволит обеспечить сокращение накладных расходов при обработке трафика, высокую отказоустойчивость, гибкость и доступность виртуальной сетевой инфраструктуры. Orion soft планирует и дальше развивать zVirt в качестве решения, обеспечивающего комплекс инфраструктурных задач. Компания сообщила, что в 2026 году у платформы появится собственный встроенный инструмент для резервного копирования и функциональность для работы с программно-определяемыми хранилищами (SDS), которая позволит строить гиперконвергентные инфраструктуры (HCI). Также компания выпустит zVirt Special Edition — сертифицированную ФСТЭК редакцию платформы, максимально приближённую по функциональности к коммерческой версии.

29.04.2026 [12:47], Руслан Авдеев

Core Scientific переделает свою 300-МВт биткоин-ферму в 1,5-ГВт ИИ ЦОДКриптомайнинговая компания Core Scientific решила полностью сменить профиль деятельности. Недавно она объявила о намерении «переформатировать» майнинговые мощности в Пекосе (Pecos, Техас) на 300 МВт — вместо них появится кампус ИИ ЦОД на 1,5 ГВт, сообщает The Register. Недавно Core Scientific рассказала о намерении продать высокодоходные облигации на сумму $3,3 млрд, это должно упростить переход. Пожалуй, больше всех от смены профиля деятельности выиграла CoreWeave. Она давно арендует объекты у Core Scienetific и даже намеревалась купить её, но акционеры последней отказались от продажи, причём уже не в первый раз. CoreWeave рассматривается ключевым арендатором компании, которая будет занимать её объекты не только в Техасе, но и в Джорджии, Оклахоме и Северной Каролине. По информации Datacenter Dynamics, Core Scientific зарезервировала более 80 га на расширение своих проектов. Помимо Техаса, Core Scientific реализует проекты в Кентукки, Северной Дакоте и Алабаме. По некоторым данным, она имеет 520 МВт доступных для аренды мощностей на существующих площадках и ещё 700 МВт «скрытых резервов». Строительство нового объекта Core Scientific в Пекосе начато в начале 2026 года, первый зал рассчитывают ввести в эксплуатацию в начале 2027 года. После завершения строительства объект предоставит более 1 ГВт доступной для аренды мощности. Впрочем, пока неизвестно, сможет ли компания получить достаточно электроэнергии. Она уже зарезервировала дополнительные 300 МВт у местной энергетической компании, которые планируется дополнить неким решением «за счётчиком» для прямого питания ЦОД энергией. Ранее сообщалось, что в округе появится автономная 5-ГВт газовая электростанция GW Ranch от Pacifico Energy, которая строится исключительно для питания ИИ ЦОД. В последние годы компании активно внедряют необычные технологии генерации и хранения энергии. Google, Oracle и AWS делают ставку на малые модульные реакторы (SMR). Тем временем Meta✴ подписала соглашение с Overview Energy о передачи 1 ГВт солнечной энергии с космической орбиты, хотя система заработает не раньше 2030 года. Вероятным кандидатом на обеспечение ЦОД электричеством остаются менее экзотические технологии — например, топливные элементы Bloom Energy. Крайне востребованы и мобильные газовые турбины, подобные тем, что используются суперкомпьютером Colossus компании xAI.

29.04.2026 [12:07], Сергей Карасёв

Ёмкость отгруженных за квартал Nearline-накопителей Seagate выросла в полтора разаКомпания Seagate обнародовала показатели деятельности в III квартале 2026 финансового года, который был закрыт 3 апреля. Выручка составила $3,11 млрд, увеличившись на 44 % по сравнению с показателем за аналогичный период предыдущего финансового года, когда было получено $2,16 млрд. На продукты для дата-центров пришлось примерно 80 % от общей квартальной выручки Seagate — $2,5 млрд. Это на 55 % больше по сравнению с результатом годичной давности: тогда продажи в указанном сегменте равнялись $1,62 млрд. Оставшиеся 20 %, или $612 млн, обеспечили все прочие решения: по сравнению с III кварталом предыдущего финансового года, когда было получено $545 млн, отгрузки в денежном выражении поднялись на 12 %. За трёхмесячный период Seagate поставила накопители суммарной вместимостью 199 Эбайт. Для сравнения: годом ранее этот показатель составлял 144 Эбайт. Таким образом, зафиксирован рост на 39 %. По направлению Nearline-устройств продажи в ёмкостном выражении подскочили практически в полтора раза (на 47 %) — со 120 до 175 Эбайт. Отгрузки накопителей других классов за год не изменились, оставшись на уровне 24 Эбайт. Чистая прибыль Seagate, рассчитанная в соответствии с общепринятыми принципами бухгалтерского учёта (GAAP), составила $748 млн против $340 млн годом ранее, что соответствует росту на 120 %. Прибыль в пересчёте на одну ценную бумагу поднялась с $1,57 до $3,27. В IV квартале текущего финансового года Seagate прогнозирует выручку в объёме $3,45 млрд ± $100 млн. Одним из главных драйверов роста компания называет высокий спрос на накопители для ЦОД, обусловленный стремительным расширением инфраструктуры ИИ.

29.04.2026 [09:39], Владимир Мироненко

SUSE: удобство важнее безопасности — цифровой суверенитет всех страшно волнует, но на деле деньги идут на ИИSUSE сообщила о результатах исследования по цифровому суверенитету и цифровой устойчивости Navigating Digital Resilience, основанном на независимом опросе, проведённом среди 309 ИТ-руководителей в 13 отраслях из Франции, Германии, Индии, Японии и США. В ходе опроса выяснилось, что 98 % респондентов считают цифровой суверенитет приоритетом, хотя активно внедряют его лишь 52 %. Это свидетельствуют о том, что признают суверенитет стратегически важным многие предприятия, особенно по мере ускорения внедрения ИИ, но его реализация остаётся неравномерной. Также есть различие по региональному признаку. Респонденты в Индии сообщили о самом высоком уровне активных инвестиций в цифровой суверенитет — 62 %, за ними следуют Германия и Япония — 57 %, США — 52 %, и Франция — 39 %. Опрос также показал, что требование суверенитета начинает влиять на закупки: 45 % респондентов заявили, что он был включен в недавние запросы предложений, а 42 % сообщили, что это повлияло на выбор поставщика. Вместе с тем 41 % респондентов сообщили, что руководствуются только требованиями клиентов или давлением со стороны регулирующих органов. Опрос также отразил связь внедрения ИИ с планированием устойчивости. 64 % респондентов заявили, что прозрачность ИИ, включая видимость процесса обучения моделей и их происхождения, станет основным фактором цифровой устойчивости в течение следующих пяти лет. В то же время при увеличении бюджета на 20 % большинство организаций отдадут приоритет инициативам в области ИИ перед инвестициями в суверенитет. Отвечая на вопрос, как определить цифровую устойчивость, респонденты неизменно подчеркивали контроль над системами и инфраструктурой, а также готовность к восстановлению. Кибербезопасность и обнаружение угроз заняли первое место (63 %), за ними следует диверсификация мультиоблачных или гибридных решений (52 %). Резервное копирование и восстановление (45 %) и непрерывный мониторинг (44 %) также были ключевыми элементами стратегии устойчивости. Также респонденты отметили важность сервисов гиперскейлеров в планировании суверенной инфраструктуры. 65 % респондентов заявили, что гиперскейлеры остаются актуальными для суверенных рабочих нагрузок, что отражает противоречие между масштабом и удобством использования сервисов гиперскейлеров и юрисдикционным контролем, к которому всё чаще стремятся многие предприятия. Эта динамика, вероятно, будет поддерживать высокий спрос на открытые, переносимые инфраструктурные стеки, охватывающие частные, гибридные и размещённые среды, не привязывая клиентов к единой операционной модели, полагает StorageReview.com. SUSE заявила, что результаты исследования подтверждают потребность в инфраструктуре, которая поддерживает как внедрение ИИ, так и требования суверенности, что соответствует портфелю её решений, включая SUSE Linux, SUSE Rancher Prime и SUSE AI. Компания также отметила, что участники независимого опроса не были проинформированы о том, что она является спонсором исследования.

29.04.2026 [01:23], Владимир Мироненко

Tenstorrent представила ИИ-серверы Galaxy Blackhole для быстрой генерации токенов и без дезагрегацииTenstorrent представила вычислительную систему Galaxy Blackhole на базе ускорителей Blackhole с архитектурой RISC-V, которая позиционируется как системная ИИ-платформа, способная конкурировать с другими решениями за счёт стабильной производительности инференса, высокоскоростного доступа к памяти и масштабируемой сети — трёх факторов, которые всё чаще определяют эффективность развёртывания ИИ в реальных условиях, пишет Forbes. 6U-сервер Tensorrent Galaxy Blackhole с воздушным охлаждением основан на 32 ИИ-ускорителях Blackhole суммарной производительностью 23 Пфлопс в режиме FP8. Система включает 6,2 Гбайт SRAM (суммарно 2,9 Пбайт/с) и 1 Тбайт GDDR6 (суммарно 16 Тбайт/с). Высокоскоростную связь между узлами при горизонтальном масштабировании обеспечивают 800GbE-порты — до 56 портов на систему с общей пропускной способностью 11,2 Тбайт/с (в дуплексе). Стоимость системы Tensorrent Galaxy Blackhole составляет $110 тыс. Восьмичиповые системы NVIDIA DGX будут производительнее, но и обойдутся в три-пять раз дороже, сообщил The Register. Базовый суперкластер Galaxy Supercluster стоимостью в $440 тыс. включает четыре системы Blackhole. При этом архитектура Tenstorrent поддерживает масштабирование до 32 узлов с 1024 ускорителями. Mesh-сеть Tenstorrent не ограничивается одним узлом. Подобно кластерам TPU от Google или Trainium2 от Amazon, её можно расширить для поддержки более крупных моделей, более высокой пропускной способности или большей интерактивности, добавив больше узлов и отрегулировав параллелизм тензоров и конвейеров. Как сообщает Tenstorrent, для DeepSeek V3 её четырёхузловые суперкластеры Blackhole Galaxy Supercluster могут обрабатывать запрос на 100 тыс. токенов — эквивалент 166 страниц текста — менее чем за четыре секунды. Tenstorrent заявила, что кластеры Galaxy Blackhole могут генерировать видео быстрее, чем в реальном времени, а также очень быстро генерировать токены LLM. Демонстрационные версии систем Tenstorrent настроены на обычный режим с генерацией текста с удобочитаемой скоростью, и режим Blitz, обеспечивающий максимально быструю обработку данных, подходящую для таких приложений, как генерация кода и агентный ИИ. В режиме Blitz MoE-модель DeepSeek-671B обеспечивает «до 350 т/с на пользователя со временем получения первого токена менее 4 с», сообщила компания. Ресурс EE Times протестировал этот режим за несколько дней до официального запуска, получив 255 т/с на пользователя для коротких запросов в стиле чат-бота. Этот режим поддерживает пакетную обработку от 8 до 64 и длину контекста до 128 тыс токенов. Он работает на 16 серверах Galaxy (512 чипов) с использованием конвейерного параллелизма на этапе декодирования. Компания отметила, что её системы не нуждаются в дезагрегации. «Мы можем выполнять и [предварительное заполнение, и декодирование] на одном узле, — сообщил генеральный директор Tenstorrent Джим Келлер (Jim Keller) изданию EE Times. — Мы создаём большой кластер, на котором можно запускать предварительное заполнение и декодирование LLM, генерацию видео, агентный ИИ… мы не специализируемся на чём-то одном. У нас много чипов, большой объём SRAM, но все чипы имеют DRAM, и все они тесно связаны между собой, поэтому наша платформа гораздо более универсальна».

28.04.2026 [17:24], Руслан Авдеев

С миру по миллиарду: Oracle всё-таки насобирала $16 млрд на ИИ ЦОД OpenAI в МичиганеКомпания Oracle завершила сделку по привлечению $16 млрд для финансирования строительства в Мичигане дата-центра The Barn в рамках проекта OpenAI Stargate Мичигане. После нескольких месяцев переговоров компания обеспечила получение заёмных средств и акционерного капитала для продолжения работ, сообщает Datacenter Dynamics. Для финансирования проекта Bank of America продал связанные с проектом облигации на сумму $14 млрд. Из них ценные бумаги на сумму $10 млрд привлекла компания Pimco, остальную часть инвестиций обеспечили другие участники рынка. Срок погашения ценных бумаг — 2045 год, до этого времени владельцы облигаций станут получать фиксированные выплаты из расчёта 7,5 % годовых от номинальной стоимости. Blackstone, по имеющимся данным, внесла $2 млрд. Проект в Салине (Saline) утверждён в октябре 2025 года. Ожидается, что площадка обеспечит 1 ГВт мощностей и обойдётся приблизительно в $10 млрд. За строительство отвечает Related Digital. STE Energy согласилась обеспечить проект 100 % необходимой электроэнергии, в т.ч. речь идёт о реализации вспомогательного проекта аккумуляторного энергохранилища, финансируемого Oracle. По словам представителя Oracle Cloud Infrastructure (OCI), вместе с партнёрами компания создаёт «высококачественные» рабочие места, инвестирует в сообщества, в которых работает и способствует долгосрочному экономическому росту на местах.

Источник изображения: Brad Switzer/unsplash.com Ранее сообщалось, что уже началось «вертикальное» строительство — возведение стен, кровли и др. после укладки фундамента и прокладки коммуникаций. Утверждалось, что все работы выполняются в срок и в соответствии с планом. Впрочем, после анонса OpenAI, Oracle и Related Digital кампуса The Barn в октябре 2025 года дела пошли не слишком гладко. Так, инвестор Blue Owl Capital отказался выделять средства, а через некоторое время TD Cowen констатировала, что банки расхотели давать Oracle деньги, и предложила последней поправить финансовое положение путём увольнения 20–30 тыс. сотрудников. Pimco является американской инвестиционной компанией, принадлежащей Allianz Group и активно ведущей дела в Европе. В 2023 году компания запустила новую европейскую платформу ЦОД Apto. В своё время Pimco объединилась с Blue Owl, чтобы помочь Meta✴ получать финансирование для своего ЦОД Hyperion.

28.04.2026 [16:33], Руслан Авдеев

Samsung Heavy Industries займётся строительством плавучих ЦОД совместно с американской Mousterian CorporationОдин из крупнейших в мире судостроителей — южнокорейская Samsung Heavy Industries подписала меморандум с американским девелопером береговой цифровой инфраструктуры Mousterian Corporation (M3) о создании плавучих ЦОД (FDC) гиперскейл-класса для удовлетворения спроса ИИ-вычисления, сообщает Converge! Digest. Особенно потенциальным партнёрам интересны регионы с ограниченными земельными ресурсами и проблемами с подключением к местными электросетям. По словам Mousterian Corporation, привлечение к проекту Samsung Heavy Industries подтверждает институциональную жизнеспособность FDC как явления. В рамках нового партнёрства M3 возглавит подбор участков, строительство, взаимодействие с потенциальными арендаторами и привлечение капитала, а Samsung Heavy Industries обеспечит компетенции в области морского инжиниринга, изготовления различных конструкций и крупнотоннажного судостроения. Компании намерены заняться внедрением плавучих ЦОД в различных юрисдикциях с использованием промышленных методов морского строительства. Это позволит ускорить сроки развёртывания инфраструктуры в сравнении с традиционными наземными дата-центрами. Концепция плавучих ЦОД ориентирована на размещение вычислительной инфраструктуры рядом с действующими электростанциями, в том числе в локациях с недоиспользуемыми, невостребованными мощностями. Реализация проекта позволяет обойти традиционные ограничения, связанные с энергоснабжением, а также получением разрешений на застройку. Таким образом партнёры стремятся ускорить создание ИИ-инфраструктуры гигаваттного масштаба с применением морских систем для эффективного охлаждения и модульного масштабирования. Кроме того, упоминалось и совместное создание плавучих малых модульных реакторов (SMR). По мнению Converge!, жизнеспособность таких проектов во многом зависит от особенностей реализации и экономической целесообразности той или иной площадки. Близкое расположение от прибрежных электростанций, терминалов СПГ и морских энергетических установок упростит получение питания и ускорит развёртывание. Охлаждение забортной водой позволит эффективно отводить тепло от высокоплотных кластеров. Кроме того, изготовление на верфях обеспечивает повторяемую, модульную модель производства, при эффективном масштабировании способную оптимизировать сроки строительства и предсказуемость затрат. Тем не менее экономическая целесообразность носит скорее ситуативный характер. Морские и прибрежные проекты требуют более высоких капитальных затрат, связанных с проектированием морского оборудования, системами швартовки, защитой от коррозии и специализированным техническим обслуживанием. Из-за специфики логистики, нехватки рабочих руки и более суровых условий работы могут вырасти и эксплуатационные расходы. Финансирование также может усложниться, поскольку плавучие ЦОД представляют собой гибриды морской инфраструктуры и цифровых активов, что требует от кредиторов и страховых компаний разработки новых систем оценки рисков. Для успеха модели решающую роль играет стратегия энергоэффективности и энергоснабжения. Тем не менее, кабельные системы для таких ЦОД будут довольно сложны и дороги, это касается и ВОЛС. Поэтому проекты FDC, вероятно, останутся нишевым, но ценным вариантом, особенно для тех регионов, где энергия вблизи воды имеется в изобилии, а вот земли не хватает. К таковым относится, например, Сингапур и окрестности. В Японии тоже есть несколько аналогичных проектов, сразу два от Mitsui и ещё один от NYK Line. Часть проектов опирается на питание не с берега, а с плавающих электростанций. Морские проекты, связанные с цифровой инфраструктурой — не редкость. Так, Samsung подписала с OpenAI письмо о намерениях, предусматривавшее, в числе прочего, и совместную разработку плавучих ЦОД, а Aikido объединила морские ветряки с модульными дата-центрами. Впрочем, не все проекты заканчиваются успешно. Так, один из пионеров плавучих ЦОД Nautilus в итоге выставила на продажу свой дата-центр и переключилась на инфраструктурные решения для наземных ЦОД. |

|