Материалы по тегу: облако

|

19.12.2025 [15:20], Владимир Мироненко

США объявили о заключении партнёрских отношений с 24 ведущими IT-компаниями в рамках «Миссии Генезис»В четверг в Белом доме США состоялся круглый стол с участием представителей администрации президента США и 24 ведущих технологических компаний страны, в ходе которого было объявлено о заключении Министерством энергетики США (DoE) партнёрских соглашений с компаниями с целью продвижения «Миссии Генезис» (Genesis Mission) — национальной инициативы для ускорения научных открытий, повышения национальной безопасности и стимулирования инноваций в энергетике с помощью ИИ. Об этом сообщил Bloomberg. Президент подписал указ о запуске «Миссии Генезис» 24 ноября 2025 года, поставив задачу удвоить производительность и повысить влияние американских исследований в течение десяти лет, предоставляя учёным и инженерам инструменты для разработки, обучения и эксплуатации ИИ-систем следующего поколения с большей скоростью, эффективностью и надёжностью. В мероприятии в четверг приняли участие министр энергетики Крис Райт (Chris Wright), заместитель министра энергетики по науке и директор миссии Genesis д-р Дарио Гил (Darío Gil) и директор Управления научно-технической политики Белого дома (OSTP) Майкл Крациос (Michael Kratsios). В число 24 организаций, подписавших меморандумы о взаимопонимании, входят такие крупные технологические компании, как Microsoft, Google, AWS, IBM, NVIDIA, Intel, AMD и OpenAI. Также к инициативе присоединились Anthropic, Accenture, Armada, Cerebras, CoreWeave, Dell, DrivenData, Groq, HPE, Oracle, Periodic Labs, Palantir, Project Prometheus, Radical AI, xAI и XPRIZE.

Источник изображения: CoreWeave «Сегодняшнее объявление о 24 новых исследовательских партнёрствах — это только начало, поскольку мы выполняем указ президента Трампа по вовлечению всего научного сообщества, включая компании, университеты, некоммерческие организации и федеральные агентства, в “Миссию Генезис”», — сказал Крациос. Он добавил, что «Миссия Генезис» поможет американским учёным и исследователям автоматизировать разработку экспериментов, ускорить моделирование и создать прогностические модели, которые приведут к прорывам в энергетике, производстве, разработке лекарств и многом другом. Компания NVIDIA объявила на своём сайте о присоединении к инициативе и планах увеличить инвестиции в ИИ-инфраструктуру и научные исследования и разработки. Также компания сообщила, что в рамках партнёрства с DoE уже «добивается прорывных результатов в ключевых областях». В частности, упомянуты:

Другие компании, присоединившиеся к «Миссии Генезис», тоже выступили с заявлениями. Например, Google сообщила, что DeepMind предоставит учёным всех 17 национальных лабораторий DoE программу ускоренного доступа к передовым моделям ИИ для науки и агентным инструментам, начиная с AI co-scientist в Google Cloud. AI co-scientist — это многоагентный виртуальный научный сотрудник, построенный на платформе Gemini. Он разработан для того, чтобы помочь учёным синтезировать огромные объёмы информации для ускорения разработки научных и биомедицинских открытий. В начале 2026 года компания планирует расширить программу ускоренного доступа для национальных лабораторий, включив в нее AlphaEvolve — программный агент на базе Gemini для разработки сложных алгоритмов, AlphaGenome — ИИ-модель, помогающую учёным лучше понимать ДНК, ускоряя исследования в области геномной биологии и улучшая понимание заболеваний, и WeatherNext — современное семейство моделей прогнозирования погоды. Министерство энергетики и все национальные лаборатории также получат доступ к Gemini for Government. В свою очередь, AWS отметила, что прошлом месяце объявила об инвестициях в размере до $50 млрд в инфраструктуру ИИ и суперкомпьютеров, специально созданную для государственных учреждений США. Инвестиции добавят почти 1,3 ГВт мощности в её регионах Top Secret, Secret и GovCloud. По словам компании, этого достаточно для одновременного запуска тысяч моделей и симуляций ИИ, а также обработки научных данных за десятилетия в режиме реального времени. «Эта инфраструктура обеспечит доступ к вычислительным мощностям по запросу, что позволит государственным заказчикам запускать сложные ИИ-задачи и обрабатывать огромные массивы данных для критически важных приложений — от разработки автономных систем и энергетических инноваций до обработки геномных данных, — подчеркнула Amazon. Компания сообщила, что через Amazon Bedrock организации смогут получить доступ к базовым моделям, таким как Amazon Nova — новейшее семейство современных, экономически эффективных моделей, предлагающих многомодальное понимание, разработку пользовательских моделей и возможности агентного управления, — наряду с моделями от ведущих компаний, таких как Anthropic. Это обеспечит исследователям гибкость в выборе подходящей модели для каждой научной задачи, от анализа сложных геномных данных до создания синтетических обучающих наборов данных для автономных систем.

16.12.2025 [11:30], Сергей Карасёв

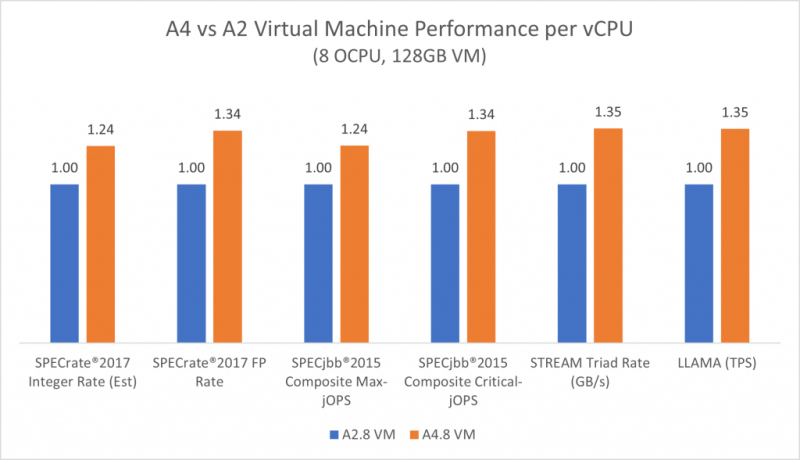

192-ядерные Arm-процессоры AmpereOne M появились в облаке OracleКомпании Ampere и Oracle объявили о том, что в облачной инфраструктуре OCI (Oracle Cloud Infrastructure) стали доступны инстансы A4 Standard на основе процессоров AmpereOne M. Эти экземпляры, как утверждается, подходят для широкого спектра рабочих нагрузок — от традиционных корпоративных приложений до ресурсоёмких задач ИИ-инференса. Чипы AmpereOne M содержат от 96 до 192 кастомизированных 64-бит ядер на базе Arm v8.6+. Используются 12 каналов DDR5-5600 с возможностью установки до 3 Тбайт памяти и 96 линий PCIe 5.0. Тактовая частота варьируется от 2,6 до 3,6 ГГц, показатель TDP — от 239 до 348 Вт. Инстансы A4 Standard обеспечивают более высокую производительность на ядро и большую пропускную способность памяти, чем экземпляры предыдущих поколений OCI A1 и A2 с чипами Ampere. Клиентам доступны виртуальные машины VM.Standard.A4.Flex с 45 OCPU (каждый OCPU содержит два ядра AmpereOne M), 700 Гбайт памяти, блочным хранилищем и сетевым подключением с пропускной способностью 100 Гбит/с. Кроме того, предлагаются экземпляры BM.Standard.A4.48 класса Bare Metal с 48 OCPU, 768 Гбайт памяти, накопителем вместимостью 3,84 Тбайт в рамках блочного хранилища и сетевым подключением на 100 Гбит/с. Заказчики, переходящие с виртуальных машин OCI A2, могут рассчитывать на повышение производительности каждого ядра до 35 % — в зависимости от рабочей нагрузки. Для ресурсоёмких вычислительных задач заявлено улучшение показателей SPECint до 24 % и SPECfp до 34 %: это особенно важно для таких приложений, как аналитика данных, пакетная обработка и научные вычисления. В случае рабочих нагрузок, чувствительных к задержкам, обеспечивается улучшение производительности SPECjbb до 34 %. Oracle подчёркивает, что для инстансов A4 Standard действуют выгодные цены: $0,0138 в расчёте на OCPU в час и $0,0027 за 1 Гбайт в час. В целом, на сегодняшний день более 110 сервисов OCI работают на оборудовании с процессорами Ampere.

14.12.2025 [22:59], Владимир Мироненко

С Microsoft в Великобритании требуют уже почти $3 млрд за завышение расценок для клиентов облачных конкурентовВ Апелляционном трибунале по вопросам конкуренции Великобритании (CAT) прошло слушание по коллективному иску против Microsoft, по итогам которого судебный орган, занимающийся рассмотрением дел, связанных с вопросами конкуренции и экономического регулирования, должен определить, может ли дело дойти до полномасштабного судебного разбирательства в 2026 году, пишет Data Center Dynamics. В иске, поданном в суд в декабре 2024 года Марией Луизой Стази (Maria Luisa Stasi), главой отдела права и политики группы по защите цифровых прав Article19, от имени клиентов облачных платформ, Microsoft обвиняется в завышении цен для компаний, использующих Windows Server в инфраструктуре конкурирующих с ней AWS, Google Cloud Platform и Alibaba Cloud, с требованием компенсации пострадавшим компаниям и организациям в размере £2,1 млрд ($2,8 млрд). Основная претензия заключается в том, что лицензии Windows Server в облаке Azure компания продаёт по вчетверо меньшей цене, чем в случае AWS или Google Cloud, и считает это совершенно нормальным. В ходе слушания Microsoft заявила, что в деле отсутствует надлежащий план возмещения предполагаемых убытков, и в связи с этим потребовала его прекращения. Представляющая интересы истцов адвокат Сара Форд (Sarah Ford) обвинила Microsoft в использовании «последовательной стратегии злоупотреблений» для поддержания доминирующего положения на рынке, жертвами которой стали тысячи обманутых предприятий. На данный момент трибунал пока не принял решение по иску против Microsoft — на это могут уйти недели или даже месяцы. В июле следственная группа британского Управления по конкуренции и рынкам (CMA) заявила, что лицензионная практика Microsoft вредит конкуренции на рынке облачных услуг, «существенно ставя в невыгодное положение AWS и Google», сообщило агентство Reuters. В ответ Microsoft заявила, что в отчёте CMA игнорируется тот факт, что «рынок облачных услуг никогда не был таким динамичным и конкурентным». Amazon и Google неоднократно жаловались CMA на деятельность Microsoft. В Евросоюзе оба облачных гиганта годами подавали точно такие же жалобы, но в итоге и AWS, и Google сбавили активность в этом направлении. Microsoft «провалила» обещанную облачную реформу, т.ч. Еврокомиссия открыла официальное расследование деятельности компании. При этом и Microsoft, и Google использовали спорные методы в борьбе друг с другом. AWS же, будучи лидером не только мирового, но и европейского облачного рынка, предпочитает действовать более аккуратно.

13.12.2025 [23:26], Руслан Авдеев

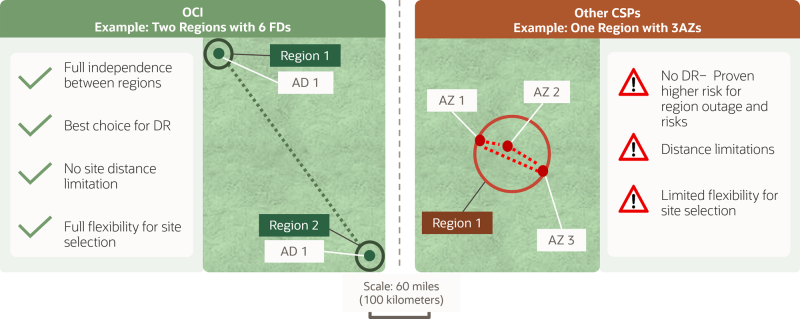

Microsoft обязалась компенсировать рост спроса на облачные и ИИ-сервисы в США, построив новые ЦОД AzureMicrosoft поделилась планами расширения инфраструктуры на территории США на фоне стремительного роста спроса на облачные и ИИ-сервисы. Компания напомнила о создании площадок Fairwater в Висконсине и Атланте. Также появится облачный регион East US 3 в агломерации «Большой Атланты» в начале 2027 года. Дополнительно планируется раширить пять действующих регионов ЦОД по всей территории Соединённых Штатов. Сеть дата-центров в границах «Большой Атланты» уже использует одни из наиболее передовых ИИ-суперкомпьютеров в мире, но в начале 2027 года сеть ЦОД в Атланте расширится, чтобы поддержать интенсивные рабочие нагрузки региона East US 3. Регион разработают с фокусом на поддержку самых ресурсоёмких задач, включая ИИ-нагрузки. Регион получит несколько зон доступности (AZ), т.е. несколько ЦОД, расположенных на некотором расстоянии друг от друга (обычно до 100 км), оснащённых независимыми источниками питания, сетевой инфраструктурой и системами охлаждения. East US 3 проектируется с учётом обязательств Microsoft, связанных с сокращением углеродных выбросов, водопотребления, утилизацией отходов и устойчивым развитием. При строительстве East US 3 уделяется первостепенное внимание сохранению и восстановлению воды. Регион планируется сертифицировать по стандарту LEED Gold. Сейчас у компании в США есть регионов шесть регионов ЦОД с несколькими зонами доступности. Планируется добавить новые зоны к ряду других регионов. В 2026 году East US 2 в Вирджинии и South Central US в Техасе, где есть по три зоны доступности, получат новые AZ. Также компания добавит ещё несколько AZ на территори США: в начале 2026 года — к US Gov Arizona, к концу 2026 года — в North Central US, а в начале 2027 года — к West Central US. Microsoft, по её собственным сдлвам, имеет больше облачных регионов, чем любой другой облачный бизнес. Всего инфраструктура Microsoft включает более 70 регионов, 400 ЦОД, более 595 тыс. км подводных и наземных ВОЛС, а также более 190 периферийных точек присутствия. В октябре 2025 года сообщалось, что Microsoft не хватает ЦОД и серверов в США, причём не только для ИИ. Впрочем, компания развернула для OpenAI первый в мире ИИ-кластер на базе суперускорителей NVIDIA GB300 NVL72. Сейчас она запустила второй «самый передовой» ИИ ЦОД в мире Fairwater в дополнение к первому проекту. В ноябре появилась информация, что компания потратит более $60 млрд на аренду ИИ-мощностей у неооблаков. Всего капитальные затраты на ИИ ЦОД должны составить $80 млрд (и до $120 млрд в 2026 финансовом году).

12.12.2025 [00:25], Владимир Мироненко

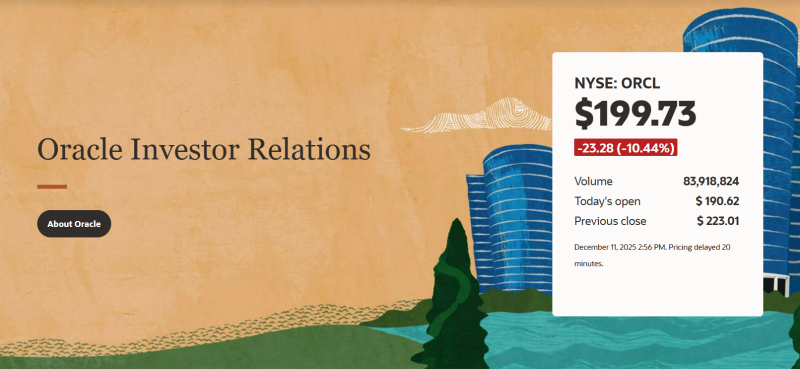

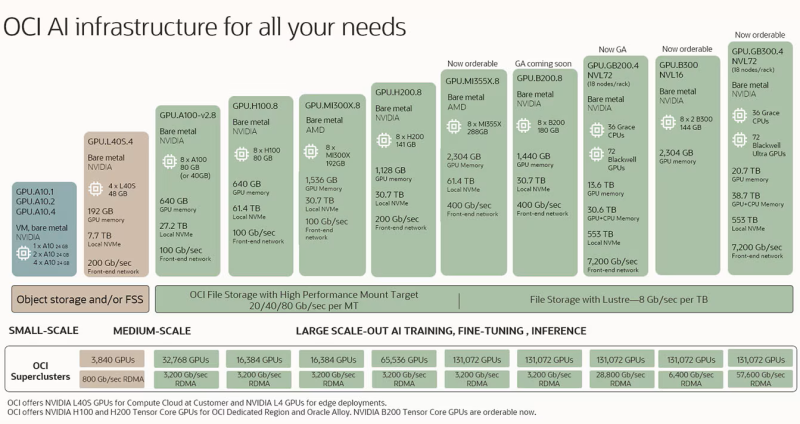

Акции Oracle показали рекордное с 2001 года падение, потянув за собой других игроков ИИ-рынкаOracle объявила результаты за II квартал 2026 финансового года, завершившегося 30 ноября. Выручка и операционная прибыль компании не оправдали ожиданий аналитиков. При этом компания повысила прогноз по расходам, что усилило опасения инвесторов по поводу её возможностей извлечь выгоду из огромного спроса ИИ-индустрии на вычислительные мощности, отметил The Wall Street Journal. В связи с этим её акции упали более чем на 11 % на внебиржевых торгах, показав в итоге самое серьёзное падение в течение дня с 2001 года. По итогам торгов в среду акции потеряли примерно треть от своей пиковой стоимости в сентябре, когда акции компании показали рекордный за 26 лет рост. Падение акций Oracle подтолкнули к падению акции других участников рынка. Акции AMD и NVIDIA упали примерно на 1 % каждая, а акции облачного провайдера CoreWeave снизились более чем на 3 % (по данным CNBC). Компания сообщила о скорректированной прибыли (Non-GAAP) за II квартал в размере $2,26 на разводнённую акцию, что значительно выше целевого показателя Уолл-стрит в $1,64 на акцию согласно консенсус-прогнозу LSEG. Вместе с тем выручка компании, несмотря на рост на 14 % по сравнению с аналогичным периодом прошлого года, до $16,06 млрд, оказалась ниже прогноза аналитиков в $16,21 млрд. Чистая прибыль (GAAP) увеличилась до $6,14 млрд, или $2,10 на разводнённую акцию, с $3,15 млрд, или $1,10 годом ранее. Выручка от облачных услуг составила $7,98 млрд, что превысило консенсус-прогноз аналитиков, опрошенных StreetAccount, в $7,92 млрд. Выручка от облачной инфраструктуры (OCI IaaS) составила $4,1 млрд, увеличившись на 68 %. Выручка от облачных приложений (OCI SaaS) равна $3,9 млрд (+11 %). Выручка от интегрированных облачных решений (SaaS) — $1,1 млрд (+18 %), выручка от NetSuite Cloud ERP (SaaS) — $1 млрд (+13 %). Выручка от разработки ПО снизилась на 3 % до $5,88 млрд, что ниже среднего прогноза аналитиков в $6,06 млрд. Продажи оборудования выросли на 7 % до $776 млн, сервисы принесли компании $1,43 млрд (+7 %). Oracle рассчитывает повысить маржинальность OCI на 30–40 %. Объём оставшихся обязательств по контрактам (RPO) вырос год к году на 438 % до $523 млрд, что выше среднего прогноза аналитиков в $501,8 млрд (согласно данным StreetAccount). Рост был вызван «новыми обязательствами от Meta✴, NVIDIA и др. компаний», сообщил в пресс-релизе главный финансовый директор Oracle Дуг Керинг (Doug Kehring). По его словам, с учётом новых обязательств, Oracle теперь планирует капитальные затраты на весь год в размере около $50 млрд, по сравнению с $35 млрд по состоянию на сентябрь. Капзатраты за 2025 финансовый год составили $21,2 млрд. Для сравнения: годовые капзатраты AWS ожидаются на уровне $125 млрд, Google — $91–$93 млрд, Meta✴ — $70–$72 млрд (а в перспективе $600 млрд), Microsoft — $80 млрд (и до $120 млрд в 2026 финансовом году), а у Alibaba Cloud, не имеющей свободного доступа к передовым ускорителям NVIDIA — $16 млрд. Здесь учитываются несколько разные периоды, но порядок затрат виден. Объявление в сентябре о том, что портфель заказов Oracle вырос до $455 млрд, привело к резкому росту акций компании. Однако с тех пор их цена упала из-за опасений по поводу уровня риска, который Oracle берёт на себя, развивая свою инфраструктуру. По данным The Register, в ноябре Oracle акции упали на 23 % — в начале месяца они стоили около $250, а в конце — около $200. Керинг попытался успокоить инвесторов, пояснив, что у компании имеется доступ к капиталу из нескольких источников, включая государственные облигации, банки и частные рынки долгового финансирования. «Кроме того, существуют и другие варианты финансирования через клиентов, которые могут предоставлять свои собственные чипы для установки в наших ЦОД, и поставщиков, которые могут сдавать свои чипы в аренду, а не продавать их», — пояснил он, добавив, что оба варианта позволяют Oracle синхронизировать её платежи с поступлениями средств и занимать значительно меньшие суммы, чем предполагают большинство аналитиков. Кроме того, Oracle отличается от «большой тройки» гиперскейлеров тем, что занимается строительством и развёртыванием ЦОД преимущественно после подтверждения обязательств клиентов. Следует отметить, что это была первая квартальная конференция по финансовым итогам с участием новых со-генеральных директоров Oracle, Клея Магуйрка (Clay Magouyrk) и Майка Сицилии (Mike Sicilia), которые заняли этот пост после ухода Сафры Кац (Safra Catz) в сентябре. В своём выступлении Сицилия отметил появление новых крупных клиентов облака OCI, в том числе Airbus, Deutsche Bank, LSEG, Panasonic, Canon и Rubrik. Аналитик Valoir Ребекка Веттеманн (Rebecca Wettemann) назвала в интервью ресурсу SiliconANGLE весьма показательным то, что он счёл необходимым подчеркнуть такое количество успешных сделок с клиентами. «Рынок был очень обеспокоен чрезмерной зависимостью Oracle от OpenAI и других проектов в области ИИ с точки зрения RPO и прогнозов, поэтому этот список успешных сделок с клиентами и ускорения роста приложений демонстрирует некоторое долгожданное разнообразие, что, безусловно, является позитивным фактором», — пояснила она. Веттеманн назвала хорошей новостью для Oracle и её стратегии капитальных затрат увеличение капвложений, поскольку она пытается занять центральное место в буме ИИ. Некоторые инвесторы обеспокоены огромным долгом, который она взяла на себя для своих инвестиций. Значительная часть портфеля заказов Oracle приходится на OpenAI Group PBC, которая обязалась потратить более $300 млрд на облачные инфраструктурные сервисы Oracle в течение следующих пяти лет. «Чем дольше портфель заказов остается невостребованным, тем выше риск того, что Oracle не сможет его монетизировать, или же ландшафт ИИ изменится настолько, что некоторые клиенты не смогут выполнить свои обязательства», — сообщила Веттеманн. Аналитик Constellation Research Хольгер Мюллер (Holger Mueller) отметил, что некоторые инвесторы могли заметить, что рост выручки Oracle происходит за счёт значительных затрат, что приводит к снижению прибыльности по мере увеличения объёмов продаж. Вместе с тем он согласился с финансовым директором по поводу того, что долг, который Oracle берёт на себя, не является проблемой. «При процентных платежах в размере приблизительно $1 млрд долговая нагрузка более чем управляема для компании», — сказал аналитик. Комментируя продажу доли в Ampere, основатель Oracle Ларри Эллисон (Larry Ellison) сказал, что решение было принято, потому что, по его мнению, больше нет смысла продолжать проектировать, производить и использовать собственные микросхемы в своих ЦОД. «Компания привержена политике чиповой нейтральности, — сказал он. — Нам необходимо быть готовыми и иметь возможность использовать любые чипы, которые захотят приобрести наши клиенты». В свою очередь, Клей Магуйрк отметил, что у Oracle более 211 действующих и планируемых облачных регионов по всему миру. Кроме того, компания наполовину завершила строительство 72 мультиоблачных ЦОД, которые будут интегрированы в облака Amazon, Google и Microsoft. «Наш бизнес по мультиоблачным базам данных — самый быстрорастущий бизнес: во II квартале он вырос на 817 %», — сказал он. Также следует обратить внимание на слова Майка Сицилии о том, что у компании «огромные преимущества перед конкурентами в области приложений». «Обучение ИИ и продажа моделей ИИ — это очень крупный бизнес, но мы считаем, что существует еще большая возможность — внедрение ИИ в самые разные продукты», — сообщил Сицилия. — Oracle находится в уникальном положении для внедрения ИИ во все три уровня наших программных продуктов: ПО для облачных ЦОД, ПО для автономных баз данных и аналитики, а также ПО для приложений. Все три направления Oracle уже достаточно масштабны — ИИ сделает их всё лучше и масштабнее». В III финансовом квартале Oracle ожидает скорректированную прибыль (Non-GAAP) на акцию в размере от $1,70 до $1,74 и рост выручки на 19-21 %. Консенсус-прогноз LSEG предполагает прибыль на акцию в размере $1,72 и выручку в размере $16,87 млрд, что подразумевает рост год к году на 19 %.

11.12.2025 [14:15], Руслан Авдеев

OpenAI заключила с Deutsche Telecom соглашение о многолетнем сотрудничестве в сфере ИИDeutsche Telecom (DT) заключила стратегическое многолетнее соглашение о партнёрстве с OpenAI. Компании намерены внедрять передовые ИИ-технологии в экосистеме компании, включая внутренние процессы и клиентские сервисы. Пилотные программы стартуют в I квартале 2026 года, сообщает блог IEEE ComSoc. DT намерена внедрить ChatGPT Enterprise в масштабах всей компании, используя ИИ для оптимизации ключевых функций, включая:

Партнёрство способно подкрепить стремление DT стать одним из лидеров европейской облачной ИИ-инфраструктуры, особое внимание уделяется достижению цифрового суверенитета. В числе предыдущих инициатив компании можно отметить создание Sovereign Cloud в 2021 году силами подразделения T-Systems и Google Cloud. В начале 2025 года был предложен пакет T Cloud Suite, обеспечивавший доступ к суверенным публичным, частным и ИИ-облакам с использованием гибридной инфраструктуры. При поддержке NVIDIA начато строительство Industrial AI Cloud в Мюнхене, запуск которого запланирован на I квартал 2026 г. По мнению экспертов, интеграция ИИ-технологий OpenAI усилит позиции DT в роли поставщика полного стека решений для корпоративных клиентов, от связи и ЦОД до специализированного ПО. Эксперты подчёркивают, что ИИ ЦОД в Германии и Европе не особенно много, благодаря чему операторы уровня DT и другие компании могут развиваться в этой нише, не опасаясь сильной конкуренции. В США ИИ ЦОД значительно больше, но попытки телеком-операторов конкурировать с гиперскейлерами на рынке ЦОД провалились. При этом масштаб проектов в США значительно больше.

Источник изображения: Deutsche Telekom По словам представителя Tekonyx, интеграция продуктов OpenAI позволит использовать инструменты разработки на основе ChatGPT для создания проприетарных информационных систем — Operational Support Systems (OSS) и Business Support Systems (BSS), связанных с техническим обеспечением работы сети и бесперебойности бизнес-процессов. Ожидается, что это откроет новые источники дохода, благодаря предложению edge-вычислений корпоративным клиентам, отраслевых ИИ-решений для медицины, ретейла и производства, интегрированных частных 5G-сетей и ИИ-пакетов для промышленных логистических хабов. Подчёркивается, что телеком-операторы могут сыграть значительную роль в организации инференса на периферии, а также хостинге специализированных моделей, которые стоит эксплуатировать поблизости от источника пользовательских данных. Более того, такие операторы будут обеспечивать связью неооблачных провайдеров уровня CoreWeave, Lambda Labs, Digital Ocean, Vast.AI и др. Поэтому OpenAI стремится заранее занять нишу сотрудничества с телеком-бизнесом. По словам других экспертов, такая модель партнёрства особенно перспективна для европейских операторов: Orange, Telefonica и др. При этом воспроизведение модели требует крупных инвестиций и масштабов развёртывания. Новое сотрудничество переводит DT из статуса пользователя ИИ в статус партнёра по разработке. В то же время OpenAI организует взаимодействие и с другими операторами — в Евросоюзе, США, Индии, Южной Корее и др. Например, компания имеет соглашения различного рода с T-Mobile US, SK Telecom, Circles, Rakuten, Orange, Jio и Airtel. Имея более 261 млн клиентов мобильных сервисов по всему миру, Deutsche Telekom имеет мощную основу для масштабного внедрения ИИ. Новое партнёрство с OpenAI знаменует переход компании от пилотных проектов к крупномасштабным продуктам, приносящим пользу всем абонентам.

11.12.2025 [14:05], Руслан Авдеев

Microsoft инвестирует в Индию $17,5 млрд для масштабирования ИИ-инфраструктурыКомпания Microsoft заявила о крупных инвестициях в ИИ-инфраструктуру в размере $23 млрд, большая часть из этих средств предназначена Индии — IT-гигант делает ставку на один из самых быстрорастущих рынков цифровых проектов в мире, сообщает Reuters. Доля индийских инвестиций составит $17,5 млрд — это крупнейшие вложения компании в азиатском регионе. Они станут развитием двухлетнего инвестиционного проекта объёмом $3 млрд. Новый, четырёхлетний план вступает в силу в 2026 году и обеспечит Microsoft самое масштабное присутствие на местном рынке облачных вычислений. Хотя момент не самый удачный из-за некоторой напряжённости между Нью-Дели и Вашингтоном, возникшей из-за торговых пошлин и зашедших в тупик переговорах о торговой сделке. Благодаря наличию в стране порядка 1 млрд интернет-пользователей и обилию IT-специалистов высокой квалификации Индия стала ключевым регионом для американских капиталовложений, техногиганты охотно инвестируют миллиарды долларов в развитие ИИ в стране. Соответствующие ЦОД стали для Индии шансом воспользоваться экономическим бумом на рынке высоких технологий, учитывая то, что её возможности по производству полупроводников пока ограничены. Так или иначе, Microsoft заявила, что новый кампус ЦОД в Хайдарабаде (Hyderabad) станет крупнейшим облачным регионом компании в Индии, включающим три зоны доступности. Как ожидается, его введут в эксплуатацию в середине 2026 года. Также компания расширит три действующих региона в Ченнаи, Хайдарабаде и Пуне. Правда, по данным Datacenter Dynamics, регион в Мумбаи переведён в статус т.н. «reserved access region» с ограниченным доступом. Дополнительно она удвоила январское обещание обучить 20 млн жителей Индии навыкам работы с ИИ до конца десятилетия. Компания интегрирует возможности Azure OpenAI в местные платформы e-Shram и National Career Service (NCS), оптимизируя подбор вакансий, способствуя развитию навыков и др. для более чем 310 миллионов работников. Microsoft также заявила, что инвестирует CA$7,5 млрд ($5,42 млрд) в Канаду в следующие два года. Новые облачные мощности должны ввести в эксплуатацию во II половине 2026 года. Это часть общего плана инвестиций Microsoft в Канаду в объёме CA$19 млрд в 2023–2027 гг. В частности, компания намерена расширить предложение Azure Local в стране. Кроме того, Microsoft взаимодействует с ИИ-стартапом Cohere для предложения передовых ИИ-моделей компании на платформе Azure. В ноябре сообщалось о планах компании инвестировать $10 млрд в ИИ-инфраструктуру в Португалии, а также $15 млрд в ОАЭ. Как прогнозирует консалтинговая компания Colliers, к 2030 году общая мощность ЦОД в Индии вырастет более чем втрое и составит порядка 4,5 ГВт. В Индии на Microsoft работает более 22 тыс. человек, в Канаде — около 5,3 тыс. В октябре Google объявила о намерении инвестировать в строительство ИИ ЦОД в штате Андхра-Прадеш (Andhra Pradesh) $15 млрд за пять лет, это станет крупнейшим вложением гиганта в стране. В январе AWS объявила о намерении вложить в страну $8,3 млрд, а теперь Amazon увеличила инвестиции до $30,5 млрд. В целом, как сообщает Reuters, ожидается, что Microsoft и другие американские облачные провайдеры только в 2025 году более $400 млрд на ИИ-проекты и ЦОД по всему миру.

11.12.2025 [14:05], Руслан Авдеев

Amazon инвестирует $35 млрд в Индию к 2030 году для инноваций в сфере ИИ и создания рабочих местAmazon объявила о намерении вложить более $35 млрд в индийские подразделения компании до 2030 года в дополнение к уже потраченным здесь $40 млрд. Новые инвестиции направят на масштабирование активности и три стратегически важных направления: цифровизацию на основе ИИ, рост экспорта и создание рабочих мест. В отчёте Keystone Strategy говорится, что инвестиции $40 млрд (в т.ч. выплаты сотрудникам и деньги на развитие инфраструктуры) сделали компанию крупнейшим зарубежным инвестором в стране, крупнейшим «катализатором» экспорта с помощью электронной торговли, и одним из ключевых создателей рабочих мест в Индии. Значительные средства затрачены на создание физической и цифровой инфраструктуры, в т.ч. пунктов обслуживания, логистических сетей, дата-центров и инфраструктуры цифровых платежей. По данным Keystone, Amazon оцифровала более 12 млн малых предприятий, помогла увеличению объёма экспорта с помощью электронной коммерции на сумму $20 млрд, а в 2024 году обеспечила порядка 2,8 млн прямых и косвенных рабочих мест в различных отраслях индийской экономики, включая технологическую сферу, логистику, службы поддержки и др. с медицинским страхованием и обучением. В Amazon утверждают, что влияние компании в стране выходит за рамки прямого трудоустройства сотрудников, она обеспечивает рабочие места в сфере упаковки, логистики и сопутствующих технологий, а также даёт возможность развития на своей торговой площадке тысячам малых предприятий. В 2030 году количество прямых и косвенных рабочих мест увеличится до 3,8 млн благодаря расширению бизнеса как самой Amazon, так и растущих сетей пунктов обслуживания и сервисов доставки — одновременно поддерживаются и смежные отрасли. Совокупный объём экспорта, связанный с электронной коммерцией, к 2030 году должен вырасти в четыре раза до $80 млрд.

Источник изображения: pavan gupta/unsplash.com Благодаря дополнительным вложениям $35 млрд Amazon намерена ускорить цифровую трансформацию в стране, укрепить местную инфраструктуру и поддержать инновации. Инвестиции соответствуют приоритетам Индии и направлены на расширение возможностей ИИ, улучшение логистики, поддержку роста малого бизнеса и создание новых рабочих мест. Программа Amazon по внедрению ИИ во все сферы жизни должна помочь преобразовать цифровое пространство страны, поддерживая заявленную государством концепцию «ИИ для всех». К 2030 году Amazon намерена обеспечить преимущества ИИ 15 млн малых предприятий — продавцы на платформе Amazon.in уже используют ИИ-инструменты Seller Assistant, Next Gen Selling и др. Опыт покупок для сотен миллионов покупателей планируется улучшить с помощью инструментов Lens AI (визуальный поиск), интерактивных покупок с помощью Rufus и многоязычных интерфейсов. Также планируется предоставить 4 млн школьников возможности обучиться навыкам работы с ИИ и познакомить их с карьерными возможностями в технологической сфере. Программа включает разработку учебной программы, посвящённой ИИ, экскурсии в технологические компании, практические занятия в «ИИ-песочнице» и обучение самих преподавателей. Инициатива напрямую поддерживает цели Национальной образовательной политики Индии от 2020 года. О том, сколько именно средств выделят на ИИ-инфраструктуру, включая ЦОД AWS, не сообщается. В начале 2025 года AWS выделила $8,3 млрд только на строительство одного облачного региона — AWS Asia-Pacific в Мумбаи (Mumbai). Регион работает с 2016 года, к 2022 году компания инвестировала в него $3,7 млрд. В 2022 году она запустила облачный регион в Хайдарабаде (Hyderabad). Обязательство потратить $8,3 млрд на ЦОД в Мумбаи — часть более обширного инвестиционного плана, в рамках которого AWS намеревалась потратить в Индии $12,7 млрд. Также компания планирует инвестировать $7 млрд в течение 14 лет в облачный регион в Хайдарабаде. Последние новости об Amazon появились вскоре после того, как Microsoft объявила о планах потратить $17,5 млрд на ИИ-инфраструктуру в Индии к 2030 году. В октябре 2025 года Google подтвердила о реализации проекта по строительству кампуса ЦОД в штате Андхра-Прадеш (Andhra Pradesh), планируется потратить $15 млрд за пять лет.

10.12.2025 [14:30], Андрей Крупин

MWS Cloud втрое увеличила облачные мощности на Дальнем ВостокеКомпания MWS Cloud (входит в МТС Web Services) завершила масштабное расширение облачной инфраструктуры на Дальнем Востоке, увеличив в три раза вычислительные мощности во Владивостоке. Виртуальная инфраструктура развёрнута в ЦОД уровня Tier III. Ранее в 2025 году MWS Cloud также в 3,3 раза расширила мощности своей облачной площадки в Сибири. Для усиления облачной платформы на базе VMware во владивостокском дата-центре были установлены серверы с процессорами частотой 3,25 ГГц и большим объёмом оперативной памяти. Такая конфигурация позволила инженерам MWS Cloud обеспечить оптимальные условия для работы высоконагруженных систем, крупных баз данных, корпоративных решений уровня SAP и «1С».

Источник изображения: mws.ru/cloud-platform «Мы стремимся, чтобы компании в разных частях страны могли получать доступ к облачным ресурсам вблизи своих производственных площадок. В рамках этой стратегии несколько лет назад MWS Cloud запустила зону доступности во Владивостоке. За эти годы потребление облачных сервисов на Дальнем Востоке значительно выросло. Поэтому, чтобы удовлетворить потребности местного бизнеса в вычислительных мощностях, MWS Cloud более чем в три раза расширила мощности в дата-центре во Владивостоке. Это позволит местному бизнесу ещё больше увеличить использование облачных мощностей и быстрее масштабировать собственные IT-системы», — говорится в заявлении MWS Cloud.

10.12.2025 [09:39], Владимир Мироненко

HPE позиционирует стек Morpheus в качестве альтернативы VMwareHPE обновила облачный портфель GreenLake и объединила сетевые решения Aruba и Juniper, чтобы предложить клиентам возможности AIOps для обеих платформ, а также высокоскоростное подключение для обработки ИИ-нагрузок. Президент и генеральный директор HPE Антонио Нери (Antonio Neri) заявил, что одной из самых серьёзных проблем является растущая стоимость виртуализации. Именно эту проблему решает платформа Morpheus, передаёт The Register. Технический директор и исполнительный вице-президент по гибридным облакам Фидельма Руссо (Fidelma Russo) сообщила, что ошибочно полагать, что предприятия стремятся просто заменить гипервизор. Она отметила, что компании ищут современную платформу, способную работать с традиционными виртуальными машинами (ВМ), контейнерами и рабочими нагрузками эпохи ИИ с тем же уровнем отказоустойчивости, безопасности и автоматизации, который они ожидают от облака. По словам Руссо, инструменты управления Morpheus и OpsRamp от HPE, а также ПО для аварийного восстановления Zerto представляют собой «полностью интегрированную альтернативную платформу корпоративного уровня, охватывающую ВМ, контейнеры и физическое оборудование». Фактически HPE предлагает альтернативу платформе VMware от Broadcom, хотя Руссо прямо её не назвала. Платформа Morpheus, приобретённая HPE в позапрошлом году, теперь поддерживает программно-определяемые сети (SDN) с нулевым доверием для виртуальных машин с гипервизором HVM (VM Essential) — на базе технологий Juniper Networks, приобретённой HPE в этом году. Также Morpheus предлагает полную поддержку Kubernetes и контейнерных рабочих нагрузок в рамках HVM для унифицированных операций с виртуальными машинами и контейнерами. Интегрированная с Morpheus система управления данными Apstra Data Center Director от Juniper обеспечивает автоматическую настройку коммутаторов при перемещении или миграции виртуальных машин, а OpsRamp интегрируется с Apstra Data Center Director и Compute Ops Management, объединяя управление и аналитику по всему стеку. «Благодаря этой интеграции… у нас теперь полностью автоматизированный стек, который устраняет проблемы, возникающие между виртуальными машинами и устойчивостью сети, что было ещё одним ключевым требованием, о чём мы говорили клиентам», — сообщила Руссо. Сообщается, что теперь поддерживаются распределённые кластеры с серверами в разных локациях, что позволяет поддерживать рабочие нагрузки даже при полном отключении одной из площадок. Синхронная репликация обеспечивается Alletra Peer Persistence. HPE также сообщила, что Morpheus VM Essentials будет работать с Veeam Data Platform v13 для резервного копирования на уровне гипервизора, что обеспечит быстрое восстановление виртуальных машин в частных облачных средах, включая HPE Private Cloud Business Edition. |

|