Материалы по тегу: aws

|

28.04.2026 [01:11], Владимир Мироненко

Microsoft и OpenAI пересмотрели «брачный договор»: эксклюзивных прав больше нет, но и выручкой делиться не надоMicrosoft и OpenAI объявили о пересмотре условий партнёрского соглашения, что некоторые эксперты рассматривают как победу разработчика ChatGPT, хотя многие считают, обе стороны остаются в выигрыше. Как отметили обе компании, обновлённое соглашение призвано упростить партнерство и способы совместной работы, обеспечивая большую предсказуемость. Согласно обновлённому соглашению, у Microsoft по-прежнему будет лицензия на интеллектуальную собственность OpenAI для моделей и продуктов, срок владения которой ограничен 2032 годом, однако теперь она будет неисключительной. До этого у Microsoft были эксклюзивные права на интеллектуальную собственность OpenAI до тех пор, пока та не создаст «общий ИИ» (AGI). Microsoft по-прежнему является «основным облачным партнёром» OpenAI, т.е. основная часть облачных ресурсов OpenAI, вероятно, будет обслуживаться Azure в течение шести лет, охватываемых этим соглашением, даже несмотря на то, что OpenAI спешит построить собственные ЦОД в сотрудничестве с другими партнёрами. В октябре OpenAI обязалась приобрести облачные ресурсы Microsoft на сумму ещё $250 млрд. Фраза о том, Microsoft по-прежнему является «основным облачным партнёром» — сигнал акционерам Microsoft о том, что OpenAI по-прежнему будет крупным клиентом Azure, отметил ресурс TechCrunch. В обновлённом соглашении указано, что «продукты OpenAI будут в первую очередь поставляться Azure, если только Microsoft не сможет и не решит отказаться от поддержки». Судя по всему, Microsoft теперь будет в числе поставщиков, предлагающих новейшие продукты OpenAI. Но что более важно, «теперь OpenAI может предоставлять все свои продукты клиентам у любого облачного провайдера». Это означает, что Microsoft теперь не сможет подать в суд на OpenAI из-за того, что та в рамках инвестиционного соглашения с Amazon на $50 млрд пообещала, что AWS получит эксклюзивные права на предоставление нового инструмента OpenAI для создания агентов — Frontier. Согласно первоначальному соглашению, OpenAI запрещалось предлагать Frontier эксклюзивно в AWS (или даже не эксклюзивно, а вообще). Когда OpenAI объявила о сделке с AWS, Microsoft публично опровергла эксклюзивные условия AWS, указав: «Microsoft сохраняет свою эксклюзивную лицензию и доступ к интеллектуальной собственности в отношении моделей и продуктов OpenAI. <…> Azure остаётся эксклюзивным поставщиком облачных услуг для stateless API-вызовов OpenAI. <…> Любые stateless-вызовы API к моделям OpenAI, являющиеся результатом сотрудничества OpenAI с любой третьей стороной, включая Amazon, будут размещаться в Azure. <…> Собственные продукты OpenAI, включая Frontier, будут по-прежнему размещаться в Azure». Microsoft также подчеркнула, что её условия действуют до тех пор, пока OpenAI не получит AGI. Financial Times тогда сообщила, что Microsoft даже рассматривала возможность подачи судебного иска по этому поводу. Комментируя заключение обновлённого соглашения, генеральный директор Amazon Энди Джасси (Andy Jassy), в частности, отметил, что это означает, что модели OpenAI станут доступны клиентам на AWS Bedrock. Хотя эта сделка выгодна для OpenAI, Microsoft тоже в выигрыше. Новое соглашение позволяет Microsoft прекратить выплату доли выручки OpenAI, в то время как OpenAI продолжит выплачивать долю выручки Microsoft до 2030 года, независимо от технологического прогресса OpenAI, хотя теперь эта сумма ограничена. В прошлом квартале Microsoft заработала $7,5 млрд благодаря инвестициям в OpenAI. Также Microsoft продолжает напрямую участвовать в развитии OpenAI в качестве крупного акционера. Владея примерно 27 % коммерческой компании, Microsoft будет иметь финансовую выгоду от роста OpenAI, даже в случае продаж её продуктов в AWS.

24.04.2026 [17:11], Сергей Карасёв

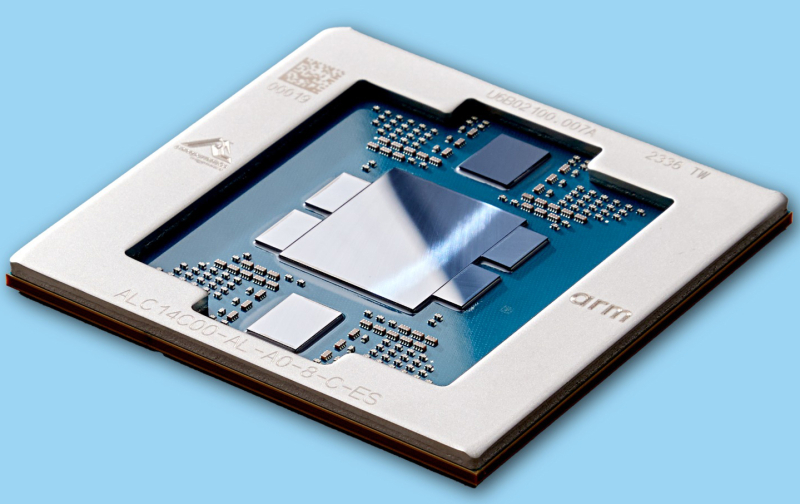

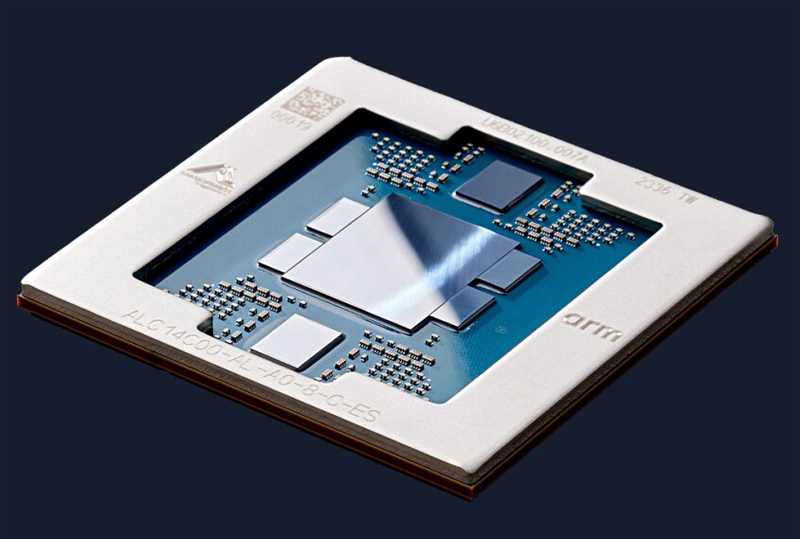

Meta✴ возьмёт на вооружение «десятки миллионов» Arm-ядер AWS Graviton5Компания Meta✴, по сообщению The Register, объявила о расширении сотрудничества с облаком AWS. Речь идёт об использовании Arm-процессоров Graviton5 для поддержания определённых ИИ-нагрузок, в частности, агентных систем. Сама AWS говорит о невероятном спросе на собственные процессоры. Крупным заказчиком является, например, Uber. AWS представила чипы Graviton5 в конце прошлого года. Эти изделия содержат 192 ядра Neoverse V3 (Poseidon), каждое из которых имеет 2 Мбайт кеша L2. Общий объём L3-кеша составляет 192 Мбайт. Присутствуют 12 каналов памяти DDR5-8800. Утверждается, что прирост производительности достигает 25 % по сравнению с процессорами Graviton предыдущего поколения. Meta✴ намерена использовать для своих задач «десятки миллионов» ядер Graviton5. Таким образом, компания станет одним из крупнейших клиентов, применяющих чипы собственной разработки AWS. Руководитель отдела инфраструктуры Meta✴, заявил, что сотрудничество с AWS направлено на диверсификацию вычислительных ресурсов. По его словам, это необходимо в свете реализации масштабных проектов в области ИИ. Ранее Meta✴ объявила о стратегическом партнёрстве с компанией Arm Holdings, которое направлено на «масштабирование эффективности ИИ на каждом уровне вычислений, охватывающем ПО и инфраструктуру ЦОД». В частности, Meta✴ намерена использовать чипы Arm AGI, специально оптимизированные для агентного ИИ. Однако, как уточняет The Register, эти изделия начнут поступать в дата-центры Meta✴ не ранее конца текущего года, поэтому компания пока будет разворачивать соответствующие нагрузки на базе Graviton5 в облаке AWS. Аналитики Counterpoint Research прогнозируют, что к 2029 году на Arm-решения будет приходиться до 90 % рынка серверных ASIC-изделий, ориентированных на ИИ. Между тем сама Meta✴ проектирует фирменные ИИ-ускорители MTIA, которые в зависимости от модификации могут применяться для обучения моделей, инференса и пр.

21.04.2026 [11:19], Сергей Карасёв

Anthropic получит от AWS до 5 ГВт ИИ-мощностей и до $25 млрд инвестицийКомпании Anthropic и Amazon объявили о расширении сотрудничества в области облачной инфраструктуры и технологий ИИ. В рамках партнёрства Anthropic получит до 5 ГВт мощностей в инфраструктуре AWS для обучения и поддержания работы своих передовых ИИ-моделей семейства Claude. В ответ Amazon инвестирует в Anthropic дополнительные $5 млрд, а в будущем — ещё до $20 млрд в зависимости от достижения определённых коммерческих целей. Ранее Amazon уже вложила $8 млрд в Anthropic. Отмечается, что Anthropic и Amazon тесно работают с 2023 года. В настоящее время более 100 тыс. клиентов используют модели Claude на платформе Amazon Bedrock. Партнёры также запустили Project Rainier — крупнейший в истории AWS и один из самых масштабных вычислительных кластеров в мире. На сегодняшний день Anthropic использует более 1 млн ускорителей AWS Trainium2 для обучения и обслуживания Claude. В рамках расширенного соглашения Anthropic обязуется потратить более $100 млрд в течение следующих десяти лет на вычислительные мощности AWS. Речь идёт об использовании изделий Trainium текущих и будущих поколений, включая Trainium4. Кроме того, будут использоваться «десятки миллионов» ядер Graviton. В общей сложности это даст до 5 ГВт вычислительной мощности. Так, к концу 2026 года будет введено в эксплуатацию около 1 ГВт ресурсов на базе Trainium.

Источник изображения: Amazon Договор предполагает использование дата-центров в Азии и Европе, что поможет повысить качество обслуживания растущей международной клиентской базы Claude. При этом пользователи смогут получить доступ к полнофункциональной консоли Claude (биллинг, безопасность, управление) непосредственно в облаке AWS — без необходимости управления дополнительными учётными данными или контрактами. Нужно отметить, что Anthropic сотрудничает и с другими поставщиками облачных услуг. В частности, недавно компания объявила о расширении использования инфраструктуры Google Cloud, а также ускорителей Google TPU. Кроме того, Anthropic взяла на себя обязательство приобрести вычислительные мощности Microsoft Azure стоимостью $30 млрд и заключить контракт на поставку дополнительных мощностей объёмом до 1 ГВт.

17.04.2026 [23:32], Владимир Мироненко

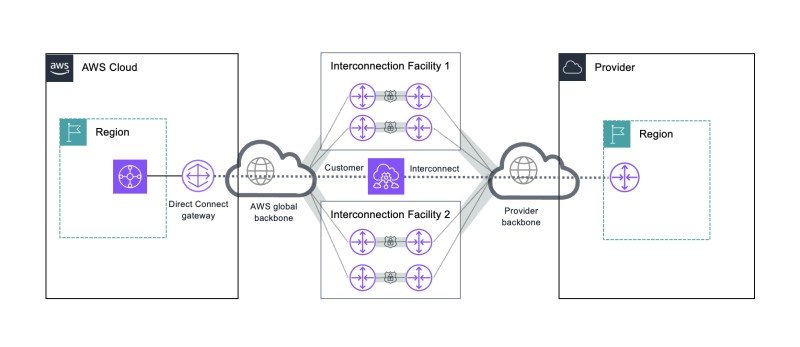

Храним здесь, запускаем там: OCI и AWS подружили свои облачные сетиOracle и Amazon решили объединить усилия для создания частного высокоскоростного соединения между OCI и AWS. Благодаря установлению связи между Oracle Interconnect и AWS Interconnect–multicloud клиенты обеих компаний получат доступ к быстрому, частному, управляемому соединению для бесперебойного запуска приложений и перемещения данных между OCI и AWS. Как отмечено в пресс-релизе, благодаря созданию ранее облачного сервиса Oracle AI Database@AWS компании впервые предложили клиентам более простой способ запуска Oracle AI Database в ЦОД AWS с теми же функциями, архитектурой и производительностью, что и в локальной среде. «Теперь мы развиваем это направление, устанавливая соединение между нашим популярным межоблачным соединением и AWS Interconnect–multicloud. Это поможет нашим общим клиентам модернизировать свои приложения, объединить данные и открыть новые возможности генеративного ИИ», — сообщила Oracle. Этот шаг отражает переход предприятий к мультиоблачным инфраструктурам, использующим десятки отдельных облачных платформ и сервисов, пишет ресурс SiliconANGLE. Современные ИИ-приложения обычно работают на архитектуре с разделённым стеком — например, компания может использовать высокопроизводительную базу данных в OCI вместе с AWS SageMaker. Изменить что-либо после запуска системы непросто, и без высокопроизводительного моста между двумя облаками клиенты будут сталкиваться с экстремальными задержками, что будет отражаться на возможностях ИИ-приложений.

Источник изображения: Oracle SiliconANGLE назвал нынешний анонс довольно неожиданным, учитывая, что отношения компаний долгое время были напряжёнными. Однако, похоже, обе компании только выиграют от партнёрства, обеспечив передачу данных между своими облаками как между единой интегрированной платформой. С этой целью Oracle интегрирует свой собственный сервис межсетевого взаимодействия со спецификацией AWS Interconnect-multicloud для создания безопасного и приватного соединения, полностью обходящего публичный интернет. Это позволит компаниям поддерживать развёртывание с разделением стека, так что организации смогут запускать приложение в OCI и хранить его данные в AWS, или наоборот. Примечательно, что Oracle охарактеризовала новое решение как «управляемое» и «нативное», то есть, клиентам не нужно настраивать вручную маршрутизацию или разрабатывать сложные стратегии репликации данных. Соблюдая спецификации AWS, Oracle, по сути, стандартизирует способ взаимодействия своего облака с платформой конкурента. Роб Стречай (Rob Strechay), ведущий аналитик theCUBE Research и Smuget Consulting, сообщил ресурсу SiliconANGLE, что сегодняшний шаг подчеркивает убеждение в том, что мультиоблачные решения — это уже не просто стратегия, а реальность для каждого предприятия. «Устраняя сложность сетевого взаимодействия между двумя крупнейшими доменами, Oracle и AWS делают межоблачную отказоустойчивость и ИИ-архитектуры гораздо более достижимыми для предприятий», — сказал он. «Будущее ИИ — это когда ваши данные хранятся в одном месте, ваши модели работают в другом, и сеть не мешает, — отметил Стречай. — Это также позволяет организациям легко осуществлять аварийное восстановление в разных облаках. Хотя на бумаге это всегда имело смысл для баз данных, Oracle делает это достижимым на практике без создания масштабного проекта в области сетевых технологий». Следует отметить, что Google Cloud ещё в мае 2023 года запустил мультиоблачное соединение Cross-Cloud Interconnect, а затем, в декабре прошлого года, — выделенное частное соединение с AWS. Со своей стороны, Oracle уже установила межсетевые соединения с Google Cloud и Azure от Microsoft. Oracle отметила, что сотрудничество между OCI и AWS Interconnect–multicloud станет последним дополнением к её комплексным мультиоблачным возможностям, планируя запуск высокопроизводительного канала позже в этом году в регионе AWS us-east-1.

14.04.2026 [16:12], Руслан Авдеев

Как по волшебству: AWS запускает инициативу Project Houdini для ускорения строительства ЦОДAmazon Web Services (AWS) исследует возможность поставить на поток строительство модульных дата-центров для ускорения развёртывания новых мощностей, сообщает Business Insider. Как следует из полученных журналистами внутренних документов компании, инициатива Project Houdini предполагает переход к готовым, собранным ещё на заводе модулям, из которых формируются машинные залы. Предполагается, что такая схема позволит сократить сроки возведения ЦОД «на месяцы». По словам представителя AWS, инновации в сфере строительства дата-центров позволяют создавать ИИ-инфраструктуру «дешевле и быстрее», поэтому клиенты обращаются именно к AWS для выполнения ресурсоёмких рабочих нагрузок. Ожидается, что только в этом году капитальные затраты Amazon составят $200 млрд, большая часть которых пойдёт на ЦОД. На днях руководство AWS сообщало сотрудникам, что компания испытывает недостаток производственных мощностей, из-за чего не может в полной мере удовлетворить спрос на мощности. Отмечается, что сейчас на обустройство машинных залов может уйти до 15 недель, около 60–80 тыс. человеко-часов от момента старта до установки серверов. Рабочие вручную прокладывают коммуникационные сети и электропроводку, готовят стойки т.д. Project Houdini предусматривает создание на производстве крупных секций, объединяющих стойки, системы электропитания, кабельную разводку, освещением, системами пожаротушения и безопасности. 45″ модули массой около 9 т доставляются в ЦОД грузовиками.

Источник изображения: Josh Olalde/unspalsh.com По оценкам AWS, время развёртывания сократится с 15 до 2–3 недель. Предполагается, что технология будет отработана к августу 2026 года, в конечном итоге её можно будет использовать для строительства более 100 ЦОД ежегодно. В рамках инициативы AWS взаимодействует с Cupertino Electric, производство первых модулей планируется начать в Топике (Topeka, Канзас), Хьюстоне (Houston, Техас) и Солт-Лейк-Сити (Salt lake City, Юта). Хотя модульные ЦОД предлагаются уже давно, обычно они используются в небольших проектах, в качестве одиночного периферийного дата-центра или как объекты всего из нескольких модулей. Такие решения предлагают, например, Schneider Electric и Vertiv. Впрочем, есть и иные подходы. Так, Meta✴ вовсе отказалась от капитального строительства, разместив ИИ-оборудование внутри быстровозводимых тентов.

13.04.2026 [22:25], Владимир Мироненко

Amazon призвала акционеров не углубляться в климатические показатели компанииСовет директоров Amazon преддверии ежегодного общего собрания призвал акционеров отклонить предложение обязать компанию раскрывать больше информации о влиянии расширения её парка ЦОД на её же климатические обязательства, сообщил The Register. Это предложение было подано некоммерческой организацией As You Sow, выступающей за корпоративную ответственность, и Mercy Investment Services, инвестиционным подразделением Sisters of Mercy of the Americas. В нём отмечается, что Amazon стремится к масштабному расширению своей облачной инфраструктуры в течение следующих нескольких лет, что ставит под сомнение реалистичность климатических обязательств, сделанных раннее центральным элементом её корпоративной стратегии. Ранее Amazon обязалась «достичь нулевых выбросов углерода к 2040 году» и полностью перейти на возобновляемые источники энергии к 2030 году. Хотя она утверждает, что выполнила последнее обязательство в 2023 году, в предложении выражается сомнение в том, сможет ли компания поддерживать этот уровень в ближайшие годы, учитывая масштабное расширение ЦОД, запланированное AWS. Компания наряду с Meta✴ действительно является одним из крупнейших мире покупателей «чистой» энергии. Однако ранее глава компании Энди Джасси (Andy Jassy) сообщил, что Amazon добавила 3,9 ГВт вычислительных мощностей в течение 2025 года и намерена удвоить этот показатель к концу 2027 года, потратив $200 млрд на расширение инфраструктуры в 2026 году. Для этой инфраструктуры потребуется дополнительная электроэнергия. В предложении отмечено, что коммунальные предприятия в таких штатах, где развиты ЦОД, теперь вынуждены строить новые газовые электростанции для удовлетворения растущего спроса и даже поддерживать работу угольных электростанций. Всё это приводит к выбросам миллионов тонн дополнительных парниковых газов в атмосферу. В связи с этим в предложении задан вопрос, как Amazon планирует решать эту проблему и будет ли увеличен объём закупаемых сертификатов возобновляемой энергии (REC). Инвесторы Amazon выиграют от анализа, объясняющего, как компания будет решать эти проблемы, говорится в документе. В свою очередь, Amazon свой призыв к акционеров отклонить предложение объяснила тем, что считает отчёт, запрошенный в предложении, ненужным. «Мы уже регулярно предоставляем публичные обновления о нашем прогрессе, инициативах и работе по достижению наших климатических целей, включая регулярные отчёты о нашей углеродоёмкости и о наших усилиях по сокращению углеродного следа рабочих нагрузок ИИ и повышению устойчивости и эффективности наших ЦОД, — говорится в обращении Amazon, — В результате, наша текущая публичная отчётность уже решает конкретные проблемы, обозначенные в этом предложении, и делает отчёт, запрошенный в предложении, ненужным».

11.04.2026 [23:18], Владимир Мироненко

Глава Amazon допустил продажу собственных чипов сторонним заказчикамНа этой неделе генеральный директор Amazon Энди Джасси (Andy Jassy) опубликовал ежегодное послание акционерам, в котором отметил высокий спрос на чипы собственной разработки. Если бы компания выделила их производство в отдельный бизнес с продажей чипов как самой AWS, так и сторонним клиентам, то его годовой оборот мог бы составить $50 млрд. Он допустил, что в будущем компания будет продавать их целыми партиями. Джасси также сообщил, что два крупных клиента AWS обратились с просьбой выкупить всю мощность инстансов на Graviton на 2026 год, но компания отклонила эти запросы, и уточнил, что расчётная годовая выручка (Revenue Run Rate, RRR) Amazon на собственных чипах (Graviton, Trainiu, Nitro) составляет $20 млрд. По словам Джасси, 98 % из 1000 крупнейших клиентов EC2 используют чипы Graviton, а мощности ускорителей Trainium2 и Trainium3 «почти полностью зарезервированы». Также уже зарезервирована значительная часть мощностей на базе Trainium4, до массовой доступности которого ещё около 18 мес. Согласно прогнозу Джасси, Trainium сэкономит компании «десятки миллиардов долларов капитальных затрат в год и обеспечит преимущество в несколько сотен базисных пунктов операционной прибыли по сравнению с использованием чипов других компаний для выполнения вычислений». Он также отметил, что, хотя расчётный годовой доход AWS в IV квартале 2025 года составил $142 млрд, 85 % глобальных ИТ-затрат по-прежнему приходится на решения on-premise. «Это изменится», — заявил Джасси. Спустя три года после начала волны развёртывания ИИ, годовой доход AWS (Revenue Run Rate, RRR) от ИИ в I квартале 2026 года превысил $15 млрд и продолжает расти. «И все же у нас по-прежнему есть ограничения по мощности, которые приводят к неудовлетворенному спросу», — говорит гендиректор Amazon. Он сообщил, что AWS будет расти ещё быстрее, если будет обеспечен большим объёмом электроэнергии. В 2025 году AWS получила 3,9 ГВт новых мощностей и намерена удвоить общую подведённую мощность к концу 2027 года. AWS запустила один из крупнейших в мире ИИ-кластеров с около 500 тыс. чипов Trainium2, который будет использоваться ИИ-стартапом Anthropic. А первым из технологических гигантов разрешил использовать собственные чипы вне его инфраструктуры стала Google, благодаря чему Anthropic приобретёт около 1 млн Google TPU v7 (Ironwood) для запуска на контролируемых ею объектах (в Fluidstack). Примерно 400 тыс. чипов компания получит напрямую от Broadcom в составе стоечных систем.

11.04.2026 [20:56], Владимир Мироненко

К 20-летию облака AWS в Amazon S3 появился файловый доступAWS представила новый сервис Amazon S3 Files, который «напрямую соединяет любые вычислительные ресурсы AWS с вашими данными в Amazon S3». Компания отметила, что благодаря новому сервису «Amazon S3 становится первым и единственным облачным объектным хранилищем, обеспечивающим полнофункциональный высокопроизводительный файловый доступ к вашим данным». Хранилище обеспечивает полную семантику ФС (NFS 4.1+) и низкую задержку, при этом ваши данные никогда не покидают S3, подчеркнула компания. Новая функция появилась через 20 лет после запуска облака AWS — именно S3-хранилище стало первым публичным облачным сервисом. Он заработал в марте 2006 года. Объектные хранилища традиционно не используются в HPC-задачах, поскольку обычно требуется POSIX-доступ на чтение и запись отдельных файлов, а не изменение целых объектов и семантика GET/PUT/DELTE. Amazon S3 отдаёт приоритет надёжности и низкой стоимости, в то время как HPC-нагрузкам обычно необходим очень быстрый доступ с низкой задержкой, а цена и надёжность являются второстепенными факторами, пишет HPCwire. S3 Files на базе EFS обеспечивает семантику ФС, такую как согласованность данных при чтении после записи, блокировка файлов и права POSIX в сочетании с масштабируемостью, надёжностью и экономичностью S3. S3 Files уже доступен в 34 регионах AWS. S3 Files интеллектуально преобразует ФС-операции в эффективные S3-запросы. Файловые приложения работают с данными S3 без изменений в коде, ИИ-агенты сохраняют данные и совместно используют их в разных конвейерах, а инструменты и приложения могут работать с файлами в S3 напрямую из любого инстанса, контейнера и функции. S3 Files использует многоуровневое кеширование данных (и метаданных) для снижения задержки доступа (менее 1 мс) и обеспечивает совокупную пропускную способность чтения до нескольких Тбайт/с. Размер файла по умолчанию для автоматического чтения из традиционного S3 составляет 125 Кбайт. Файлы меньшего размера могут оказаться в высокопроизводительном хранилище и стать доступными через NFS, если служба хранения сочтёт это необходимым; пользователи могут изменить этот параметр. Хотя, возможно, S3 Files, не будет таким же быстрым, как Lustre (который также предлагает AWS), это всё равно довольно быстрый файловый доступ. Поставщики файловых хранилищ, такие как NetApp и Qumulo, уже предоставляют комбинированные сервисы файлового и объектного хранения в AWS. Теперь они столкнутся с усилением конкуренции, отметил ресурс Blocks & Files. Например, есть Amazon FSx for NetApp ONTAP, Dell PowerScale for AWS, VAST AI OS и Cloud Native Qumulo (CNQ). Так, CNQ тоже предлагает более 1 Тбайт/с и 1 млн IOPS при использовании стандартных клиентов NFS. Аналитики рассматривают нововведение как стратегический шаг AWS по позиционированию S3 как основного слоя хранения данных для ИИ-агентов и современных приложений, выходящий за рамки традиционного использования ИИ в озерах данных и пакетной аналитике, пишет InfoWorld. Ранее предприятиям, разрабатывающим и развёртывающим агентные системы и другие современные ИИ-приложения, обычно приходилось либо формировать отдельную СХД с файловым доступом, либо создавать слой трансляции для работы с S3-хранилищем, отмечает Pareekh Consulting. S3 Files упростит архитектуру хранения, объединив озёра данных, файловые системы и промежуточные уровни хранения в рамках Amazon S3.

09.04.2026 [11:24], Сергей Карасёв

Uber перенесёт рабочие нагрузки на чипы AWS Graviton и Trainium нового поколенияКомпания Uber сообщила о расширении использования облачной платформы Amazon Web Services (AWS). Оператор сервисов для вызова такси и частных водителей, а также доставки еды и грузов перенесёт определённые нагрузки на чипы AWS Graviton и Trainium нового поколения. Компания уже использует Arm-процессоры Ampere в облаке Oracle. В частности, Uber будет использовать изделия Graviton4, насчитывающие до 96 ядер, для поддержания работы своих зон обслуживания поездок (Trip Serving Zones). Соответствующая инфраструктура функционирует в режиме реального времени: каждый раз, когда пользователь заказывает поездку или доставку, система рассчитывает оптимальный маршрут, выбирает подходящего водителя и определяет время. В часы пик и при проведении крупных мероприятий создаётся огромная вычислительная нагрузка: требуются анализ миллионов возможных сценариев поездок и обработка данных о местоположении пользователей и водителей. Ожидается, что применение Graviton4 позволит сократить задержки и оптимизировать затраты, а также обеспечит необходимую масштабируемость в периоды всплеска запросов без ущерба для надёжности, доступности или безопасности.

Источник изображения: AWS Кроме того, Uber начнёт применять ускорители Trainium3 для обучения некоторых своих ИИ-моделей, которые лежат в основе приложений вызова такси и доставки. Эти изделия оснащены 144 Гбайт памяти HBM3E, а производительность на операциях FP8 достигает 2,52 Пфлопс. ИИ-модели Uber, как отмечается, анализируют данные миллиардов поездок для выбора водителя или курьера, оценки времени прибытия и генерации рекомендаций для пользователей. Обучение ИИ в таком масштабе требует колоссальных вычислительных возможностей: решения Trainium3, как подчёркивается, способны предоставить необходимые ресурсы. «Uber — одно из самых требовательных приложений в мире, работающих в режиме реального времени. Мы помогаем Uber обеспечивать надёжность, на которую рассчитывают сотни миллионов людей, а также внедрять ИИ-функции, определяющие будущее сервисов совместных поездок и доставки по запросу», — говорит Рич Гераффо (Rich Geraffo), вице-президент и управляющий директор AWS в Северной Америке.

03.04.2026 [17:08], Руслан Авдеев

AWS захотела пристроить ещё один ЦОД к АЭСAWS, в своё время задавшая тренд на размещение дата-центров возле АЭС, рассчитывает построить новый кампус ЦОД в непосредственной близости от атомной электростанции Calvert Cliffs Nuclear Power Plant — в округе Калверт (Calvert County) штата Мэриленд, сообщает Datacenter Dynamics. Реализация проекта планируется совместно с энергокомпанией Constellation Energy, уже участвующей в других атомных проектах, связанных с индустрией ЦОД. В 2024 году именно Amazon первой в США попыталась построить ЦОД непосредственно на месте получения энергии, приобретя у Talen Energy гигаваттный кампус около АЭС Susquehanna в Пенсильвании. В сделку входило соглашение, оговаривавшее поставки энергии из Susquehanna напрямую дата-центру, что вызвало протесты местных коммунальных компаний. В результате жалобы регулятору FERC соглашение было заблокировано, так что кампус AWS получает энергию опосредованно. В случае с Calvert Cliffs компания уже провела предварительную проверку, анализ нормативно-правовых актов, оценила площадку и разработала предварительные «эскизы» объекта, но официально разрешение у властей пока не запрашивала. Согласно презентации, кампус может включать до восьми дата-центров к югу и западу от АЭС. Территорию уже зонировали для тяжёлой промышленности. Теперь её придётся резонировать для дата-центров.

Источник изображения: Constellation Energy AWS уже объявляла о планах расширить облачный регион в Северной Вирджинии на штат Мэриленд. В апреле 2025 года компания объявила, что её объекты разместятся в технопарке Quantum Frederick Park компании TPG в Адамстауне, приблизительно в 150 км от округа Калверт. Также планируется проложить трансатлантический кабель Fastnet для связи США и Ирландии. Внимание к территории вблизи АЭС в округе проявляют и другие компании. Так, Natelli Holdings хочет купить участок для четырёх зданий ЦОД, первоначальные инвестиции составят $30 млн. Впрочем, местные жители таким инициативам не слишком рады. Отдельные представители округа предложили немедленно ввести 24-месячный мораторий на «любые согласования, разрешения, резонирование, планы, строительство» и прочие действия, связанные с возведением дата-центров — до того, как общественности будут официально представлены результаты всестороннего экологического исследования, включая оценку воздействия ЦОД на землю, воду и воздух. Сама Amazon параллельно ведёт переговоры о строительстве крупного ЦОД рядом с АЭС Comanche Peak в Техасе, принадлежащей Luminant Generation (Vistra). Также компания намерена построить в Вашингтоне мини-реакторы X-Energy на 960 МВт. Microsoft перезапустит АЭС Three Mile Island (принадлежит Constellation Energy), чтобы обеспечивать электричеством свои ИИ ЦОД в течение 20 лет. Станция заработает даже раньше, чем планировалось. Google намерена перезапустить АЭС Duane Arnold Energy Center (DAEC) в Айове, которая принадлежит NextEra, и пристроить к ней шесть дата-центров. Договор об эксклюзивных поставках электроэнергии с АЭС Clinton Clean Energy Center (Constellation Energy) в Иллинойсе сроком на 20 лет заключила и Meta✴. Также Meta✴ купит у Vistra энергию с АЭС Davis-Besse и Perry (Огайо), и Beaver Valley (Пенсильвания). Проекты сотрудничества операторов ИИ ЦОД с АЭС имеются в Индии и Китае. В России не первый год работает дата-центр «Росатома» вблизи Калининской АЭС. |

|