Материалы по тегу: схд

|

27.04.2026 [21:29], Владимир Мироненко

Попроще и подешевле: YADRO обновила конфигурации TATLIN.AFA и TATLIN.BACKUP на фоне глобального дефицита компонентовКомпания YADRO представила оптимизированные версии СХД TATLIN.AFA и TATLIN.BACKUP, использование которых поможет снизить стоимость хранения данных при, как заявляют разработчики, сохранении ключевых эксплуатационных параметров СХД. YADRO отметила, что представленные конфигурации разработаны в ответ на глобальное удорожание и дефицит компонентов для серверов и СХД. Новые версии TATLIN.AFA и TATLIN.BACKUP расширяют возможности выбора конфигурации под прикладные сценарии и бюджет заказчиков, которым приходится в этих условиях одновременно решать две задачи: обновлять и масштабировать ИТ-инфраструктуру, сохраняя инвестиции в разумных пределах, говорит YADRO. Оптимизированная конфигурация TATLIN.AFA с 1 Тбайт RAM не уступает по производительности флагманской версии с 2 Тбайт, но при этом дешевле. Вместе с тем флагманская версия TATLIN.AFA с 2 Тбайт RAM лучше справляется с дедупликацией благодаря большему объёму памяти. При этом обе конфигурации получат полную функциональность ПО TATLIN 4.0 и 4.1, включая поддержку грядущих технологий онлайн-компрессии данных и асинхронной репликации. Обновлённая конфигурация СХД для резервного копирования TATLIN.BACKUP с 1,5 Тбайт RAM сопоставима по производительности благодаря доработкам в ПО с конфигурацией с 2 Тбайт RAM в малых системах с полезной ёмкостью до 380 Тбайт. Однако для работы с большей дисковой ёмкостью и расширенным набором функций рекомендуется перейти на классическую флагманскую конфигурацию с 2 Тбайт RAM. Функция компрессии данных для TATLIN.AFA и TATLIN.UNIFIED, которая находится на финальной стадии разработки и войдёт в ПО TATLIN 4.1, позволит более эффективно использовать полезную ёмкость систем и дополнительно снизить стоимость хранения данных. Компания сообщила, что технологию уже можно протестировать на реальных данных с помощью эмулятора, доступного по запросу через её коммерческих представителей. YADRO отмечает растущий приоритет для заказчиков стабильности поставок и обслуживания, а также баланса между производительностью и экономической целесообразностью. Компания заранее озаботилась запасами комплектующих и ключевых компонентов для СХД, которых хватит на 2026 год и часть 2027 года.

25.04.2026 [13:55], Сергей Карасёв

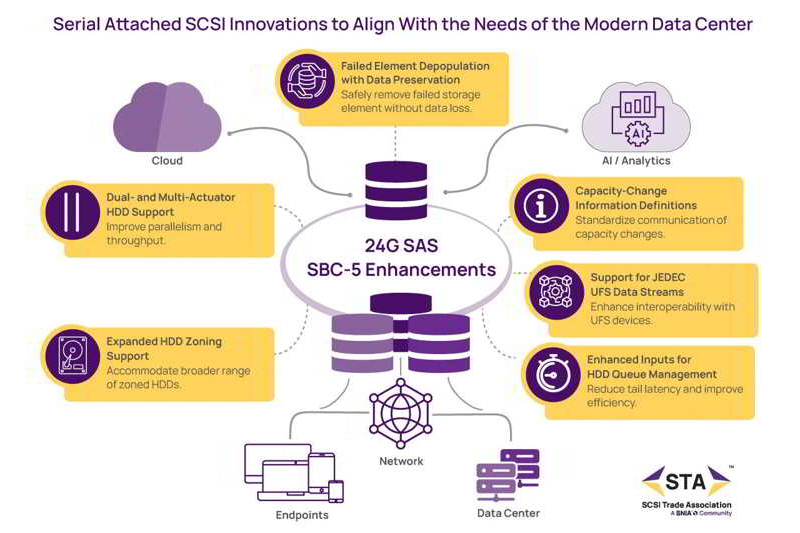

Новая версия набора команд SCSI улучшает масштабируемость и отказоустойчивость СХДТехнический комитет INCITS SCSI (T10), по сообщению ресурса StorageNewsletter, обнародовал пятую версию набора команд SCSI для блочных устройств хранения. Основное внимание в документе SCSI Block Commands — 5 (SBC-5) уделяется улучшению производительности и масштабируемости, а также повышению эффективности и отказоустойчивости сложных СХД. Стандарт является частью экосистемы Serial Attached SCSI (SAS). Одним из ключевых нововведений в SBC-5 стала функция устранения сбойных элементов с сохранением данных. Этот инструмент позволяет игнорировать вышедшую из строя область хранения без переформатирования накопителя и без потери существующей информации. В случае возникновения неполадок устройство предоставляет хосту уменьшенную ёмкость, что позволяет продолжить работу в обычном режиме. Эта функция в настоящее время реализована для HDD, а в перспективе может быть распространена и на SSD.

Источник изображения: StorageNewsletter Ещё одним изменением стала поддержка HDD с двумя и более актуаторами: это позволит повысить пропускную способность в системах с накопителями следующего поколения благодаря многопоточности. Расширены возможности управления очередью привода HDD на стороне хоста: путём оптимизации операций чтения/записи повышается эффективность и снижается задержка. Кроме того, улучшена поддержка зонирования жёстких дисков, выполненных по технологии черепичной магнитной записи (SMR). Усовершенствованы функции определения изменений вместимости в результате технического обслуживания, устранения сбоев или обновления конфигурации. Плюс к этому улучшена совместимость с устройствами Universal Flash Storage (UFS).

25.04.2026 [00:10], Владимир Мироненко

А король-то голый: VDURA уверена, что SSD не вытеснят HDD из ЦОДПо мнению гендиректора VDURA Кена Клаффи (Ken Claffey), рост цен на флеш-память и её дефицит покончили с прогнозами по поводу того, что SSD заменят HDD, подтверждая, что самое верное направление — многоуровневое хранение данных, как у гиперскейлеров, передаёт Blocks & Files. Клаффи в довольно язвительной форме прокомментировал обращение главы поставщика All-Flash СХД Everpure Чарльза Джанкарло (Charles Giancarlo) к клиентам: «Это… тот момент, когда флеш-император прошёлся по городу без одежды». Клаффи исходит из того, что шумиха вокруг неминуемой замены жёстких дисков была неоправданной. В мае 2023 года исполнительный директор Everpure (тогда ещё Pure Storage) предсказал, что после 2028 года HDD больше продаваться не будут из-за затрат на электроэнергию и доступности, а также из-за снижения стоимости NAND в пересчёте на Тбайт. Следует отметить, что с тех пор соотношение цены Гбайт SSD и жёсткого диска выросло с 4–5 раз до 22,6 раза. «Flash-накопитель — подходящий носитель для “горячих” данных, для производительности, для метаданных, для контрольных точек, и так будет всегда. Это критика архитектурного проекта, который ставит все ваши данные на кон против товара, который никогда не будет дешёвым и который люди, создающие проект, никогда не контролировали», — пишет Клаффи. Он считает, что идея Pure о том, что все данные должны храниться на флеш-накопителях, никогда не была верной; «и письмо Everpure, которая повышает цены на 70 % с начала года в дополнение к уже существующей большой разнице, просто сорвало последний фиговый листок. “Флеш-император” голый». Клаффи говорит, что гиперскейлеры никогда не верили в идею полного перехода на флеш-память, имея внутреннее трёхуровневое хранилище: SSD, HDD, LTO. Так устроены Google Colossus, внутренние хранилища Meta✴ и Microsoft Azure, Amazon S3 и большая часть EBS: «Каждый из гиперскейлеров использует программно-определяемую архитектуру со смешанной функциональностью. Достаточный объём NVMe, чтобы справиться с нагрузкой, затем жёсткий диск для всего, что не требует скорости флеш-памяти, и ленточный накопитель для архивов». Клаффи настаивает на том, что флеш-память — это высокопроизводительный носитель данных, а не высокоёмкий, и что ценообразование на инфраструктуру на основе стоимости товара, который вы сами не производите, — это стратегическая ошибка, которую можно совершить только один раз. Никто из поставщиков All-Flash СХД — ни Everpure, ни VAST, ни WEKA — не производит NAND-память, не контролирует её стоимость, поставки и распределение и не определяет её развитие. Флеш-память никогда не была достаточно дешёвой, чтобы заменить жёсткий диск и теперь «не будет дешёвой ещё много лет», говорит Клаффи. Будущее за платформами смешанного типа, с твердотельными накопителями и жёсткими дисками, «разработанными с нуля для использования разнородных носителей как единой системы». «Это архитектурный образец, на котором построены системы хранения данных Google, Meta✴ и Microsoft», а также VDURA, утверждает Клаффи, советуя другим компаниям следовать их примеру.

24.04.2026 [17:34], Владимир Мироненко

Everpure (Pure Storage) пообещала повышать цены в крайнем случае, прогнозируя их рост на многие годыВ связи с продолжающимся ростом цен на память и накопители всех видов компания Everpure (ранее Pure Storage) обратилась к клиентам с заявлением, в котором сообщила, что продолжит придерживаться объявленного в феврале решения сохранять рентабельность продукции на минимальном уровне. Это позволит клиентам частично сократить расходы, пишет The Register. Гендиректор Everpure Чарльз Джанкарло (Charles Giancarlo) сообщил, что с начала года цены компании выросли на 70 %. «Мы ожидаем, что нынешняя ситуация сохранится», — добавил он, предположив, что кризис, вероятно, продлится гораздо дольше, чем перебои в работе в эпоху COVID. Он также добавил, что в течение последних десяти лет компания ежегодно снижала стоимость терабайта примерно на 20 %. В своём письме, которое приводит Blocks & Files, Джанкарло отметил, что в этом году необычайно высокий рост спроса на полупроводниковые компоненты для удовлетворения потребностей ИИ-индустрии намного превзошёл мировые мощности по их производству, что привело к рекордному росту цен на. «Повышение на 70 % может показаться чрезмерным, пока не поймёшь реальность: себестоимость многих важных полупроводниковых компонентов Everpure выросла на 300–900 % (в 4–10 раз) с середины 2025 года», — сообщил Джанкарло. В некоторых случаях поставщики не могли обеспечить заявленные объёмы из-за резкого роста спроса, что вынуждало компанию искать альтернативные источники (и платить больше) для соблюдения обещанных сроков поставки. Гендиректор не исключает, что рост цен может продолжаться «ещё много лет». «Мы не собираемся извлекать выгоду из этого кризиса… мы решили разделить бремя ответственности с нашими клиентами, — сказал Джанкарло. — С этой целью мы стремимся к прозрачности наших цен и последовательности в наших взаимоотношениях с клиентами, партнёрами по каналам сбыта и поставщиками». Everpure сообщила, что какое-то время придерживалась 60–90–дневных квот, поскольку затраты росли, но затем в феврале была вынуждена начать повышать цены и ужесточать условия. Сейчас квоты сократились примерно до 30 дней, поскольку стоимость компонентов и их доступность постоянно меняются.

Источник изображения: Everpure Компания отметила, что в рамках мер по борьбе с повышением цен многие производители и разработчики ПО предложили технологии многоуровневого хранения данных (тиринг), позволяющие снизить затраты на хранение данных в СХД. В их числе Dell, StorONE, VAST Data, NetApp, WEKA, VDURA и т.д. Everpure отметила, не может осуществлять тиринг на диски ни локально, ни в облаке. А поскольку Everpure использует только проприетарные флеш-накопители DFM, она также не может использовать сторонние б/у SSD. У IBM тоже есть проприетарные накопители FlashCore, однако её СХД поддерживает и стандартные накопители. Вместо этого, по словам гендиректора Everpure, компания будет максимально компенсировать рост цен на компоненты и повышать свои цены только в случае крайней необходимости. Everpure также отметила устойчивость своей цепочки поставок, построенной на диверсифицированных источниках и производстве, позиционируя себя как более защищённую от наихудших сбоев, чем конкуренты. О 300-Тбайт накопителях придётся на время забыть, а планы вытеснить HDD из ЦОД — отложить.

24.04.2026 [11:05], Сергей Карасёв

Гибридная СХД TrueNAS V160 обеспечивает пропускную способность до 60 Гбайт/сКомпания TrueNAS (ранее — iXsystems) анонсировала гибридную систему хранения V160, предназначенную для задач ИИ, машинного обучения и работы с базами данных. Новинка позволяет формировать платформы с оптимальным сочетанием производительности и стоимости, что важно в условиях стремительного роста цен на SSD. СХД выполнена в форм-факторе 4U. Применены два контроллера TrueNAS пятого поколения на основе неназванного 32-ядерного процессора AMD EPYC с 768 Гбайт оперативной памяти DDR5 каждый. Доступны 24 отсека для NVMe SSD или SAS HDD вместимостью соответственно до 122,8 Тбайт и 26 Тбайт (7200 об/мин). Система позволяет задействовать до 24 Тбайт адаптивного кеша. Заявленная пропускная способность в зависимости от выбранной конфигурации достигает 60 Гбайт/с. Допускается подключение до шести дисковых полок с NVMe SSD или до четырнадцати полок с SAS HDD на 102 отсека, что позволяет создавать конфигурации, насчитывающие более 1400 накопителей. При использовании исключительно SSD суммарная вместимость может достигать 20 Пбайт, в случае HDD — 35 Пбайт. Сетевые порты имеют следующую конфигурацию: 4 × 100/200GbE, 2 × 400GbE, 4 × FC16, 2 × FC32. Реализована поддержка протоколов SMBv2, SMBv3, NFSv3, NFSv4 w/RDMA, iSCSI, iSER, FC, NVMe-oF/RDMA, S3. Питание обеспечивают два блока с сертификатом 80 Plus Titanium, резервированием и возможностью горячей замены. Заявленная доступность СХД превышает 99,999 %. В качестве программной платформы применяется TrueNAS Enterprise 25.10 (используется файловая система OpenZFS). Доступны файловое, блочное и объектное хранилища со сжатием и дедупликацией. Говорится о совместимости с VMware, Proxmox, Hyper-V, Xen, OpenShift, Kubernetes.

13.04.2026 [22:37], Владимир Мироненко

Lenovo завершила покупку Infinidat, которая оценивается в $500 млнLenovo Group сообщила о завершении приобретения Infinidat, израильского поставщика высокопроизводительных решений для корпоративного хранения данных, о котором было объявлено в январе 2025 года. Это первая сделка Lenovo в Израиле за многие годы. По оценкам экспертов, покупка Infinidat обошлась более чем в $500 млн, хотя ранее капитализация компания достигала $1,6 млрд. Анонсируя сделку, Lenovo сообщила о планах создать местный ЦОД и расширить своё присутствие в Израиле, сигнализируя о долгосрочных планах, выходящих за рамки самой сделки. Компания Infinidat, основанная в 2011 году, разрабатывает высокопроизводительные СХД, используемые в таких областях, как финансовые сервисы, здравоохранение, телекоммуникации и государственный сектор. В ней работает около 500 чел., из них примерно 300 в Израиле. В соответствии с условиями сделки, Infinidat войдёт в качестве бизнес-подразделения в состав группы инфраструктурных решений (Infrastructure Solutions Group, ISG). Сделка, как ожидается, укрепит позиции Lenovo на глобальном рынке корпоративного хранения данных и расширит возможности компании по предоставлению готовой к использованию ИИ-инфраструктуры данных клиентам по всему миру. Как отметил ресурс CTech, приобретение Infinidat отражает более широкий сдвиг в бизнес-модели Lenovo. Компания, некогда известная как крупнейший в мире производитель ПК, неуклонно расширяет портфель инфраструктурных решений. Покупка Infinidat позволит ей укрепить положение в верхнем сегменте корпоративных СХД, где надёжность, производительность и киберустойчивость имеют решающее значение. «С Infinidat мы значительно расширяем наши возможности корпоративного хранения данных и ускоряем предоставление отказоустойчивой, высокопроизводительной инфраструктуры данных, которая обеспечивает работу ИИ, аналитики и критически важных рабочих нагрузок», — заявил президент ISG. Ранее Lenovo провела реструктуризацию ISG, которая обошлась в $285 млн, с целью улучшения структуры затрат этой бизнес-группы. В частности, была проведена «оптимизация продуктового портфеля, повышение квалификации персонала и обеспечение устойчивого повышения производительности». Как ожидается, это обеспечит ежегодную экономию более $200 млн в течение следующих трёх лет и ускорят трансформацию ISG в сторону прибыльного и устойчивого роста. Несмотря на рекордный прирост выручки в последнем квартале, чистая прибыль компании снизилась на 21 % в годовом исчислении, а ISG полтора десятилетия испытывает проблемы с прибыльностью.

13.04.2026 [13:38], Сергей Карасёв

Хранилище Backblaze Storage Pod стало экспонатом Музея компьютерной историиАмериканская компания Backblaze, специализирующаяся на облачном хранении данных и резервном копировании, сообщила о том, что её оригинальная платформа Storage Pod 1.0 стала экспонатом Музея компьютерной истории (Computer History Museum) в Маунтин-Вью (Калифорния, США). Backblaze начала работу в 2007 году. Целью проекта было предоставление неограниченного облачного хранилища для резервных копий за $5/мес. Для снижения стоимости услуг вместо дорогих корпоративных накопителей применялись самые обычные HDD. При этом Backblaze опубликовала спецификации своего оборудования, что позволило другим компаниям и энтузиастам создавать аналогичные серверы. Backblaze отмечает, что частично благодаря её разработкам и открытому подходу к архитектуре СХД появились такие проекты, как Open Compute Project (2011 год) и Netflix Open Connect (2012 год). Вместе с тем фирма Protocase, которая занималась гибкой листового металла и изготовлением деталей для оригинального Storage Pod, на фоне роста спроса на такие услуги создала новую компанию 45Drives. В офисе Backblaze ранее действовал собственный музей оборудования, в котором были представлены системы Storage Pod в различных модификациях, созданных в процессе эволюции платформы. Однако в середине января Backblaze полностью перешла на удалённую работу, поэтому было предложено разместить оригинальную модель Storage Pod в Музее компьютерной истории. Даг Спайсер (Dag Spicer), старший куратор Музея компьютерной истории, говорит, что появление первого продукта Backblaze — системы Storage Pod 1.0 — стало переломным моментом для отрасли облачного хранения. Компания бросила вызов существовавшим тогда проприетарным техническим платформам, снизив стоимость благодаря использованию стандартных компонентов и собственного ПО. «Backblaze поделилась своими разработками со всем миром, положив начало революции в области "открытого оборудования". Компания доказала, что высокоплотные корпоративные хранилища можно создавать при существенно меньших финансовых затратах, нежели чем при использовании традиционных подходов. Для нас большая честь сохранить оригинальный экземпляр Storage Pod», — подчёркивает Спайсер.

11.04.2026 [20:56], Владимир Мироненко

К 20-летию облака AWS в Amazon S3 появился файловый доступAWS представила новый сервис Amazon S3 Files, который «напрямую соединяет любые вычислительные ресурсы AWS с вашими данными в Amazon S3». Компания отметила, что благодаря новому сервису «Amazon S3 становится первым и единственным облачным объектным хранилищем, обеспечивающим полнофункциональный высокопроизводительный файловый доступ к вашим данным». Хранилище обеспечивает полную семантику ФС (NFS 4.1+) и низкую задержку, при этом ваши данные никогда не покидают S3, подчеркнула компания. Новая функция появилась через 20 лет после запуска облака AWS — именно S3-хранилище стало первым публичным облачным сервисом. Он заработал в марте 2006 года. Объектные хранилища традиционно не используются в HPC-задачах, поскольку обычно требуется POSIX-доступ на чтение и запись отдельных файлов, а не изменение целых объектов и семантика GET/PUT/DELTE. Amazon S3 отдаёт приоритет надёжности и низкой стоимости, в то время как HPC-нагрузкам обычно необходим очень быстрый доступ с низкой задержкой, а цена и надёжность являются второстепенными факторами, пишет HPCwire. S3 Files на базе EFS обеспечивает семантику ФС, такую как согласованность данных при чтении после записи, блокировка файлов и права POSIX в сочетании с масштабируемостью, надёжностью и экономичностью S3. S3 Files уже доступен в 34 регионах AWS. S3 Files интеллектуально преобразует ФС-операции в эффективные S3-запросы. Файловые приложения работают с данными S3 без изменений в коде, ИИ-агенты сохраняют данные и совместно используют их в разных конвейерах, а инструменты и приложения могут работать с файлами в S3 напрямую из любого инстанса, контейнера и функции. S3 Files использует многоуровневое кеширование данных (и метаданных) для снижения задержки доступа (менее 1 мс) и обеспечивает совокупную пропускную способность чтения до нескольких Тбайт/с. Размер файла по умолчанию для автоматического чтения из традиционного S3 составляет 125 Кбайт. Файлы меньшего размера могут оказаться в высокопроизводительном хранилище и стать доступными через NFS, если служба хранения сочтёт это необходимым; пользователи могут изменить этот параметр. Хотя, возможно, S3 Files, не будет таким же быстрым, как Lustre (который также предлагает AWS), это всё равно довольно быстрый файловый доступ. Поставщики файловых хранилищ, такие как NetApp и Qumulo, уже предоставляют комбинированные сервисы файлового и объектного хранения в AWS. Теперь они столкнутся с усилением конкуренции, отметил ресурс Blocks & Files. Например, есть Amazon FSx for NetApp ONTAP, Dell PowerScale for AWS, VAST AI OS и Cloud Native Qumulo (CNQ). Так, CNQ тоже предлагает более 1 Тбайт/с и 1 млн IOPS при использовании стандартных клиентов NFS. Аналитики рассматривают нововведение как стратегический шаг AWS по позиционированию S3 как основного слоя хранения данных для ИИ-агентов и современных приложений, выходящий за рамки традиционного использования ИИ в озерах данных и пакетной аналитике, пишет InfoWorld. Ранее предприятиям, разрабатывающим и развёртывающим агентные системы и другие современные ИИ-приложения, обычно приходилось либо формировать отдельную СХД с файловым доступом, либо создавать слой трансляции для работы с S3-хранилищем, отмечает Pareekh Consulting. S3 Files упростит архитектуру хранения, объединив озёра данных, файловые системы и промежуточные уровни хранения в рамках Amazon S3.

10.04.2026 [14:04], Руслан Авдеев

Wasabi купит у Seagate сервис облачного хранения Lyve CloudАмериканская Wasabi Technologies, специализирующаяся на «горячих» облачных хранилищах, купит у Seagate облачное хранилище Lyve Cloud. Это позволит Wasabi укрепить позиции на рынке объектных S3-хранилищ. Сделка обусловлена тем, что клиенты ищут альтернативы традиционным облачным гиперскейлерам, сообщает Silicon Angle. Финансовые условия сделки пока не разглашаются, но уже известно, что Seagate получит долю в капитале Wasabi. Последняя объявила о планах со временем интегрировать Lyve Cloud в основной бизнес Wasabi. Покупка стала свидетельством стратегических изменений как для продавца, так и для покупателя. Оператор облачных хранилищ Wasabi получит в своё распоряжение большую клиентскую базу и дополнительные возможности для масштабирования, а Seagate сможет сосредоточиться на основном бизнесе по выпуску накопителей и СХД, сохранив потенциал роста благодаря получению доли в капитале Wasabi. Кроме того, благодаря инвестициям Seagate у Wasabi появился новый партнёр, поэтому в компании ожидают, что сделка поможет перейти от конкуренции с Seagate к партнёрству. Платформа корпоративного хранения данных Lyve Cloud работает с 2021 года и стремится обеспечить «предсказуемое» ценообразование, безопасность и соответствие отраслевым нормативам. В своё время Seagate построила этот бизнес в ответ на растущий запрос на облачные хранилища с контролируемым ценообразованием, особенно для крупных данных — резервного копирования, аналитики и видео. Компании-клиенты, оперирующие петабайтами данных, всё чаще обращают внимание на возможность «пересмотреть» цены в облаках, особенно схемы оплаты за выгрузку, а также сложные механизмы ценообразования. Провайдеры вроде Wasabi стремятся привлечь их фиксированными ценами и упрощённой тарификацией.

Источник изображения: Wasabi Ожидается, что сделка укрепит позиции Wasabi на рынке резервного копирования и восстановления данных. Обе компании продолжат взаимодействие с компаниями, отвечающими за решения в сфере безопасности, включая Veeam Software, Rubrik и Commvault Systems. Одной из целей сделки называется упрощение операций для клиентов, использующих хранилища нескольких поставщиков одновременно. Инициатива Lyve Cloud — часть более обширного плана Seagate, пытавшейся создать экосистему, связанную со своим оборудованием для хранения данных, в т.ч. патнёрство с поставщиками управляемых сервисов и решений для резервного копирования. С продажей этого бизнеса Seagate фактически отказывается от прямой конкуренции с облачными хранилищами, при этом она сохраняет косвенное участие в бизнесе благодаря доле в капитале. По имеющимся данным, клиенты Lyve Cloud перейдут на платформу Wasabi, управляющей глобальной сетью облачных хранилищ. Акцент делается на совместимость с Amazon S3. По данным Datacenter Dynamics, в начале года Wasabi привлекла $70 млн в раунде акционерного финансирования, доведя капитализацию до $1,8 млрд. Раунд возглавила L2 Point Management, участие также приняли Everpure (ранее Pure Storage) и действующие инвесторы, включая Fidelity Management & Research Company. На тот момент Wasabi заявляла, что финансирование будет использовано на поддержку расширения ИИ-инфраструктуры, масштабирования глобального присутствия и развития продуктового портфолио. В ноябре 2025 года Wasabi представила новый класс облачных хранилищ, оптимизированный для работы с ИИ-моделями и большими объёмами данных, а также запустила новый облачный регион в Сан-Хосе (Калифорния).

04.04.2026 [15:28], Сергей Карасёв

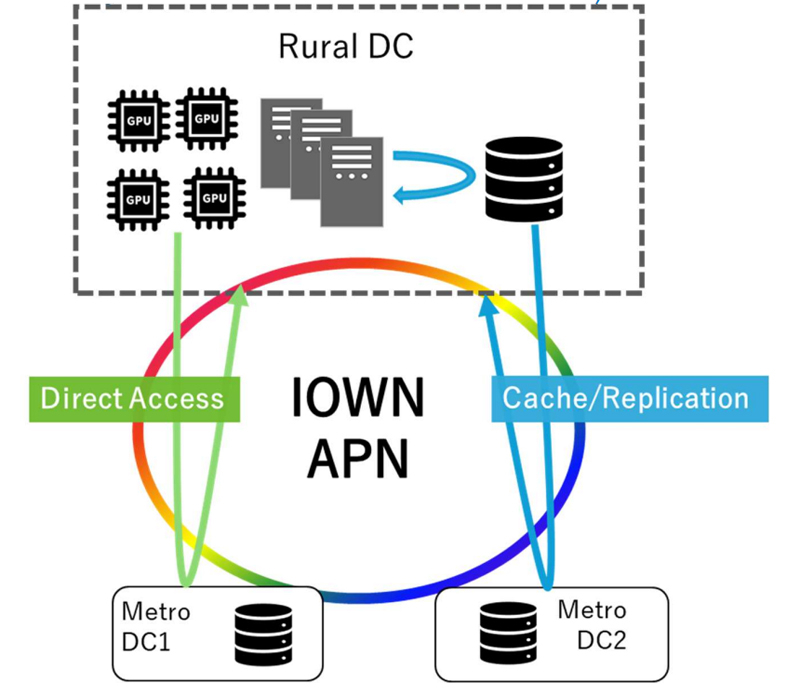

ИИ на селе: NetApp и NTT протестировали геораспределённое обучение LLMМеждународный отраслевой консорциум IOWN (Innovative Optical and Wireless Network Global Forum), по сообщению ресурса Blocks & Files, предложил концепцию геораспределённой вычислительной платформы, предполагающую территориальное разделение дата-центров с массивами GPU-ускорителей и All-Flash СХД. Такое решение, как ожидается, позволит повысить экономическую эффективность обучения масштабных ИИ-моделей. Консорциум IOWN основан в январе 2020 года корпорациями NTT, Intel и Sony. Он занимается разработкой коммуникационной и вычислительной инфраструктуры следующего поколения на основе фотоники. В настоящее время в консорциум входят более 170 компаний и организаций, включая Microsoft, NVIDIA, Cisco, Nokia, Samsung, Fujitsu, KDDI, Orange, Red Hat и др. Участники IOWN указывают, что дефицит и высокая стоимость электроэнергии в городских районах ограничивают возможности по созданию ИИ ЦОД. Вместе с тем данные, необходимые для обучения ИИ, как правило накапливаются и хранятся именно в мегаполисах, и их перемещение в сельскую местность с дешёвой электроэнергией не всегда целесообразно. В качестве решения проблемы IOWN предлагает размещать в удалённых районах дата-центры с GPU, обеспечивая при этом их подключение к площадкам с СХД в городских зонах посредством полностью фотонной сети (APN).

Источник изображения: IOWN Разработанная концепция предусматривает применение одномодового оптоволокна (SMF) с пропускной способностью 100 Гбит/с, а также технологии NFS over RDMA/ТСР. В экспериментальной системе задействованы хранилище NetApp типа All-Flash и большая языковая модель (LLM) Tsuzumi, разработанная японской телекоммуникационной компанией NTT. Благодаря прямому доступу GPU-серверов к хранилищу NetApp время обучения Tsuzumi в геораспределённой системе на базе APN по сравнению с традиционной инфраструктурой повышается менее чем на 1 %. При этом расстояние между удалёнными локациями может достигать 3000 км. Более подробная информация изложена в документе «Green Computing with Remote GPU over APN (tsuzumi-7B)». Отметим, что гиперскейлеры уже перешли к обучению моделей в рамках нескольких разнесённых ЦОД, хотя чаще речь идёт о формировании компактных ИИ-кластеров, а не о географическом разделении хранилищ и вычислительных мощностей. Утверждается, что обычно операторы стараются размещать ЦОД на расстоянии до 60 км, тогда как NetApp и NTT говорят о тысячах километров. |

|